一、研究动机

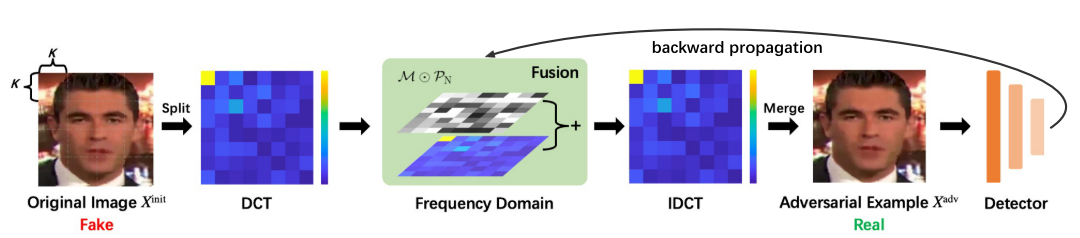

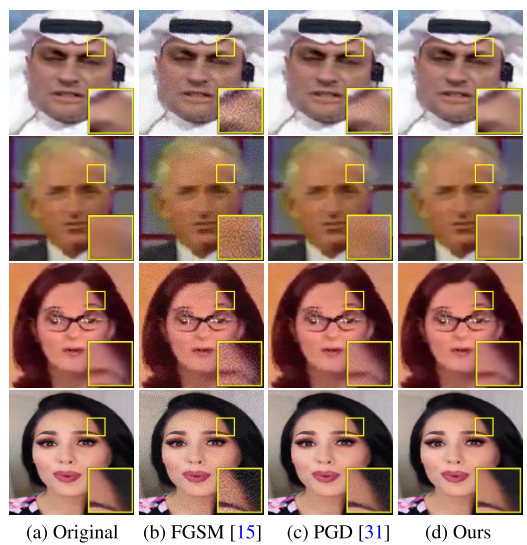

现有的后门攻击方法生成的对抗样本容易被识别,只是在空间域增加了扰动。为此,作者提出了一种频率对抗性攻击的方法,在频域中增加了对抗性的扰动DCT,接着利用融合模块对不同频段的能量进行微调,有效的避免了在空间范围攻击的冗余噪声:FGSM, PGD,最终通过逆变换生成对抗样本。

!NOTE

关键点:空间域和频率域混合攻击,元学习实现交替式的混合攻击学习

攻击模型优点:隐藏在频带中,不易于被发现

❗ 模型缺点: 黑盒攻击存在过拟合现象

!TIP

可学习的点:

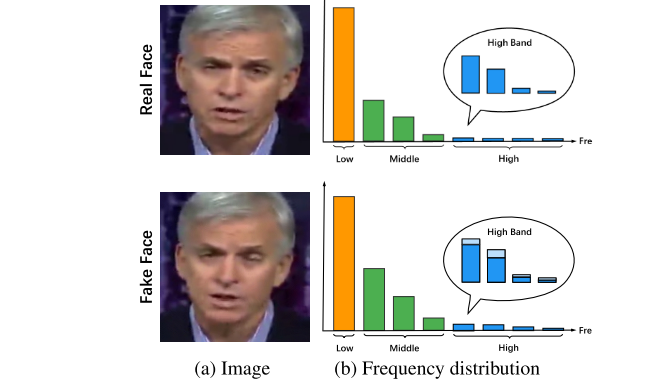

- 低频区域与占大部分能量的图像内容有关,而高频区域与图像的边缘和纹理信息有关。

- 与真脸相比,假脸在高频区域显示出更多的能量

二、模型方法

!NOTE

- FUNSION MODULE:修正频域中的能量

- L p − n o r m L_p-norm Lp−norm :约束分布 (对比其他模型是通过最小化扰动)

-

基于频域的模型攻击

-

混合模式攻击

二、模型方法

!NOTE

- FUNSION MODULE:修正频域中的能量

- L p − n o r m L_p-norm Lp−norm :约束分布 (对比其他模型是通过最小化扰动)

- 基于频域的模型攻击

- 模型的优化目标函数:

-

对图像进行分块,并对每一个块基于离散傅里叶变换(DCT)从空间域转换为频域信息

-

由于伪造图像的高频带比真实图像高,作者提出加入

fusion module修正其中的频带能量,通过一个矩阵动态的自适应学习平衡不平衡能量的影响

- 更新动态矩阵的算法:

- 伪代码

- 混合模式攻击

!TIP

利用

元学习的思想,利用空间域和频域的梯度来迭代更新对抗性样本,每一次更新交换两个域攻击的次序。

PGD模型作为空间域的基底模型

- 伪代码

三、数据与模型

- 对比的攻击模型:

FGSM,PGD- 基础模型框架:

EfficientNet b4,ResNet 50,XceptionNet,F3-Net,LRL

- 基础模型框架:

- 数据:

DFDC:随机选取1000张假图

FaceForensics++:从四种算法中选取 560张假图(140 × \times × 4)

- 评价指标:

攻击成功率:攻击成功的图像在所有被分类为假人脸的图像中所占的比例 - 攻击图像的指标:

MSE,PSNRandSSIM - 图像输入大小 320 \\times320 \\times3

- 将

PGD模作为混合攻击模式下的空间攻击

四、实验

- 在三个基础空间域检测模型(

DFDC,FaceForensics++)的攻击实验

由于Eff b4和Xcep之间结构的明显差异,两个网络之间的对抗性攻击相互之间的可转移性有限。

- 消融实验

-

频域模型的攻击实验

-

图像生成结果及评价

参考文献

- 对抗模型:

- FGSM:简单的梯度损失优化扰动

- PGD:在FGSM基础上的多重扰动