目录

1.算法运行效果图预览

(完整程序运行后无水印)

2.算法运行软件版本

matlab2022a/matlab2024b

3.部分核心程序

(完整版代码包含详细中文注释和操作步骤视频)

.............................................

X = Alpx;

%bilstm

layers=bilstm_layer(bw_in,round(X(1)),round(X(2)),bw_out,X(3),X(4),X(5));

%参数设定

opts = trainingOptions('adam', ...

'MaxEpochs',10, ...

'GradientThreshold',1,...

'ExecutionEnvironment','cpu',...

'InitialLearnRate',X(6), ...

'LearnRateSchedule','piecewise', ...

'LearnRateDropPeriod',2, ...

'LearnRateDropFactor',0.5, ...

'Shuffle','once',...

'SequenceLength',1,...

'MiniBatchSize',64,...

'Verbose',1);

%网络训练

[net1,INFO] = trainNetwork(Xtrain,Ytrain,layers,opts);

Rmsev = INFO.TrainingRMSE;

figure;

plot(Rmsev)

xlabel('训练次数');

ylabel('RMSE');

%预测

for i = 1:length(Xtest)

Ypred(i) = net1.predict(Xtest(i));

end

figure

plot(Ypred,'r-')

hold on

plot(Ytest','b-')

legend('预测值','实际值')

xlabel('时间(s)')

ylabel('负荷(KW)')

rmse = mean((Ypred(:)-Ytest(:)).^2);% 计算均方根误差

title(sprintf('GWO-biLSTM分析-RMSE=%.3f', rmse));

save R3.mat Ypred Ytest rmse Rmsev

2094.算法理论概述

在GWO算法中,灰狼被分为四类:α(领头狼)、β(第二领导者)、δ(第三领导者)以及普通狼(Ω)。在每次迭代中,这些角色对应于当前种群中适应度最好的三个解以及其余的解。通过模拟这些狼在捕食过程中的协作与竞争,算法逐步向全局最优解靠近.

1.数据预处理:对时间序列数据进行归一化处理,使其取值范围在(0,1)之间。

2.初始化种群:随机生成一组种群,每个个体代表一组网络参数。

3.计算适应度值:对于每个个体,将其对应的网络参数代入 CNN-LSTM-SAM 网络中,对训练数据进行预测,并计算预测结果与真实值之间的误差,作为该个体的适应度值。

4.更新个体信息。

5.重复步骤 3 和 4,直到满足停止条件(如达到最大迭代次数或适应度值小于某个阈值)。

6.输出最优网络参数:将全局最优位置对应的网络参数作为最优网络参数,代入BiLSTM网络中,对测试数据进行预测,得到最终的预测结果。

在序列预测问题中,如气象数据预测、交通流量预测等,准确捕捉序列中的长期依赖关系和上下文信息是关键。双向长短期记忆网络(BiLSTM)能有效处理长序列数据,同时考虑序列的过去和未来信息,但BiLSTM的性能受其参数设置的影响较大。粒子群优化算法(PSO)是一种基于群体智能的优化算法,具有全局搜索能力强、收敛速度快等优点。将PSO应用于BiLSTM的参数优化,可以提高BiLSTM的序列预测性能。

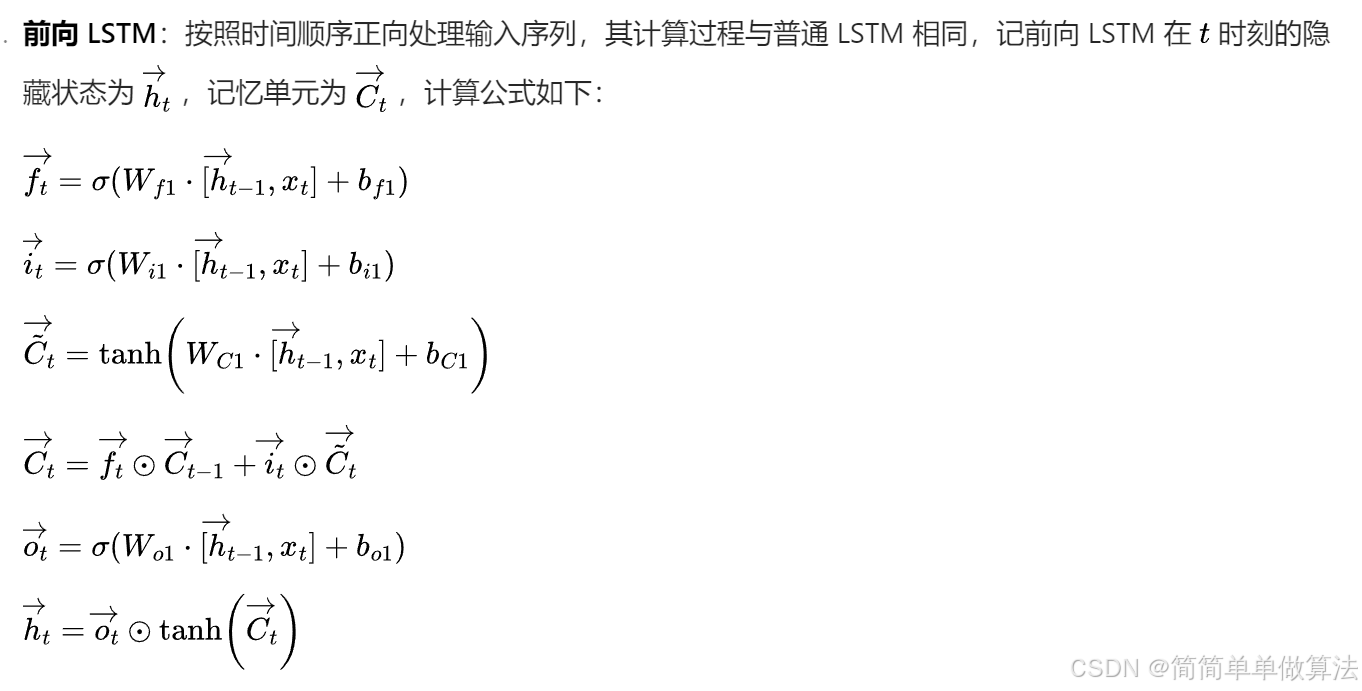

LSTM是一种特殊的循环神经网络(RNN),旨在解决传统RNN在处理长序列时的梯度消失和梯度爆炸问题,从而更好地捕捉长序列中的长期依赖关系。其核心结构包含输入门、遗忘门、输出门以及记忆单元。

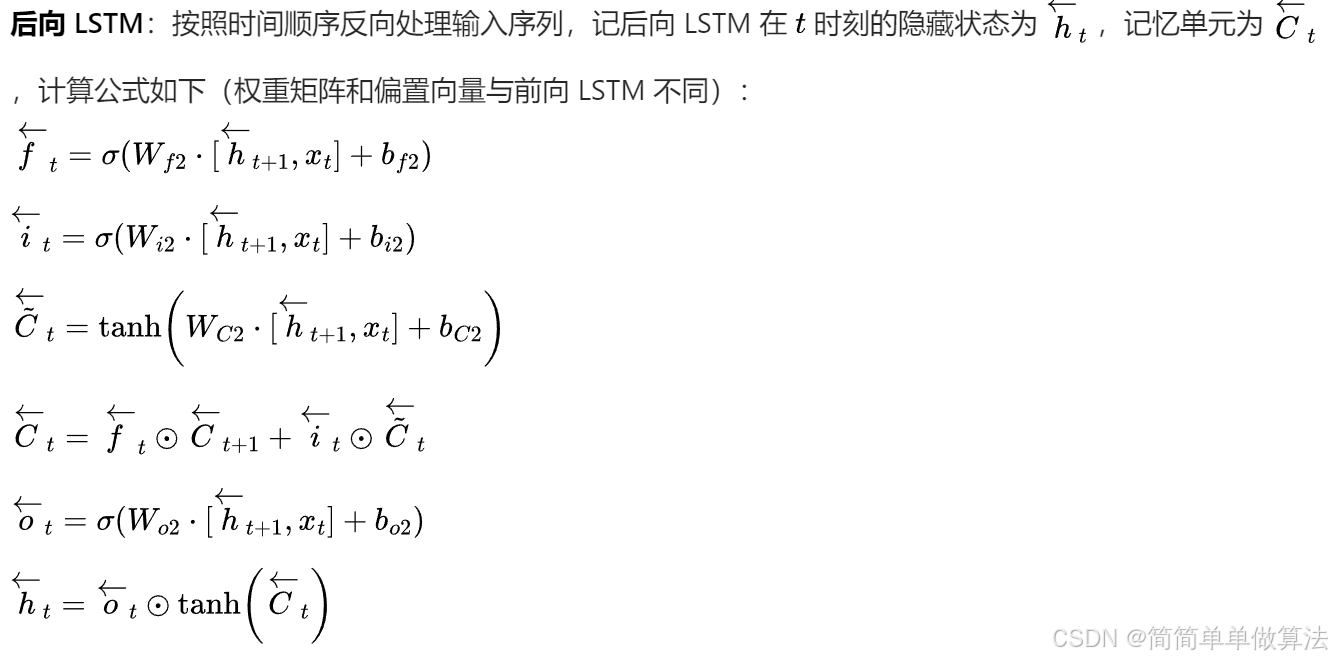

BiLSTM 是在LSTM基础上发展而来,它通过同时向前和向后处理序列,能够更好地捕捉序列中的前后文信息,从而在序列预测任务中表现更优。BiLSTM由一个前向LSTM和一个后向LSTM 组成。

5.算法完整程序工程

OOOOO

OOO

O