目录

[1. 深度学习(Deep Learning)](#1. 深度学习(Deep Learning))

[1.1 深度学习的基本概念](#1.1 深度学习的基本概念)

[1.2 深度学习的数学原理](#1.2 深度学习的数学原理)

[1.3 深度学习的特点](#1.3 深度学习的特点)

[1.4 深度学习在大模型中的应用](#1.4 深度学习在大模型中的应用)

[2. 宽度学习(Wide Learning)](#2. 宽度学习(Wide Learning))

[2.1 宽度学习的基本概念](#2.1 宽度学习的基本概念)

[2.3 宽度学习的应用](#2.3 宽度学习的应用)

[3. 持续学习(Continual Learning)](#3. 持续学习(Continual Learning))

[3.1 持续学习的基本概念](#3.1 持续学习的基本概念)

[3.2 持续学习的数学原理](#3.2 持续学习的数学原理)

[3.3 持续学习的应用](#3.3 持续学习的应用)

[4. 终身学习(Lifelong Learning)](#4. 终身学习(Lifelong Learning))

[4.1 终身学习的基本概念](#4.1 终身学习的基本概念)

[4.2 终身学习的数学原理](#4.2 终身学习的数学原理)

[4.3 终身学习的应用](#4.3 终身学习的应用)

[5. 总结](#5. 总结)

引言:

随着人工智能(AI)技术的飞速发展,深度学习(Deep Learning) 、宽度学习(Wide Learning) 、**持续学习(Continual Learning)和终身学习(Lifelong Learning)**逐渐成为重要的研究方向。这四种学习方式在不同场景下各有优势,并且在当前的大规模人工智能模型(如GPT-4、DALL·E 3、CLIP等)中得到了广泛应用。

为了更清晰地理解它们的区别,我们不仅需要从概念上理解,还要深入分析它们的数学原理、技术方法以及实际应用。本文将系统性地探讨这四种学习方式,并通过表格进行比较,以更直观地展示它们的异同点。

1. 深度学习(Deep Learning)

1.1 深度学习的基本概念

深度学习是机器学习的一个重要分支,核心思想是使用多层神经网络 模拟人脑的认知过程,以自动学习数据特征,并用于模式识别、预测和决策。深度学习的关键特点包括:

- 端到端学习(End-to-End Learning):从原始数据到最终预测结果,全过程由模型自动学习,不需要人工设计特征。

- 层级化特征提取 :每一层神经网络学习不同层次的特征:

- 浅层提取基本特征,如边缘、颜色等(适用于图像)。

- 深层学习高级抽象特征,如人脸、文字结构等。

深度学习的应用极为广泛,包括自然语言处理(NLP)、计算机视觉(CV)、语音识别(ASR)、自动驾驶、游戏AI等。

1.2 深度学习的数学原理

深度学习依赖神经网络(Neural Networks )进行计算,其核心是前向传播(Forward Propagation)和反向传播(Backpropagation)。

-

前向传播

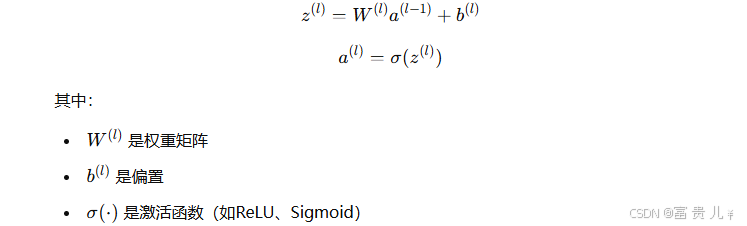

- 计算每一层神经元的激活值:

-

反向传播

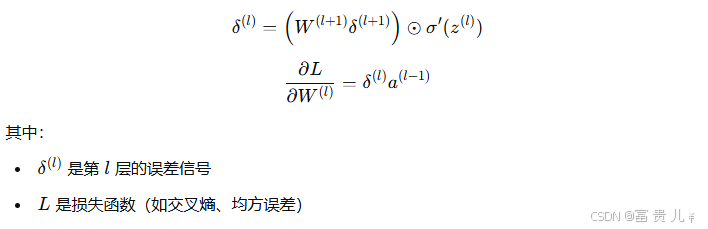

- 计算损失函数对参数的梯度,并更新权重

1.3 深度学习的特点

- 层次化特征学习:深度学习自动学习数据的层级特征。

- 端到端训练:从输入到输出,模型可以整体优化。

- 非线性映射能力强:通过多层非线性激活函数,深度学习能够逼近复杂函数。

1.4 深度学习在大模型中的应用

| 应用领域 | 相关模型 | 作用 |

|---|---|---|

| 自然语言处理 | GPT-4, BERT | 语言生成、问答 |

| 计算机视觉 | ResNet, ViT | 图像分类、目标检测 |

| 语音识别 | DeepSpeech, Wav2Vec | 语音到文本转换 |

2. 宽度学习(Wide Learning)

2.1 宽度学习的基本概念

宽度学习主要关注横向扩展神经网络的结构,即增加神经元的数量,而非增加层数。其核心思想是:

- 通过更宽的隐藏层,提高模型的特征表达能力。

- 增强并行计算效率,减少计算深度带来的梯度消失问题。

2.2宽度学习的原理

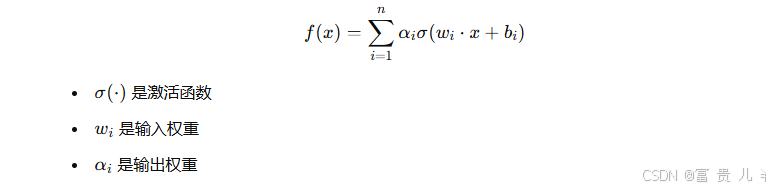

宽度学习(Wide Learning)关注增加神经元的数量 ,其核心数学原理是通用逼近定理(Universal Approximation Theorem),它指出:

- 浅层但宽的神经网络可以逼近任意连续函数:

2.3 宽度学习的应用

| 应用领域 | 相关模型 | 作用 |

|---|---|---|

| 推荐系统 | Wide & Deep Learning | 结合记忆和泛化能力 |

| 图像分类 | CLIP | 多模态特征学习 |

| 目标检测 | YOLO | 提高特征捕捉能力 |

3. 持续学习(Continual Learning)

3.1 持续学习的基本概念

持续学习指的是让模型在不断学习新知识的同时,不遗忘旧知识 。其核心挑战是灾难性遗忘(Catastrophic Forgetting),即模型在训练新任务时,会丢失原有任务的知识。

3.2 持续学习的数学原理

为了缓解灾难性遗忘,常见方法包括:

-

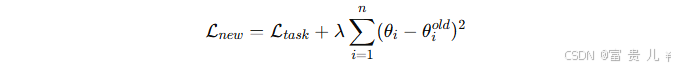

参数正则化(Elastic Weight Consolidation, EWC)

- 通过增加损失函数中的正则项,减少旧任务参数变化:

回放机制(Experience Replay)

- 存储部分旧任务数据,在新任务训练时混合使用,避免遗忘。

3.3 持续学习的应用

| 应用领域 | 相关模型 | 作用 |

|---|---|---|

| AI 语音助手 | ChatGPT, Siri | 记住用户偏好 |

| 自动驾驶 | Tesla FSD | 适应新环境 |

| 搜索引擎 | Bing Chat | 记住上下文信息 |

4. 终身学习(Lifelong Learning)

4.1 终身学习的基本概念

终身学习强调知识的长期积累和自主进化,核心目标是让AI具备:

- 自适应进化:可以长期适应环境变化。

- 知识整合:结合不同领域的知识,提高泛化能力。

4.2 终身学习的数学原理

终身学习依赖:

- 记忆增强神经网络(MANN)

- 元学习(Meta-Learning)

- 知识蒸馏(Knowledge Distillation)

4.3 终身学习的应用

| 应用领域 | 相关模型 | 作用 |

|---|---|---|

| AI 助手 | Personal AI | 记录长期偏好 |

| 智能医疗 | IBM Watson | 终身学习医学知识 |

5. 总结

| 特性 | 深度学习 | 宽度学习 | 持续学习 | 终身学习 |

|---|---|---|---|---|

| 学习方式 | 逐层加深 | 增加神经元 | 逐步适应 | 长期累积 |

| 适用场景 | 静态任务 | 并行计算 | 动态环境 | 长期进化 |

这四种学习方法相互补充,使得大模型在不断进化中更加智能,最终向通用人工智能(AGI)迈进。