数据读取与格式转换

读取JSON数据:使用Spark提供的读取接口(如 spark.read.json() ,在不同编程语言接口下使用方式类似)将给定的JSON格式数据读入Spark中,形成 DataFrame 。

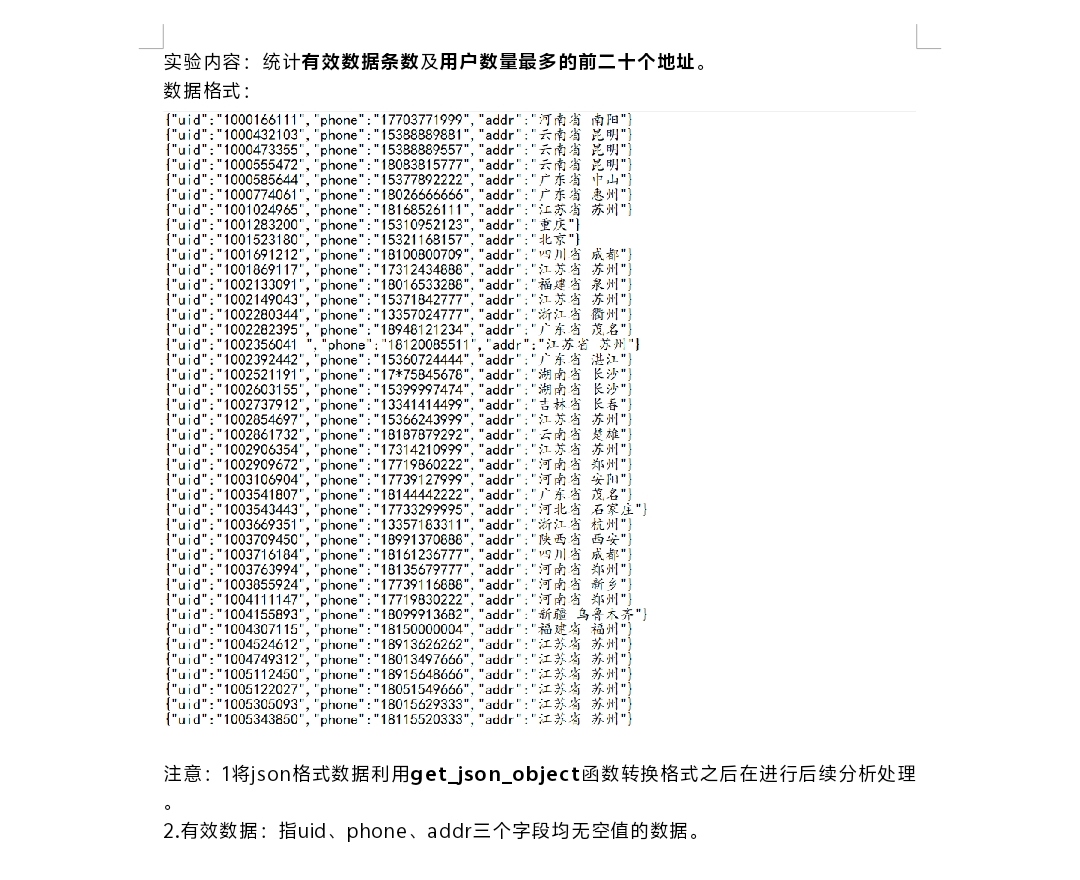

格式转换:按照题目要求,利用 get_json_object 函数(如果是在SQL语句中操作,在不同语言中使用该函数的语法略有差异)对JSON格式数据进行格式转换,以便后续分析处理。

统计有效数据条数

筛选有效数据:依据有效数据的定义( uid 、 phone 、 addr 三个字段均无空值 ),使用过滤条件(如 filter 函数 )筛选出满足条件的数据行。

统计数量:对筛选后的有效数据,调用 count 函数统计其记录条数。

统计用户数量最多的前二十个地址

分组聚合:以 addr 字段为分组依据,使用 groupBy 函数对有效数据进行分组,然后通过 count 函数统计每个地址对应的用户数量(即记录数)。

排序与筛选:根据统计出的用户数量,使用排序函数(如 orderBy ,并按降序排列)对地址进行排序,最后使用 limit 函数选取用户数量最多的前二十个地址 。