随着人工智能技术的快速发展,大语言模型如ChatGPT和DeepSeek在科研领域展现出强大的潜力,尤其是在论文撰写方面。本文旨在介绍如何利用ChatGPT和DeepSeek提升科研论文撰写的效率与质量,并提供一个具体案例,详细阐述其技术流程及公式、代码的应用。

整体科研流程

1. 文献调研与选题

-

利用ChatGPT进行文献筛选:通过输入研究领域和关键词,ChatGPT可以快速生成一系列相关文献列表,并根据文献摘要进行初步筛选。

-

DeepSeek辅助文献泛读与精读:利用DeepSeek的深度解析能力,对筛选出的文献进行深入阅读,提取关键信息和创新点,为论文选题提供依据。

2. 论文框架构建

-

ChatGPT生成论文框架:根据研究目的和内容,ChatGPT可以生成论文的基本框架,包括引言、方法、结果、讨论等部分。

-

DeepSeek优化框架细节:通过DeepSeek对框架进行细化,确保各部分逻辑清晰、衔接紧密。

3. 内容撰写与润色

-

ChatGPT撰写初稿:基于研究数据和结果,ChatGPT可以生成论文初稿,包括引言、方法描述、结果展示等。

-

DeepSeek润色与修改:利用DeepSeek对初稿进行润色,修正语法错误、提升表达流畅度,并根据审稿人意见进行针对性修改。

4. 公式推导与代码实现

-

ChatGPT辅助公式推导:在理论推导部分,ChatGPT可以提供公式推导的思路和步骤,帮助研究者快速完成复杂公式的推导。

-

DeepSeek与Python融合实现代码:对于涉及编程的部分,DeepSeek可以与Python结合,自动生成代码框架,并根据研究需求进行微调。

5. 论文投稿与反馈处理

-

ChatGPT辅助投稿信撰写:利用ChatGPT生成投稿信,包括研究亮点、创新点及投稿理由等。

-

DeepSeek处理审稿意见:根据审稿人的反馈,DeepSeek可以帮助研究者快速整理意见,并提供修改建议,提高论文接受率。

技术流程及公式、代码讲解

数据预处理

-

步骤:使用Python进行数据清洗、归一化等操作。

-

代码示例 :

python

import pandas as pd

from sklearn.preprocessing import MinMaxScaler`

读取数据`

data = pd.read_csv('stock_data.csv')`

数据清洗`

data.dropna(inplace=True)`

特征选择`

features = ['Open', 'High', 'Low', 'Close', 'Volume']

X = data[features]

y = data['Adj Close'].shift(-1) # 下一个交易日的收盘价作为标签`

归一化`

scaler = MinMaxScaler()

X_scaled = scaler.fit_transform(X)

特征提取

-

步骤:利用ChatGPT和DeepSeek生成特征提取的思路和代码框架。

-

示例代码 :

python

from sklearn.decomposition import PCA`

主成分分析(PCA)`

pca = PCA(n_components=5) # 提取5个主成分

X_pca = pca.fit_transform(X_scaled)

模型构建与训练

-

步骤:选择LSTM模型进行时间序列预测,利用DeepSeek与Python融合生成代码框架。

-

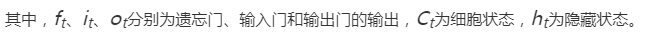

模型公式 :LSTM模型的核心是遗忘门、输入门和输出门的计算,具体公式如下:

f_t = \sigma(W_f \cdot h_{t-1}, x_t] + b_f)

]

i_t = \sigma(W_i \cdot h_{t-1}, x_t] + b_i)

]

\tilde{C}*t = \tanh(W_C \cdot h* {t-1}, x_t + b_C)

]

C_t = f_t * C_{t-1} + i_t * \tilde{C}t

]

o_t = \sigma(W_o \cdot h {t-1}, x_t] + b_o)]

h_t = o_t * \tanh(C_t)

]

-

代码示例:

python

import torch

import torch.nn as nnclassLSTMModel(nn.Module):

def__init__(self, input_size, hidden_size, num_layers, output_size):

super(LSTMModel, self).__init__()

self.hidden_size = hidden_size

self.num_layers = num_layers

self.lstm = nn.LSTM(input_size, hidden_size, num_layers, batch_first=True)

self.fc = nn.Linear(hidden_size, output_size)defforward(self, x):

h0 = torch.zeros(self.num_layers, x.size(0), self.hidden_size).to(x.device)

c0 = torch.zeros(self.num_layers, x.size(0), self.hidden_size).to(x.device)

out, _ = self.lstm(x, (h0, c0))

out = self.fc(out[:, -1, :])

return out`

模型参数`

input_size = X_pca.shape]

hidden_size = 50

num_layers = 2

output_size = 1model = LSTMModel(input_size, hidden_size, num_layers, output_size)

criterion = nn.MSELoss()

optimizer = torch.optim.Adam(model.parameters(), lr=0.001)`

模型训练`

for epoch inrange(100):

model.train()

outputs = model(torch.tensor(X_pca, dtype=torch.float32))

loss = criterion(outputs, torch.tensor(y.values:], dtype=torch.float32))

optimizer.zero_grad()

loss.backward()

optimizer.step()

if (epoch+1) % 10 == 0:

print(f'Epoch [{epoch+1}/100], Loss: {loss.item():.4f}') -

更多大语言应用技术推荐阅读:ChatGPT、DeepSeek等大语言模型助力论文与项目撰写、数据分析、机器学习与深度学习建模