1、修改Ollama服务配置文件

执行命令

bash

sudo vim /etc/systemd/system/ollama.service[Unit]

Description=Ollama Service

After=network-online.target

[Service]

ExecStart=/usr/local/bin/ollama serve

User=ollama

Group=ollama

Restart=always

RestartSec=3

Environment="PATH=/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/usr/local/games:/snap/bin"

Environment="OLLAMA_HOST=0.0.0.0:11434"

Environment="OLLAMA_ORIGINS=*"

[Install]

WantedBy=default.target增加

Environment="OLLAMA_HOST=0.0.0.0:11434"

Environment="OLLAMA_ORIGINS=*"配置完成后,需要重新加载:

bash

sudo systemctl daemon-reload然后重启Ollama服务

bash

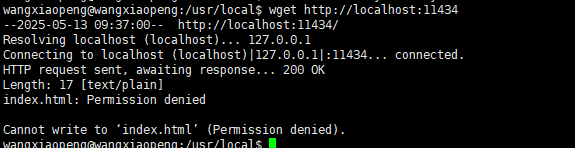

systemctl restart ollama重启后可以使用http://ip:11434来访问服务。

如果服务器可以访问 ,远程访问被拒绝,请检查端口是否开放。这里不去说明端口开放的步骤了。

接下来就可以使用接口来调用对应的模型了