华为云Flexus+DeepSeek征文 | 基于Dify构建具备联网搜索能力的知识库问答助手

- 一、构建知识库问答助手引言

- 二、构建知识库问答助手环境

-

- [2.1 基于FlexusX实例的Dify平台](#2.1 基于FlexusX实例的Dify平台)

- [2.2 基于MaaS的模型API商用服务](#2.2 基于MaaS的模型API商用服务)

- 三、构建知识库问答助手实战

-

- [3.1 配置Dify环境](#3.1 配置Dify环境)

- [3.2 创建知识库问答助手](#3.2 创建知识库问答助手)

- [3.3 使用知识库问答助手](#3.3 使用知识库问答助手)

- 四、总结

一、构建知识库问答助手引言

知识库问答助手是融合人工智能技术与结构化知识管理的智能系统,通过自然语言处理(NLP)和检索增强生成(RAG)技术,实现高效精准的问答服务。它能解析用户自然语言提问,从企业文档、产品手册等知识源中快速定位信息,并结合大模型生成简明易懂的答案。

DeepSeek-R1作为一款性能卓越的开源大语言模型,在数学推理(MATH 500第一)和代码生成(LiveCodeBench第一)等场景表现突出,特别适合处理复杂的多轮对话场景。而Dify作为同样开源的生成式AI应用开发平台,提供了可视化编排界面和丰富的功能模块,使开发者无需编写复杂代码即可快速构建AI应用。

DeepSeek-R1与Dify的结合为企业提供了零代码开发、高性能推理、知识增强和显著成本优势的一站式智能客服解决方案:通过Dify可视化界面3分钟即可搭建应用,DeepSeek-R1在多步骤逻辑问题处理上比传统方案快5-10倍,结合RAG技术可关联企业私有文档提升回答准确性,同时华为云FlexusX + 华为云ModelArts Studio 为项目的稳定高效的运行提供可靠的基础,还让用户更省钱!

二、构建知识库问答助手环境

2.1 基于FlexusX实例的Dify平台

华为云FlexusX实例提供高性价比的云服务器,按需选择资源规格、支持自动扩展,减少资源闲置,优化成本投入,并且首创大模型QoS保障,智能全域调度,算力分配长稳态运行,一直加速一直快,用于搭建Dify-LLM应用开发平台。

Dify是一个能力丰富的开源AI应用开发平台,为大型语言模型(LLM)应用的开发而设计。它巧妙地结合了后端即服务(Backend as Service)和LLMOps的理念,提供了一套易用的界面和API,加速了开发者构建可扩展的生成式AI应用的过程。

参考:华为云Flexus+DeepSeek征文 | 基于FlexusX单机一键部署社区版Dify-LLM应用开发平台教程

2.2 基于MaaS的模型API商用服务

MaaS预置服务的商用服务为企业用户提供高性能、高可用的推理API服务,支持按Token用量计费的模式。该服务适用于需要商用级稳定性、更高调用频次和专业支持的场景。

参考:华为云Flexus+DeepSeek征文 | 基于ModelArts Studio开通和使用DeepSeek-V3/R1商用服务教程

三、构建知识库问答助手实战

3.1 配置Dify环境

输出管理员的邮箱和密码,登录基于FlexusX部署好的Dify网站

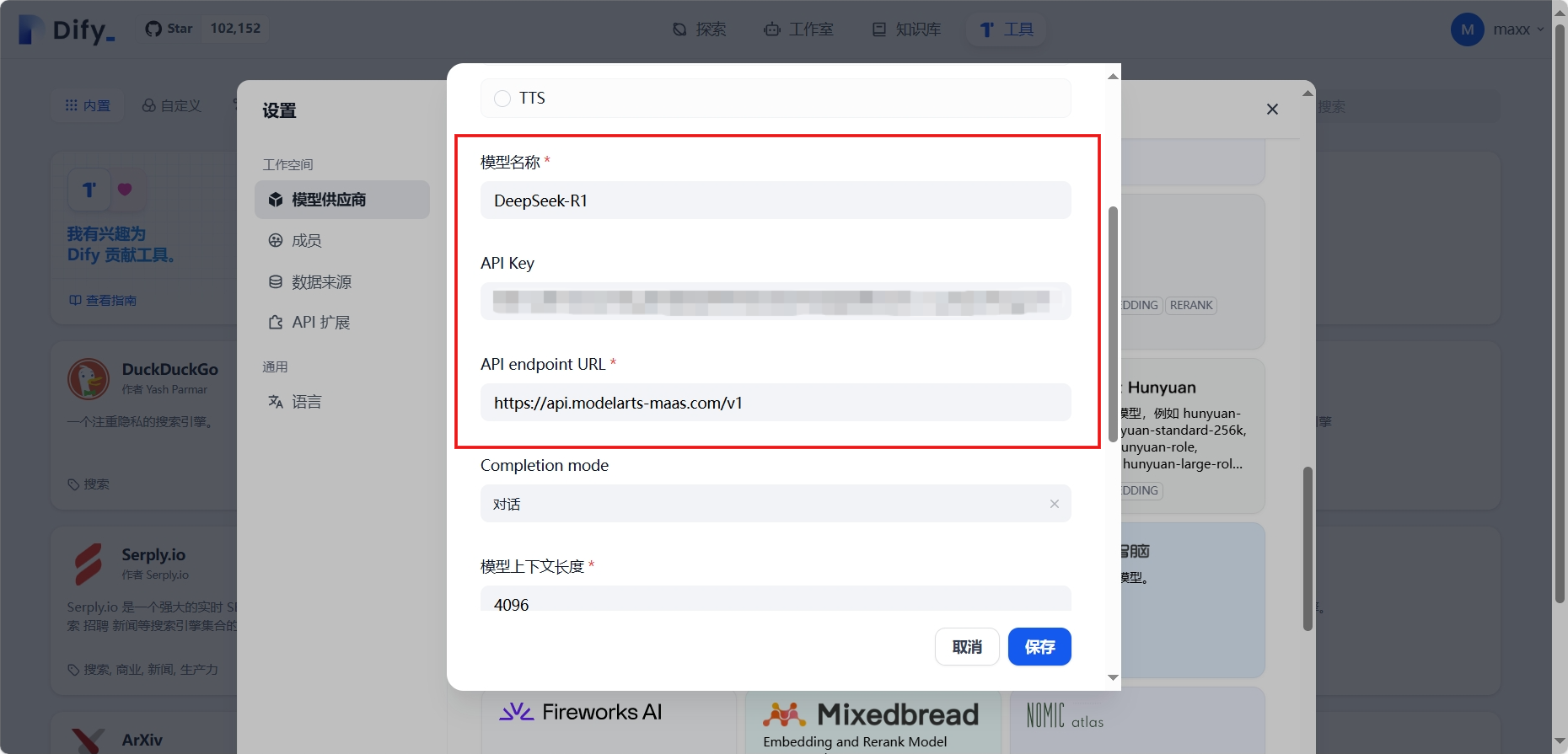

将MaaS平台的模型服务接入Dify,这里我们选择的是DeepSeek R1商用服务,需要记住调用说明中的接口信息和 API Key 管理中API Key,若没有可以重新创建即可

配置Dify模型供应商:设置 - 模型供应商 - 找到OpenAI-API-compatible供应商并单击添加模型,在添加 OpenAI-API-compatible对话框,配置相关参数,然后单击保存

| 参数 | 说明 |

|---|---|

| 模型类型 | 选择LLM。 |

| 模型名称 | 填入模型名称。 |

| API Key | 填入创建的API Key。 |

| API Endpoint URL | 填入获取的MaaS服务的基础API地址,需要去掉地址尾部的"/chat/completions"后填入 |

3.2 创建知识库问答助手

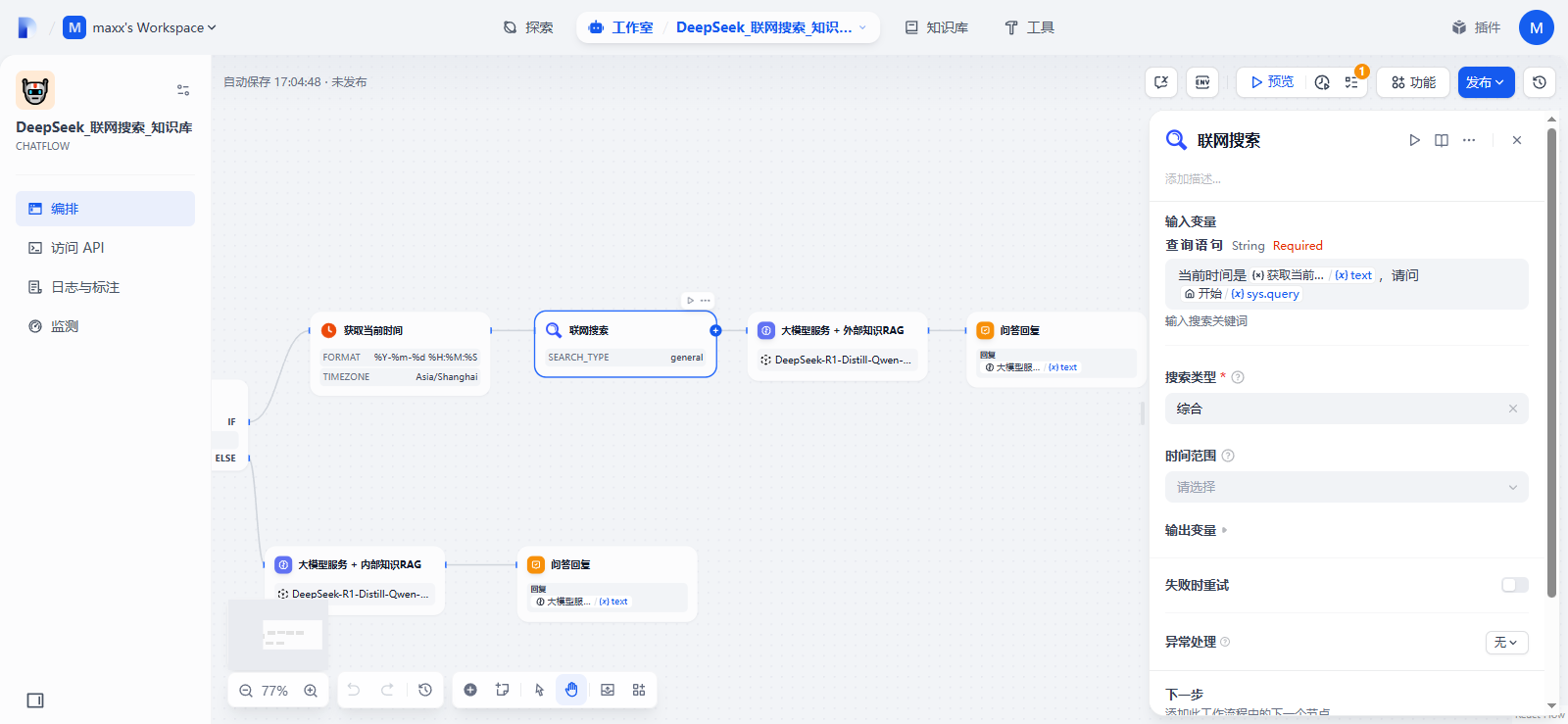

导入工作流

xml

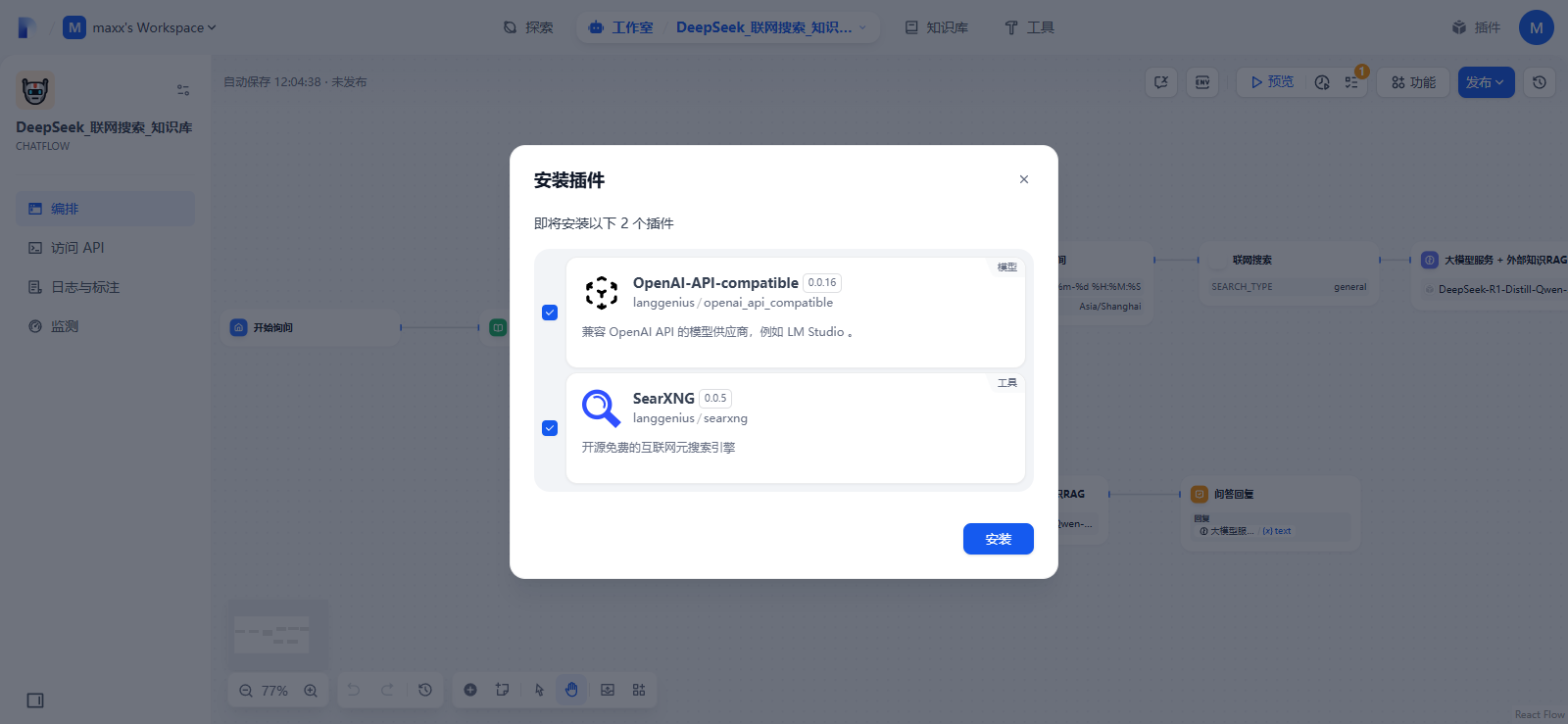

https://documentation-samples.obs.cn-north-4.myhuaweicloud.com/solution-as-code-publicbucket/solution-as-code-moudle/building-a-dify-llm-application-development-platform/workflow/DeepSeek_%E8%81%94%E7%BD%91%E6%90%9C%E7%B4%A2_%E7%9F%A5%E8%AF%86%E5%BA%93.yml安装插件,安装完成后关闭窗口

选择联网搜索插件,点击授权按钮,并添加url:http://{内网ip}:8081,保存授权即可

需要自行部署SearXNG服务,若出现

403 Forbidden报错,则在/etc/searxng/settings.yml的search.formats,添加json

bash

formats:

- html

- json本地部署searxng:https://docs.dify.ai/zh-hans/guides/tools/tool-configuration/searxng

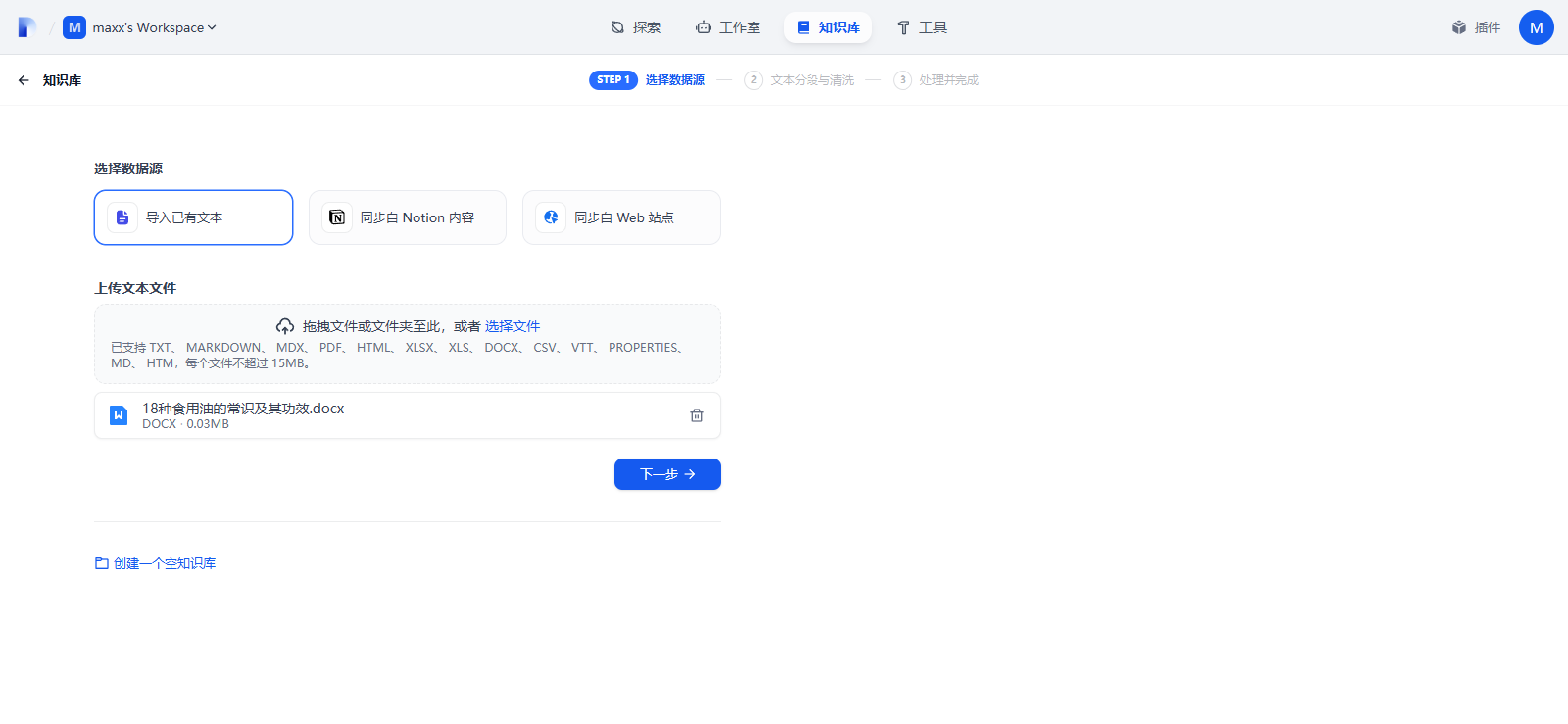

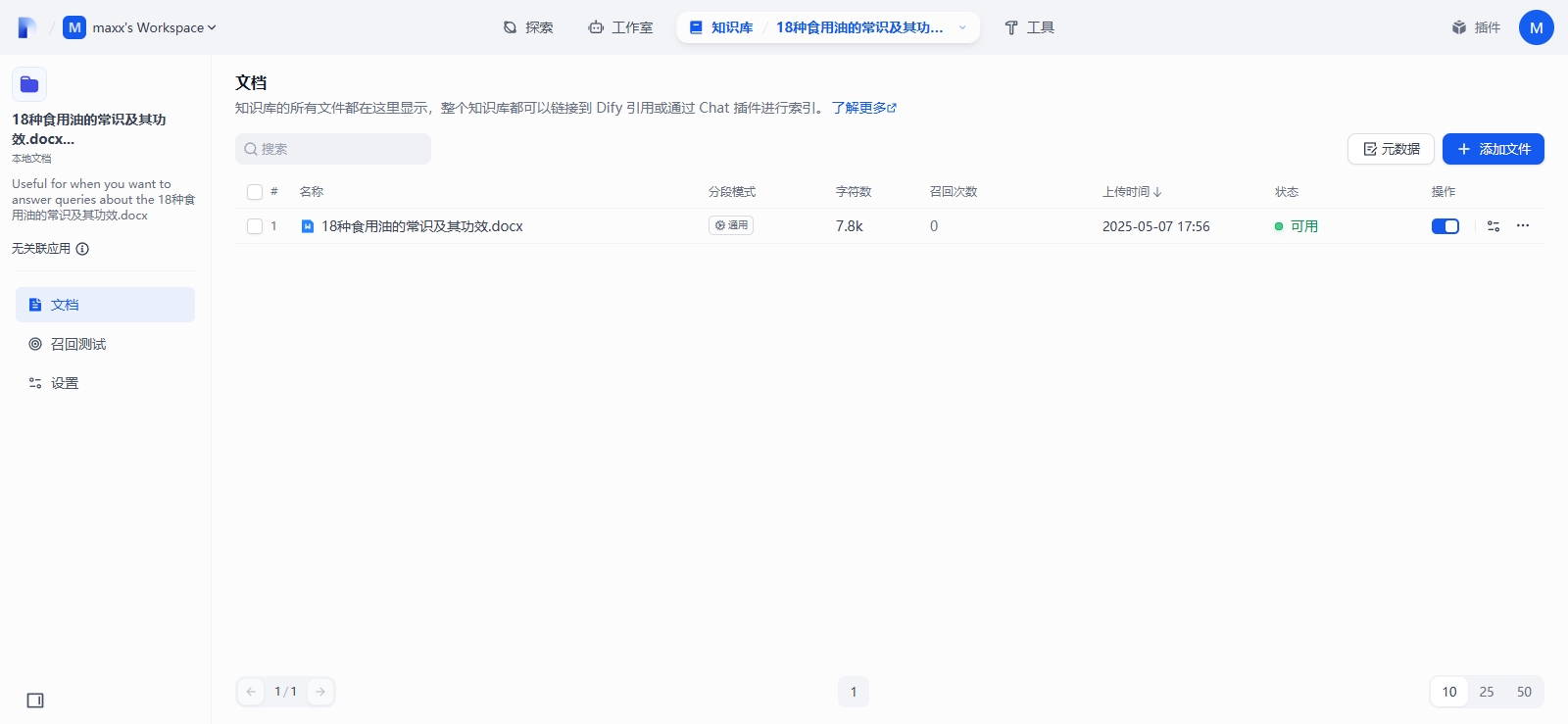

创建知识库:导入已有文本

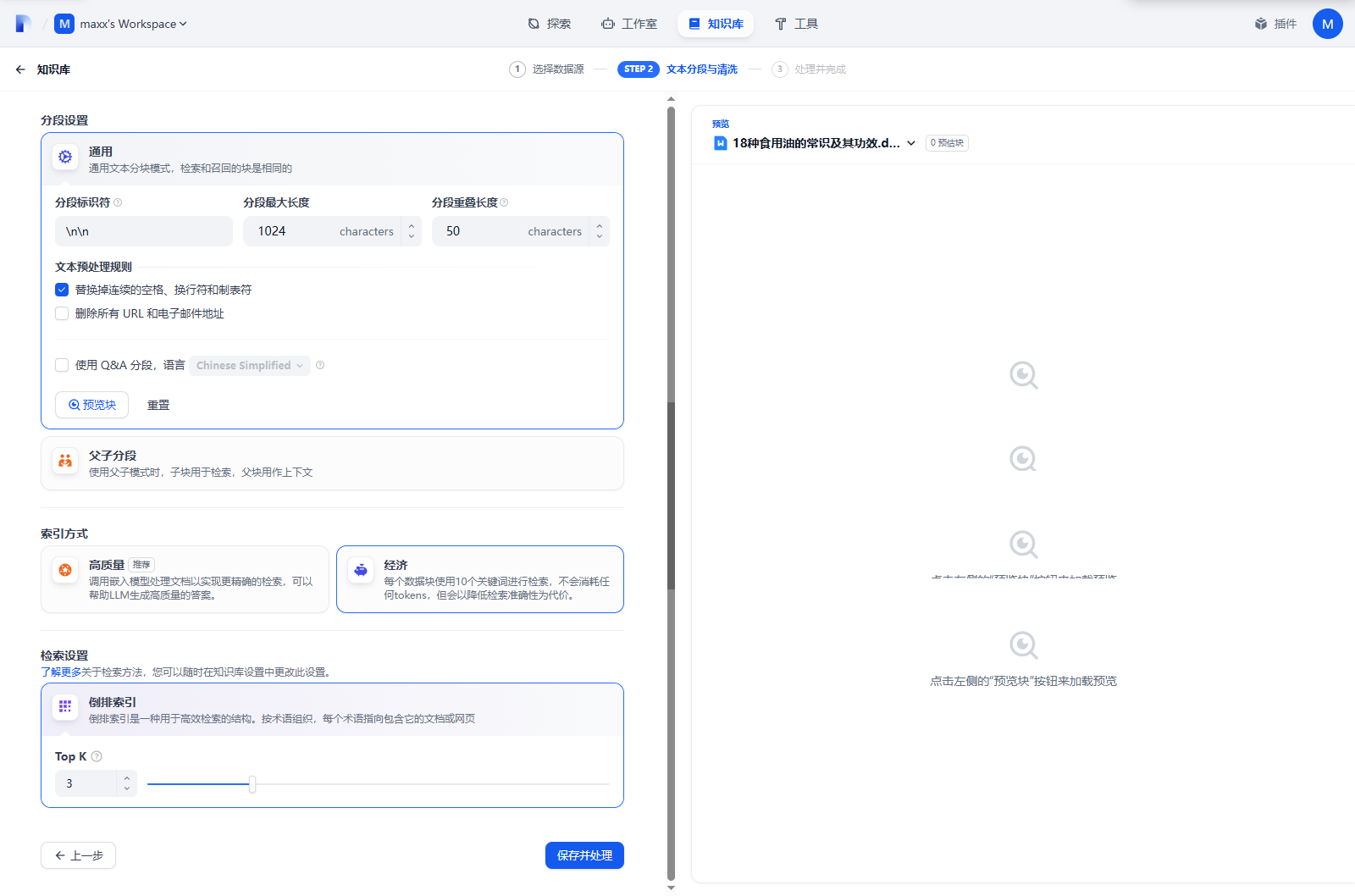

文本分段与清洗本示例保持默认配置不变,索引方式:经济

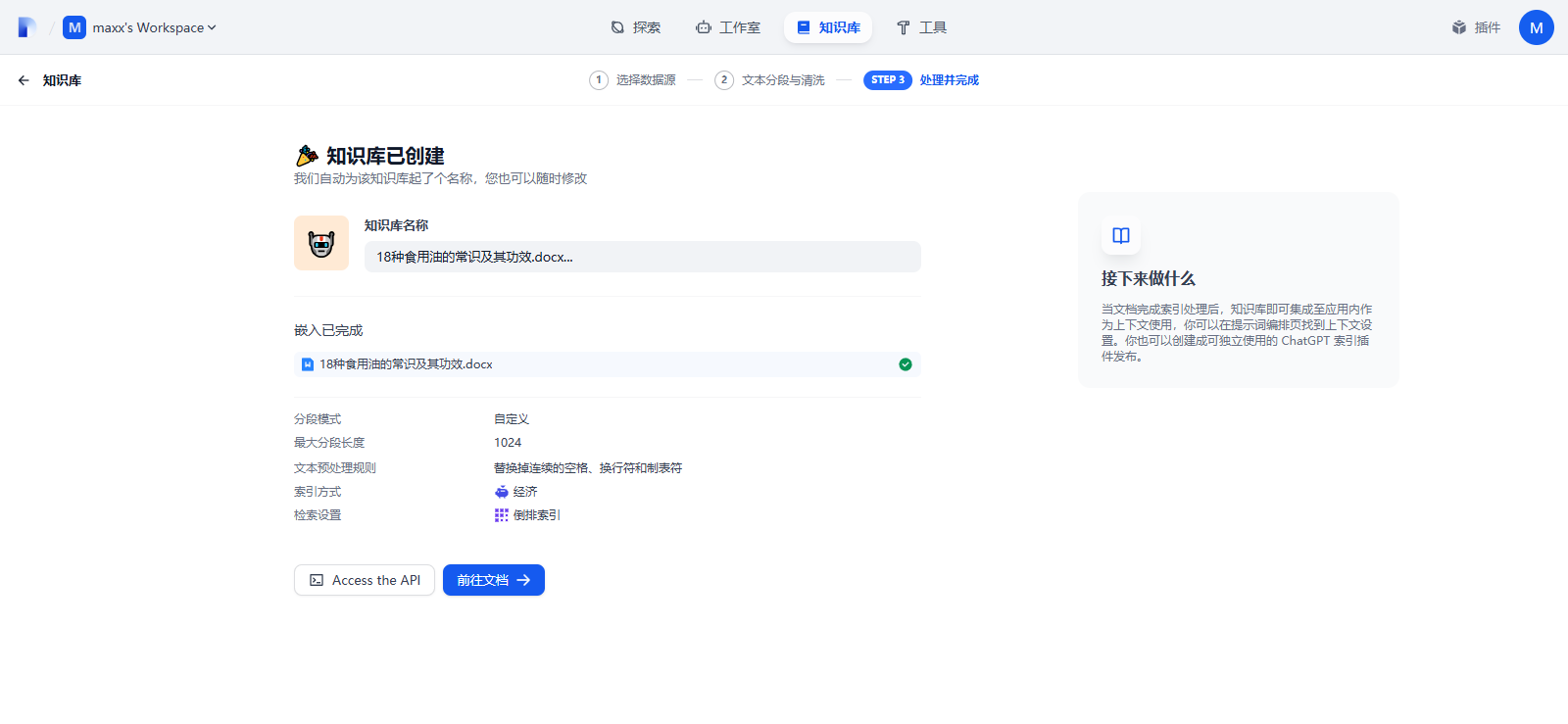

等待文件索引完成,知识库已创建

导入的知识库文档为可用状态

3.3 使用知识库问答助手

未命中

输出结果

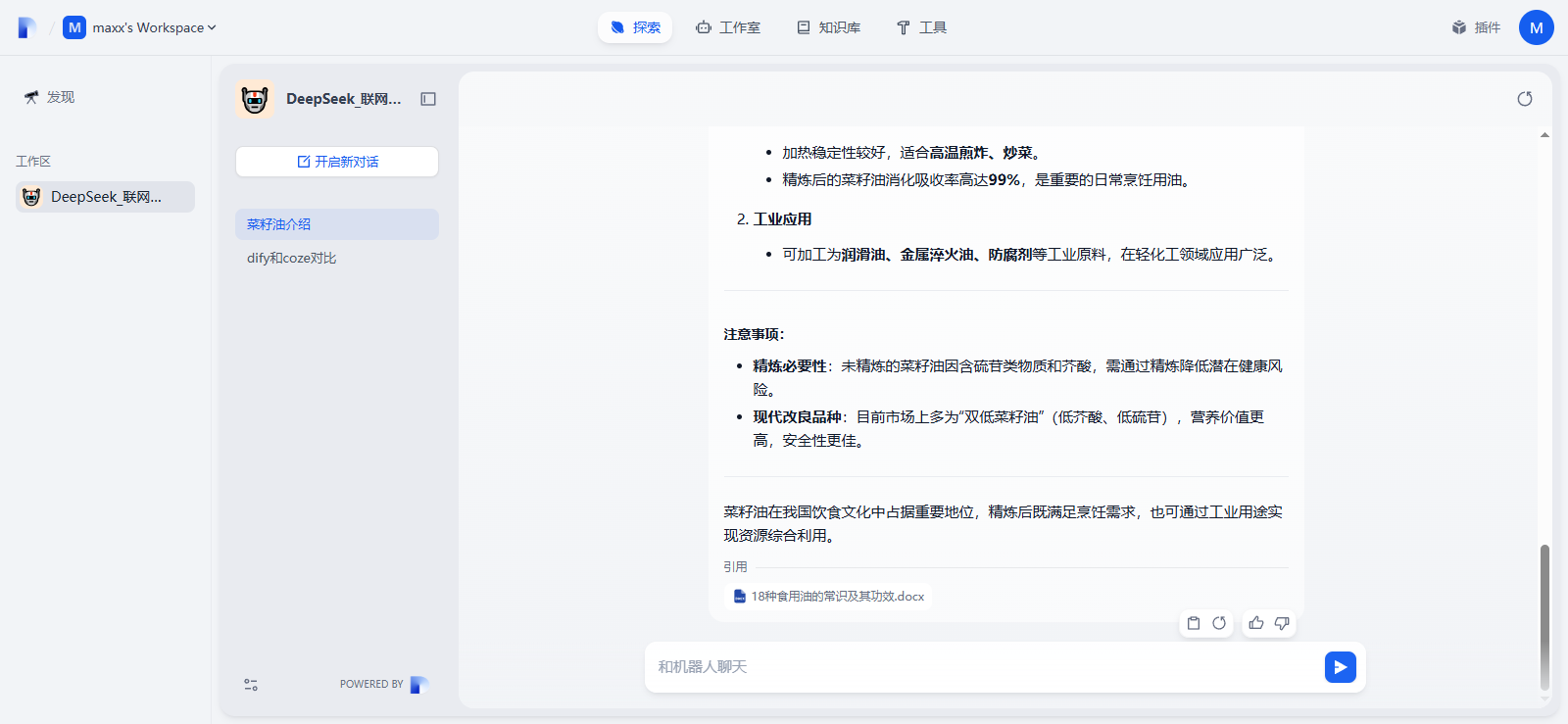

命中

输出结果

四、总结

基于Dify构建具备联网搜索能力的知识库问答助手,通过云端部署Dify平台,结合华为云MaaS提供的大模型(如DeepSeek),并配置向量数据库实现混合检索(语义+关键词)。用户上传文档后,系统自动进行文本分段、向量化处理,通过RAG技术增强生成答案的准确性。同时,集成联网搜索模块可实时获取外部信息,弥补知识库的时效性局限。该方案适用于企业知识管理、个人知识库检索等场景,兼顾数据安全与智能交互需求。

华为云Flexus X云服务器通过柔性算力技术实现CPU/内存灵活配比,结合X-Turbo加速使关键应用性能达业界6倍;MaaS平台提供高性能DeepSeek-R1等API服务,支持200万免费Token及商用级稳定调用,两者协同为企业提供高性能、高可靠的智能化云服务解决方案。