一、ollama准备

1.官网下载ollama:https://ollama.com/download

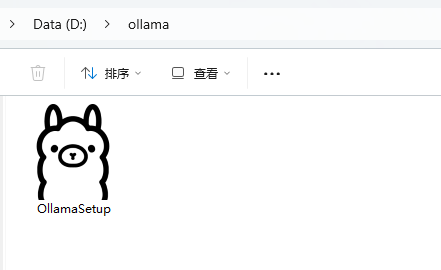

2.在 d 盘创建 ollama 文件夹,把软件包放进去

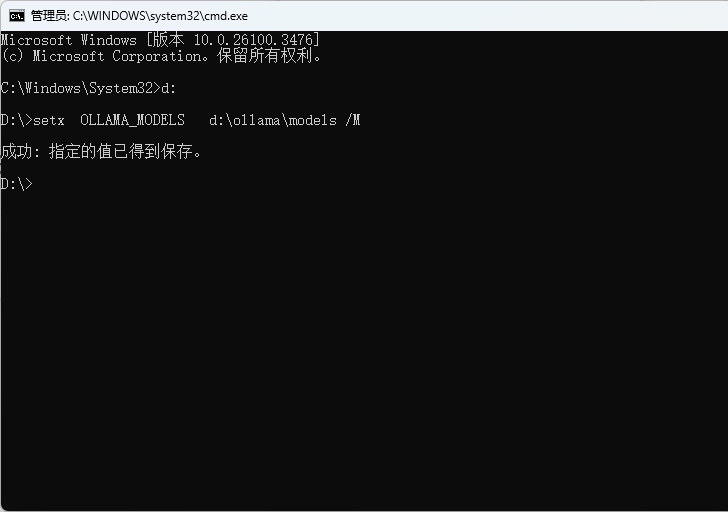

3.管理员身份运行黑窗口

win + r 弹出运行窗口

输入 cmd 后, ctrl + shift + 回车,以管理员身份打开

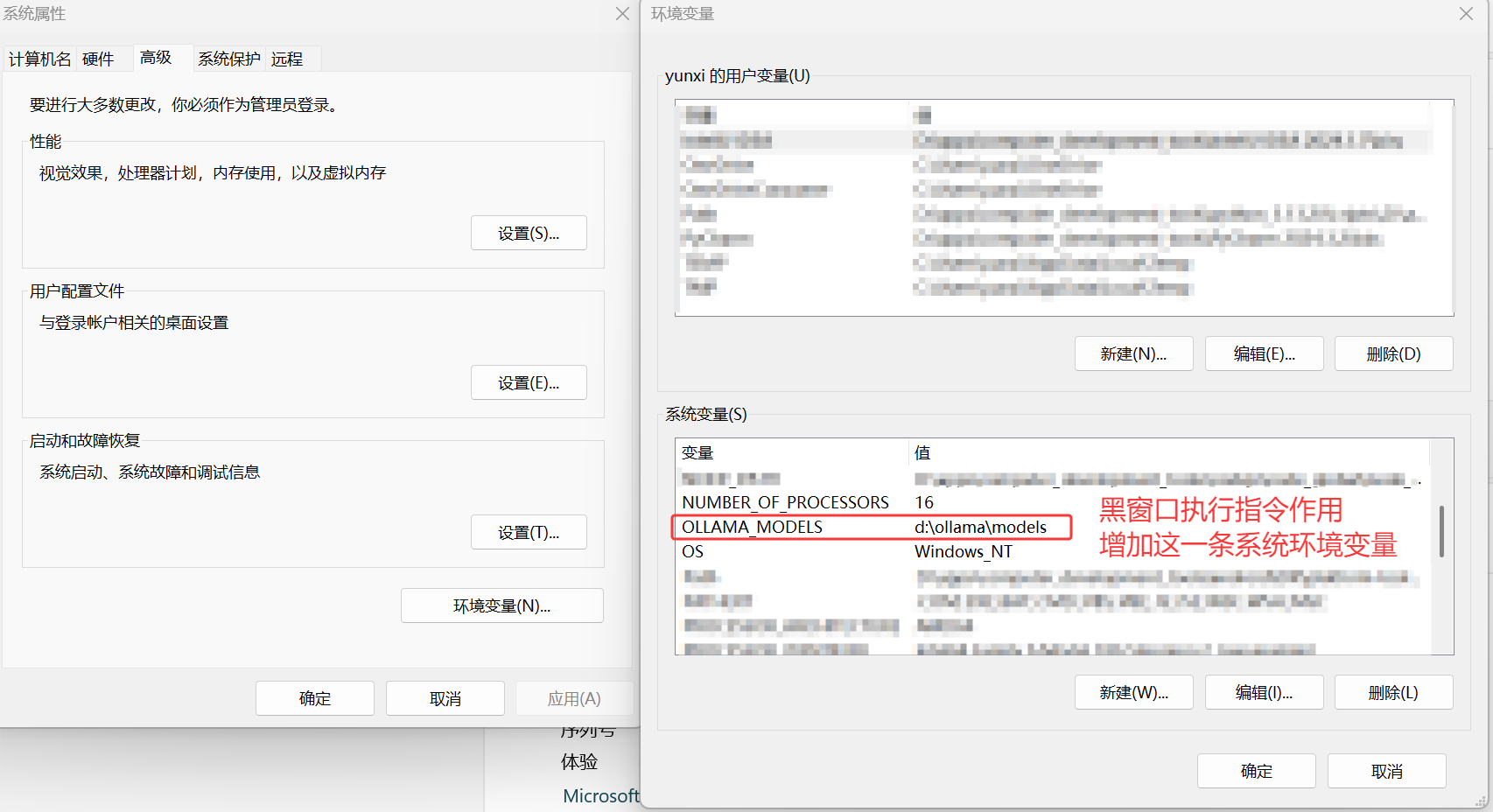

3.切换到 d 盘,添加系统环境变量(如果直接运行安装文件,模型文件会自动保存在C盘。时间久了,C盘很容易存满)

d: 回车

setx OLLAMA_MODELS d:\ollama\models /M

(OLLAMA_MODELS: 环境变量名称,d:\ollama\models: 变量值,/M: 创建的是系统环境变量)

作用展示:

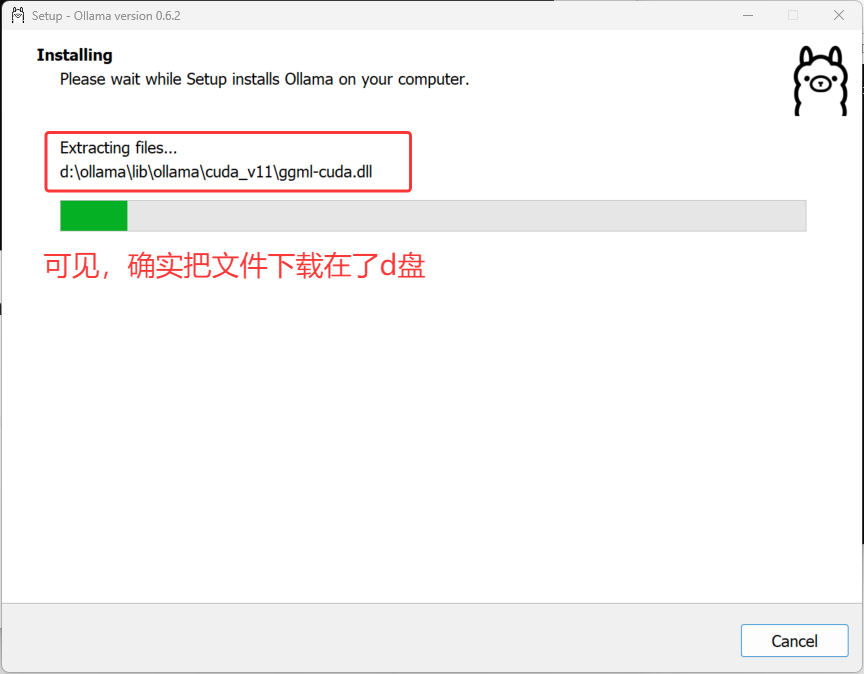

4.切换到 ollama 目录,安装ollama程序到指定目录

cd ollama

ollamaSetup.exe /dir=d:\ollama

在弹出的安装界面中,点 Install 后, 等待完成

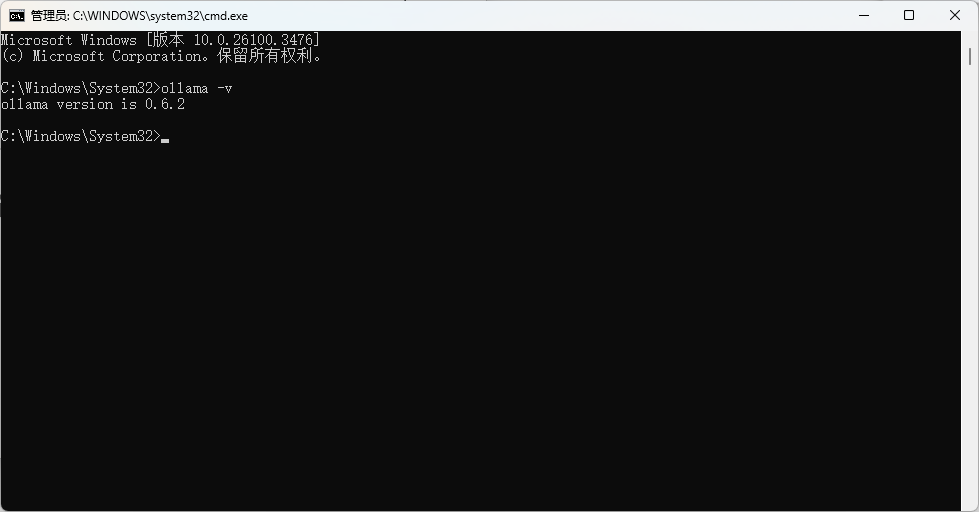

5.关闭原来的 CMD,打开一个新的 CMD,让配置生效,并查看ollama是否安装成功

ollama -v

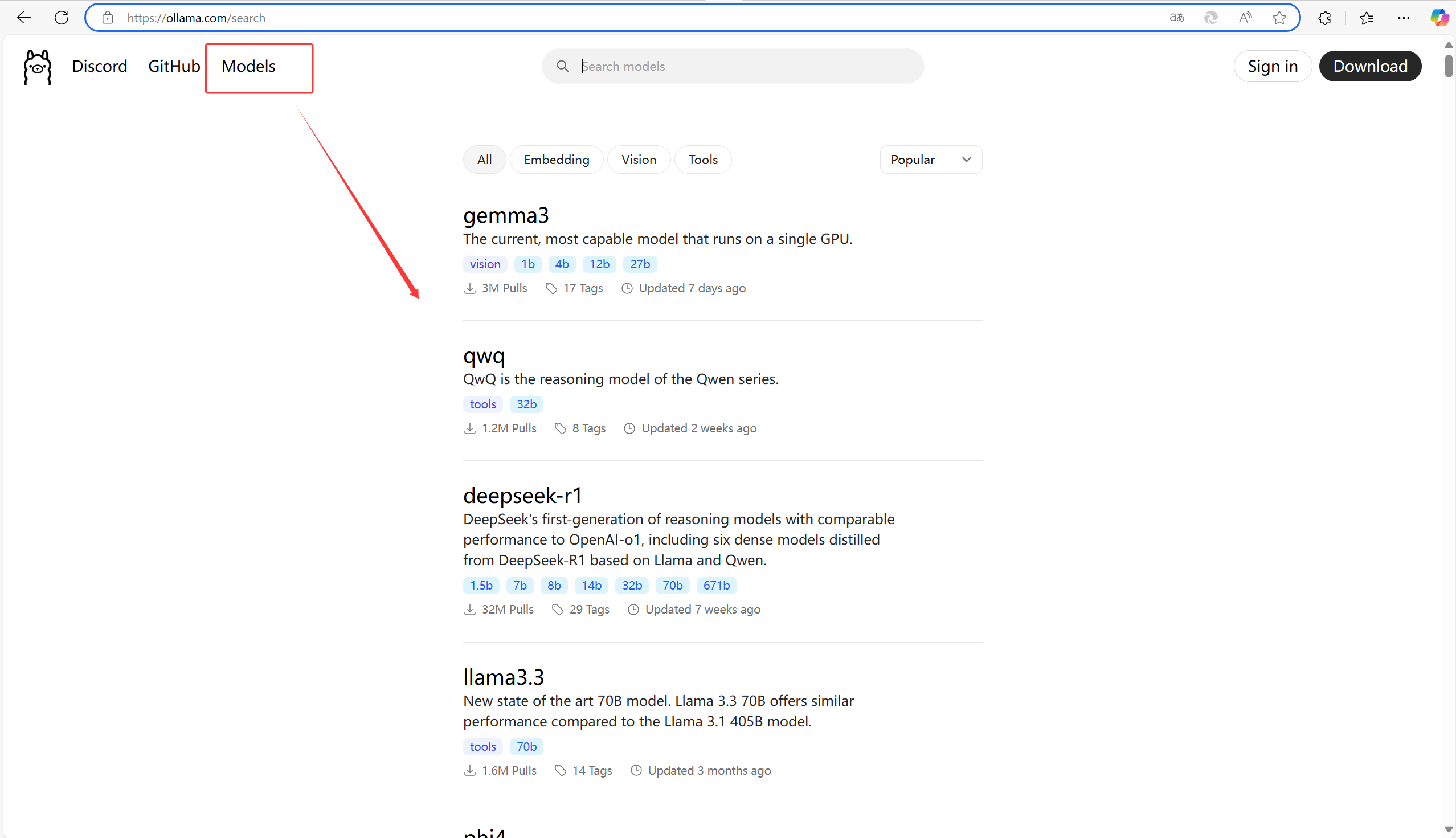

二、拉取并运行模型

1.官网搜索想要的模型:https://ollama.com

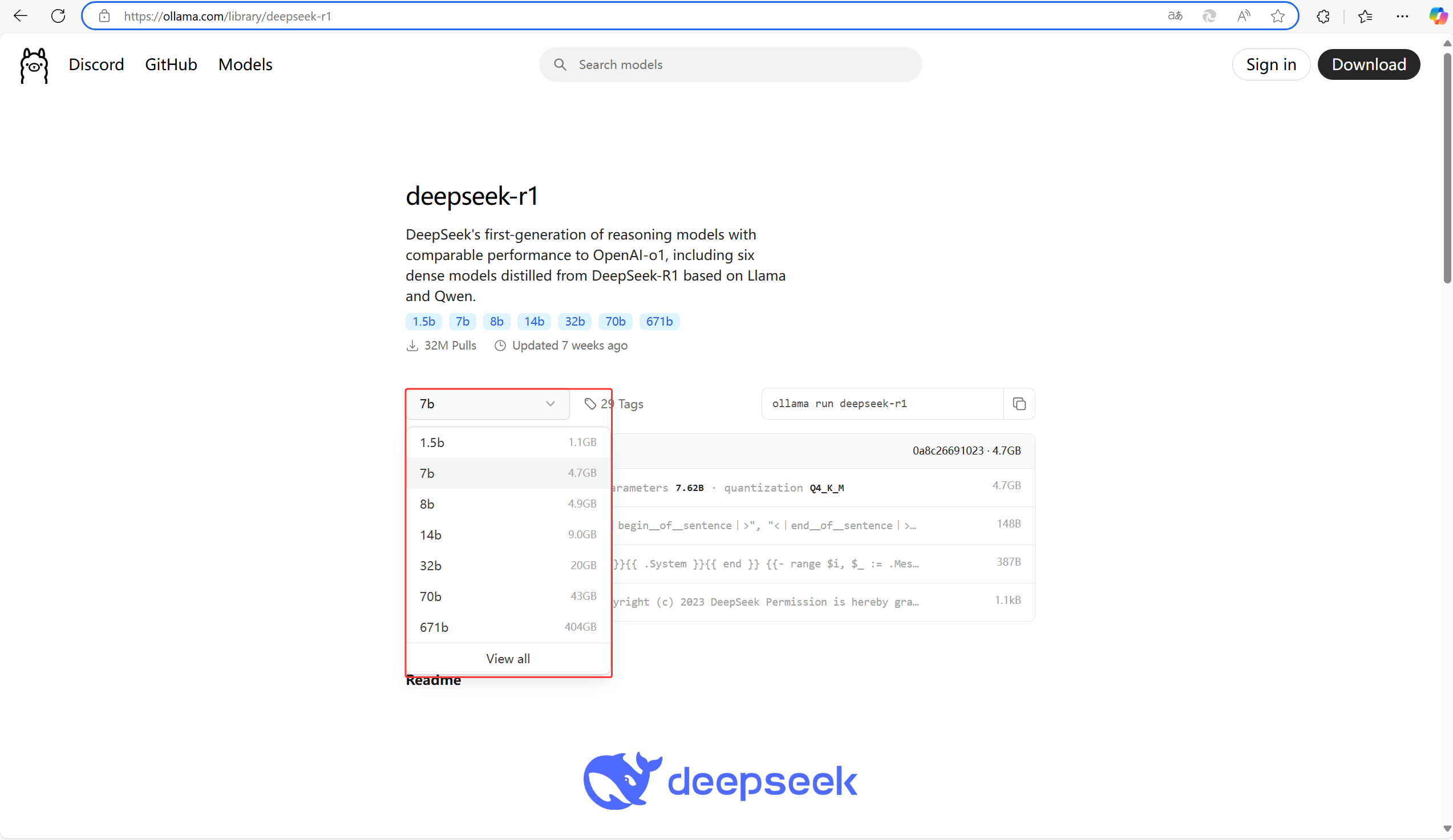

点击models 菜单项,进入模型列表页面

2.找到模型后,点击进入详情页面

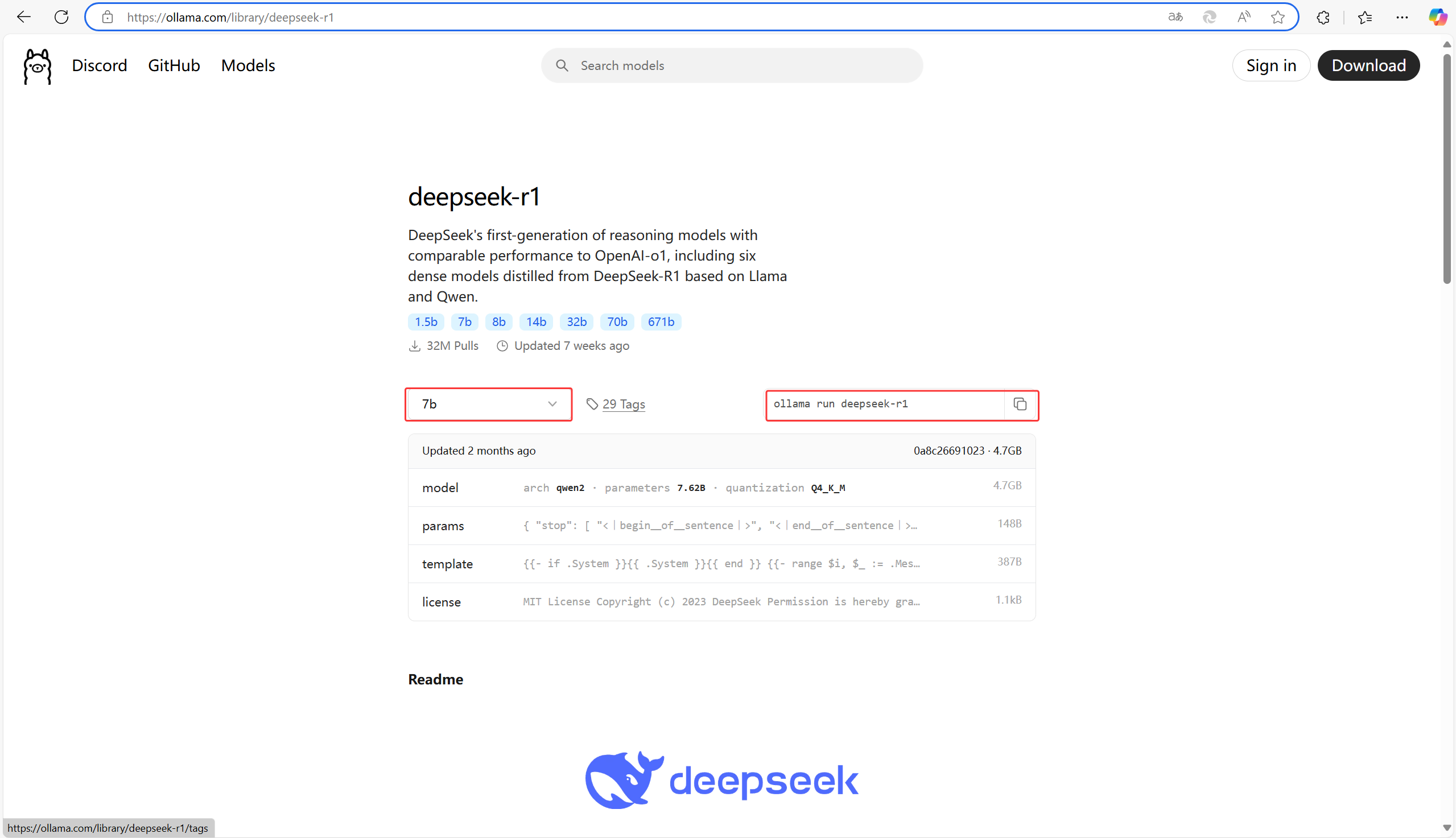

3.选择想要的模型参数大小,复制右侧的命令

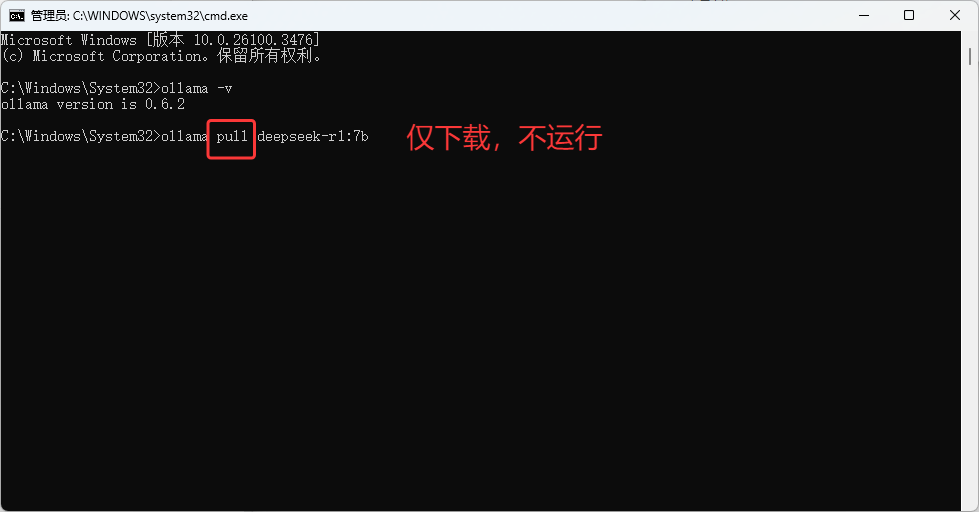

4.回到 CMD 窗口,粘贴命令,修改命令为仅下载,不运行

原命令 ollama run deepseek-r1:7b

新命令 ollama pull deepseek-r1:7b

(下载(拉取模型)速度变慢,可以 ctrl+c 中断,过一会再执行 ollama pull deepseek-r1:7b, 将会接着上一次的进度进行拉取下载)

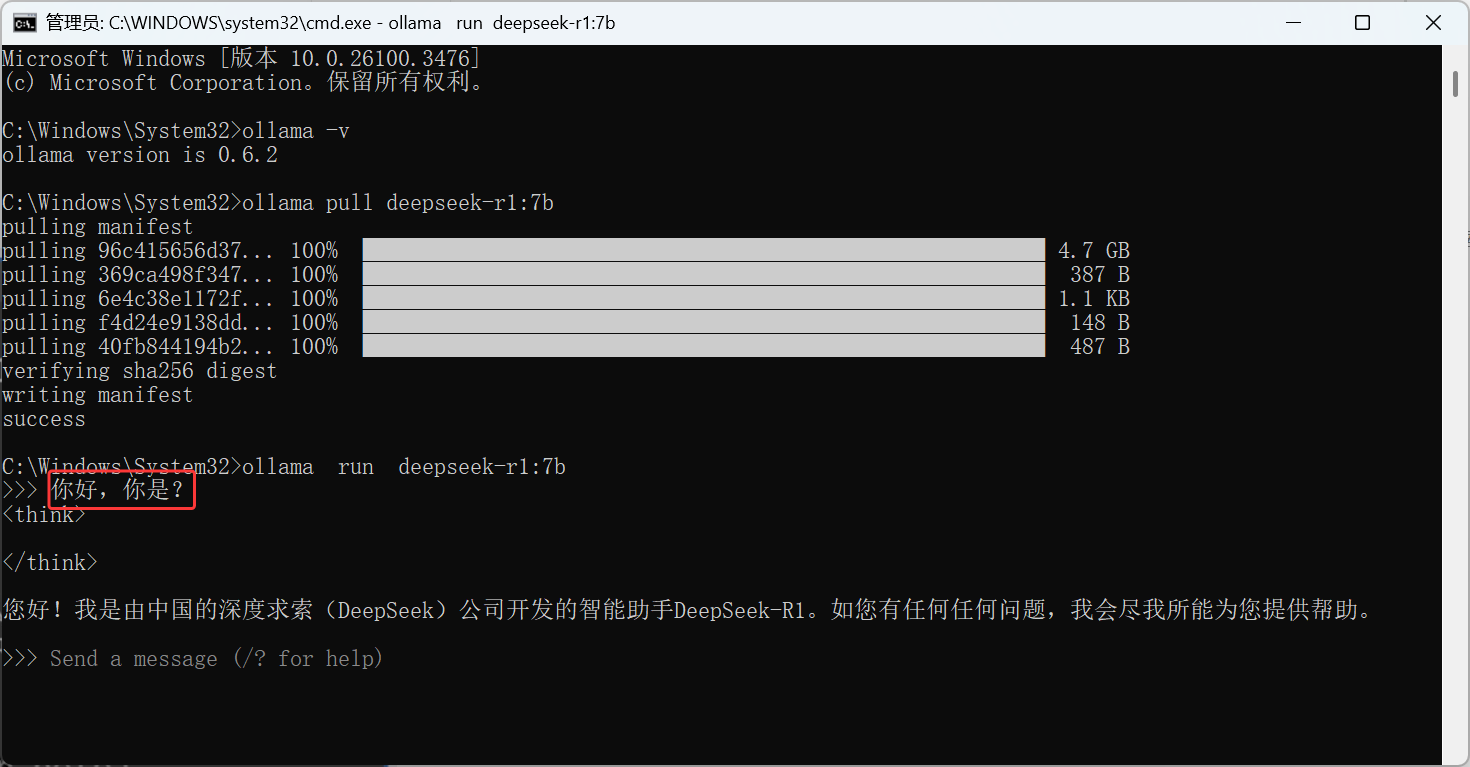

5.运行大模型

ollama run deepseek-r1:7b

在 >>>提示符后输入信息即可聊天

tips:管理员运行的黑窗口才可以中文输入

输入/bye 或者 ctrl + d 也可以退出. ollama服务还在

三、Open-webui前端部署

1.直接在anaconda创建的虚拟环境中部署

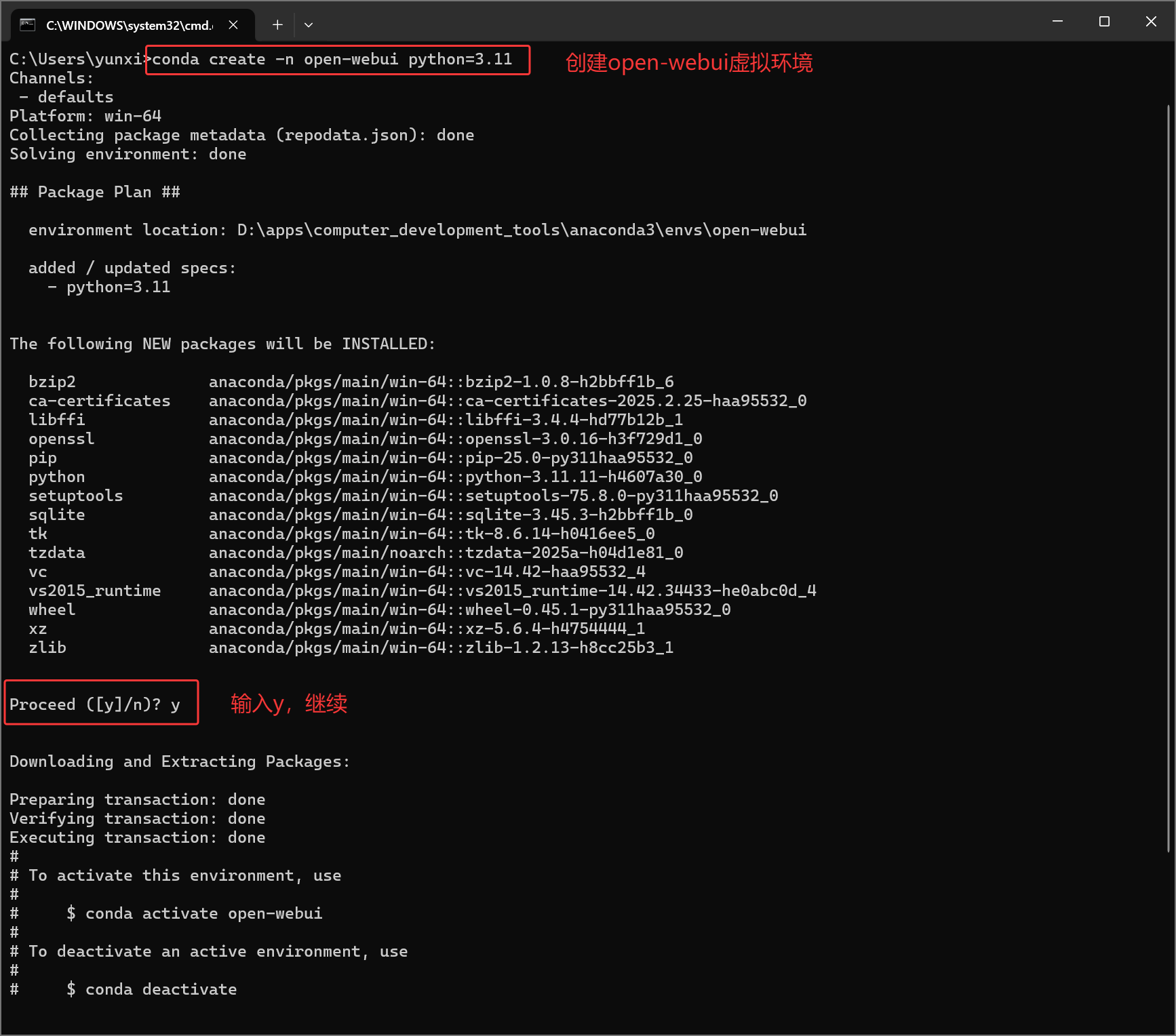

1.创建虚拟环境指令:conda create -n open-webui python=3.11

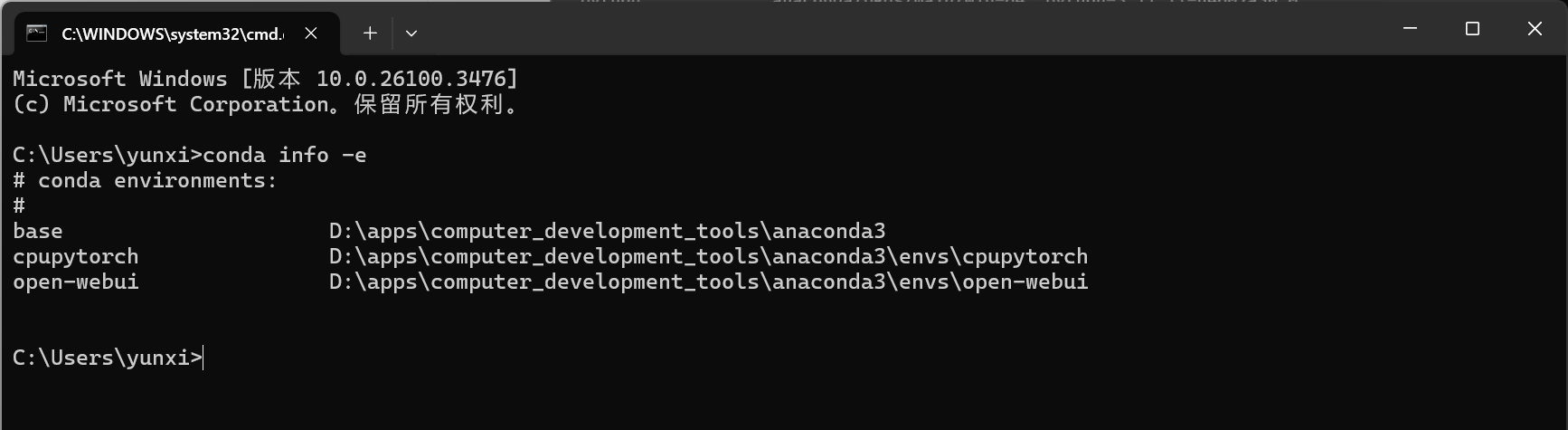

2.一般创建工作区非常顺利,如果不放心,新打开黑窗口,查看工作区是否创建成功指令:conda info -e

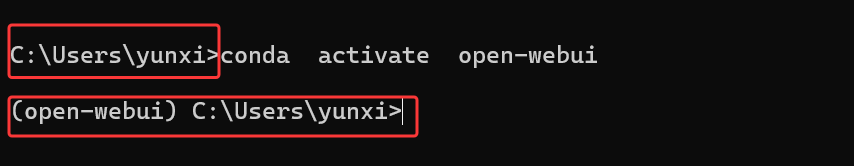

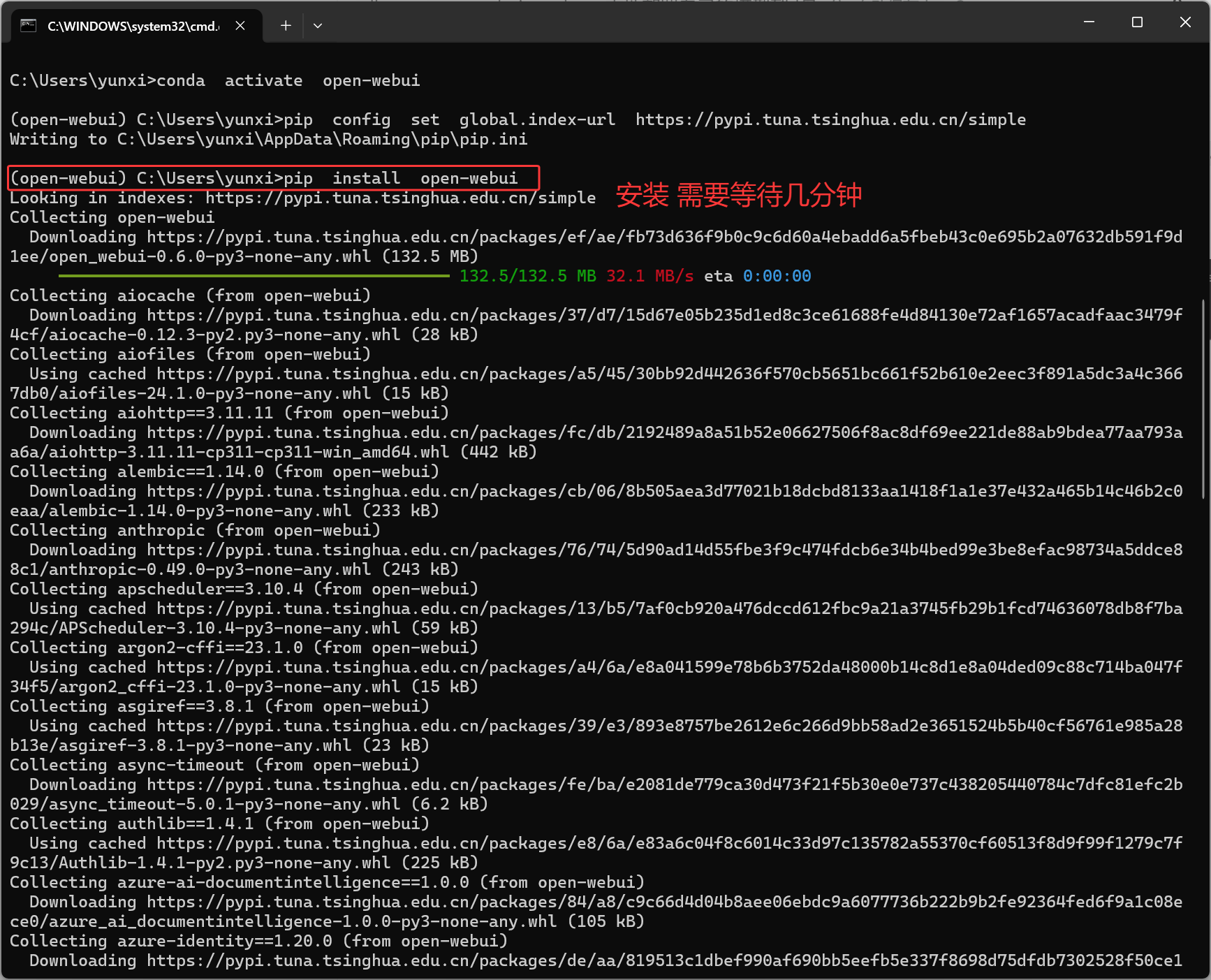

3.进入创建的工作区指令:conda activate open-webui

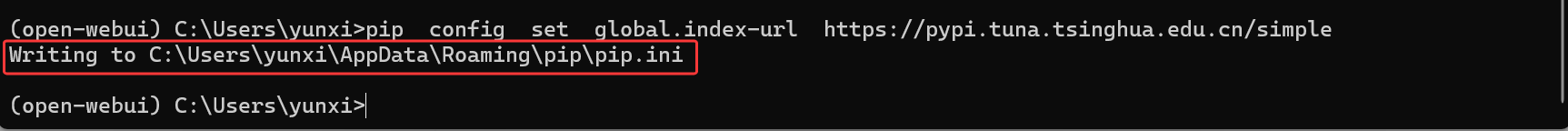

4.配置pip清华镜像指令:pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple

镜像指令来自:https://zhuanlan.zhihu.com/p/628870519

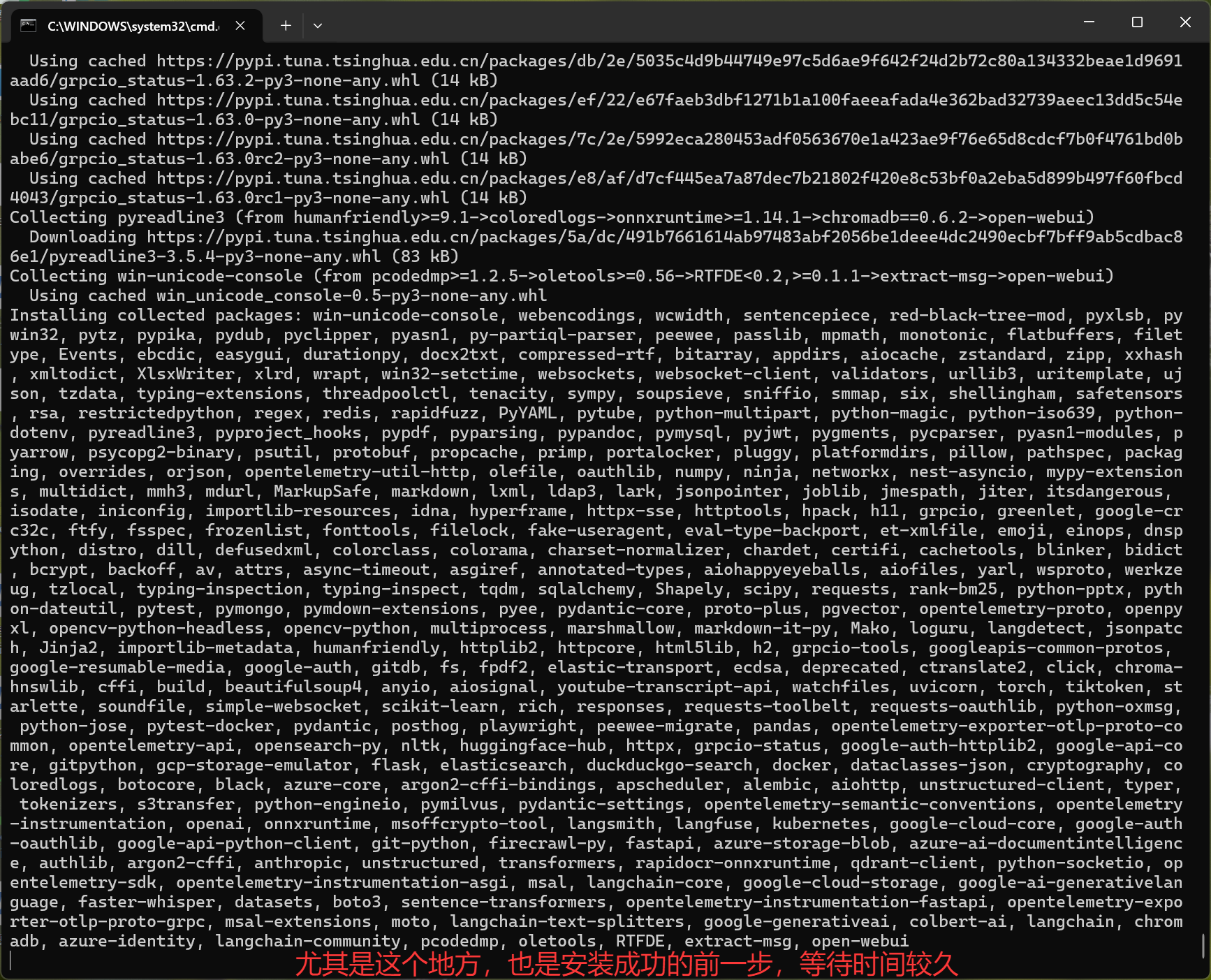

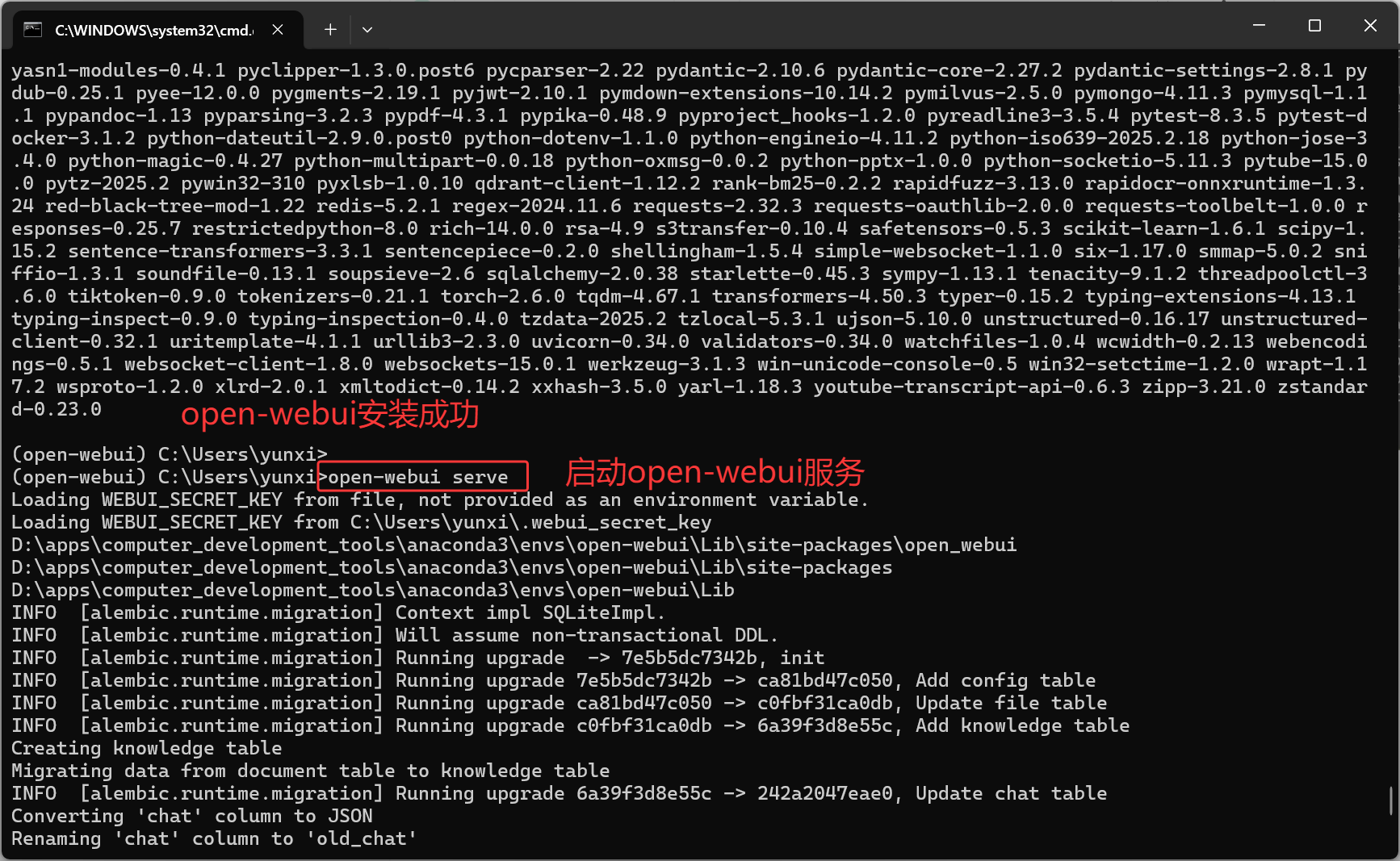

5.安装 open-webui指令:pip install open-webui

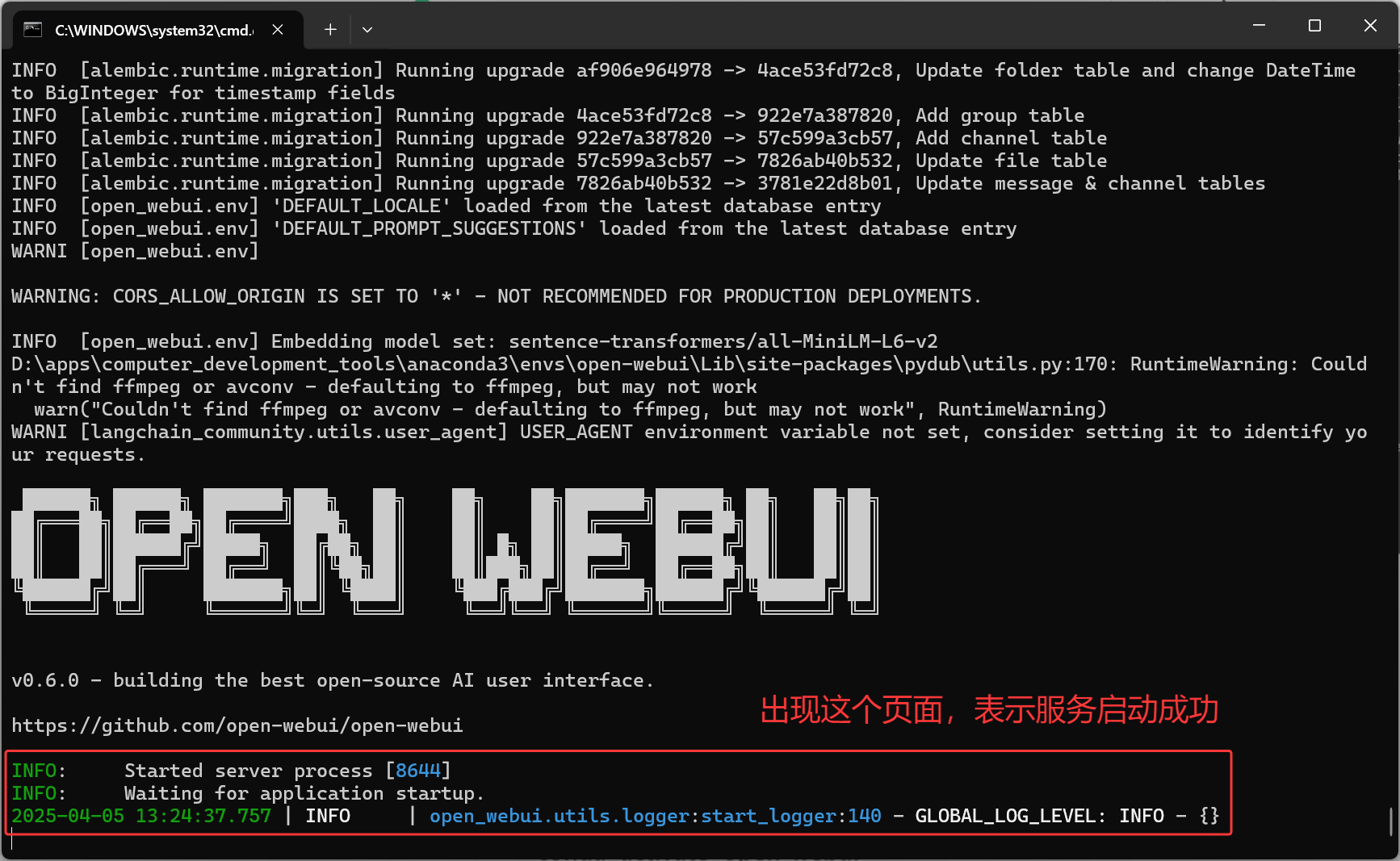

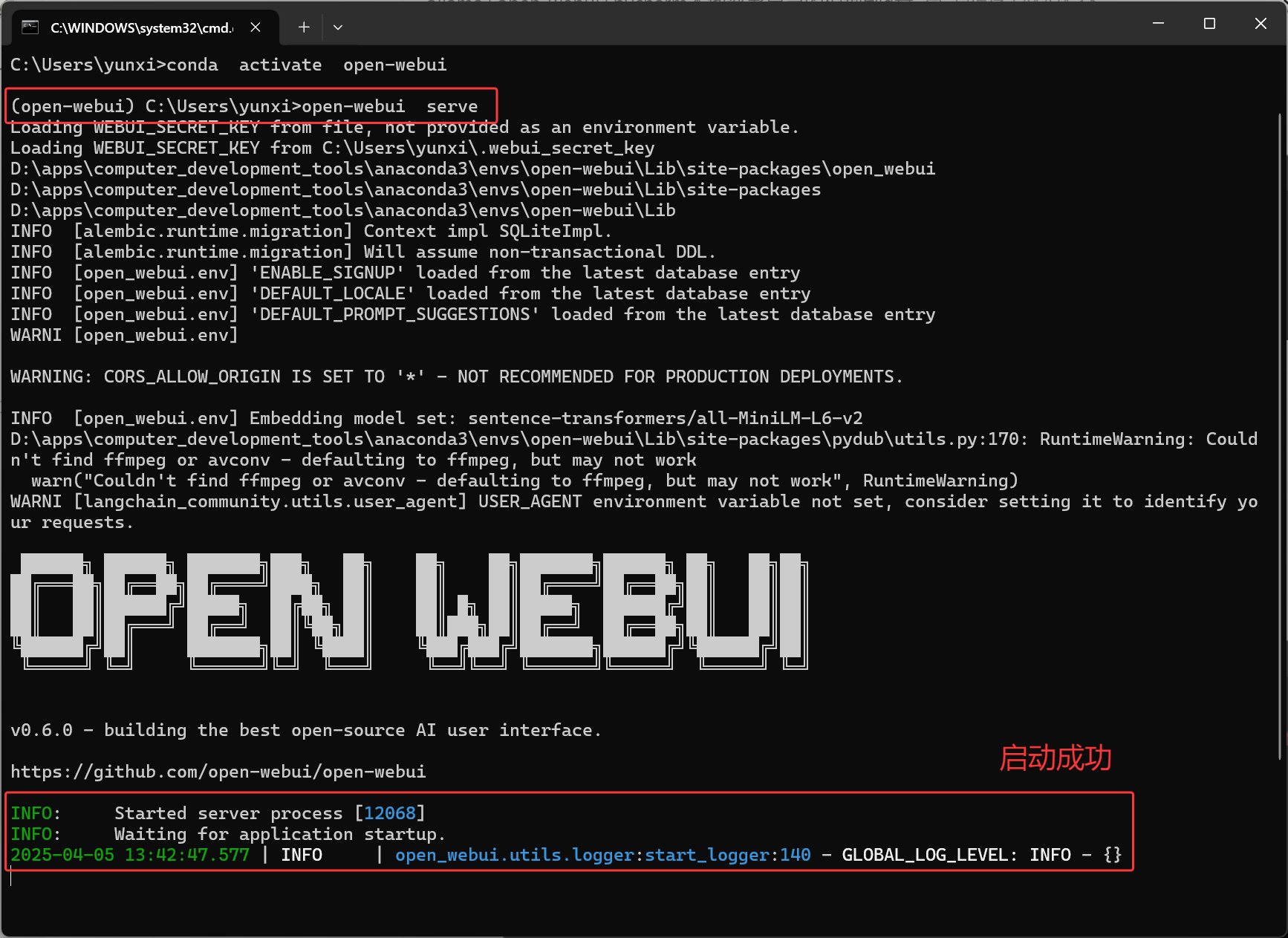

6.启动 open-webui指令:open-webui serve

7.服务启动成功页面

8.浏览器打开服务:localhost:8080

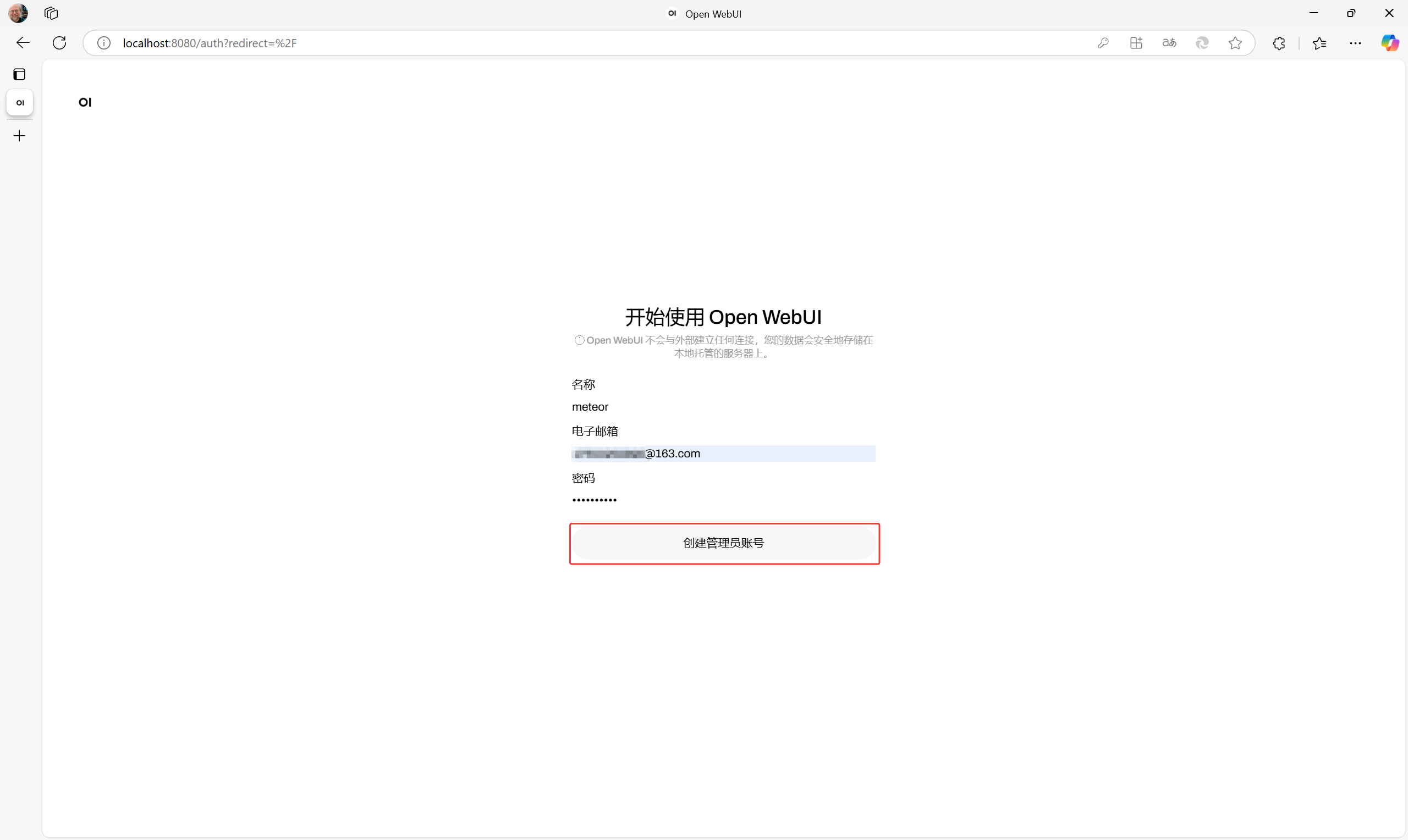

9.输入信息,创建管理员账号

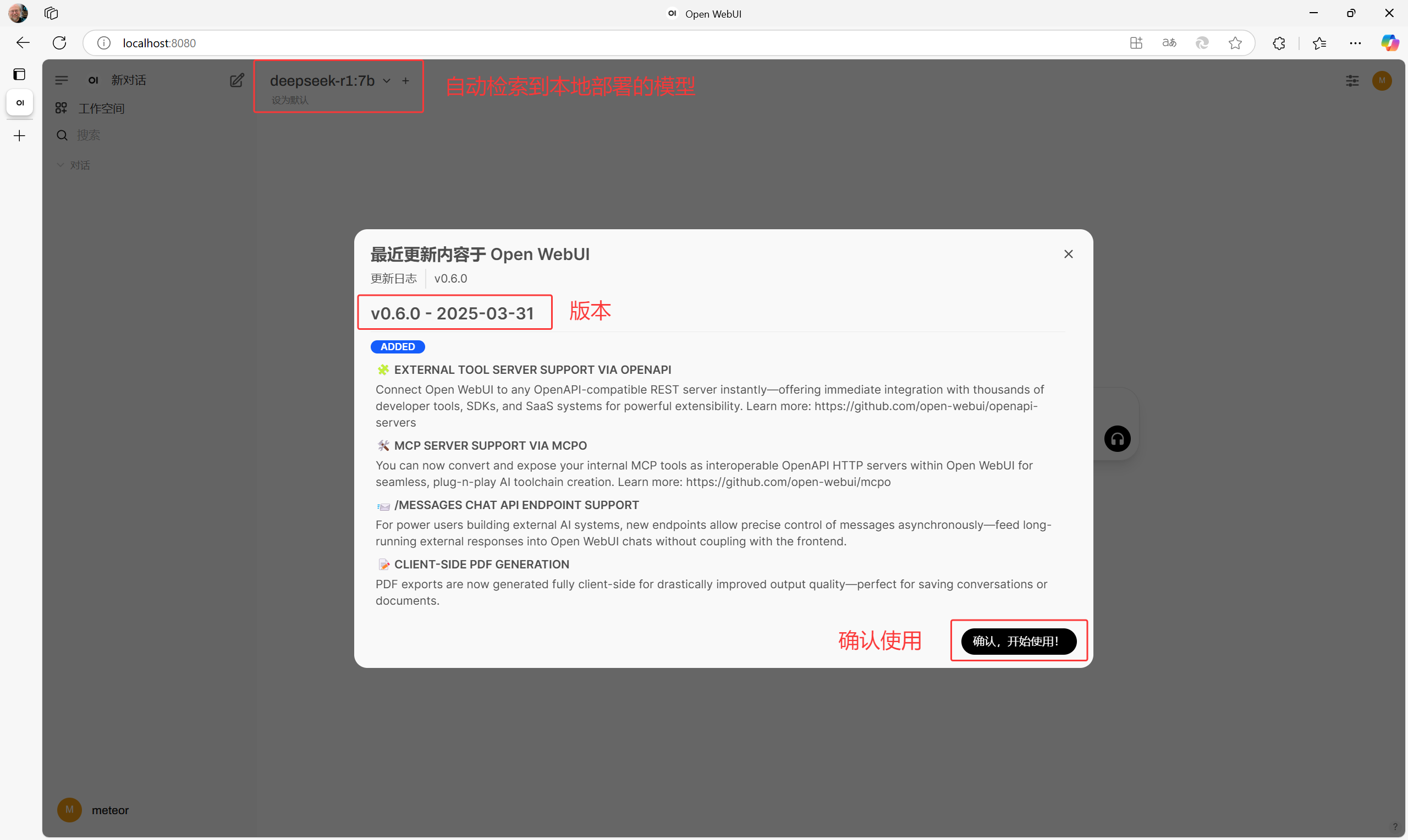

10.创建后进入页面,弹出版本信息

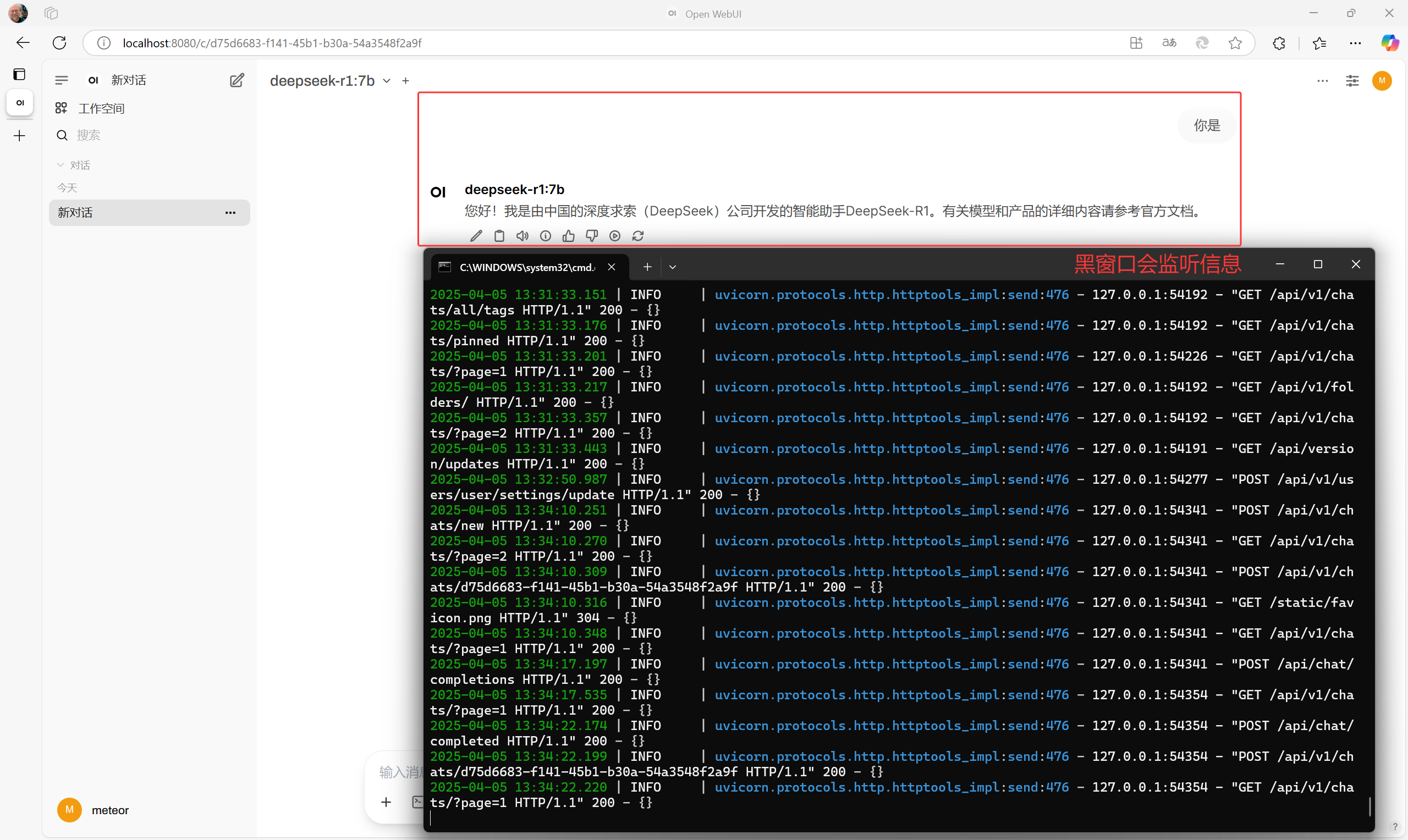

11.尝试使用(ctl+c或者叉掉黑窗口,意味着关闭服务,浏览器中将不能使用)

平时使用流程

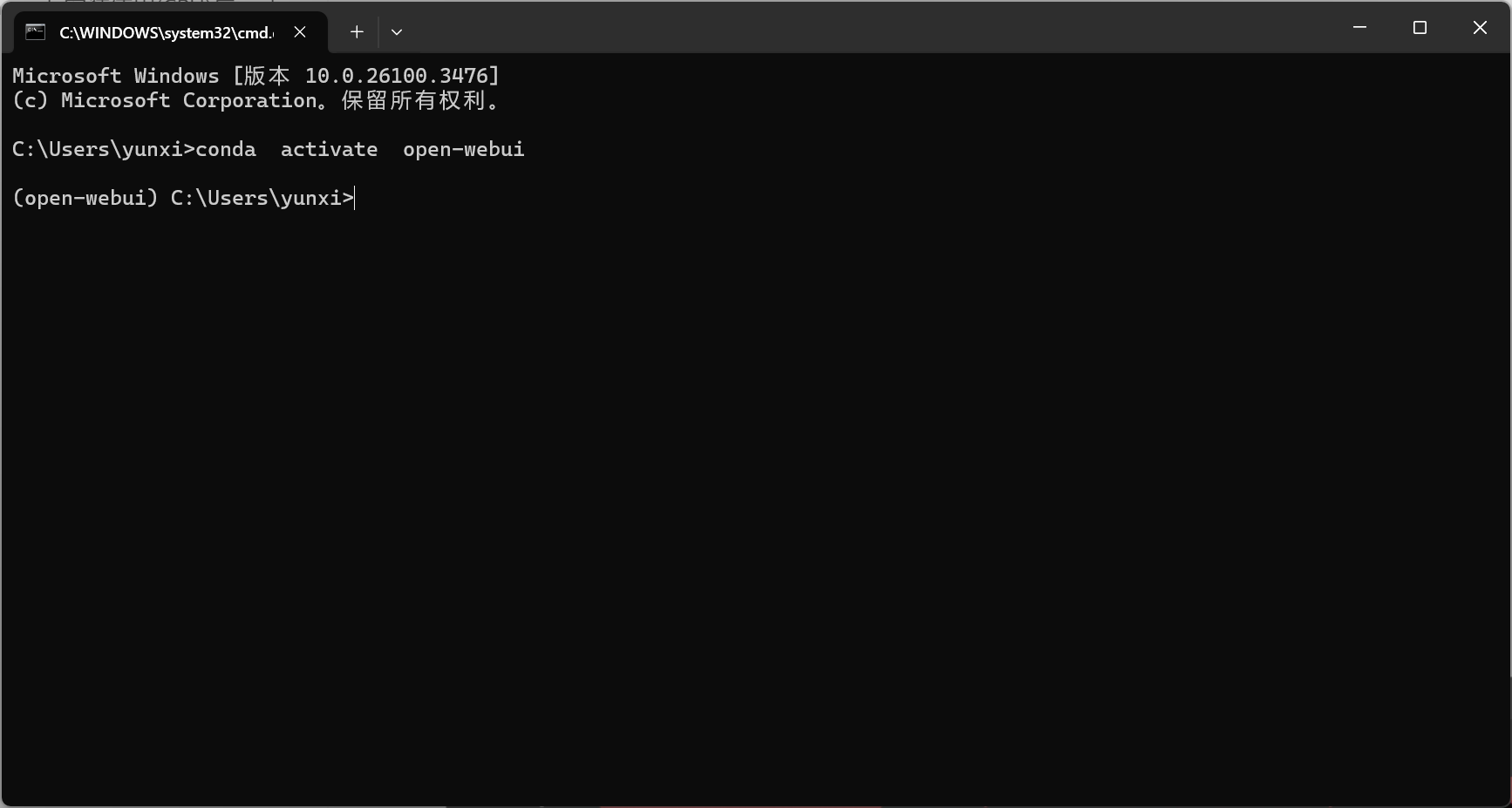

1.打开黑窗口,进入open-webui工作区指令:conda activate open-webui

2.工作区中启动open-webui指令:open-webui serve

3.退出或关闭 open-webui:ctrl + c或者叉掉黑窗口

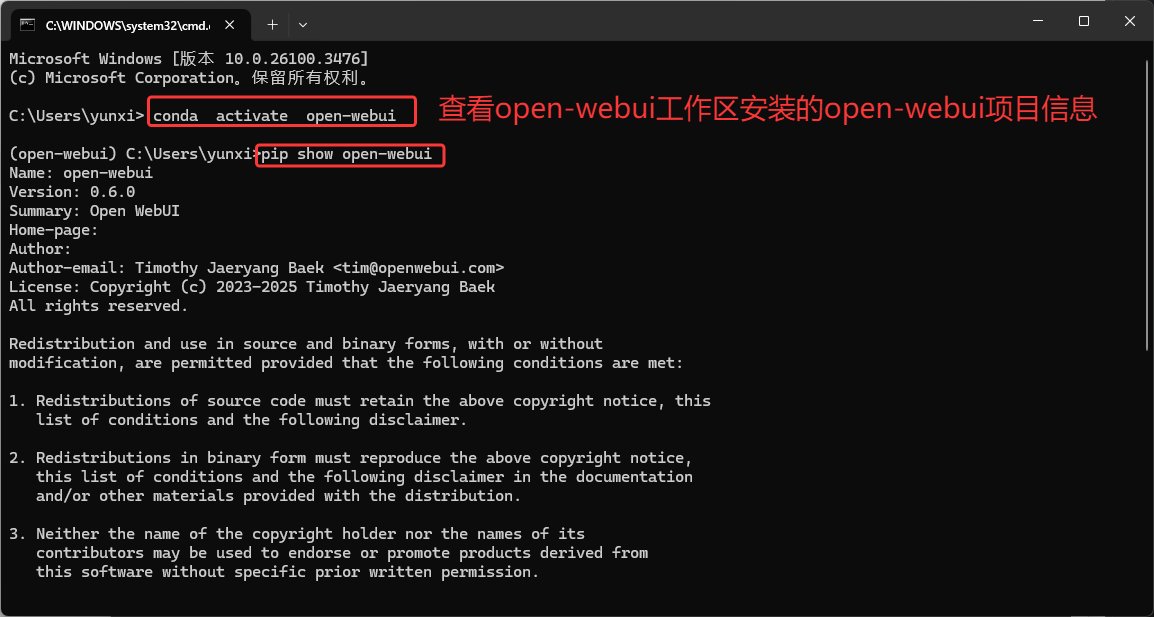

查看工作区安装的open-webui项目信息

指令:conda activate open-webui pip show open-webui

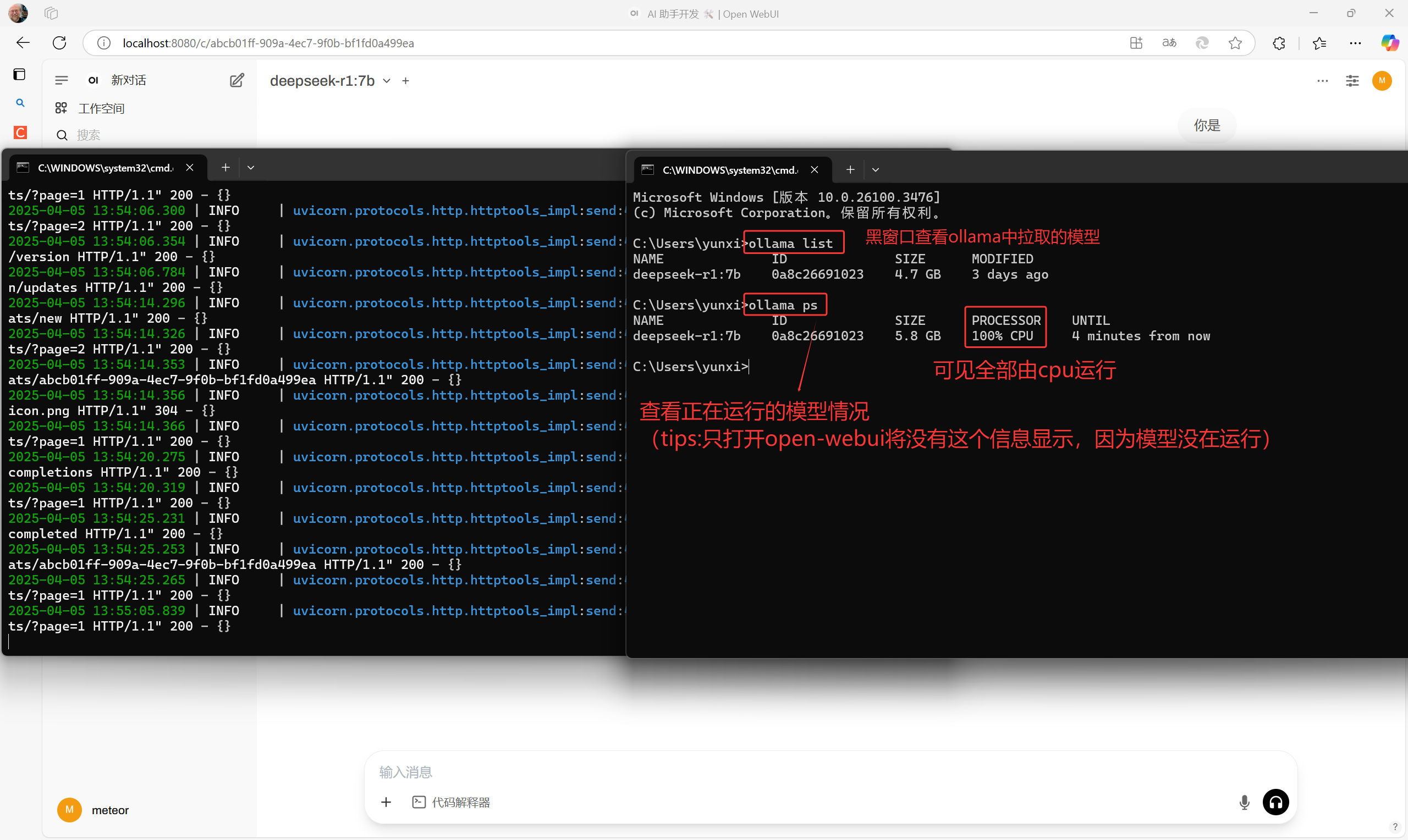

查看模型情况

查看ollama中拉取的模型指令:ollama list

查看正在运行的模型情况:ollama ps

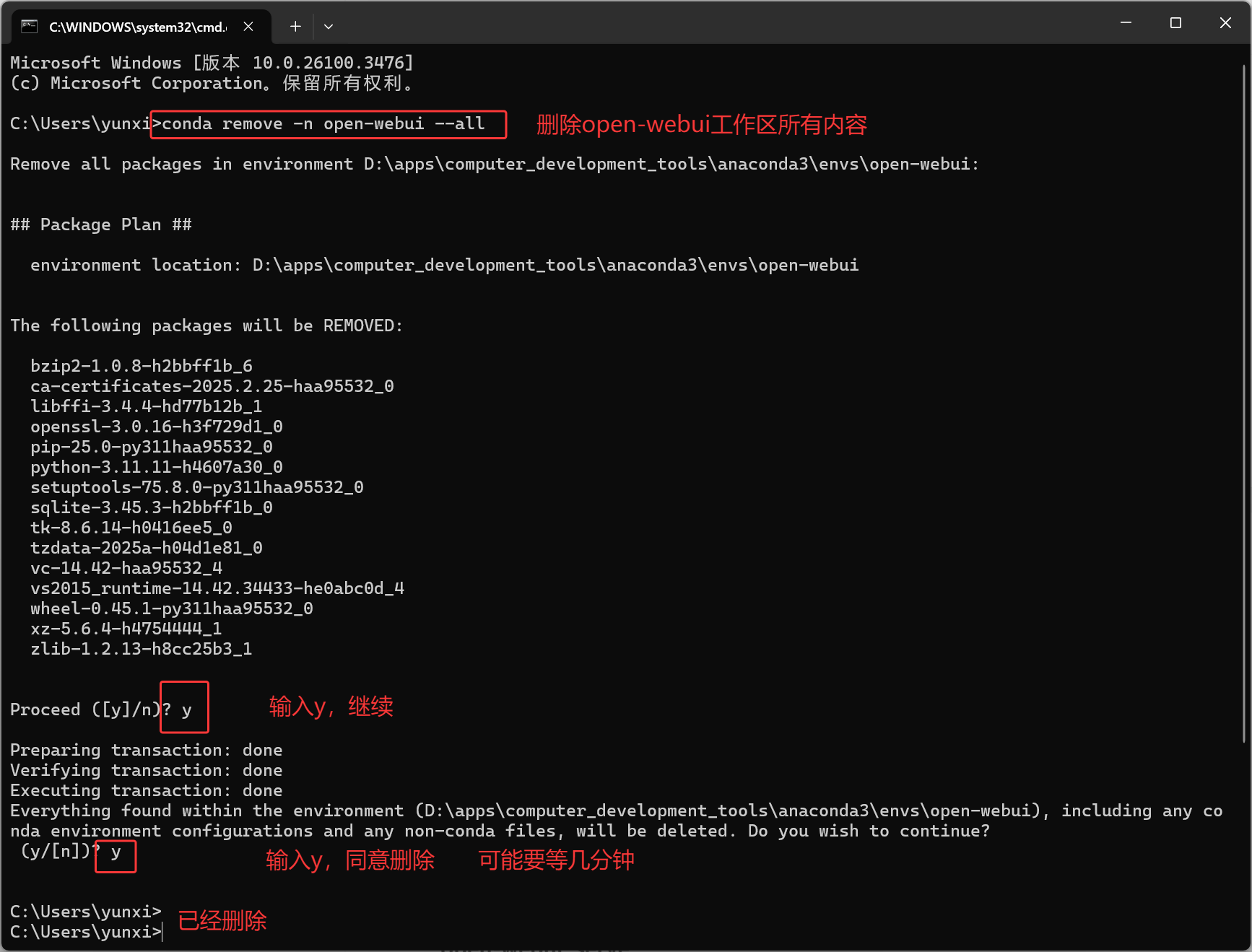

删除open-webui工作区内容:

指令:conda remove -n open-webui --all

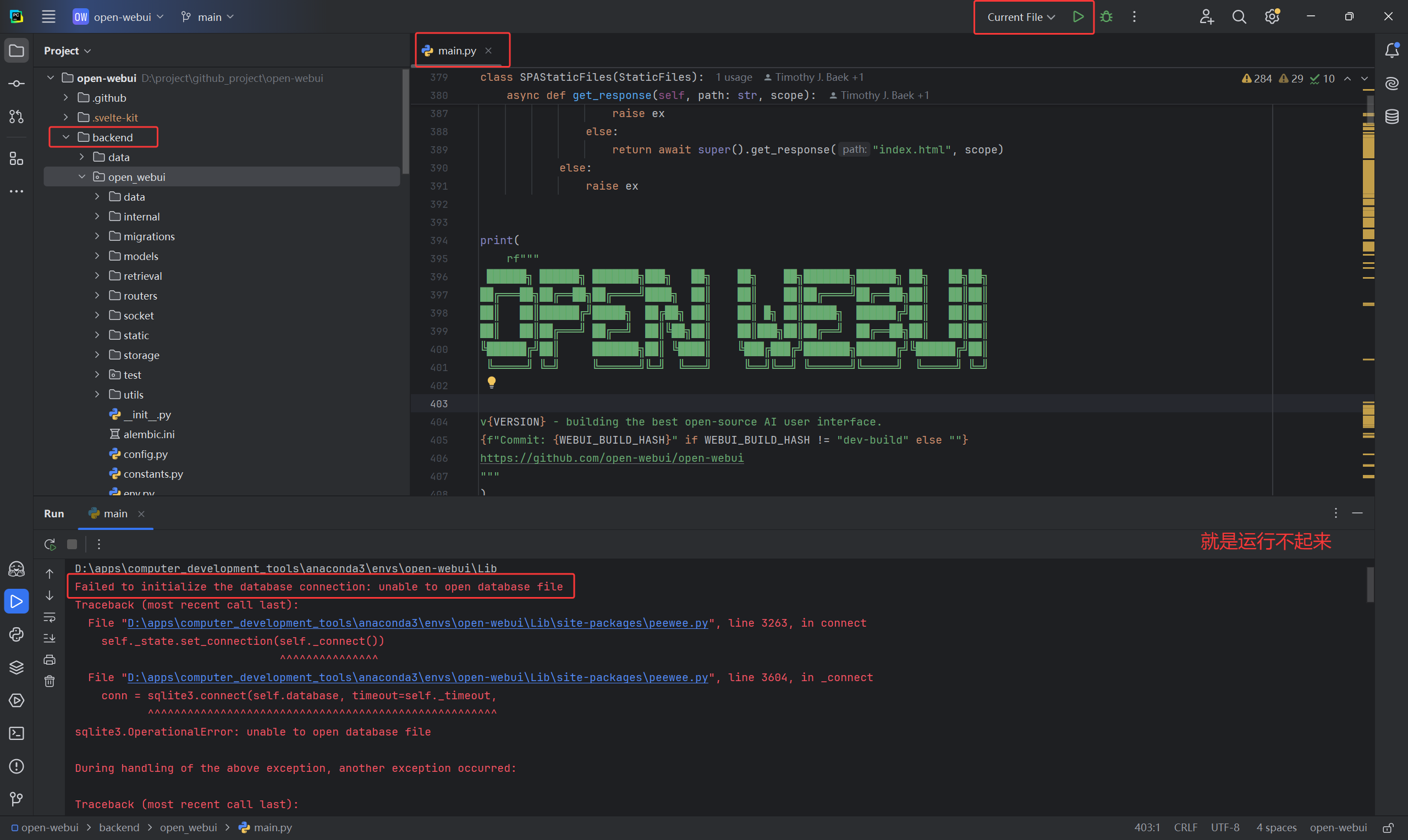

2.Open-webui使用非pip安装运行

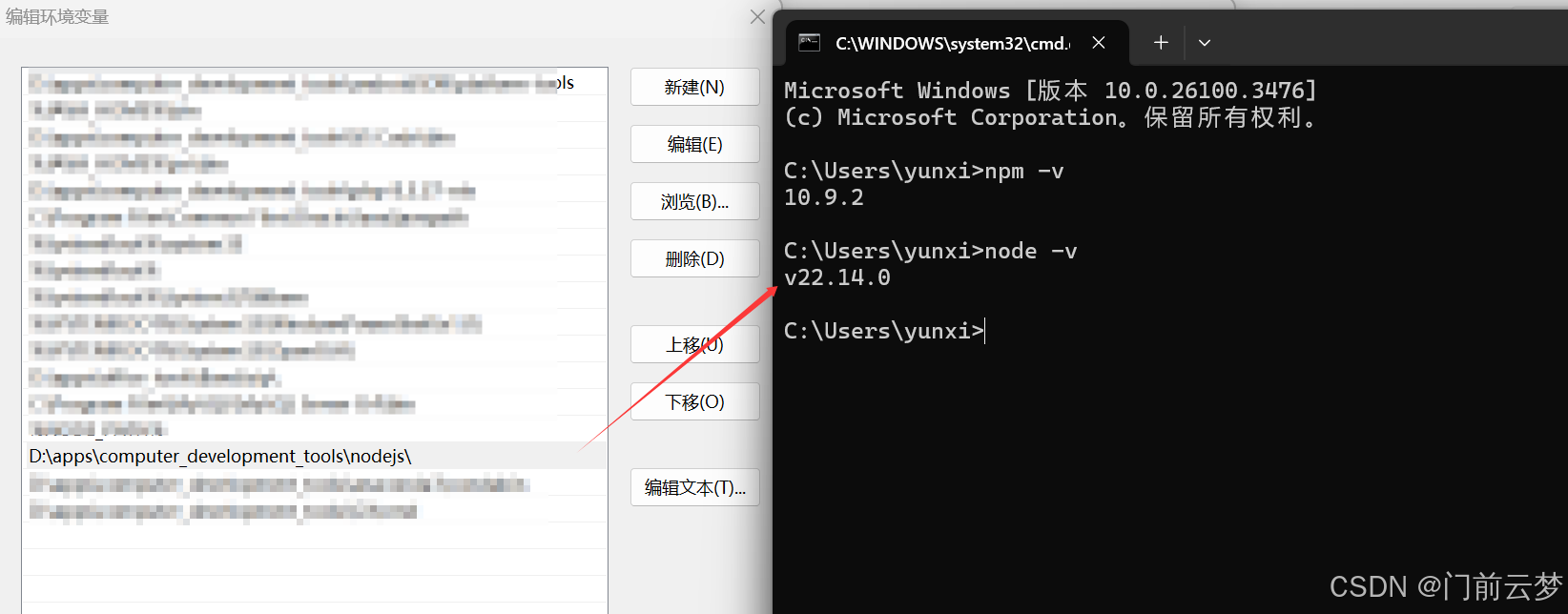

- node.js已经安装,版本20以上,(我下载的22)

- node.js环境变量已配置

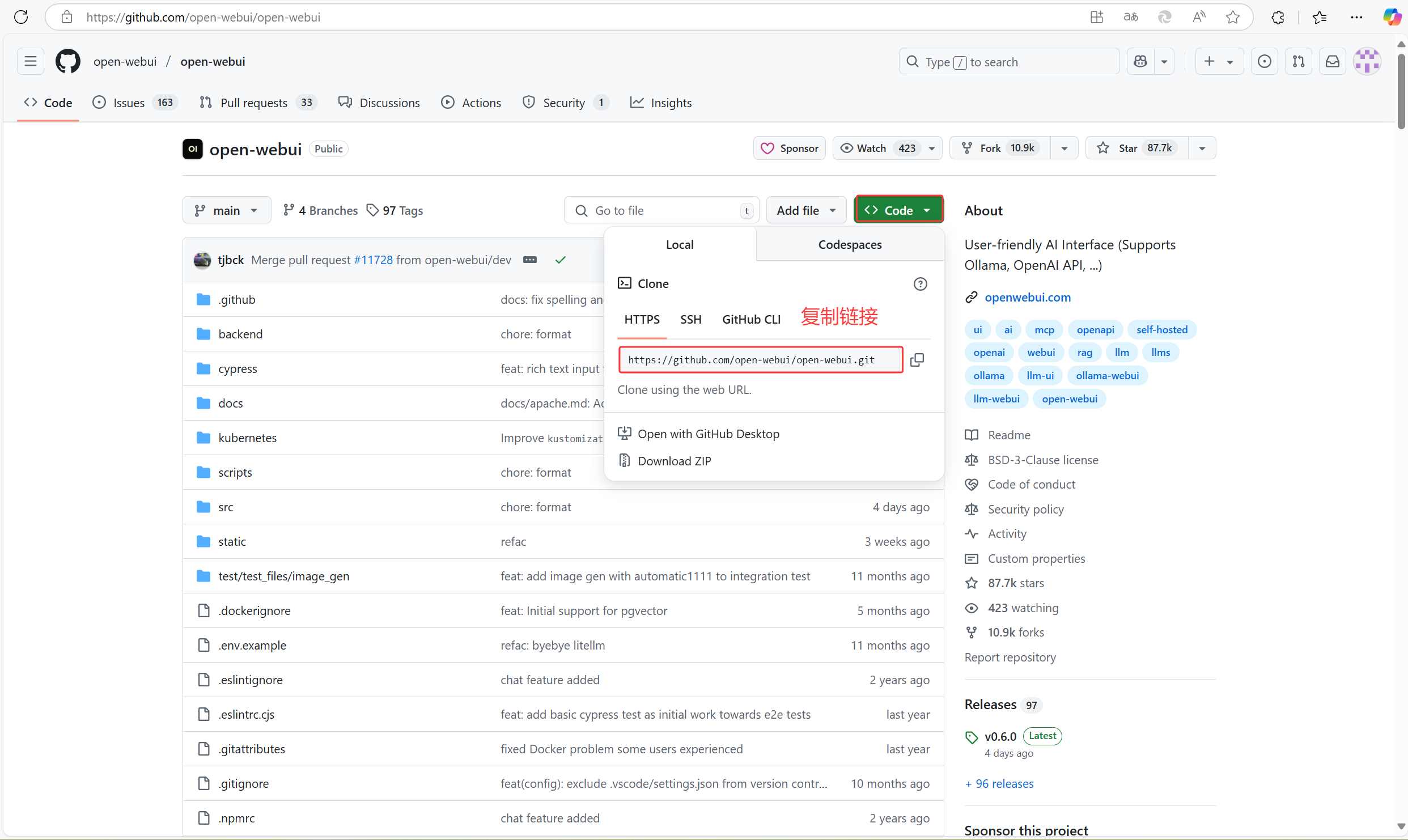

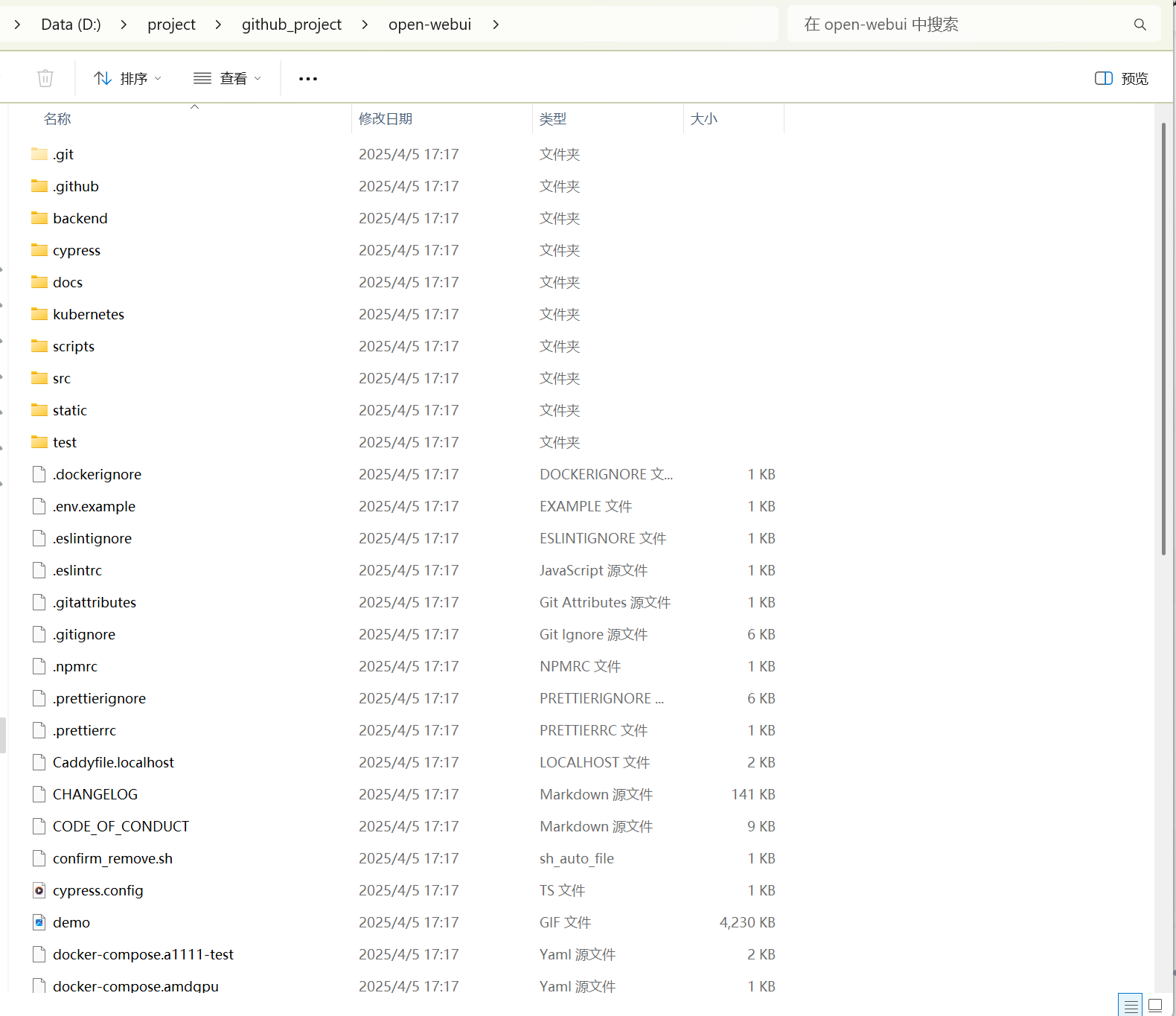

1.在github上下载源码

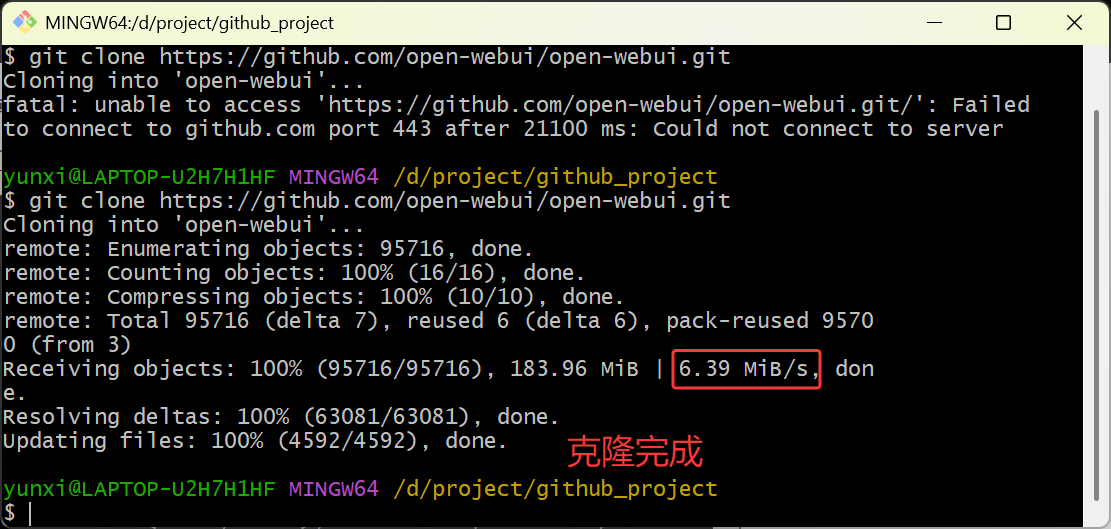

2.右键放项目的地方,打开Git Bash,克隆指令:git clone https://github.com/open-webui/open-webui.git (换成自己要克隆的项目地址哈)

3.等待克隆完成

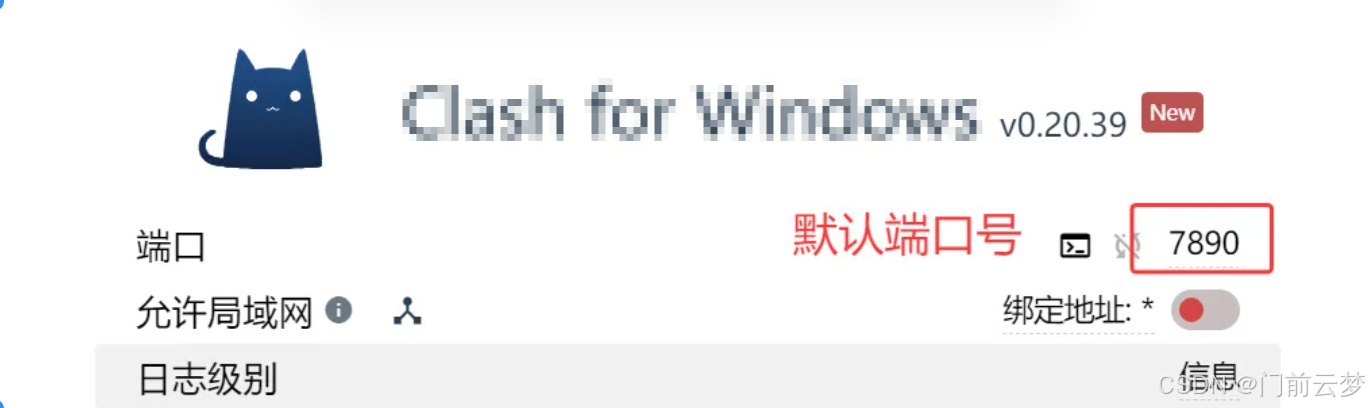

4.使用魔法速度还是慢?克隆失败?

使用魔法指令:

git config --global http.proxy http://127.0.0.1:7890

git config --global https.proxy http://127.0.0.1:7890

如果不需要魔法,可以取消设置,指令:

git config --global --unset http.proxy

git config --global --unset https.proxy

目的是设置 Git 通过 HTTP 和 HTTPS 协议访问网络时使用魔法工具地址,确保你的魔法工具(如 小猫)已启动,且 7890 端口是它的监听端口(不同工具端口可能不同),仅对 Git 生效,此配置不会影响其他程序(如浏览器)的网络请求

效果:速率提高到每秒兆字节

5.进入目录

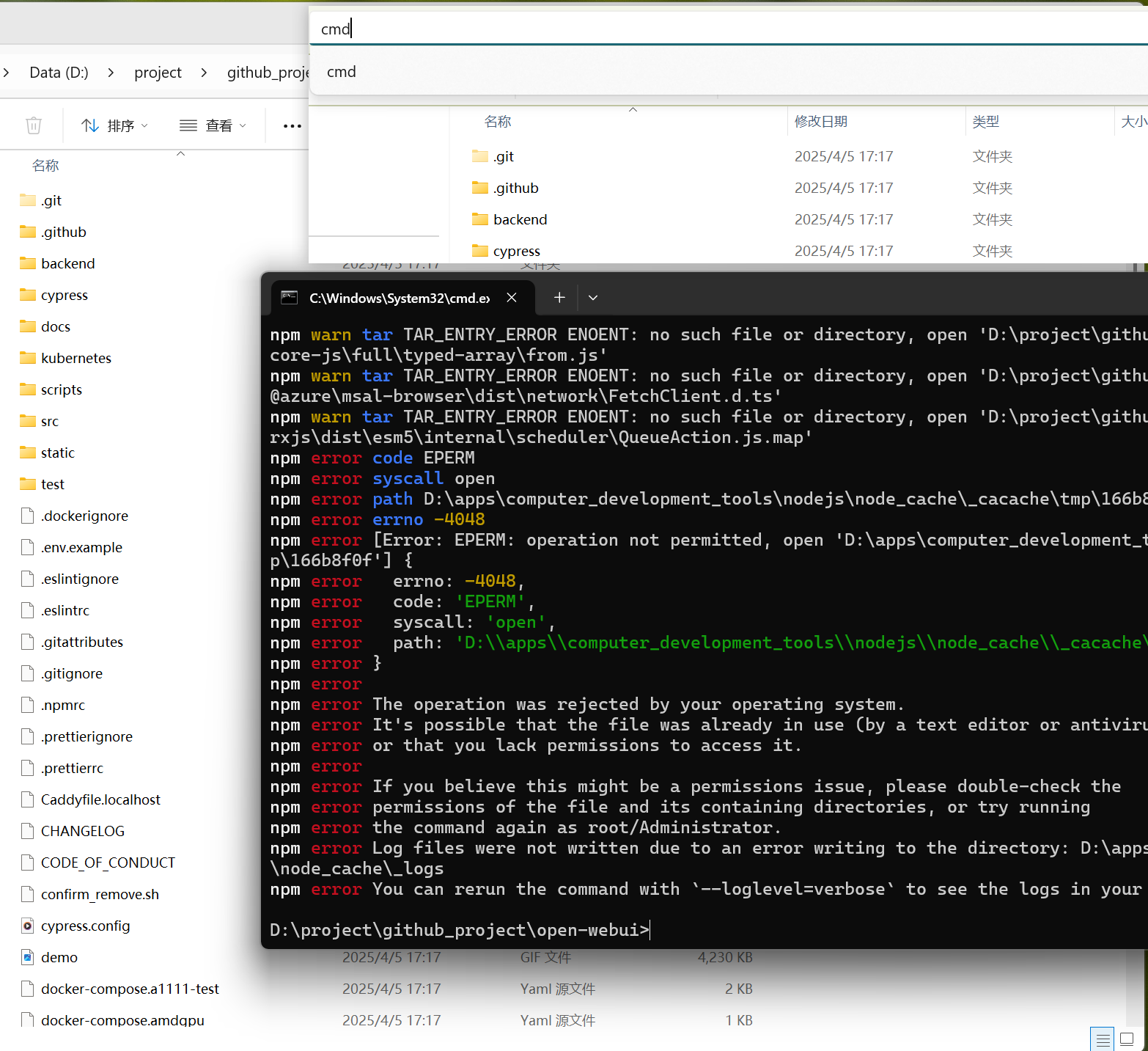

6.路径输入cmd,启动黑窗口,运行指令npm install

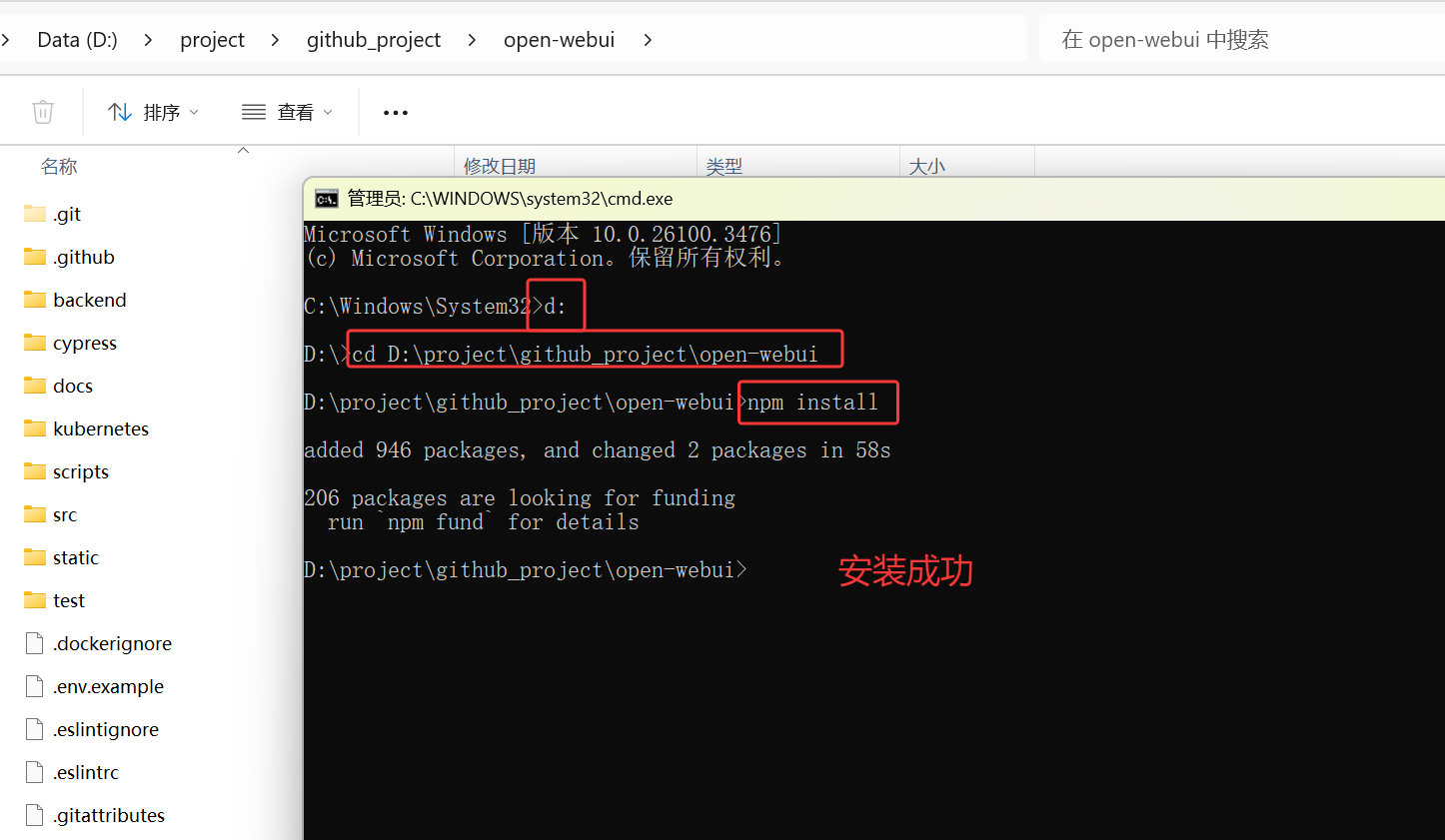

7.路径打开的cmd不是管理员身份打开的,win+R打开运行,输入cmd后,ctrl+shift+回车。切到目录再执行指令:npm install

安装后会在目录中多一个文件夹:node_modules,如果没有显示,返回上一级文件夹,再进入。

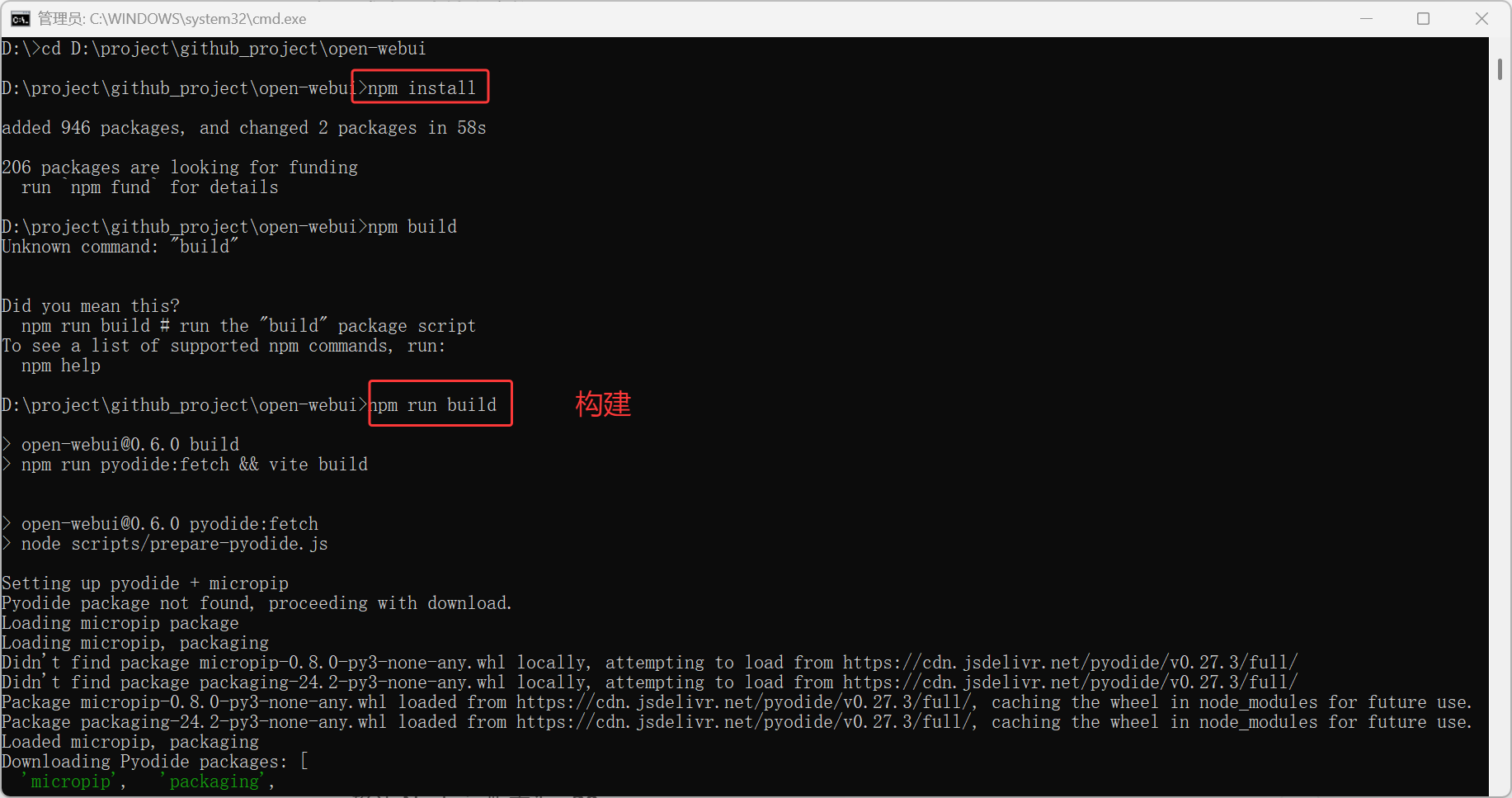

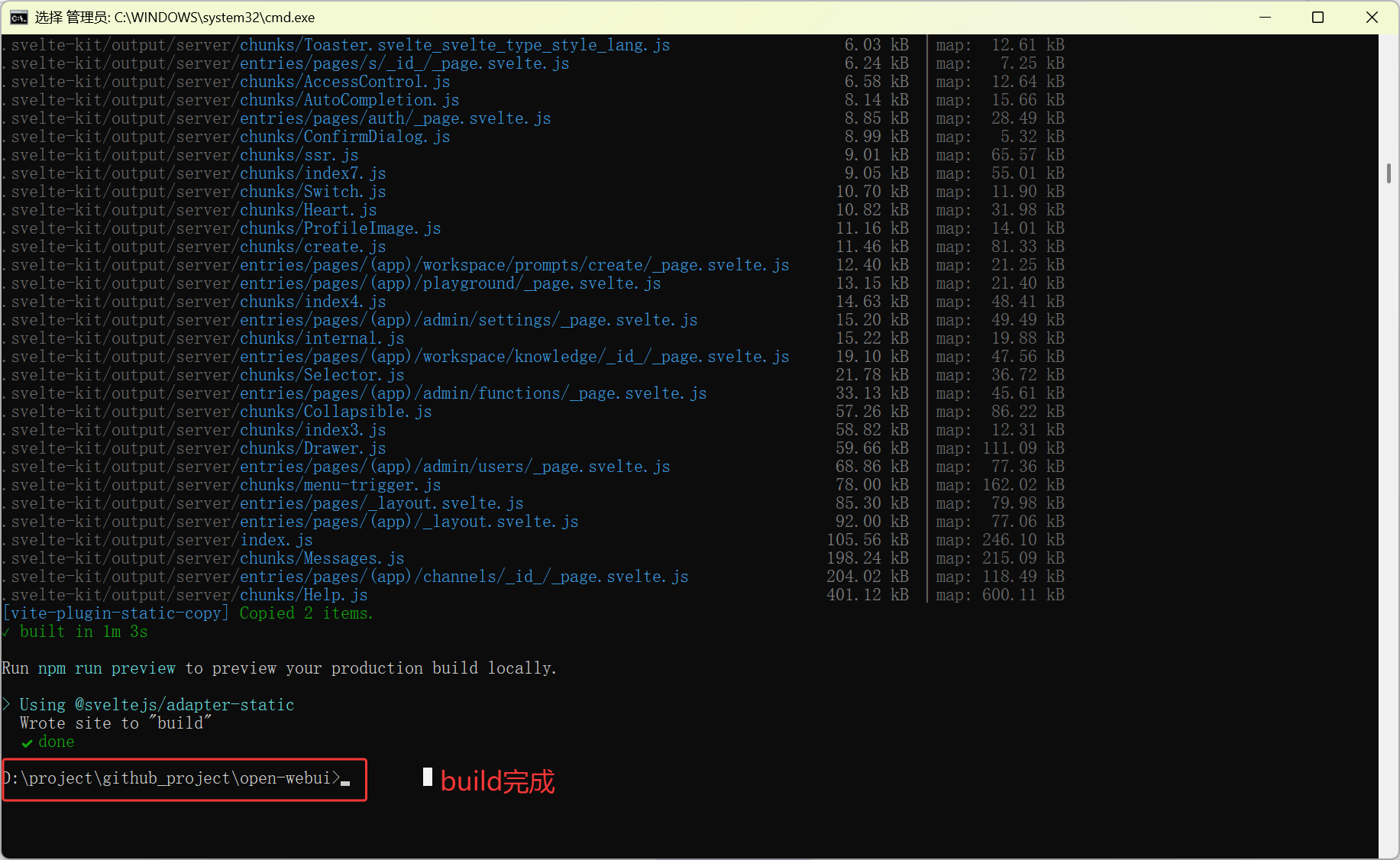

8.继续输入指令完成前端构建:npm run build

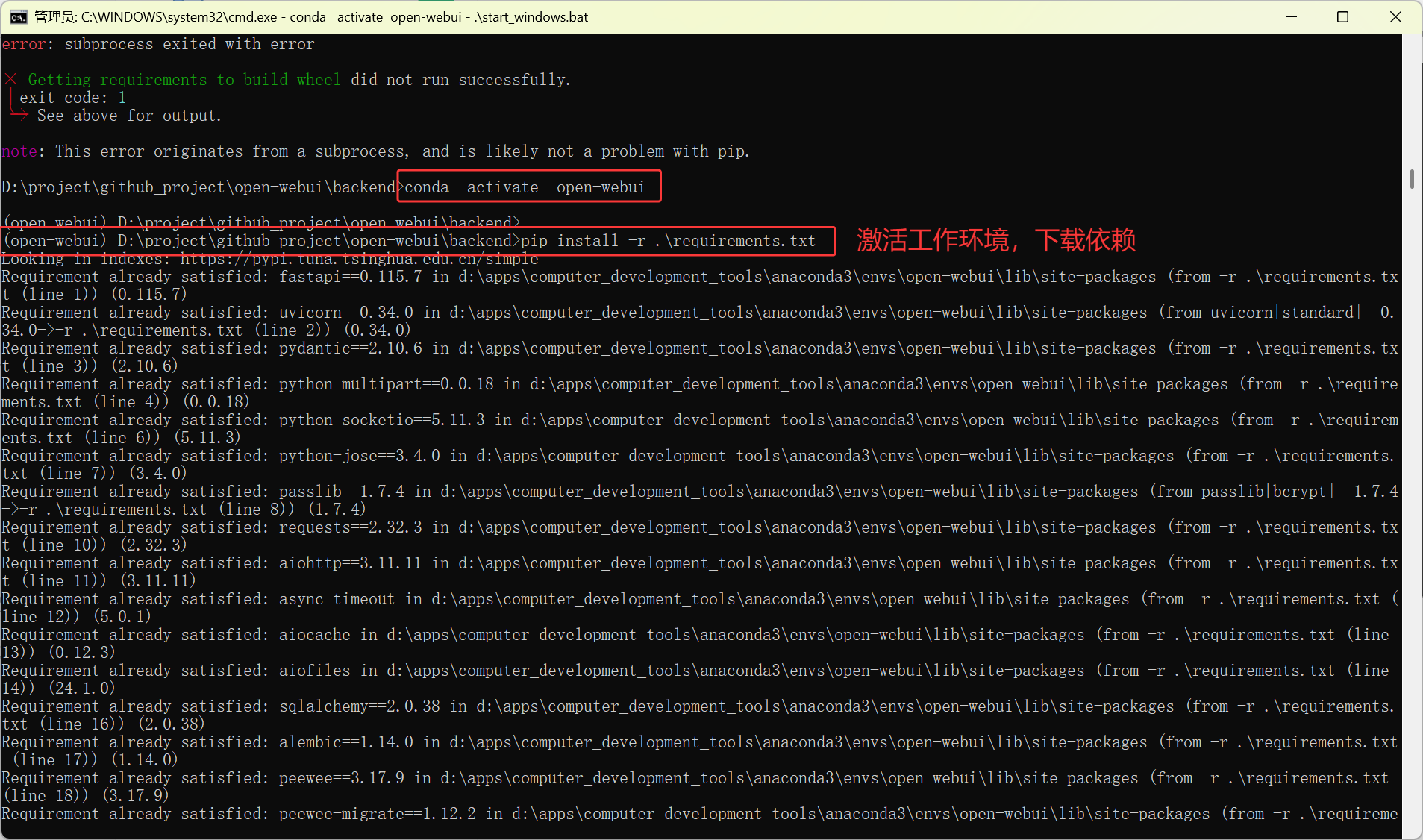

9.依旧使用anaconda中创建的open-webui虚拟环境

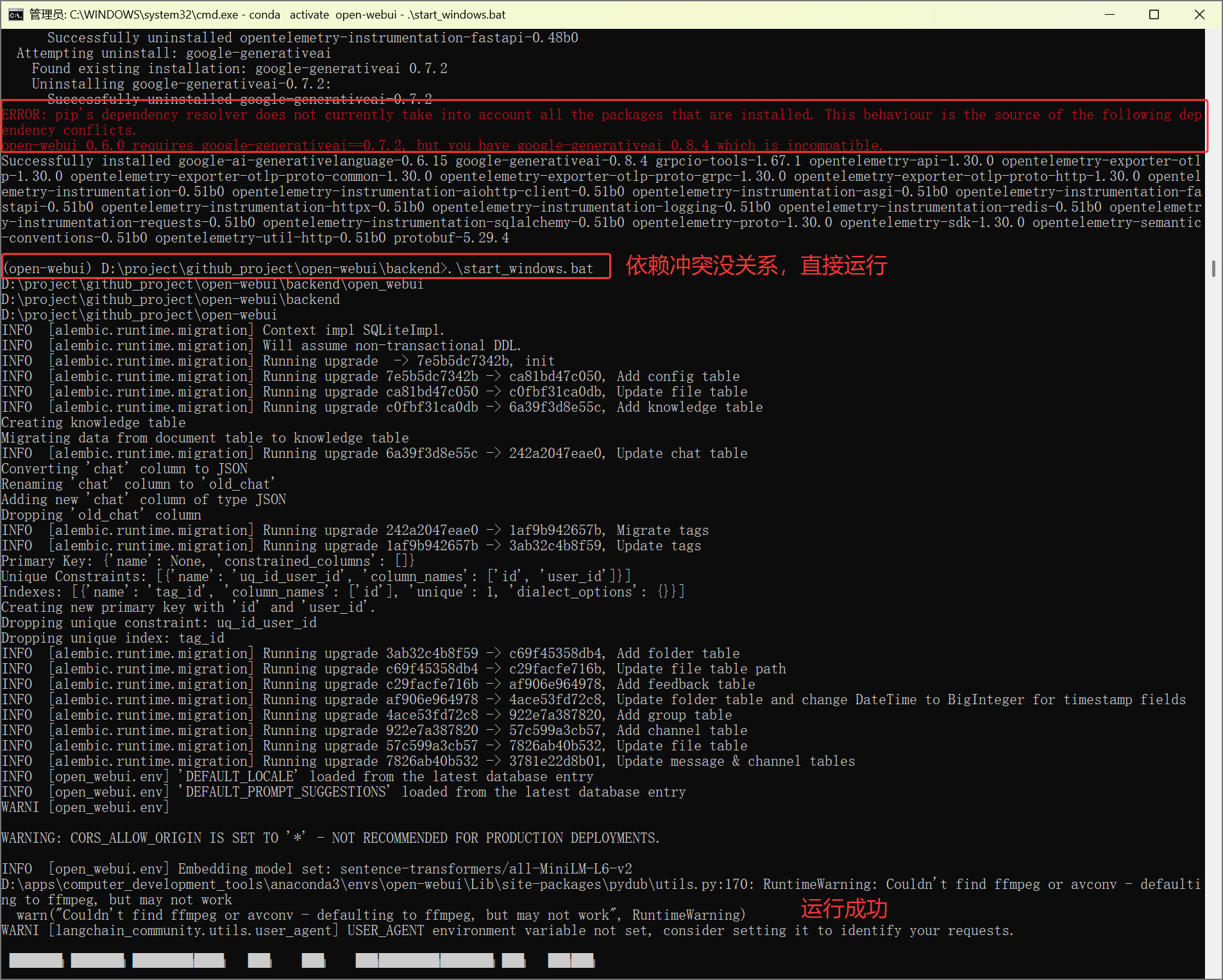

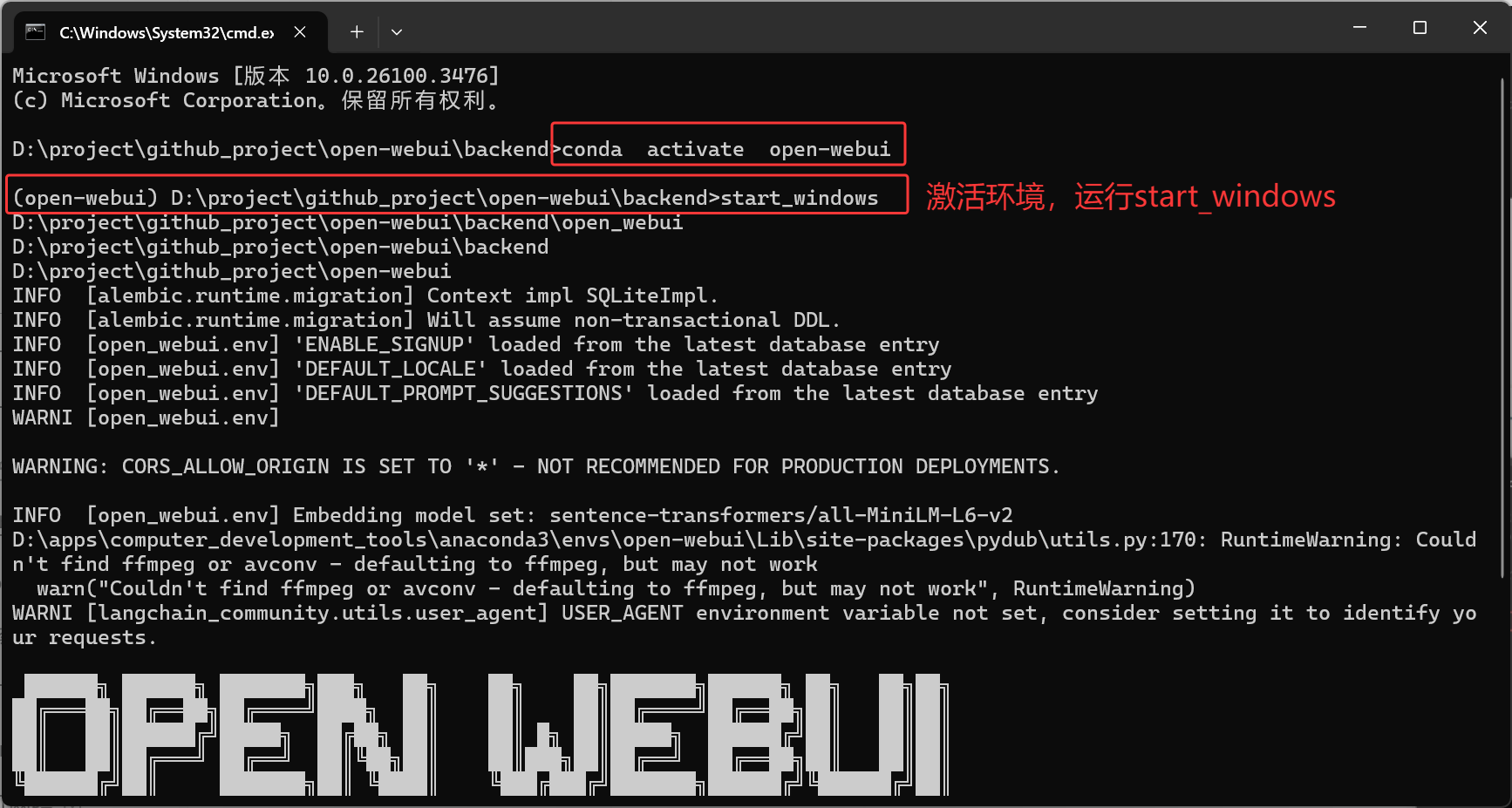

10.运行指令:.\start_windows.bat

平常使用

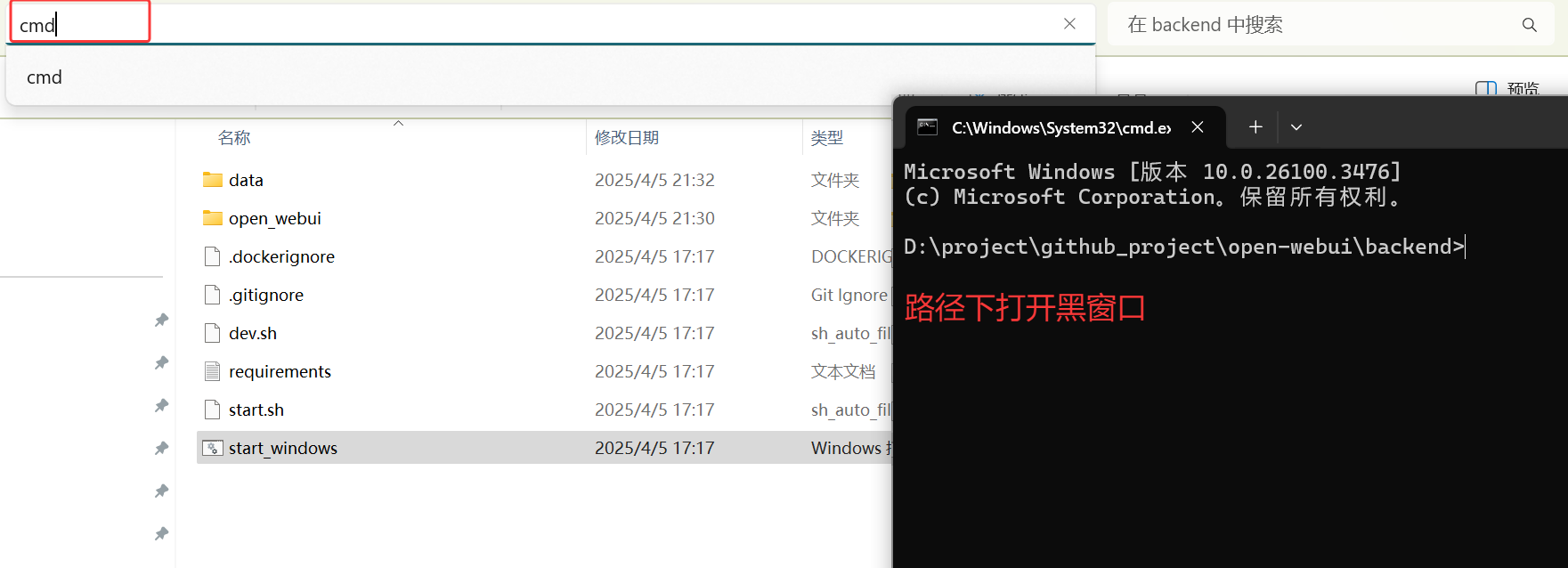

1.路径打开黑窗口,避免切目录

2.虚拟环境下运行黑窗口

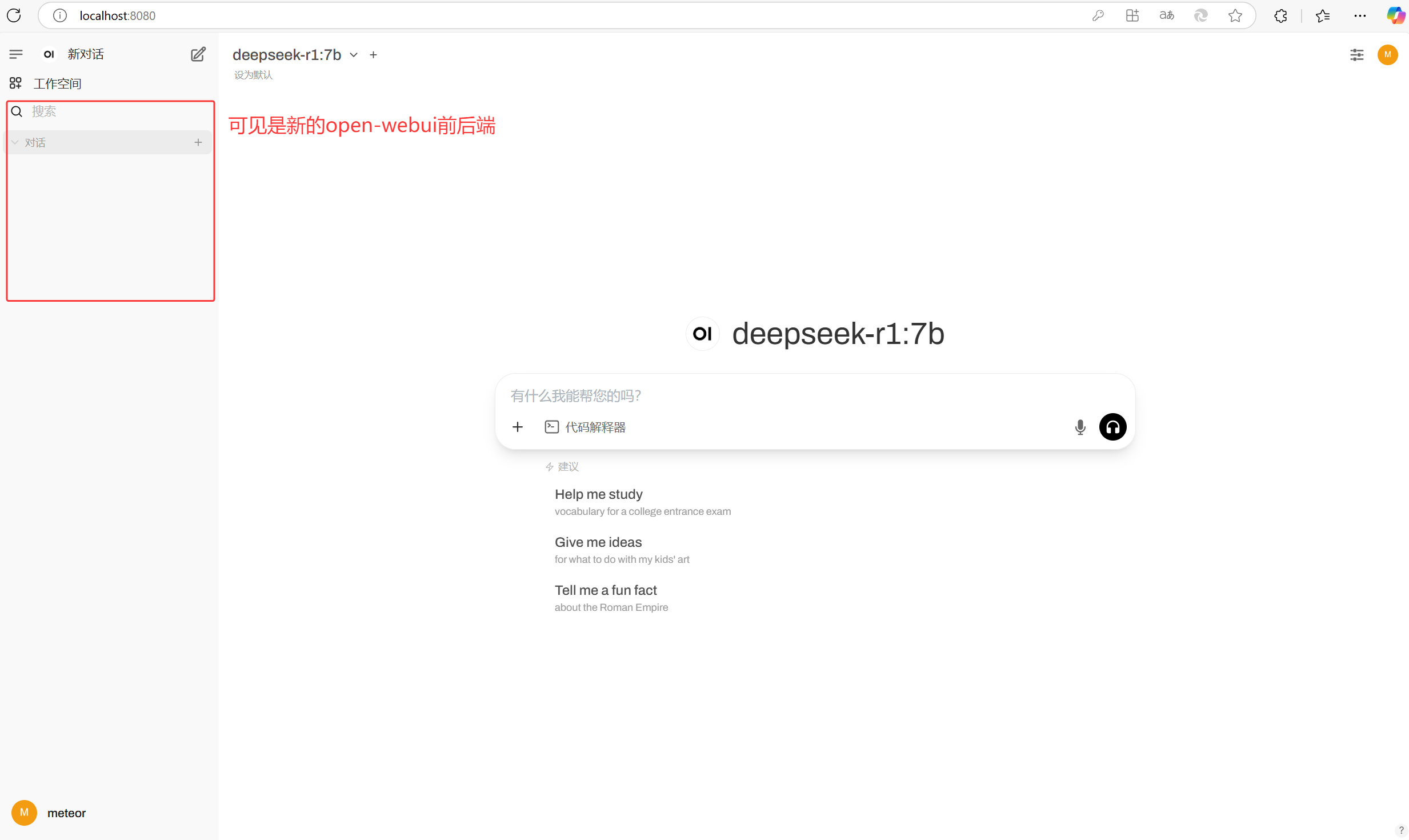

11.浏览器输入localhost:8080,聊天记录是空的,可见是新部署的。

四、我的疑惑

Q1:为什么右键项目,使用pycharm打开,运行后端的main.py文件,报无法打开数据库文件(unable to open database file),管理员运行pycharm也不行。。。