导读

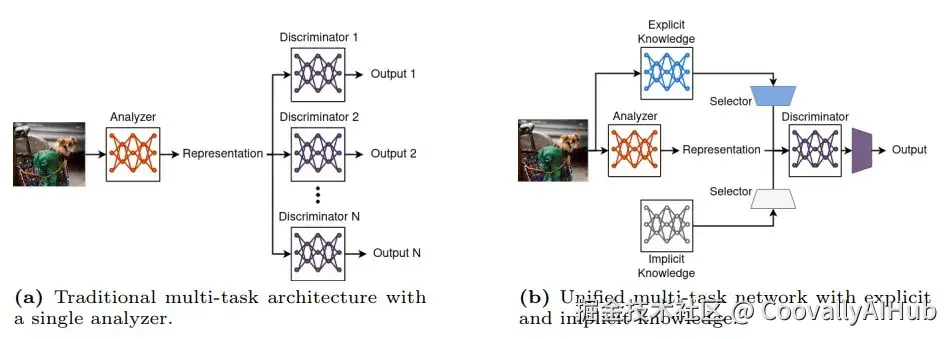

在目标检测领域,YOLO系列以其高效的推理速度广受欢迎,而Transformer结构则在精度上展现出强大潜力。如何兼顾二者优势,打造一个"又快又准"的模型,是近年来研究热点之一。本文介绍的一项新研究------YotoR(You Only Transform One Representation) ,首次将Swin Transformer 与YoloR架构深度融合,提出了一套新的混合检测模型家族,在多个评测任务中都实现了对原模型的性能超越,值得重点关注。

在过去的研究中,Transformer虽然在图像分类、分割等任务中展现了强大的全局建模能力,但由于计算复杂度高、速度慢,它一直难以进入实时目标检测的主流应用。而另一方面,以YOLO为代表的CNN结构,虽在速度上有明显优势,但在复杂场景下的检测精度仍有提升空间。

能否将二者优势融合?

这正是YotoR模型所尝试解决的问题。

YotoR模型:你只需要转换一个表示

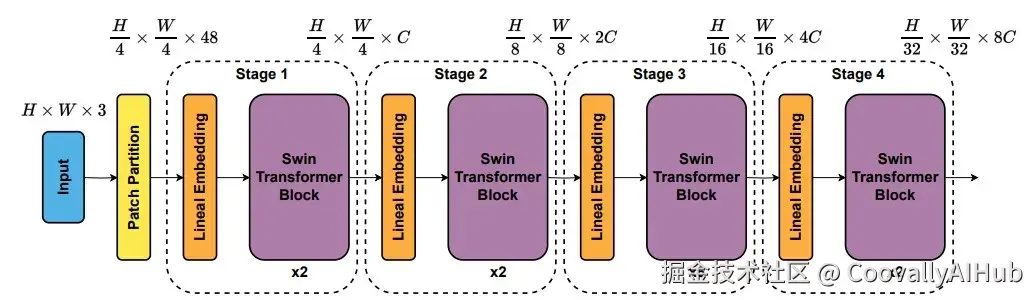

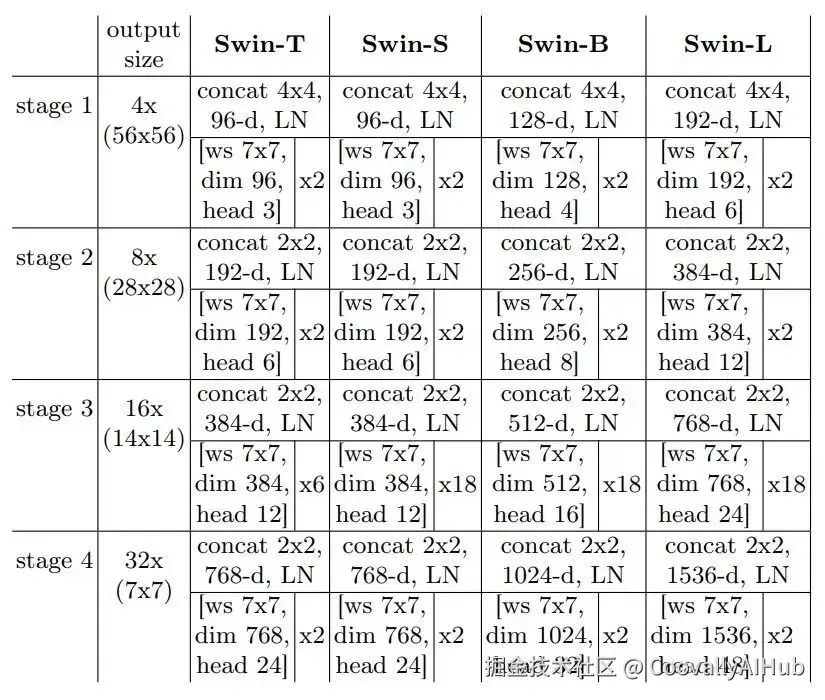

YotoR模型系列,其核心思路是结合Swin Transformer作为特征提取器 ,再连接YoloR的检测头,兼顾Transformer的建模能力和YOLO系列的实时性。

YotoR的结构看似简单,实则暗藏巧思:

- Swin Transformer: 负责提取层次化的全局特征;

- YoloR Head & Neck: 借助YOLO家族成熟的检测机制,实现快速、高效的目标定位。

这种混合式设计不仅提升了检测性能,还大大缩短了Transformer模型的推理时延。

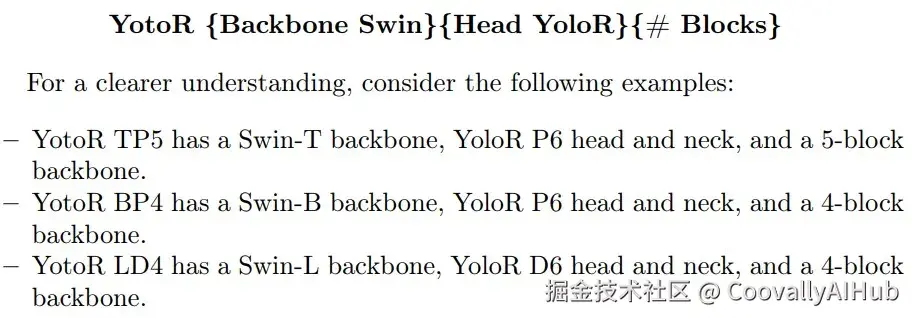

- 命名形式

YotoR {Backbone类型}{Head版本}{Block数量}

- YotoR TP5: Swin-Tiny 作为 Backbone,YoloR-P6 作为 Head,使用 5 个主干模块;

- YotoR BP4: Swin-Base + YoloR-P6 + 4 个主干模块;

- YotoR BB4: Swin-Base + 自适配的 YoloR 头部,去除了尺寸适配卷积,更"原生"融合。

其中 TP5 和 BP4 是本文重点实验对象。

技术亮点:为什么YotoR值得深入关注?

YotoR 不只是结构的拼接,更是一种有针对性地融合。它在以下几个关键维度上带来了突破:

- 高效融合Transformer与YOLO:兼顾全局与实时性

- Swin Transformer 具备强大的全局建模和层次特征提取能力,但其计算复杂度高,限制了在高分辨率检测任务中的实时部署。

- YoloR 架构则以轻量、高速、实用著称,特别适合边缘设备和实时响应场景。

YotoR的创新点在于,利用Swin Transformer作为特征提取Backbone ,再通过YoloR的Neck+Head结构进行快速目标回归 ,从而平衡精度与推理速度,填补了"高性能但不实时"和"实时但不够准"之间的空档。

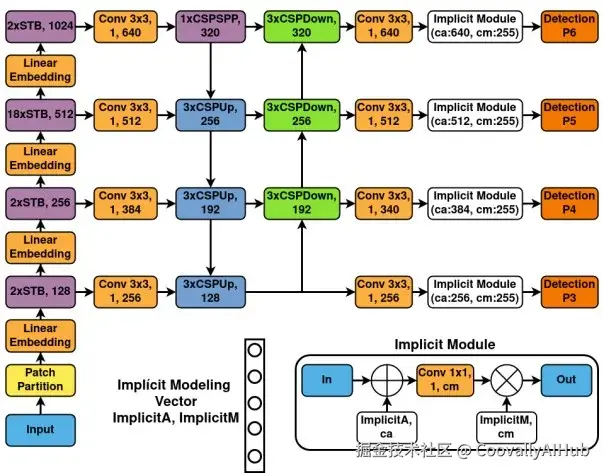

- 精心设计的连接适配模块,消除信息瓶颈

Transformer提取的特征与YOLO系列的输入维度存在差异。YotoR在连接这两个模块时,通过线性嵌入+1×1卷积对通道数、空间维度进行匹配,确保特征信息不被压缩或截断。

其中:

- YotoR TP4是基础结构,但存在连接通道不匹配导致的信息瓶颈;

- YotoR TP5、BP4在结构设计上补足了关键层级,使得信息传递更顺畅,表现明显优于原YOLO和Transformer模型。

- 无需改动Transformer结构,原生支持预训练权重

相比某些结构重构方法,YotoR不修改Swin Transformer的主体结构,这意味着可以直接复用公开的ImageNet预训练模型,显著加快收敛速度、降低训练成本。

这种"原生融合"的设计,不仅简化了实现,也为未来的迁移学习、多任务检测奠定了良好基础。

- 可扩展性强,支持不同规模组合

YotoR提供了多种组合方式(TP4、TP5、BP4、BB4等),对应不同任务对速度、精度、资源消耗的要求。

未来可以根据业务场景,进一步探索如下组合:

- 更强 backbone: 如 Swin-L + YoloR-D6 → YotoR LD5;

- 更轻 head: 替换为 Nano Head → 部署到 Jetson/树莓派;

- 多模态输入: 引入热红外、深度图等信息。

实验结果详解:YotoR到底有多强?

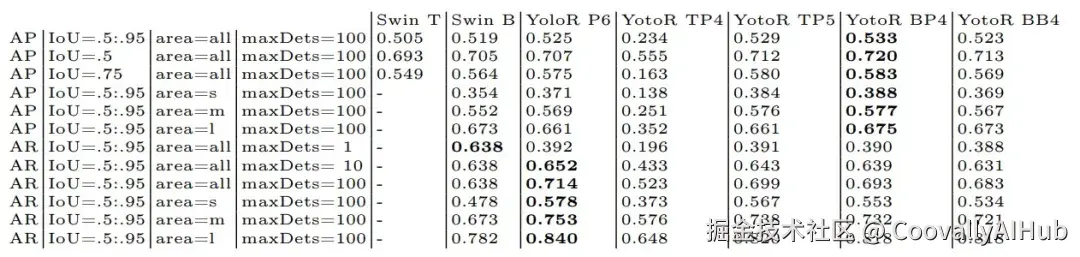

研究团队在MS COCO数据集上对多个YotoR模型进行了全面评估,重点对比对象包括:

- Swin Transformer 原始模型(Swin-T、Swin-B)

- YoloR P6(当前主流的 YOLO 检测模型之一)

- 提出的 YotoR 变体(TP4、TP5、BP4、BB4)

- 检测精度:YotoR全面超越原模型

结论: YotoR 在整体 mAP 上超越了 Swin 和 YoloR 各自的基线模型,尤其在中大目标上表现突出,BP4在大目标检测上性能最优。

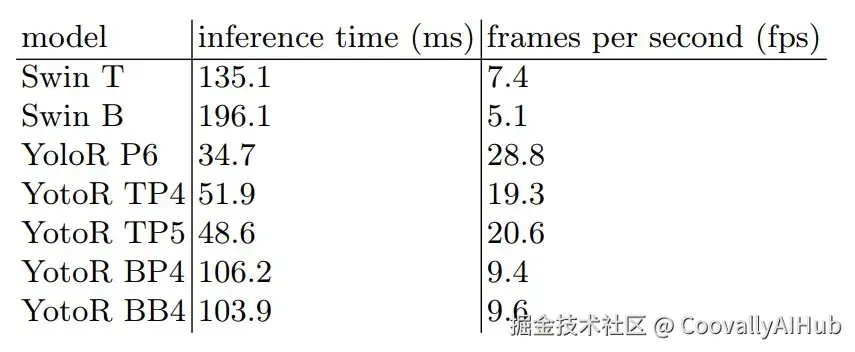

- 推理速度:提升明显,达到实用级帧率

结论: 虽然无法完全追平 YOLO 的速度,但TP5 帧率比 Swin-T 提升178% ,同时在精度上更优;BP4 则比 Swin-B 快了近一倍。

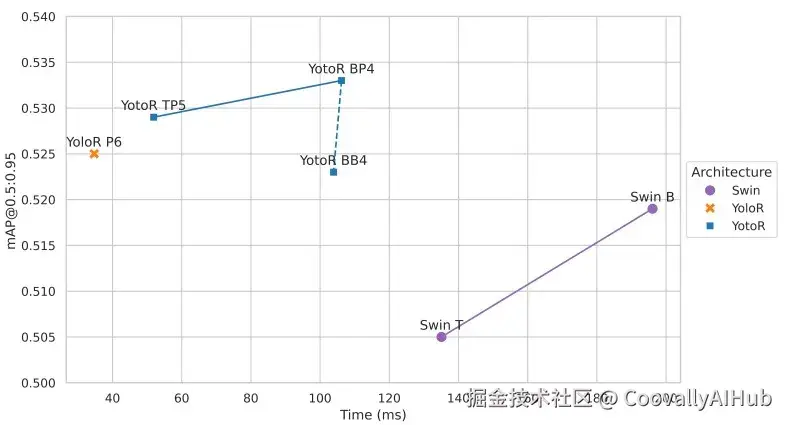

- 综合表现:YotoR实现更优精度-速度权衡

如下图所示(论文图4),YotoR 模型均处于"更高精度+更快速度"的优势区域,表现出极佳的实用性。

YotoR 模型的 mAP/FPS 均衡点,优于单独使用 YOLO 或 Swin Transformer 的任一模型。

实战架构解析

以 YotoR BP4 为例,其结构如下:

- Backbone: Swin-B Transformer,提取多尺度特征;

- Linear Embedding: 用于对齐 Swin 输出与 YoloR 输入;

- Neck & Head: YoloR P6 结构,用于生成最终检测框;

- 特别设计了结构对齐与卷积通道调整模块,确保两部分自然过渡,避免信息瓶颈。

此外,YotoR 还支持不同规模模型的组合,如 TP4、TP5、BB4,满足从轻量级到高性能的多场景需求。

总结

YotoR以其创新的结构设计和优秀的实战表现,为目标检测领域提供了一个兼具Transformer精度优势与YOLO实时效率的融合范式。在轻量化部署、工业视觉、自动驾驶等高要求场景中,它无疑将成为极具潜力的新一代解决方案。