【导读】

无需昂贵ReID网络,FastTracker凭借几何与场景认知在复杂交通场景中实现精准实时追踪。 在MOT等多项基准中实现SOTA,为智慧交通带来更轻、更快的多目标跟踪新方案。>>更多资讯可加入CV技术群获取了解哦

多目标跟踪(MOT)技术是智能监控、自动驾驶等领域的核心基础,但在现实场景中,尤其是在车辆与行人混杂、遮挡频繁的复杂交通环境中,传统方法往往表现不佳。大多数现有跟踪器(如DeepSORT、ByteTrack)虽然在行人跟踪上表现优秀,但在多类别、高密度、多方向的真实场景中泛化能力有限。

今天我们要介绍的FastTracker,正是为了解决这一问题而诞生。它不仅在不依赖重计算网络的情况下实现了多类别实时跟踪,更在多个权威数据集上刷新了记录,表现出了极强的实用性和鲁棒性。

论文标题:

FastTracker: Real-Time and Accurate Visual Tracking

论文 链接 :

代码地址:

核心创新:轻量而智能的跟踪机制

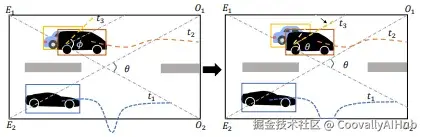

- occlusion-aware 遮挡处理:不靠ReID,也能"记住"谁是谁

传统方法通常依赖复杂的卷积网络(CNN)进行重识别(Re-ID),计算成本高、难以实时运行。FastTracker提出了一种纯几何驱动的遮挡处理机制:

- 覆盖度量(Coverage Metric) :通过目标之间的空间重叠情况判断是否发生遮挡,尤其适用于大小差异明显的物体;

- 速度阻尼(DampenVelocity) :对遮挡中的目标降低其运动速度,防止轨迹漂移;

- 边界框放大(EnlargeBox) :适当扩大框体尺寸,提高重现时的匹配成功率。

这些策略共同作用,使得系统在严重遮挡后仍能保持ID一致性,如下图所示:

- 环境感知轨迹校正:让交通规则"指导"跟踪

FastTracker创新地引入了场景结构先验,比如车道方向、十字路口、人行道区域等,构建"运动锥"模型:

- 区域限制 (ClampToROI) : 利用预先定义的道路区域(ROI),防止目标轨迹漂移到路外等不可能出现的区域。

- 方向约束 (ProjectToCone) : 根据车道线方向定义一个合理的"运动锥",如果目标的预测运动方向超出了这个锥形范围,就将其投影回合理的方向内。

这种方式不仅提升了轨迹连续性,也大幅减少了ID切换,尤其在结构化道路场景中效果显著。

- 两阶段匹配策略:先准后全,平衡召回与精度

继承并优化了ByteTrack的双阶段匹配机制:

- 第一阶段: 高置信度检测框与现有轨迹匹配(宽松阈值,提高召回);

- 第二阶段: 低置信度检测框与未匹配轨迹匹配(严格阈值,控制误匹配)。

这一策略在保证高精度的同时,尽可能找回被遗漏的目标,尤其适用于遮挡密集的场景。

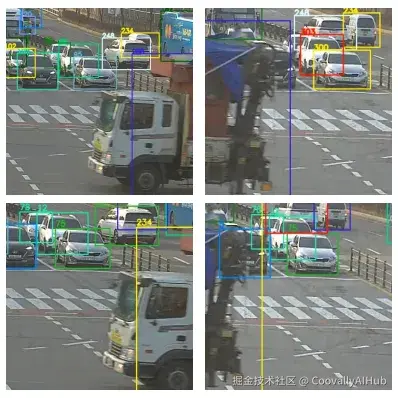

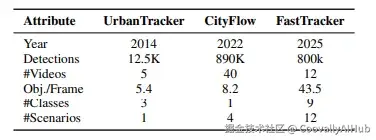

全新基准数据集:FastTrack Benchmark

为更全面评估跟踪器在真实交通环境中的表现,团队发布了FastTrack数据集,具备以下特点:

- 高密度: 平均每帧43.5个目标,是CityFlow的5倍以上;

- 多类别: 包含车辆(轿车、卡车、巴士、摩托等)与行人共9类;

- 多场景: 涵盖十字路口、隧道、高速路、人行横道等12类场景;

- 多光照: 包含白天、夜晚、阴影过渡等复杂光照条件。

该数据集极大弥补了现有数据集中在复杂性与真实性方面的不足。

如果你也在为寻找数据集苦恼,在Coovally上,持续集成和开源多类高质量数据集, 覆盖自动驾驶、安防监控、工业检测等多个领域,推动AI开发更加高效与开放。

!!点击下方链接,立即体验Coovally!!

平台链接: www.coovally.com

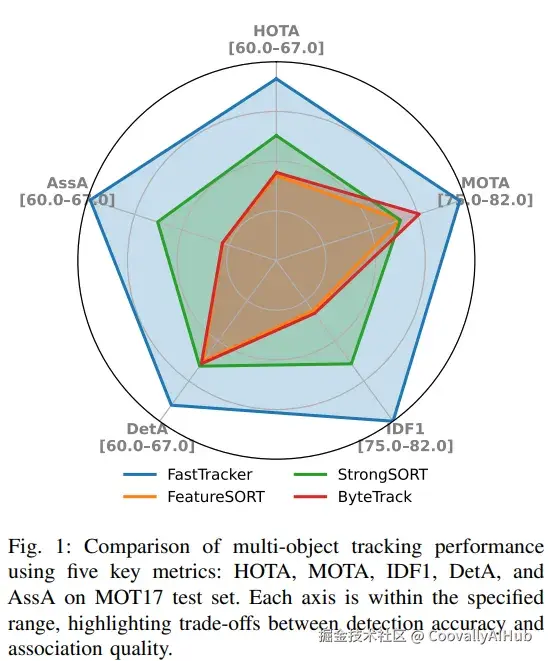

实验结果:全面领先,实时高效

FastTracker在多个公开数据集与自建数据集上均达到最先进水平(SOTA),部分结果如下:

- MOT17 测试集:

** **

**

- MOTA: 81.8 | HOTA: 66.4 | IDF1: 82.0

- ID切换数最低(885),漏检数最低(75162)

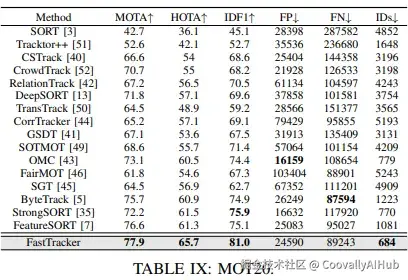

- MOT20 测试集(极端拥挤场景):

- MOTA: 77.9 | HOTA: 65.7 | IDF1: 81.0

- 全面领先ByteTrack、StrongSORT等主流方法

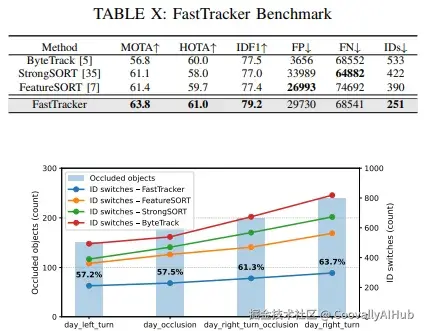

- 自建FastTrack数据集:

** **

**

- MOTA: 63.8 | HOTA: 61.0 | IDF1: 79.2

- 身份切换数仅为251,显著优于对比基线

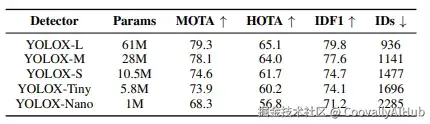

- 轻量级适配能力:

即使搭配YOLOX-Nano(参数量仅1M),FastTracker仍能在MOT17上达到:

- MOTA: 68.3 | IDF1: 71.2

- 可在边缘设备实现实时推理,极具部署价值。

除了高性能的推理部署,Coovally平台也为算法开发与实验提供了强大支持。 研究人员和开发者可以在平台上使用自己熟悉的开发工具(如 VS Code、Cursor 等),通过 SSH 协议直连云端算力,享受如同本地一样的实时开发与调试体验,同时调用高性能 GPU 环境,加速实验进展。

为了帮助用户更高效地掌握模型训练全过程,Coovally平台还可以直接查看"实验日志" 。在每一个实验详情页中,用户都可以实时查看训练日志、输出信息或报错内容,无需额外配置、无缝集成于工作流中!

不论是模型调参、错误排查,还是过程复现,这项新功能都将大幅提升你的实验效率。

总结:推开多类别实时跟踪的新大门

FastTracker通过轻量遮挡处理、环境感知优化、两阶段匹配三大核心创新,在不依赖昂贵ReID网络的前提下,实现了多类别、高密度、复杂场景下的精准实时跟踪。

它不仅在多项权威评测中刷新记录,还提供了首个专注于城市CCTV视角的多类别跟踪数据集FastTrack,极大推动了行业在真实场景中的算法评估与落地进展。