作为目标检测领域的经典模型,YOLOv4 以 "单 GPU 可训练、精度速度双优" 为核心亮点,其设计思路和技术细节对开发者极具参考价值。

一、YOLOv4 整体介绍:从 "定位" 到 "性能"

这部分主要明确了 YOLOv4 的核心优势和行业地位,是理解后续技术的基础。

1.1 核心定位:"亲民" 且 "能打"

单 GPU 友好:所有实验均基于单 GPU 完成,无需依赖多 GPU 集群,大幅降低了训练门槛,普通开发者也能复现和使用。

精髓传承:虽作者变更,但延续了 YOLO 系列 "实时检测" 的核心基因,同时在细节上做了极致优化(PPT 中 "细还是他细" 的评价正源于此)。

1.2 核心思路:两大维度 + 充分验证

优化方向:从 "数据层面" 和 "网络设计层面" 双管齐下,前者通过数据增强提升泛化能力,后者通过组件改进优化特征提取。

消融实验充分:PPT 提到 "能做的都做了",意味着每个技术点都经过了对比验证,确保效果可复现、有依据。

1.3 性能表现:碾压同期模型

从 PPT 中的 "FPS(速度)vs mAP(精度)" 对比图(V100 显卡测试)可看出:

YOLOv4 在实时检测(real-time)场景下,精度(mAP)超过 YOLOv3、EfficientDet(D0-D4)、ASFF 等模型;

同时保持了优秀的速度(FPS),实现了 "速度与精度的最优平衡",堪称当时目标检测领域的 "全能选手"。

二、核心技术:Bag of Freebies(BOF)------ 无推理代价的精度提升

"BOF" 指只增加训练阶段成本,不影响推理速度的技术,是 YOLOv4 精度提升的关键

2.1 数据增强:让训练数据 "更丰富"

通过多样化数据输入,迫使模型学习更鲁棒的特征,避免过拟合

Mosaic:参考 CutMix 思路,将 4 张不同图像拼接成 1 张进行训练,大幅增加数据多样性,且无需额外推理成本。

Random Erase:用随机值或训练集平均像素值,替换图像中的随机区域,模拟 "部分遮挡" 场景。

Hide and Seek:按概率随机隐藏图像中的多个小补丁,让模型关注全局特征而非局部细节。

Self-adversarial-training(SAT):通过给图像引入 "噪音点" 增加训练难度,提升模型对干扰的抵抗能力。

2.2 网络正则化:让模型 "不自信"

解决神经网络 "过拟合、过度自信" 的痛点,提升泛化能力

DropBlock:对比传统 Dropout(随机遮挡单个像素点),DropBlock 直接 "遮挡一个连续区域",更贴合目标检测中 "目标是连续区域" 的特点,迫使模型学习全局特征。

Label Smoothing:将 "硬标签"(如 [0,1])软化成 "软标签"(如 [0.05, 0.95],公式:标签 ×(1-ε)+ε/ 类别数,ε 取 0.1),避免模型对预测结果过度自信,有效缓解过拟合。

2.3 损失函数优化:让框回归 "更精准"

针对传统 IOU 损失的痛点,提出改进方案,提升预测框与真实框的匹配度。

传统 IOU 的痛点:① 预测框与真实框无交集时,IOU=0,梯度无法计算,模型无法学习;② 相同 IOU 值下,无法区分预测框的位置差异(如 "偏左" 和 "偏右" 可能 IOU 相同)。

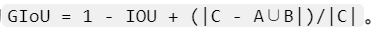

GIoU(Generalized IOU) :引入 "能同时包含预测框(A)和真实框(B)的最小封闭框 C",公式为 。既解决了 "无交集时梯度为 0" 的问题,又能通过封闭框 C 反映位置差异,引导预测框向真实框靠近。

。既解决了 "无交集时梯度为 0" 的问题,又能通过封闭框 C 反映位置差异,引导预测框向真实框靠近。

三、关键网络组件:SPPNet------ 解决输入大小难题

YOLOv4 中用于优化特征处理的核心组件 ------SPPNet(空间金字塔池化)

背景:YOLOv3 训练时需调整输入图像大小以适配网络,灵活性差。

SPPNet 作用:通过 "多尺度最大池化" 操作,将不同尺寸的输入特征图,转换为固定尺寸的特征输出。无需改变输入图像大小,既提升了训练灵活性,又能完整保留多尺度特征信息。

四、小结:核心逻辑

围绕 YOLOv4"单 GPU 可训练、精度速度双优" 的核心目标展开:

以 "BOF 技术" 为核心,通过数据增强、正则化、损失优化,在不影响推理速度的前提下大幅提升精度;

以 "SPPNet" 为辅助,优化特征处理流程,解决输入大小适配问题;

所有设计均围绕 "降低门槛、提升效果",为后续网络设计(如 BOS 技术)打下坚实基础。