1. 哈希概念

哈希(hash)⼜称散列,是⼀种组织数据的⽅式。从译名来看,有散乱排列的意思。本质就是通过哈希函数把关键字Key跟存储位置建⽴⼀个映射关系,查找时通过这个哈希函数计算出Key存储的位置,进⾏快速查找。

1.1 直接定址法

当关键字的范围⽐较集中时,直接定址法就是⾮常简单⾼效的⽅法,⽐如⼀组关键字都在[0,99]之间, 那么我们开⼀个100个数的数组,每个关键字的值直接就是存储位置的下标。再⽐如⼀组关键字值都在[a,z]的⼩写字⺟,那么我们开⼀个26个数的数组,每个关键字的acsii码 - 'a' 就是存储位置的下标。 也就是说直接定址法本质就是⽤关键字计算出⼀个绝对位置或者相对位置。这个⽅法我们在计数排序部分已经⽤过了,其次在string章节的下⾯OJ也⽤过了。

cpp

// 先计算每个字母出现的次数

// 然后从头开始找

class Solution {

public:

int firstUniqChar(string s) {

int arr[26]={0};

for(int i=0;i<s.size();i++)

{

//每个关键字的acsii码 - 'a' 就是存储位置的下标

arr[s[i]-'a']++;

}

for(int i=0;i<s.size();i++)

{

if(arr[s[i]-'a']==1)

return i;

}

return -1;

}

};1.2 哈希冲突

直接定址法的缺点也⾮常明显,当关键字的范围⽐较分散时,就很浪费内存甚⾄内存不够⽤。假设我 们只有数据范围是[0, 9999]的N个值,我们要映射到⼀个M个空间的数组中(⼀般情况下M >= N),那么 就要借助哈希函数(hash function)hf,关键字key被放到数组的h(key)位置,这⾥要注意的是h(key)计 算出的值必须在[0, M)之间。这⾥存在的⼀个问题就是,两个不同的key可能会映射到同⼀个位置去,这种问题我们叫做哈希冲突, 或者哈希碰撞。理想情况是找出⼀个好的哈希函数避免冲突,但是实际场景中,冲突是不可避免的, 所以我们尽可能设计出优秀的哈希函数,减少冲突的次数,同时也要去设计出解决冲突的⽅案。

1.3 负载因⼦

假设哈希表中已经映射存储了N个值,哈希表的⼤⼩为M,那么负载因子=N/M ,负载因⼦有些地⽅也翻译为载荷因⼦/装载因⼦等,他的英⽂为load factor。负载因子其实就是数组的空间利用率。负载因⼦越⼤,哈希冲突的概率越⾼,空间利⽤率越⾼;负载因⼦越⼩,哈希冲突的概率越低,空间利⽤率越低;

1.4 将关键字转为整数

我们将关键字映射到数组中位置,⼀般是整数好做映射计算,如果不是整数,我们要想办法转换成整 数,这个细节我们后⾯代码实现中再进⾏细节展⽰。下⾯哈希函数部分我们讨论时,如果关键字不是整数,那么我们讨论的Key是关键字转换成的整数。

1.5 哈希函数

⼀个好的哈希函数应该让N个关键字被等概率的均匀的散列分布到哈希表的M个空间中,但是实际中却 很难做到,但是我们要尽量往这个⽅向去考量设计。

1.5.1 除法散列法/除留余数法

• 除法散列法也叫做除留余数法,顾名思义,假设哈希表的⼤⼩为M,那么通过key除以M的余数作为 映射位置的下标,也就是哈希函数为:h(key) = key % M。

• 当使⽤除法散列法时,要尽量避免M为某些值,如2的幂,10的幂等。如果是2^X ,那么key % 2^X ,本质相当于保留key的后X位,那么后x位相同的值,计算出的哈希值都是⼀样的,就冲突了。如: {63 , 31}看起来没有关联的值,如果M是16,也就是2^4 ,那么计算出的哈希值都是15,因为63的⼆ 进制后8位是 00111111,31的⼆进制后8位是 00011111。如果是10^X ,就更明显了,保留的都是 10进值的后x位,如:{112, 12312},如果M是100,也就是10^2 ,那么计算出的哈希值都是12

• 当使⽤除法散列法时,建议M取不太接近2的整数次幂的⼀个质数(素数)。C++里是直接给了一个这样子的素数数组用于数组扩容使用,里面相邻的元素之间的大小相当于2倍关系。

• 需要说明的是,实践中也是⼋仙过海,各显神通,Java的HashMap采⽤除法散列法时就是2的整数次幂做哈希表的⼤⼩M,这样玩的话,就不⽤取模,⽽可以直接位运算,相对⽽⾔位运算⽐模更⾼效⼀些(因为除法的效率没位运算来的高效)。但是他不是单纯的去取模,⽐如M是2^16次⽅,本质是取后16位,那么⽤key2 = key >> 16,然后把 key 和 key2 异或的结果作为哈希值。也就是说我们映射出的值还是在[0,M)范围 内,但是尽量让key所有的位都参与计算,这样映射出的哈希值更均匀⼀些即可。所以我们上⾯建议M取不太接近2的整数次幂的⼀个质数的理论是⼤多数数据结构书籍中写的理论,但是实践中, 灵活运⽤,抓住本质,⽽不能死读书。

1.5.2 乘法散列法(了解)

• 乘法散列法对哈希表⼤⼩M没有要求,他的⼤思路第⼀步:⽤关键字 K 乘上常数 A (0<A<1)

• h(key) = floor(M × ((A × key)%1.0)),其中floor表⽰对表达式进⾏下取整,A∈(0,1),这⾥ 最重要的是A的值应该如何设定,Knuth认为 (⻩⾦分割点) ⽐较好。 A = ( 5 − 1)/2 = 0.6180339887....

• 乘法散列法对哈希表⼤⼩M是没有要求的,假设M为1024,key为1234,A = 0.6180339887, A*key = 762.6539420558,取⼩数部分为0.6539420558, M×((A×key)%1.0) = 0.6539420558*1024 = 669.6366651392,那么h(1234) = 669。

总结:

即乘法散列法就是用关键字key*黄金分割数(0.6180339887....),然后取小数x,再用x*M,将最终结果y向下取整。

1.5.3 全域散列法(了解)

• 如果存在⼀个恶意的对⼿,他针对我们提供的散列函数,特意构造出⼀个发⽣严重冲突的数据集, ⽐如,让所有关键字全部落⼊同⼀个位置中。这种情况是可以存在的,只要散列函数是公开且确定 的,就可以实现此攻击。解决⽅法⾃然是⻅招拆招,给散列函数增加随机性,攻击者就⽆法找出确 定可以导致最坏情况的数据。这种⽅法叫做全域散列。

• hab (key) = ((a × key + b)%P )%M ,P需要选⼀个⾜够⼤的质数,a可以随机选[1,P-1]之间的 任意整数,b可以随机选[0,P-1]之间的任意整数,这些函数构成了⼀个P*(P-1)组全域散列函数组。 假设P=17,M=6,a = 3,b = 4, 则 h34 (8) = ((3 × 8 + 4)%17)%6 = 5。

• 需要注意的是每次初始化哈希表时,随机选取全域散列函数组中的⼀个散列函数使⽤,后续增删查 改都固定使⽤这个散列函数,否则每次哈希都是随机选⼀个散列函数,那么插⼊是⼀个散列函数, 查找⼜是另⼀个散列函数,就会导致找不到插⼊的key了。

总结:

为了防止有人破解了哈希函数后进行恶意攻击,我们选择使用以下这个哈希函数:hab (key) = ((a × key + b)%P )%M,每次初始化哈希表时a和b的值都是系统随机从[1,P-1]和[0,P-1]中选取的,给散列函数增加随机性,攻击者就⽆法找出确 定可以导致最坏情况的数据。

函数组是 "逻辑上的集合",不是 "物理上存好的一堆函数",本质是同一个全域散列公式,通过 a、b 的不同取值,形成不同的 "具体函数实例"。

1.5.4 其他⽅法(了解)

平⽅取中法、折叠法、随机数法、数学分析法等,这些⽅ 法相对更适⽤于⼀些局限的特定场景。

1.6 处理哈希冲突

实践中哈希表⼀般还是选择除法散列法作为哈希函数,当然哈希表⽆论选择什么哈希函数也避免不了 冲突,那么插⼊数据时,如何解决冲突呢?主要有两种两种⽅法,开放定址法和链地址法。

1.6.1 开放定址法

在开放定址法中所有的元素都放到哈希表⾥,当⼀个关键字key⽤哈希函数计算出的位置冲突了,则按照某种规则找到⼀个没有存储数据的位置进⾏存储,开放定址法中负载因⼦⼀定是⼩于的。这⾥的规则有三种:线性探测、⼆次探测、双重探测。

线性探测

• 从发⽣冲突的位置开始,依次线性向后探测,直到寻找到下⼀个没有存储数据的位置为⽌,如果⾛ 到哈希表尾,则回绕到哈希表头的位置。

• h(key) = hash0 = key % M ,如果hash0位置冲突了(即hash0位置的状态是:存在exist),则线性探测公式为:hc(key,i) = hashi = (hash0 + i) % M, i = {1, 2, 3, ..., M − 1} ,因为负载因⼩于1, 则最多探测M-1次,⼀定能找到⼀个存储key的位置。

• 线性探测的⽐较简单且容易实现,线性探测的问题假设,hash0位置连续冲突,hash0,hash1, hash2位置已经存储数据了,后续映射到hash0,hash1,hash2,hash3的值都会争夺hash3位 置,这种现象叫做群集/堆积。下⾯的⼆次探测可以⼀定程度改善这个问题。

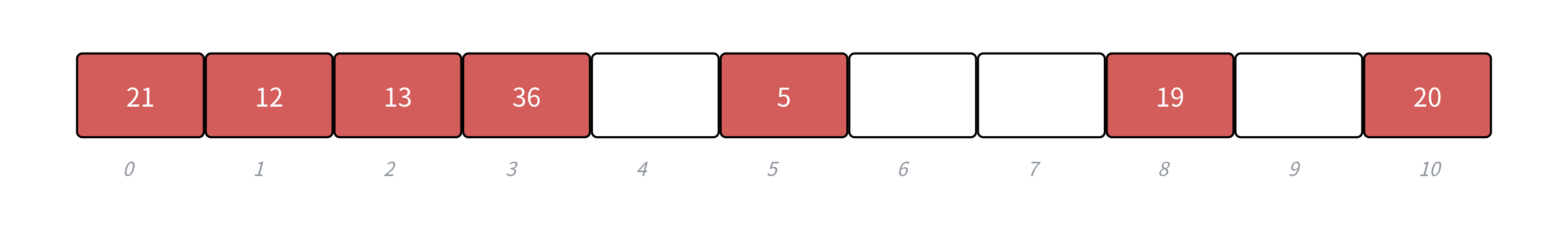

• 下⾯演⽰ {19,30,5,36,13,20,21,12} 等这⼀组值映射到M=11的表中。

h(19) = 8,h(30) = 8,h(5) = 5,h(36) = 3,h(13) = 2,h(20) = 9,h(21) = 10,h(12) = 1

⼆次探测

• 从发⽣冲突的位置开始,依次左右按⼆次⽅跳跃式探测,直到寻找到下⼀个没有存储数据的位置为⽌,如果往右⾛到哈希表尾,则回绕到哈希表头的位置;如果往左⾛到哈希表头,则回绕到哈希表 尾的位置;

• h(key) = hash0 = key % M ,如果hash0位置冲突了,则⼆次探测公式为: hc(key,i) = hashi = (hash0 ± i^2 ) % M, i = {1, 2, 3, ..., M/2}

• ⼆次探测当hashi = (hash0 − i^2)%M 时,当hashi<0时,需要hashi+M

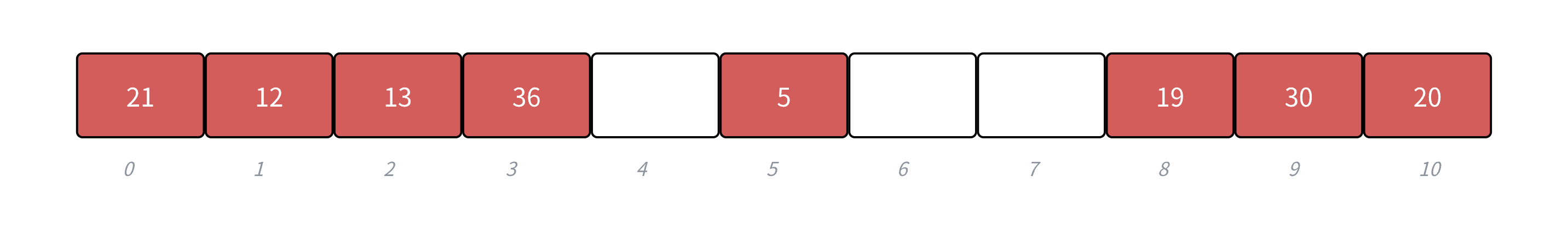

• 下⾯演⽰ {19,30,52,63,11,22} 等这⼀组值映射到M=11的表中。

h(19) = 8, h(30) = 8, h(52) = 8, h(63) = 8, h(11) = 0, h(22) = 0

双重散列(了解)

• 第⼀个哈希函数计算出的值发⽣冲突,使⽤第⼆个哈希函数计算出⼀个跟key相关的偏移量值,不 断往后探测,直到寻找到下⼀个没有存储数据的位置为⽌。

• h1 (key) = hash0 = key % M , hash0位置冲突了,则双重探测公式为: hc(key,i) = hashi = (hash0 + i ∗ h2 (key)) % M, i = {1, 2, 3, ..., M}

• 要求 h2 (key) < M 且 h2 (key) 和M互为质数,有两种简单的取值⽅法:

1、当M为2整数幂时, 从[0,M-1]任选⼀个奇数;

2、当M为质数时,h2 (key) h2 (key) = key % (M − 1) + 1

• 保证 h2 (key) 与M互质是因为根据固定的偏移量所寻址的所有位置将形成⼀个群,若最⼤公约数 p = gcd(M, h1 (key)) > 1 ,那么所能寻址的位置的个数为 M/P < M ,使得对于⼀个关键字来 说⽆法充分利⽤整个散列表。举例来说,若初始探查位置为1,偏移量为3,整个散列表⼤⼩为12, 那么所能寻址的位置为{1, 4, 7, 10},寻址个数为 12/gcd(12, 3) = 4

总结:

当第一个哈希函数计算出的值 a 发生冲突是使用第二个哈希函数计算出一个h2,再用变量i *h2计算出偏移量 x 给与 a 以寻找一个没有存储数据的位置。

且必须保证 h2 (key) < M 且 h2 (key) 和M互为质数,否则可能会造成某些位置无法探测到的情况。

1.6.2 开放定址法代码实现

开放定址法在实践中,不如下⾯讲的链地址法,因为开放定址法解决冲突不管使⽤哪种⽅法,占⽤的都是哈希表中的空间,始终存在互相影响的问题,即开放定址法始终会出现抢位置的情况。所以开放定址法,我们简单选择线性探测实现即可。

开放定址法的哈希表结构

cpp

// 状态表

enum State

{

// 存在、空、删除

EXIST,

EMPTY,

DELETE

};

// 节点结构

template<class K, class V>

class HashDate

{

pair<K, V> _kv;

State _state = EMPTY;

};

// 哈希表结构

template<class K, class V>

class HashTable

{

private:

vector<HashDate<K, V>> _tables;

size_t _n;// 表中存储的数据个数

};要注意的是这⾥需要给每个存储值的位置加⼀个状态标识(空、存在、删除),否则删除⼀些值以后,会影响后⾯冲突的值的查找。如下图,我们删除30,会导致查找20失败,当我们给每个位置加⼀个状态标识 {EXIST, EMPTY, DELETE} ,删除30就可以不⽤删除值,⽽是把状态改为 DELETE(删除) ,那么查找20 时是遇到 EMPTY 才停。

h(19) = 8,h(30) = 8,h(5) = 5,h(36) = 3,h(13) = 2,h(20) = 9,h(21) = 10,h(12) = 1

扩容

这⾥我们哈希表负载因⼦控制在0.7,当负载因⼦到0.7以后我们就需要扩容了,我们还是按照2倍扩容,但是同时我们要保持哈希表大小是⼀个质数,哈希表初始值给是质数,2倍后就不是质数了。那么如何解决?,⼀种⽅案就是Java HashMap的使⽤2的整数幂,但是计算时不能直接取模的改进⽅法,得使用位运算的方式。另外⼀种⽅案是sgi版本的哈希表使⽤的⽅法,给了⼀个近似2倍的质数表,每次去质数表获取扩容后的⼤⼩。

cpp

// 质数表,近似2倍

// inline修饰的函数是内敛函数

// 内联函数是指某些简短且使用频繁的函数,为了减少函数调用的开销,将函数替换成了函数体内的代码,用空间换时间

inline unsigned long __stl_next_prime(unsigned long n)

{

// Note: assumes long is at least 32 bits.

static const int __stl_num_primes = 28; // 质数表数据个数

static const unsigned long __stl_prime_list[__stl_num_primes] = {

53, 97, 193, 389, 769,

1543, 3079, 6151, 12289, 24593,

49157, 98317, 196613, 393241, 786433,

1572869, 3145739, 6291469, 12582917, 25165843,

50331653, 100663319, 201326611, 402653189, 805306457,

1610612741, 3221225473, 4294967291

};

// first,last是质数表首元素和尾元素的下一个位置的指针

const unsigned long* first = __stl_prime_list;

const unsigned long* last = __stl_prime_list + __stl_num_primes;

// 在[first,last)范围内找到第一个>=n的元素的指针

const unsigned long* pos = lower_bound(first, last, n);

// 如果n大于质数表中的所有元素,返回最大的元素,否则返回找到位置的元素

return pos == last ? *(last - 1) : *pos;

}key不能取模的问题

当key是string(非int)Date(自定义)等类型时,key不能取模,那么我们需要给HashTable增加⼀个仿函数,这个仿函数⽀持把key转换成⼀个可以取模的整形,如果key可以转换为整形并且不容易冲突,那么这个仿函数就⽤默认参数即可,如果这个Key不能转换为整形,我们就需要⾃⼰实现⼀个仿函数传给这个参数,实现这个仿函数的要求就是尽量key的每值都参与到计算中,让不同的key转换出的整形值不同。string 做哈希表的key⾮常常⻅,所以我们可以考虑把string特化⼀下。

cpp

// 将key转化成size_t

// struct默认是public

template<class K>

struct HashFunc

{

size_t operator()(const K& key)

{

return (size_t)key;

}

};

// 特化string

template<>

struct HashFunc<string>

{

size_t operator()(const string& s)

{

size_t hash = 0;

// 字符串转换成整形,可以把字符ascii码相加即可

// 但是直接相加的话,类似"abcd"和"bcad"这样的字符串计算出是相同的

// 这⾥我们使⽤BKDR哈希的思路,⽤上次的计算结果去乘以⼀个质数

// 这个质数⼀般去31, 131等效果会⽐较好

for (auto ch : s)

{

hash += ch;

hash *= 131;

}

return hash;

}

};开放定址法完整代码

cpp

// 开放定址法

namespace open_address

{

// 状态表

enum State

{

// 存在、空、删除

EXIST,

EMPTY,

DELETE

};

// 节点结构

template<class K, class V>

class HashDate

{

public:

pair<K, V> _kv;

State _state = EMPTY;

};

// 将key转化成size_t

template<class K>

struct HashFunc

{

public:

size_t operator()(const K& key)

{

return (size_t)key;

}

};

// 特化string

template<>

struct HashFunc<string>

{

public:

size_t operator()(const string& s)

{

size_t hash = 0;

// 字符串转换成整形,可以把字符ascii码相加即可

// 但是直接相加的话,类似"abcd"和"bcad"这样的字符串计算出是相同的

// 这⾥我们使⽤BKDR哈希的思路,⽤上次的计算结果去乘以⼀个质数

// 这个质数⼀般去31, 131等效果会⽐较好

for (auto ch : s)

{

hash += ch;

hash *= 131;

}

return hash;

}

};

// 哈希表结构

// K是key,V是数据类型,Hash负责把key转换成size_t

template<class K, class V, class Hash = HashFunc<K>>

class HashTable

{

public:

// 质数表,近似2倍

// inline修饰的函数是内敛函数

// 内联函数是指某些简短且使用频繁的函数,为了减少函数调用的开销,将函数替换成了函数体内的代码,用空间换时间

inline unsigned long __stl_next_prime(unsigned long n)

{

// Note: assumes long is at least 32 bits.

static const int __stl_num_primes = 28; // 质数表数据个数

static const unsigned long __stl_prime_list[__stl_num_primes] = {

53, 97, 193, 389, 769,

1543, 3079, 6151, 12289, 24593,

49157, 98317, 196613, 393241, 786433,

1572869, 3145739, 6291469, 12582917, 25165843,

50331653, 100663319, 201326611, 402653189, 805306457,

1610612741, 3221225473, 4294967291

};

// first,last是质数表首元素和尾元素的下一个位置的指针

const unsigned long* first = __stl_prime_list;

const unsigned long* last = __stl_prime_list + __stl_num_primes;

// 在[first,last)范围内找到第一个>=n的元素的指针

const unsigned long* pos = lower_bound(first, last, n);

// 如果n大于质数表中的所有元素,返回最大的元素,否则返回找到位置的元素

return pos == last ? *(last - 1) : *pos;

}

HashTable()

:_tables(__stl_next_prime(0))

, _n(0)

{}

bool Insert(const pair<K, V>& kv)

{

// 负载因子>=0.7,扩容

if (_n * 10 / _tables.size() >= 7)

{

HashTable<K, V> newht;

// 传_table.size()返回的还是_table.size()

// 因为lower_bound找的是第一个>=_table.size()的元素

newht._tables.resize(_tables.size() + 1);

// 将旧表中的元素插入新表,表中元素位置有可能发生变化

for (auto& data : _tables)

{

newht.Insert(data._kv);

}

// 交换新旧表地址

_tables.swap(newht._tables);

}

Hash hash;

size_t hash0 = hash(kv.first) % _tables.size();

size_t hashi = hash0;

size_t i = 1;

while (_tables[hashi]._state != EMPTY)

{

hashi = (hash0 + i) % _tables.size();

i++;

}

// 二次探测

// hc(key,i) = hashi = (hash0 ± i^2 ) % M

//size_t flag = 1;

//while (_tables[hashi]._state != EMPTY)

//{

// hashi = (hash0 + flag * i * i) % _tables.size();

// if (hashi < 0) hashi += _tables.size();

// if (flag) flag = -1;

// else

// {

// flag = 1;

// i++;

// }

//}

_tables[hashi]._kv = kv;

_tables[hashi]._state = EXIST;

_n++;

return true;

}

HashDate<K, V>* Find(const K& key)

{

Hash hash;

size_t hash0 = hash(key) % _tables.size();

size_t hashi = hash0;

size_t i = 1;

while (_tables[hashi]._state != EMPTY)

{

if (_tables[hashi]._state == EXIST

&& _tables[hashi]._kv.first == key)

{

return &_tables[hashi];

}

hashi = (hash0 + i) % _tables.size();

i++;

}

return nullptr;

}

bool Erase(const K& key)

{

HashDate<K, V>* ret = Find(key);

if (ret)

{

ret->_state = DELETE;

return true;

}

return false;

}

private:

vector<HashDate<K, V>> _tables;

size_t _n;// 表中存储的数据个数

};

}1.6.3 链地址法

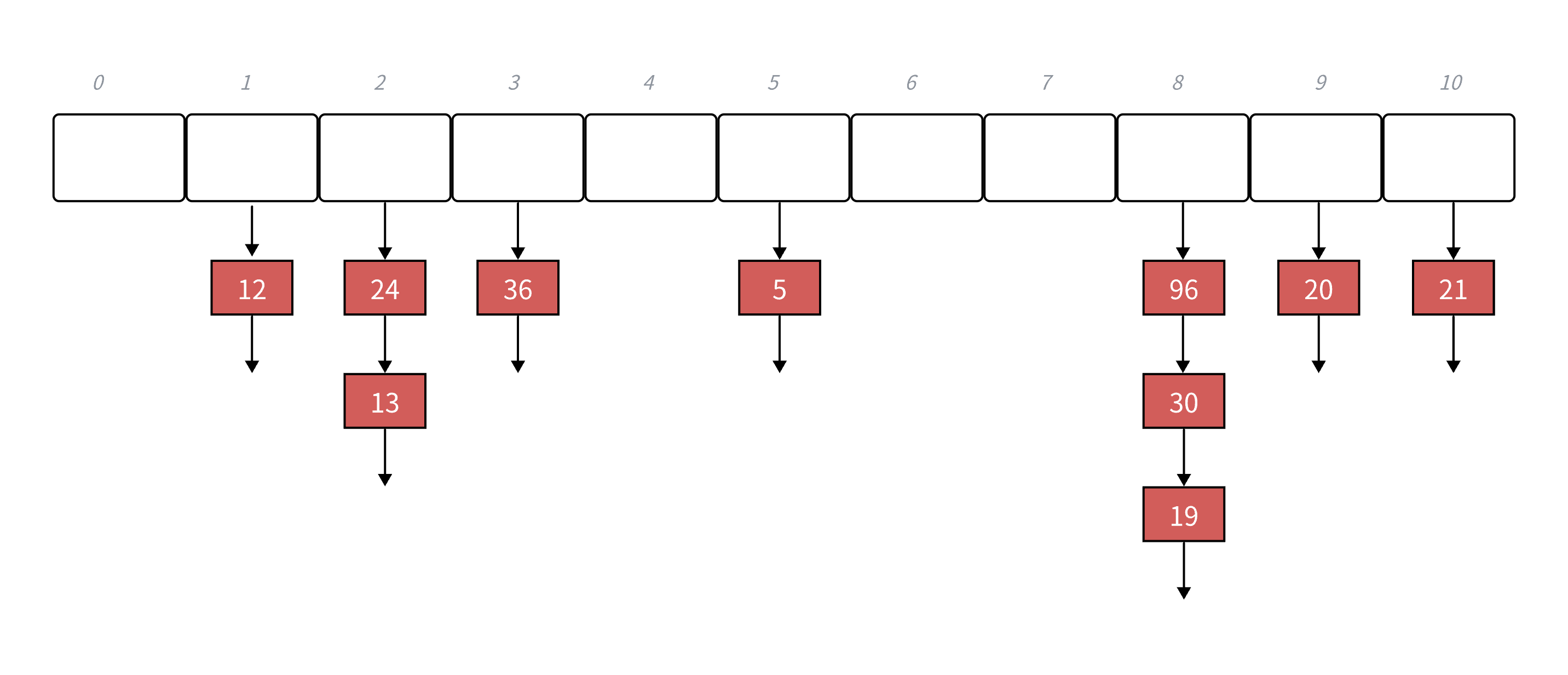

解决冲突的思路:

开放定址法中所有的元素都放到哈希表⾥,链地址法中所有的数据不再直接存储在哈希表中,哈希表中存储⼀个指针,没有数据映射这个位置时,这个指针为空,有多个数据映射到这个位置时,我们把这些冲突的数据链接成⼀个链表,挂在哈希表这个位置下⾯,链地址法也叫做拉链法或者哈希桶。

设 M 为 11,h(19) = 8,h(30) = 8,h(5) = 5,h(36) = 3,h(13) = 2,h(20) = 9,h(21) = 10,h(12) = 1,h(24) = 2,h(96) = 88

扩容

开放定址法负载因⼦必须⼩于1,链地址法的负载因⼦就没有限制了,可以⼤于1。负载因⼦越⼤,哈希冲突的概率越⾼,空间利⽤率越⾼;负载因⼦越⼩,哈希冲突的概率越低,空间利⽤率越低;stl中 unordered_xxx的最⼤负载因⼦基本控制在1,⼤于1就扩容,我们下⾯实现也使⽤这个⽅式。

极端场景:

如果极端场景下,某个桶特别⻓怎么办?其实我们可以考虑使⽤全域散列法,这样就不容易被针对 了。但是假设不是被针对了,⽤了全域散列法,但是偶然情况下,某个桶很⻓,查找效率很低怎么 办?这⾥在Java8的HashMap中当桶的⻓度超过⼀定阀值(8)时就把链表转换成红⿊树。⼀般情况下, 不断扩容,单个桶很⻓的场景还是⽐较少的,下⾯我们实现就不搞这么复杂了。

cpp

// 链地址法

namespace hash_bucket

{

// 节点结构

template<class K,class V>

struct HashNode

{

pair<K, V> _kv;

HashNode<K, V>* _next;

// 构造

HashNode(const pair<K,V>& kv)

:_kv(kv)

,_next(nullptr)

{}

};

// 哈希表实现

template<class K,class V,class Hash=HashFunc<K>>

class HashTable

{

typedef HashNode<K, V> Node;

// 扩容

inline unsigned long __stl_next_prime(unsigned long n)

{

static const int __stl_num_primes = 28;

static const unsigned long __stl_prime_list[__stl_num_primes] =

{

53, 97, 193, 389, 769,

1543, 3079, 6151, 12289, 24593,

49157, 98317, 196613, 393241, 786433,

1572869, 3145739, 6291469, 12582917, 25165843,

50331653, 100663319, 201326611, 402653189, 805306457,

1610612741, 3221225473, 4294967291

};

const unsigned long* first = __stl_prime_list;

const unsigned long* last = __stl_prime_list +

__stl_num_primes;

const unsigned long* pos = lower_bound(first, last, n);

return pos == last ? *(last - 1) : *pos;

}

public:

HashTable()

{

_tables.resize(__stl_next_prime(0), nullptr);

}

~HashTable()

{

// 依次把每个桶释放

for (int i = 0; i < _tables.size(); i++)

{

Node* cur = _tables[i];

while (cur)

{

Node* next = cur->_next;

delete cur;

cur = next;

}

_tables[i] = nullptr;

}

}

// 插入

bool Insert(const pair<K, V>& kv)

{

// 不允许键值冗余

if (Find(kv.first) != nullptr)

return false;

Hash hash;

size_t hashi = hash(kv.first) % _tables.size();

// 负载因子==1需要扩容

if (_n == _tables.size())

{

// 扩容时创建新的结点,后⾯还要释放旧结点

//HashTable<K, V> newHT;

//newHT._tables.resize(__stl_next_prime(_tables.szie() + 1));

//for (int i = 0; i < _tables.szie(); i++)

//{

// Node* cur = _tables[i];

// while (cur)

// {

// newHT.Insert(cur->_kv);

// cur = cur->_next;

// }

//}

//// 调用vector的swap

//_table.swap(newHT._tables);

// 移动旧表的结点到新表,效率更好

vector<Node*> newTables(__stl_next_prime(_tables.size() + 1), nullptr);

for (int i = 0; i < _tables.size(); i++)

{

Node* cur = _tables[i];

while (cur)

{

// 提前保存旧链表的下一个位置

Node* next = cur->_next;

// 旧节点在新表中的映射位置

size_t hashi = hash(cur->_kv.first) % newTables.size();

// 将旧节点头插至新表中的映射位置

cur->_next = newTables[hashi];

newTables[hashi] = cur;

cur = next;

}

// 将旧表位置置空

_tables[i] = nullptr;

}

_tables.swap(newTables);

}

// 将新节点头插值映射位置

Node* newNode = new Node(kv);

Node* cur = _tables[hashi];

newNode->_next = cur;

_tables[hashi] = newNode;

return true;

}

// 查找

Node* Find(const K& key)

{

Hash hash;

size_t hashi = hash(key) % _tables.size();

Node* cur = _tables[hashi];

while (cur)

{

if (cur->_kv.first == key)

return cur;

else

cur = cur->_next;

}

return nullptr;

}

// 删除

bool Erase(const K& key)

{

Hash hash;

size_t hashi = hash(key) % _tables.size();

Node* cur = _tables[hashi];

Node* prev = nullptr;

while (cur)

{

if (cur->_kv.first == key)

{

// 如果删除的是头节点,下一个节点作为新的头节点

if (prev == nullptr)

{

_tables[hashi] = cur->_next;

}

// 否则连接cur的前后节点

else

{

prev->_next = cur->_next;

}

delete cur;

_n--;

return true;

}

prev = cur;

cur = cur->_next;

}

return false;

}

private:

vector<Node*> _tables;

size_t _n = 0;// 初始值

};

}