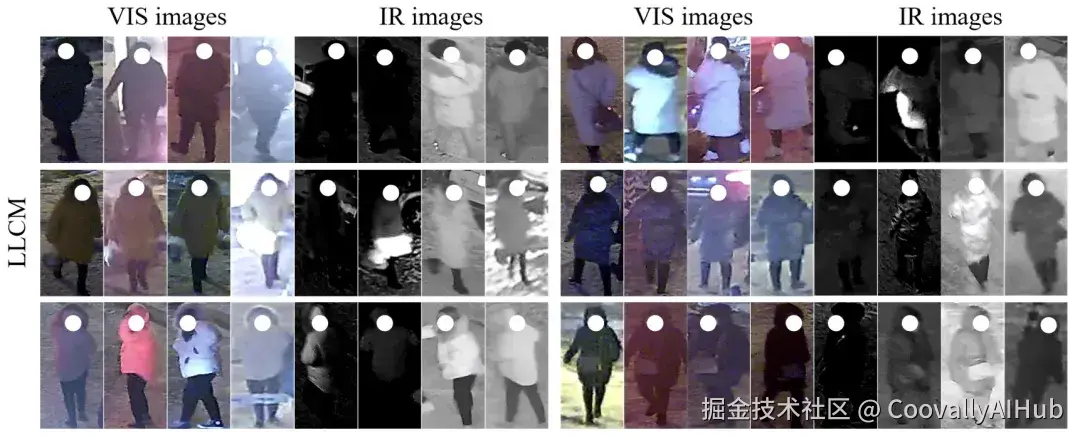

想象这样一个安防场景:白天,监控摄像头(可见光模式)清晰地捕捉到一个人的影像;到了夜晚,摄像头自动切换到红外模式,画面变成了基于热辐射的黑白图像。对于人类来说,我们很容易判断这是同一个人,但对于AI系统来说,这几乎是两个完全不同的对象!

这就是可见光-红外行人重识别(VI-ReID)领域面临的核心挑战------如何让AI克服巨大的模态差异,实现全天候、不间断的智能监控。这一难题长期以来困扰着学术界和工业界。

传统方法为何失效?

过去的VI-ReID模型主要是在空间域上进行特征学习,即关注图像的像素级信息,如颜色、纹理等表面特征。但在可见光与红外这两种模态之间,这些表面特征差异巨大:白天的彩色衣物在夜间红外图像中只会显示为不同温度的黑白区域。

当AI模型依赖于这些容易变化的表面特征时,自然就变成了"脸盲"。

创新思路:从"看图像"到"听频率"

火箭军工程大学杨小冈教授团队的最新研究《Discovering Multi-Frequency Embedding for Visible-Infrared Person Re-identification》提出了一种全新的解决方案------多频嵌入网络(MFENet)。

论文链接:ieeexplore.ieee.org/document/11...

代码链接:github.com/GuHY777/MFE...

这项研究的核心洞见是:与其在空间域死磕表面特征,不如转向频域挖掘身份的本质特征。

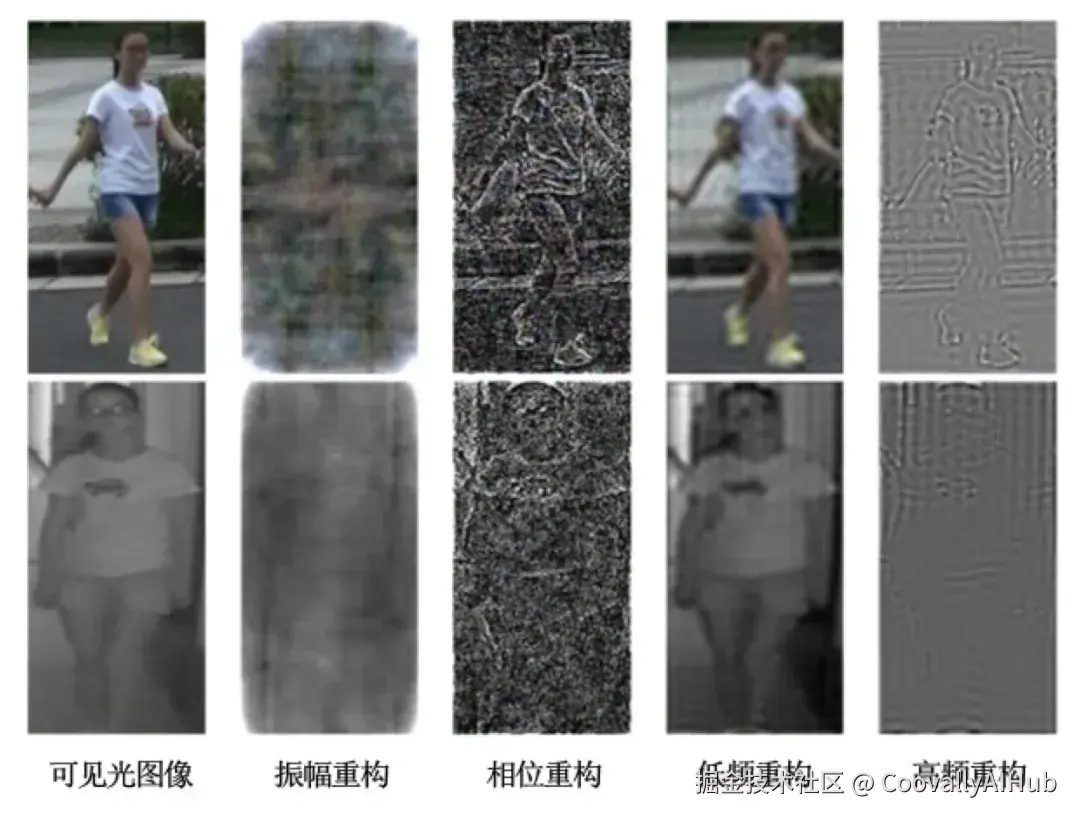

什么是频域分析?

简单来说:空间域(我们正常看到的图像)回答"这里有什么",频域(经过傅里叶变换后)回答 "图像由哪些基础模式组成" 。在频域中,图像信息可以分为:低频信号:代表图像的整体轮廓、色块和缓慢变化的背景。在VI-ReID中,这部分充满了"模态噪声"(如颜色信息vs温度信息);高频信号:代表图像的边缘、纹理和突变细节。这部分藏着"身份黄金"(如人的轮廓、携带物品的形状,这些在两种模态间是共享的)。

传统方法要么仅在空间域挣扎,要么简单地进行高低频二分,效果有限。而MFENet如同一位顶级"音频工程师",能够精细分析整个"频谱",提取最纯净的"身份旋律"。

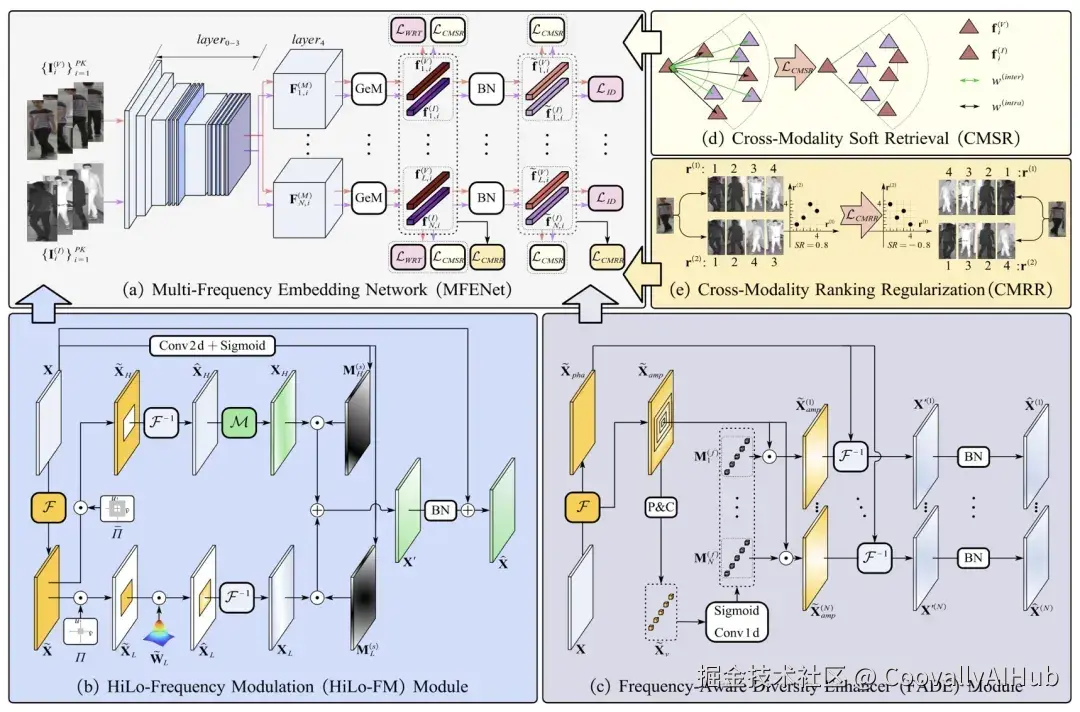

MFENet的核心创新

- 创新一:高低频调制模块(HiLo-FM)

HiLo-FM是一个"智能滤波器",专门处理频域中的高低频信息:

- 频域分离: 通过设计的掩码将频域特征分离为低频和高频成分

- 低频处理(去粗取精): 对充满模态噪声的低频信息,直接在频域进行高效滤波,去除干扰,保留有用的全局结构

- 高频处理(精益求精): 对宝贵的高频细节,转换回空间域后使用轻量级多尺度卷积精细提取边缘、轮廓等身份特征

- 智能融合: 通过注意力机制,将处理后的高频和低频特征自适应融合,既保留细节又抑制噪声

- 创新二:频率感知多样性增强模块(FADE)

如果HiLo-FM是"高低音调节器",那么FADE就是专业的"多段均衡器":

- 不再满足于简单的高低频二分,而是将整个频谱切分为多个频段

- 通过注意力机制自动学习每个频段的重要性权重

- 增强包含身份特征的频段,抑制包含模态噪声的频段

- 通过多分支架构学习多样化的特征组合,提升模型鲁棒性

专为跨模态设计的训练准则

除了网络结构创新,研究团队还设计了专门针对VI-ReID任务的损失函数:

- 准则一:跨模态软检索损失(CMSR)

团队给AI设定了一条新规则:"你不仅要让'白天A'和'白天的另一张A'看起来相似,更要让'白天A'和'晚上A'看起来比'白天A'和'白天B'更相似!"

这一损失函数优先保证跨模态(可见光-红外)的一致性,而不是像传统方法那样更关注同模态内部的相似性。

- 准则二:跨模态排序正则化损失(CMRR)

该损失鼓励网络中的多个分支学会"殊途同归"------使用不同的特征(如一个分支关注背包,另一个关注体型)来识别同一个人,极大地丰富了模型的特征多样性。

性能表现:刷新SOTA纪录

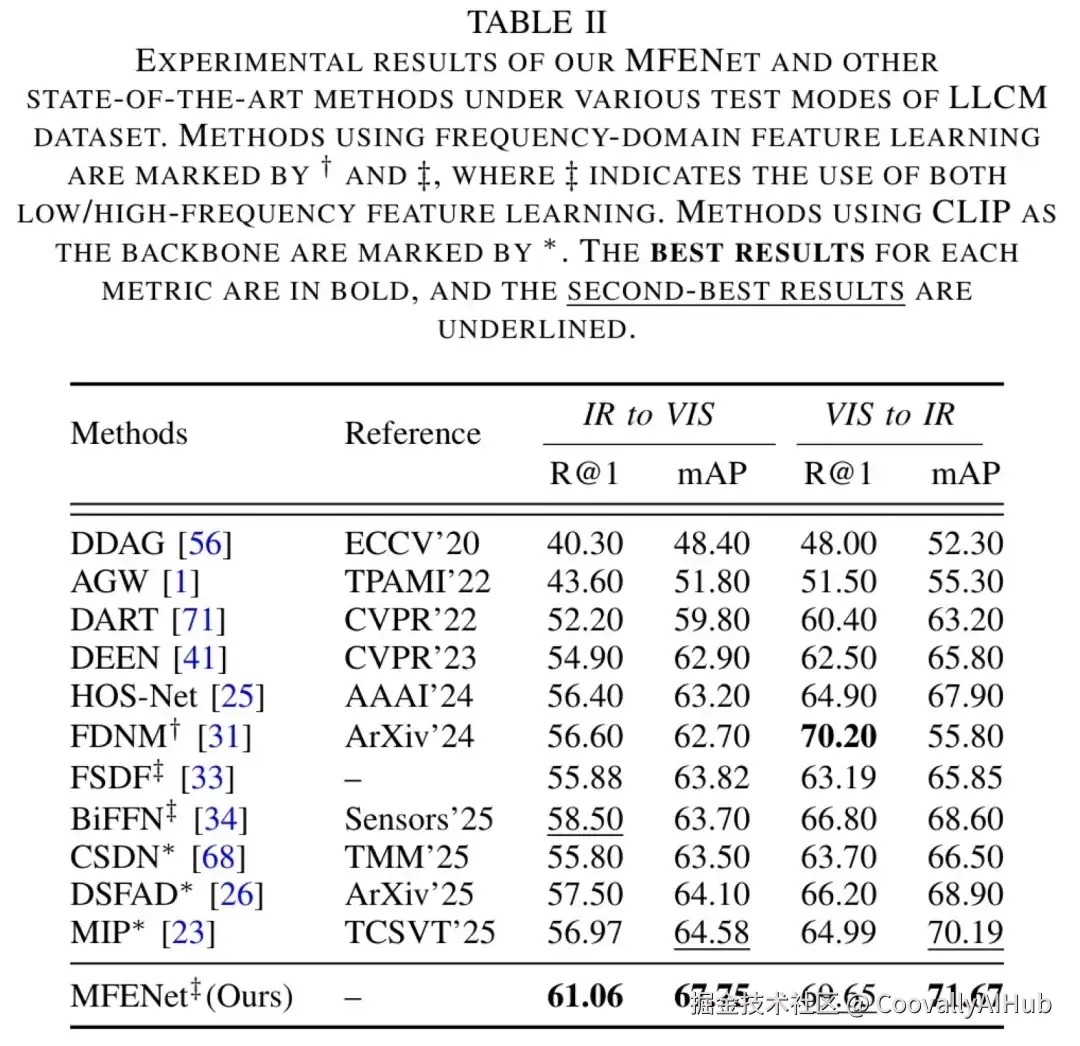

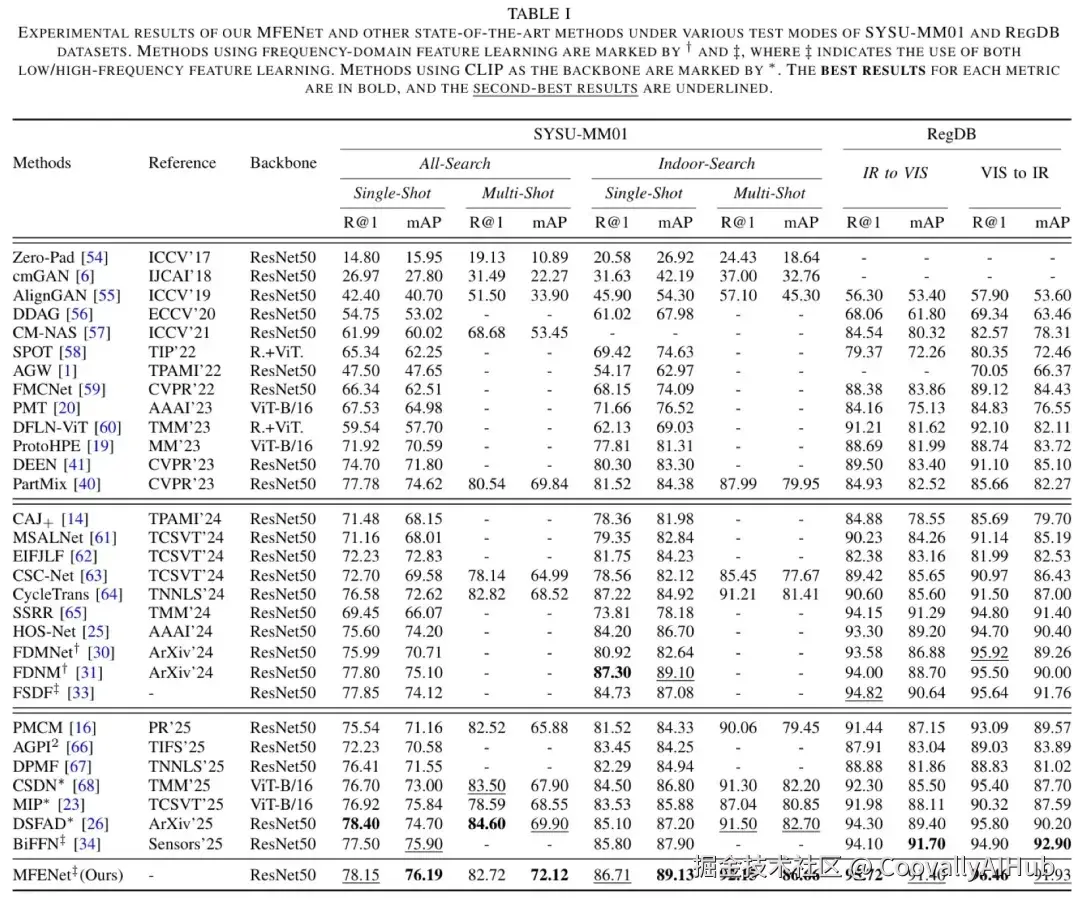

MFENet在三大主流VI-ReID基准数据集(SYSU-MM01、RegDB、LLCM)上进行了全面评估,结果令人印象深刻:

在最具挑战性、规模最大的LLCM数据集上,MFENet在"红外搜可见光"(IR to VIS)模式下:

- Rank-1准确率达到61.06%

- mAP达到67.75%

这两项关键指标均大幅超越现有所有方法,毫无悬念地登顶SOTA!在SYSU-MM01和RegDB数据集上,MFENet同样展现出顶尖性能和强大鲁棒性。

- 可视化验证

通过消融实验和特征可视化,团队验证了MFENet各模块的有效性:

- 各模块贡献分析: HiLo-FM和FADE模块均对性能提升有显著贡献

- 特征分布可视化: MFENet学习的特征在跨模态情况下具有更好的聚类效果

- 注意力可视化: 通过Grad-CAM++显示,MFENet更关注与身份相关的区域

总结与展望

火箭军工程大学团队提出的MFENet,首次将高效的高低频特征处理(HiLo-FM)与精细的多频带注意力(FADE)相结合,并辅以专为跨模态检索设计的CMSR和CMRR损失函数。

这项工作证明了深入理解和利用频域信息是攻克VI-ReID模态差异的关键,不仅为全天候智能监控提供了新的SOTA方案,也为其他跨模态视觉任务开辟了全新的思路。