文章摘要

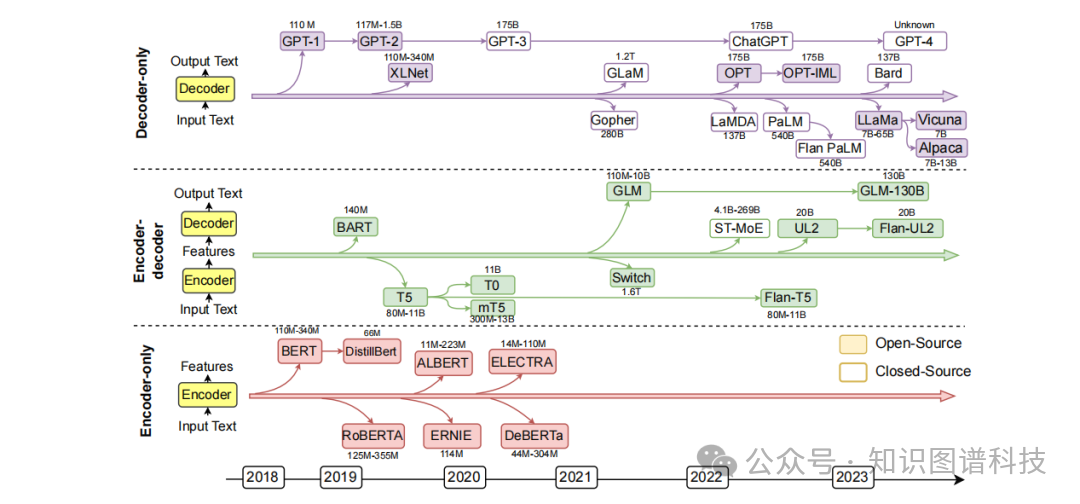

本文提出了融合大语言模型(LLMs)与知识图谱(KGs)的前瞻性路线图,涵盖三大框架:KG增强的LLMs、LLM增强的KGs,以及协同LLMs+KGs。通过系统综述现有研究并指出未来方向,为两种互补技术的统一提供了全面指导。

pdf原文:https://t.zsxq.com/cGCV3

一、引言:两大技术的碰撞与融合

在人工智能领域,我们正在见证两股强大力量的交汇:大语言模型 (Large Language Models, LLMs)如ChatGPT、GPT-4,以及知识图谱(Knowledge Graphs, KGs)如维基百科、华谱等结构化知识库。

1.1 大语言模型的崛起

以BERT、RoBERTA、T5为代表的大语言模型,在海量语料库上进行预训练后,在问答、机器翻译、文本生成等自然语言处理任务中展现出卓越性能。 特别是近期,模型规模的急剧增长赋予了LLMs"涌现能力"(emergent ability),为将其应用于通用人工智能(AGI)铺平了道路。拥有数十亿参数的ChatGPT和PaLM2等先进LLMs,在教育、代码生成、推荐系统等复杂实际任务中展现出巨大潜力。

1.2 知识图谱的独特价值

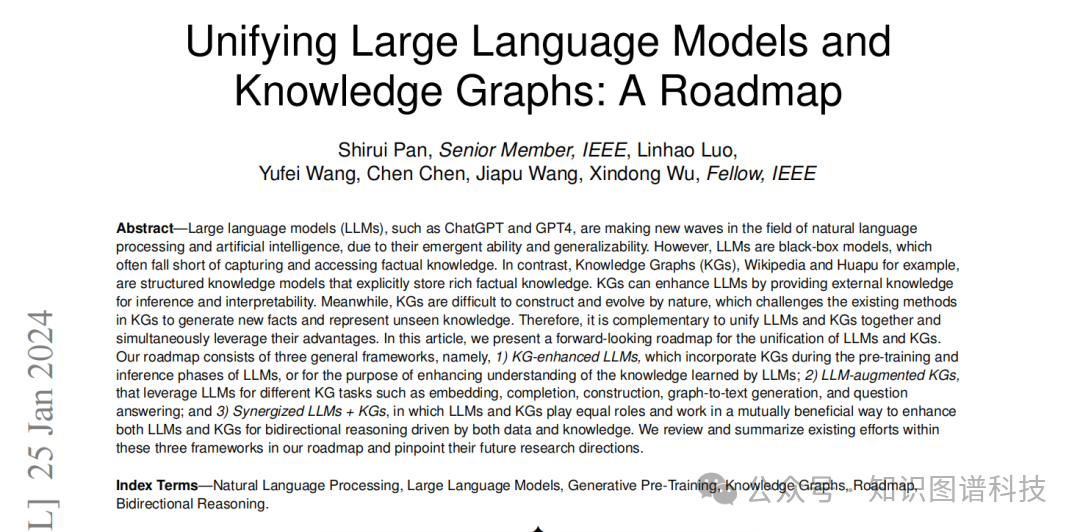

然而,LLMs作为"黑盒模型",常常无法有效捕获和获取事实性知识。 相比之下,知识图谱作为结构化知识模型,明确存储着丰富的事实性知识。KGs可以通过提供外部知识来增强LLMs的推理能力和可解释性。

同时,知识图谱本身在构建和演化方面存在天然困难,这使得现有KG方法在生成新事实和表示未知知识方面面临挑战。 因此,将LLMs和KGs统一起来,同时发挥两者优势,成为一种互补性的解决方案。

1.3 融合的必要性

尽管已有一些关于知识增强LLMs的综述,但它们主要关注使用KGs作为外部知识来增强LLMs,忽视了为LLMs集成KGs的其他可能性,以及LLMs在KG应用中的潜在作用。

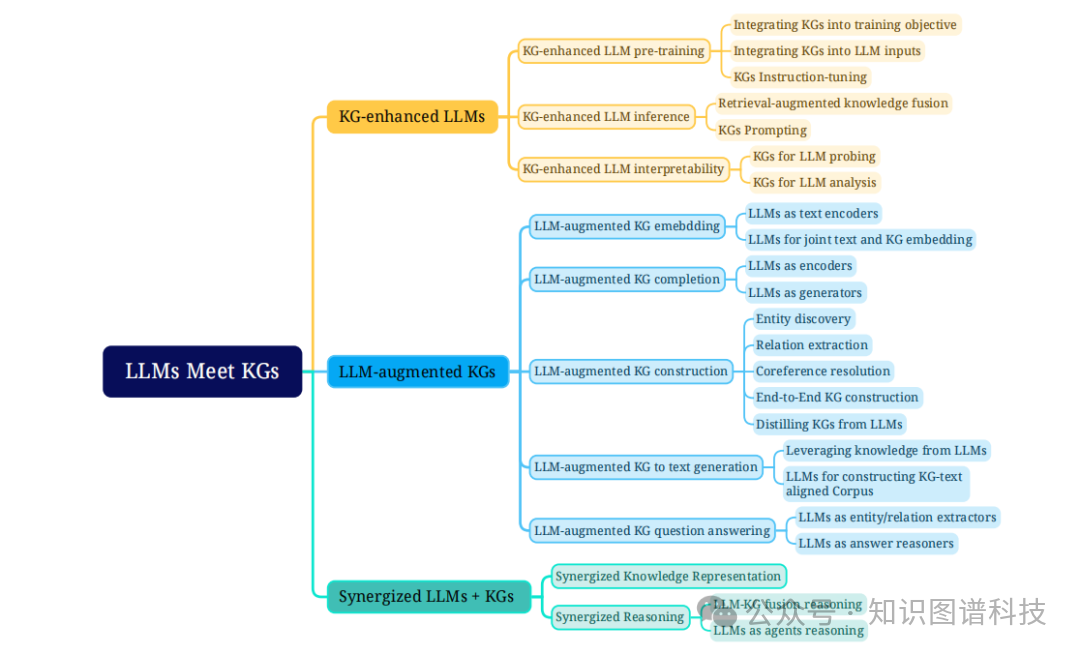

二、核心贡献:三大框架路线图

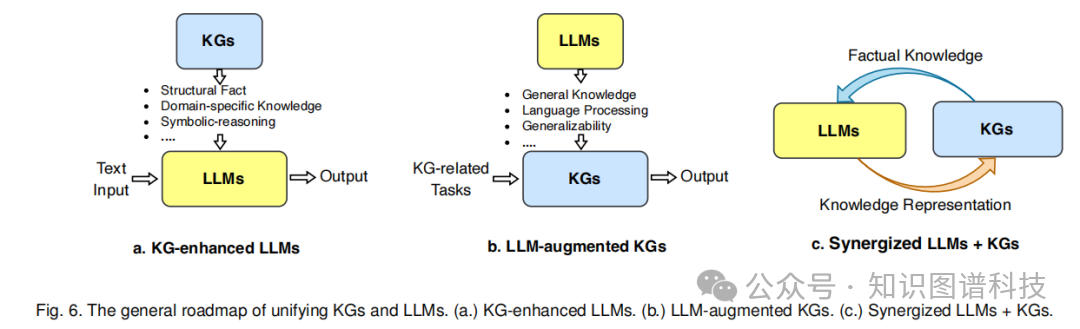

本文提出了一个前瞻性路线图,旨在统一LLMs和KGs,充分利用各自优势并克服各自局限,服务于各种下游任务。主要贡献包括:

2.1 完整的路线图

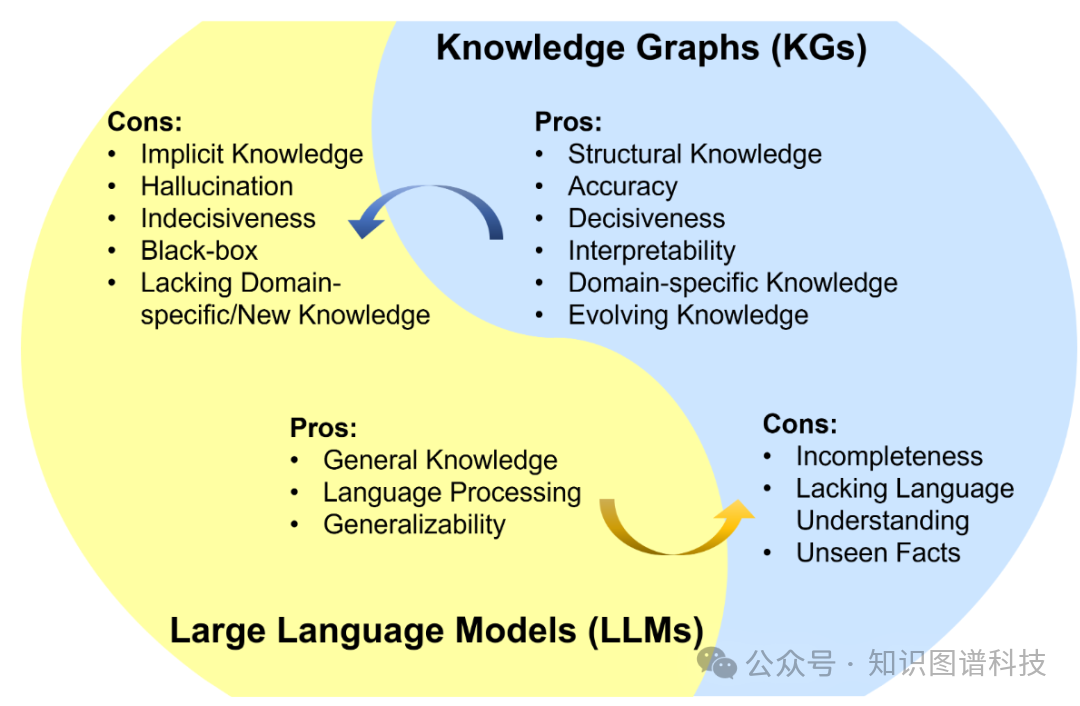

我们提出的路线图包含三个统一LLMs和KGs的通用框架:

-

KG增强的LLMs(KG-enhanced LLMs):在LLMs的预训练和推理阶段融入KGs,或用于增强对LLMs所学知识的理解

-

LLM增强的KGs(LLM-augmented KGs):利用LLMs完成不同的KG任务,如嵌入、补全、构建、图到文本生成和问答

-

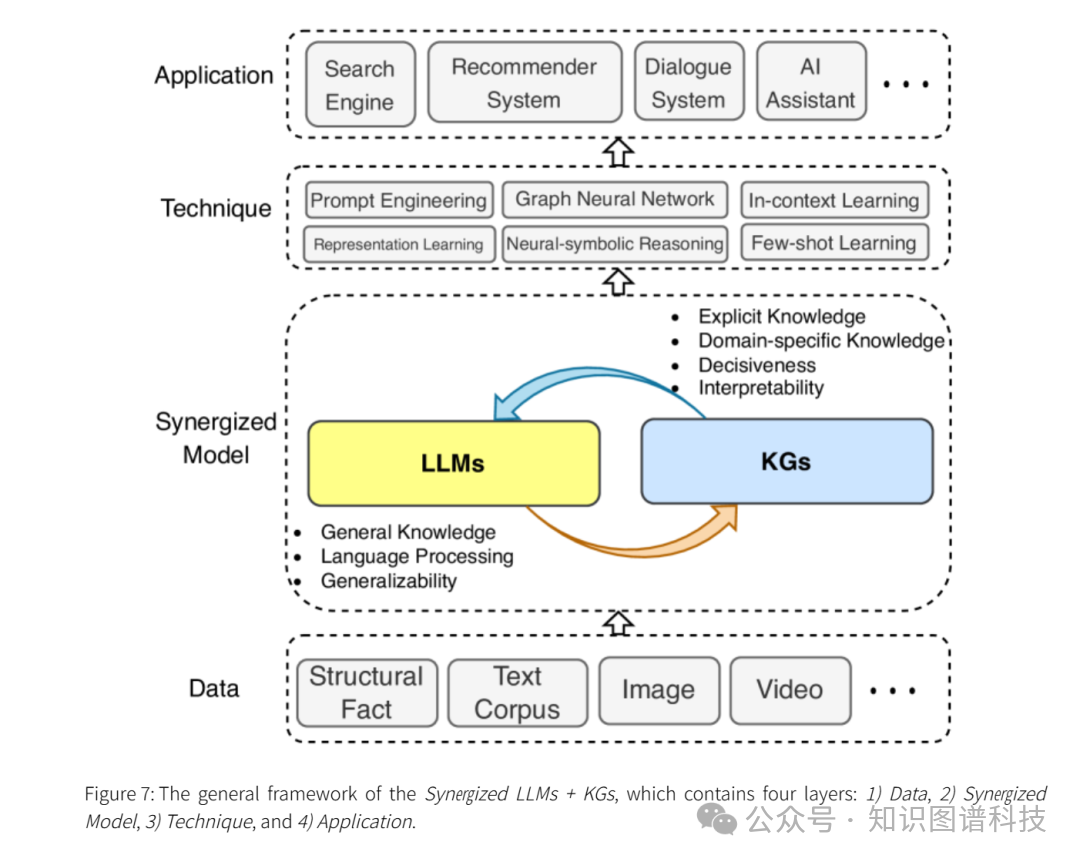

协同LLMs + KGs(Synergized LLMs + KGs):LLMs和KGs扮演同等角色,以互惠方式协同工作,通过数据和知识驱动的双向推理增强两者能力

2.2 详细分类与综述

针对路线图的每个集成框架,我们提供了详细的分类和新颖的研究分类法。在每个类别中,从不同集成策略和任务的角度综述研究,为每个框架提供更深入的见解。

2.3 前沿技术覆盖

本文涵盖了LLMs和KGs的先进技术,包括ChatGPT、GPT-4等最先进的LLMs,以及多模态知识图谱等新型KGs的讨论。

2.4 挑战与未来方向

我们总结了现有研究中的挑战,并提出了几个有前景的未来研究方向。

三、技术背景:LLMs与KGs基础

3.1 大语言模型(LLMs)

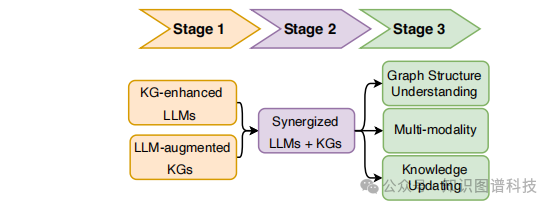

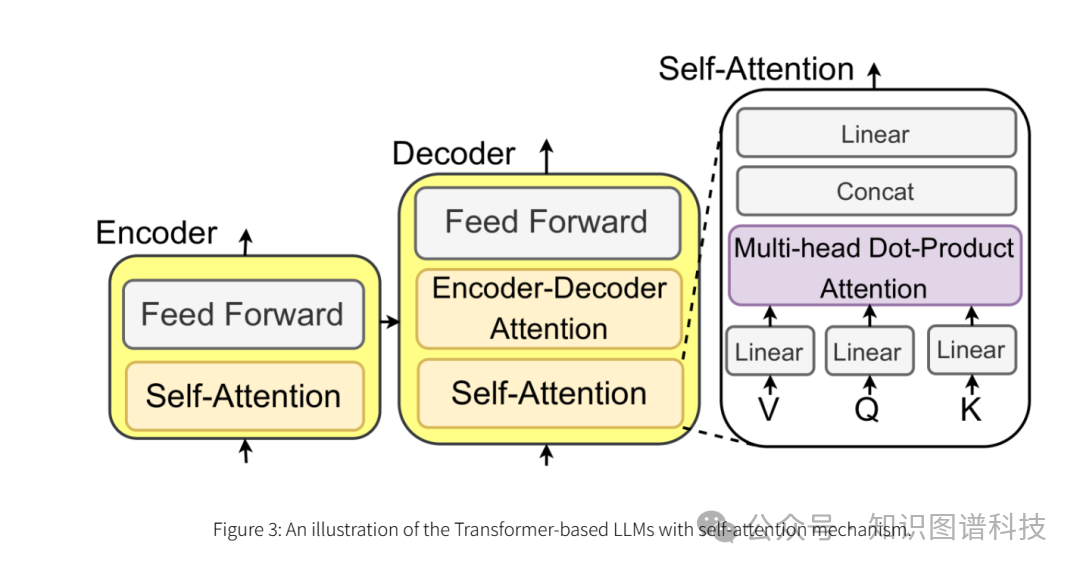

在大规模语料库上预训练的大语言模型在各种NLP任务中展现出巨大潜力。如图3所示,大多数LLMs源自Transformer设计,包含编码器和解码器组件。

现代LLMs通过提示工程(Prompt Engineering)高效应用于各种场景。提示工程是一种技术,通过精心设计输入提示,引导模型生成期望的输出,而无需修改模型参数。

3.2 知识图谱(KGs)

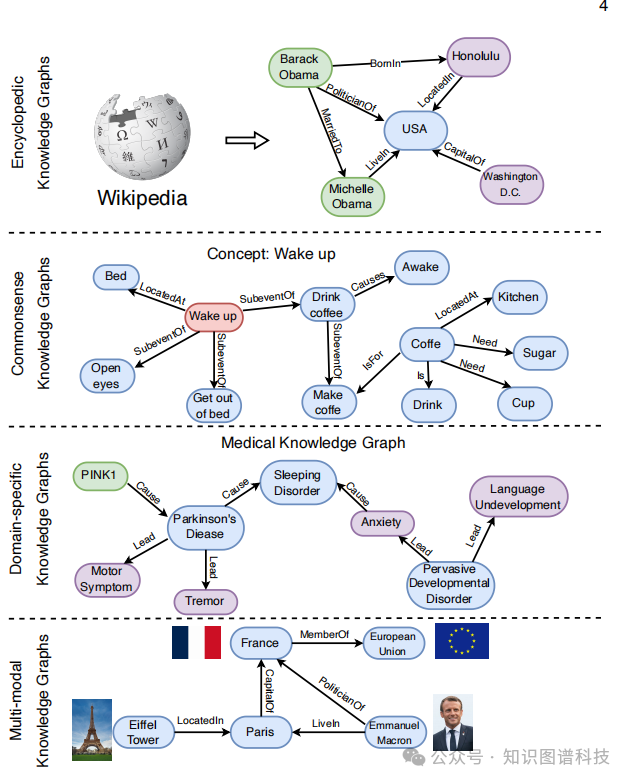

知识图谱是一种结构化的知识表示方法,通常以三元组(头实体、关系、尾实体)的形式存储事实。 根据不同特性,KGs可以分为多种类型:

3.2.1 百科知识图谱

如DBpedia、Wikidata等,从维基百科等大规模百科全书中提取结构化知识。

3.2.2 常识知识图谱

如ConceptNet,专注于存储日常生活中的常识性知识。

3.2.3 领域特定知识图谱

针对特定领域构建,如医疗、金融等垂直领域的专业知识图谱。

3.2.4 多模态知识图谱

与仅包含文本信息的传统知识图谱不同,多模态知识图谱以图像、声音、视频等多种模态表示事实。例如,IMGpedia、MMKG和Richpedia将文本和图像信息整合到知识图谱中。这些知识图谱可用于图像-文本匹配、视觉问答和推荐等多模态任务。

3.3 应用场景

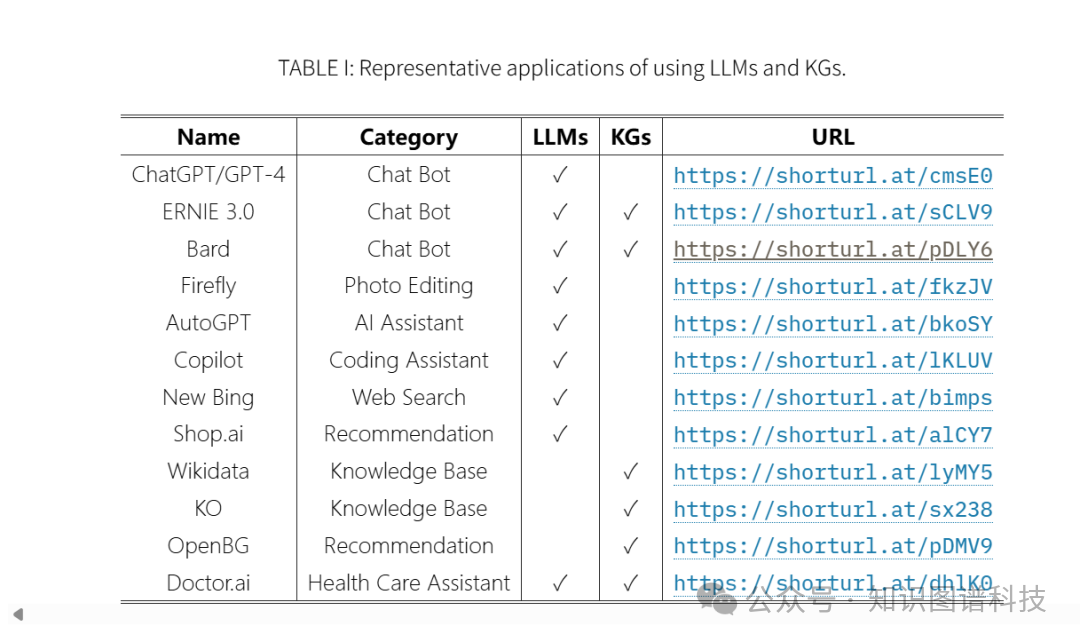

LLMs和KGs已广泛应用于各种实际应用中:

-

聊天机器人

:ChatGPT/GPT-4采用LLM架构,ERNIE 3.0和Bard则将KGs融入聊天应用以提高知识意识

-

创意工具

:Firefly开发了照片编辑应用,用户可使用自然语言描述编辑照片

-

辅助工具

:Copilot(编码助手)、New Bing(网络搜索)、Shop.ai(推荐)

-

知识服务

:Wikidata和KO作为提供外部知识的代表性知识图谱应用;OpenBG是为推荐设计的知识图谱

-

医疗健康

:Doctor.ai开发了结合LLMs和KGs的健康护理助手,提供医疗建议

四、框架一:KG增强的LLMs

知识图谱可以在多个层面增强大语言模型的能力:

4.1 预训练阶段的KG集成

在LLMs的预训练过程中融入知识图谱,可以让模型从一开始就学习到结构化的事实性知识。这种方法通过在训练目标中加入KG相关任务,或者将KG嵌入作为额外输入,使模型能够更好地理解实体关系和领域知识。

4.2 推理阶段的KG增强

在实际应用中,可以将KG作为外部知识库,在LLMs进行推理时动态检索相关事实。这种方法特别适用于需要精确事实性知识的任务,如问答系统、事实核查等。通过检索-增强生成(RAG)等技术,可以显著提升LLMs在知识密集型任务中的表现。

4.3 可解释性增强

利用知识图谱的结构化特性,可以增强LLMs的可解释性。通过将模型的推理过程映射到知识图谱中的路径或子图,研究人员和用户能够更好地理解模型的决策逻辑。

五、框架二:LLM增强的KGs

大语言模型同样可以显著提升知识图谱的各项能力:

5.1 知识图谱嵌入(KG Embedding)

传统的KG嵌入方法主要依赖图结构信息。LLMs可以通过其强大的语言理解能力,为实体和关系生成更丰富的语义嵌入表示,从而提升下游任务的性能。

5.2 知识图谱补全(KG Completion)

LLMs可以基于现有的知识图谱三元组,预测缺失的实体或关系,帮助补全不完整的知识图谱。通过上下文学习和few-shot学习能力,LLMs能够发现KG中的隐含关系。

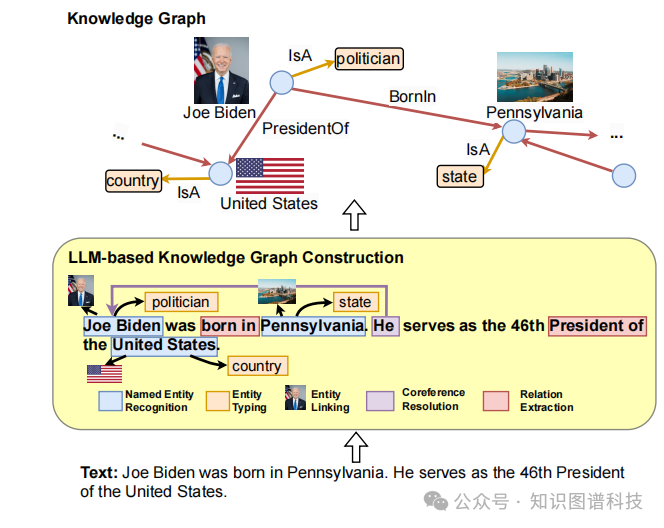

5.3 知识图谱构建(KG Construction)

从非结构化文本中自动抽取实体、关系并构建知识图谱是一项重要任务。LLMs凭借其强大的信息抽取和理解能力,可以大幅提升KG构建的效率和质量。

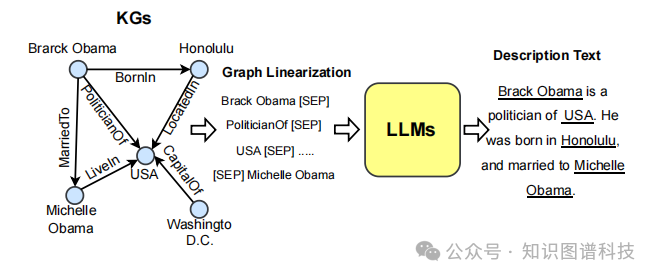

5.4 图到文本生成(Graph-to-Text Generation)

将知识图谱中的结构化信息转换为自然语言描述,对于知识传播和人机交互至关重要。LLMs的生成能力使其成为完成这一任务的理想工具。

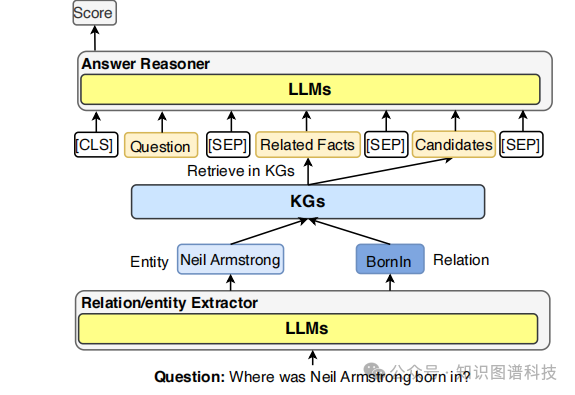

5.5 知识图谱问答(KG-based QA)

基于知识图谱的问答系统需要理解自然语言问题并在KG中检索答案。LLMs可以增强问题理解、查询生成和答案表述等各个环节。

六、框架三:协同LLMs + KGs

近年来,LLMs和KGs的协同作用引起了研究者的广泛关注。作为两种本质上互补的技术,它们应当被统一到一个通用框架中,相互增强。

6.1 统一框架的四层架构

我们提出的协同LLMs + KGs统一框架包含四个层次:

6.1.1 数据层(Data Layer)

LLMs和KGs分别用于处理文本数据和结构化数据。随着多模态LLMs和KGs的发展,该框架可扩展到处理视频、音频和图像等多模态数据。

6.1.2 协同模型层(Synergized Model Layer)

LLMs和KGs相互协同以提升各自能力。这一层实现了两种技术的深度融合,使它们能够互补短板、强化优势。

6.1.3 技术层(Technique Layer)

LLMs和KGs中使用的相关技术可以融入该框架以进一步提升性能。包括提示工程、检索增强、知识蒸馏等各种技术手段。

6.1.4 应用层(Application Layer)

LLMs和KGs可以集成应对各种实际应用,如搜索引擎、推荐系统和AI助手。

6.2 双向推理机制

协同框架的核心在于实现数据驱动和知识驱动的双向推理:

-

数据到知识

:从海量数据中通过LLMs提取和生成结构化知识

-

知识到数据

:利用KGs中的结构化知识指导和约束LLMs的生成过程

这种双向机制确保了两种技术的深度融合和互惠增强。

6.3 知识表示的统一

在协同框架中,需要建立LLMs的连续表示空间与KGs的离散符号空间之间的桥梁。通过神经-符号融合技术,可以实现两种表示形式的无缝转换和互操作。

七、挑战与未来研究方向

7.1 当前面临的主要挑战

7.1.1 扩展性问题

随着知识图谱规模的增长和LLMs参数量的增加,如何高效地融合两者成为关键挑战。

7.1.2 知识更新与演化

如何保持知识图谱和LLMs的知识同步更新,适应快速变化的现实世界。

7.1.3 多模态融合

在多模态场景下如何有效整合不同模态的知识和数据。

7.1.4 可解释性与可信度

如何在保持性能的同时提升系统的可解释性和可信度。

7.2 未来研究方向

7.2.1 神经-符号混合智能

深入探索连续神经网络表示与离散符号推理的深度融合,开发新型混合架构。

7.2.2 持续学习与知识演化

构建能够持续学习和自主更新的知识系统,实现知识的动态演化。

7.2.3 多语言与跨文化知识融合

在全球化背景下,研究如何融合不同语言和文化背景下的知识。

7.2.4 领域自适应与迁移

开发高效的领域适应技术,使通用框架能够快速适应特定垂直领域。

7.2.5 伦理与安全

在知识融合过程中确保数据隐私、避免偏见,构建负责任的AI系统。

八、结论

本文提出了融合大语言模型与知识图谱的全面路线图,通过KG增强的LLMs、LLM增强的KGs以及协同LLMs + KGs三大框架,为两种互补技术的统一提供了系统性指导。

随着人工智能技术的不断发展,LLMs和KGs的深度融合将成为构建下一代智能系统的关键。通过充分发挥各自优势,这种融合不仅能够提升系统的性能和可靠性,更将推动我们向真正的通用人工智能迈进。

对于企事业单位和科研院所而言,理解并把握这一技术趋势,将有助于在AI时代占据先机。无论是在产品研发、技术创新还是投资决策方面,LLMs与KGs的融合都将带来前所未有的机遇和价值。

标签

#LargeLanguageModels #KnowledgeGraphs #大语言模型 #知识图谱 #人工智能 #神经符号融合

欢迎加入「知识图谱增强大模型产学研」知识星球,获取最新产学研相关"知识图谱+大模型"相关论文、政府企业落地案例、避坑指南、电子书、文章等,行业重点是医疗护理、医药大健康、工业能源制造领域,也会跟踪AI4S科学研究相关内容,以及Palantir、OpenAI、微软、Writer、Glean、OpenEvidence等相关公司进展。