备注 :回顾看过的论文,对目前看过的Qwen进行整理在此总结(注:笔者水平有限,若有描述不当之处,欢迎大家留言。后期会继续更新LLM系列,文生图系列,VLM系列,agent系列等。如果看完有收获,可以【点赞】【收藏】【加粉】)

阐述的思维逻辑:会给出论文中的核心点和核心点的描述。

一句话总结: Qwen (7B/14B) 以 3万亿tokens 的大规模高质量多语种数据为基础,通过 SFT 与 RLHF 对齐,推出了基础版和对话版模型,并在当时的中小型 LLM 评测中展现了卓越的性能,尤其在中文处理上具有显著优势。

技术亮点 :

1 大规模、高质量、多语种训练数据:

-

数据规模 :Qwen 在预训练阶段使用了3万亿tokens 的大规模高质量语料。

-

数据构成 :语料覆盖中文、英文以及十多种其他语言,确保了模型的多语种能力 和跨语言理解基础。

**2 后训练流程【SFT + RLHF】:**提升模型的指令遵循、对话能力和安全性。

- 对齐方法 :通过经典的 监督微调(SFT) 和 人类反馈强化学习(RLHF) 流程,将基础模型对齐到人类偏好,形成了功能强大的 Qwen-Chat 版本。

备注:后续为机器翻译

摘要

大型语言模型(LLM)已经彻底改变了人工智能领域,能够执行以前认为仅限于人类的自然语言处理任务。在这项工作中,我们介绍了QWEN1,这是我们大型语言模型系列的第一款。QWEN是一个综合性的语言模型系列,包含不同参数数量的模型。它包括QWEN,基础预训练语言模型,以及QWEN-CHAT,这些聊天模型通过人类对齐技术进行了微调。基础语言模型在多个下游任务中表现出色,而聊天模型,特别是那些使用人类反馈强化学习(RLHF)训练的模型,在复杂任务上表现出色,如使用代码解释器等工具的能力。此外,我们还开发了针对编码的专业模型CODE-QWEN和CODE-QWEN-CHAT,以及针对数学的专业模型MATH-QWEN-CHAT,这些模型基于基础语言模型构建,显示出相比开源模型显著的性能提升,虽然在一些专有模型面前稍逊色。

一 介绍

Large language models (LLMs)(Radford 等,2018;Devlin 等,2018;Raffel 等,2020;Brown 等,2020;OpenAI,2023;Chowdhery 等,2022;Anil 等,2023;Thoppilan 等,2022;Touvron 等,2023a;b)通过为复杂推理和问题解决任务提供强大的基础,已经彻底改变了人工智能(AI)领域。这些模型能够将海量知识压缩进神经网络,使其成为极其多才多能的智能体。借助聊天界面,LLMs 可以执行过去被认为是人类专属的任务,尤其是涉及创造性与专业性的任务(OpenAI,2022;Ouyang 等,2022;Anil 等,2023;Google,2023;Anthropic,2023a;b)。它们能够以自然语言与人类交流、回答问题、提供信息,甚至生成诸如故事、诗歌、音乐等创造性内容。这推动了广泛应用的发展,包括聊天机器人、虚拟助手、语言翻译和摘要工具等。

LLMs 不仅局限于语言任务。它们也能够作为通用智能体(Reed 等,2022;Bai 等,2022a;Wang 等,2023a;AutoGPT,2023;Hong 等,2023),与外部系统、工具和模型协作,以达成人类设定的目标。例如,LLMs 可以理解多模态指令(OpenAI,2023;Bai 等,2023;Liu 等,2023a;Ye 等,2023;Dai 等,2023;Peng 等,2023b)、执行代码(Chen 等,2021;Zheng 等,2023;Li 等,2023d)、使用工具(Schick 等,2023;LangChain, Inc.,2023;AutoGPT,2023)等。这为 AI 应用带来了全新的可能性,从自动驾驶和机器人技术到医疗健康和金融领域。随着这些模型不断发展和提升,我们有望在未来看到更多创新且令人兴奋的应用。无论是帮助我们解决复杂问题、创造新的娱乐方式,或改变我们的生活和工作方式,LLMs 都将成为塑造 AI 未来的核心力量。

图 1:Qwen 系列模型演化历程。我们使用包含数万亿个词元的海量数据集对语言模型 QWEN 进行了预训练。然后,我们使用 SFT 和 RLHF 将 QWEN 与人类偏好进行匹配,从而得到了 QWEN-CHAT 及其改进版本 QWEN-CHAT-RLHF。此外,我们还基于QWEN 开发了专门用于编码和数学的模型,例如CODE-QWEN、CODE-QWEN-CHAT 和MATH-QWEN-CHAT,并采用了类似的技术。请注意,我们之前发布了多模态LLM、QWEN-VL和它们也基于QWEN-VLCHAT(Ba等人,2023),我们的QWEN基础模型。

图 1:Qwen 系列模型演化历程。我们使用包含数万亿个词元的海量数据集对语言模型 QWEN 进行了预训练。然后,我们使用 SFT 和 RLHF 将 QWEN 与人类偏好进行匹配,从而得到了 QWEN-CHAT 及其改进版本 QWEN-CHAT-RLHF。此外,我们还基于QWEN 开发了专门用于编码和数学的模型,例如CODE-QWEN、CODE-QWEN-CHAT 和MATH-QWEN-CHAT,并采用了类似的技术。请注意,我们之前发布了多模态LLM、QWEN-VL和它们也基于QWEN-VLCHAT(Ba等人,2023),我们的QWEN基础模型。

尽管 LLMs 拥有令人印象深刻的能力,但它们常因缺乏可复现性、可控性以及对服务提供者的可访问性而受到批评。在本研究中,我们很高兴介绍并发布我们的 LLM 系列初始版本------QWEN。QWEN 这一名称来自中文词语"千问",寓意着能够涵盖"成千上万的问题",代表着包容广泛询问的理念。QWEN 是一个全面的语言模型系列,包含不同参数规模的多个模型。该系列包括基础预训练语言模型、使用人类对齐技术(如监督微调 SFT、人类反馈强化学习 RLHF 等)训练的聊天模型,以及代码与数学等专业方向的模型。具体细节如下所述:

-

基础语言模型,即QWEN,已通过使用多达3万亿个标记的多样化文本和代码进行广泛的训练,涵盖了广泛的领域。这些模型在多个下游任务中持续展现出卓越的性能,甚至与它们更大规模的模型相比也不逊色。

-

QWEN-CHAT模型已经在经过精心挑选的数据集上进行微调,涵盖了任务执行、聊天、工具使用、代理、安全性等方面。基准评估表明,SFT模型能够实现卓越的性能。此外,我们还训练了奖励模型来模拟人类偏好,并将其应用于RLHF,用于训练能够生成符合人类偏好的回答的聊天模型。通过对一个具有挑战性的测试进行人工评估,我们发现,通过RLHF训练的QWEN-CHAT模型具有很强的竞争力,但在我们的基准测试中仍略逊于GPT-4。

-

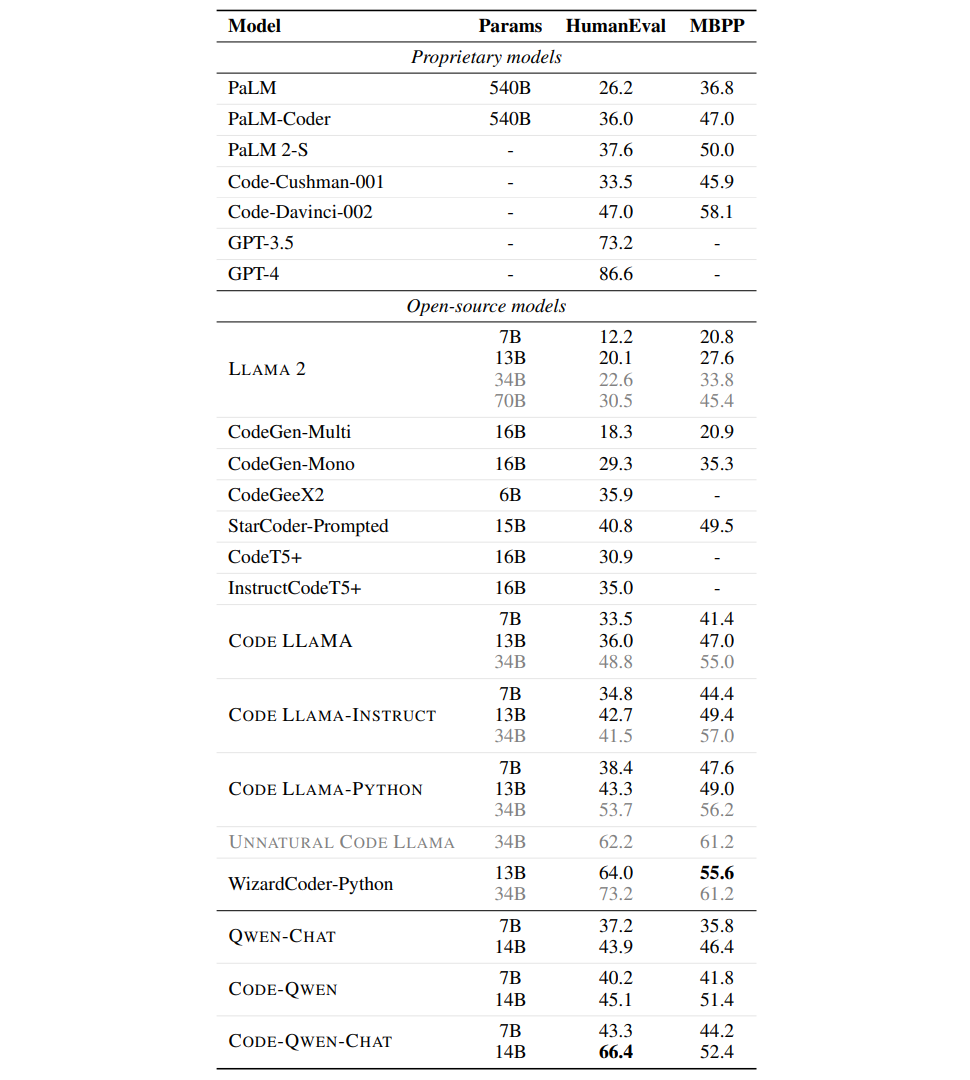

此外,我们推出了名为CODE-QWEN的专门模型,包括CODE-QWEN-7B和CODE-QWEN-14B,以及它们的聊天模型CODE-QWEN-14B-CHAT和CODE-QWEN-7B-CHAT。具体而言,CODE-QWEN已在大规模的代码数据集上进行预训练,并进一步微调以处理与代码生成、调试和解释相关的对话。通过在基准数据集(如HumanEval(Chen等,2021)、MBPP(Austin等,2021)和HumanEvalPack(Muennighoff等,2023))上进行的实验,展示了CODE-QWEN在代码理解和生成方面的高水平能力。

-

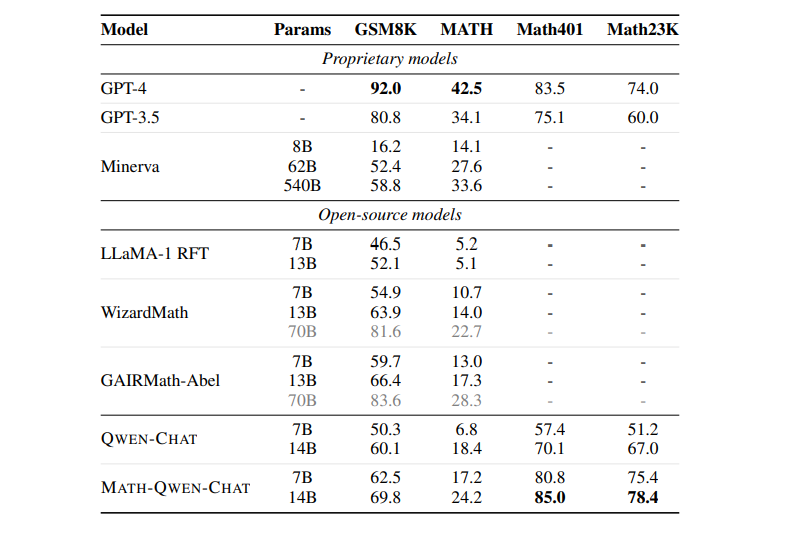

本研究还介绍了MATH-QWEN-CHAT,专门设计用于解决数学问题。我们的结果表明,MATH-QWEN-7B-CHAT和MATH-QWEN-14B-CHAT在同等规模的开源模型中具有显著优势,并且在与数学相关的基准数据集(如GSM8K(Cobbe等,2021)和MATH(Hendrycks等,2021))上的表现接近GPT-3.5。

-

此外,我们已经开源了QWEN-VL和QWEN-VL-CHAT,这些模型具有理解视觉和语言指令的多功能能力。它们在各种评估基准中超过了当前的开源视觉语言模型,并且支持中英文的文本识别和视觉关联。此外,这些模型还支持多图像对话和讲故事。更多细节可以参考Bai等(2023)。

目前,我们正式开源了具有14B参数和7B参数的基础预训练模型QWEN及对齐的聊天模型QWEN-CHAT。此次发布旨在提供更加全面和强大的LLM,适用于开发者或应用场景。

本报告的结构如下:第2章描述了我们的预训练方法和QWEN的结果;第3章介绍了我们对齐的方法,并报告了自动评估和人工评估的结果。此外,本章还详细介绍了我们在构建能够使用工具、代码解释器和代理的聊天模型方面的工作;第4和第5章深入探讨了编码和数学的专门模型及其表现;第6章概述了相关工作;第7章总结了本论文并指出未来的研究方向。

二 预训练

预训练阶段涉及通过学习大量数据来获得对世界及其各种复杂性的全面理解。这不仅包括基本的语言能力,还包括算术、编程和逻辑推理等高级技能。本节介绍了数据、模型设计和扩展,以及在基准数据集上的综合评估结果。

2.1 数据

数据的规模已经被证明是开发稳健的大型语言模型的关键因素,正如先前的研究所强调的(Hoffmann等,2022;Touvron等,2023b)。为了创建一个有效的预训练数据集,确保数据的多样性,并涵盖广泛的类型、领域和任务是至关重要的。我们的数据集旨在满足这些要求,包含了公共网页文档、百科全书、书籍、代码等。此外,我们的数据集是多语言的,其中很大一部分数据是英文和中文。

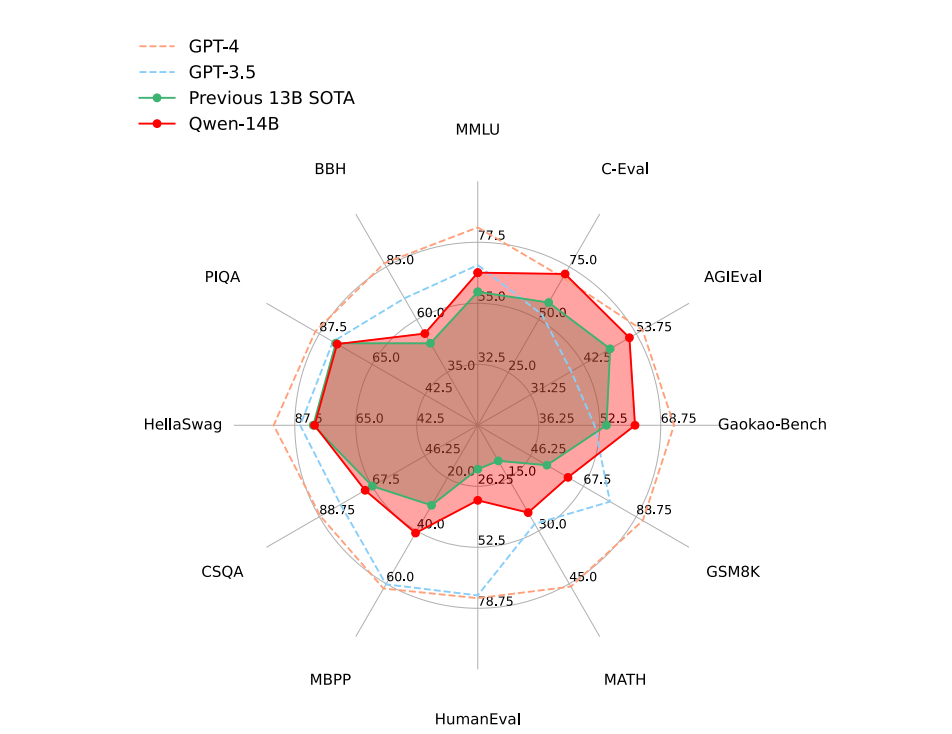

图 2:GPT-4、GPT-3.5、之前的 13B SOTA 模型以及 QWEN-14B 的性能。我们在涵盖语言理解、知识、推理等多个领域的 12 个数据集上展示了结果。QWEN 的性能显著优于之前类似规模的 SOTA 模型,但仍落后于 GPT-3.5 和 GPT-4.

图 2:GPT-4、GPT-3.5、之前的 13B SOTA 模型以及 QWEN-14B 的性能。我们在涵盖语言理解、知识、推理等多个领域的 12 个数据集上展示了结果。QWEN 的性能显著优于之前类似规模的 SOTA 模型,但仍落后于 GPT-3.5 和 GPT-4.

为了确保预训练数据的质量,我们制定了一个全面的数据预处理程序。对于公共网页数据,我们从HTML中提取文本,并使用语言识别工具来确定语言。为了增加数据的多样性,我们采用了去重技术,包括归一化后的精确匹配去重和使用MinHash和LSH算法的模糊去重。为了过滤掉低质量的数据,我们采用了基于规则和基于机器学习的方法相结合的方式。具体而言,我们使用多个模型来评估内容,包括语言模型、文本质量评分模型和用于识别潜在冒犯或不当内容的模型。我们还手动从不同来源抽样文本,并进行审核,以确保其质量。为了进一步提升数据质量,我们有选择性地从某些来源上采样数据,以确保我们的模型在多样化的高质量内容上进行训练。最近的研究(Zeng等,2022;Aribandi等,2021;Raffel等,2020)表明,通过多任务指令进行预训练可以增强模型的零-shot和few-shot性能。为了进一步提升模型的性能,我们在预训练过程中加入了高质量的指令数据。为了保证基准评估的完整性,我们采取了类似于Brown等(2020)的方法,精心排除了任何与测试集中的数据存在13-gram重叠的指令样本。

由于下游任务的数量庞大,因此无法为所有任务重复这一过滤过程。相反,我们确保了报告任务的指令数据经过了我们的过滤过程,以确保其准确性和可靠性。最终,我们构建了一个包含多达3万亿个标记的数据集。

2.2 分词(Tokenization)

词表的设计会显著影响训练效率以及下游任务的性能。在本研究中,我们采用了字节对编码(BPE)作为分词方法,遵循 GPT-3.5 和 GPT-4 的做法。我们以开源的快速 BPE 分词器 tiktoken(Jain,2022)为起点,并选择词表 cl100k_base 作为初始基础。为了提升模型在多语言下游任务中的表现,尤其是中文,我们在词表中加入了常用的中文字符和词语,以及其他语言的词语。此外,参考 Touvron 等(2023a;2023b)的做法,我们将数字拆分为单个数字字符。最终的词表大小约为 152K。

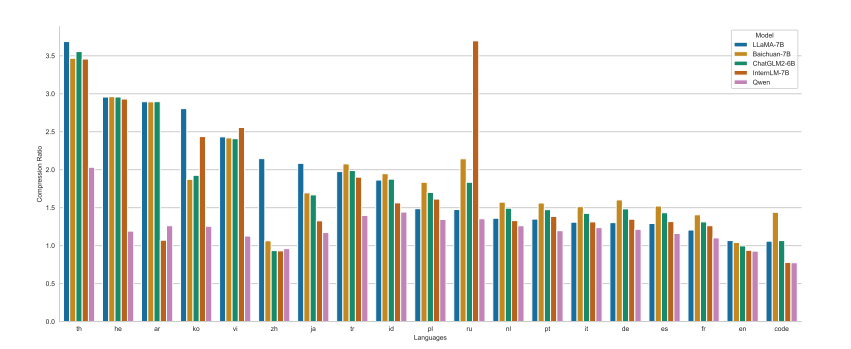

图 3 展示了 QWEN 分词器在压缩率方面的表现。在该对比中,我们将 QWEN 与其他分词器进行比较,包括 XLM-R(Conneau 等,2019)、LLaMA(Touvron 等,2023a)、Baichuan(Inc.,2023a)和 InternLM(InternLM Team,2023)。我们的研究结果表明,QWEN 在大多数语言上的压缩效率都优于其他模型。这意味着在推理服务中所需的成本显著降低,因为 QWEN 的较少 token 数即可表达更多信息。此外,我们还进行了初步实验,确保扩大 QWEN 词表不会对下游任务的性能产生负面影响。尽管词表规模增加,但实验结果显示 QWEN 在下游评测中仍保持稳定的性能。

图 3:不同模型的编码压缩率。我们随机选取每种语言的 100 万份文档语料库来测试和比较不同模型的编码压缩率(以支持 100 种语言的 XLM-R(Conneau et al.. 2019)为基准值1,图中未显示)。可以看出,QWEN在确保高效解码中文、英文和中文代码的同时,也对许多其他语言(例如泰语、希伯来语、阿拉伯语、韩语、越南语、日语、土耳其语、印尼语、波兰语、俄语、荷兰语、葡萄牙语、意大利语、德语、西班牙语、法语等)实现了高压缩率,赋予模型在这些语言中强大的可扩展性和高训练及推理效率。

图 3:不同模型的编码压缩率。我们随机选取每种语言的 100 万份文档语料库来测试和比较不同模型的编码压缩率(以支持 100 种语言的 XLM-R(Conneau et al.. 2019)为基准值1,图中未显示)。可以看出,QWEN在确保高效解码中文、英文和中文代码的同时,也对许多其他语言(例如泰语、希伯来语、阿拉伯语、韩语、越南语、日语、土耳其语、印尼语、波兰语、俄语、荷兰语、葡萄牙语、意大利语、德语、西班牙语、法语等)实现了高压缩率,赋予模型在这些语言中强大的可扩展性和高训练及推理效率。

2.3 架构(Architecture)

QWEN 使用了经过改进的 Transformer 架构。具体而言,我们采用了近年来广泛认可为顶级开源 LLM 的 LLaMA(Touvron 等,2023a)训练策略,并在此基础上进行改动,主要包括:

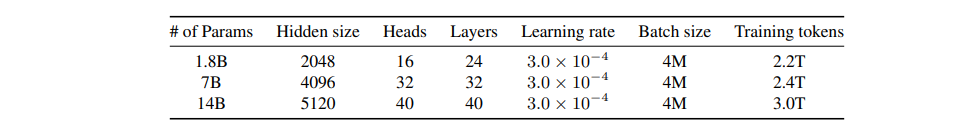

表1:模型规模、架构和优化超参数

表1:模型规模、架构和优化超参数

-

**Embedding 与输出投影(output projection)。**根据初步实验结果,我们选择了"未绑定 embedding"的方式,而不是绑定输入 embedding 与输出投影的权重。尽管这种做法会带来更高的显存消耗,但能带来更好的性能。

-

**位置编码(Positional embedding)。**我们选择使用 RoPE(旋转位置编码,Su 等,2021)来注入位置信息。RoPE 已被广泛应用于现代大模型中,如 PaLM(Chowdhery 等,2022;Anil 等,2023)以及 LLaMA(Touvron 等,2023a;2023b)。特别地,我们将反频率矩阵使用 FP32 精度,而不是 BF16 或 FP16,以优先保证模型性能和精度。

-

**Bias(偏置)。**参考 Chowdhery 等(2022),我们在大多数层中移除了 bias,但在注意力的 QKV 层加入了 bias,以增强模型的外推能力(Su,2023b)。

-

**Pre-Norm 与 RMSNorm。**在现代 Transformer 中,pre-norm 被广泛采用,它相比 post-norm 能显著提升训练稳定性。我们同时将传统 LayerNorm(Ba 等,2016)替换为 RMSNorm(Jiang 等,2023),在保持性能相同的前提下进一步提高了效率。

-

**激活函数(Activation function)。**我们选择使用 SwiGLU(Shazeer,2020)作为激活函数,它结合了 Swish(Ramachandran 等,2017)与门控线性单元 GLU(Dauphin 等,2017)。初步实验表明,基于 GLU 的激活函数普遍优于 GeLU(Hendrycks & Gimpel,2016)。此外,按照以往研究的做法,我们将前馈网络(FFN)的维度从"隐藏层 4倍"调整为"隐藏层的 8/3"。

2.4 训练(Training)

我们遵循标准的自回归语言建模方式训练 QWEN(Radford 等,2018),即根据之前的 token 预测下一个 token。模型的上下文长度设为 2048。为了构建 batch,我们会对文档进行打乱与拼接,然后 truncate 到指定长度。为提升计算效率并减少显存消耗,我们在注意力模块使用 Flash Attention(Dao 等,2022)。优化器采用 AdamW(Kingma & Ba,2014;Loshchilov & Hutter,2017),超参数为 β1=0.9、β2=0.95、ϵ=1e−8。学习率采用 cosine 调度,每个模型规模都有独立的 peak learning rate,并会衰减到峰值的 10%。所有模型均采用 BFloat16 混合精度训练,以增强训练稳定性。

2.5 上下文长度扩展(Context Length Extension)

Transformer 模型在注意力机制的上下文长度方面存在显著限制。随着上下文长度的增加,其二次复杂度的计算会导致计算成本和内存成本急剧上升。在本研究中,我们实现了一些简单的、仅在推理阶段应用的、无需训练的技术,用于扩展模型的上下文长度。其中一个关键技术是 NTK-aware 插值(bloc97,2023)。与位置插值(PI)(Chen 等,2023a)对 RoPE 的每个维度进行等比例缩放不同,NTK-aware 插值通过调整 RoPE 的基数,以训练无关的方式防止高频信息丢失。为了进一步提升性能,我们还实现了一个简单的扩展方法,称为动态 NTK-aware 插值,该方法后来在(Peng 等,2023a)中被正式讨论。它通过按块动态改变尺度,避免严重的性能退化。这些技术使我们能够有效扩展 Transformer 模型的上下文长度,而不牺牲其计算效率或准确性。

QWEN 另外还结合了两种注意力机制:LogN-Scaling(Chiang & Cholak,2022;Su,2023a)和窗口注意力(Beltagy 等,2020)。LogN-Scaling 通过一个依赖于上下文长度与训练长度之比的因子对查询与键的点积进行重新缩放,以确保随着上下文长度增长,注意力值的熵保持稳定。窗口注意力将注意力限制在一定的上下文窗口内,防止模型关注距离过远的 token。

我们还观察到,模型在长上下文建模能力上在不同层之间存在差异,其中较低层相较于较高层更加敏感于上下文长度的扩展。基于这一观察,我们为不同层分配了不同的窗口大小:对较低层使用较短的窗口,对较高层使用较长的窗口。

2.6 实验结果(Experimental Results)

为了评估我们模型的 zero-shot 和 few-shot 学习能力,我们使用一系列数据集进行了全面的基准测试。我们将 QWEN 与最新的开源基础模型进行比较,包括 LLaMA(Touvron 等,2023a)、LLAMA 2(Touvron 等,2023b)、MPT(Mosaic ML,2023)、Falcon(Almazrouei 等,2023)、Baichuan2(Yang 等,2023)、ChatGLM2(ChatGLM2 Team,2023)、InternLM(InternLM Team,2023)、XVERSE(Inc.,2023b)以及 StableBeluga2(Stability AI,2023)。我们的评估覆盖共 7 个常用基准,包括 MMLU(5-shot)(Hendrycks 等,2020)、C-Eval(5-shot)(Huang 等,2023)、GSM8K(8-shot)(Cobbe 等,2021)、MATH(4-shot)(Hendrycks 等,2021)、HumanEval(0-shot)(Chen 等,2021)、MBPP(0-shot)(Austin 等,2021)以及 BBH(Big Bench Hard)(3-shot)(Suzgun 等,2022)。我们的目标是对模型在这些基准上的整体表现提供一个全面总结。

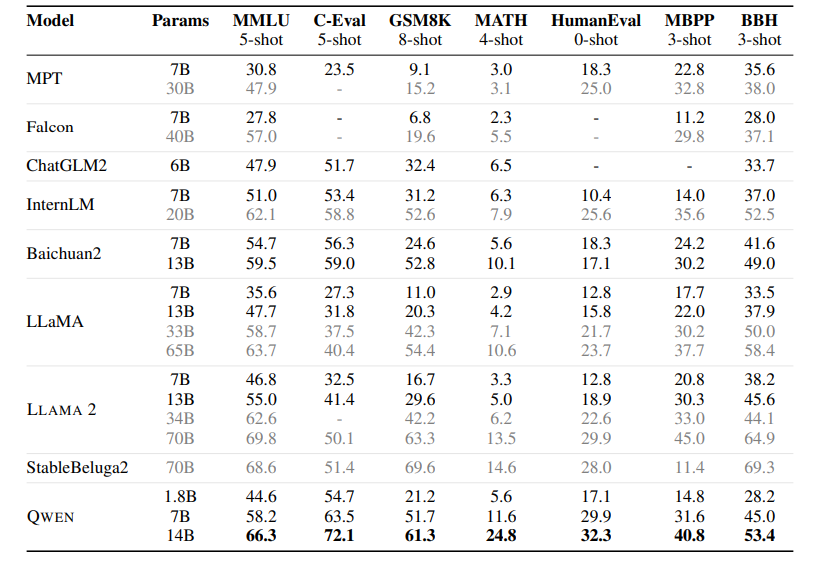

在本次评估中,我们聚焦于未经对齐的基础语言模型,并从模型官方结果以及 OpenCompass(OpenCompass Team,2023)中收集其最佳分数。结果展示在表 2 中。

表2:与开源基础模型相比,在常用基准测试中的总体性能。我们最大的QWEN模型拥有140亿个参数在所有数据集上均优于之前130亿参数的最先进模型

表2:与开源基础模型相比,在常用基准测试中的总体性能。我们最大的QWEN模型拥有140亿个参数在所有数据集上均优于之前130亿参数的最先进模型

我们的实验结果表明,三个 QWEN 模型在所有下游任务中均展现出优异表现。值得注意的是,即使是较大的模型,例如 LLaMA2-70B,也在 3 个任务上被 QWEN-14B 超越。QWEN-7B 同样表现出色,超过了 LLaMA2-13B,并取得了与 Baichuan2-13B 相当的结果。特别值得一提的是,尽管参数量相对较小,QWEN-1.8B 在某些任务中仍能展现出具有竞争力的表现,甚至在某些情况下超过更大的模型。这些发现突出了 QWEN 模型的强大能力,尤其是 QWEN-14B,同时也表明诸如 QWEN-1.8B 这样的较小模型在某些应用中仍能取得强劲表现。

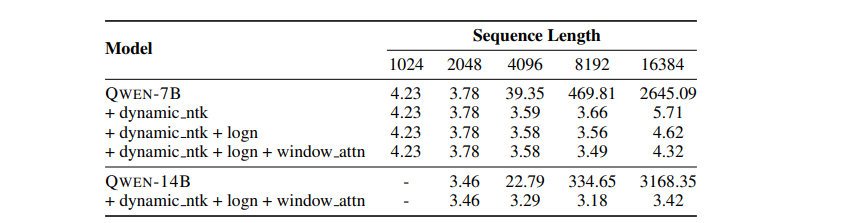

为了评估上下文长度扩展的效果,表 3 展示了模型在 arXiv 上的困惑度(PPL)测试结果。这些结果表明,通过结合 NTK-aware 插值、LogN-Scaling 以及分层窗口分配,我们能够在超过 8192 tokens 的上下文长度下有效保持模型性能。

表3:QWEN在运用不同技术进行长上下文推理的结果。我们的实验结果表明,应用我们的关键技术能够使模型在上下文长度增加时始终保持较低的困惑度。这表明这些技术在增强模型理解和生成长文本的能力方面发挥了重要作用。

表3:QWEN在运用不同技术进行长上下文推理的结果。我们的实验结果表明,应用我们的关键技术能够使模型在上下文长度增加时始终保持较低的困惑度。这表明这些技术在增强模型理解和生成长文本的能力方面发挥了重要作用。

三 对齐

预训练的大型语言模型(LLMs)通常无法与人类行为对齐,因此它们在大多数情况下不适合作为 AI 助手。最近的研究表明,使用对齐技术,如监督微调(SFT)和通过人类反馈的强化学习(RLHF),可以显著提高语言模型进行自然对话的能力。在本节中,我们将详细介绍 QWEN 模型如何通过 SFT 和 RLHF 训练,并评估它们在基于聊天的辅助任务中的表现。

3.1 监督微调

为了让模型更好地理解人类行为,第一步是进行 SFT,该过程通过聊天风格的数据对预训练的 LLM 进行微调,包括查询和回答。在接下来的部分中,我们将深入讨论数据构建和训练方法的细节。

3.1.1 数据

为了提升监督微调数据集的能力,我们对多种风格的对话进行了标注。传统的数据集(Wei 等,2022a)包含大量以问题、指令和回答为提示的数据,而我们的做法更进一步,通过标注人类风格的对话来提升模型的帮助能力,重点关注多样化任务的自然语言生成。为了确保模型能够在各种情境下进行推广,我们特别排除了以模板格式进行标注的数据,因为这些数据可能会限制模型的能力。此外,我们还优先考虑了与安全性相关的数据标注,如暴力、偏见和色情内容,以确保模型的安全性。

除了数据质量,我们还观察到训练方法对模型最终表现有显著影响。为此,我们使用了 ChatML 风格的格式(OpenAI,2022),它是一种多功能的元语言,能够描述回合的元数据(如角色)和内容。这种格式使得模型能够有效区分各种类型的信息,包括系统设置、用户输入和助手输出等。通过这种方式,我们提升了模型准确处理和分析复杂对话数据的能力。

3.1.2 训练

与预训练一致,我们也采用了下一个 token 预测作为 SFT 的训练任务。我们对系统和用户输入应用了损失掩码。更多细节请见 A.1.1 节。模型的训练过程使用 AdamW 优化器,超参数设置为 β1 = 0.9、β2 = 0.95 和 ϵ = 10−8。序列长度限制为 2048,批次大小为 128。模型共训练了 4000 步,其中前 1430 步逐步增加学习率,直到达到 2 × 10−6 的峰值。为了防止过拟合,采用了 0.1 的权重衰减,0.1 的丢弃率,并对梯度进行 1.0 的裁剪。

3.2 强化学习与人类反馈

尽管 SFT 已经证明有效,但我们认识到其泛化能力和创造力可能有限,且容易出现过拟合。为了应对这个问题,我们引入了强化学习与人类反馈(RLHF),进一步使 SFT 模型与人类偏好对齐,采用了 Ouyang 等(2022)和 Christiano 等(2017)的方法。该过程包括训练奖励模型并使用近端策略优化(PPO)(Schulman 等,2017)进行策略训练。

3.2.1 奖励模型

为了创建一个成功的奖励模型,类似于构建一个大型语言模型(LLM),必须首先进行预训练,然后进行微调。这个预训练过程,也称为偏好模型预训练(PMP)(Bai 等,2022b),需要一个包含对比数据的大型数据集。该数据集由成对样本组成,每对样本包含对同一查询的两个不同回答以及它们对应的偏好。同样,微调也在这种对比数据上进行,只是由于有质量标注,微调阶段的质量更高。

在微调阶段,我们收集了各种提示并根据 QWEN 模型的输出调整奖励模型。为了确保用户提示的多样性和复杂性得以充分考虑,我们建立了一个包含约 6600 个详细标签的分类系统,并实施了一个平衡采样算法,既考虑多样性,又兼顾复杂性,选择样本进行标注(Lu 等,2023)。为了生成多样的回答,我们使用了不同大小的 QWEN 模型和不同的采样策略,因为多样的回答有助于减少标注难度并提升奖励模型的表现。然后,经过标准标注指南的评估后,基于评分形成了对比对。

在创建奖励模型时,我们使用了与 QWEN 相同规模的预训练语言模型作为起点。需要注意的是,我们在原始 QWEN 模型中加入了池化层,以便根据特定的结束 token 提取句子的奖励。学习率设置为 3 × 10−6,批次大小为 64。此外,序列长度设置为 2048,训练过程持续 1 个周期。

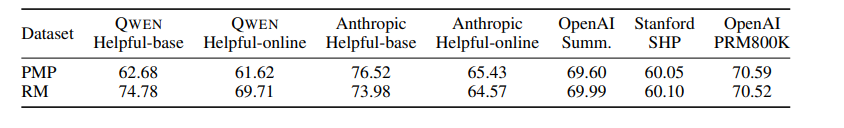

我们采用测试数据集上的准确率作为奖励模型的重要(但非唯一)评价指标。在表 4 中,我们报告了 PMP 和奖励模型在多种人类偏好基准数据集上的测试成对准确率(Bai 等,2022b;Stiennon 等,2020;Ethayarajh 等,2022;Lightman 等,2023)。具体而言,QWEN Helpful-base 和 QWEN Helpful-online 是我们的专有数据集。QWEN Helpful-base 中的回复由未经 RLHF 的 QWEN 生成,而 QWEN Helpful-online 则包含经过 RLHF 的 QWEN 所生成的回复。结果显示,PMP 模型在分布外数据上展现出很强的泛化能力,而奖励模型在我们的 QWEN 奖励数据集上呈现出显著提升。

表 4:QWEN 偏好模型预训练 (PMP) 和奖励模型(RM)在各种人类偏好基准数据集上的测试准确率

表 4:QWEN 偏好模型预训练 (PMP) 和奖励模型(RM)在各种人类偏好基准数据集上的测试准确率

3.2.2 强化学习

我们的 PPO 过程涉及四个模型:策略模型、价值模型、参考模型和奖励模型。在开始 PPO 操作之前,我们暂停策略模型的更新,专注于更新价值模型 50 步,以确保价值模型能有效地适应不同的奖励模型。

在 PPO 操作期间,我们对每个查询同时采样两个回答。这一策略已在我们的内部基准测试中证明更加有效。我们将 KL 散度系数设置为 0.04,并基于运行均值对奖励进行归一化。

策略和价值模型的学习率分别为 1 × 10−6 和 5 × 10−6。为了提高训练稳定性,我们使用了值损失裁剪,裁剪值为 0.15。对于推理,策略的 top-p 设置为 0.9。我们的实验结果表明,尽管与 top-p 设置为 1.0 的情况相比,熵略低,但奖励的增加速度较快,最终在相似条件下获得了更高的评估奖励。

此外,我们还实现了一个预训练梯度来减轻对齐税(alignment tax)。实验证明,使用该奖励模型时,KL 惩罚足够强大,可以有效抵消非严格代码或数学类基准测试中的对齐税,例如常识知识和阅读理解任务。为了确保预训练梯度的有效性,相比于 PPO 数据,我们使用了大规模的预训练数据。此外,我们的实验证明,对于该系数的过大值会显著妨碍对奖励模型的对齐,最终损害最终的对齐效果,而过小的值对对齐税的减少几乎没有影响。

3.3 自动和人工评估对齐模型

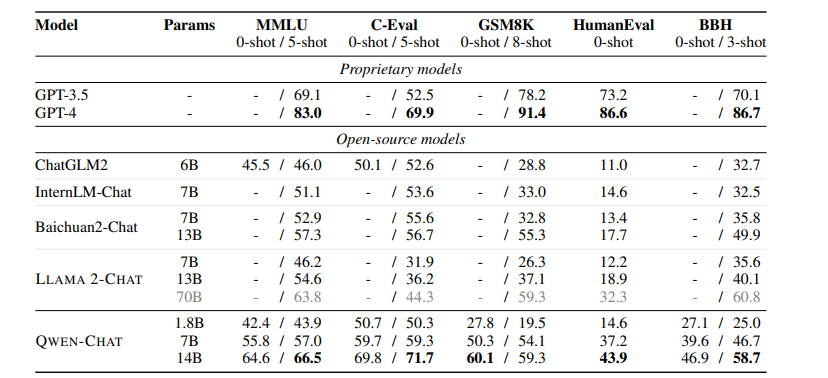

为了展示我们对齐模型的效果,我们将其与其他对齐模型在已建立的基准测试中进行了比较,包括 MMLU(Hendrycks 等,2020)、C-Eval(Huang 等,2023)、GSM8K(Cobbe 等,2021)、HumanEval(Chen 等,2021)和 BBH(Suzgun 等,2022)。除了常用的 few-shot 设置外,我们还测试了我们的对齐模型在 zero-shot 设置下的表现,展示模型如何理解指令。zero-shot 设置中的提示包含指令和问题,没有任何先前的示例。

表 5 显示了我们对齐模型的性能,结果表明,QWEN-14B-Chat 在所有数据集上超越了其他所有模型,包括 GPT-3.5(OpenAI,2022)和 LLaMA 2-CHAT-70B(Touvron 等,2023b)。特别是在 HumanEval 中,QWEN 的表现显著高于其他开源模型。

表 5:对齐模型在常用基准测试集上的性能。我们报告了模型的零样本和少样本性能。

表 5:对齐模型在常用基准测试集上的性能。我们报告了模型的零样本和少样本性能。

此外,QWEN 的性能在同等规模的开源模型中也始终表现更佳,例如 LLaMA2(Touvron 等,2023b)、ChatGLM2(ChatGLM2 Team,2023)、InternLM(InternLM Team,2023)以及 Baichuan2(Yang 等,2023)。这表明我们的对齐方法(将模型在大量人类对话数据上进行微调)在提升模型理解与生成人类语言的能力方面是有效的。

尽管如此,我们对于传统基准评估能否准确衡量使用对齐技术训练的聊天模型在当今环境中的性能与潜力仍持保留态度。前述结果提供了一些竞争力的证据,但我们认为开发专门针对对齐模型的新评价方法至关重要。

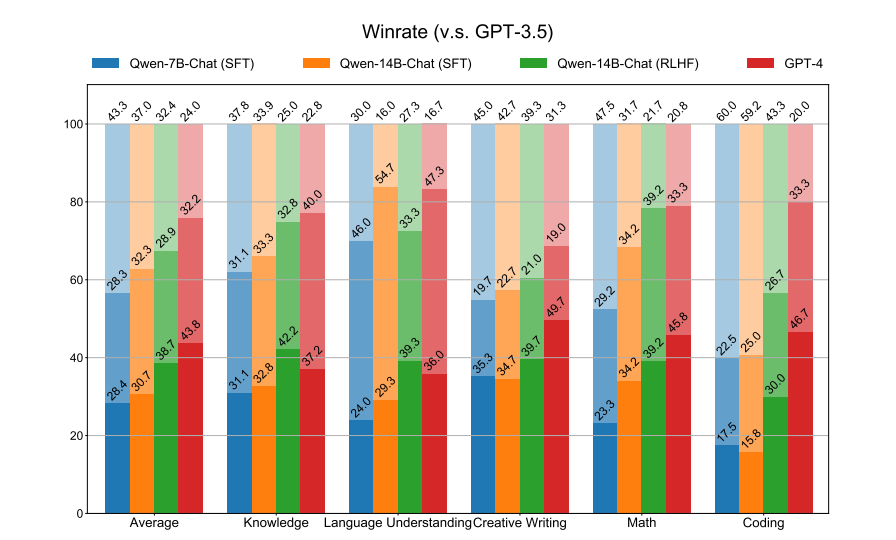

我们认为人工评测是关键,因此我们为此专门构建了一套精心筛选的数据集。我们的流程包括收集 300 条中文指令,覆盖知识、语言理解、创意写作、编程与数学等多个主题。为了评估不同模型的表现,我们选择了 QWEN-CHAT-7B 的 SFT 版本,以及 QWEN-CHAT-14B 的 SFT 与 RLHF 版本,并加入两个强基线模型 GPT-3.5 和 GPT-4 作为比较对象。对于每条指令,我们要求三位标注员根据有用性、信息量、有效性以及其他相关因素,对模型生成的回答进行排名。我们构建的数据集与评估方法为不同语言模型在各类任务中的能力提供了全面且严谨的测评。

图 4 展示了各模型的胜率情况。对于每个模型,我们报告其相对于 GPT-3.5 的胜、平、负百分比,每个柱状图自底向上依次表示这三类统计。实验结果清晰显示,RLHF 模型相比 SFT 模型有显著提升,这表明 RLHF 能够促使模型生成更符合人类偏好的回答。在整体性能方面,我们发现 RLHF 模型显著优于 SFT 模型,仅落后于 GPT-4。这说明 RLHF 在对齐人类偏好方面具有有效性。为了进一步呈现模型表现,我们在附录 A.2.2 中提供了不同模型的案例研究。然而,目前仍难以准确衡量我们模型与闭源模型之间的差距。因此,对于聊天模型来说,需要更大规模且更严格的评估。

图 4:聊天模型的人工评估结果。我们将 Qwen-7B(SFT)、Qwen14B (SFT)、Qwen-14B (RLHF)以及GPT-4 与 GPT-3.5 进行比较。每个柱状图段代表胜、平、负的百分比,从下到上依次排列。平均而言,RLHF 模型优于 SFT 模型。数据集包含 300 条中文指令。

图 4:聊天模型的人工评估结果。我们将 Qwen-7B(SFT)、Qwen14B (SFT)、Qwen-14B (RLHF)以及GPT-4 与 GPT-3.5 进行比较。每个柱状图段代表胜、平、负的百分比,从下到上依次排列。平均而言,RLHF 模型优于 SFT 模型。数据集包含 300 条中文指令。

3.4 工具使用、代码解释器与代理

QWEN 模型是多功能的,能够协助(半)自动化日常任务,通过其工具使用和规划技能作为代理或助手来帮助简化各种任务。我们探索了 QWEN 在以下几个方面的能力:

-

通过 ReAct 提示(Yao 等,2022)使用未见过的工具(见表 6)。

-

使用 Python 代码解释器增强数学推理、数据分析等(见表 7 和表 8)。

-

作为一个能够访问 Hugging Face 上多个多模态模型的代理,与人类进行互动(见表 9)。

为了增强 QWEN 作为智能体或副驾驶的能力,我们在 SFT 中采用了 self-instruct(Wang et al., 2023c)策略。具体而言,我们利用 QWEN 的 in-context learning 能力进行自我指令生成。通过提供少量示例,我们可以提示 QWEN 生成更相关的查询,并生成遵循特定格式(如 ReAct(Yao et al., 2022))的输出。随后,我们应用规则并引入人工标注人员,以过滤掉任何噪声样本。之后,这些样本被纳入 QWEN 的训练数据中,从而使更新后的 QWEN 在自我指令方面表现得更加可靠。我们多次迭代这一过程,直到收集到足够数量、质量优秀且多样性广泛的样本。最终,我们的样本集合包含约 2000 条高质量样本。

在微调过程中,我们将这些高质量样本与所有其他通用 SFT 样本混合,而不是引入额外的训练阶段。通过这种方式,我们能够保留对构建智能体应用同样重要的通用能力。

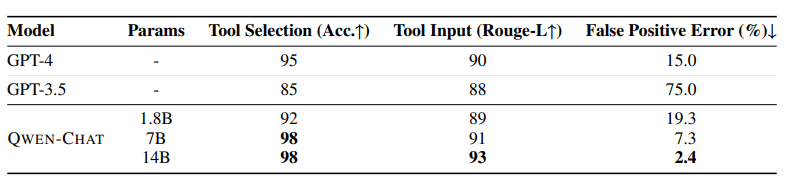

使用 ReAct Prompting 进行工具调用。我们构建并公开了一个基准,用于评估 QWEN 在使用 ReAct Prompting 调用插件、工具、函数或 API 方面的能力(参见 Qwen Team, Alibaba Group, 2023b)。为确保公平评测,我们从评估集中排除所有出现在 QWEN 训练集中的插件。该基准评估模型从最多 5 个候选工具中选择正确工具的准确率、传递给工具的参数的合理性,以及错误调用(false positives)的频率。在该评估中,错误调用指的是当模型面对一个不需要任何工具的问题时,仍然错误地调用了工具。

表 6 的结果显示,随着模型规模的增长,QWEN 在识别查询与可用工具相关性方面持续取得更高准确率。然而,表格也强调,在达到某一规模之后,选择合适工具和提供相关参数的性能提升变得有限。这表明当前的初步基准可能相对简单,并需要在未来进一步增强。值得注意的是,GPT-3.5 是一个例外,在该基准上的表现不佳。这可能是因为该基准主要聚焦中文,而 GPT-3.5 的能力可能无法很好匹配。此外,我们观察到 GPT-3.5 往往会尝试至少使用一个工具,即便查询无法通过提供的工具有效解决。

表 6:QWEN 在内部中文基准测试中的表现,该基准测试评估基通过 ReAct 提示使用未见过的工具的能力

表 6:QWEN 在内部中文基准测试中的表现,该基准测试评估基通过 ReAct 提示使用未见过的工具的能力

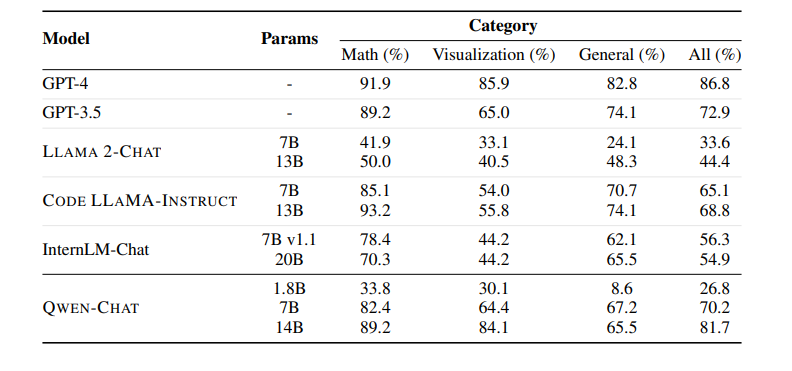

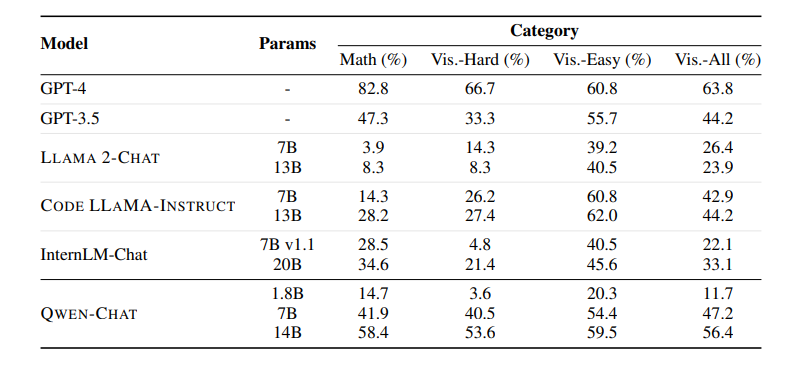

使用代码解释器进行数学推理与数据分析。Python 代码解释器被广泛视为增强 LLM 智能体能力的强大工具。探究 QWEN 是否能够充分利用该解释器,在数学推理与数据分析等多个领域提升能力,具有重要意义。为此,我们开发并公开了一个专门用于该目的的基准(参见 Qwen Team, Alibaba Group, 2023a)。

该基准涵盖三类主要任务:数学问题求解、数据可视化,以及其他通用任务,如文件后处理与网页爬取。在可视化任务中,我们区分两种难度等级。较简单的等级仅需编写并执行单段代码即可完成,不需要高级规划能力。然而,较困难的等级要求策略性规划,并按顺序执行多段代码,因为后续代码必须基于之前代码的输出。例如,智能体可能需要先通过一段代码检查 CSV 文件的结构,然后再编写并执行其他代码生成图表。

在评估指标方面,我们同时考虑代码的可执行性与正确性。关于正确性指标,对于数学问题,我们通过验证最终响应和代码执行结果中是否都包含真实数值答案来衡量准确率。在数据可视化方面,我们使用 QWEN-VL(Bai et al., 2023)来评估准确率。QWEN-VL 能够回答由文本和图像组成的问题,我们依赖它确认代码生成的图像是否满足用户请求。

可执行性和正确性的结果分别展示在表 7 和表 8 中。可以看出,CODE LLAMA 通常优于其通用模型 LLAMA 2,这并不意外,因为该基准特别需要编程能力。然而值得注意的是,针对代码生成优化的专业模型不一定优于通用模型。这是因为该基准涵盖了超越编程能力的多种技能,例如将数学问题抽象成方程、理解语言指定的约束、以及按照特定格式(如 ReAct)作答。值得注意的是,QWEN-7B-CHAT 与 QWEN-14B-CHAT 在所有开源替代方案中表现显著领先,尽管它们是通用模型。

表7:QWEN 生成的代码在内部代码解释器评估基准测试中可执行的比例。该基准测试考察了 QWEN在数学问题求解、数据可视化和通用编程方面的能力。CODE LLAMA 在可视化任务中表现不佳,因为它仅根据 CSV 文件名就错误地生成了不存在的列(见图 5)。

表7:QWEN 生成的代码在内部代码解释器评估基准测试中可执行的比例。该基准测试考察了 QWEN在数学问题求解、数据可视化和通用编程方面的能力。CODE LLAMA 在可视化任务中表现不佳,因为它仅根据 CSV 文件名就错误地生成了不存在的列(见图 5)。  表 8:代码解释器内部评估基准测试中最终响应的正确性。可视化难度高的任务涉及规划多个步骤,而可视化难度低的任务则不需要。可视化难度高的任务则同时衡量这两种类型的任务。CODELLAMA 在执行可视化难度低的任务时表现出色,但在执行可视化难度高的任务时表现欠佳,这是因为它倾向于根据CSV 文件名错误地创建不存在的列(参见图5)。

表 8:代码解释器内部评估基准测试中最终响应的正确性。可视化难度高的任务涉及规划多个步骤,而可视化难度低的任务则不需要。可视化难度高的任务则同时衡量这两种类型的任务。CODELLAMA 在执行可视化难度低的任务时表现出色,但在执行可视化难度高的任务时表现欠佳,这是因为它倾向于根据CSV 文件名错误地创建不存在的列(参见图5)。

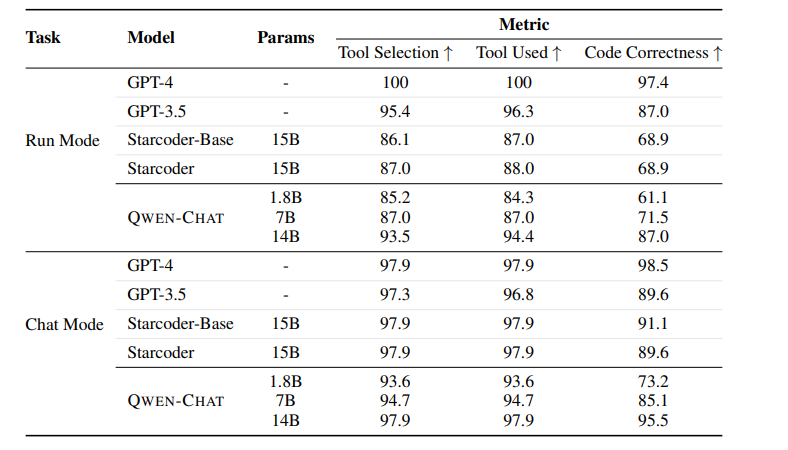

作为 Hugging Face Agent 使用。Hugging Face 提供了一个名为 Hugging Face Agent 或 Transformers Agent(Hugging Face, 2023)的框架,它为 LLM 智能体赋予一组精心整理的多模态工具,包括语音识别和图像生成。该框架允许 LLM 智能体与人类交互、解释自然语言指令,并根据需要使用所提供的工具。

为评估 QWEN 作为 Hugging Face Agent 的有效性,我们使用了 Hugging Face 提供的评估基准。结果展示在表 9 中。评估结果显示,QWEN 相较于其他开源替代方案表现良好,仅略低于专有模型 GPT-4,展示了 QWEN 的竞争能力。

表9:QWEN-Chat 在 Hugging Face Agent 基准测试中的结果

表9:QWEN-Chat 在 Hugging Face Agent 基准测试中的结果

四 CODE-QWEN:编码专用模型

通过对特定领域数据的训练,尤其是针对代码的预训练和微调,已经证明是非常有效的。一种经过代码数据强化的语言模型可以在编码、调试和解释等任务中成为有价值的工具。在这项工作中,我们开发了一系列通用模型,利用预训练和对齐技术,构建了专用的编码模型,这些模型基于 QWEN 的基础语言模型,包括继续预训练的 CODE-QWEN 和通过监督微调的 CODE-QWEN-CHAT。两者分别有 14B 和 7B 的参数版本。

4.1 CODE 预训练

我们认为仅依靠代码数据进行预训练可能会导致模型丧失作为通用助手的能力。因此,与之前单纯依赖代码数据进行预训练的做法不同(Li 等,2022;2023d),我们采取了不同的方式(Roziere 等,2023),首先在包括文本和代码数据的混合数据集上对 QWEN 进行预训练,然后继续在代码数据上进行预训练。我们继续在约 90 亿个标记的代码数据上对模型进行预训练。在预训练阶段,我们使用基础语言模型QWEN来初始化模型。许多依赖于代码专用模型的应用可能会遇到长上下文场景,例如工具使用和代码解释,如第3.4节所述。为了解决这一问题,我们对模型进行了最多8192长度上下文的训练。与第2.4节中的基础模型训练类似,我们在注意力模块中采用了Flash Attention (Dao et al., 2022),并使用标准优化器AdamW (Kingma & Ba, 2014; Loshchilov & Hutter, 2017),设置β1 = 0.9, β2 = 0.95, ϵ = 10⁻⁸。我们将CODE-QWEN-14B的学习率设置为6.0 × 10⁻⁵,CODE-QWEN-7B的学习率设置为3.0 × 10⁻⁵,采用3%的warm-up迭代次数,并且不进行学习率衰减。

4.2 CODE 监督微调

通过一系列的实验证明,我们认为多阶段的 SFT 策略比其他方法更能提升性能。在监督微调阶段,基于 CODE-QWEN 的代码基础模型初始化的 CODE-QWEN-CHAT 通过 AdamW 优化器(Kingma & Ba,2014;Loshchilov & Hutter,2017)进行优化,学习率分别为 2.0 × 10−6 和 1.0 × 10−5,适用于 14B 和 7B 模型。

4.3 评估

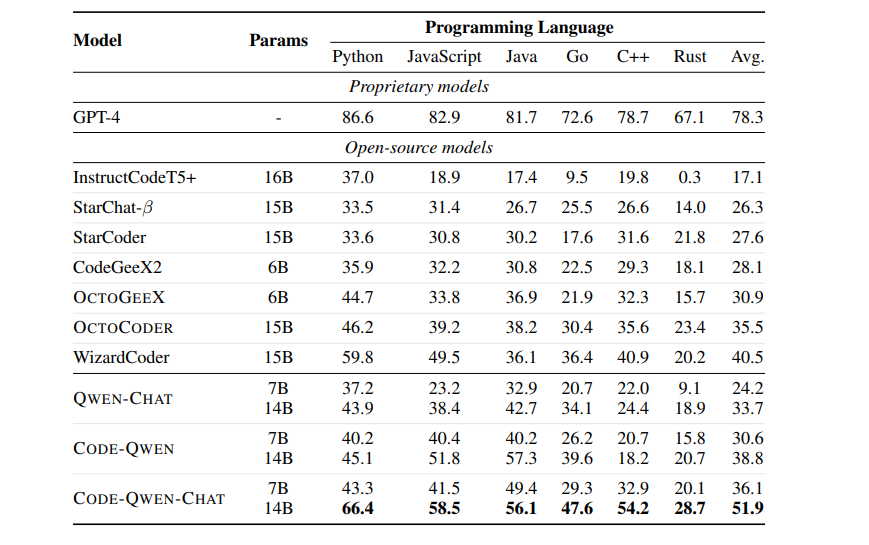

我们的CODE-QWEN模型已经与专有和开源语言模型进行了对比,如表10和表11所示。这些表格展示了我们在Humaneval (Chen et al., 2021)、MBPP (Austin et al., 2021)以及多语言代码生成基准HUMANEVALPACK (Muennighoff et al., 2023)测试集上的评估结果。比较基于模型在这些基准数据集上的pass@1表现。该比较结果在表10和表11中有清晰展示。

表10:HumanEval和MBPP 的 pass@1(%)结果。大部分分数来自 StarCoder(Li等人,2023d)CodeT5+(Wang等人,2023d)、WizardCoder(Luo 等人,2023b)和 CODE LLAMA (Roziere 等人,2023)的论文。

表10:HumanEval和MBPP 的 pass@1(%)结果。大部分分数来自 StarCoder(Li等人,2023d)CodeT5+(Wang等人,2023d)、WizardCoder(Luo 等人,2023b)和 CODE LLAMA (Roziere 等人,2023)的论文。  表11:HUMANEVALPACK(synthesize)基准测试中零样本通过率(1%)的性能。基准测试结果部分来自 OCTOPACK(Muennighoff等人,2023)。

表11:HUMANEVALPACK(synthesize)基准测试中零样本通过率(1%)的性能。基准测试结果部分来自 OCTOPACK(Muennighoff等人,2023)。

我们的分析表明,专用模型,特别是CODE-QWEN和CODE-QWEN-CHAT,在相似参数量的情况下,明显优于以往的基线模型,例如OCTOGEEX (Muennighoff et al., 2023)、InstructCodeT5+ (Wang et al., 2023d)和CodeGeeX2 (Zheng et al., 2023)。实际上,这些模型甚至可以与更大规模的模型如Starcoder (Li et al., 2023d)的性能相媲美。

与一些极大规模闭源模型相比,CODE-QWEN和CODE-QWEN-CHAT在pass@1方面表现出明显优势。然而,需要注意的是,这些模型在总体上仍落后于最先进的方法,例如GPT-4。不过,随着模型规模和数据规模的持续扩展,我们认为这一差距在不久的将来可以缩小。

必须强调的是,前述评估不足以全面掌握模型的优劣。我们认为,有必要开发更严格的测试,以便能够准确评估我们与GPT-4相比的相对性能。

五MATH-QWEN:数学推理专用模型

我们创建了一系列数学专用模型,称为MATH-QWEN-CHAT,该系列基于QWEN预训练语言模型构建。具体来说,我们开发了专门用于算术和数学的助手模型,并且与人类行为保持一致。我们发布了该系列的两个版本:MATH-QWEN-14B-CHAT和MATH-QWEN-7B-CHAT,分别拥有140亿和70亿参数。

5.1 训练

我们在增强的数学指令数据集上进行数学SFT,以进行数学推理训练,因此直接获得了聊天模型MATH-QWEN-CHAT。由于数学SFT数据的平均长度较短,我们使用1024的序列长度以加快训练速度。数学SFT数据集中的大多数用户输入为考试题目,模型容易预测输入格式,而预测输入条件和数字(可能是随机的)则没有意义。因此,我们对系统和用户的输入进行掩码处理,以避免在其上计算损失,并发现在初步实验中掩码处理加速了收敛。优化方面,我们使用AdamW优化器,超参数与SFT相同,但峰值学习率为2 × 10⁻⁵,训练步数为50,000。

5.2 评估

我们在GSM8K(小学数学)(Cobbe et al., 2021)、MATH(具有挑战性的竞赛数学题)(Hendrycks et al., 2021)、Math401(算术能力)(Yuan et al., 2023b)和Math23K(中国小学数学)(Wang et al., 2017)测试集上评估模型。我们将MATH-QWEN-CHAT与专有模型ChatGPT和Minerva (Lewkowycz et al., 2022)以及开源数学专用模型RFT (Yuan et al., 2023a)、WizardMath (Luo et al., 2023a)和GAIRMath-Abel (Chern et al., 2023a)进行比较(见表12)。MATH-QWEN-CHAT模型在数学推理和算术能力方面优于开源模型及同等规模的QWEN-CHAT模型。与专有模型相比,MATH-QWEN-7B-CHAT在MATH中优于Minerva-8B;MATH-QWEN-14B-CHAT在GSM8K和MATH中追赶Minerva-62B和GPT-3.5,并在算术能力及中文数学题上表现更佳。

表 12:数学推理模型的结果。我们报告了 QWEN在所有基准测试中使用贪婪解码的准确率。对于MATH 测试,我们报告了 QWEN 在 Lightman 等人(2023) 测试集上的性能。

表 12:数学推理模型的结果。我们报告了 QWEN在所有基准测试中使用贪婪解码的准确率。对于MATH 测试,我们报告了 QWEN 在 Lightman 等人(2023) 测试集上的性能。

六相关工作

6.1 大型语言模型

大型语言模型(LLM)的热潮始于Transformer架构的提出(Vaswani et al., 2017),随后被Radford等(2018)、Devlin等(2018)、Liu等(2019)应用于大规模预训练数据。这些工作在迁移学习中取得了显著成功,模型规模从1亿增长至超过100亿参数(Raffel et al., 2020;Shoeybi et al., 2019)。

2020年,GPT-3的发布------一个比T5大十倍的巨型语言模型------展示了通过提示工程和上下文学习实现少样本和零样本学习的巨大潜力,并随后引入链式思维提示(Wei et al., 2022c)。这一成功推动了进一步扩展模型规模的研究(Scao et al., 2022;Zhang et al., 2022;Du et al., 2021;Zeng et al., 2022;Lepikhin et al., 2020;Fedus et al., 2022;Du et al., 2022;Black et al., 2022;Rae et al., 2021;Hoffmann et al., 2022;Chowdhery et al., 2022;Thoppilan et al., 2022)。因此,社区将这些大型语言模型视为下游模型的基础(Bommasani et al., 2021)。

ChatGPT (OpenAI, 2022)的诞生及GPT-4 (OpenAI, 2023)的推出标志着人工智能领域的两个历史性时刻,证明了大型语言模型可作为有效的AI助手与人类交流。这激发了研究者和开发者构建与人类价值观对齐,甚至有潜力实现通用人工智能(AGI)的语言模型兴趣(Anil et al., 2023;Anthropic, 2023a;b)。

开源LLM的发展尤为突出,特别是LLaMA (Touvron et al., 2023a)和LLAMA 2 (Touvron et al., 2023b),被认为是迄今最强大的开源语言模型,这推动了开源社区的活跃(Wolf et al., 2019),并催生了系列大型语言模型的协作开发(Mosaic ML, 2023;Almazrouei et al., 2023;ChatGLM2 Team, 2023;Yang et al., 2023;InternLM Team, 2023)。

6.2 对齐

社区对LLM对齐的有效性印象深刻。未对齐的LLM常出现重复生成、幻觉和偏离人类偏好等问题。自2021年以来,研究者致力于提升LLM在下游任务中的表现(Wei et al., 2022a;Sanh et al., 2021;Longpre et al., 2023;Chung et al., 2022;Muennighoff et al., 2022),并探索将LLM与人类指令对齐的方法(Ouyang et al., 2022;Askell et al., 2021;Bai et al., 2022b;c)。对齐研究的一大挑战是数据收集困难。虽然OpenAI通过其平台收集了人类提示或指令,但其他机构难以实现。

在此方面已有进展,例如Wang等(2023c)提出的self-instruct方法,为对齐研究的数据收集问题提供了潜在解决方案。因此,开源聊天数据激增,包括Alpaca (Taori et al., 2023)、MOSS (Sun et al., 2023a)、Dolly (Conover et al., 2023)、Evol-Instruct (Xu et al., 2023b)等(Sun et al., 2023b;Xu et al., 2023a;c;Chen et al., 2023c;Ding et al., 2023;Ji et al., 2023;Yang, 2023)。同样,开源聊天模型也有所增加,如Alpaca (Taori et al., 2023)、Vicuna (Chiang et al., 2023)、Guanaco (Dettmers et al., 2023)、MOSS (Sun et al., 2023a)、WizardLM (Xu et al., 2023b)等(Xu et al., 2023c;Chen et al., 2023c;Ding et al., 2023;Wang et al., 2023b)。

训练高效的聊天模型通常基于SFT和RLHF (Ouyang et al., 2022)。SFT类似于预训练,但侧重于使用上述数据进行指令跟随训练。对于许多开发者来说,内存限制是进一步研究SFT的主要障碍。因此,参数高效调优方法如LoRA (Hu et al., 2021)和Q-LoRA (Dettmers et al., 2023)受到关注。LoRA仅调优低秩适配器,Q-LoRA在此基础上结合4位量化LLM和分页注意力(Dettmers et al., 2022;Frantar et al., 2022;Kwon et al., 2023)。在RLHF方面,近期采用的方法包括PPO (Schulman et al., 2017;Touvron et al., 2023b),也存在RRHF (Yuan et al., 2023c)、DPO (Rafailov et al., 2023)和PRO (Song et al., 2023)等替代技术。尽管RLHF效果仍有争议,但仍需更多证据以理解其提升LLM智能的机制及潜在缺陷。

6.3 工具使用与代理

LLM的规划功能允许通过上下文学习调用工具,如API或代理功能(Schick et al., 2023)。Yao等(2022)提出ReAct生成格式,使模型可生成使用工具的思路、接收API观测输入并生成响应。GPT-3.5和GPT-4在少量示例提示下表现稳定且出色。除工具使用外,LLM还可利用外部记忆源如知识库(Hu et al., 2023;Zhong et al., 2023b)或搜索引擎(Nakano et al., 2021;Liu et al., 2023b)生成更准确和信息丰富的答案,这推动了LangChain等框架的流行(LangChain, Inc., 2023)。LLM在工具使用方面的研究也激发了构建具有LLM能力的代理的兴趣,如可调用不同AI模型的代理(Shen et al., 2023;Li et al., 2023a)、具身终身学习或多模态代理(Wang et al., 2023a;Driess et al., 2023),以及多代理交互甚至构建微型社会(Chen et al., 2023b;Li et al., 2023b;Xu et al., 2023d;Hong et al., 2023)。

6.4 编程用LLM

已有研究表明,LLM在代码理解和生成方面具有出色能力,尤其是参数量巨大的模型(Chowdhery et al., 2022;Anil et al., 2023;Rae et al., 2021;Hoffmann et al., 2022)。此外,一些LLM在编码相关数据上进行了预训练、继续预训练或微调,性能显著优于通用LLM。这些模型包括Codex (Chen et al., 2021)、AlphaCode (Li et al., 2022)、SantaCoder (Allal et al., 2023)、Starcoder-Base (Li et al., 2023d)、InCoder (Fried et al., 2022)、CodeT5 (Wang et al., 2021)、CodeGeeX (Zheng et al., 2023)及CODE LLAMA (Roziere et al., 2023)。近期研究还关注针对编码的专用对齐技术,如Code Llama-Instruct (Roziere et al., 2023)和StarCoder (Li et al., 2023d)。这些模型可辅助开发者完成代码生成(Chen et al., 2021;Austin et al., 2021)、代码补全(Zhang et al., 2023a)、代码翻译(Szafraniec et al., 2023)、错误修复(Muennighoff et al., 2023)、代码优化(Liu et al., 2023c)及代码问答(Liu & Wan, 2021)等任务。总之,LLM有潜力通过提供强大的代码理解和生成工具,革新编程领域。

6.5 数学用LLM

具备一定规模的LLM已显示出数学推理能力(Wei et al., 2022b;Suzgun et al., 2022)。为提升LLM在数学相关任务上的表现,研究者采用链式思维提示(Wei et al., 2022c)和草稿纸(scratchpad)技术(Nye et al., 2021),取得良好效果。此外,自洽性(Wang et al., 2022)和least-to-most提示(Zhou et al., 2022)进一步提升了模型在这些任务上的表现。然而,提示工程耗时且需大量试错,LLM仍难以持续高效或获得令人满意的数学问题解决效果。单纯扩大数据和模型规模并非提高数学推理能力的高效方法,而在数学相关语料上进行预训练则能稳定增强这些能力(Hendrycks et al., 2021;Lewkowycz et al., 2022;Taylor et al., 2022;Lightman et al., 2023)。此外,在数学相关指令跟随数据集上微调(Si et al., 2023;Yuan et al., 2023a;Luo et al., 2023a;Yue et al., 2023;Chern et al., 2023a;Yu et al., 2023)同样有效,且成本低于数学专用预训练。尽管准确性有限,LLM在实际数学问题上仍有显著潜力,未来发展空间广阔。

七· 结论

本报告介绍了QWEN系列大型语言模型,展示了自然语言处理的最新进展。该系列模型参数规模为14B、7B和1.8B,已在海量数据(包括数万亿token)上进行预训练,并使用SFT和RLHF等先进技术微调。此外,QWEN系列还包括编码和数学专用模型,如CODE-QWEN、CODE-QWEN-CHAT和MATH-QWEN-CHAT,这些模型在特定领域数据上训练,以在各自领域表现优异。实验结果表明,QWEN系列在综合基准和人工评估中与现有开源模型竞争,并可匹配部分专有模型的性能。

我们认为,QWEN的开放访问将促进社区内的协作与创新,使研究者和开发者在此基础上进一步探索语言模型的潜力。通过向公众提供这些模型,我们希望激发新的研究和应用,推动领域发展,并加深对现实环境中变量和技术的理解。总之,QWEN系列代表了大型语言模型发展的重要里程碑,我们期待其在未来推动进步和创新。

参考文献

1 Qwen1 : https://arxiv.org/pdf/2309.16609