🚀 本文收录于Github:AI-From-Zero 项目 ------ 一个从零开始系统学习 AI 的知识库。如果觉得有帮助,欢迎 ⭐ Star 支持!

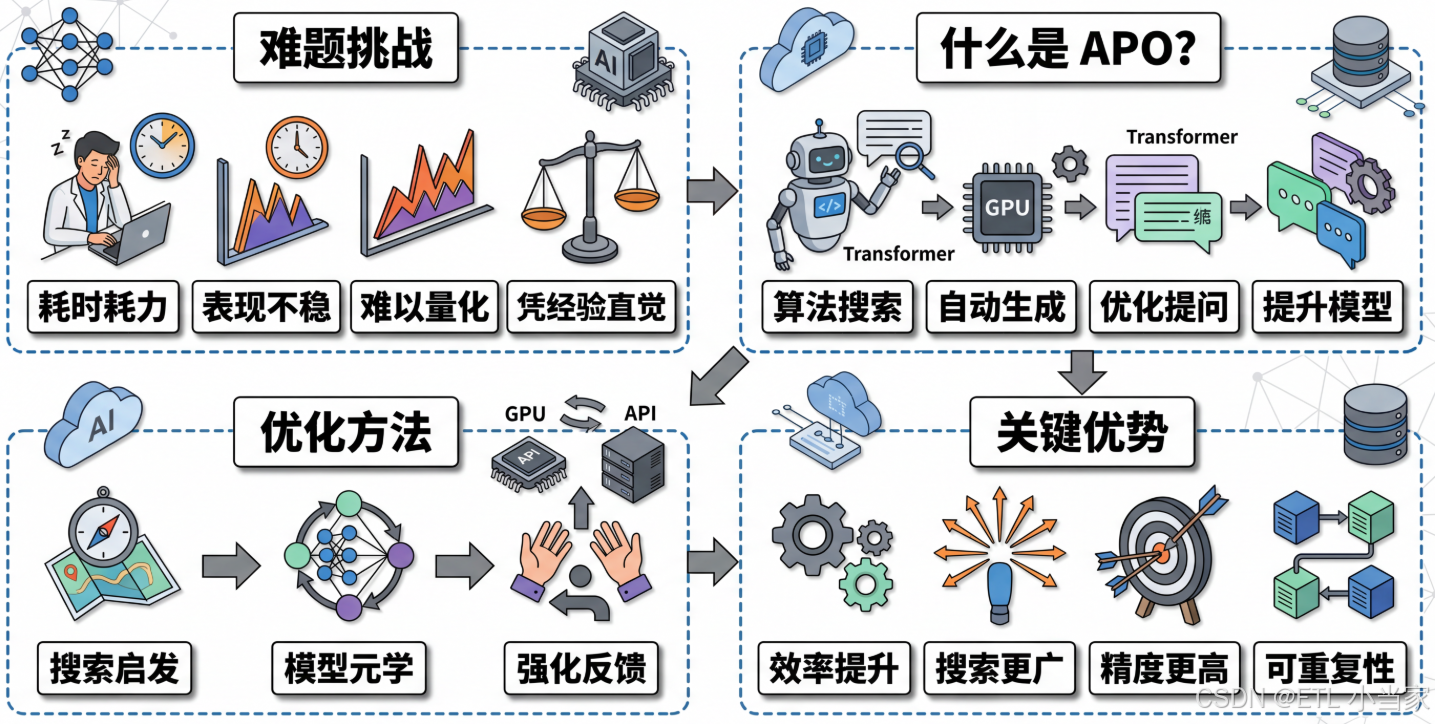

什么是自动Prompt优化?为什么需要算法来寻找最佳提示词?

by @Laizhuocheng

一、简介

想象你是一位厨师,想要找到最完美的蛋糕配方。传统方法是凭经验不断尝试不同的配料比例,这既耗时又可能错过最佳组合。现在假设你有一台智能烤箱,它能够自动测试成千上万种配方组合,通过数据分析快速找到最优解------这正是自动Prompt优化在AI领域的作用。

在实际应用中,Prompt工程面临巨大的挑战。一个看似简单的问题,可能有成千上万种不同的提问方式,每种方式都会导致大语言模型产生不同的回答。比如同样是问"如何减肥",有人会问"有哪些减肥方法?",有人会问"最有效的减重策略是什么?",还有人会问"请给我一个减肥计划表"------这些微小的差异可能会影响回答的质量、准确性和实用性。

自动Prompt优化的价值在于,它将这门依赖经验和直觉的"艺术"转变为可量化、可重复的"科学",让AI系统能够以最优的方式理解和回应人类的需求。

二、什么是自动Prompt优化?

自动Prompt优化(Automatic Prompt Optimization)是一种**使用算法和机器学习技术自动搜索、生成和改进提示词(Prompt)**的方法,旨在找到能够最大化AI模型性能的最佳Prompt表述。它将Prompt工程从依赖人工经验和直觉的"艺术"转变为可量化、可重复的"科学"。

通俗理解:如果把大语言模型比作一个超级聪明但有时会误解指令的助手,那么自动Prompt优化就像是给这个助手配备了一位"提示词翻译官"。这位翻译官会不断尝试不同的表达方式,找出最能让助手准确理解并完美执行任务的指令版本。

三、自动Prompt优化如何工作

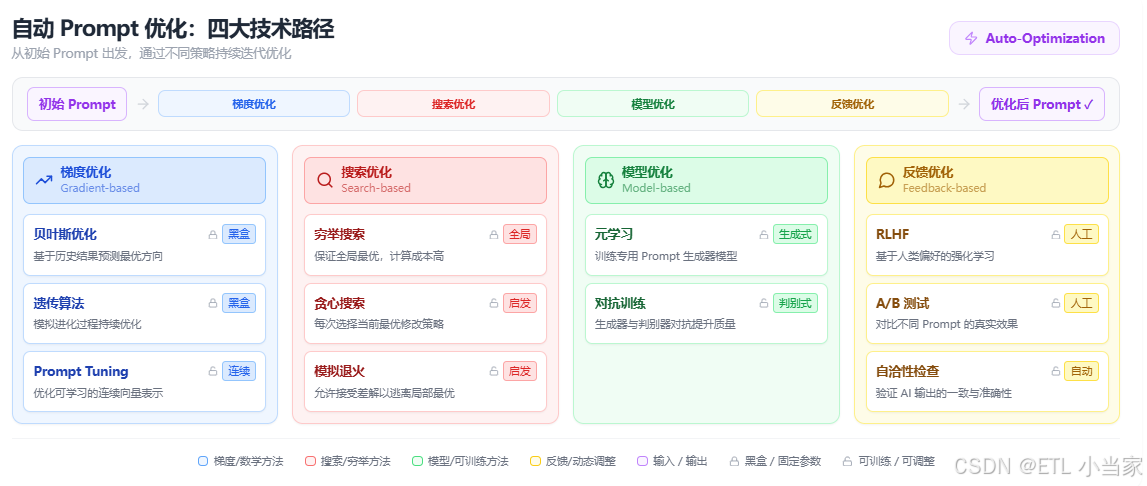

技术方法分类

1. 基于梯度的优化(Gradient-based)

虽然大语言模型本身不可微分,但可以通过以下方式实现:

黑盒优化:

- 贝叶斯优化:基于历史结果预测最有希望的Prompt

- 遗传算法:通过"进化"过程优化Prompt

- 强化学习:将Prompt优化建模为序列决策问题

连续Prompt优化:

- Prompt tuning:优化可学习的连续向量表示

- Prefix tuning:在输入前添加可训练的前缀向量

- LoRA:通过低秩适配器优化Prompt表示

2. 基于搜索的优化(Search-based)

穷举搜索:适用于小规模参数空间,保证找到全局最优解,但计算成本高。

启发式搜索:

- 贪心搜索:每次选择当前最优的修改

- 模拟退火:允许暂时接受较差的解以避免局部最优

- 粒子群优化:模拟群体智能搜索最优解

3. 基于模型的优化(Model-based)

元学习(Meta-learning):训练一个"Prompt生成器"模型,学习从任务描述生成有效Prompt。

对抗训练(Adversarial Training):训练生成器和判别器,生成器生成Prompt,判别器评估效果,通过对抗过程提升Prompt质量。

4. 基于反馈的优化(Feedback-based)

人工反馈:

- RLHF(Reinforcement Learning from Human Feedback):基于人类偏好优化

- A/B测试:比较不同Prompt的实际效果

- 用户行为分析:根据用户交互数据优化Prompt

自动反馈:

- 自洽性检查:验证AI输出的一致性

- 事实核查:验证输出的准确性

- 多样性评估:确保输出的丰富性

四、自动Prompt优化的优缺点

| 优势 | 劣势 |

|---|---|

| 效率提升:自动化搜索过程,从小时/天级缩短到分钟/小时级 | 评估指标设计困难:如何客观定义"好"的Prompt仍是挑战 |

| 搜索范围广:可以测试数千个变体,发现人类难以想到的表述 | 计算成本高:大规模搜索需要大量API调用,实时优化对计算资源要求高 |

| 优化精度高:细粒度调优,每个细节都能优化 | 泛化能力有限:在特定数据集上优化的Prompt可能在其他场景表现不佳 |

| 可复现性强:建立可重复的优化流程,版本控制和回溯能力 | 可解释性差:自动生成的Prompt可能难以理解,调试困难 |

| 标准化:量化评估指标,建立工程实践 | 隐私和安全风险:优化过程可能泄露敏感信息,恶意Prompt可能被自动发现 |

五、自动Prompt优化的实际应用与发展趋势

实际应用场景

1. 企业级AI应用

- 客服系统:自动优化意图识别和回复生成的Prompt,提升用户满意度

- 内容生成:找到最适合品牌语调的写作Prompt,保持内容一致性

- 数据分析:优化数据查询和报告生成的Prompt,提高数据洞察准确性

2. 研究和开发

- 基准测试:为学术研究找到最优Prompt配置,确保实验公平性

- 模型比较:公平比较不同模型在相同Prompt下的表现

- 新任务探索:快速为新任务找到有效的Prompt策略,降低研发门槛

3. 个性化服务

- 用户偏好适配:根据用户反馈自动调整Prompt,提供个性化体验

- 上下文感知:根据对话历史动态优化Prompt,保持对话连贯性

- 多语言优化:为不同语言找到最佳Prompt表述,提升跨语言效果

4. 安全和合规

- 偏见检测:自动发现和修复有偏见的Prompt,促进公平性

- 安全约束:确保Prompt不会引发有害行为,降低安全风险

- 合规检查:验证Prompt符合行业规范,满足监管要求

当前局限性

技术挑战:

- 评估指标设计复杂,不同任务需要不同的评估标准

- 主观质量难以量化,需要结合多种评估方法

- 泛化能力有限,模型更新可能导致优化结果失效

实践挑战:

- 计算资源需求高,成本效益需要平衡

- 隐私保护要求严格,优化过程需要脱敏处理

- 人机协作难度大,如何平衡自动化和人工控制是关键

发展与演进

优化方向:

- 自适应优化:系统能够根据任务特点自动选择最佳优化策略

- 多目标优化:同时优化准确性、速度、成本等多个指标

- 持续学习:模型能够从用户反馈中持续改进,实现动态优化

未来展望:

- 智能Prompt生成器:AI能够自动生成高质量的Prompt,甚至理解任务本质

- Prompt即服务(Prompt-as-a-Service):专门的Prompt优化平台将成为标准配置

- 人机协作优化:算法负责大规模搜索,人类专家负责设定目标和最终决策

- 跨模态Prompt优化:从纯文本扩展到图像、音频等多模态场景

六、总结与思考

自动Prompt优化代表了AI工程化的必然趋势。随着大语言模型在各行各业的深入应用,手工调优Prompt已经无法满足规模化、标准化的需求。自动优化不仅提高了效率和性能,更重要的是建立了可重复、可验证的工程实践。

然而,完全的自动化并不是目标。最佳的Prompt优化策略应该是人机协作的:算法负责大规模搜索和精细调优,人类专家负责设定目标、提供领域知识和最终决策。这种协作模式既能发挥算法的计算优势,又能保持人类的判断力和创造力。

总结:自动Prompt优化通过算法和机器学习技术,将依赖经验和直觉的Prompt工程转变为可量化、可重复的科学实践。它能够显著提升效率、扩展搜索范围、提高优化精度,并建立标准化的工程流程。

思考:真正的智能不仅在于如何找到最优解,更在于理解何时需要寻找最优解,以及最优解背后的价值取向。Prompt优化的终极目标不是让机器变得完美,而是让人机协作变得更加自然和高效。在这个过程中,我们需要平衡自动化效率与人类价值观,让技术真正服务于人的需求,而不是反过来被技术所束缚。