本文将详细介绍在

Windows 11系统中通过WSL2架构搭建高效深度学习开发环境的完整流程。将基于Ubuntu子系统,整合Anaconda环境管理工具和PyCharm专业开发环境,特别针对GPU支持进行重点配置,实现从环境准备到模型训练的全流程指导。无论您是偏好Windows操作但需要Linux开发环境的程序员,还是希望在同一设备上兼顾办公与实验的研究人员,本方案都能为您提供一条可靠且高效的实践路径。

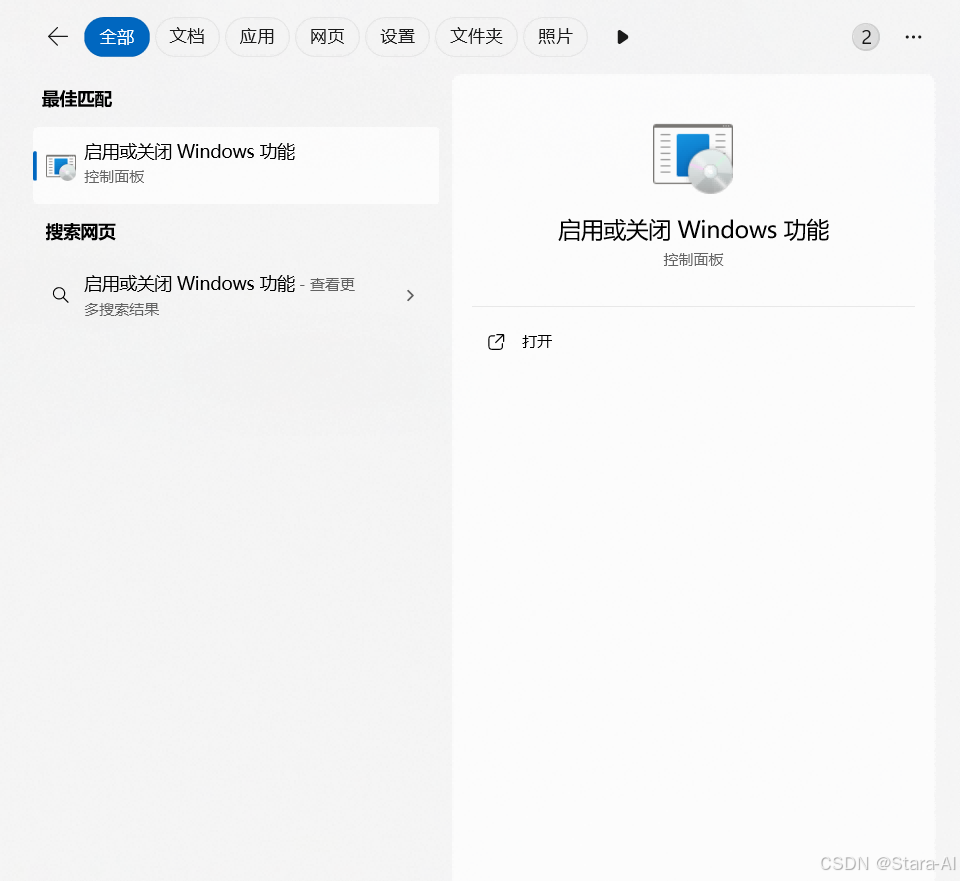

1. 启用必要功能

- 在 Windows 搜索栏输入 "启用或关闭 Windows 功能"

- 勾选两项: 适用于 Linux 的 Windows 子系统 , 虚拟机平台

- 重启电脑

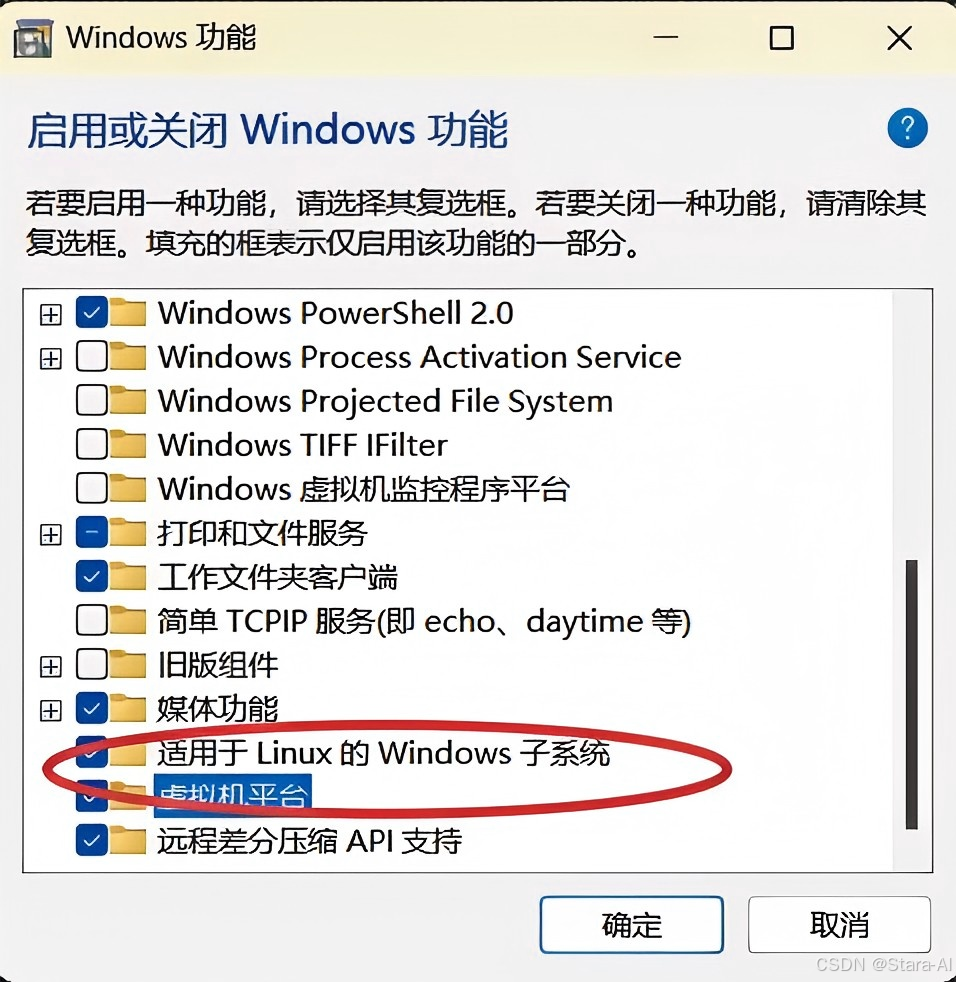

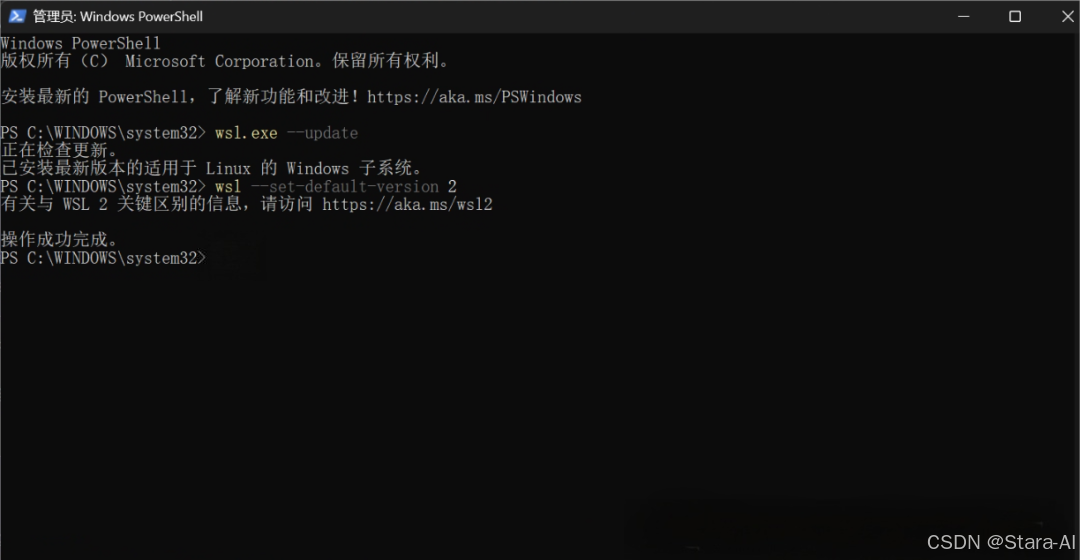

2. PowerShell 启用 WSL

以 管理员 身份打开

PowerShell,依次执行:

powershell

dism.exe /online /enable-feature /featurename:Microsoft-Windows-Subsystem-Linux /all /norestart这条命令是为你的Windows系统安装了"可以运行Linux程序"的兼容层。没有它,你根本无法在Windows里运行Ubuntu等发行版。

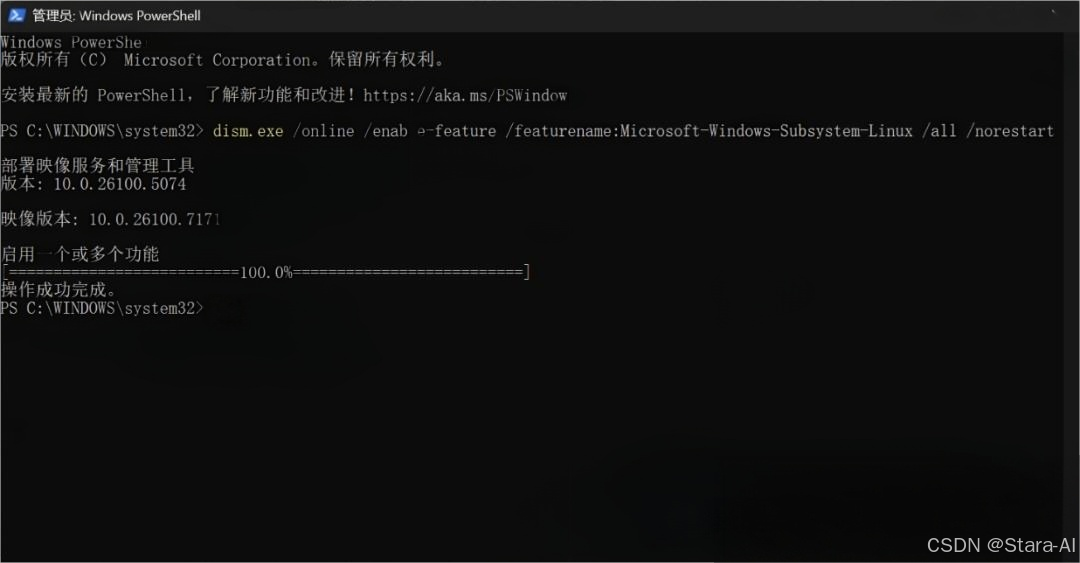

powershell

dism.exe /online /enable-feature /featurename:VirtualMachinePlatform /all /norestart这条命令是开启WSL 2(第二代)支持的关键。WSL 1 和 WSL 2 的核心区别在于架构,WSL 2 基于一个轻量级的虚拟机,因此需要启用系统的虚拟化功能。这带来了完整的Linux内核兼容性和巨大的I/O性能提升。

| 命令 | 功能 | 目的 |

|---|---|---|

| 命令一 | 启用 WSL | 让Windows能理解和运行Linux环境。 |

| 命令二 | 启用 虚拟机平台 | 让WSL能以更先进的WSL 2模式运行,获得最佳性能。 |

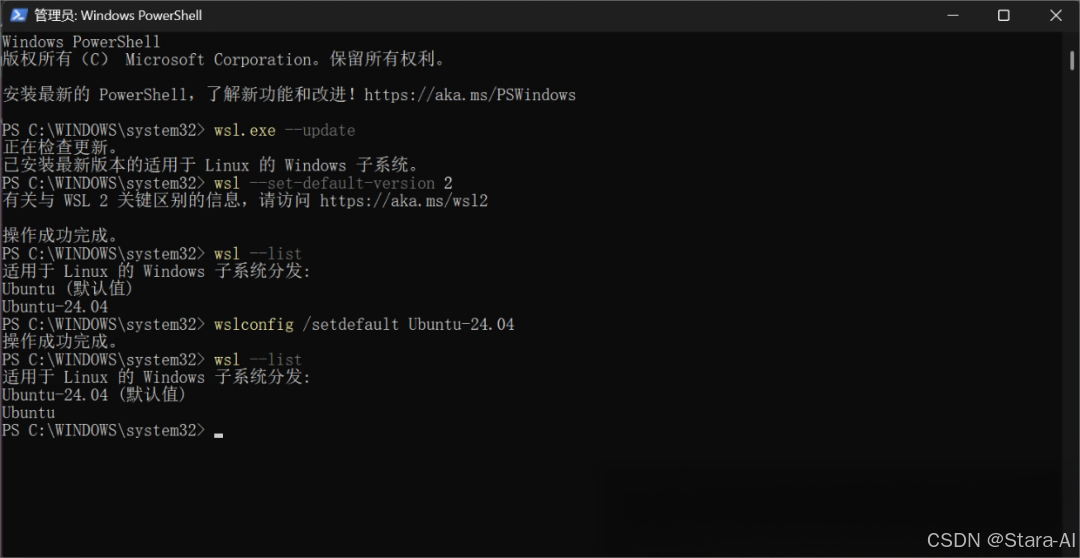

重启计算机,将WSL 2设置为默认版本 (这样以后安装的Linux发行版都会用性能更好的WSL 2),依次执行命令:

powershell

# 一键安装WSL的默认Linux发行版(通常是Ubuntu)。

# 此命令会自动启用所需的Windows功能、下载最新Linux内核、并安装默认发行版。

# 注意:执行后通常需要重启计算机。

wsl.exe --install

# 检查并更新WSL的Linux内核版本。

# 在WSL安装完成后,建议运行此命令以确保内核为最新版本,从而获得更好的性能和安全性。

wsl.exe --update

# 将WSL的默认版本设置为第2代。

# WSL 2相比WSL 1具有完整的Linux内核兼容性和更高的文件系统性能。

# 重要:执行此命令后,新安装的Linux发行版将默认使用WSL 2。

wsl --set-default-version 2

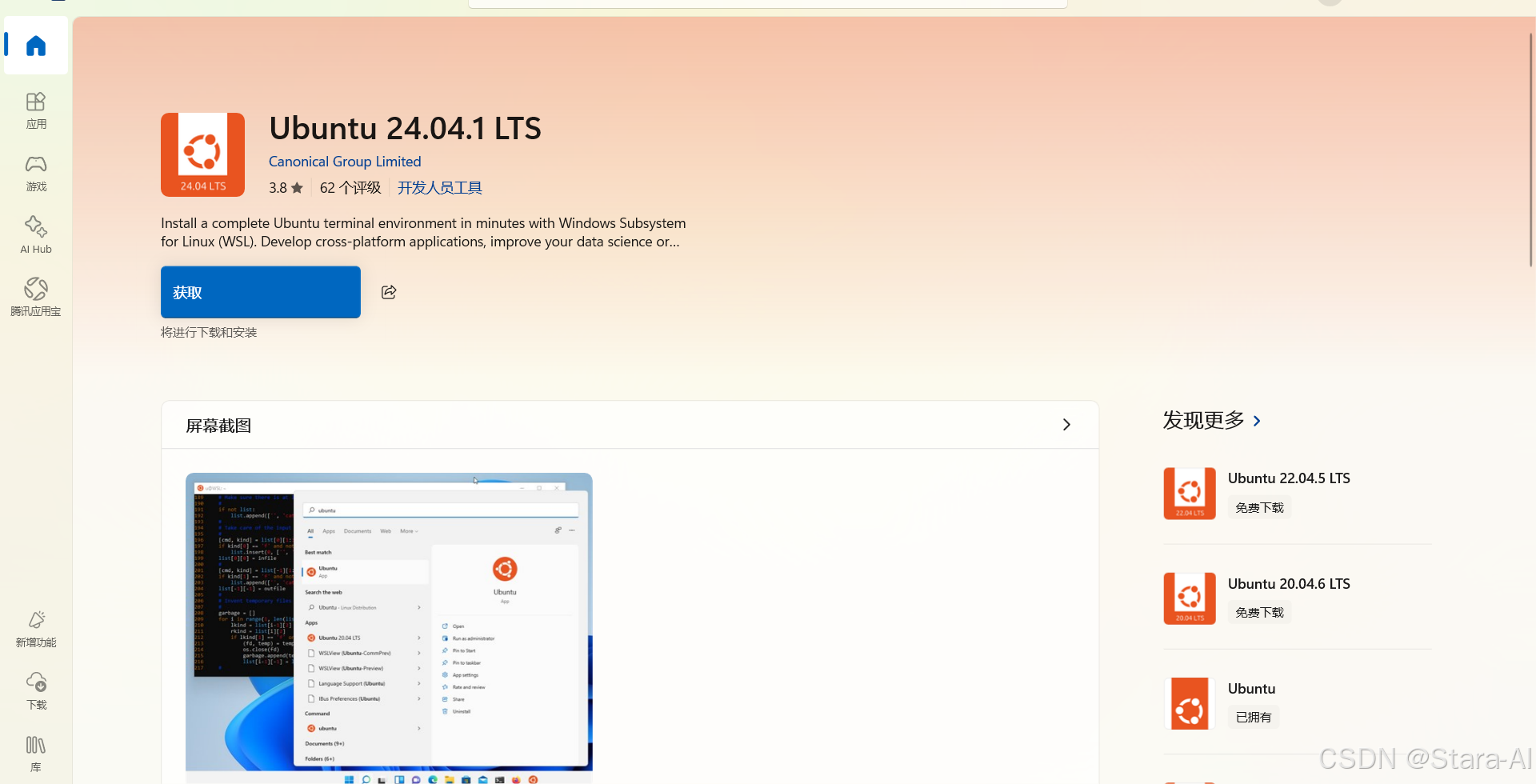

3. 安装 Ubuntu 24.04

打开

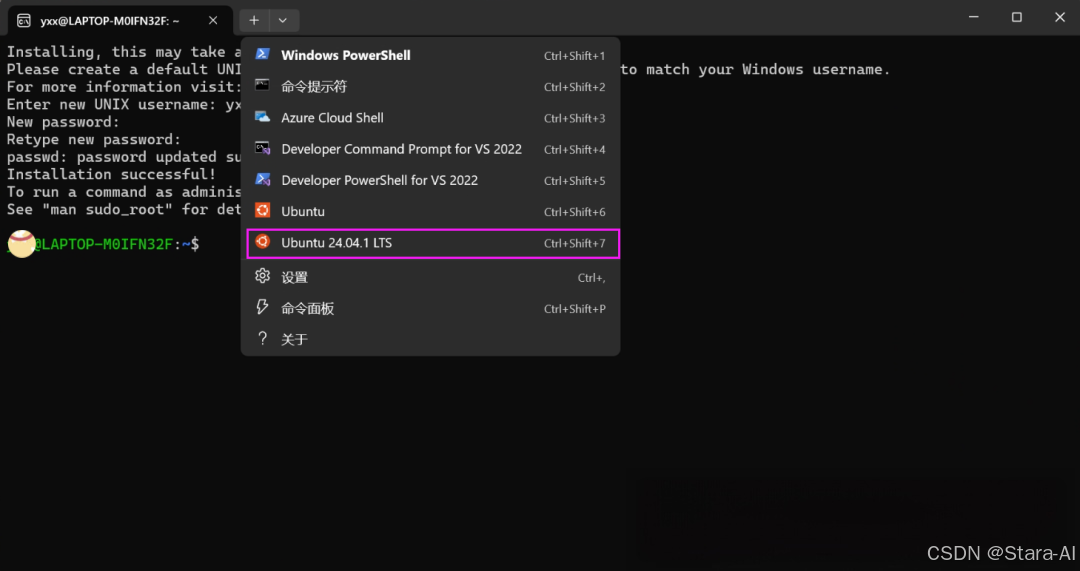

Microsoft Store,搜索Ubuntu 24.04.1 LTS并安装。

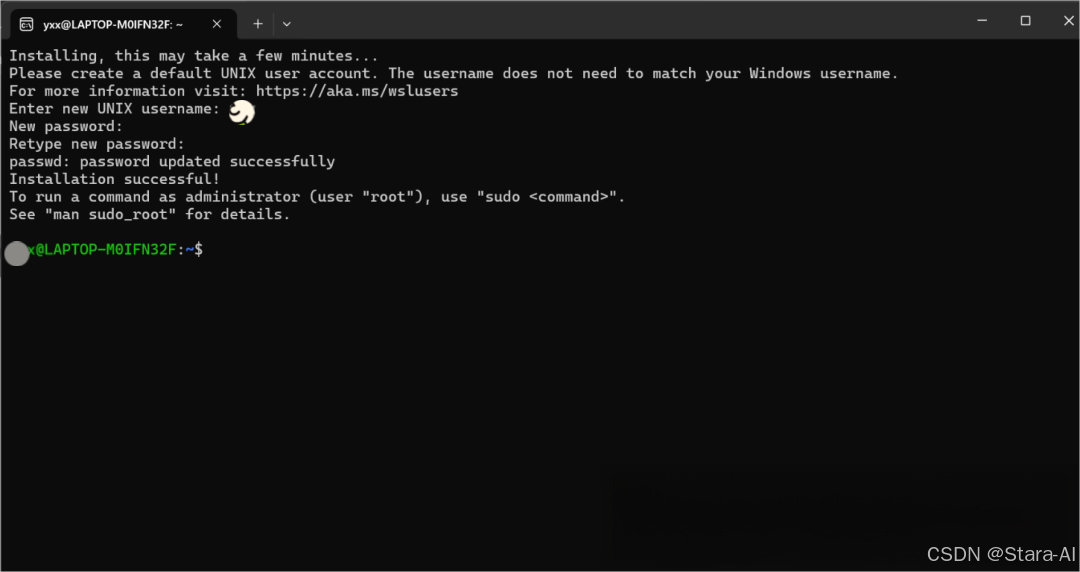

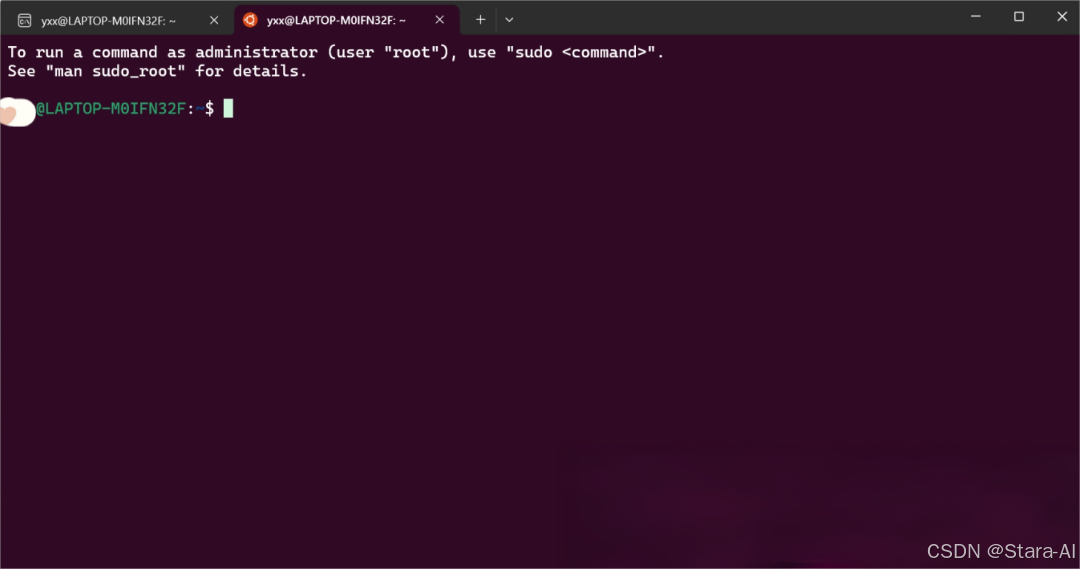

首次启动时会提示你创建 用户名 和 密码(密码输入时不显示,正常输入回车即可)。

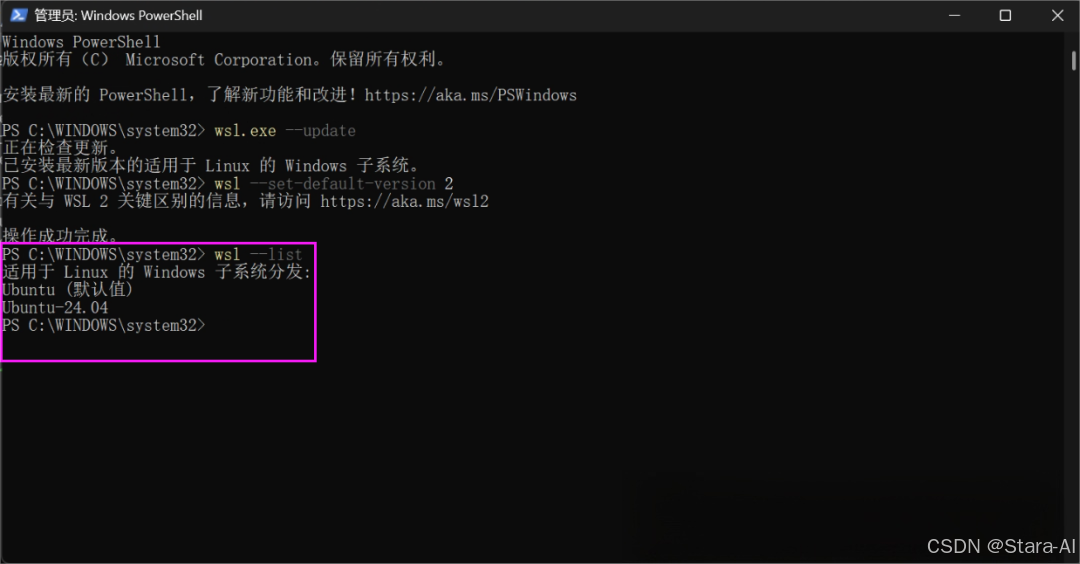

Windows PowerShell查看是否安装成功。

推荐设置为默认发行版(可选):

powershell

wslconfig /setdefault Ubuntu-24.04

您可以在终端窗口的下拉菜单中查看已安装的系统。

点击即可进入安装系统

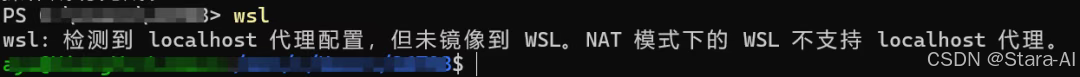

如果遇到: wsl : 检测到 localhost 代理配置,但未镜像到 WSL...

解决方案:

- Win 键搜索 "WSL Settings"

- 进入 网络 设置页

- 将 网络模式 从 NAT 改为 Mirrored

- 重启

WSL:

要解决上述问题,只需在

Windows PowerShell中执行以下操作:重启WSL服务,然后重新启动Ubuntu系统即可。

powershell

wsl --shutdown4. 安装 CUDA Toolkit 与 cuDNN

WSL2可直接调用 Windows 系统的NVIDIA驱动,仅需安装CUDA Toolkit和cuDNN即可实现 GPU 加速功能。

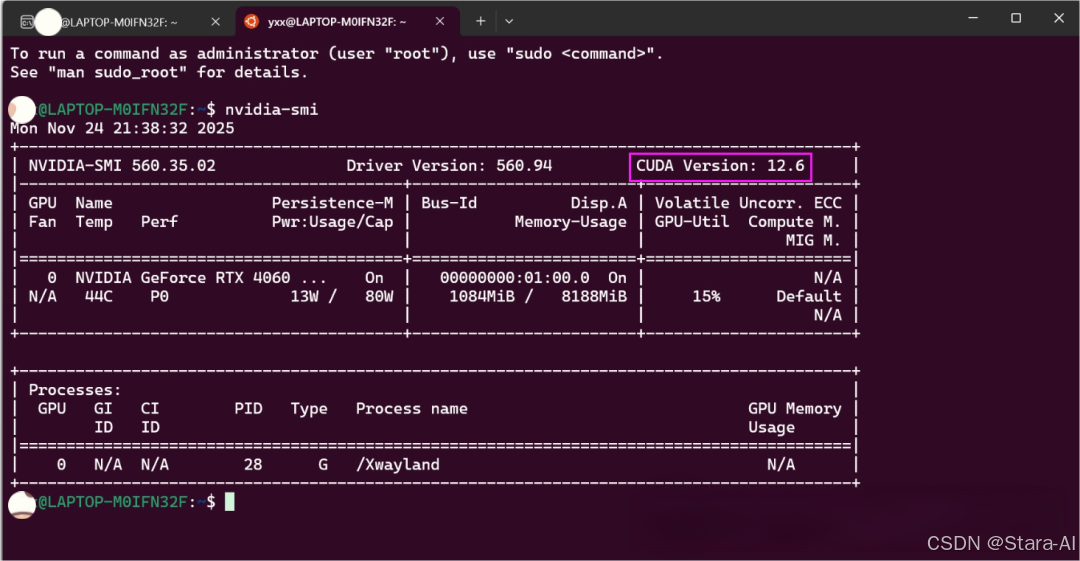

powershell

nvidia-smi

请注意 :顶部显示的 CUDA Version 仅表示驱动程序支持的最高版本,而非实际安装的版本。

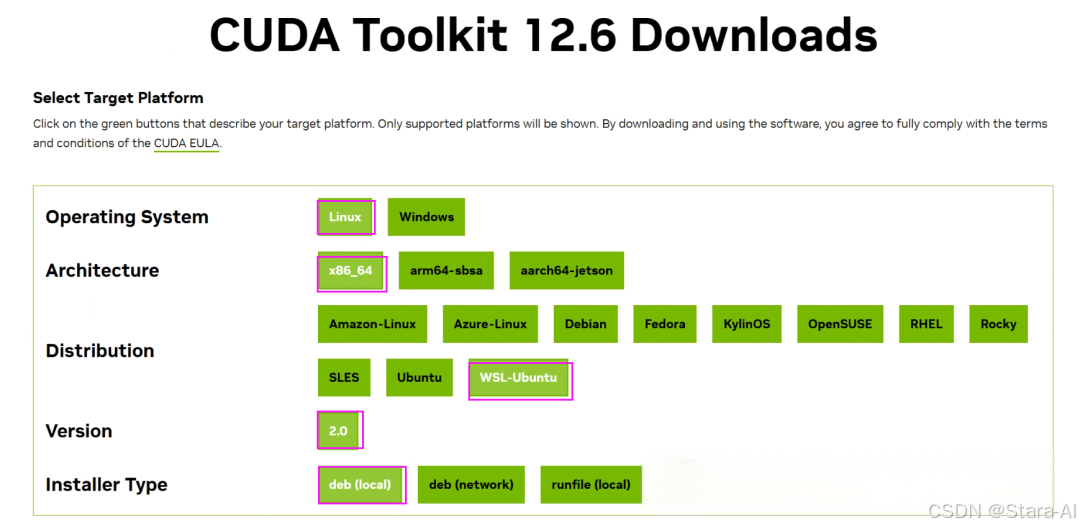

安装适用于

WSL的CUDA Toolkit 12.6, 直接去官网下载所需版本:https://developer.nvidia.com/cuda-toolkit-archive

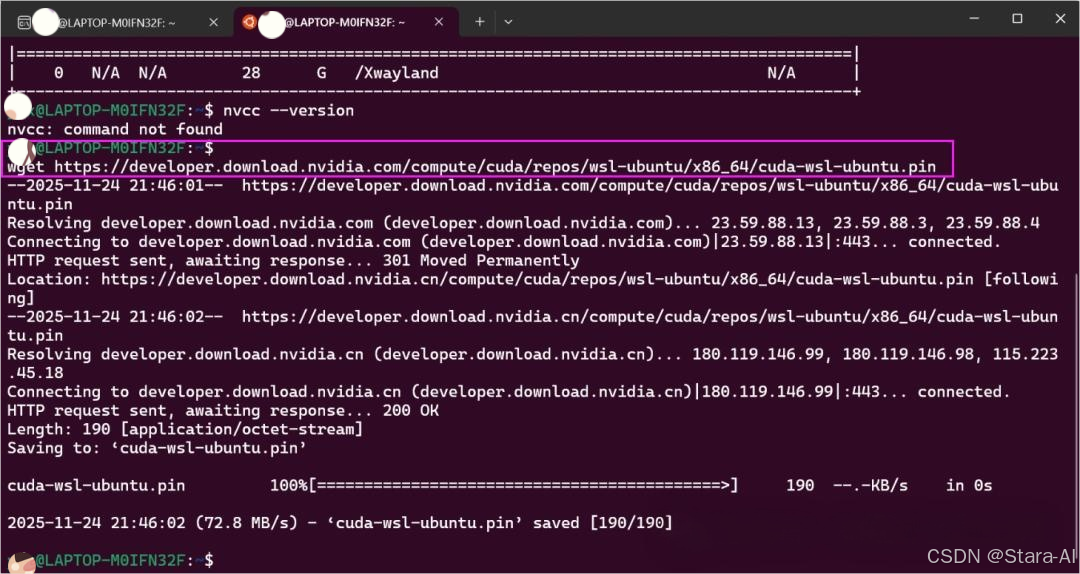

powershell

wget https://developer.download.nvidia.com/compute/cuda/repos/wsl-ubuntu/x86_64/cuda-wsl-ubuntu.pin

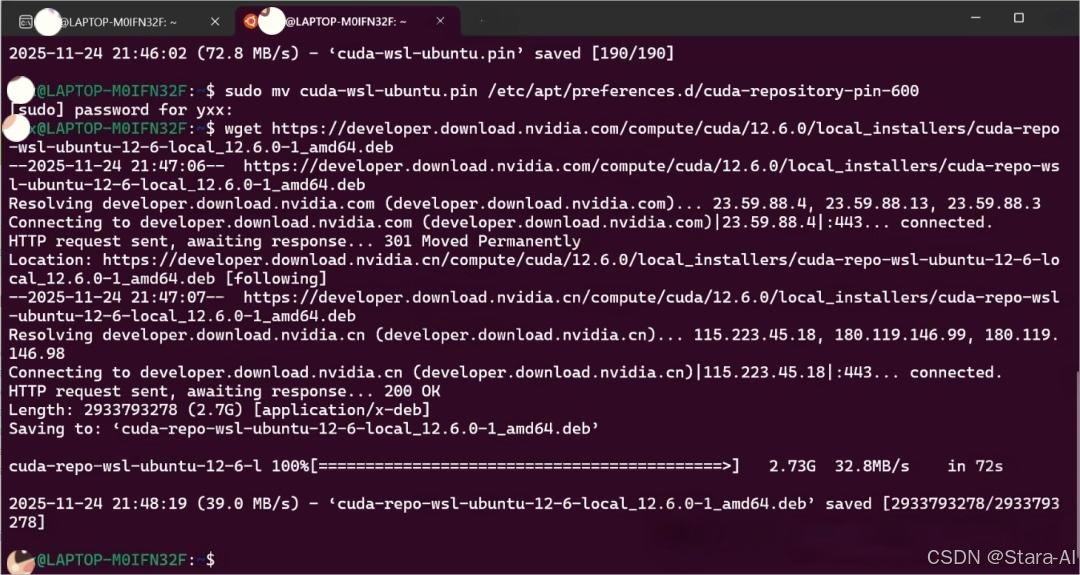

powershell

sudo mv cuda-wsl-ubuntu.pin /etc/apt/preferences.d/cuda-repository-pin-600输入密码后按回车:

powershell

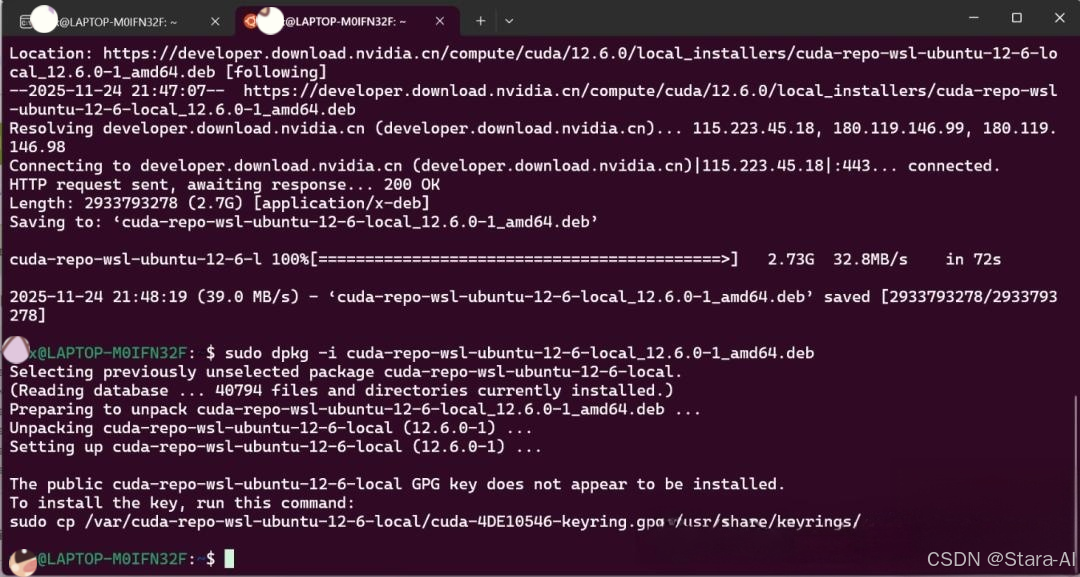

wget https://developer.download.nvidia.com/compute/cuda/12.6.0/local_installers/cuda-repo-wsl-ubuntu-12-6-local_12.6.0-1_amd64.deb

powershell

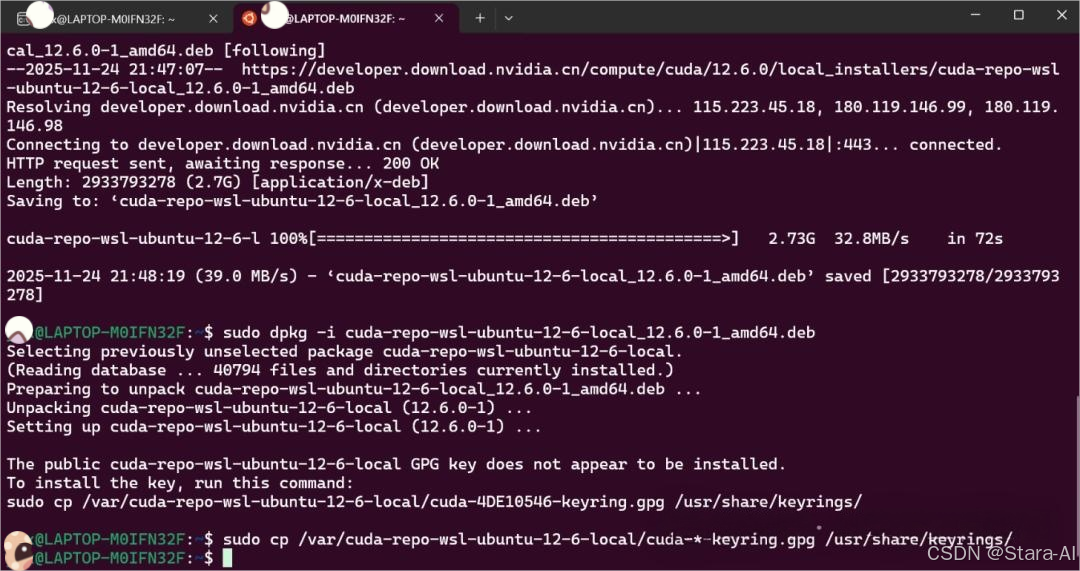

sudo dpkg -i cuda-repo-wsl-ubuntu-12-6-local_12.6.0-1_amd64.deb

powershell

sudo cp /var/cuda-repo-wsl-ubuntu-12-6-local/cuda-*-keyring.gpg /usr/share/keyrings/

powershell

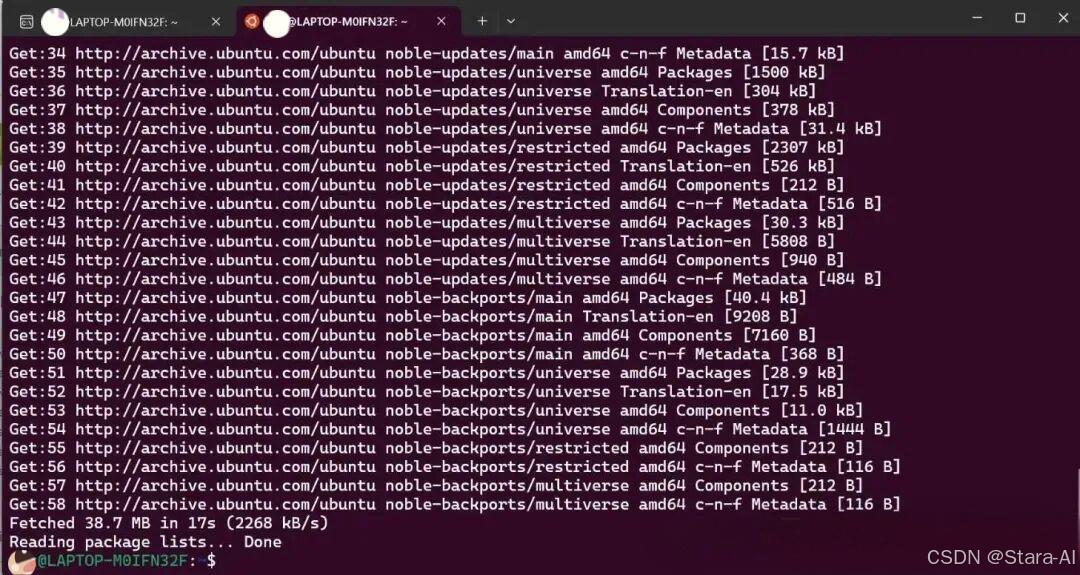

sudo apt-get update

powershell

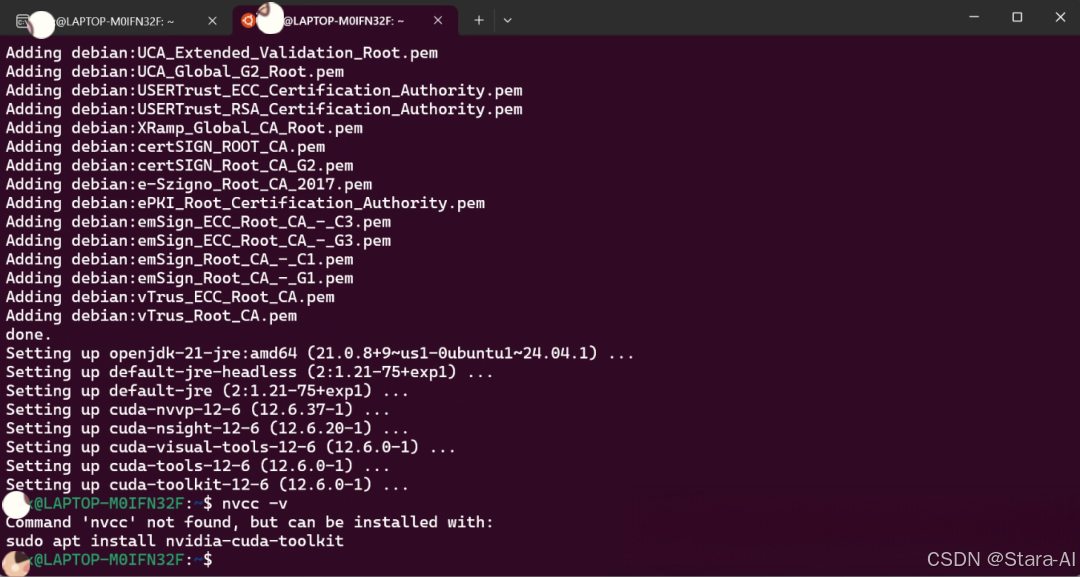

sudo apt-get -y install cuda-toolkit-12-6

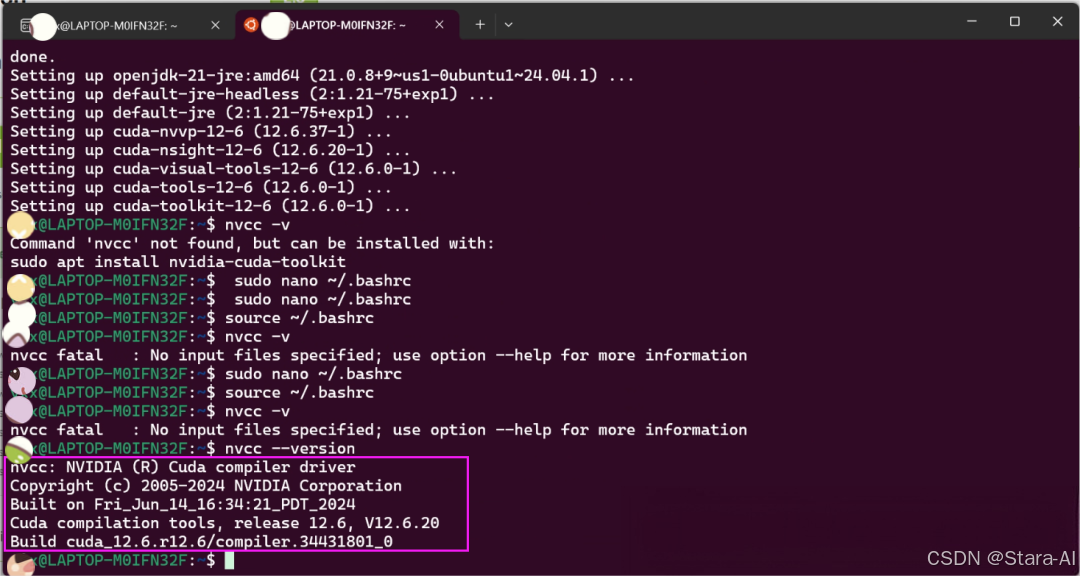

安装完成后运行

nvcc -v命令时若提示找不到可执行文件,并非cuda toolkit安装问题,而是由于尚未配置环境变量所致。

4.1 配置环境变量

powershell

sudo nano ~/.bashrc按住键盘向下箭头,将光标移至文件末尾。随后,在文件最后添加以下内容(注意修改版本号,如本例中的12.6)。

python

export PATH=/usr/local/cuda-12.6/bin${PATH:+:${PATH}}

export LD_LIBRARY_PATH=/usr/local/cuda-12.6/lib64${LD_LIBRARY_PATH:+:${LD_LIBRARY_PATH}}按 Ctrl+X 保存并退出,然后更新环境变量:

powershell

source ~/.bashrc要检查安装是否成功,只需在终端输入

nvcc --version命令。

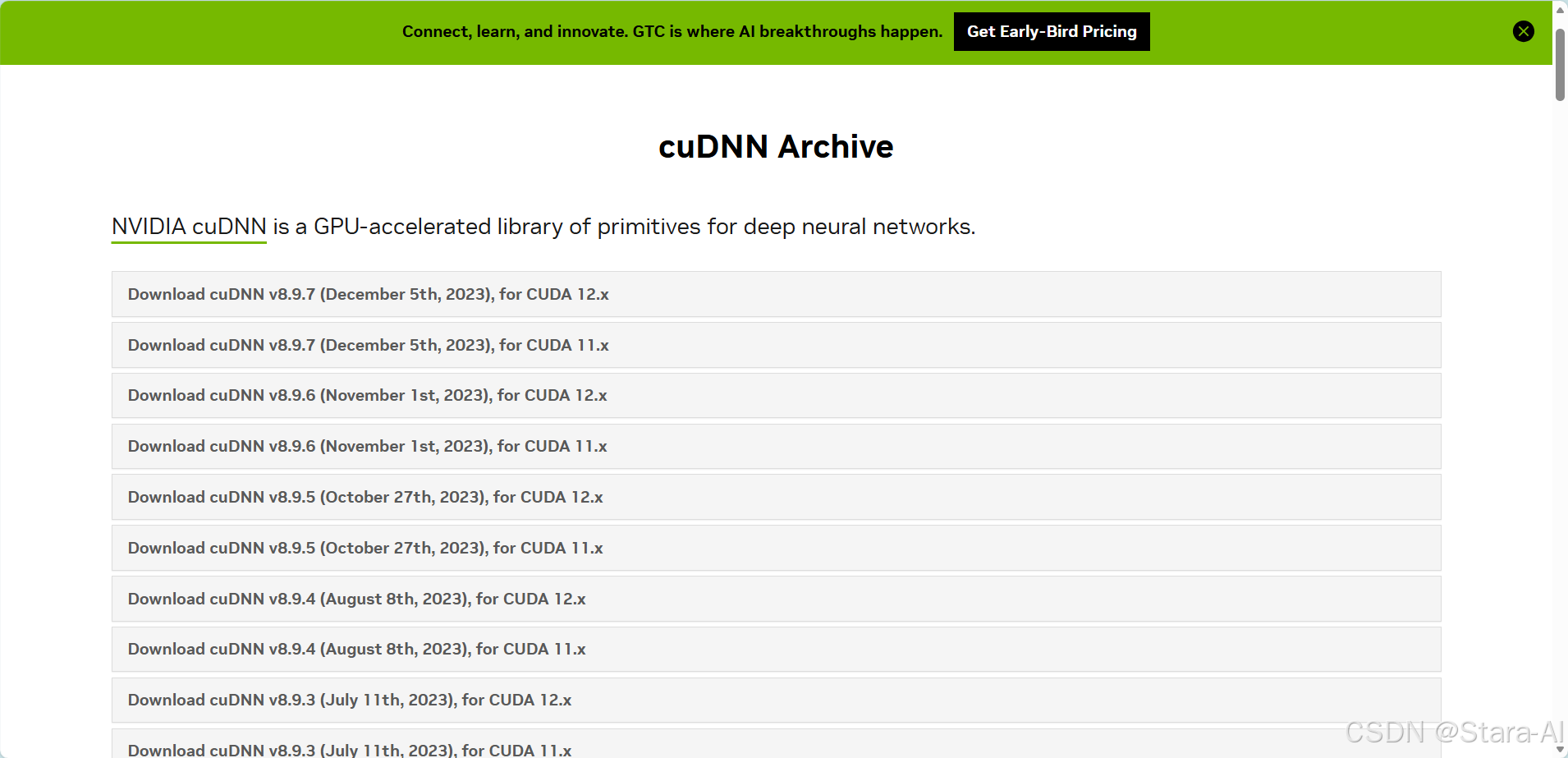

4.2 安装 cuDNN (兼容 CUDA 12.x)

cuDNN Archive:https://developer.nvidia.com/rdp/cudnn-archive

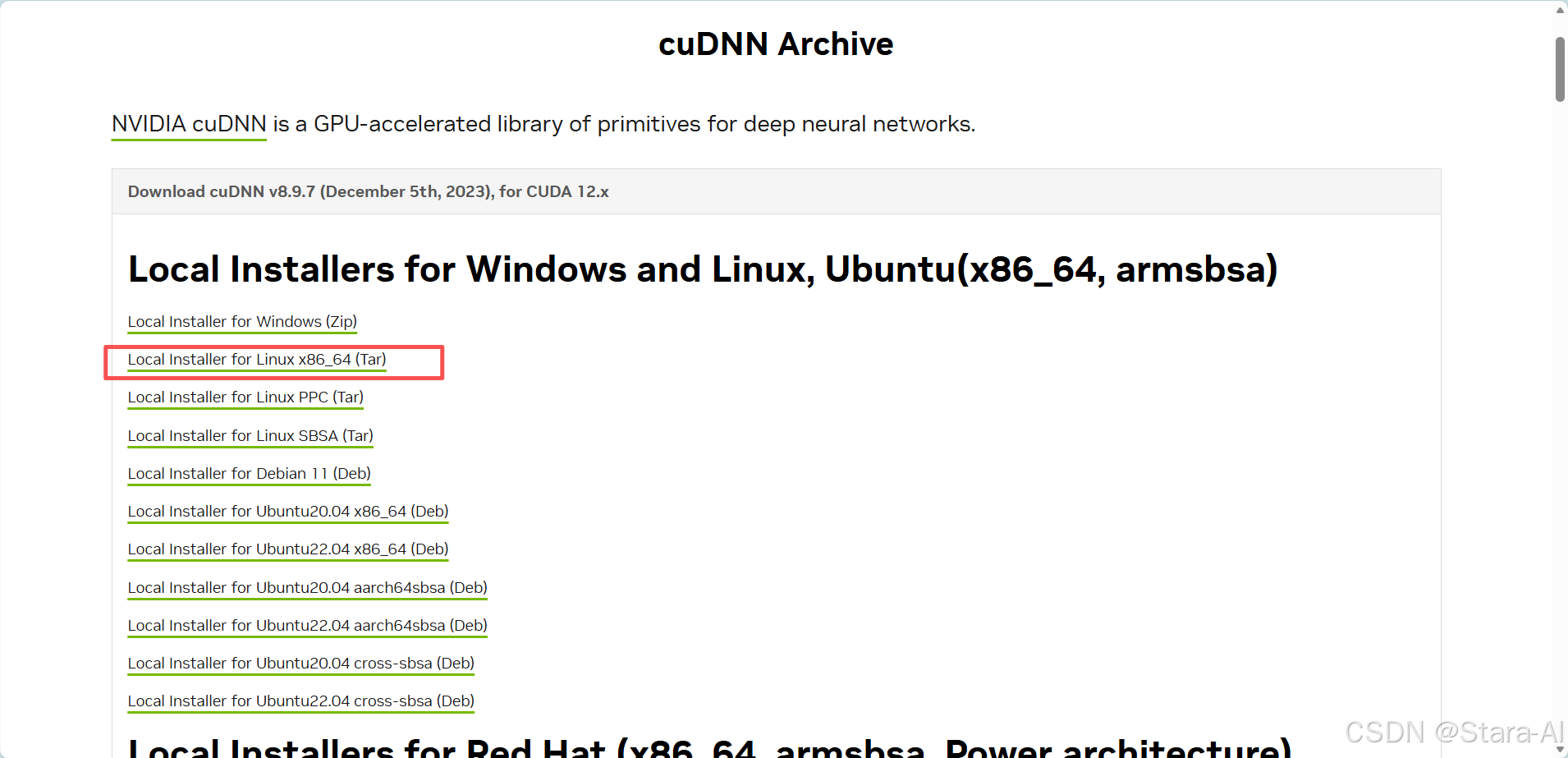

获取适用于

CUDA 12.x的cuDNN v8.9.7(需注册NVIDIA账号):请访问

NVIDIA cuDNN官方资源库下载

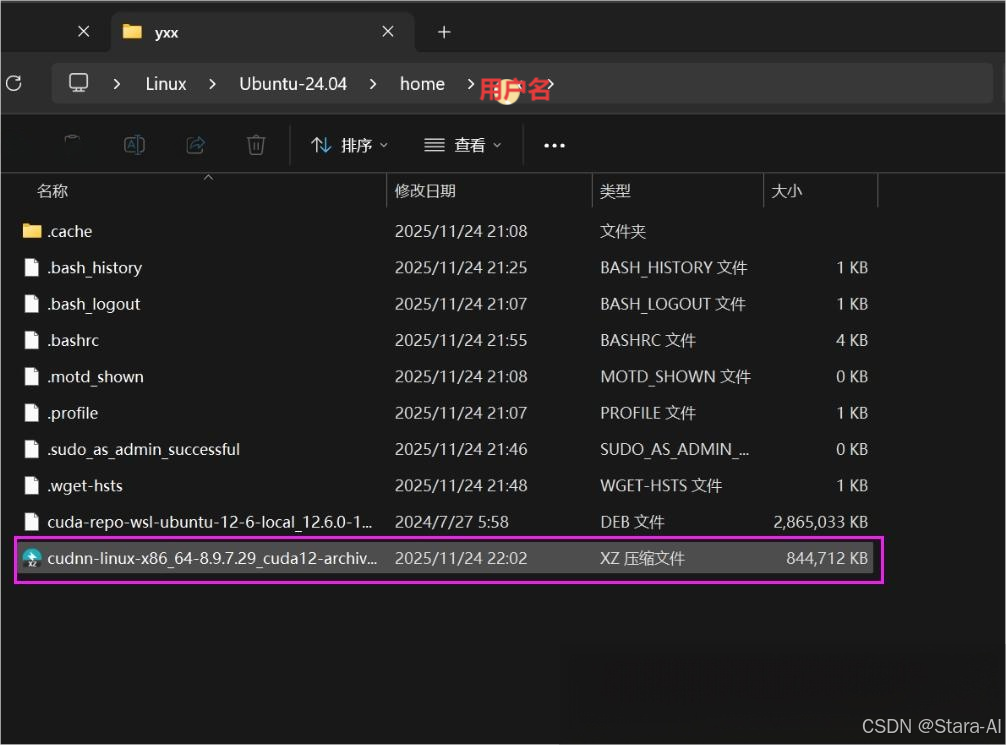

将下载好的

.tar.xz文件拷贝至WSL系统的home目录下

powershell

\\wsl.localhost\Ubuntu-24.04\home\用户名

解压并安装:

powershell

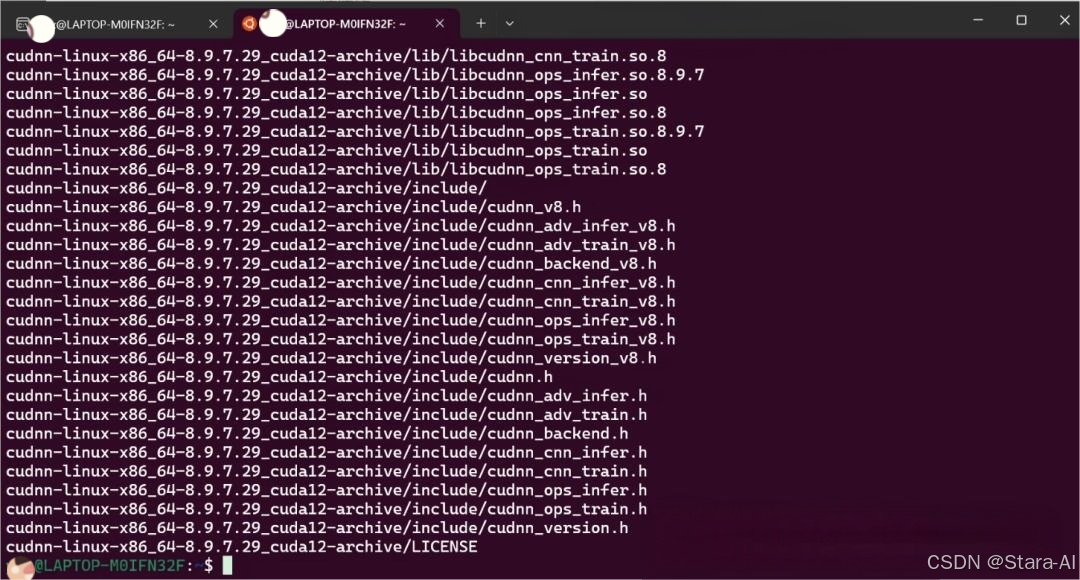

sudo tar -xvf cudnn-linux-x86_64-8.9.7.29_cuda12-archive

将解压后的文件分别复制到对应的目录中(注意:以下命令中的 /lib/ 和 /include/ 路径均指向解压后 cudnn-linux-x86_64-8.9.7.29_cuda12-archive 文件夹内的相应目录):

首先,进入解压后的

cudnn-linux-x86_64-8.9.7.29_cuda12-archive文件夹

powershell

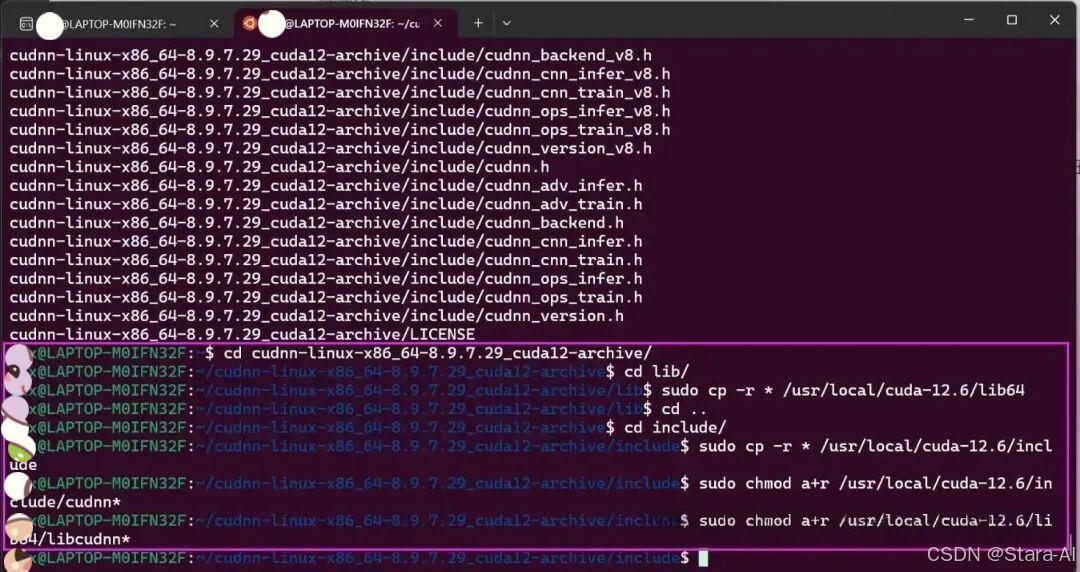

cd cudnn-linux-x86_64-8.9.7.29_cuda12-archive/进入

lib文件夹

powershell

cd lib/将文件全部复制到目标文件夹

powershell

sudo cp -r * /usr/local/cuda-12.6/lib64退出

lib文件夹

powershell

cd ..进入

include文件夹

powershell

cd include/将所有文件复制到目标文件夹

powershell

sudo cp -r * /usr/local/cuda-12.6/include调整读取权限:

powershell

sudo chmod a+r /usr/local/cuda-12.6/include/cudnn*

sudo chmod a+r /usr/local/cuda-12.6/lib64/libcudnn*

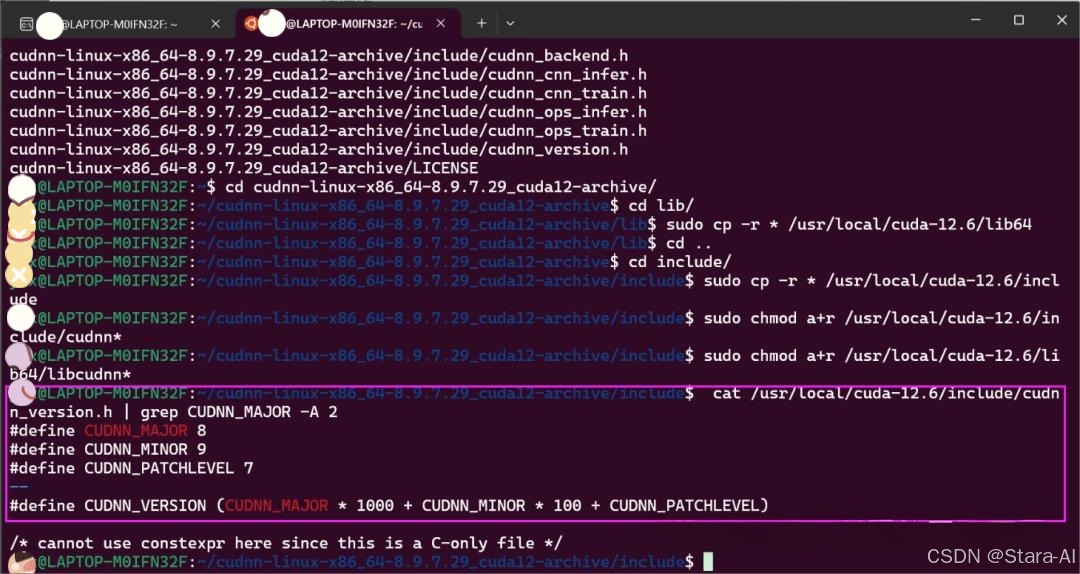

安装验证:

powershell

cat /usr/local/cuda-12.6/include/cudnn_version.h | grep CUDNN_MAJOR -A 2

5. 搭建深度学习环境Anaconda + PyTorch

5.1 安装 Anaconda

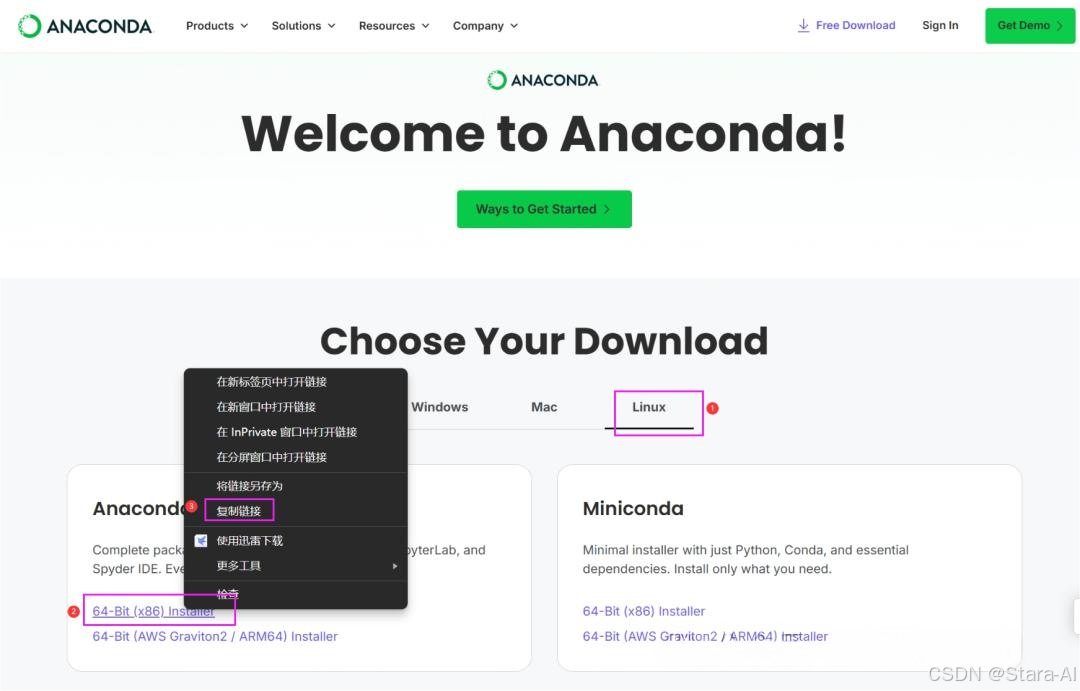

进入

Anaconda官网Free Download | Anaconda,如没有注册过,需要注册一下才能看到下载链接。

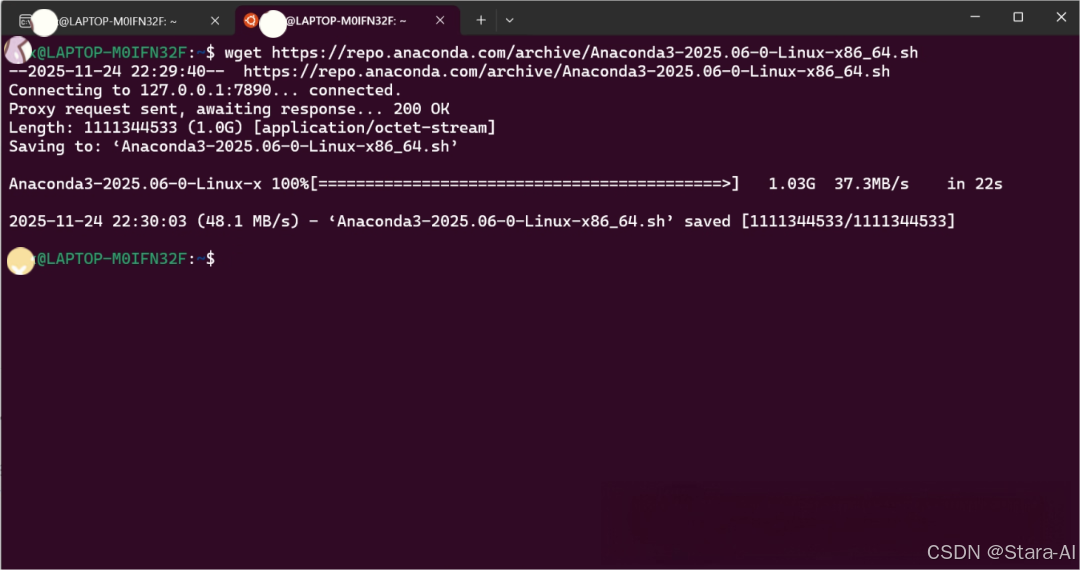

powershell

wget https://repo.anaconda.com/archive/Anaconda3-2025.06-0-Linux-x86_64.sh

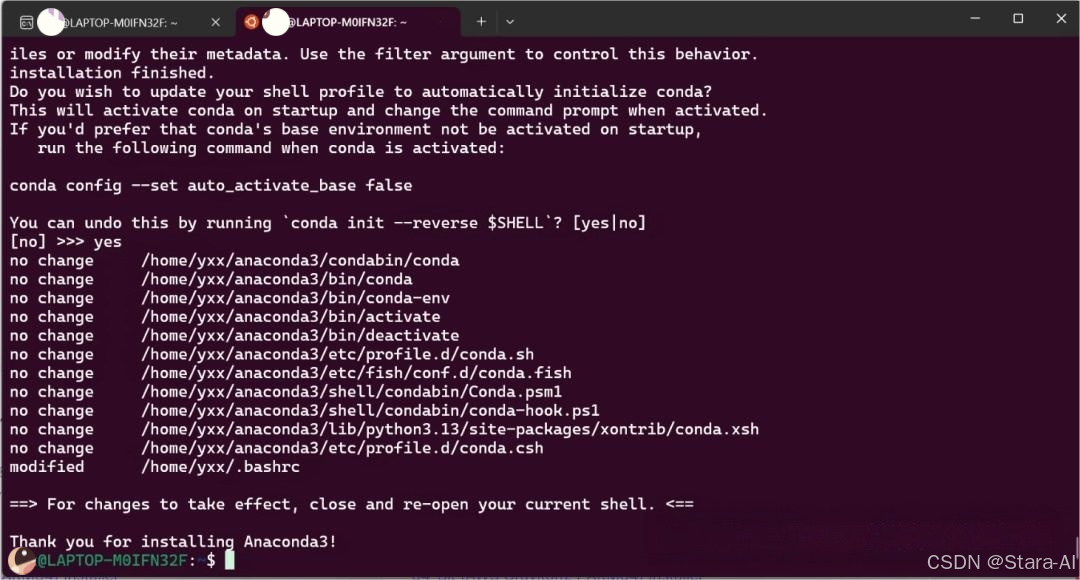

执行

sh Anaconda3-2025.06-0-Linux-x86_64.sh命令后,只需按提示操作:按Enter键继续,并在需要时输入

yes确认即可完成安装。

请注意:安装完成后需重启终端,方可继续后续操作。

创建并激活虚拟环境

powershell

conda create --name cu126py310 python=3.10

powershell

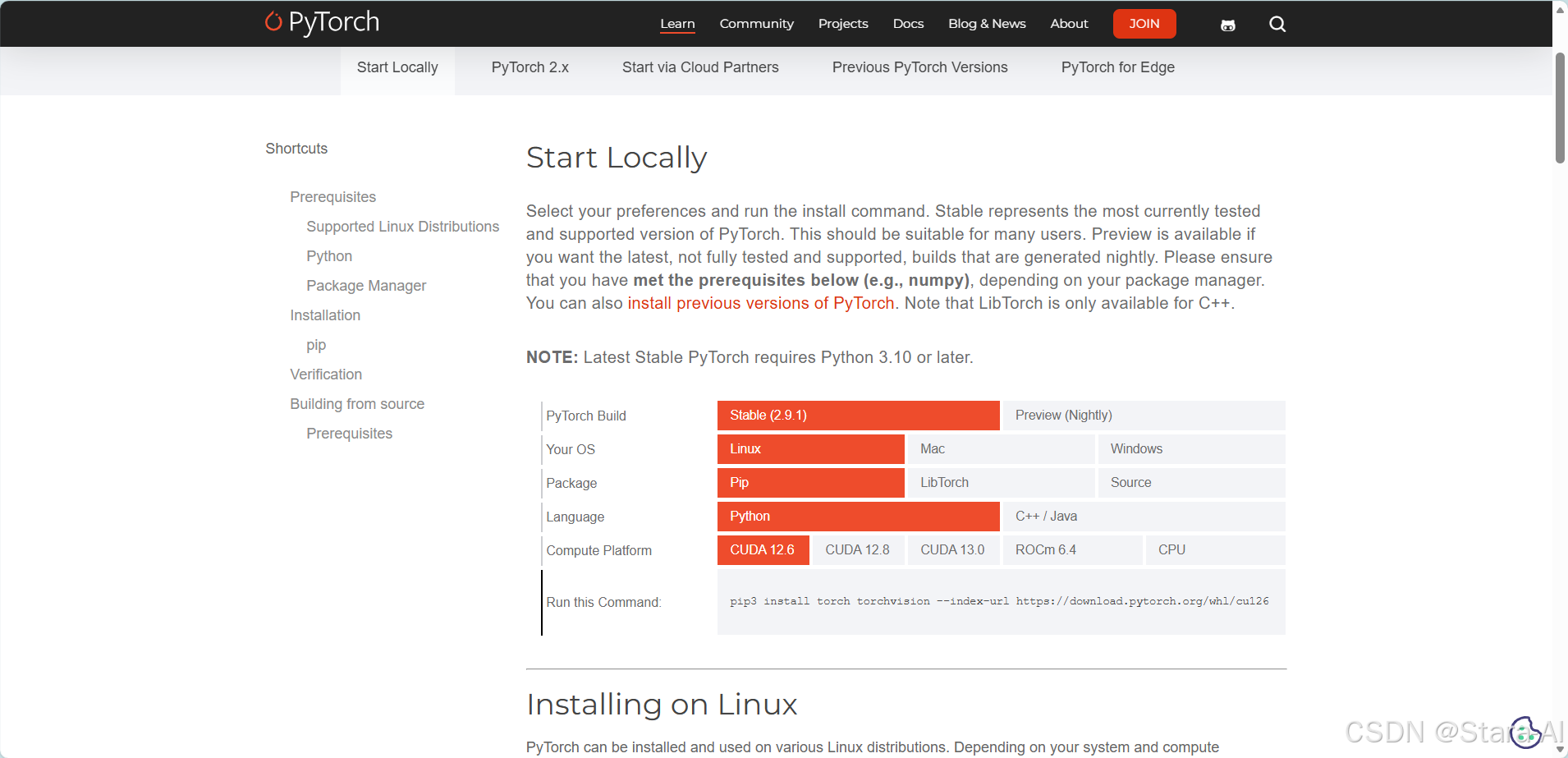

conda activate cu126py3105.2 安装 PyTorch(CUDA 12.6 版本)

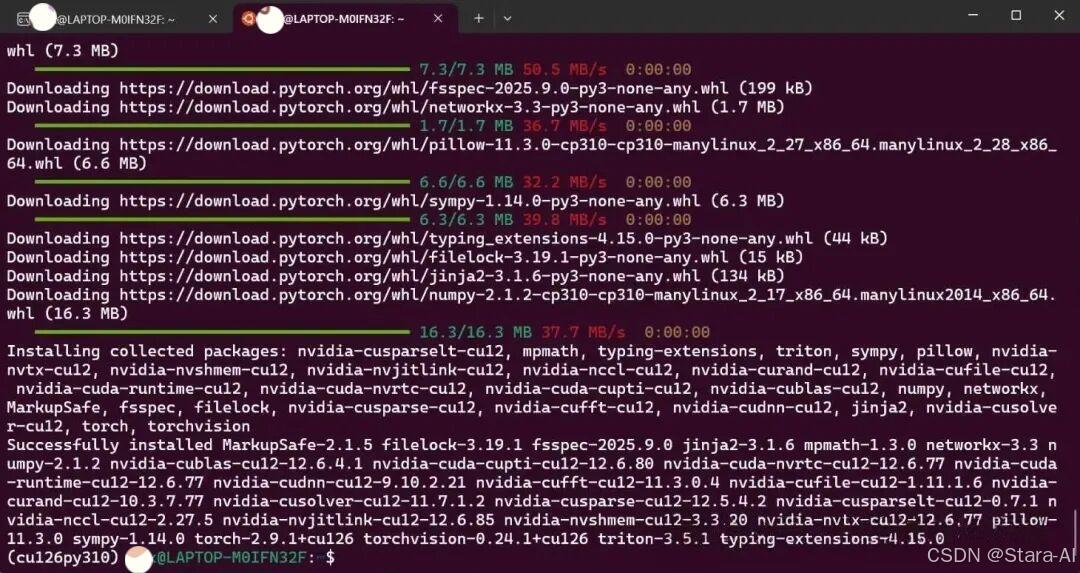

python

pip3 install torch torchvision --index-url https://download.pytorch.org/whl/cu126

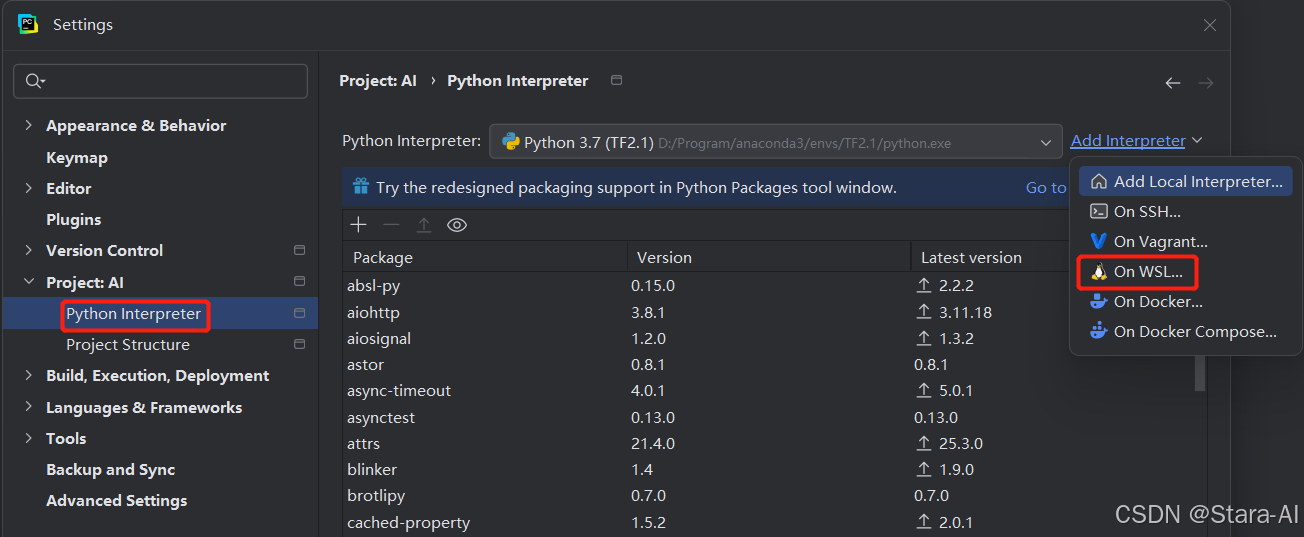

5.3 PyCharm 远程连接 WSL2 环境

在PyCharm 的设置中选择项目里的Python 解释器选项,点击添加解释器,选择

WSL

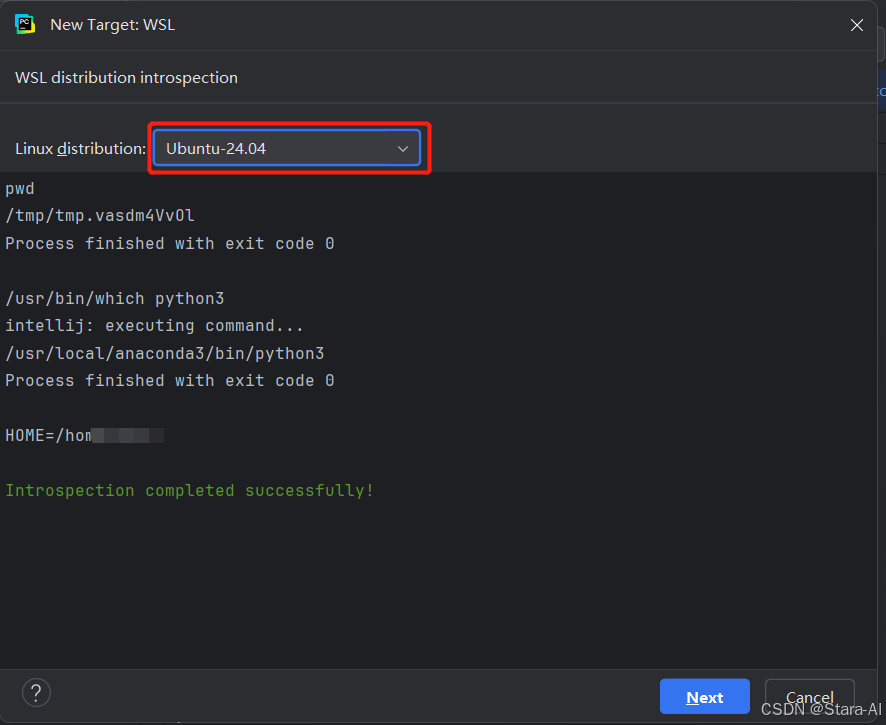

选择环境所在的

Linux系统,点击下一步

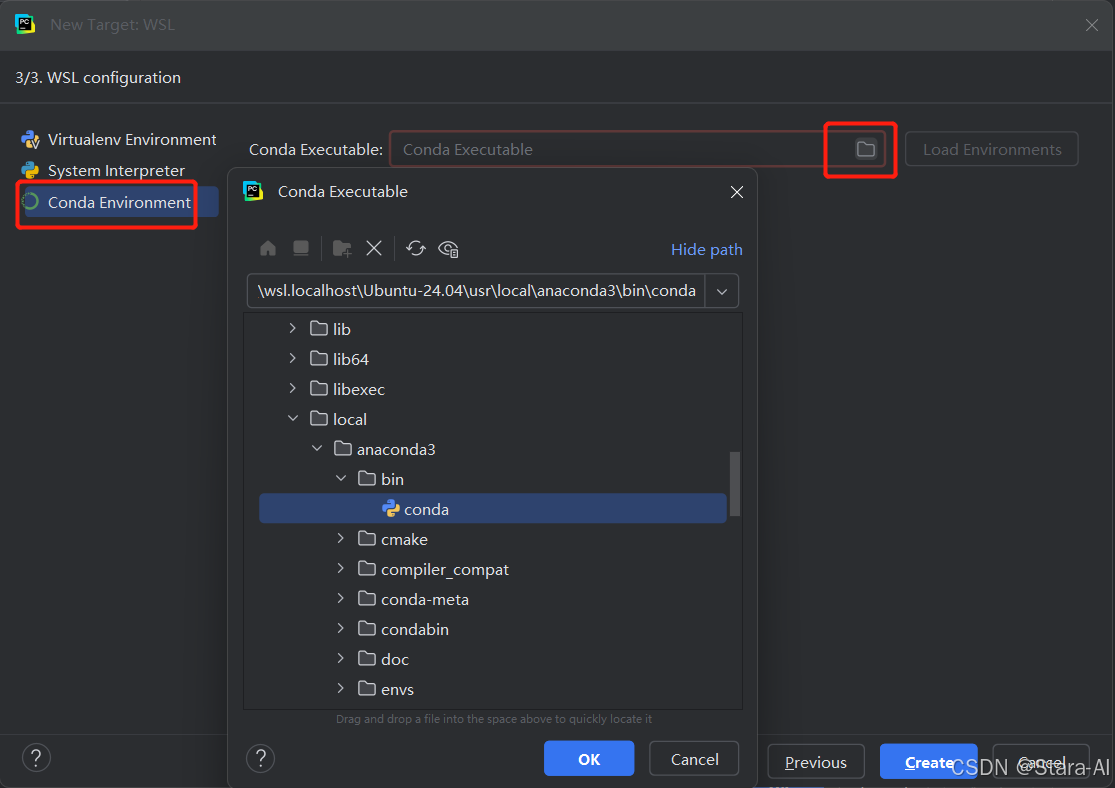

在左边选项栏中选择

conda环境,需要选择conda解释器,一般存在conda目录下的bin文件夹下

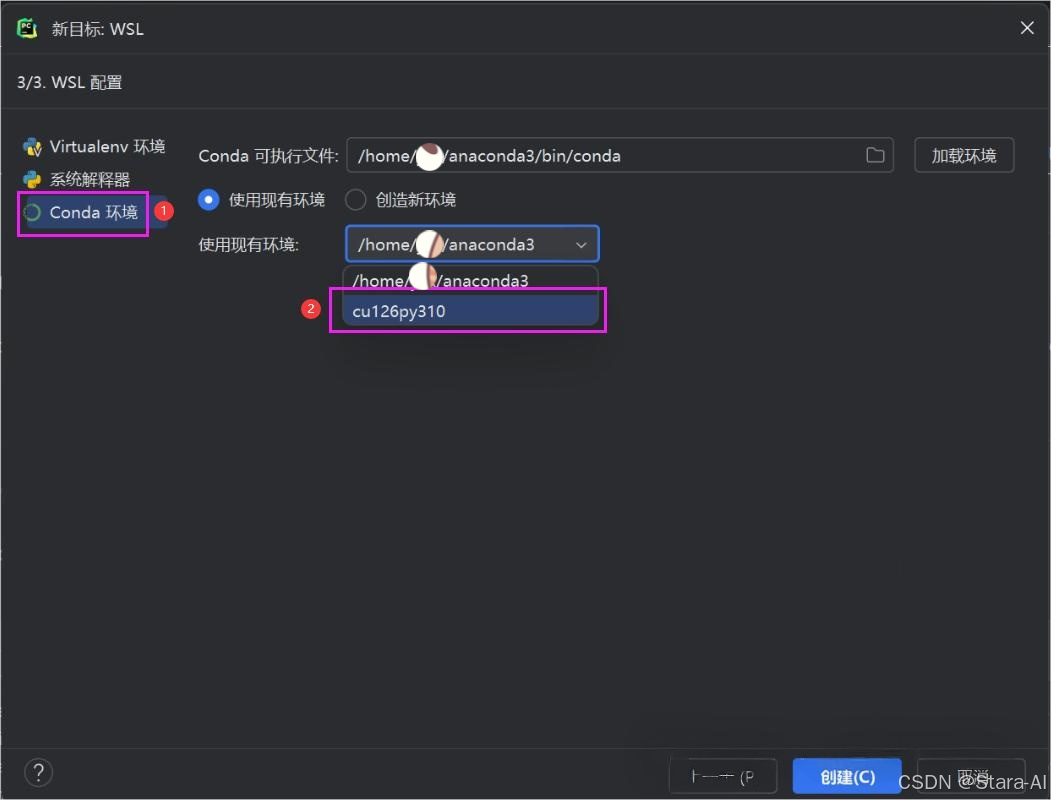

选定

conda解释器后,点击加载环境,选择对应环境,点击创建即可成功连接到wsl中的conda环境了

新建Python文件,运行代码验证 GPU 是否可用

python

import torch

import torchvision

print('PyTorch version: ', torch.__version__)

print('TorchVision version: ', torchvision.__version__)

print("CUDA available:", torch.cuda.is_available())

print("CUDA version:", torch.version.cuda)

if torch.cuda.is_available():

print("GPU device:", torch.cuda.get_device_name(0))

python

# 输出

PyTorch version: 2.9.1+cu126

TorchVision version: 0.24.1+cu126

CUDA available: True

2.9.1+cu126

CUDA available: True

CUDA version: 12.6

GPU device: NVIDIA GeForce RTX 4060 Laptop GPU6. 总结

通过本文的逐步配置,我们已在 Windows 11 上成功基于 WSL 2 搭建起完整的深度学习开发环境。该环境集成了 Ubuntu 子系统、CUDA 加速、Anaconda 虚拟环境及 PyCharm 开发工具,实现了在 Windows 系统中无缝使用 Linux 生态并调用 GPU 进行模型训练的目标。

本方案兼顾了 Windows 的易用性 与 Linux 的开发效率,为深度学习开发者提供了一条高效、稳定且易于维护的实践路径,解决了双系统切换、虚拟机性能损耗等传统痛点,让开发更专注、实验更顺畅。