文章目录

- [01 Grand Challenge 上数据集的下载](#01 Grand Challenge 上数据集的下载)

- [02 zenodo上数据集的下载](#02 zenodo上数据集的下载)

- [03 hugging face 上数据集的下载](#03 hugging face 上数据集的下载)

-

- (1)直接在网页上下载

- [(2)通过 huggingface_hub 库下载](#(2)通过 huggingface_hub 库下载)

- [(3)使用 Git LFS](#(3)使用 Git LFS)

- [(4) hugging face 上数据集的下载 常见问题与解决方案](#(4) hugging face 上数据集的下载 常见问题与解决方案)

-

-

- [问题 :网络连接错误 (ConnectionError / ReadTimeout)](#问题 :网络连接错误 (ConnectionError / ReadTimeout))

-

01 Grand Challenge 上数据集的下载

之前写过一个Grand Challenge 上数据集的下载的帖子,不再赘述:https://blog.csdn.net/verse_armour/article/details/153273551?spm=1001.2014.3001.5501

02 zenodo上数据集的下载

(1)直接在网页上下载

操作比较简单,但是一般来说比较慢,网络不好的时候容易下载中断,又要重新下载。

(2)使用zenodo_get

github地址:https://github.com/dvolgyes/zenodo_get

- 安装:直接在虚拟环境中pip安装即可:

pip install zenodo-get -i https://pypi.tuna.tsinghua.edu.cn/simple - 使用:

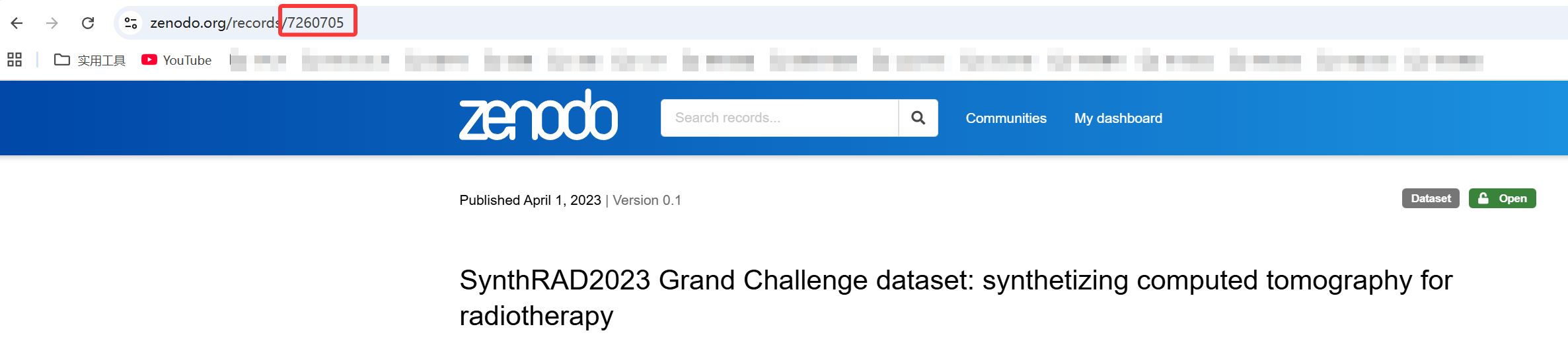

zenodo_get RECORD_ID_OR_DOI - note:这里的RECORD_ID_OR_DOI是zenodo网页url末尾的数字,比如这个数据集就是

7260705

但是我用下来这个工具在下载的时候也容易中断,十几个G的数据集只能下载几百兆,下不完全。

(3)使用wget

直接wget -c https://zenodo.org/api/records/8003760/files/Task2_val.zip/content -O Task2_val.zip

- -c 参数表示 断点续传(Continue),如果连接断开,重新运行该命令会从断开的地方继续,而不会重新开始。

- -O Task2.zip 表示将下载的文件重命名为 Task2.zip。

这个方案是我下来最流畅的一个,没有遇到问题。

03 hugging face 上数据集的下载

(1)直接在网页上下载

需要一个一个下载,一般不用。

(2)通过 huggingface_hub 库下载

适用场景: 下载原始文件、大批量文件备份。

安装: pip install huggingface_hub

python

from huggingface_hub import snapshot_download

# 下载整个数据集仓库到本地

snapshot_download(repo_id="shibing624/medical",

repo_type="dataset",

local_dir="./medical_data",

resume_download=True) # 支持断点续传(3)使用 Git LFS

像克隆 GitHub 仓库一样克隆数据集。注意必须安装 Git LFS,否则大文件只能下到指针文件。

适用场景: 习惯用 Git 管理、需要查看历史版本的用户。

shell

git lfs install

git clone https://huggingface.co/datasets/username/dataset-nameHugging Face (HF) 是目前最主流的 NLP 和 AI 社区,下载数据集主要有三种方式:Python 代码库(官方推荐) 、命令行工具 和 Git。

以下是详细的下载指南,以及国内用户最常遇到的"网络连接"等问题的解决方案。

(4) hugging face 上数据集的下载 常见问题与解决方案

下载 Hugging Face 数据集时,90% 的问题都集中在网络连接上。

问题 :网络连接错误 (ConnectionError / ReadTimeout)

现象: 报错 ConnectTimeoutError,HTTPSConnectionPool(host='huggingface.co', port=443): Max retries exceeded。

原因: 国内网络环境连接 Hugging Face 官方服务器不稳定或被阻断。

✅ 解决方案 A:使用 HF-Mirror 镜像站(最推荐)

这是一个国内公益镜像站,完全同步官方资源。

-

设置环境变量 (在终端运行或写入

.bashrc):bashexport HF_ENDPOINT=https://hf-mirror.com -

设置后,正常的 Python 脚本(

load_dataset等)无需修改代码,会自动走镜像下载。