光学定位系统的发展历史(最后面有一些场景展示,有需要讨论的请联系我)

Ø 1838 年 , 物理学家惠斯顿发明了实体镜 , 第一次发现和定义了立体视觉

Ø 1839 年,法国画家达盖尔发明了银版摄影法,并制作了世界上第一台真正的照相机

Ø 1851-1859 年 - 摄影测量的真正开始 : 法国陆军上校劳塞达特 ( Laussedat ) 提出并进行了交会摄影测量 , 被公认为 " 摄影测量之父 "

Ø 20 世纪初 - 模拟摄影测量:德国卡尔蔡司厂成功制造出实用的 " 立体自动测图仪 "

Ø 1957-1970 年代 - 解析摄影测量时代: 1957 年 , 海拉瓦博士提出利用计算机进行解析测图的思想

Ø 主动式红外光学追踪阶段( 1980s-1990s )

基于红外LED或反光球的主动/被动标记点追踪系统,主要应用于医疗手术导航和动作捕捉领域,精度达到亚毫米级。

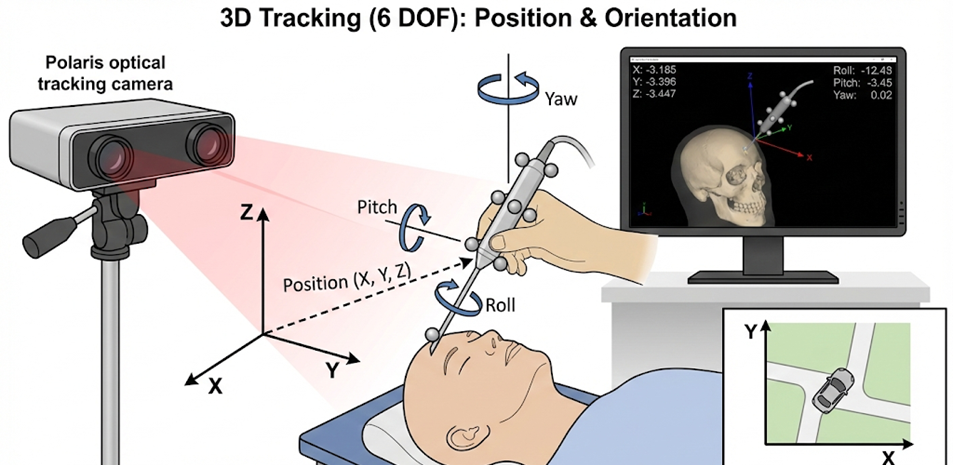

Ø 1981 年 - NDI 公司成立: 1984 年推出 WATSMART 系统 , 这是公司第一代 3D 实时光学测量产品; Polaris 光学跟踪系统于 1996 年推出,是一款小巧轻便、经济高效的定位应用测量解决方案。 Polaris 最初主要集成到 OEM 计算机辅助手术系统中,用于颅骨、脊柱和骨科手术。

Ø 1980s 末 -1990s 影视 + 医疗 🎬 Vicon 开创影视动捕 → 《 泰坦尼克号 》《 星球大战 》

🏥 NDI Polaris(1996)→ 手术导航。。。。。 后续就是国内的一些相关公司也在跟着做一些类似的东西。但是本质上大差不差。

https://baike.baidu.com/item/VICON 光学运动捕捉系统 /6207971

https://baike.baidu.com/item/VICON%E5%85%89%E5%AD%A6%E8%BF%90%E5%8A%A8%E6%8D%95%E6%8D%89%E7%B3%BB%E7%BB%9F/6207971

https://www.ndigital.cn/company/ndi-history/?lang=en

。。。。。。。。。。。

展示了NDI Polaris光学追踪相机在实际医疗场景中的应用。系统通过红外相机实时追踪手术器械上的标记点,精确计算出器械在三维空间中的位置(X, Y, Z坐标)和三个旋转角度(Yaw偏航、Pitch俯仰、Roll滚转),达到6自由度追踪。这使得医生在进行神经外科、脊柱手术等精密操作时,能在屏幕上看到器械相对于患者解剖结构(如CT扫描的骨骼模型)的实时位置,大幅提高手术精度和安全性。这种亚毫米级的追踪精度正是光学定位系统从1990年代起在医疗领域广泛应用的核心价值。

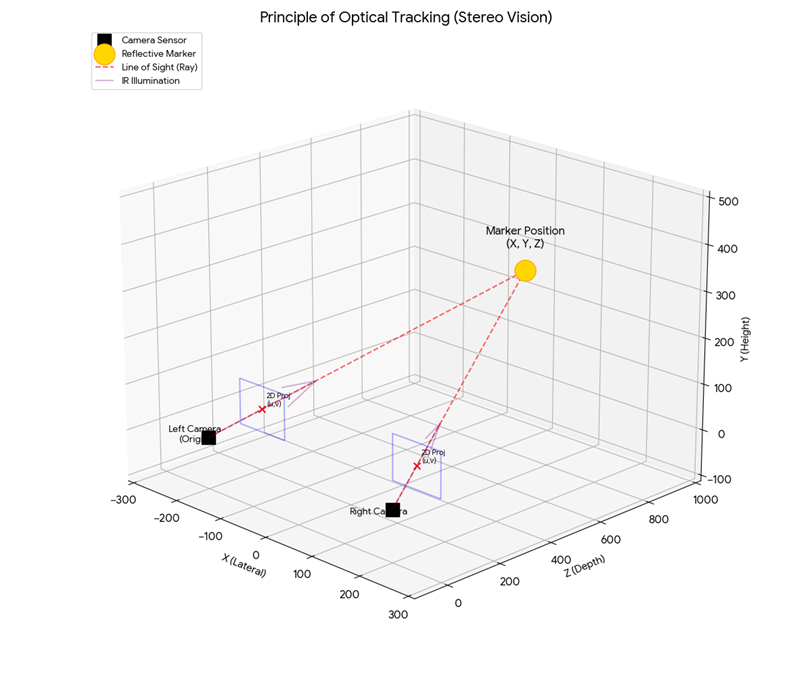

光学追踪系统的核心原理是立体视觉技术。系统使用至少两个精确校准的相机(左相机和右相机)从不同角度同时观察反光标记点。每个相机捕捉到标记点在其成像平面上的2D投影位置(用红色虚线表示视线射线),然后通过三角测量法计算出标记点在三维空间中的精确位置坐标(X, Y, Z)。这种双目视觉原理类似于人眼的深度感知机制------正是因为两只眼睛的视角差异,我们才能判断物体的远近。系统中两个相机的基线距离(Baseline)越大,测量的深度精度理论上越高,但同时也会限制可追踪的空间范围。

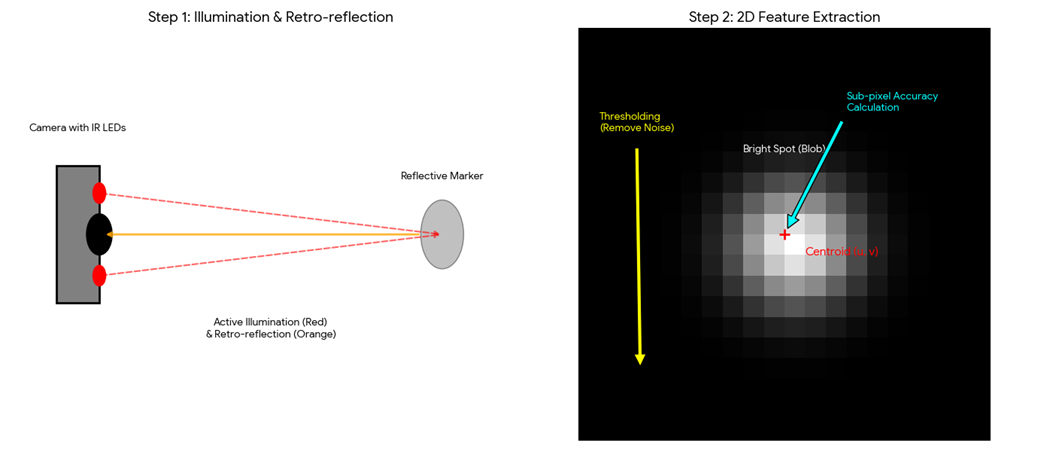

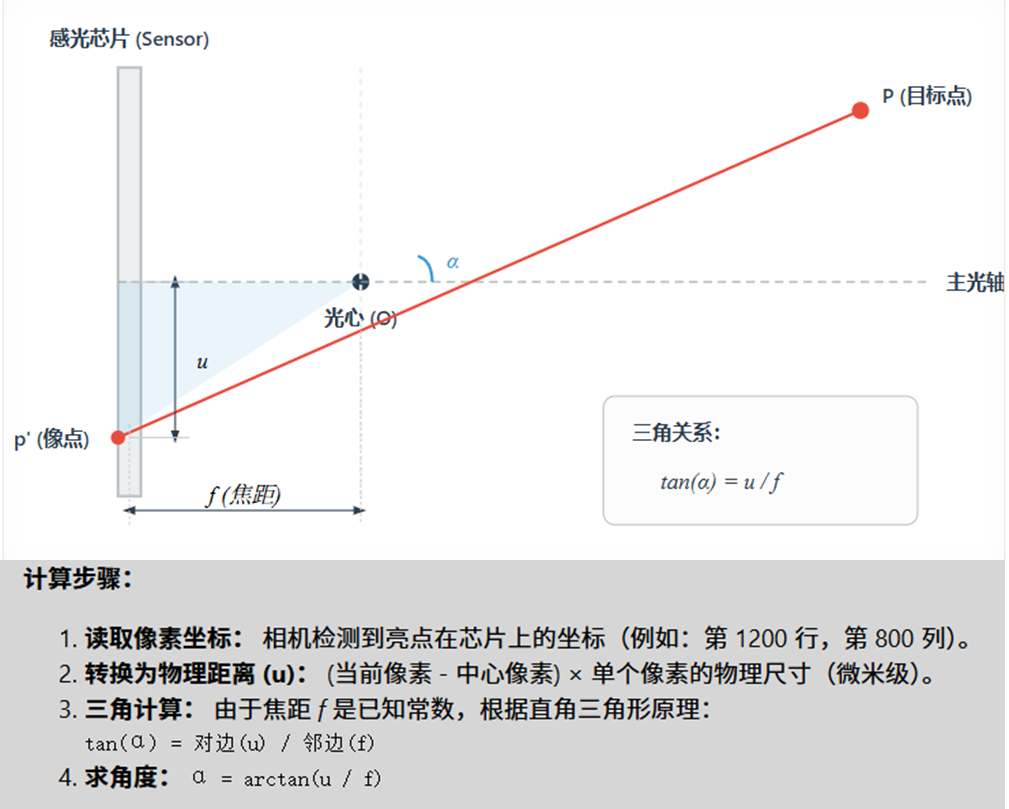

光学追踪分为两个关键步骤。第一步:主动照明与回射反射------相机周围配备红外LED灯环,发出红外光照射追踪区域。当红外光照射到反光标记点(通常是由回射反射材料制成的小球)时,光线会沿原路径强烈反射回相机,形成明亮的光斑。第二步:2D特征提取------相机传感器捕获到的图像经过阈值处理(Thresholding)去除噪声后,亮点区域(Bright Spot Blob)会被识别出来。系统进一步计算每个亮斑的质心(Centroid)坐标(u, v),并通过亚像素算法(Sub-pixel Accuracy Calculation)将定位精度提升到像素级别以下,这是实现毫米级甚至亚毫米级追踪精度的关键技术。

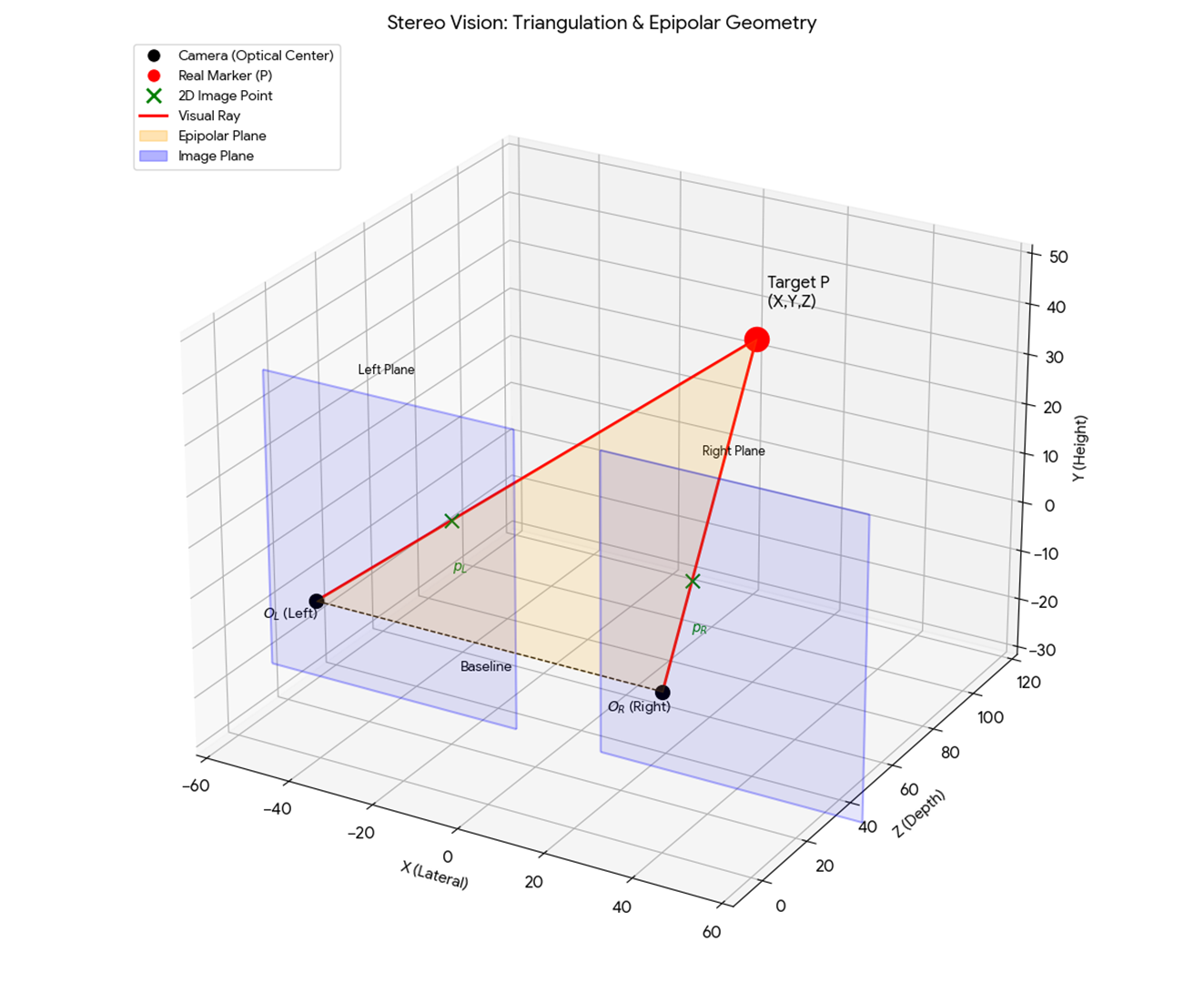

这张图展示了立体视觉系统的数学基础------极线几何(Epipolar Geometry)。当左相机和右相机都观察到同一个真实标记点P时,P点在左相机成像平面上的投影位置必然位于对应的极线(Base Line)上,右相机同理。两条从相机光心发出的视线射线(Visual Ray,红色线)在三维空间中相交,交点即为标记点P的真实位置(X,Y,Z)。图中的Baseline表示两个相机光心之间的距离,这是三角测量的基准线。极平面(Epipolar Plane,浅色区域)包含了两个相机光心和目标点P,限定了对应点的搜索范围。这种几何约束不仅提高了计算效率,还能通过多相机冗余观测提升系统的鲁棒性和精度。

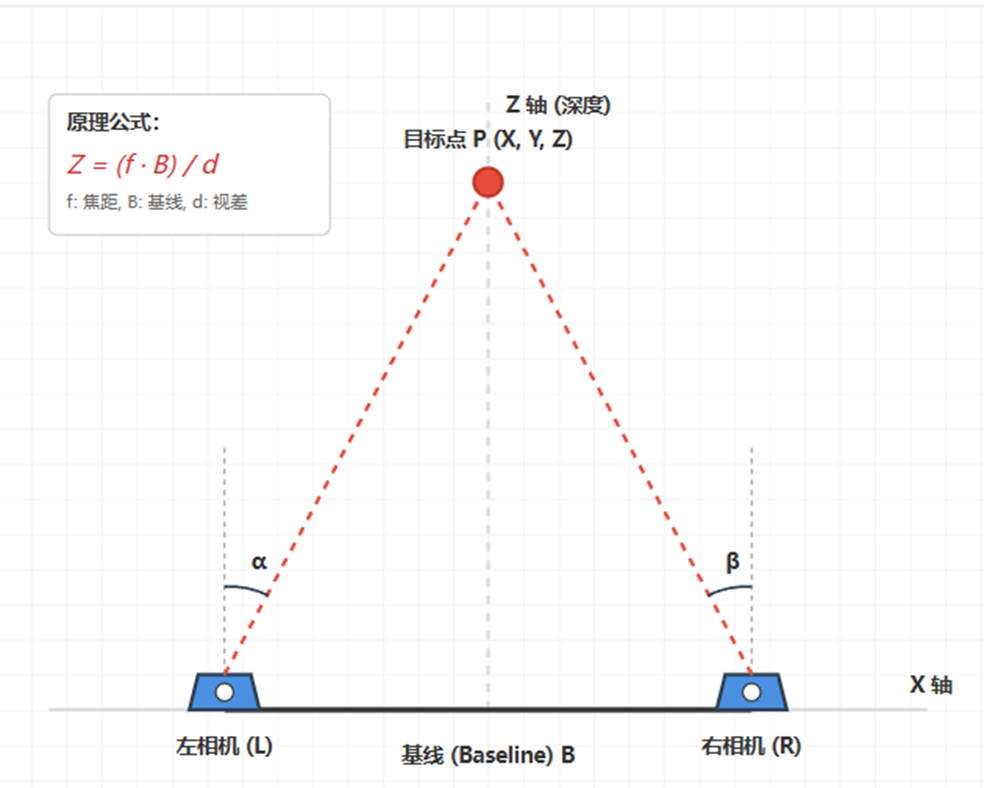

以下是获取xyz坐标的示意:

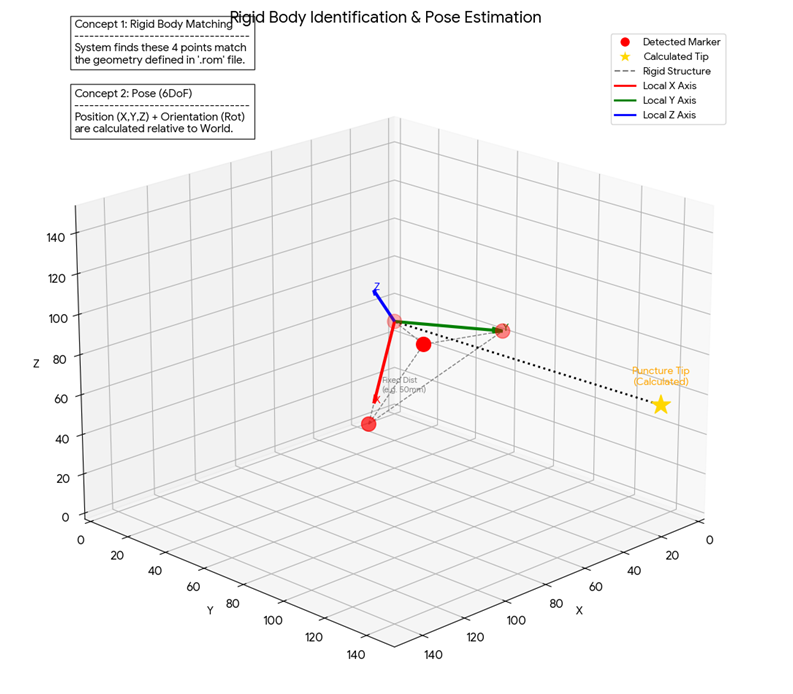

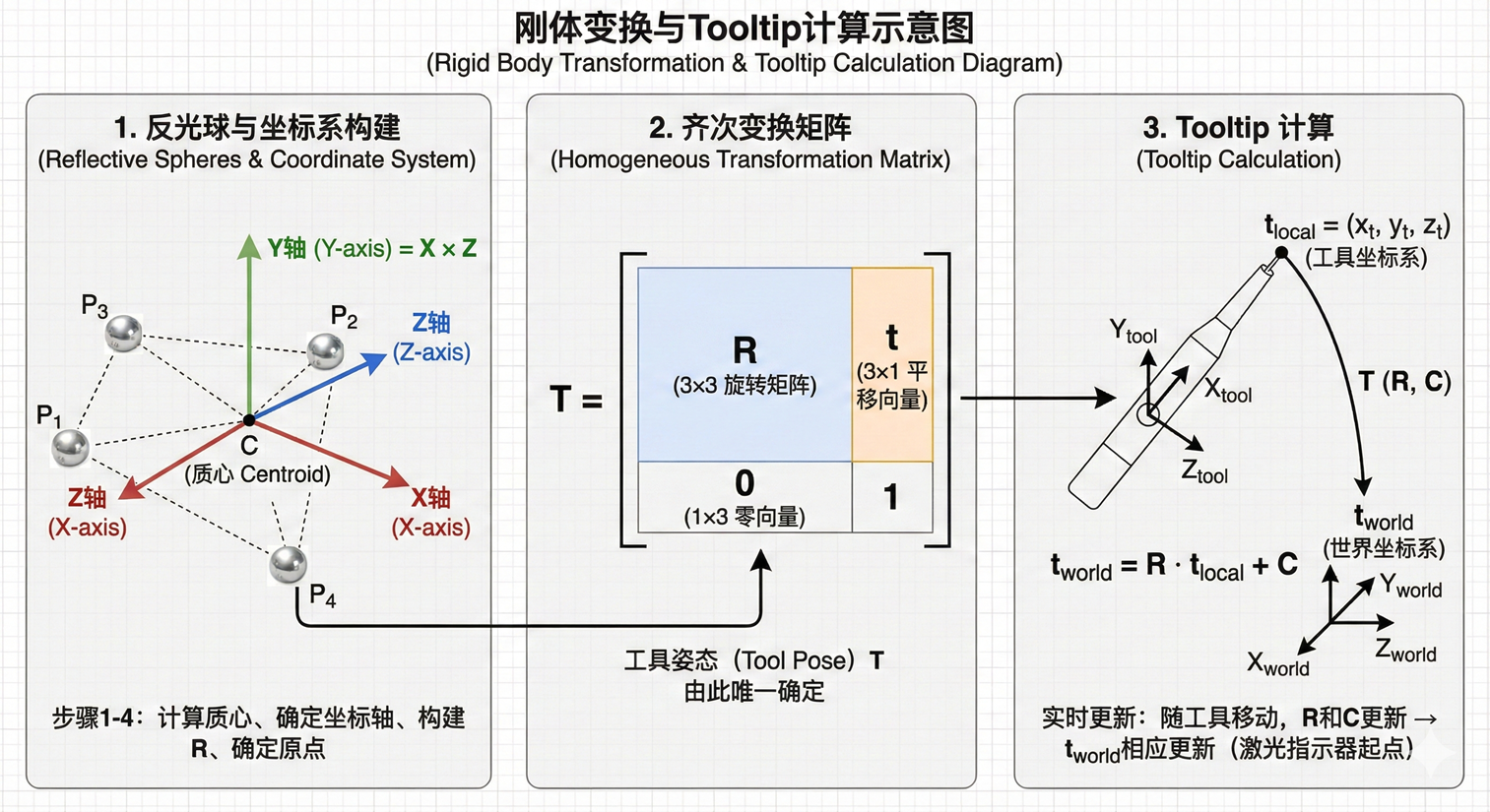

单个标记点只能提供3D位置信息,而要实现6自由度(6DOF)追踪------即同时获取物体的位置(X,Y,Z)和姿态角度(Roll滚转, Pitch俯仰, Yaw偏航),需要在被追踪物体上固定多个标记点形成"刚体"(Rigid Body)。系统首先通过刚体匹配(Concept 1: Rigid Body Matching)识别出当前检测到的标记点簇是否符合预先定义的几何配置(.rom文件中存储了标记点的相对位置关系)。一旦匹配成功,系统利用多个标记点的空间分布信息,通过姿态估计算法(Concept 2: Pose/6DoF Estimation)计算出刚体的本地坐标系(Local X/Y/Z Axis)相对于世界坐标系的位置和旋转矩阵。图中红点是实际检测到的标记点,黄色星星是根据刚体模型计算出的虚拟参考点(如手术工具的尖端),这使得系统能够追踪到物理标记点之外的关键位置,极大扩展了应用场景。

以下便是做的一些场景展示: