现代化智能体Ai

分层架构

基础设施层: Gpu/Tpu Cloud云算力支持,数据仓库,负载均衡,文件存储系统,工作流调度系统,监控运维系统等

Agent网络层: 包含自主规划Agent,通信协议,向量数据库,状态机维护,工具使用,身份认证权限控制,多智能体系统,短期/长期记忆的管理等。

协议层: 比较耳熟能详的是mcp , A2A, Fcp。这一层主要定义工具调用/编写的规范,智能体通信/使用规范。

知识增强层: 这一层主要是做数据/知识的增强,供大模型学习/获取新数据/知识,主要包含Rag,工具调用,知识库增强,联网搜索/爬虫,插件集成等功能。

认知与推理层: 目标管理,制定执行计划,进行决策,循环反馈,自我提升。需要用到强化学习等相关技术了。

记忆与个性化层: 主要作用于Agent的长期记忆,提取用户的相关信息,兴趣偏好,行为偏好以及历史对话等形成用户画像,更好地做到千人千面。

应用层: 这一层就是各种各样的应用Agent,比如deepresearch agent,平台类的agent(比如物流,客服,订单等)。

运维与治理层: 日志审计与监控统计(统计模型/工具调用量,耗时,token消耗量等,资源cpu,内存,网络,磁盘等使用情况),CI/CD,安全等。这一层是智能体系统走向生产环境的关键保障,决定了系统的可靠性和可持续性。

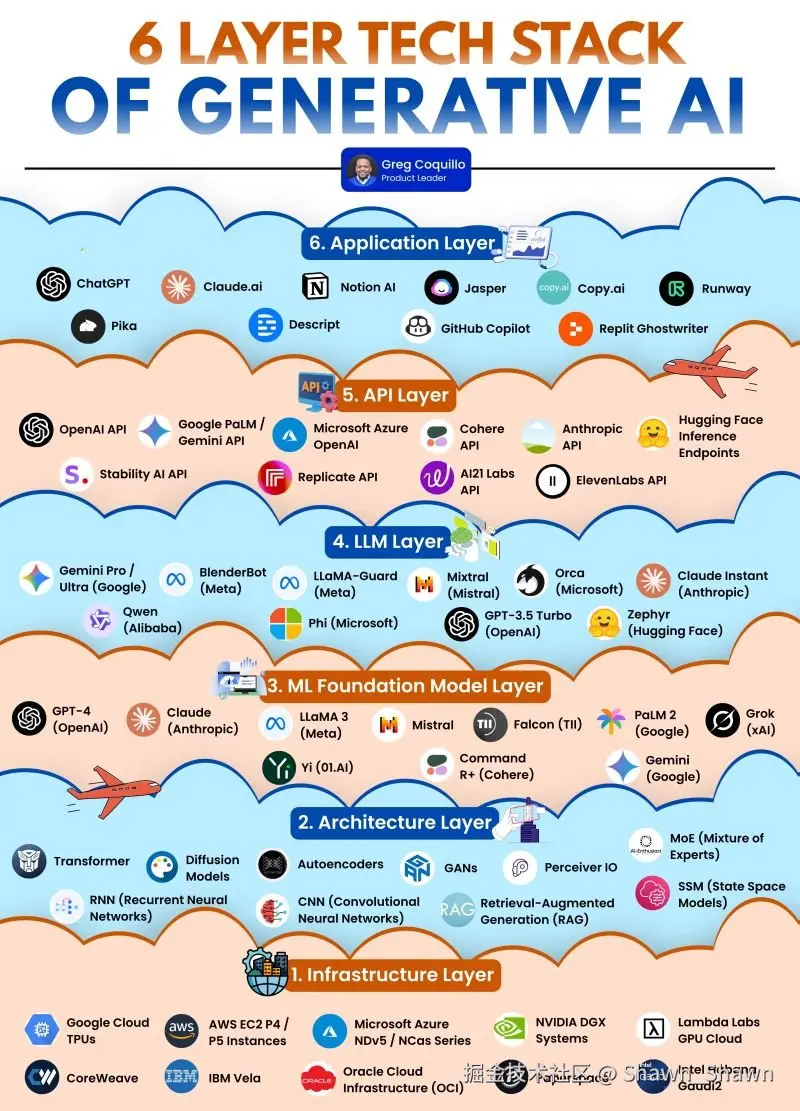

技术分层

| 技术栈层级 (Technology Stack) | 定义 (Definition) |

|---|---|

| 应用层 (Applications layer) | 用于生成针对各种问题和提示的自然语言回复的应用程序,例如聊天机器人 和翻译器 。但是,真实性对于最大限度地减少"幻觉"并将模型建立在现实基础上至关重要。 |

| API 层 (API layer) | 面向专业开发者 (作为构建各种应用程序的 Google LLM 的入口点)和业余爱好者(MakerSuite 原型设计工具)的 API。 |

| 大语言模型 (LLMs) 层 (Large Language Model layer) | 预训练的通用语言模型,可以针对特定任务进行微调。 旨在执行通用的语言任务,如语言翻译、摘要生成或对话生成。 |

| 机器学习基础模型层 (ML Foundation Model layer) | 预训练的通用、多功能语言模型。 可以针对各种下游 NLP 任务进行微调,例如文本分类或情感分析。 |

| 架构层 (Architecture layer) | 一种用于自然语言处理 (NLP) 任务的神经网络架构 ,它解锁了两个关键能力: • 决策制定 (Decision making) • 注意力广度 (Attention span) 这可以用自注意力 (Self-attention) 这一单一概念来概括。 |

| 基础设施层 (Infrastructure layer) | 张量处理单元 (TPU) 是专为深度学习工作负载设计的,并针对执行神经网络中常用的矩阵运算进行了优化。 |

这张图展示了生成式 AI (Generative AI) 的 6 层技术栈,从底层的硬件设施一直到顶层的用户应用。

以下是从下往上(由底层到应用层)的详细说明:

基础设施层: 提供算力,NVIDIA(显卡)、Google Cloud TPU、AWS(亚马逊云)、Microsoft Azure。

架构层: 这一层定义了模型的结构方式。例如,目前最火的 ChatGPT 主要是基于 Transformer 架构;画图 AI 常用 Diffusion Models(扩散模型)、RAG(检索增强生成)。

机器学习基础模型层: 预训练的通用、多功能语言模型。可以进行对特定领域进行微调,例如文本分类或者情感分析等。

大语言模型层: 预训练的通用语言模型,可以针对特定任务进行微调。旨在执行通用的语言任务,如语言翻译、摘要生成或对话生成。

Api层: 让开发者能够方便地调用模型能力的接口。只需要通过 API 接口,用户可以与大模型进行对话,OpenAI API, Google PaLM API, Azure OpenAI, Hugging Face Inference等基本都有Open Api提供

应用层: 这一层将 AI 的能力包装成好用的工具,比如写代码助手、聊天机器人、文案生成器等,ChatGPT(聊天)、GitHub Copilot(写代码)、Notion AI(笔记写作)、Jasper(营销文案)、Midjourney/Runway(图像视频生成)。

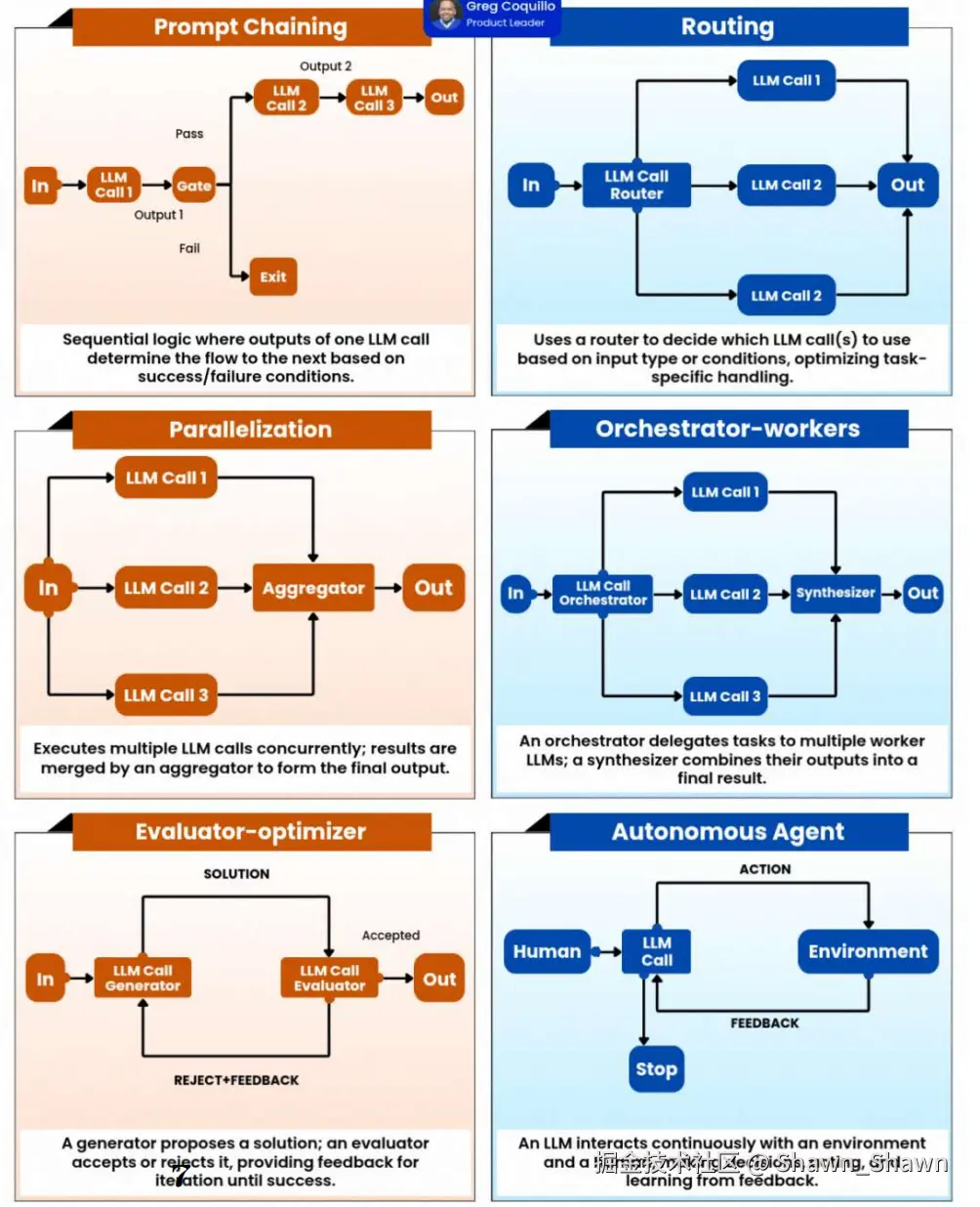

多Agent模式

1. 链式 (Prompt Chaining)

- 核心逻辑 : "单行线" 。像接力赛一样,一步接一步,前一步的输出是后一步的输入。

- 适用场景:流程固定、不能出错的标准化任务(如:写大纲→写正文→润色)。

2. 路由式 (Routing)

- 核心逻辑 : "分诊台" 。先看病(识别意图),再挂号(分流),把任务派给专门负责的那个模型。

- 适用场景:用户需求五花八门,需要分类处理(如:客服系统分流到人工、退款或查询)。

3. 并行式 (Parallelization)

- 核心逻辑 : "多线程" 。把大任务拆成几个互不干扰的小任务,大家同时干,最后把结果拼起来。

- 适用场景:任务之间没关联(如:同时分析某公司的股票、新闻和财报)。

4. 协作式 (Orchestrator-workers)

- 核心逻辑 : "项目组" 。有一个"包工头"(协调者)负责拆解任务、分派给不同的"工人"(子模型),最后汇总成果。

- 适用场景:任务太复杂,需要不同专业技能配合(如:一个负责查资料,一个负责写代码,一个负责测试)。

5. 评估优化式 (Evaluator-optimizer)

- 核心逻辑 : "改稿模式" 。一个负责写,一个负责审。审不过就打回重写,直到满意为止。

- 适用场景:对质量要求极高,容错率低(如:生成代码、法律合同)。

6. 规划式 / 自主智能体 (Autonomous Agent)

- 核心逻辑 : "自动驾驶" 。给一个大目标,AI 自己想办法拆解步骤、执行,遇到路不通就自己换条路走。

- 适用场景:环境在变、需要多轮决策的复杂任务(如:自主完成一个软件开发项目)。

参考文献

zhuanlan.zhihu.com/p/192598926...