论文题目:Toward Generalized Image Quality Assessment: Relaxing the Perfect Reference Quality Assumption(面向广义图像质量评价:放松完美参考质量假设)

会议:CVPR2025

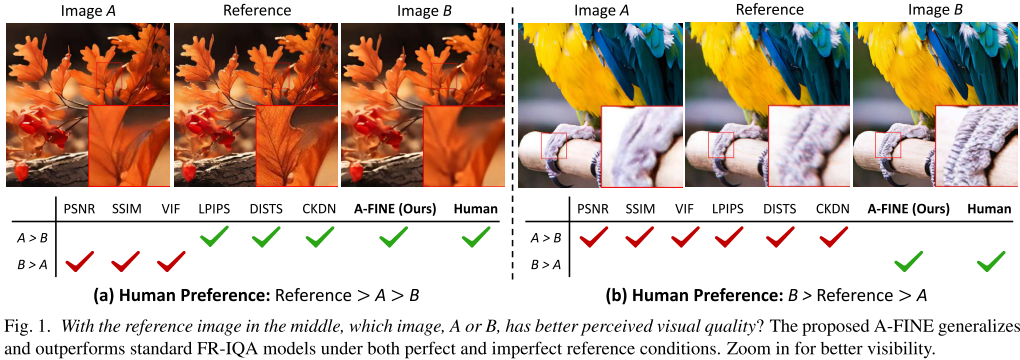

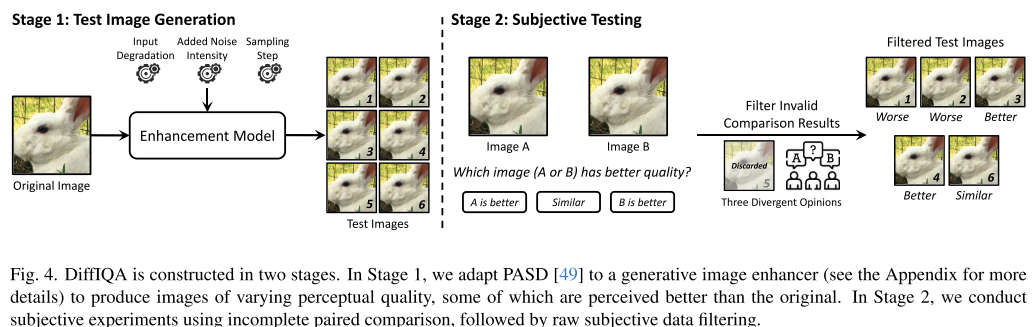

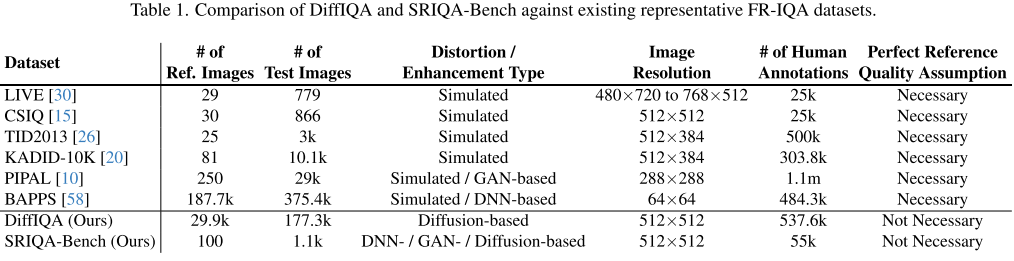

摘要:全参考图像质量评估(FR-IQA)通常假设参考图像具有完美的质量。然而,由于现代成像系统的传感器和光学限制,这种假设是有缺陷的。此外,最近的生成增强方法能够产生比原始图像更高质量的图像。这些都对当前FR-IQA模型的有效性和适用性提出了挑战。为了放松对完美参考图像质量的假设,我们建立了一个大规模的IQA数据库,即DiffIQA,其中包含大约18万张图像,这些图像是由基于扩散的图像增强器生成的,具有可调的超参数。每个图像都被人类受试者标注为与参考图像相比质量更差、相似或更好。在此基础上,我们提出了一种广义的FR-IQA模型,即Adaptive FIdelity-Naturalness Evaluator (A-FINE),用于准确评估和自适应结合测试图像的保真度和自然度。当参考图像比测试图像更自然时,A-FINE与标准FR-IQA很好地对齐。我们通过广泛的实验证明,在完善的IQA数据集和我们新创建的DiffIQA上,A-FINE优于标准的FR-IQA模型。为了进一步验证A-FINE,我们还构建了一个超分辨率IQA基准(SRIQA-Bench),包括来自十种最先进的SR方法的测试图像,并具有可靠的人类质量注释。在SRIQA-Bench上的测试再次证实了A-FINE的优势。

代码与数据集地址:https://tianhewu.github.io/A-FINEpage.github.io/

引言

在人工智能快速发展的今天,图像质量评估(IQA)技术在计算机视觉领域扮演着越来越重要的角色。从图像获取、传输到存储和处理的整个生命周期中,准确评估图像质量对于优化各种视觉任务至关重要。然而,传统的图像质量评估方法存在一个根本性的假设缺陷,这在生成式AI时代显得尤为突出。

传统方法的根本缺陷

完美参考假设的问题

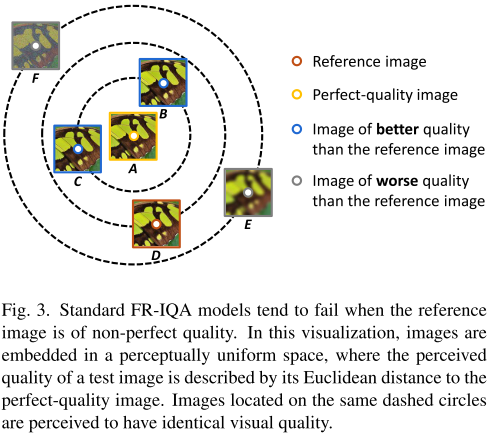

传统的全参考图像质量评估(FR-IQA)方法建立在一个看似合理但实际上有问题的假设之上:参考图像具有完美的质量。这一假设在以下几个方面存在明显缺陷:

-

硬件限制的现实:现代成像系统受到传感器噪声、光学畸变等物理限制,很难捕获真正"完美"的图像。

-

复杂场景的挑战:自然场景往往具有高动态范围、复杂的时空变化和广泛的色彩谱,这些特性使得完美捕获变得极其困难。

-

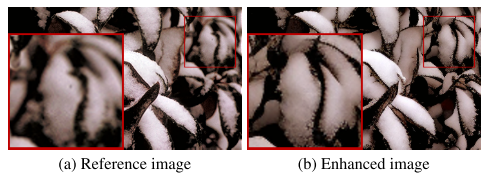

生成技术的颠覆:现代生成式图像增强技术(如扩散模型)能够产生比原始参考图像质量更高的结果,直接违背了完美参考假设。

评估失效的具体表现

当这一假设被违背时,传统FR-IQA方法会出现严重的评估偏差:

- 无法识别改进:当测试图像质量优于参考图像时,传统方法往往无法正确识别这种改进

- 错误的质量排序:在比较多个增强图像时,可能给出与人类感知不符的质量排序

- 优化目标偏离:当这些方法被用作深度学习模型的损失函数时,可能导致模型优化方向错误

创新解决方案:A-FINE模型

核心设计理念

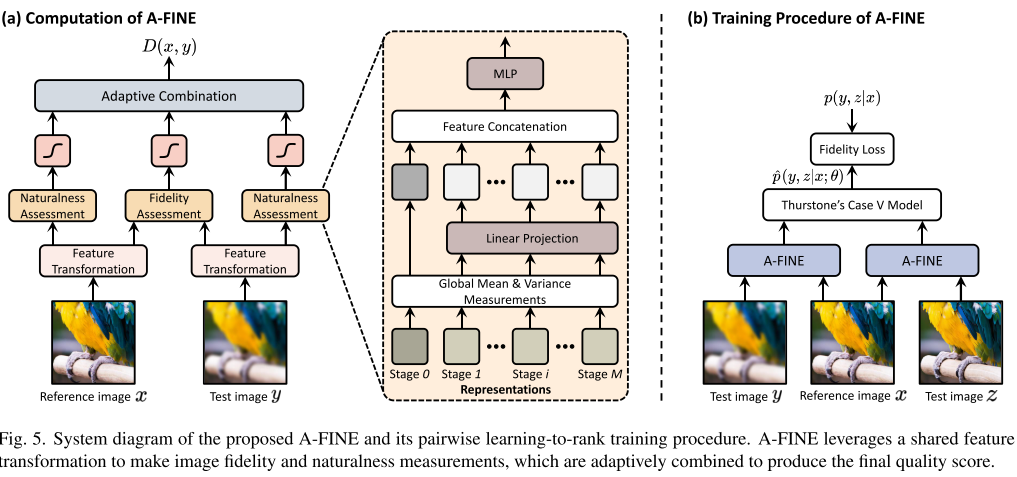

研究团队提出的A-FINE(Adaptive Fidelity-Naturalness Evaluator)模型采用了一个巧妙的设计理念:自适应地平衡保真度和自然度。

该模型的核心公式为:

D(x,y) = F(x,y) + λ(x,y) × N(y)其中:

F(x,y):图像保真度项,测量测试图像y相对于参考图像x的相似性N(y):图像自然度项,评估测试图像y的内在感知质量λ(x,y):自适应权重函数,根据两图像的相对自然度动态调整权重

自适应权重机制

权重函数的设计体现了模型的核心智慧:

λ(x,y) = exp(k(N(x) - N(y)))这个函数的巧妙之处在于:

- 当参考图像x的自然度远高于测试图像y时,λ接近于0,模型主要依赖保真度项,退化为传统FR-IQA

- 当测试图像y的自然度高于参考图像x时,λ增大,自然度项的权重增加,模型能够正确评估增强图像的质量

技术实现亮点

-

先进的特征提取:使用Vision Transformer(CLIP ViT-B/32)替代传统的VGG网络,提供更强的特征表征能力

-

端到端优化:整个模型可以进行端到端的联合训练,确保各组件协调工作

-

三阶段训练策略:

- 第一阶段:预训练自然度评估模块

- 第二阶段:优化保真度评估的权重参数

- 第三阶段:微调自适应权重和非线性映射参数

突破性数据集:DiffIQA

数据集特点

为了训练和评估广义FR-IQA模型,研究团队构建了DiffIQA数据集,该数据集具有以下突破性特点:

- 规模庞大:包含约180,000张512×512分辨率的图像

- 质量多样:使用改进的扩散模型生成质量差于、相似于或优于参考图像的测试样本

- 标注丰富:537,624个人工质量标注,每个图像对至少由3名评估者标注

- 场景真实:涵盖DF2K、互联网创作共享图像和真实拍摄图像

数据生成策略

研究团队采用了创新的数据生成方法:

- 扩散模型改造:将PASD方法改造为强大的图像增强器

- 质量控制:通过调整降质程度、噪声强度和采样步数控制输出质量

- 多样性保证:每个输入图像生成6个不同质量的测试版本

实验结果与性能分析

跨数据集性能对比

在标准IQA数据集(TID2013、KADID-10K、PIPAL)上,A-FINE取得了显著优势:

| 方法类别 | 代表方法 | 平均准确率 |

|---|---|---|

| 传统方法 | PSNR | 72.2% |

| 传统方法 | DISTS | 77.2% |

| 广义方法 | CKDN | 77.1% |

| A-FINE | 我们的方法 | 83.6% |

DiffIQA数据集上的表现

在新构建的DiffIQA数据集上,A-FINE展现出了卓越的泛化能力:

- 整体准确率:79.9%

- 参考图像质量较低场景:78.5%

- 测试图像优于参考场景:82.3%

相比之下,传统方法在测试图像优于参考的场景下严重失效:

- PSNR:仅18.2%

- SSIM:仅20.1%

- DISTS:仅21.4%

SRIQA-Bench基准测试

在专门构建的超分辨率IQA基准上,A-FINE同样表现出色:

- 回归方法:83.3%准确率

- 生成方法:78.9%准确率

- 整体性能:82.4%准确率

这一结果证明了A-FINE在评估各类图像增强技术方面的有效性。

技术深度解析

保真度项的改进

A-FINE对传统保真度评估进行了重要改进:

- 多尺度特征融合:在Vision Transformer的不同层级提取特征

- 结构-纹理统一:同时考虑全局纹理和结构相似性

- 学习权重优化:通过端到端训练优化各层特征的权重

自然度评估的创新

自然度评估模块是A-FINE的核心创新之一:

- 全局统计特征:计算每个阶段特征图的均值和方差

- 维度映射:通过线性投影将特征映射到统一维度

- 非线性预测:使用多层感知器进行最终的自然度评分

训练策略的优化

三阶段训练策略的设计体现了深度学习工程的最佳实践:

- 预训练稳定性:先训练自然度评估确保特征提取稳定

- 分步骤优化:避免多目标优化的困难

- 精细调参:最后阶段专注于关键超参数优化

实际应用价值

图像处理算法评估

A-FINE为各种图像处理算法提供了更准确的评估标准:

- 超分辨率算法:能够正确评估生成式SR方法的输出质量

- 图像去噪:在噪声图像作为参考时提供可靠评估

- 图像增强:准确评估各种增强算法的效果

深度学习模型优化

作为损失函数,A-FINE可以指导模型朝向更符合人类感知的方向优化:

- 感知质量优化:相比传统MSE损失,提供更好的感知质量指导

- 多目标平衡:在保真度和自然度之间找到最佳平衡

- 自适应调整:根据输入特点自动调整优化重点

内容质量控制

在内容创作和媒体处理中,A-FINE可以:

- 自动质量筛选:识别并过滤低质量内容

- 增强效果验证:验证图像增强算法的实际效果

- 用户体验优化:确保向用户展示高质量的视觉内容

方法局限性与未来发展

当前局限性

研究团队诚实地指出了方法的几个局限性:

- 参考质量阈值:当参考图像质量过低时,保真度项可能引入显著偏差

- 函数形式探索:当前的自适应权重函数可能不是最优形式

- 性能权衡:在评估降质图像和增强图像之间存在性能权衡

未来研究方向

基于这些局限性,未来的研究可以从以下方向展开:

- 更复杂的权重函数:探索非线性、多参数的自适应权重机制

- 多模态融合:结合语义信息、文本描述等多模态信息

- 无监督学习:减少对大量标注数据的依赖

- 实时评估:优化模型计算效率,实现实时质量评估

对学术界和工业界的影响

学术贡献

这项研究对学术界产生了深远影响:

- 范式转变:从完美参考假设向广义评估的转变

- 新评估标准:为图像质量评估提供了新的评估框架

- 数据资源:DiffIQA数据集为社区提供了宝贵的研究资源

工业应用前景

对于工业界而言,这项技术具有广泛的应用前景:

- 媒体处理:视频平台、图像编辑软件的质量控制

- 移动摄影:手机相机的图像增强效果评估

- 内容创作:AI艺术创作、图像生成的质量把控

- 医疗影像:医学图像增强和恢复的质量评估

结论

这篇论文代表了图像质量评估领域的一个重要突破。通过放松完美参考质量假设,A-FINE模型不仅解决了传统方法在生成式AI时代面临的根本挑战,也为未来的研究开辟了新的方向。

DiffIQA数据集的构建和SRIQA-Bench基准的建立,为社区提供了宝贵的研究资源。实验结果充分证明了方法的有效性和实用性。

随着生成式AI技术的不断发展,图像质量评估面临着前所未有的挑战和机遇。这项研究不仅提供了当前问题的解决方案,更重要的是,它启发了我们重新思考图像质量评估的基本假设和方法论。

未来,我们可以期待看到更多基于这一范式的研究工作,以及在实际应用中的广泛部署。这将进一步推动计算机视觉领域的发展,为用户带来更好的视觉体验。