机器学习入门:监督/无监督学习核心任务全解析

机器学习作为人工智能的核心分支,其本质是让计算机从数据中学习规律,进而实现对未知数据的预测或分析。而"监督学习"和"无监督学习"是机器学习最基础、最核心的两大范式,几乎所有经典算法都围绕这两类任务展开。本文将带你吃透这两大学习模式的核心逻辑、典型任务及应用场景,帮你搭建机器学习的底层认知框架。

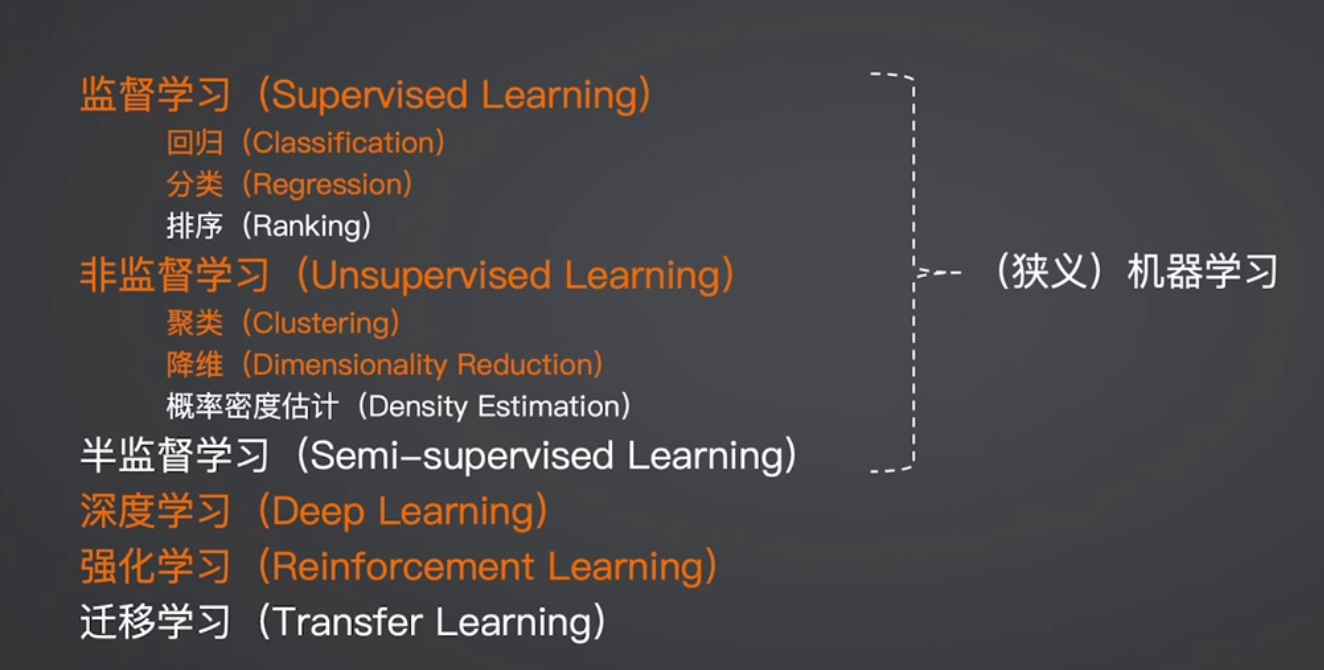

1 先搞懂:机器学习的核心分类逻辑

在正式拆解监督和无监督学习前,我们先看一张图,快速建立整体认知:

从数据维度来看,机器学习的核心划分依据是训练数据是否带有"标签":

- 带标签数据 → 监督学习

- 无标签数据 → 无监督学习

- 少量标签+大量无标签 → 半监督学习(延伸分支)

- 与环境交互学策略 → 强化学习(延伸分支)

- 多层网络学特征 → 深度学习(延伸分支)

接下来,我们聚焦核心------监督学习和无监督学习,逐一拆解。

2 监督学习:给机器"喂答案"的学习模式

2.1 核心定义

监督学习(Supervised Learning)是机器学习的核心分支,核心特征是:使用带标签的数据集训练模型。

你可以把它理解为"学生做有答案的练习题":每个训练样本都包含"输入数据(题目)+ 对应输出标签(答案)",模型的目标是学习"输入→输出"的映射规律,学成后就能给新的"题目"(未见过的输入数据)给出正确"答案"(预测结果)。

2.2 三大典型子任务

监督学习的输出形式决定了它的核心子任务,主要分为3类:

2.2.1 分类(Classification):输出"离散类别"

- 核心逻辑:模型学习后,对新输入数据判断其所属的"类别标签",标签是离散的、有限的。

- 通俗例子 :

- 邮件分类:判断一封邮件是"垃圾邮件"还是"正常邮件"(二分类);

- 图像识别:识别一张图片里的动物是"猫""狗"还是"兔子"(多分类);

- 风控场景:判断一个用户的贷款申请是"风险用户"还是"低风险用户"。

2.2.2 回归(Regression):输出"连续数值"

- 核心逻辑:模型学习后,对新输入数据预测一个连续的数值,输出没有固定的类别限制。

- 通俗例子 :

- 房价预测:根据房屋面积、地段、房龄等特征,预测具体的房价(如120万、156.8万);

- 销量预测:根据历史销量、促销活动、季节等特征,预测下个月的商品销量(如5000件、8900件);

- 体温预测:根据患者的症状、年龄等,预测未来24小时的体温数值。

2.2.3 排序(Ranking):输出"优先级顺序"

- 核心逻辑:模型学习后,对一组数据按照特定规则(如相关性、重要性)输出排序结果。

- 通俗例子 :

- 搜索引擎:将搜索结果按与用户查询的相关性从高到低排序;

- 推荐系统:将商品/视频按用户的偏好程度排序展示;

- 招聘场景:将简历按与岗位的匹配度排序。

2.3 监督学习的核心特点

- 优点:目标明确、可解释性相对强(多数算法)、预测结果直观;

- 缺点:对标签数据依赖高(标签标注成本高)、易过拟合(模型"死记硬背"答案,而非学规律);

- 适用场景:有明确预测目标、能获取带标签数据的场景(如风控、销量预测、图像分类)。

3 无监督学习:让机器"自主找规律"的学习模式

3.1 核心定义

无监督学习(Unsupervised Learning)是机器学习的另一核心分支,核心特征是:使用无标签的数据集训练模型。

类比到学习场景,这就像"学生分析一堆没有答案的原始数据,自己总结规律":训练数据只有输入信息,没有预设的输出标签,模型的目标是自主挖掘数据的内在结构、规律或分布特征。

3.2 三大典型子任务

3.2.1 聚类(Clustering):给数据"自动分组"

- 核心逻辑:模型根据数据的相似性(如特征距离、相似度),将数据自动划分成多个"簇"(组),同一簇内的数据相似度高,不同簇间相似度低。

- 通俗例子 :

- 用户分群:根据用户的消费金额、消费频率、购买品类等,将用户分成"高价值用户""潜力用户""低活跃用户";

- 商品聚类:将电商平台的商品按属性、销量、价格等特征分成不同品类;

- 异常检测前置:先将正常数据聚类,偏离聚类中心的则判定为异常数据。

3.2.2 降维(Dimensionality Reduction):给数据"瘦身"

- 核心逻辑:在保留数据核心信息的前提下,降低数据的特征维度(减少特征数量),解决"高维数据稀疏、计算成本高"的问题。

- 通俗例子 :

- 图像压缩:将高维的图像像素数据(如1000×1000像素)转化为低维的特征向量,同时保留图像的核心特征(如轮廓、颜色);

- 特征筛选:将用户的100个行为特征,降维为5个核心特征(如活跃度、消费能力、偏好度),简化后续模型训练;

- 数据可视化:将高维数据(如10维)降维到2维/3维,直观展示数据的分布规律。

3.2.3 概率密度估计(Density Estimation):分析数据"分布规律"

- 核心逻辑:模型推断数据在特征空间中的概率分布规律,判断新数据是否符合该分布。

- 通俗例子 :

- 异常检测:先估计正常用户的行为数据分布,若新用户的行为数据偏离该分布,则判定为异常行为(如盗号、欺诈);

- 数据生成前置:学习真实数据的分布规律,为生成式模型(如GAN)提供基础。

3.3 无监督学习的核心特点

- 优点:无需标签数据(降低数据成本)、能发现数据的隐藏规律、适用范围广;

- 缺点:结果解释性弱(如聚类的"簇"没有明确含义)、评估难度高(无标签对照);

- 适用场景:探索数据规律、无标签数据、需挖掘隐藏结构的场景(如用户分群、数据降维、异常检测)。

4 监督 vs 无监督:一张表看懂核心差异

| 维度 | 监督学习 | 无监督学习 |

|---|---|---|

| 数据特征 | 带标签(输入+输出) | 无标签(仅输入) |

| 核心目标 | 学习"输入→输出"映射 | 挖掘数据内在规律/结构 |

| 典型任务 | 分类、回归、排序 | 聚类、降维、密度估计 |

| 结果特点 | 目标明确、可直接预测 | 规律隐藏、需人工解读 |

| 标签成本 | 高(需人工标注) | 低(无需标注) |

| 典型算法 | 线性回归、逻辑回归、SVM | K-means、PCA、层次聚类 |

5 机器学习的扩展方向(补充认知)

除了核心的监督/无监督学习,机器学习还有几个重要的延伸分支,帮你建立完整认知:

- 半监督学习:结合"少量带标签数据 + 大量无标签数据",平衡标签成本和模型性能(如电商商品分类,仅标注少量商品,让模型学习其余商品);

- 深度学习:基于多层神经网络,擅长提取图像、文本等复杂数据的深层特征(如ChatGPT、图像生成模型);

- 强化学习:智能体通过与环境交互、获取奖惩信号学习决策策略(如游戏AI、自动驾驶);

- 迁移学习:将已训练好的模型知识迁移到相似任务,降低新任务训练成本(如用预训练的图像模型做特定场景的识别)。

6 小结

监督学习和无监督学习是机器学习的"基石":

- 若你有明确的预测目标、能获取带标签数据,优先选择监督学习(分类/回归);

- 若你想探索数据规律、只有无标签数据,选择无监督学习(聚类/降维)。

下一篇,我们将聚焦"机器学习十大经典算法",拆解不同算法对应的任务类型和适用场景,帮你精准匹配算法与业务需求。

思考小问题:你所在的行业中,哪些场景适合用监督学习?哪些适合无监督学习?欢迎在评论区交流~