目录

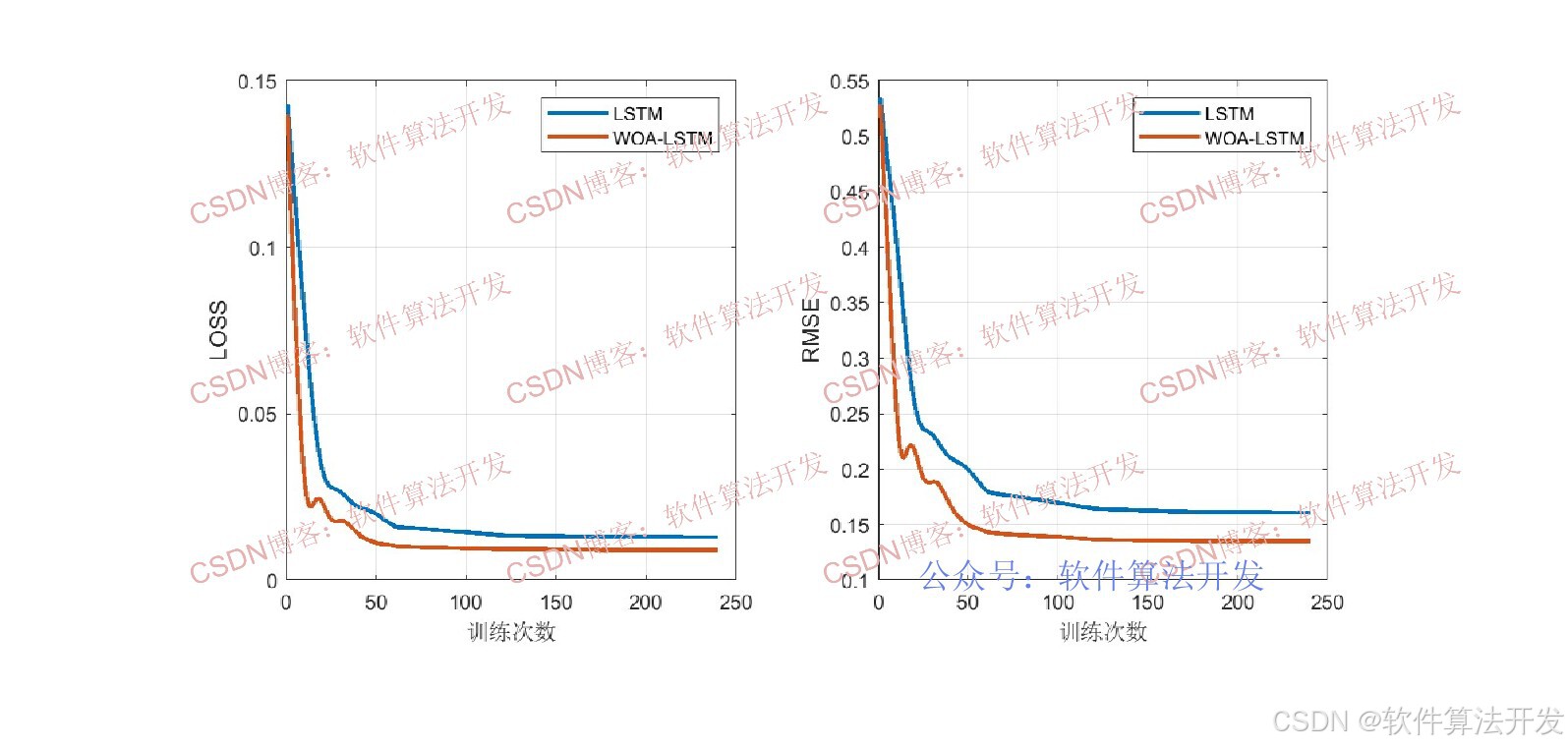

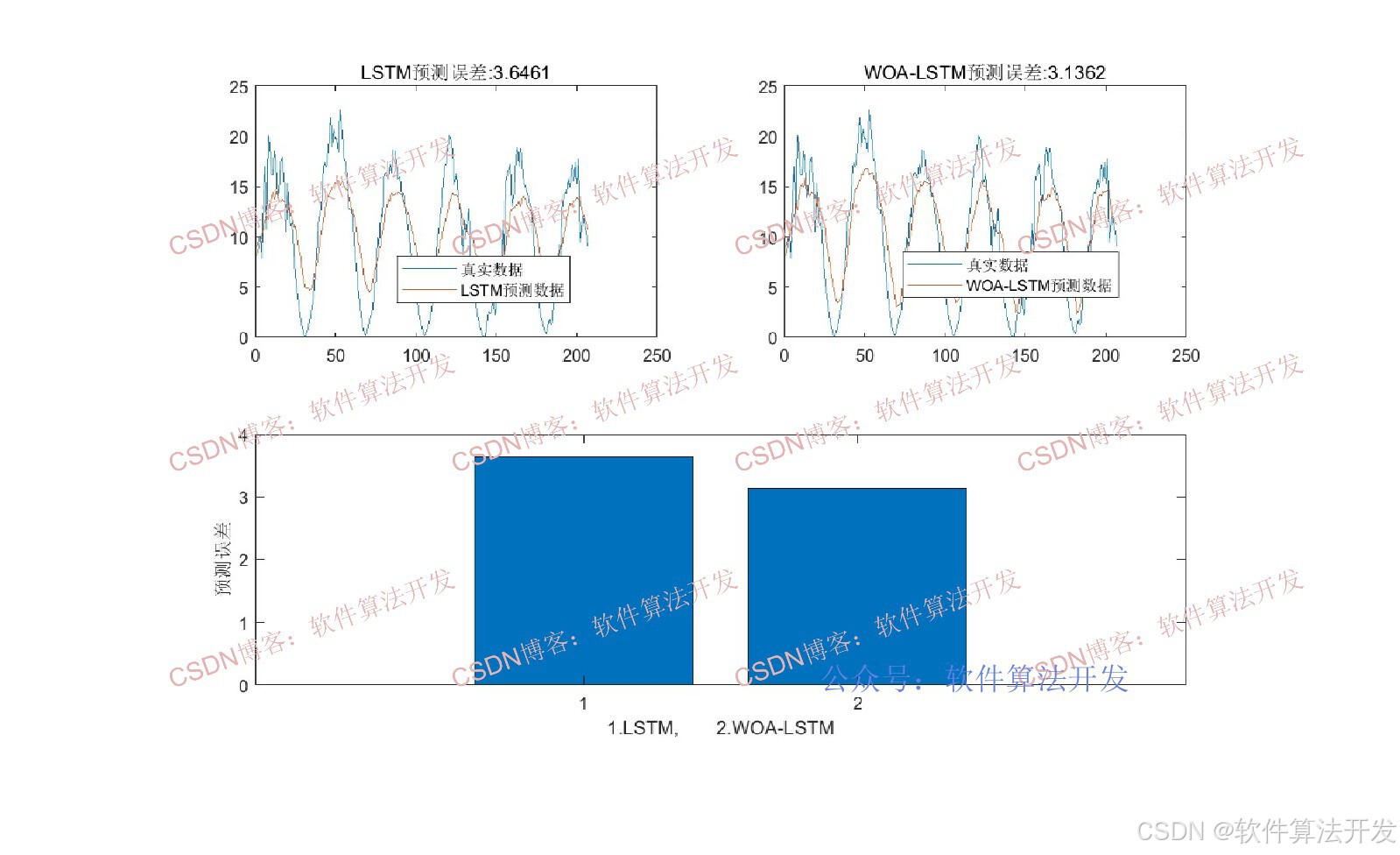

本文提出一种WOA-LSTM混合算法,通过鲸鱼优化算法(WOA)自动优化LSTM网络的隐藏层神经元数量,解决传统LSTM超参数需经验设定的问题。算法将神经元数量作为WOA的搜索变量,以预测均方误差为适应度函数,实现一维时间序列的高精度预测。程序在MATLAB环境下实现,包含数据预处理、WOA优化、LSTM训练和预测等模块,支持GPU加速训练。实验结果表明,该方法能有效提升预测精度,适用于连续时间序列的回归预测任务。

1.程序功能描述

WOA-LSTM算法是将鲸鱼优化算法(WOA)与长短期记忆网络(Long Short-Term Memory, LSTM)相结合的时间序列预测模型,核心是利用WOA优化LSTM的隐藏层神经元数量,解决LSTM超参数凭经验设定导致的预测精度不足问题,适用于一维连续时间序列的回归预测。

2.测试软件版本以及运行结果展示

MATLAB2022A/MATLAB2024B版本运行

3.部分程序

....................................................

% 获取最佳解并绘制优化后的节点部署

bestX = Leader_pos;

% 将优化得到的最佳参数转换为整数,作为LSTM隐藏层神经元数量

% 加1是为了确保至少有1个神经元

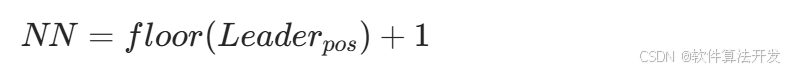

NN=floor(bestX)+1

% 定义LSTM神经网络结构

layers = [ ]; % 回归层,用于回归任务(输出连续值)

% 设置网络训练参数

options = trainingOptions('adam', ... % 使用Adam优化器,适合深度学习训练

'MaxEpochs', 240, ... % 最大训练轮数为240

'GradientThreshold', 1, ... % 梯度阈值为1,防止梯度爆炸

'InitialLearnRate', 0.004, ... % 初始学习率为0.004

'LearnRateSchedule', 'piecewise', ...% 学习率调度方式为分段衰减

'LearnRateDropPeriod', 60, ... % 每60轮衰减一次学习率

'LearnRateDropFactor',0.2, ... % 学习率衰减因子为0.2(变为原来的20%)

'L2Regularization', 0.01, ... % L2正则化系数为0.01,防止过拟合

'ExecutionEnvironment', 'gpu',... % 使用GPU加速训练(需配置GPU支持)

'Verbose', 0, ... % 不显示训练过程细节

'Plots', 'training-progress'); % 显示训练进度图表(损失变化等)

% 训练LSTM网络

[net,INFO] = trainNetwork(Pxtrain, Txtrain, layers, options);

% 使用训练好的网络进行预测

Dat_yc1 = predict(net, Pxtrain); % 对训练数据进行预测(归一化尺度)

Dat_yc2 = predict(net, Pxtest); % 对测试数据进行预测(归一化尺度)

% 将预测结果反归一化,恢复到原始数据范围

Datn_yc1 = mapminmax('reverse', Dat_yc1, Norm_O);

Datn_yc2 = mapminmax('reverse', Dat_yc2, Norm_O);

% 将细胞数组转换为矩阵(方便后续处理和分析)

Datn_yc1 = cell2mat(Datn_yc1);

Datn_yc2 = cell2mat(Datn_yc2);

% 保存训练信息、预测结果和收敛曲线到MAT文件,便于后续分析

save R2.mat INFO Datn_yc1 Datn_yc2 T_train T_test Convergence_curve

1324.算法理论概述

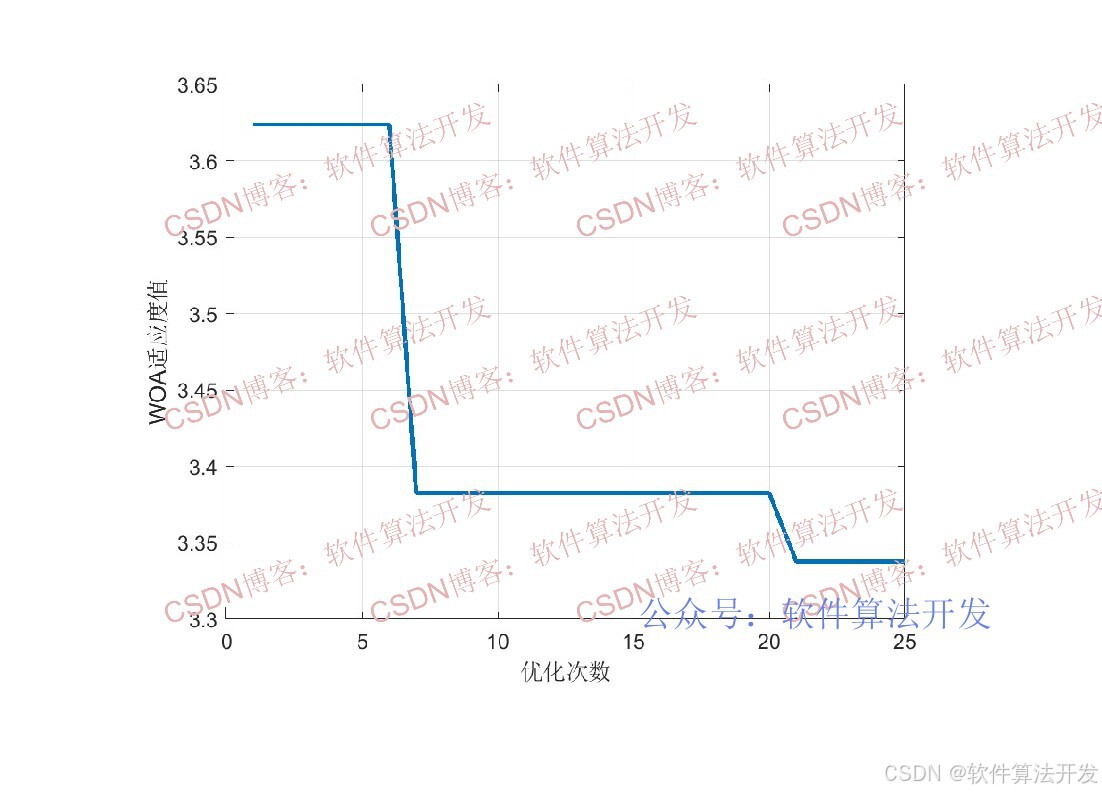

该算法通过鲸鱼优化算法(WOA)自适应优化LSTM神经网络的隐含层神经元数量,解决LSTM超参数凭经验设置导致的预测精度低、泛化能力差问题,实现一维时间序列的高精度预测,核心是将 LSTM隐含层神经元数量作为WOA的搜索变量,以预测误差为适应度函数,寻优后构建最优结构 LSTM完成预测。

WOA模拟座头鲸的包围捕食、气泡网攻击、随机搜索三种行为,通过自适应调整搜索策略在解空间中寻优,具有参数少、收敛速度快、全局搜索能力强的特点,适合求解单变量超参数优化问题(本文为LSTM隐含层神经元数量)。将LSTM隐含层神经元数量作为WOA的一维搜索变量,将LSTM的预测误差作为WOA的适应度函数,通过WOA的全局寻优得到最优神经元数量,再构建该结构的LSTM完成时间序列预测,实现超参数的自适应优化。

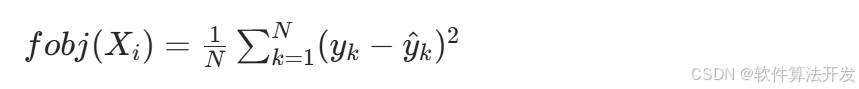

对每个候选解Xi(神经元数量),构建对应LSTM模型并训练,以预测均方误差MSE为适应度函数 fobj(Xi),公式为:

其中,N为训练集样本数,yk为真实值,y^k为LSTM预测值,适应度值越小表示预测精度越高。

WOA迭代结束后,将WOA得到的最优领导者位置转换为整数,作为LSTM的最优隐含层神经元数量,公式为:

最后,根据WOA寻优得到的NN ,构建LSTM网络结构并设置训练参数,对归一化后的训练数据进行训练。

5.完整程序

VVV

关注后手机上输入程序码:135