摘要

受计算机视觉领域自监督学习最新进展的启发,本文提出了 DeLoRes------一种通用的音频表征学习新方法。我们的主要目标是在资源受限(包括数据和计算资源)的条件下,使网络学习到能够泛化至多种下游任务的音频表征。受 Barlow Twins 目标函数的启发,我们提出学习对输入音频样本的各种失真具有不变性的嵌入表示,同时确保这些嵌入包含关于原始样本的非冗余信息 。具体而言,我们对两个相同网络分别输入同一音频片段的不同失真版本,计算其输出之间的互相关矩阵,并使其尽可能接近单位矩阵。我们在自监督学习阶段仅使用了大规模 AudioSet 数据集的一个小子集以及 FSD50K 数据集,所用模型参数量不到当前最先进算法的一半。为评估所学表征的有效性,我们将它们迁移到 9 个不同的下游分类任务中,涵盖语音、音乐和动物声音等多个领域,并在多种评估设置下取得了具有竞争力的结果。此外,我们的预训练算法不仅简单直观,而且由于其内在构造特性,天然适合高效计算,无需复杂的实现细节来避免平凡解或退化解。我们还对实验结果进行了消融研究,并将全部代码和预训练模型公开发布。

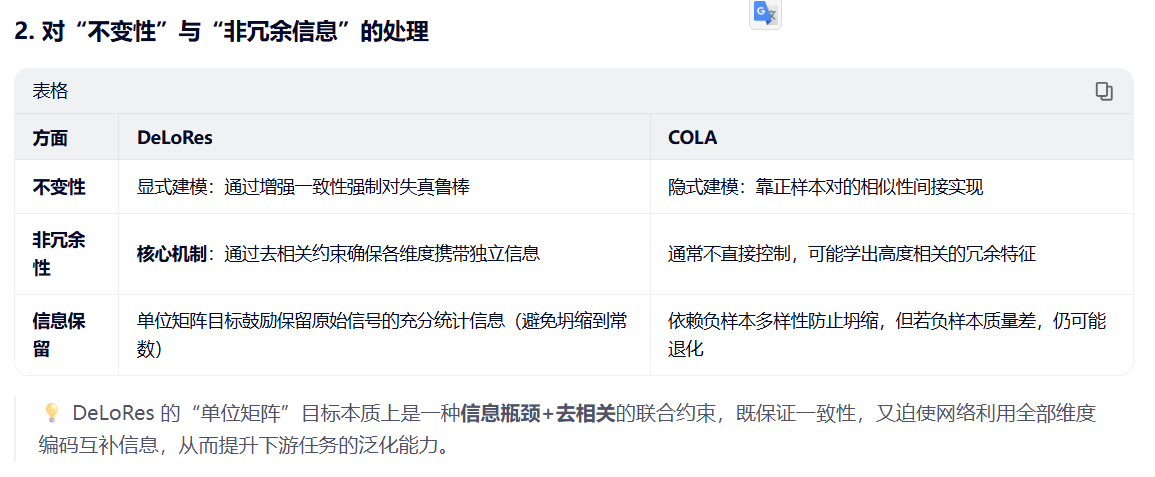

DeLoRes(基于 Barlow Twins 的冗余最小化方法) 与 COLA(Contrastive Learning of Audio representations,基于对比学习的方法)对比

引言

近年来,无监督表征学习(包括自监督学习和半监督学习)在多种模态(如文本、视觉和语音)中取得了巨大成功。尽管自监督学习(SSL)和半监督学习在自动语音识别(ASR)任务上已展现出卓越性能,但在其他语音与音频处理任务(例如语音情感识别、说话人识别、语种识别以及声学场景识别)方面的尝试仍较为有限。

语音与音频领域的自监督学习旨在从声学信号中提取高层次信息,以构建可用于多种下游任务的通用表征。通过自监督方式学习到的模型权重,通常有两种使用方式:一是在线性评估协议下作为特征提取器(Niizumi 等,2021;Ling 和 Liu,2020);二是结合迁移学习,在下游任务中进行端到端微调,并附加一个预测头(Chen 等,2020;Baevski 等,2020;Hsu 等,2021)。已有研究表明,通过自监督语音表征学习获得的特征,其性能已优于传统的低层特征(如滤波器组和梅尔频率倒谱系数 MFCCs)。

过去,在学习适用于多种下游任务(不仅限于语音识别)的通用音频表征方面,相关研究较为有限,且现有方法存在诸多不足。例如,Jansen 等(2018)和 Shor 等(2020a)所采用的基于三元组(triplet-based)的目标函数依赖于负样本挖掘,而所学特征的质量对样本生成策略高度敏感(Shor 等,2020a)。Saeed、Grangier 和 Zeghidour(2020)提出的对比学习系统通常在线运行,需要大量显式的成对特征比较,计算开销大,且依赖大批量数据以有效挖掘负样本。此外,Baevski 等(2020)指出,负样本挖掘的质量会显著影响模型性能。

另一方面,Niizumi 等(2021)提出的方法采用动量编码器(momentum encoder),即利用一个滑动平均网络为同一音频片段的两组增强样本生成预测目标,并优化二者之间的均方误差(MSE)损失。然而,该方法依赖于非对称的网络设计(symmetry-breaking network design)才能有效工作。Chen 和 He(2020)也指出,在此类学习范式中,更新过程中的非对称性(例如"stop-gradient"操作)对于防止平凡解至关重要。此外,引入独立的教师网络也使训练所需的参数量翻倍。

此前该领域的研究普遍依赖大规模数据集和大型模型进行 SSL 预训练。然而,正如 Hannun(2021)所指出的,自监督学习的主要挑战在于规模问题,从而限制了其可及性。因此,若能使用更轻量级的模型,并在更少数据上高效训练,将显著提升自监督方法的普及性。此外,许多现有方法还利用音频信号的时间序列特性,即假设时间上邻近裁剪的音频片段应具有相近的表征,而时间距离较远的片段则应具有差异较大的表征。但 Niizumi 等(2021)通过音乐与枪声等反例指出,这种策略并非在所有情况下都是最优的。

本文提出 DeLoRes(Decorrelating Latent Spaces for Low Resource Audio Representation Learning)------一种简单而强大的自监督预训练框架,用于学习涵盖语音及其他声音类型的通用音频表征。受 Barlow Twins 框架(Zbontar 等,2021)启发,我们采用一种基于不变性与冗余度降低的目标函数:对同一音频片段的两个增强版本分别提取嵌入向量,计算其互相关矩阵,并使其尽可能接近单位矩阵。这一思想非常契合声学领域,因为在声学中互相关常被用于衡量两个时移信号之间的相关性。

与现有自监督音频预训练方法相比,我们的方法在概念上更为简洁,并通过其内在构造天然避免了平凡解。我们不再需要像 Saeed 等(2020)那样依赖大批量训练,也不再像 Niizumi 等(2021)那样依赖额外的教师网络和破坏对称性的网络设计;同时避免了 Jansen 等(2018)对负样本挖掘所需精心设计的样本生成策略的依赖,也规避了 Ghosh 等(2021)方法中可能出现的退化解问题。

我们在 9 个具有挑战性且多样化的下游任务(包括语音、音乐和动物声音)上验证了 DeLoRes 的有效性。预训练阶段,我们仅使用大规模 AudioSet 数据集(Gemmeke 等,2017)的 10% 子集,并采用比以往工作小得多的模型架构。实验表明,仅在 DeLoRes 嵌入之上训练一个线性分类器,其性能即可与当前最先进的通用音频表征学习算法相媲美,且在数据量和计算资源消耗方面显著低于这些方法。

相关工作

近年来,应用于无标签数据的自监督学习(SSL)已被证明非常有效,当与迁移学习结合用于各类低资源下游任务时(涵盖文本、图像和语音等多种模态),能达到最先进的性能表现。在仅允许针对特定下游任务在SSL学习到的表征之上训练线性层的线性评估协议下,该方法也实现了显著性能提升或接近最先进的成果。

已展现巨大成功的SSL算法包括对比学习的变体、掩码预测、聚类,或采用多种目标函数优化的动量编码器。一个简单而强大的思想是通过比较图像表征对,将不同图像的表示推远,同时拉近同一图像经变换或不同视角得到的表示。Chen等人(2020)首次在计算机视觉中提出该框架,建议将同一图像的不同增强版本作为正样本对,批次中其他图像作为负样本对来计算对比损失。

近期非对比式SSL方法包括Chen和He(2020)以及Grill等人(2020),二者通过修改网络架构和参数更新引入不对称性。网络架构的不对称性通过特定"预测器"网络实现,参数更新的不对称性体现在模型参数仅使用输入的一个扭曲版本更新,而另一个扭曲版本的表征作为固定目标。

另一研究方向中,Caron等人(2019)等聚类方法提出从一个视图计算"伪标签",并用同一图像的另一个视图预测聚类分配。类似地,Caron等人(2021)与Asano等人(2020)提出使用不可微算子。Caron等人(2021)部分受对比学习启发,提出交换聚类预测问题,即尝试从一个视图预测另一个视图的聚类分配,并使用交叉熵损失优化网络。

解决掩码预测任务的SSL在文本领域以掩码语言建模(MLM)、在语音领域以掩码声学建模(MAM)形式广泛存在。这些方法大多旨在通过分类目标预测掩码实体类别(如Hsu等人2021;Devlin等人2019),或重构原始帧(如Liu等人2020;Liu等人2021),或强制网络对掩码帧的预测与原始掩码帧的量化表示间相似(如Baevski等人2020)。

无监督音频表征领域的先前工作多样,例如L3(Arandjelović和Zisserman 2017)、AuDeep(Freitag等人2017)、自回归预测编码(Chung和Glass 2020)、对比预测编码(van den Oord等人2019)、度量学习(Jansen等人2018)、自编码(Latif等人2020)。但这些方法仅在一个或有限下游任务上评估。TRILL(Shor等人2020b)即三重损失网络,是首批在多样化下游任务上测试学习表征的工作之一,通过基于三重态的目标函数使时间相近的音频段在嵌入空间中也更接近。

COLA(Saeed等人2020)通过解决对比任务学习通用音频表征,性能超越该领域先前工作。其采用类似TRILL的挖掘策略,从相同音频样本分段生成相似对,不同样本生成负样本,并证明余弦和双线性相似性两种目标函数的有效性,以及大批量有助于学习更好表征。

BYOL-A(Niizumi等人2021)则提出不使用负样本,直接最小化源自同一音频段经数据增强产生嵌入的均方误差,且不同于先前工作从单一音频段学习表征而不考虑时间片段间关系。

最近,DECAR(Ghosh等人2021)基于CV中的Deepcluster框架提出聚类方法学习通用音频表征,其预训练包含两次前向传播:先聚类特征提取网络输出,再将聚类分配作为同一音频样本增强版本的伪标签,第二次传播时通过伪标签与增强样本预测间的损失优化网络。

受最初为文本处理设计但在图像和语音领域也大获成功的Transformer启发,Gong等人(2021)提出SSAST------音频频谱图Transformer(AST)的自监督预训练策略。AST是首个无卷积、纯注意力机制的音频分类模型。SSAST联合优化判别式和生成式掩码频谱块建模(MSPM)目标,加权求和InfoNCE损失和均方误差。

对比学习需要大批量和负样本精心挖掘,而非对比SSL在CV和音频领域的共性问题是通过特定实现选择避免目标函数的平凡解,或依赖非平凡学习动态。最近提出的Barlow Twins以其概念更简单、构造本质避免陷阱的新损失函数独树一帜。与其他方法类似,它处理同一图像的不同增强视图,但计算这些视图批次输入网络嵌入的互相关矩阵,并使其尽可能接近单位矩阵。本文方法受Barlow Twins框架启发。

方法论

DeLoRes架构

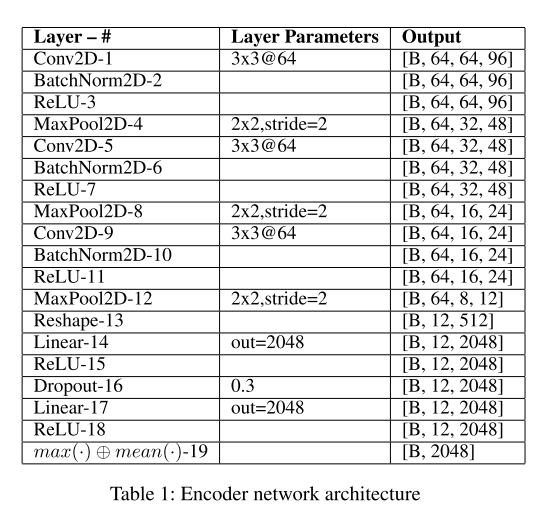

SSL预训练使用基于卷积的特征编码器,学习权重迁移至下游任务。实验了多种ConvNet架构,包括先前工作常用的高效可扩展EfficientNet-B0(Saeed等人2020;Ghosh等人2021),但采用DCASE 2020挑战赛任务6解决方案的更简单架构(Koizumi等人2020;Takeuchi等人2020)效果更佳。该架构不仅更简单,且在与目标任务相关的挑战中表现良好,Niizumi等人(2021)也用于SSL预训练。

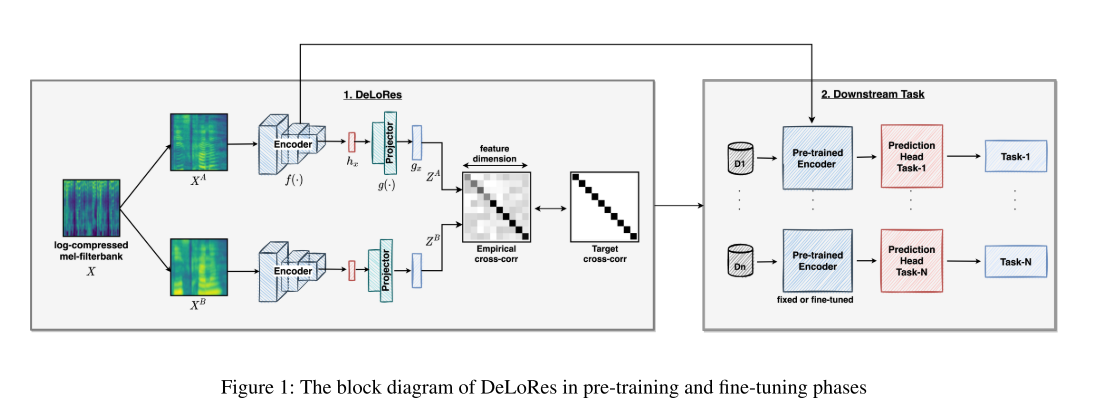

网络架构包含三个Conv2D层,每层后接BatchNormalization、ReLU激活和MaxPool2D层。最后通过一组线性层(每层后接ReLU和Dropout)处理嵌入。SSL预训练阶段的投影头采用两个线性层(首个后接BatchNorm1D和ReLU),在投影头与编码器输出间添加Dropout层正则化,最终嵌入经BatchNormalization转为零均值单位方差。投影头单元数是可调参数,影响方程(4)定义的互相关矩阵C大小。如图1所示,投影头仅用于SSL预训练后即丢弃。层细节见表1。

DeLoRes学习算法

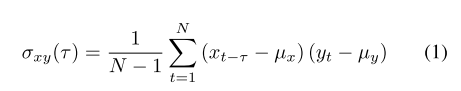

协方差与互相关 给定两个时间序列xt和yt,每个序列包含N个样本,其中t为时间索引,xt−τ表示xt延迟τ个样本后的版本。这对信号之间的互协方差矩阵可计算如下:

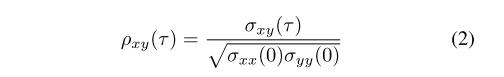

式中μx和μy分别为xt和yt的均值。通过归一化方程(1),可计算两信号的互相关系数:

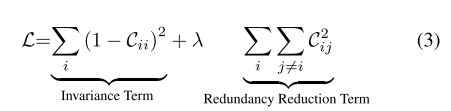

目标函数 我们采用Barlow Twins目标函数(Zbontar等人2021年提出),其定义如方程(3)所示,用于优化我们的网络

不变性项

冗余减少项

其中C由公式(4)定义。目标函数的不变性项试图使互相关矩阵的对角线元素接近1 ,直观上使嵌入对应用的失真保持不变。冗余减少项由一个正常数λ加权,对互相关的非对角线元素求和并试图使其接近0。直观上,这种去相关减少了输出嵌入之间的冗余,使其仅包含样本的非冗余信息并保留有用信息。

Barlow Twins目标函数计算一对经过不同增强的音频样本通过编码器输出获得的两个嵌入之间的互相关矩阵,并试图使其尽可能接近单位矩阵。

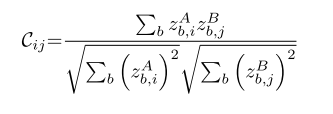

学习框架 图1展示了完整的端到端预训练和微调流程。对于一批音频样本,我们首先从每个样本中随机截取980毫秒的片段x,然后提取每个样本的对数压缩梅尔滤波器组。接着将这些样本分批得到X,并通过应用不同的增强K为批次中的每个样本创建两个增强视图XA和XB。随后使用ConvNet特征编码器f获得嵌入批次ZA和ZB。这些输出用于计算互相关矩阵C,其中矩阵中的每个元素沿批次维度由公式(4)计算得出:

其中,b代表批次样本的索引,i和j代表嵌入向量的维度索引,C的取值范围在-1到1之间。虽然(Zbontar等人,2021年)展示了损失函数的设计如何受到信息瓶颈理论的启发,但(Tsai等人,2021年)对为何巴洛双胞胎方法也可被称为无负样本对比学习提供了精彩的解释。这一解释超出了本文的讨论范围,我们建议读者直接参考这些论文以获取更详细的信息。

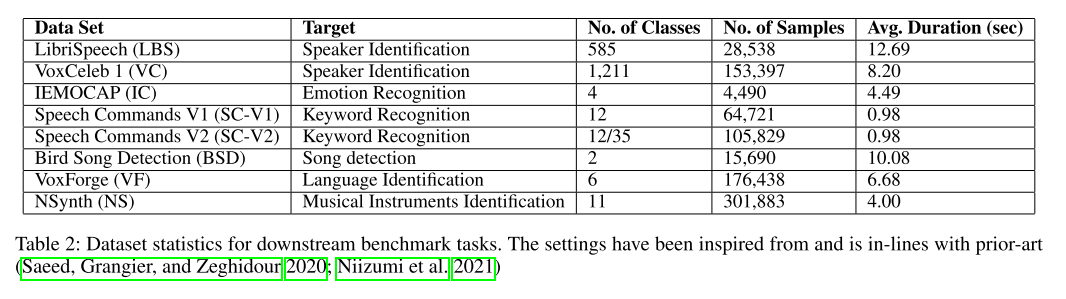

数据集

AudioSet的所有文件并非直接可供下载,需要手动从YouTube视频中截取。此外,随着时间的推移,许多这类视频已被YouTube下架。因此,先前基于完整200万条AudioSet语料进行预训练所报告的结果,可能无法被其他独立研究者复现。

• 正如(Hannun 2021)所指出的,若采用更轻量级的模型(只需较少数据即可高效训练),语音和音频的自监督学习将更易于小型实验室开展。因此,与领域内现有技术不同,我们希望在较小规模的预训练数据集配置下比较系统性能。

在下游任务中,我们通过多样化音频任务测试所学嵌入表示的有效性。为增强多样性并检验泛化能力,我们混合选择了语音与非语音任务:

- 说话人识别:采用两个常用数据集LibriSpeech(LBS)(Panayotov等2015)和VoxCeleb(Nagrani等2017)

- 关键词检测:使用Google语音命令V1(SC)和V2数据集(Warden 2018),该数据集在现有技术中有多种标签配置,我们实验采用12标签和35标签两种配置

- 语音分类:在IEMOCAP数据集(Busso等2008)上进行语音情感分类,在Voxforge数据集(Voxforge.org 2014)上进行语种识别

- 非语音声学信号分类 :实验采用三个常用数据集

- 鸟类鸣叫检测(Stowell等2019):二分类任务,判断音频片段是否包含鸟鸣

- 音乐分类:使用NSynth数据集(Engel等2017),包含不同乐器的音符样本

实现细节

数据增强策略

正如(Zbontar等人2021年)所指出的,Barlow Twins目标函数对用于计算并优化交叉相关矩阵的样本对之间的数据增强方法非常敏感。本节将详细描述在输入编码器网络前,对双胞胎批次数据应用的多种增强操作K。我们借鉴了(Niizumi等人2021年)的思路,实现了一个标准化步骤,随后依次进行混音增强和随机尺寸裁剪模块,下文将具体阐述。

标准化处理

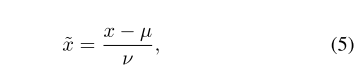

我们对梅尔频谱图x进行标准化:

其中μ和ν分别代表训练样本的均值与标准差。

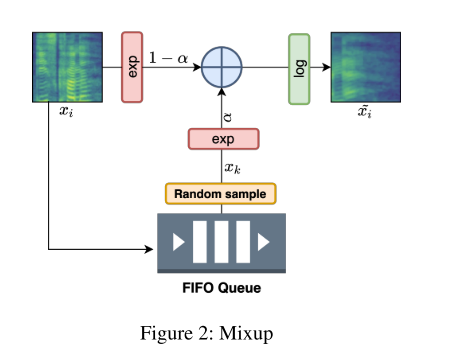

混音增强(Mixup)

混音增强作为一种数据增强方案,在计算机视觉(CV)的监督学习中已展现显著成效(Zhang等人2018年)。该团队首次将其应用于自监督学习(SSL)环境下的音频预训练任务,实验表明,使用混音增强相比未使用时性能提升显著(在线性评估协议下的5项下游任务中平均性能下降8.4%)。

混音的核心功能是以较小比例混合随机选取的历史批次输入音频(xₖ),作为最终混合音频(x̃ᵢ)的背景声。这种机制能帮助模型学习对噪声不变的嵌入表示。

我们采用与(Niizumi等人2021年)相似的设定,仅使用音频特征(而非原始论文(Zhang等人2018年)提出的音频与标签混合),因为SSL环境下缺乏标签数据。由于音频在通过增强模块前需进行对数缩放,因此在混音前需转换为线性尺度,完成后再转回对数尺度。我们维护了一个容量为2048的FIFO队列存储历史输入,从中随机选取频谱图进行混音。

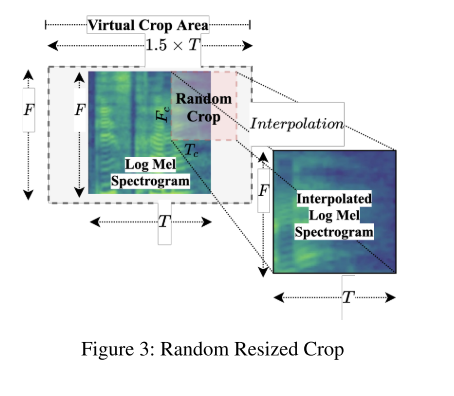

随机尺寸裁剪(RRC)

随机尺寸裁剪是CV领域监督与半监督学习中最常用的图像增强方法之一。与混音不同,RRC无需标签支持。其核心原理是随机裁剪图像部分区域并调整至指定尺寸。多数SSL算法均采用该技术(Chen等人2020年;Caron等人2021年;Zbontar等人2021年),特别是(Zbontar等人2021年)的研究表明,禁用RRC会导致性能显著下降。

当它们未使用该技术时。本文中,我们采用了一种与计算机视觉领域原始随机裁剪(RRC)功能高度相似的RRC应用方式。为适配音频领域,我们借鉴了(Niizumi等人,2021)的研究思路。

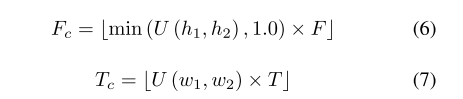

输入频谱图包含F个频率仓和T个时间帧。首先,我们从虚拟裁剪边界中随机选取比原始输入更长的时间帧(即1.5×T)作为裁剪区域。裁剪区域尺寸通过以下方式随机生成:

实验设置

给定音频输入序列,我们提取对数压缩的梅尔滤波器组,其窗口大小为64毫秒,步长为10毫秒,并在60至7800赫兹范围内设置N=64个梅尔间隔频率仓。如前所述,在预训练阶段,我们从AudioSet(原始时长为10秒每条)中随机截取一小段音频片段。这种做法与该领域先前的研究一致(Saeed, Grangier, and Zeghidour 2020; Niizumi et al. 2021)。在我们的预训练配置中,采用T=96帧,对应1024秒时长。对于下游任务,帧数T取决于各数据集平均时长(例如LibriSpeech为12.69秒,IEMOCAP为4.49秒)。

卷积神经网络编码器选用嵌入维度hx∈R²⁰⁴⁸。预训练时,hx通过一组线性层g(又称投影头)处理,该结构包含两个全连接层(每层8192个单元),输出gx∈R⁸¹⁹²,后接批归一化层使嵌入呈零均值单位方差。下游任务训练与推理时,预训练后弃用g,替换为与任务类别数相等的单线性层。

采用自监督学习进行100轮预训练,优化方案参照(Zbontar et al. 2021; Grill et al. 2020)。使用LARS优化器(You, Gitman, and Ginsburg 2017),批量大小为1024。但(Zbontar et al. 2021)指出Barlow Twins损失函数在小批量下表现亦佳。

如(Zbontar et al. 2021)所述,权重学习率设为0.2,偏置0.0048。学习率乘以批量大小后除以256。采用10轮学习率预热期,之后学习率降至千分之一并应用余弦衰减策略(Loshchilov and Hutter 2017)。损失函数权衡参数λ设为0.0051。

下游任务均采用Adam优化器,学习率10⁻³,批量模式训练(批量64),最多100轮。本工作多数超参数设置沿袭原实现(Zbontar et al. 2021)。

结果

线性评估协议

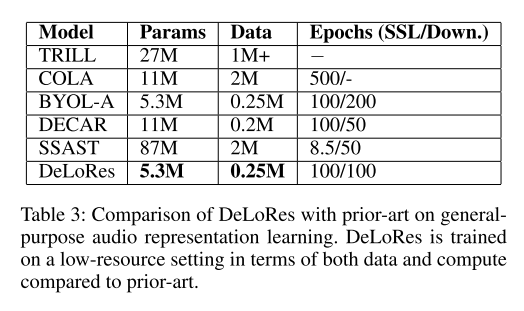

我们比较了DeLoRes嵌入在9个具有挑战性和多样性的下游任务中的有效性。表4报告了与其他最先进方法在线性评估协议上的比较,其中仅针对DeLoRes嵌入训练特定下游任务的线性层。

尽管我们的架构较小且预训练数据较少,我们在该领域仍与其他先前工作具有竞争力。

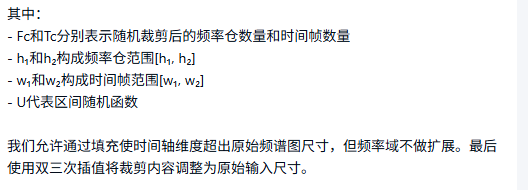

表3:DeLoRes与先前通用音频表示学习方法的比较。与先前方法相比,DeLoRes在数据和计算资源较低的情况下进行训练。

表4:线性评估协议设置的结果比较。除DeLoRes外,其他方法的结果均来自文献。"--"表示这些方法未报告这些任务的结果。

除BYOL-A外,其他方法均在线性评估协议中表现优异,BYOL-A作为当前最先进方法,在5个任务中表现最佳,如表4所示。BYOL-A使用了比我们多10倍的数据进行自监督学习预训练,参数数量是我们的两倍(因为有教师网络),并进行了400轮预训练,是我们的4倍。

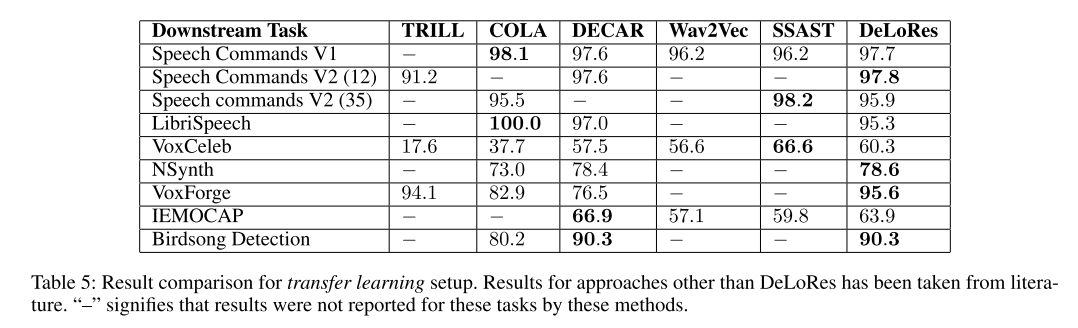

迁移学习设置

表5报告了与其他最先进方法在迁移学习设置上的比较,其中所有模型权重在下游任务上端到端微调。尽管这种比较可能不公平,因为更大的模型架构可能比我们的模型更好地学习任务特定特征,但类似于线性评估协议,我们的实验表明,DeLoRes在通用音频表示学习空间中,在9个任务中的5个任务上优于其他方法,而在其他4个任务中略微落后。

低资源设置

表3显示了其他自监督学习预训练任务与我们提出的方法在模型大小、训练时间(轮次数)和用于自监督学习的总数据量(AudioSet样本数)上的比较。我们声称我们的训练是低资源的有三个主要原因:

- 与先前工作相比,我们仅使用了一小部分预训练数据。自监督学习已知受益于大量数据。

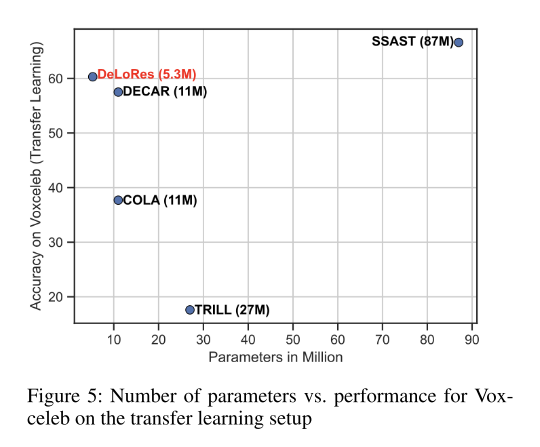

- 我们的架构使用最少的编码器参数进行无标签音频的自监督学习。BYOL-A虽然使用与我们相同的网络,但使用了额外的教师网络,使训练参数数量翻倍。图5以图示形式展示了这一点。

- 与先前方法相比,我们预训练的轮次数少得多。我们的模型在100轮内收敛。

结果分析

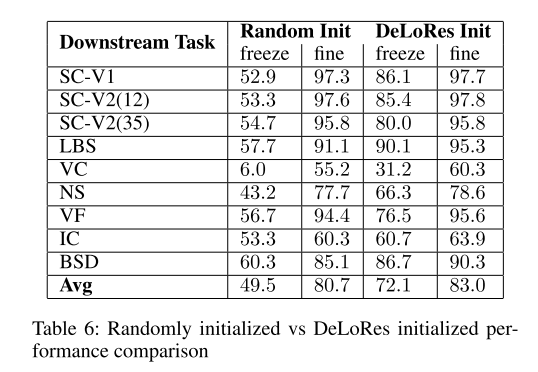

如表6所示,与随机初始化的嵌入相比,使用DeLoRes嵌入带来了显著的性能提升。这清楚地表明,我们的预训练步骤学习了强大的表示。表6选择的任务均具有比我们总预训练数据更少的训练样本。

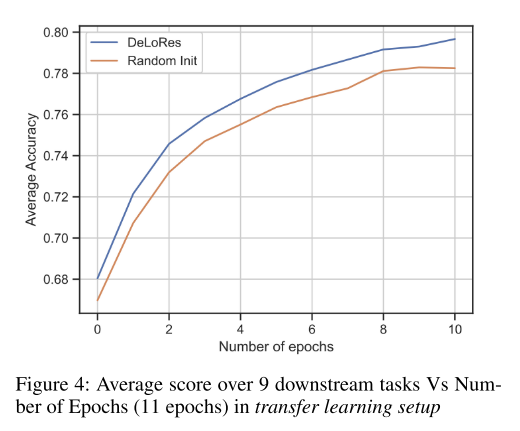

此外,我们在图4中看到,我们的模型在第一个轮次就达到了更高的准确率,并在后续轮次中进一步提升。基于自监督学习的预训练使模型训练更快、更好。

结论

本文提出了一种通过自监督学习结合不变性与冗余缩减框架来学习通用音频表征的新方法。DeLoRes本质上结构简单,其重构特性自然规避了平凡解。我们还证明了在低资源(数据与算力)环境下仍能学习到优质表征。该模型在线性评估中表现优异,经端到端微调后性能更为突出。未来工作包括:延长预训练周期以观察性能提升,分析不同超参数调整的影响,以及探究方法对各类数据增强的敏感性。在论文后续版本中,我们计划推出LAPE基准测试------包含11项多样化下游任务的音频表征综合评估体系,并展示DeLoRes-M模型在LAPE中11项任务里9项达到业界领先水平。