一 Model I/O之调用模型

LangChain作为一个"工具",不提供任何 LLMs,而是依赖于第三方集成各种大模型。比如,将

OpenAI、Anthropic、Hugging Face 、LlaMA、阿里Qwen、ChatGLM等平台的模型无缝接入到你的应用。

角度1:按照模型功能的不同:

非对话模型(LLMs、Text Model)

对话模型(Chat Models)( 推荐)

嵌入模型(Embedding Models)( 暂不考虑)

角度2:模型调用时,几个重要参数的书写位置的不同:

硬编码:写在代码文件中

使用环境变量

使用配置文件( 推荐)

角度3:具体调用的API

OpenAI提供的API

其它大模型自家提供的API

LangChain的统一方式调用API( 推荐)

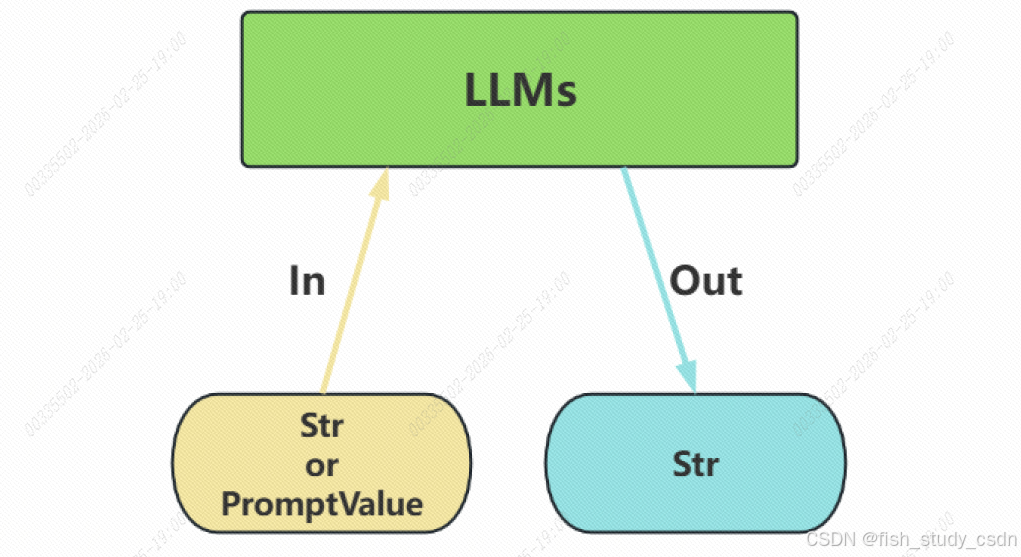

类型1:LLMs(非对话模型)

LLMs,也叫Text Model、非对话模型,是许多语言模型应用程序的支柱。主要特点如下:

输入:接受文本字符串或PromptValue 对象

输出:总是返回文本字符串

1) 适用场景:仅需单次文本生成任务(如摘要生成、翻译、代码生成、单次问答)或对接不支持消息

2) 结构的旧模型(如部分本地部署模型)( 言外之意,优先推荐ChatModel )

不支持多轮对话上下文。每次调用独立处理输入,无法自动关联历史对话(需手动拼接历史文

本)。

3) 局限性:无法处理角色分工或复杂对话逻辑。

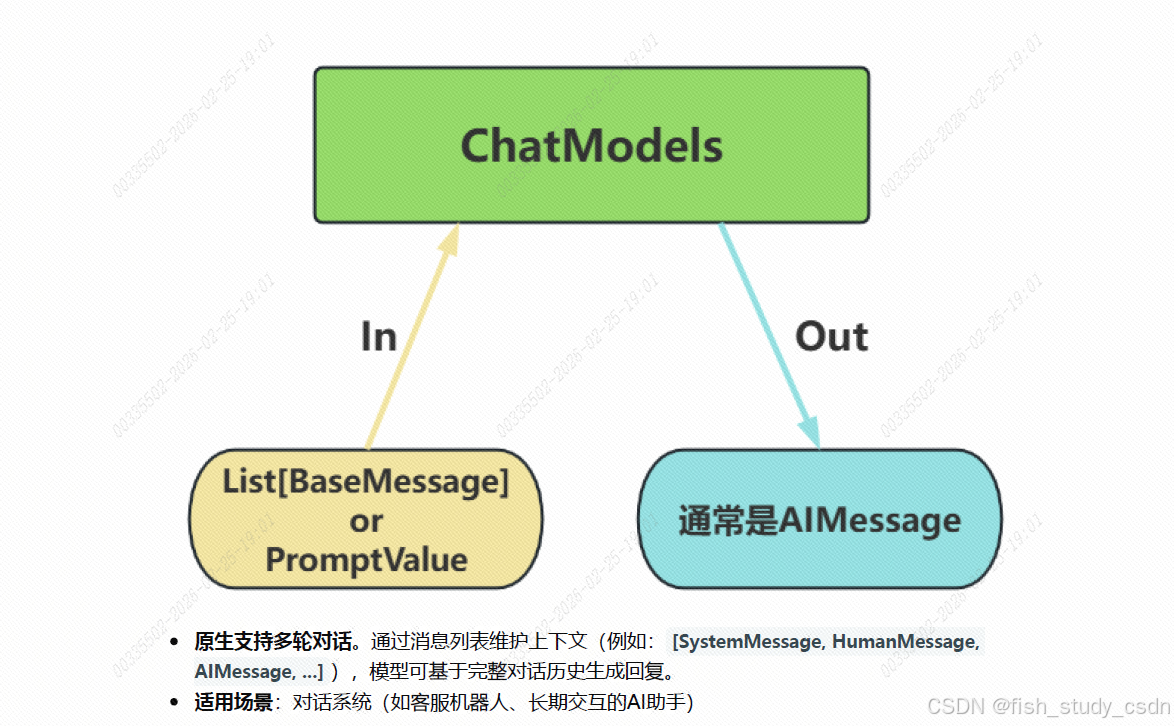

类型2:Chat Models(对话模型)

ChatModels,也叫聊天模型、对话模型,底层使用LLMs。

大语言模型调用,以 ChatModel 为主!

主要特点如下:

输入:接收消息列表ListBaseMessage 或PromptValue ,每条消息需指定角色(如

SystemMessage、HumanMessage、AIMessage)

输出:总是返回带角色的消息对象( BaseMessage 子类),通常是AIMessage