气体泄漏是化工安全的重大隐患,但传统方法只能从单张红外图像逐帧分析。犹他州立大学联合洛斯阿拉莫斯国家实验室,尝试用NeRF把多张红外高光谱图像融合成3D场景,然后从任意新角度检测气体。结果:30张训练图像就能达到AUC 0.821。

数据:DIRSIG合成LWIR HSI,128通道(7.8-13.4µm),SF6气体,231张图像

核心指标(30张训练图像) :PSNR 39.6dB,气体检测AUC 0.821,检出率55.7%,误报率0.3%

一个真实的安全痛点

化工厂、炼油厂、天然气管道------这些设施最怕什么?气体泄漏。

很多有毒有害气体肉眼看不到、鼻子闻不到,等发现时往往已经酿成事故。怎么在泄漏早期就发现它?

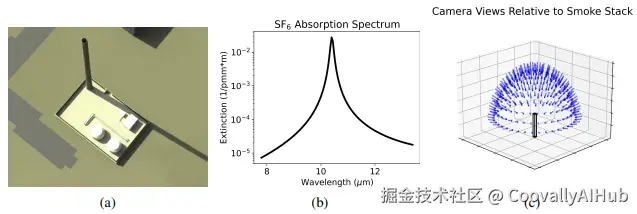

目前的主流方法是用长波红外高光谱相机。原理很直观:很多气体在红外波段有独特的"吸收指纹"------特定波长的光穿过气体时会被吸收,形成一个可被检测的光谱特征。通过分析图像中每个像素的光谱,就能判断哪些地方可能有气体。

但这个方法有一个根本局限:每次只能从一个角度看一张图。

你站在A点拍了一张,能看到气体羽流的正面;但它的侧面长什么样?它在空间中占多大体积?它飘向了哪个方向?------这些问题,一张2D图像回答不了。

如果能把从不同角度拍的多张红外图像,融合成一个3D场景,是不是就能从任意角度去理解气体泄漏了?

犹他州立大学和洛斯阿拉莫斯国家实验室(美国从事国家安全科研的顶级机构之一)刚发表的一篇论文,做的就是这件事。

用NeRF"看见"红外光中的气体

NeRF(Neural Radiance Fields,神经辐射场)是近年来3D重建领域最热门的技术之一。简单说,它能从一组不同角度的照片中,学习出一个3D场景的隐式表示,然后从任意新角度渲染出逼真的图像。

但标准NeRF有两个前提:输入是RGB三通道图像,且场景中的物体对所有颜色都"可见"。

气体泄漏场景完全不满足这两个前提:

- 不是RGB,是128个通道。 本文使用的红外高光谱相机有128个光谱通道,覆盖7.8-13.4µm波段

- 气体不是在所有波长都能被看到。 SF6气体在10.5µm附近有强吸收------在这些波长它是"可见的";在其他波长它几乎完全透明

要让NeRF处理这种数据,需要做四个关键改动。

改动一:给每个波长一个独立的"密度"

标准NeRF给空间中每个点分配一个密度值------要么有东西要么没有。但气体不是这样的:在吸收波长它"存在",在其他波长它"不存在"。

论文的做法是让NeRF为每个空间点输出128个密度值,每个光谱通道一个。这样模型就能学到:"这个位置在10.5µm波长有高密度(有气体),在8µm波长密度为零(气体透明)。"

改动二:在没见过的角度上做"几何约束"

红外图像拍摄成本高,数量有限。当训练图像很少时,NeRF很容易在没见过的角度上产生"幻觉"------生成不合理的几何形状。

论文采用了RegNeRF的方法:随机生成一些训练集中不存在的虚拟视角,要求这些视角上的渲染深度是"分段平滑"的。相当于告诉模型:"你没见过这个角度,但场景不应该长得奇形怪状。"

改动三:不只管亮度对不对,还管光谱形状对不对

标准NeRF的损失函数只比较渲染亮度和真实亮度的差异(L2损失)。但气体检测依赖的是光谱形状------128个通道之间的相对关系。

论文增加了一个"光谱角"损失(SAM),衡量渲染光谱和真实光谱之间的角度。打个比方:L2管"每门课考了多少分",SAM管"各科分数的比例关系是否一致"。

改动四:哪个波长学得差,就给它加权------自适应加权损失

这是论文的原创贡献。他们发现模型在某些波长总是学不好------而这些波长恰好对应气体的吸收波段。

解决方案很直觉:每隔5000次训练迭代,统计每个通道的平均误差,误差越大的通道给越高的权重。模型会自动把更多"注意力"分给难学的波长。

巧妙的地方在于:这个方法不需要预先知道是什么气体------它完全基于模型自身的残差来自适应调整。

实验结果:30张图是个关键转折点

先说一个重要前提:本文的所有实验使用的是合成数据------由物理仿真软件DIRSIG生成,不是真实拍摄。论文对此很坦诚:目前不存在公开的多视角红外高光谱气体数据集,这也是该领域的一个共同瓶颈。

实验场景是一个简单的模拟设施:烟囱、道路、建筑,加上SF6(六氟化硫)气体羽流。共231张图像从半球形位置拍摄,测试了20、30、40、50、75、100张训练图像的效果。

图像重建

| 训练图像数 | 标准Mip-NeRF | 本文方法 |

|---|---|---|

| 20张 | PSNR 33.7 | PSNR 36.7 |

| 30张 | PSNR 34.5 | PSNR 39.6 |

| 100张 | PSNR 45.1 | PSNR 47.1 |

一个直观的比较:本文方法用20张图达到的效果,标准Mip-NeRF需要50张图才能达到。 训练图像需求减半。

气体检测

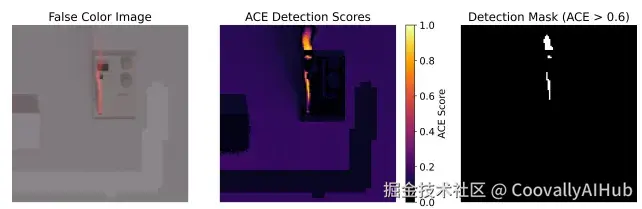

在渲染的新视角图像上用ACE检测器检测SF6气体,结果:

| 训练图像数 | 标准Mip-NeRF AUC | 本文方法 AUC | 本文方法检出率(TPR) |

|---|---|---|---|

| 20张 | 0.588 | 0.615 | 21.4% |

| 30张 | 0.638 | 0.821 | 55.7% |

| 50张 | 0.832 | 0.913 | 70.5% |

| 100张 | 0.949 | 0.987 | 86.5% |

30张图是关键转折点:AUC从0.615跳到0.821,检出率从21.4%跳到55.7%。20张时两种方法表现都有限,超过50张差距开始缩小。

误报率(FPR)在所有情况下都低于1%------几乎没有"把不是气体的地方认成气体"的情况。

需要客观看待的数字

检出率55.7%意味着近一半气体像素被漏掉了。 论文指出,NeRF倾向于低估羽流边缘区域------渲染出的羽流体积比真实的偏小。即使在100张训练图像下,检出率也只有86.5%。

另外,不同随机采样之间的性能波动较大。 同样是20张训练图像,不同采样的AUC在0.505到0.741之间波动。在稀疏视角下,哪几张图被选进训练集,对最终结果有显著影响。

为什么这篇论文仍然值得关注

尽管有上述局限,这篇论文打开了一个值得关注的方向:NeRF不只是"渲染好看的3D场景"的工具,它可以学习人眼看不到的物理性质。

从RGB三通道到128通道LWIR高光谱,从渲染可见光图像到在渲染图上检测气体------这是NeRF应用范围的一次实质性扩展。

几个具体的技术启发:

- 自适应加权损失(AWL2) :根据模型残差动态调权的思路,适用于任何多通道NeRF任务

- 多通道密度:当不同波长下物体"可见性"不同时(气体、半透明材料等),比单一密度场更合理

- RegNeRF几何正则化在稀疏视角下的增益:对"图像数量有限"的实际应用场景有直接参考价值

下一步的关键是:能否获取真实的多视角LWIR HSI数据来验证?以及能否推广到更复杂的场景和更多种类的气体?论文将这些留作了未来工作。

Coovally AI Hub | 以国际视角解读全球AI前沿------从顶会论文、开源实战到中外企业落地案例,帮你技术进阶与商业破圈。