文章目录

- [Attention Is All You Need](#Attention Is All You Need)

-

- Abstract

- Introduction

- Background

- [Model Architecture](#Model Architecture)

Attention Is All You Need

背景:共同第一作者,作者顺序随机。

Jakob提出用自注意力机制替代循环神经网络,并率先推动这一构想的验证工作。Ashish与Illia共同设计实现了最初的Transformer模型,并深度参与了本研究的各个环节。Noam提出了缩放点积注意力、多头注意力机制及无参数位置表示方法,成为另一位参与几乎所有技术细节的研究者。Niki在我们最初的代码库和tensor2tensor框架中设计、实现、调优并评估了无数模型变体。Llion同样尝试了新型模型变体,负责维护初始代码库,并实现了高效推理与可视化功能。Lukasz和Aidan投入大量时日设计并实现tensor2tensor的各个模块,以此取代原有代码库,显著提升了研究成果并极大加速了研究进程。

†在Google Brain工作期间完成的研究。

‡在Google Research工作期间完成的研究。

Abstract

The dominant sequence transduction models are based on complex recurrent or convolutional neural networks that include an encoder and a decoder. The best performing models also connect the encoder and decoder through an attention mechanism.

主流的序列转换模型基于复杂的循环神经网络或卷积神经网络,通常包含编码器和解码器。性能最佳的模型还通过注意力机制连接编码器和解码器。

【解析】sequence transduction:序列转换:是机器学习中的一个核心任务,读取一个序列的数据,并生成另一个序列的数据。如:复制输入文献翻译并讲解。

We propose a new simple network architecture, the Transformer, based solely on attention mechanisms, dispensing with recurrence and convolutions entirely. Experiments on two machine translation tasks show these models to be superior in quality while being more parallelizable and requiring significantly less time to train.

我们提出了一种新的简单网络架构------Transformer,完全基于注意力机制,完全摒弃了循环和卷积。在两个机器翻译任务上的实验表明,这些模型在质量上更优越,同时具有更好的并行性,训练时间显著减少。

Our odel achieves 28.4 BLEU on the WMT 2014 English-to-German ranslation task, improving over the existing best results, including ensembles, by over 2 BLEU. On the WMT 2014 English-to-French translation task, our model establishes a new single-model state-of-the-art BLEU score of 41.8 after training for 3.5 days on eight GPUs, a small fraction of the training costs of the best models from the literature. We show that the Transformer generalizes well to other tasks by applying it successfully to English constituency parsing both with large and limited training data.

我们的模型在WMT 2014英语-德语翻译任务上取得了28.4 BLEU值,将现有最佳结果(包括集成模型)提升了超过2个BLEU点。在WMT 2014英语-法语翻译任务上,我们的模型在8块GPU上训练3.5天后,以41.8的BLEU分数创下了新的单模型最先进水平,其训练成本仅为文献中最佳模型的极小一部分。我们通过将Transformer成功应用于英语成分句法分析任务(涵盖大规模和有限训练数据两种情况),证明该架构能够很好地泛化到其他任务。

【解析】:

- BLEU:双语评估替补指标,是机器翻译中最常用的自动评估指标,通过比较模型输出与多个参考译文的 n-gram 重合度来计算,其取值范围为 0~100,当年 28.4与41.8 都是非常高的分数。

- n-gram:指的是文本中连续的 N 个项。这里的"项"(gram)通常指的是字、词或字符。

当 N=1 时,叫 Unigram(一元语法),也就是单个的词。

当 N=2 时,叫 Bigram(二元语法),也就是连续的两个词。

当 N=3 时,叫 Trigram(三元语法),也就是连续的三个词。 - WMT 2014是14年一个国际翻译比赛给出的数据集,英--->德 和 英--->法 是两个经典高难度翻译任务。

直观的例子:

假设有一句话:"我今天去公园"。

Unigrams (1-gram):"我", "今天", "去", "公园" (4个)

Bigrams (2-gram):"我今天", "今天去", "去公园" (3个)

Trigrams (3-gram):"我今天去", "今天去公园" (2个)

可以看到,随着 N 增大,片段越来越长,捕捉的上下文信息也越来越多,但出现的频率通常会越来越低。

BLEU 分数,其核心计算思想就是比较模型翻译结果和人工参考翻译之间,这些 N-gram 片段的重合度。

BLEU 不仅仅是看单个词(1-gram)翻译得对不对(比如 "cat" 翻译成 "猫"),还要看词语搭配和语序是否流畅。它通过计算不同长度的 N-gram(通常是 1-gram 到 4-gram)的精确度,然后综合起来得到一个分数。

Introduction

Recurrent neural networks, long short-term memory 13 and gated recurrent 7 neural networks in particular, have been firmly established as state of the art approaches in sequence modeling and transduction problems such as language modeling and machine translation 35, 2, 5. Numerous efforts have since continued to push the boundaries of recurrent language models and encoder-decoder architectures 38, 24, 15.

循环神经网络,特别是长短期记忆网络13和门控循环神经网络7,已经被确立为序列建模和转换问题(如语言建模和机器翻译)的最先进方法35, 2, 5。此后,众多努力持续推动循环语言模型和编码器-解码器架构 的边界38, 24, 15。

【解析】:这段话介绍的是2017年深度学习的现状, 其实 这三个神经网络------RNN(循环神经网络)、LSTM(长短期记忆网络)和GRU(门控循环单元)------在2025年仍然被广泛使用,并且非常活跃。 虽然在大语言模型(LLM)和大部分自然语言处理(NLP)任务中,Transformer架构已经成为绝对的主流,但RNN及其变体凭借其独特的时序建模能力和计算效率,在特定领域不仅没有被淘汰,反而在不断演进和创新。

- RNN 的诞生就是为了处理这种序列数据。它的特点是:网络不仅会学习当前输入的信息,还会把一个"状态向量"(可以理解为对之前信息的记忆)传递给下一步。

【传统的神经网络(如全连接网络、CNN)假设输入之间是相互独立的。但是 现实中,我这段文字是依赖于先后顺序才能被你所完全理解的。】

但是RNN的缺陷是:

a. 短期记忆:在实际训练中,RNN 很难记住太久远之前的信息。

b. 梯度消失,爆炸,因为在反向传递中,由于更新的权重,其梯度会随时间推移,而指数级的衰减, 导致模型要么不能学习长距离的依赖关系,要么梯度爆炸。

h_t-1 是上一时刻的隐藏状态,x_t 为当前输入,两个W是权重矩阵。

-

LSTM(长短期记忆网络)是 RNN 的一种变体,专门设计用来解决 RNN 的长期依赖问题。它的核心创新在于引入了一个精妙的内部结构------"门",来控制信息的流动。

a. 遗忘门:查看当前输入与隐藏状态输入,然后给出1 与 0,决定是否丢弃

b. 输入门:决定将那些新的信息 加入 隐藏状态。

c. 输出门:决定基于当前的细胞状态,要输出什么信息。

并且引入了细胞状态:假设LSTM在阅读这句话:"我 出生 在 北京, 我 在 这里 长大。" 会记忆关键信息:"主语是我"、"地点是北京" 并将其存储至细胞状态中。

-

GRU(门控循环单元)是LSTM的变体,将LSTM的三个门简化为两个门

a. 更新门:输入门+遗忘门,决定要保留过去多少的记忆,以及要加入多少新信息,其值越大,保留信息越多。

b. 重置门:决定要忽略多少信息,

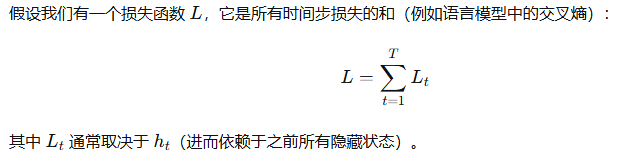

Recurrent models typically factor computation along the symbol positions of the input and output sequences. Aligning the positions to steps in computation time, they generate a sequence of hidden

states h_t, as a function of the previous hidden state h_t−1 and the input for position t. This inherently sequential nature precludes parallelization within training examples, which becomes critical at longer sequence lengths, as memory constraints limit batching across examples. Recent work has achieved significant improvements in computational efficiency through factorization tricks 21 and conditional computation 32, while also improving model performance in case of the latter. The fundamental

constraint of sequential computation, however, remains.

循环模型通常沿着输入和输出序列的符号位置进行计算分解。将位置与计算时间步骤对齐,它们生成一系列隐藏状态 h_t,作为前一个隐藏状态 h_t−1 和位置 t 处输入的函数。这种固有的顺序性质阻碍了训练样本内的并行化,这在较长序列长度时变得至关重要,因为内存约束限制了样本间的批处理。最近的工作通过分解技巧21和条件计算32在计算效率方面取得了显著改进,在后者的情况下还提高了模型性能。然而,顺序计算的基本约束仍然存在。

【解析】:这段话深入分析了RNN网络的核心问题,RNN计算公式要用到 h_t-1 前一时刻的隐藏状态,和 当前时刻的输入,所以 这种 对前一个状态的严格依赖,会导致不能进行并行计算,尤其是在处理长序列时,必须逐个依次计算。 这是 CPU 和 GPU、FPGA 的核心区别。

除此之外:由于内存限制,我们甚至无法同时处理多个训练样本(批处理大小必须 逐渐减小)。

分解技巧指:将大橘子分解为小矩阵

条件计算指:只激活网络的一部分来提高效率。

【小插曲:关于GPU与FPGA的差异:GPU是一种高度并行的冯诺依曼架构处理器,而FPGA其本质上则是可重构的硬件电路,GPU就是在CPU的基础上,将控制单元简化和ALU算术逻辑单元简化,可以一个指定调度器同时驱动多个ALU,遇到分支的时候,通过线程束来处理,而不是用CPU的复杂的分支预测。】

Attention mechanisms have become an integral part of compelling sequence modeling and transduction models in various tasks, allowing modeling of dependencies without regard to their distance in the input or output sequences 2, 19. In all but a few cases 27, however, such attention mechanisms are used in conjunction with a recurrent network.

注意力机制已成为各种任务中引人注目的序列建模和转换模型的组成部分,允许建模依赖关系而不是考虑它在输入或输出序列中的距离,然而,除了少数情况外,这些注意力机制是与循环网络结合使用的。

【解析】:RNN处理长序列,随着序列长度增加,早期信息会被遗忘,使得模型难以捕捉长距离的依赖关系。 注意力机制的核心思想是让模型在生成每个输出时,都能够"回头看"整个输入序列,并根据相关性给不同位置的输入分配不同的权重。这样,无论两个相关元素在序列中相距多远,模型都能够直接建立它们之间的联系,而不需要通过中间的许多步骤来传递信息。 但是在2017年之前,注意力机制几乎总是作为RNN的辅助组件出现,用来增强RNN的能力,而不是独立使用。

In this work we propose the Transformer, a model architecture eschewing recurrence and instead relying entirely on an attention mechanism to draw global dependencies between input and output. The Transformer allows for significantly more parallelization and can reach a new state of the art in translation quality after being trained for as little as twelve hours on eight P100 GPUs.

在这项工作中,我们提出了Transformer,一种避免循环并完全依赖注意力机制来获取输入和输出之间全局依赖关系的模型架构。Transformer允许显著更多的并行化,并且在八个P100 GPU上仅训练十二小时后就能在翻译质量上达到新的最先进水平。

Background

在深度学习的发展历程中,研究者们一直在寻找更好的序列建模方法。从最初的RNN到LSTM、GRU,再到加入注意力机制的RNN,每一步都是在原有架构基础上的改进。即使是前面提到的卷积模型和记忆网络,也都保留了某种形式的循环或卷积结构。Transformer的革命性在于它彻底抛弃了这些传统结构,纯粹基于自注意力机制构建。这种设计哲学的转变具有深远意义:它证明了注意力机制本身就足够强大,不需要依赖其他复杂的结构。BERT、GPT等后续的重要模型都是基于Transformer架构发展而来的,可以说Transformer开启了现代自然语言处理的新时代。