在 VS Code 中使用 Continue 扩展配合本地运行的 LMStudio 进行开发的详细步骤:

🚀 步骤 1:安装并配置 LMStudio

-

下载 LMStudio

访问 LMStudio 官网 下载对应操作系统的版本(Windows/macOS/Linux)。

-

启动 LMStudio

打开 LMStudio,在主页选择或下载需要的语言模型(如

Llama 3、Mistral等)。✅ 确保模型成功加载(状态显示为

Loaded)。 -

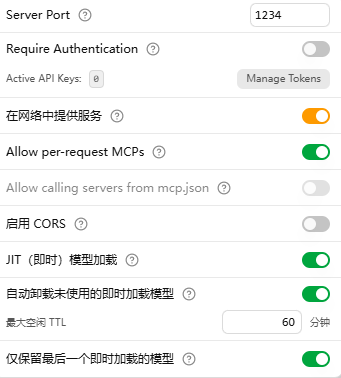

启用本地服务器

点击左侧导航栏的

Local Server,开启服务(默认端口为1234)。📌 记录 API 地址(如

http://localhost:1234)。

⚙️ 步骤 2:安装 VS Code 扩展

- 安装 Continue 扩展

在 VS Code 扩展商店中搜索Continue,安装并重启 VS Code。

🔧 步骤 3:配置 Continue 连接 LMStudio

-

创建配置文件

在 VS Code 中按

Ctrl+Shift+P(或Cmd+Shift+P),输入Continue: Edit config并选择config.json。 -

添加 LMStudio 配置

在

config.json中添加以下内容:json{ "models": [ { "title": "LMStudio Local", "model": "lmstudio", "apiBase": "http://localhost:1234/v1", "apiKey": "sk-xxx" // 留空或用任意字符串 } ] }💡 注意:

apiBase需与 LMStudio 的本地地址一致,路径末尾加/v1。

C:\Users\admin\.continue\config.yaml

name: Local Config

version: 1.0.0

schema: v1

models:

# 原有模型配置

- name: Llama 3.1 8B

provider: ollama

model: llama3.1:8b

roles:

- chat

- edit

- apply

- name: Qwen2.5-Coder 1.5B

provider: ollama

model: qwen2.5-coder:1.5b-base

roles:

- autocomplete

- name: Nomic Embed

provider: ollama

model: nomic-embed-text:latest

roles:

- embed

- name: Gemma 2 9b IT

provider: lmstudio

model: gemma2-9b-it

apiBase: http://localhost:1234/v1

- name: Autodetect

provider: lmstudio

model: AUTODETECT

apiBase: http://localhost:1234/v1/

# 补充界面显示的新模型(LM Studio 已加载)

- name: Qwen3.5 9B

provider: lmstudio

model: qwen3.5-9b

apiBase: http://localhost:1234/v1

roles:

- chat

- edit

- apply

- name: Deepseek R1 0528 Qwen3 8B

provider: lmstudio

model: deepseek-r1-0528-qwen3-8b

apiBase: http://localhost:1234/v1

roles:

- chat

- edit

- name: Granite 3.1 8B

provider: lmstudio

model: granite3.1-8b

apiBase: http://localhost:1234/v1

roles:

- chat

- name: Gemma 3 4B

provider: lmstudio

model: gemma3-4b

apiBase: http://localhost:1234/v1

roles:

- chat

- autocomplete

- name: Olmocr 2 7B

provider: lmstudio

model: olmocr2-7b

apiBase: http://localhost:1234/v1

roles:

- chat

- edit