一、概述

在选择ETL平台时,原生Spark 代表了技术上的纯粹性和最大控制力,适合有深厚技术积累的团队;而Prophecy低代码平台则致力于在不牺牲底层能力的前提下,通过可视化、AI辅助和工程化协作,大幅提升开发效率和团队赋能。以下从多个维度对两者进行系统比较,以帮助您做出更适合团队长期发展的选择。

二、核心维度对比表

| 维度 | 原生Spark开发 | Prophecy平台 | 解读与优势 |

|---|---|---|---|

| 开发效率 | 需手工编写、调试所有代码,重复劳动多,开发周期长(周-月)。 | 可视化拖拽+AI生成,可复用组件库,开发周期缩短至天-周,10倍速交付。 | Prophecy让团队从"写代码"转向"设计数据流",快速响应业务需求。 |

| 人员技能要求 | 必须精通Java/Python/Scala及Spark原理,门槛高。 | 支持低代码/无代码开发,业务分析师可通过拖拽完成ETL,同时保留代码视图供工程师使用。 | 实现全员数据工程,让懂业务但不擅长编程的同事能直接参与开发,释放工程师精力。 |

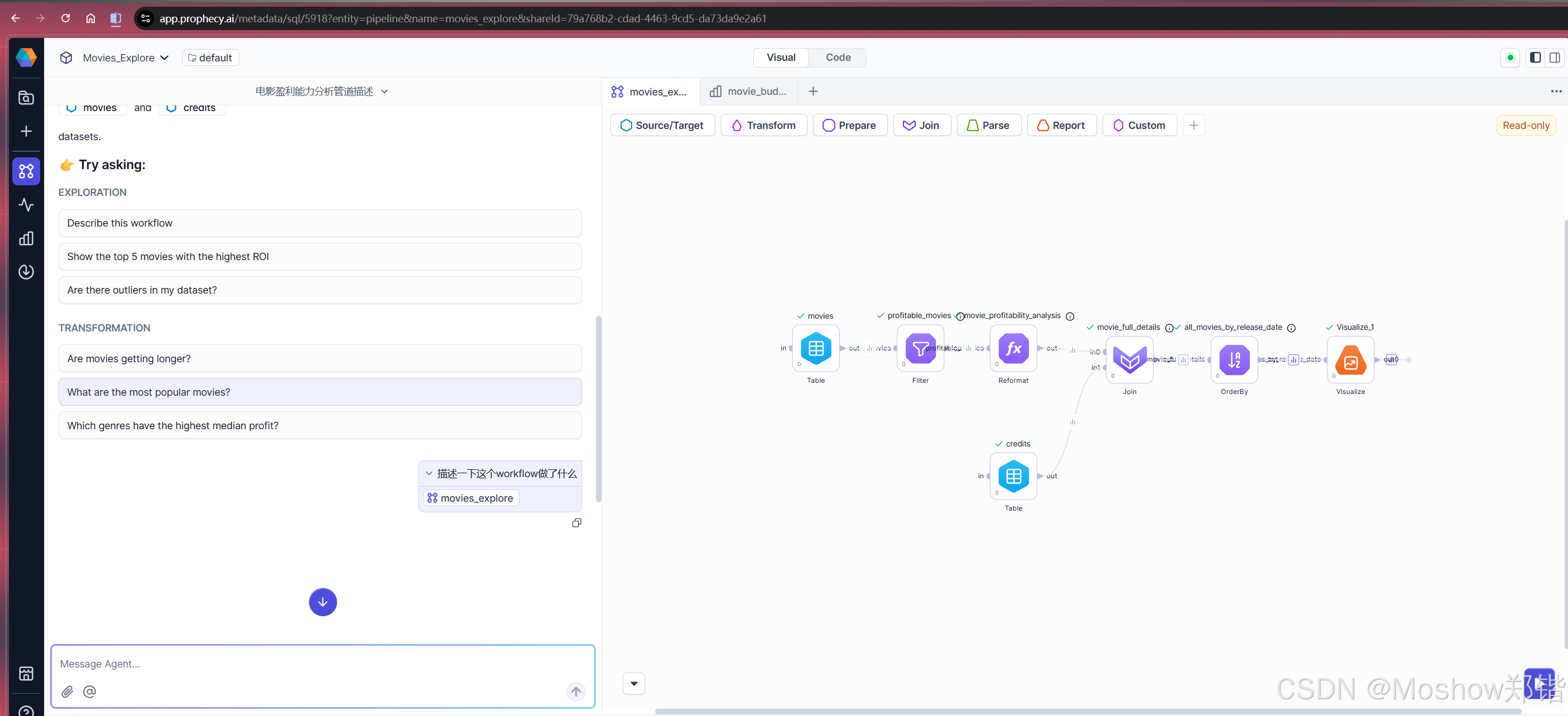

| AI辅助能力 | 无原生AI能力,依赖人工经验。 | 内置AI Agent,支持用自然语言描述需求,AI自动生成、测试、优化数据管道。 | 从"写代码"到"描述需求",极大降低入门门槛,提升开发起点。 |

| 代码可控性 | 完全掌控,但代码风格、质量因人而异,维护成本高。 | 代码透明且开放:可视化操作生成原生Spark代码,所有代码存储在Git中,可导出、审查、修改。 | 无供应商锁定,满足技术团队对"原生"和"掌控"的核心诉求。 |

| 协作与治理 | 依赖个人习惯,版本控制需手动管理,代码审查困难。 | Git原生集成,内置分支管理、合并请求、CI/CD、代码审查,实现规范化工程协作。 | 将软件工程的最佳实践带入数据团队,提升代码质量和可维护性。 |

| 性能调优灵活性 | 需人工配置Spark参数、分析执行计划,经验要求高,环境配置与代码耦合。 | 环境与代码分离(Fabric抽象),可在UI中直接设置Spark Config;生成的代码遵循最佳实践,且支持人工干预调优;运行时继承云平台原生优化(如Photon)。 | 保留并增强调优能力:工程师可从更高起点优化,同时保持对底层参数的精细控制。 |

| CI/CD集成 | 需自行搭建集成流程,将代码打包、测试、部署,工作量大。 | 提供Prophecy Build Tool (PBT),可与GitHub Actions、Jenkins等任意CI/CD工具无缝集成,实现自动化构建、测试、版本管理、部署。 | 完全开放,生成的代码是标准工程,可融入现有DevOps流程,实现一键发布与回滚。 |

| 是否支持原生Spark SQL / PySpark | 本身就是原生环境。 | 完全支持:可视化组件映射原生操作;可随时切换到代码视图编写原生PySpark/SQL;支持导入现有dbt项目。 | 双模工作环境,满足工程师对原生操作的需求,同时提供可视化便利。 |

三、性能调优灵活性深度解析

印度团队强调对性能调优的掌控,Prophecy不仅不限制,反而提供了更高效的调优模式:

-

执行环境配置 :通过Fabric(环境面料),将环境参数(集群大小、Spark配置、依赖库等)与管道代码解耦。开发、测试、生产环境可分别设置,避免配置错误影响性能。

-

代码级优化:AI生成的代码遵循Spark最佳实践(如合理选择join类型、避免shuffle等),资深工程师可直接审查和修改这些代码,甚至插入自定义优化逻辑。

-

运行时监控 :管道运行在客户自己的云环境中(如Databricks、AWS EMR),完全继承云平台的原生性能优化引擎(如Databricks Photon)和监控工具(Spark UI、云监控),无需切换系统。

-

资源动态调整:通过Fabric配置,可针对不同数据量级的作业灵活调整资源,无需改动管道逻辑。

结论:Prophecy让工程师从"手写所有代码"的重复劳动中解放出来,专注于更高价值的性能优化,同时保留了所有底层控制权。

四、CI/CD集成方式详解

Prophecy提供两种集成路径,满足不同成熟度的DevOps实践:

-

通过Prophecy Build Tool (PBT) 深度集成

-

PBT是命令行工具,支持在CI/CD流水线中执行构建、测试、验证、部署、版本管理。

-

可与GitHub Actions、Jenkins、GitLab CI等无缝集成。

-

示例流程:代码推送 → CI触发

pbt validate→pbt test(单元测试) →pbt build(生成jar/whl) →pbt deploy→ 自动打版本标签。 -

实现完全自动化、与现有工具链一致的发布流程。

-

-

通过Prophecy原生Git工作流轻量集成

-

UI内直接管理Git分支、提交、合并请求、代码审查。

-

合并后一键发布,自动创建版本标签并部署到目标环境。

-

核心:无论哪种方式,Prophecy生成的代码都是标准工程代码,存储在Git中,可被任何CI/CD工具处理,不存在"集成黑箱"。

五、原生操作支持说明

-

可视化组件映射原生API:Prophecy的每个组件(如过滤、聚合、join)都对应原生的Spark DataFrame操作或SQL语句。

-

代码视图:用户随时切换到"代码模式",直接编写和修改PySpark或Scala代码,这些代码会被平台识别并融入可视化流程。

-

混合开发:可在同一个项目中混合使用可视化节点和手写代码节点,灵活应对复杂逻辑。

-

导入现有项目:支持导入现有的dbt Core项目或Spark SQL脚本,平滑迁移。

本质 :Prophecy是一个Spark代码的"高级生成器"和"可视化编辑器",不是替代品,而是增强层。

六、总结:Prophecy的价值定位

-

对技术团队:保留了原生Spark的所有控制权(代码开放、性能调优、CI/CD集成),同时通过AI和可视化将开发效率提升一个量级。

-

对业务团队:提供了低门槛的开发环境,让懂业务的人能自助构建数据管道,减少对工程师的依赖。

-

对组织:实现了"全民数据工程",加速数据驱动决策,同时通过工程化治理保障代码质量和可维护性。

最终建议:选择Prophecy不是放弃原生Spark,而是为Spark加上"涡轮增压器"和"标准化驾驶舱",让团队在保持技术深度的同时,获得前所未有的开发速度和协作能力。