随着企业数据平台从 T+1报表时代 走向 实时数据时代,实时数据同步能力逐渐成为数据平台建设的基础能力。过去企业更多依赖定时ETL任务,例如每天凌晨同步数据库数据到数仓;而现在,越来越多的场景需要分钟级甚至秒级的数据更新,比如实时订单分析、生产监控、库存变化预警、实时经营看板等。

在这样的背景下,CDC(Change Data Capture,数据变更捕获)技术逐渐成为主流解决方案。CDC通过解析数据库事务日志(如MySQL binlog、Oracle LogMiner等),捕获数据变化并实时同步到目标系统,实现高时效的数据流转。

在国内数据集成工具市场中,两款经常被企业拿来对比的产品是:

- ETLCloud CDC

- FineDataLink(FDL)

两者都支持数据库CDC实时同步,但在架构设计、产品定位以及企业使用场景上却存在明显差异。本人使用ETLCloud社区版本也有一定的时间了,现在来做一个相对客观的横向观察。

一、实时数据同步:从"批处理ETL"到"CDC流式同步"

传统ETL工具的核心模式是:数据库 → 定时任务 → 批量同步 → 数据仓库

这种方式在BI报表时代非常有效,但当业务需要实时分析时,就会出现明显问题:

- 数据延迟高(通常几十分钟到数小时)

- 数据同步对数据库压力较大

- 无法支撑实时业务联动

因此现在越来越多的数据平台开始采用CDC模式。CDC的核心流程是:数据库日志 → CDC监听 → 数据流 → 目标系统

这种方式只同步发生变化的数据,因此具备几个明显优势:

- 减少对源数据库压力

- 支持秒级数据同步

- 更适合实时数仓或实时数据平台

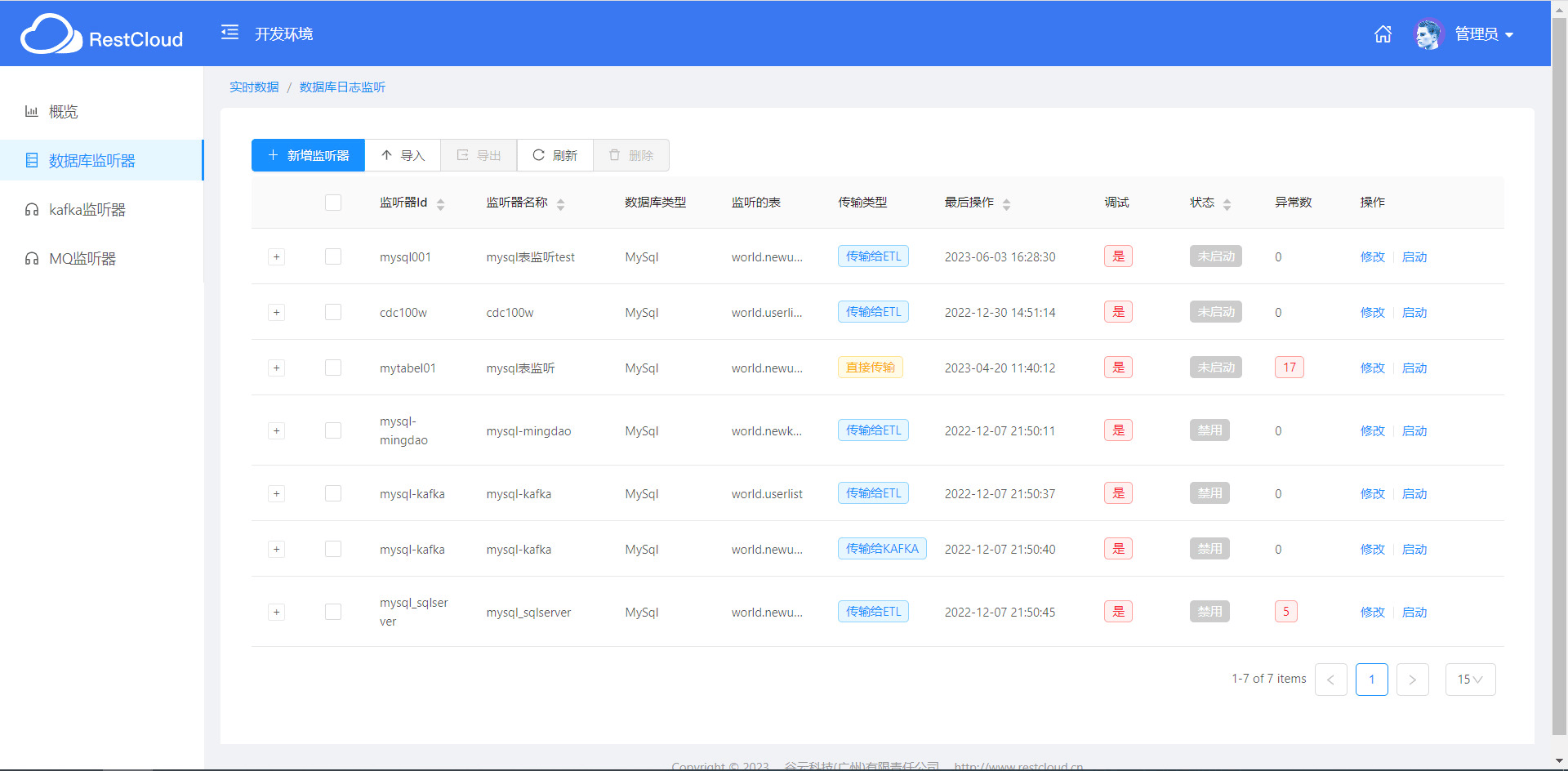

二、ETLCloud CDC:实时同步与ETL流程融合

ETLCloud在社区版本中已经提供了CDC实时同步能力,可以监听数据库日志,实现数据实时增量同步。这种能力主要用于解决企业常见的数据同步场景,例如:

- 业务数据库 → 数据仓库

- 系统之间的数据同步

- 实时数据集成

ETLCloud CDC的一个特点是:CDC数据可以直接进入ETL流程进行处理。也就是说,它不仅仅是一个数据复制工具,还可以在同步过程中完成数据加工。例如:订单表CDC → ETL流程 → 关联客户表 → 数据清洗 → 写入数仓

这种模式对于构建实时数仓非常有价值,因为很多实时数据同步任务本身就需要做数据处理,比如:

- 维度补充

- 字段转换

- 多表关联

- 宽表构建

如果CDC只能做数据复制,往往还需要额外开发流计算程序;而当CDC直接进入ETL流程时,很多数据处理逻辑可以直接在平台内完成。另外,在企业实际项目中,经常会遇到 整库同步 或 大批量表同步 的需求。例如:

MySQL → 数仓 需要同步100~500张表,ETLCloud CDC支持:

- 批量同步数据库表

- 自动创建目标表结构

- 可视化配置同步任务

这样可以明显降低数据同步任务的配置成本。说明的是我这里讨论的是 ETLCloud社区版本内置的CDC能力。在ETLCloud企业版本中,还提供了更加专业的CDC工具组件,用于支持更大规模的数据同步场景,例如高并发日志解析、分布式部署和更高吞吐量的数据管道能力。

三、FineDataLink(FDL):BI生态中的数据集成平台

FineDataLink(FDL)是帆软推出的数据集成产品,其定位是一体化的数据集成与数据开发平台,主要用于帮助企业构建数据管道,为BI分析提供数据准备能力。FDL同样支持CDC实时同步,能够通过数据库日志捕获变化数据,并实现实时增量同步.在产品架构上,FDL的核心能力包括:

- 数据管道任务

- ETL/ELT数据开发

- 数据服务API发布

- 数据运维监控

其同步能力主要通过 CDC + 数据管道任务 来实现,例如:数据库 → CDC捕获 → 数据管道 → 数据仓库

FDL的一大特点是 低代码数据开发模式。平台通过拖拽式DAG流程设计数据同步任务,降低了数据开发门槛,使得业务团队也可以参与数据集成开发。另外,FDL与帆软BI产品(如FineReport、FineBI)形成完整生态,因此在BI数据准备场景中比较常见。例如:业务系统 → FDL → 数据仓库 → BI报表

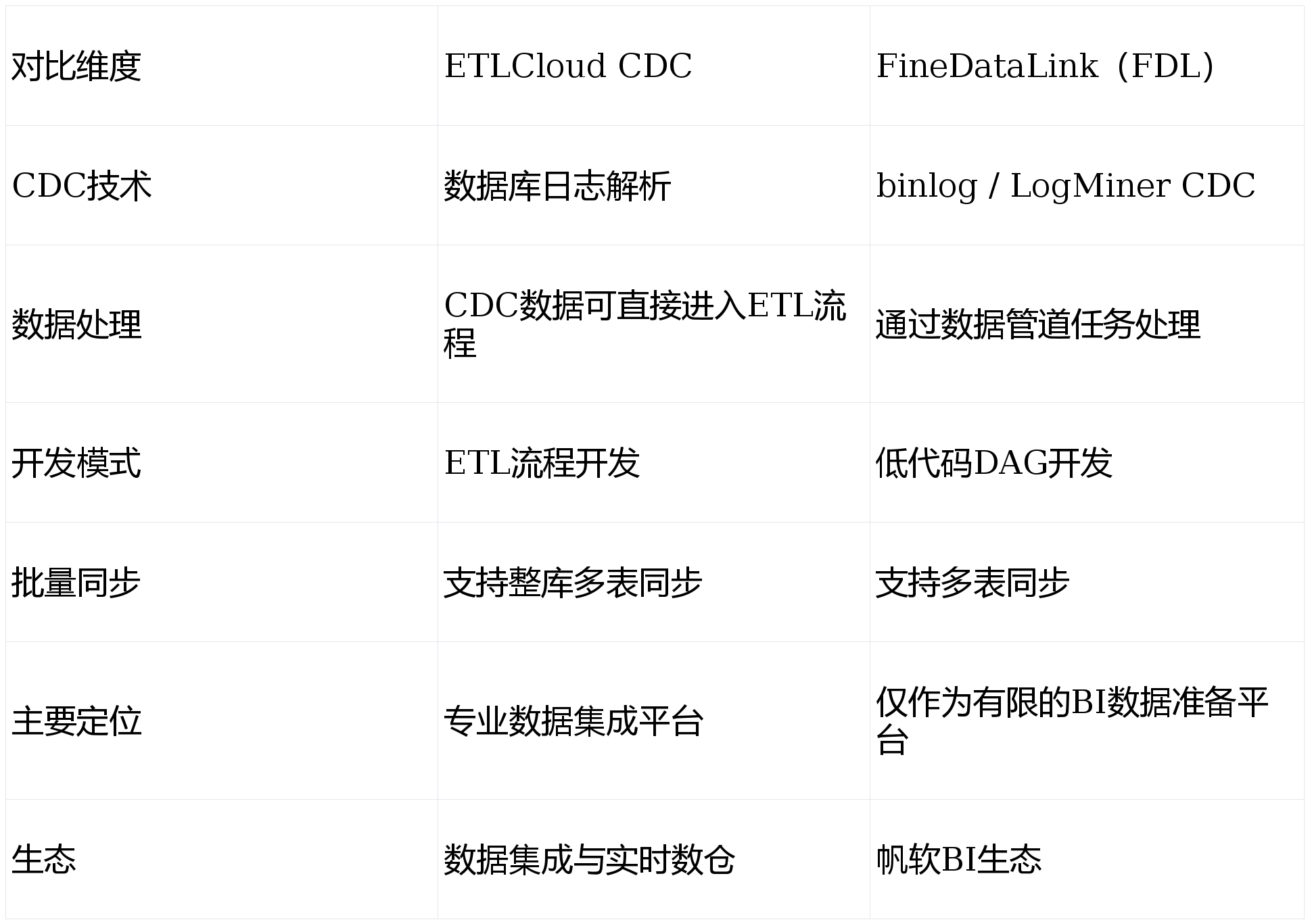

四、两者CDC能力对比

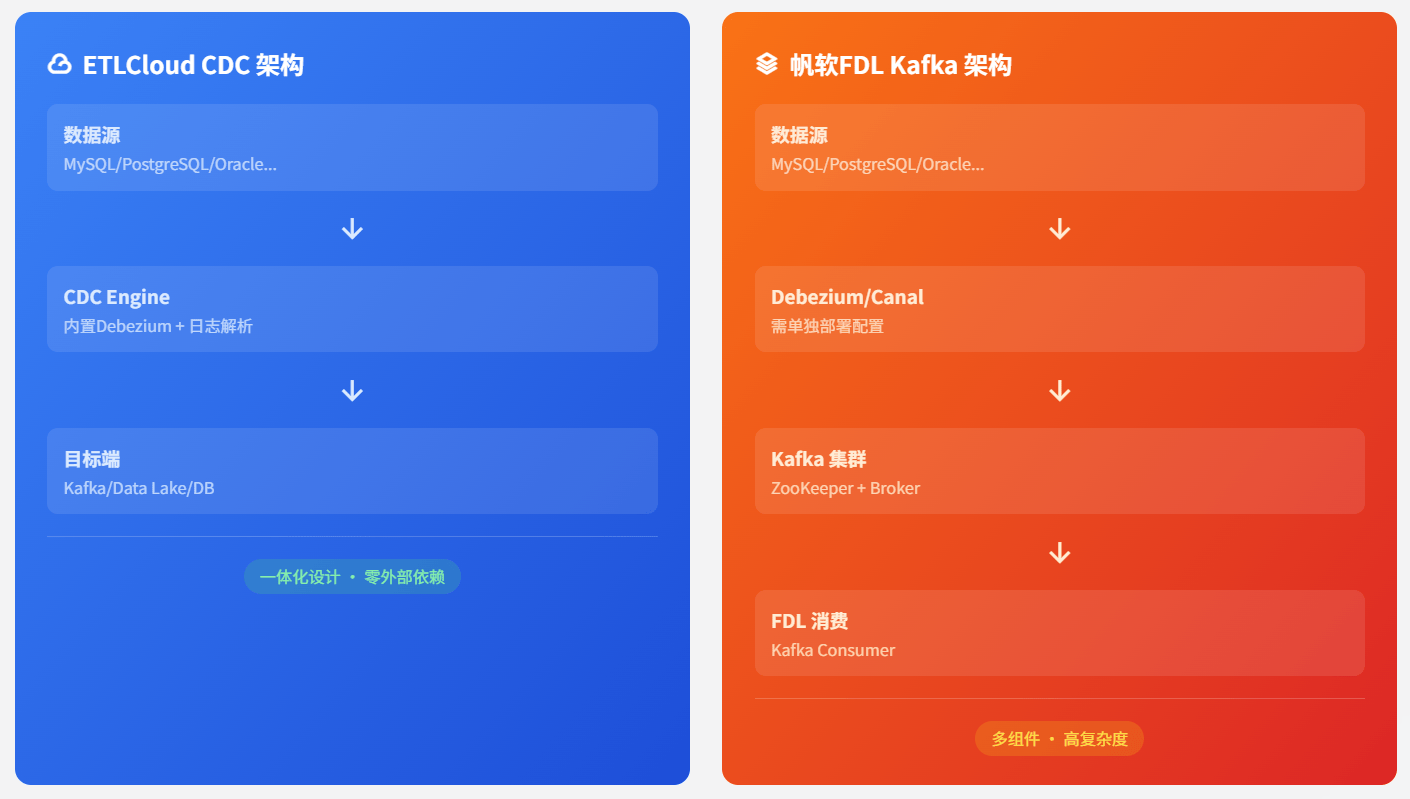

如果从实时同步能力角度看,两者的核心技术路线其实比较接近,都基于数据库日志解析实现CDC同步。但在实际使用体验和产品定位上仍然存在一些差异。简单总结可以这样理解:

从这个角度来看,两者其实代表了 两种不同的数据平台思路:

ETLCloud 更偏向数据集成平台,强调数据同步与数据处理能力的结合。

FDL 更偏向BI数据准备工具,强调低代码数据开发与BI生态整合。

五、企业数据平台选型的关键点

很多企业在选择实时同步工具时,最关心的问题通常是:

谁同步更快?

但在实际项目中,这往往不是最重要的因素。真正影响项目成败的通常是以下几个方面:

第一,是否融入整体数据架构。

如果企业要建设数据中台或实时数仓,CDC能力最好能够与数据处理流程打通。

第二,是否支持复杂数据处理。

很多同步任务不仅仅是复制数据,还涉及字段转换、多表关联、维度补充等数据加工。

第三,是否容易运维。

当同步任务规模达到数百甚至上千个时,稳定性和运维能力会变得非常重要。

因此,CDC工具并不是孤立存在的,而是企业数据平台的一部分。

六、总结

从技术角度来看,ETLCloud CDC 和 FineDataLink(FDL) 都能够实现数据库实时同步,两者在CDC技术路线上的差异表面看起来不大,cdc只有在实际项目中验证后才能对比出结果。

但在产品定位上,两者的侧重点不同:

- FDL更偏向BI生态中的数据准备工具,适合BI分析场景的数据管道建设。

- ETLCloud更偏向企业级数据集成平台,在实时数据处理和ETL流程结合方面更加灵活。

另外需要特别说明的是,本文对比的是 ETLCloud社区版本内置的CDC能力。在ETLCloud企业版本中,还提供了更加专业的CDC工具组件,用于支持更高规模、更高性能的数据同步场景。

对于企业来说,工具选型并不是简单的"谁更强",而是要看:

谁更适合你的数据平台架构。

当企业开始建设实时数据平台、实时数仓或数据中台时,CDC能力往往只是第一步,真正决定平台能力的,是数据同步之后的数据处理与数据集成能力。