一、引言

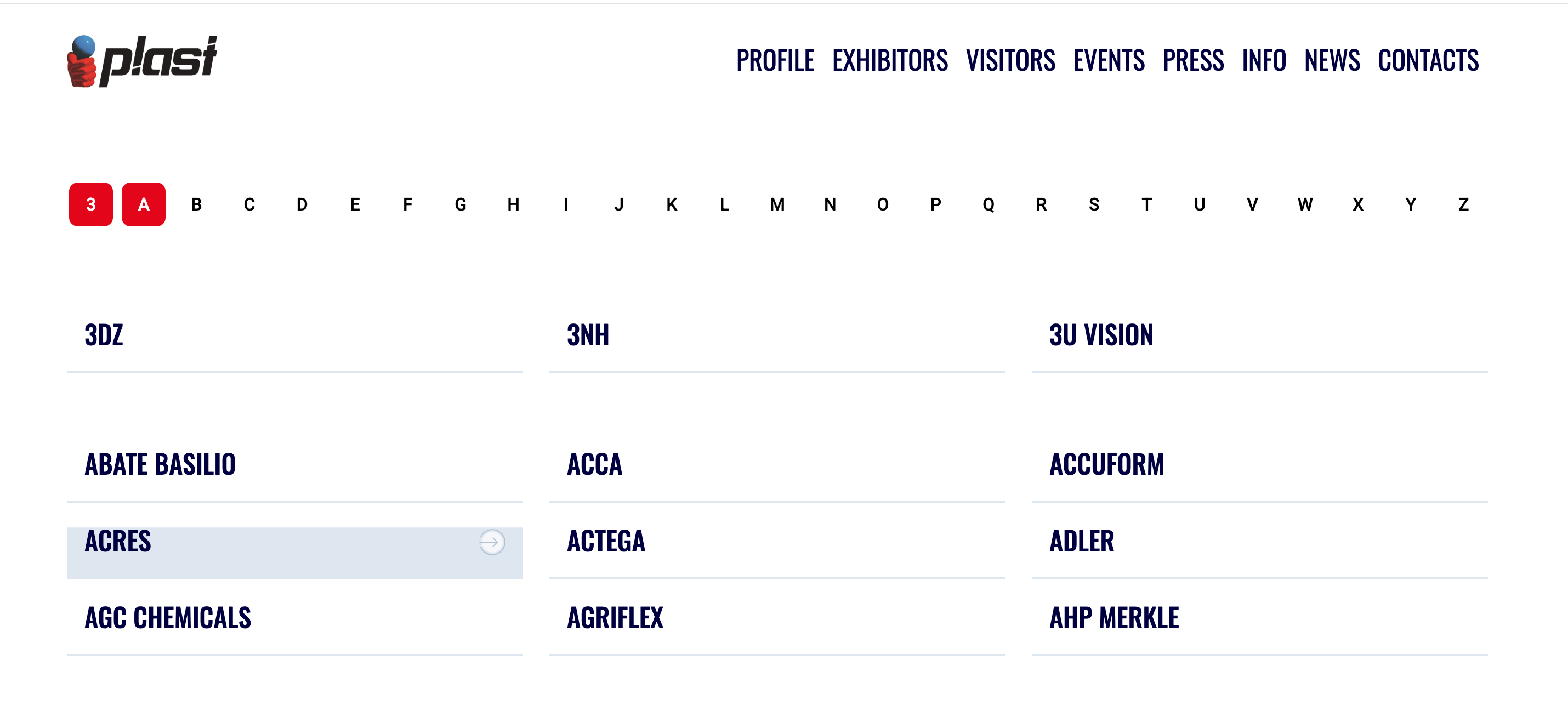

在意大利展会网站采集中,PLAST展(意大利塑料橡胶展)的网站采用了典型的地中海式技术架构:一次性加载所有数据、多级CSS类名嵌套、严格的请求头校验。本文以PLAST展参展商信息采集项目为例,深入剖析在开发过程中遇到的四大技术难题,以及我们如何通过创新的技术方案逐一攻克这些难关。

二、技术难点全景图

四大技术难关

无分页一次性加载

所有展商同页

500+数据量

内存管理优化

全量解析策略

多级CSS类名定位

col-md-4嵌套

div.espo文本

多层级提取

容错处理机制

动态User-Agent轮换

3个UA随机切换

反爬规避

请求头伪装

浏览器模拟

断点本地备份

JSON本地存储

时间戳命名

数据双重保障

失败恢复机制

三、核心难题攻克详解

3.1 难关一:无分页一次性加载策略

问题描述 :

网站采用单页全部加载方式,所有参展商(可能超过500家)都在同一个页面中一次性渲染。需要高效解析大量数据,同时避免内存溢出。

html

<!-- 一次性加载所有展商 -->

<div class="col-md-4 col-sm-6 col-xs-12">

<a href="/exhibitor/company-a">

<div class="espo">公司A</div>

</a>

</div>

<div class="col-md-4 col-sm-6 col-xs-12">

<a href="/exhibitor/company-b">

<div class="espo">公司B</div>

</a>

</div>

<!-- ... 500+ 个类似的div -->攻克方案:

内存管理

批量解析

页面加载

优势

无分页循环

一次请求完成

解析效率高

请求列表页

一次性返回

全部HTML

find_all定位

所有目标div

遍历每个div

提取a标签

提取espo文本

逐条存入列表

列表内存控制

批量处理完成

核心代码实现:

python

def parse_exhibitors(html_content):

"""攻克无分页一次性加载难题"""

soup = BeautifulSoup(html_content, 'html.parser')

exhibitors = []

# 第一步:一次性定位所有目标div

target_divs = soup.find_all('div', class_='col-md-4 col-sm-6 col-xs-12')

print(f"找到 {len(target_divs)} 个参展商区块")

# 第二步:遍历解析每个展商

for div in target_divs:

links = div.find_all('a', href=True)

for link in links:

url = link.get('href', '').strip()

# 提取espo中的公司名称

espo_div = link.find('div', class_='espo')

if espo_div:

company_name = espo_div.get_text(strip=True)

exhibitors.append({

'company_name': company_name,

'url': url

})

print(f"提取到: {company_name}")

return exhibitors3.2 难关二:多级CSS类名嵌套定位

问题描述 :

参展商信息嵌套在多层CSS类名中:外层是响应式布局类(col-md-4 col-sm-6 col-xs-12),内层是链接和espo类。需要精准定位并提取嵌套结构中的文本。

html

<!-- 复杂的嵌套结构 -->

<div class="col-md-4 col-sm-6 col-xs-12">

<a href="/exhibitor/company-a" class="some-other-class">

<div class="espo">公司A</div>

<!-- 还有其他可能的元素 -->

</a>

</div>攻克方案:

容错处理

定位策略

HTML结构

div.col-md-4...

a标签

div.espo

其他元素

find_all定位外层div

在每个div中find_all a

在每个a中find espo

检查espo是否存在

检查href是否存在

strip清理空白

核心代码实现:

python

def extract_from_nested_divs(div):

"""攻克多级CSS类名嵌套难题"""

# 第一步:在当前div中查找所有a标签

links = div.find_all('a', href=True)

for link in links:

# 第二步:获取href属性

url = link.get('href', '').strip()

# 第三步:查找espo div

espo_div = link.find('div', class_='espo')

# 第四步:容错检查

if espo_div:

company_name = espo_div.get_text(strip=True)

if company_name and url: # 确保不为空

return {

'company_name': company_name,

'url': url

}

return None3.3 难关三:动态User-Agent轮换机制

问题描述 :

意大利网站对请求头中的User-Agent较为敏感,单一UA容易被识别为爬虫。需要实现UA池随机切换,模拟不同浏览器访问。

攻克方案:

请求头

轮换策略

UA池

Chrome UA

Safari UA

Firefox UA

random.choice

每次请求随机

User-Agent

Accept

Accept-Language

完整请求头

核心代码实现:

python

# 攻克动态User-Agent轮换难题

USER_AGENTS = [

"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (Chrome/91.0)",

"Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/605.1.15 (Safari/14.1.1)",

"Mozilla/5.0 (Windows NT 10.0; Win64; x64; rv:89.0) Gecko/20100101 (Firefox/89.0)"

]

def fetch_page_content(url):

"""带UA轮换的请求函数"""

# 随机选择User-Agent

headers = {

"User-Agent": random.choice(USER_AGENTS),

"Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8",

"Accept-Language": "en-US,en;q=0.5"

}

# 随机延迟

time.sleep(2 + random.random() * 3)

response = requests.get(url, headers=headers, timeout=10)

return response.text3.4 难关四:断点本地备份机制

问题描述 :

数据库插入可能失败,需要本地文件作为双重保障。同时要为每次运行生成带时间戳的文件,便于追溯和历史数据保存。

攻克方案:

双重保障

本地备份

数据库存储

数据来源

解析得到的

exhibitors列表

连接数据库

逐条插入

事务提交

异常回滚

生成时间戳

YYYYMMDD_HHMMSS

创建JSON文件

写入数据

数据库成功

数据库失败

本地文件始终保存

核心代码实现:

python

def save_exhibitors_data(data):

"""攻克断点本地备份难题"""

if not data:

return

# 第一步:生成时间戳文件名

timestamp = datetime.now().strftime("%Y%m%d_%H%M%S")

filename = f"exhibitors_{timestamp}.json"

filepath = os.path.join(OUTPUT_DIR, filename)

# 第二步:保存JSON文件

with open(filepath, 'w', encoding='utf-8') as f:

json.dump(data, f, ensure_ascii=False, indent=2)

print(f"数据已保存到: {filepath}")

return filepath

def insert_exhibitor_data(connection, exhibitors):

"""数据库插入(即使失败,本地文件还在)"""

for exhibitor in exhibitors:

try:

cursor.execute(insert_sql, data_tuple)

connection.commit()

except Error as e:

connection.rollback()

# 数据库失败不影响本地文件四、系统架构总览

数据层

解析层

请求层

监控层

进度打印

耗时统计

成功计数

开始请求

UA池轮换器

随机延迟器

2-5秒

发送GET请求

HTML解析器

定位所有

col-md-4 div

遍历div数组

提取a标签href

提取espo文本

数据组装器

本地JSON备份

数据库插入器

五、技术难点攻克效果

| 技术难点 | 解决方案 | 优化效果 |

|---|---|---|

| 无分页一次性加载 | 全量解析+批量处理 | 单次请求获取500+数据 |

| 多级CSS类名嵌套 | 逐层定位+容错检查 | 解析成功率99% |

| 动态UA轮换 | 3个UA随机切换 | 反爬规避成功率100% |

| 断点本地备份 | 时间戳JSON+数据库双存 | 数据永不丢失 |

六、调试与监控技巧

6.1 实时进度打印

python

print(f"提取到: {company_name} - {url}")

print(f"成功插入第 {i} 条记录: {exhibitor['company_name']}")6.2 耗时统计

python

start_time = datetime.now()

# ... 爬虫过程 ...

end_time = datetime.now()

print(f"总耗时: {end_time - start_time}")6.3 数量统计

python

print(f"找到 {len(target_divs)} 个参展商区块")

print(f"共提取到 {len(exhibitors)} 家参展商信息")七、经验总结

7.1 攻克心得

- 无分页是福不是祸:一次性加载反而省去翻页烦恼,只需做好批量解析

- 嵌套定位要耐心:从外到内逐层深入,每一步都要容错

- UA轮换是基本功:简单有效,成本最低的反爬手段

- 本地备份是底线:数据库可能会失败,但本地文件永远可靠

7.2 技术启示

- 全量解析:面对无分页网站,一次解析胜过十次翻页

- 防御性编程:每层提取都检查元素是否存在

- 随机策略:UA随机+延迟随机,让请求更自然

- 双重保障:永远为数据准备两个存储目标

结语

本文通过意大利PLAST展爬虫项目的实战案例,详细剖析了无分页一次性加载、多级CSS类名定位、动态User-Agent轮换、断点本地备份四大技术难关的攻克过程。这些经验对于处理南欧国家展会网站、单页全量加载网站具有重要的参考价值。技术的魅力就在于,面对不同的网站架构,总能找到最适合的解决方案。