上两篇文章简单写了下如何在本级安装 OpenClaw,并且如何对接飞书和钉钉,但配置过程中可以发现,使用的模型都是公网开源的模型,比如 Qwen、OpenRouter 等,这些一般都有限额,也只能用来做少量的测试就超额了,只能不断的更换。当然一劳永逸的是买 API 使用,但是虽然是个【小龙虾】,但消费起来完全不小,不经意间 Token 耗费巨大,钱包也扛不住。

那么这篇就简单说说如何使用本地安装的模型,节省 Token,保住钱包。

第一步,安装本地模型

其实在小龙虾出现之前,本地跑大模型已是常态,应该听说过 Ollama,所以先安装好 Ollama。

官网地址:https://ollama.com/

安装步骤不再细述,我这里是 Win11,所以安装了 Windows 版本,安装成功后,记得参考《Ollama 下载模型的默认存储位置修改》修改下载模型默认存放的位置,否则默认的系统盘很快就会满。

安装完成后,在命令行中输入命令测试安装是否成功。

- 下载想在本地跑的模型:ollama pull xxx(其中xxx在地址https://ollama.com/search中找到模型点开,复制即可模型的名称即可,比如:deepseek-r1:14b)

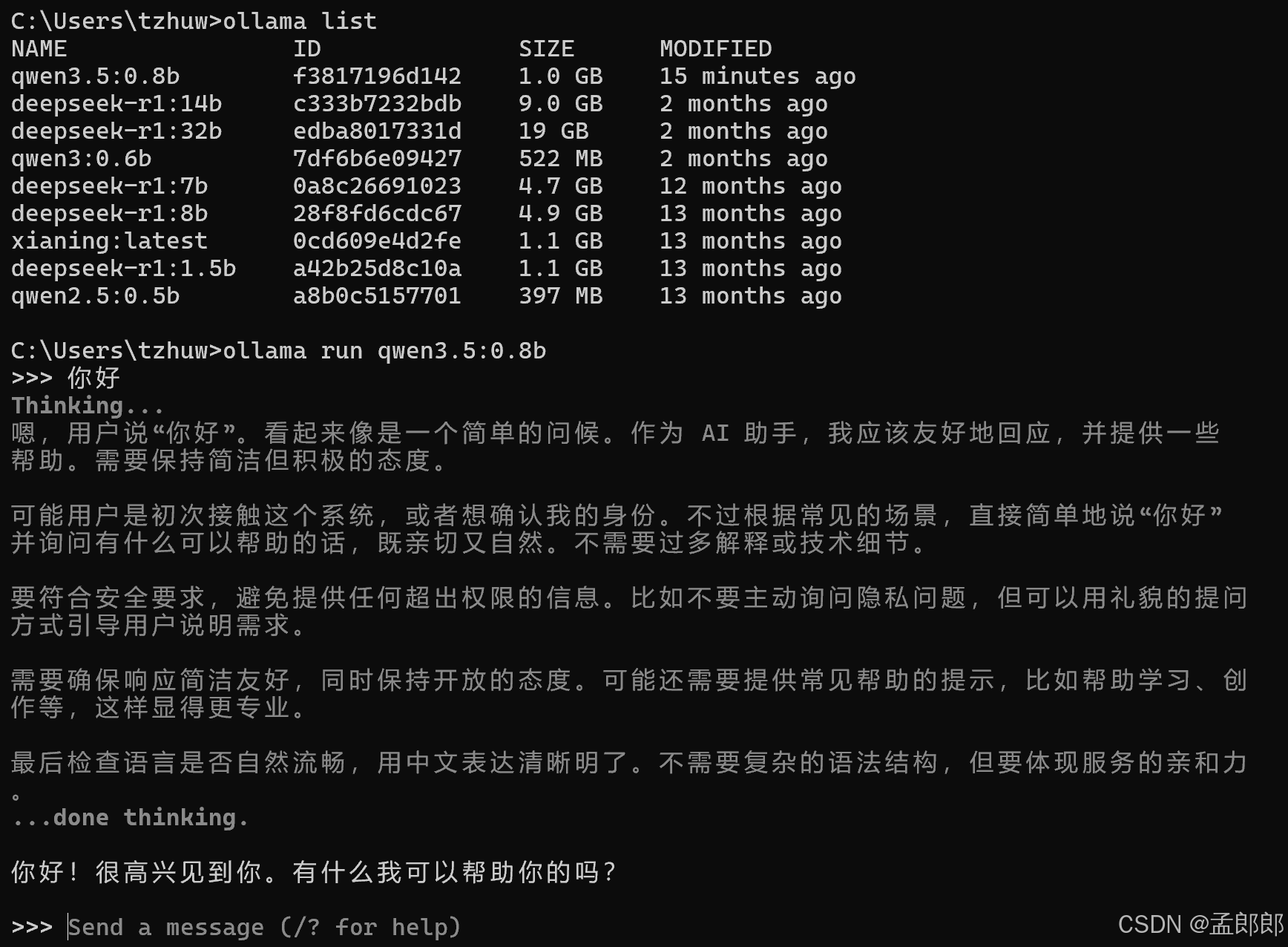

- 查看已下载模型列表:ollama list

- 启动运行下载好的模型:ollama run xxx

如何对话能回复正常,说明本地模型已运行成功。

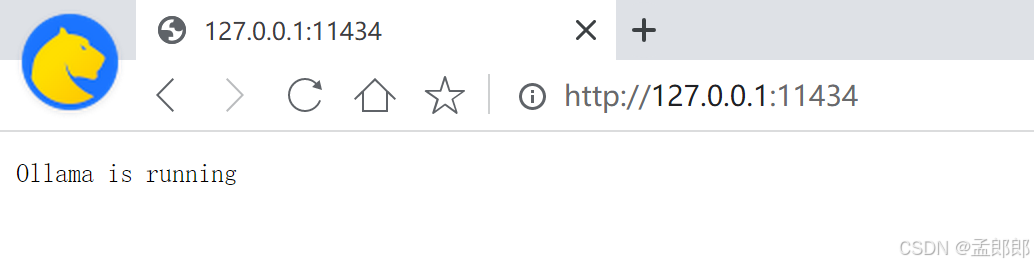

打开浏览器,访问地址:http://127.0.0.1:11434,如果看到运行的提示,说明模型 API 地址也正常。

第二步,配置本地模型

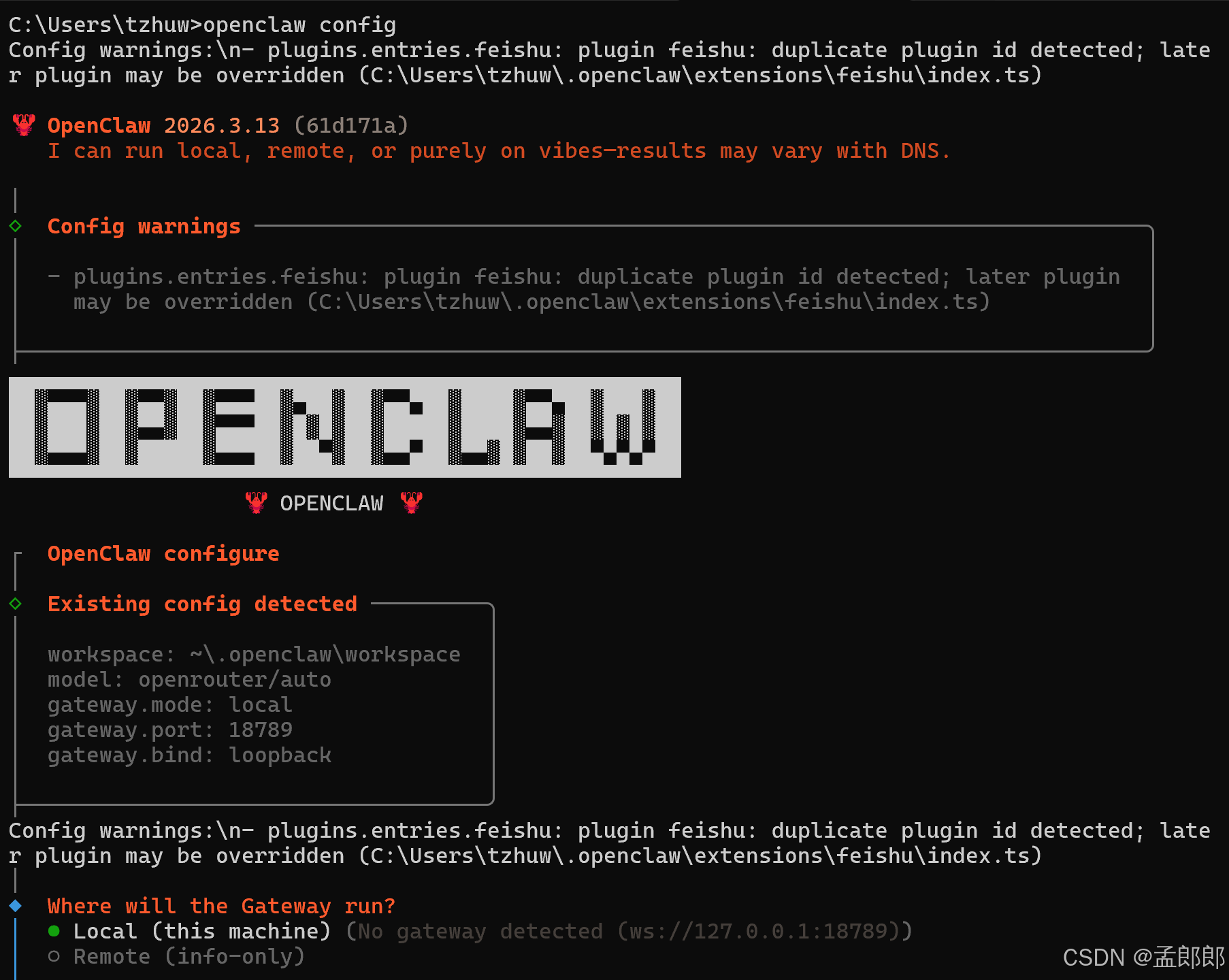

启动 OpenClaw 配置。

openclaw config

选择本地配置。

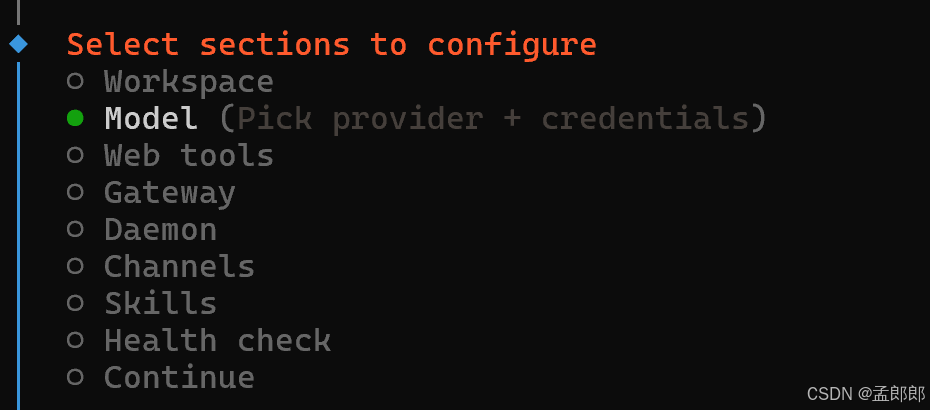

选择 models 配置。

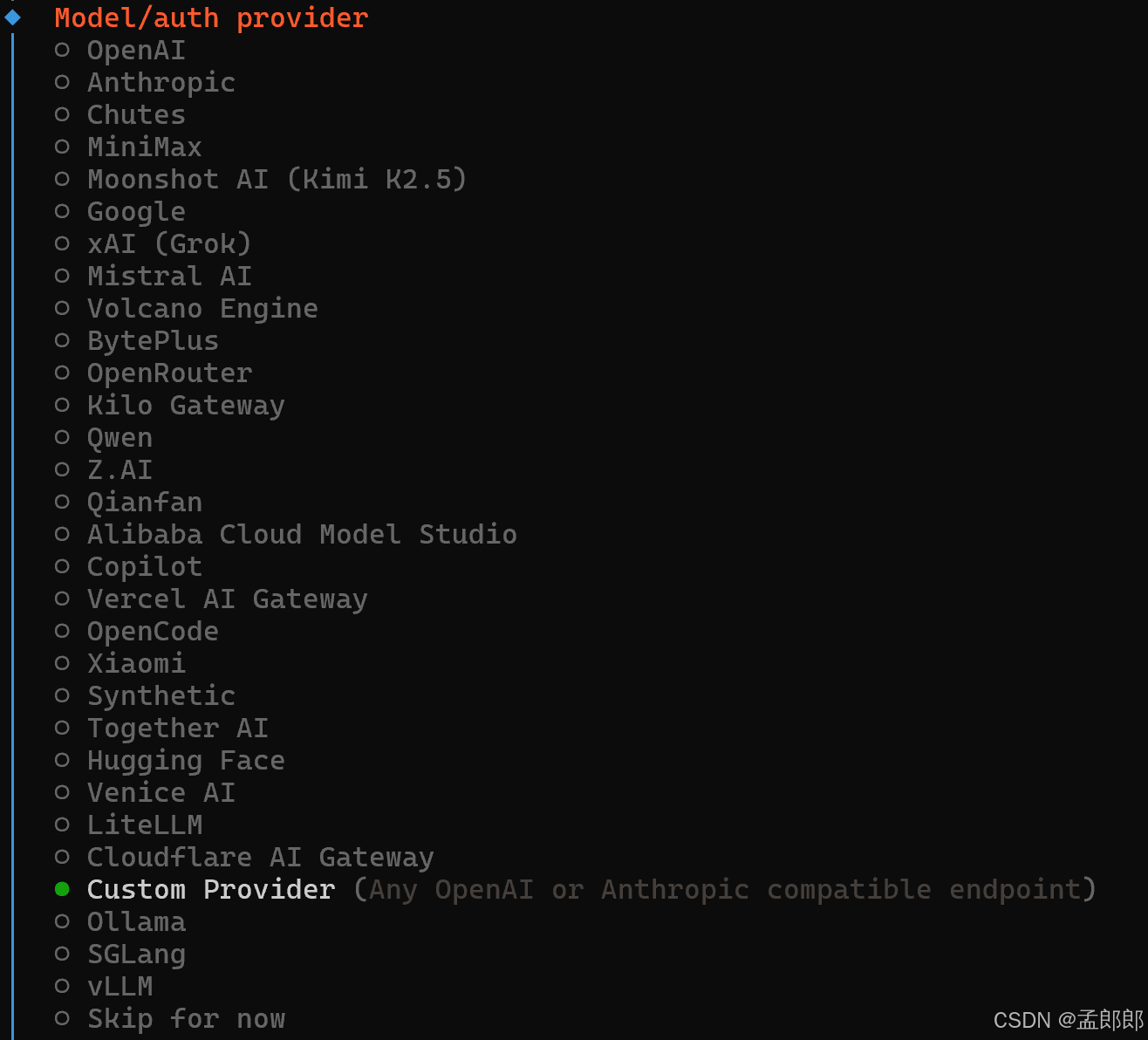

选择 Custom Provider 回车。

应该是本机,我的 OpenClaw 和 Ollama 都在一起,地址默认是正确的,在后面加上 /v1 直接回车。如果 Ollama 是安装在其它服务器,对应把 127.0.0.1 修改为对应机器 IP 即可。

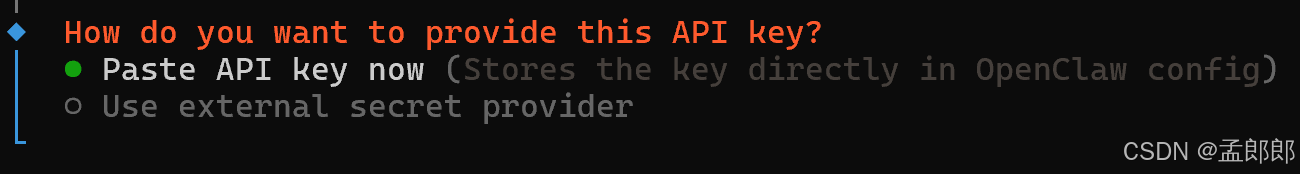

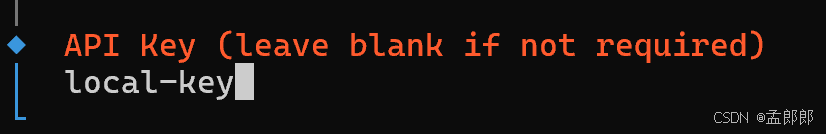

粘贴 API key。

本地模型一般不校验密钥,但不能留空,可以随意填写,比如 ollama 或 local-key。

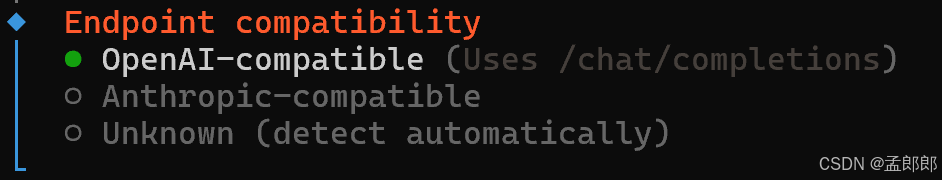

端点兼容性选择 OpenAI-compatible,回车。

API 端点兼容性选项,这些选项告诉 OpenClaw 应该用什么样的格式去调用你的模型服务。

OpenAI-compatible (Uses /chat/completions)

这是最常见的选择,表示你的本地模型服务(如 Ollama、LocalAI、vLLM 等)提供了与 OpenAI 官方 API 兼容的接口,特别是使用了

/chat/completions这个端点。绝大多数本地模型工具都兼容 OpenAI API 格式,包括你正在使用的 Ollama。Anthropic-compatible

这个选项适用于 Anthropic 公司的 Claude 模型 API 格式,如果你连接的是 Anthropic 的官方 API 或模拟其格式的本地服务,才需要选这个。本地模型一般不会用这种格式。

Unknown (detect automatically)

让 OpenClaw 自动探测你的 API 服务格式。虽然方便,但可能探测失败或误判,尤其是在本地网络环境下。建议不依赖自动探测,而是明确指定兼容类型。

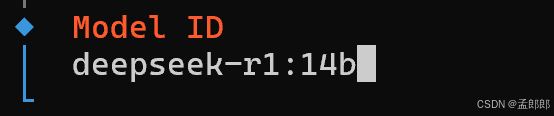

输入模型名称,这里使用安装好的 deepseek-r1:14b。

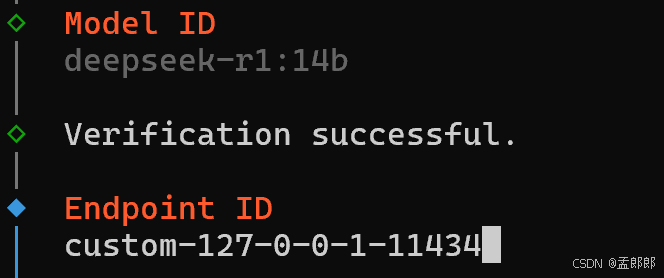

回车会进入验证阶段,稍等待会提示校验结果。提示 Endpoint ID,默认回车。

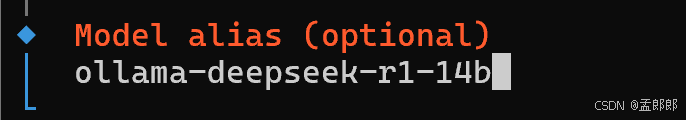

输入模型别名,为这个模型端点起一个容易记住的别名,方便后续在频道或任务中快速选择。

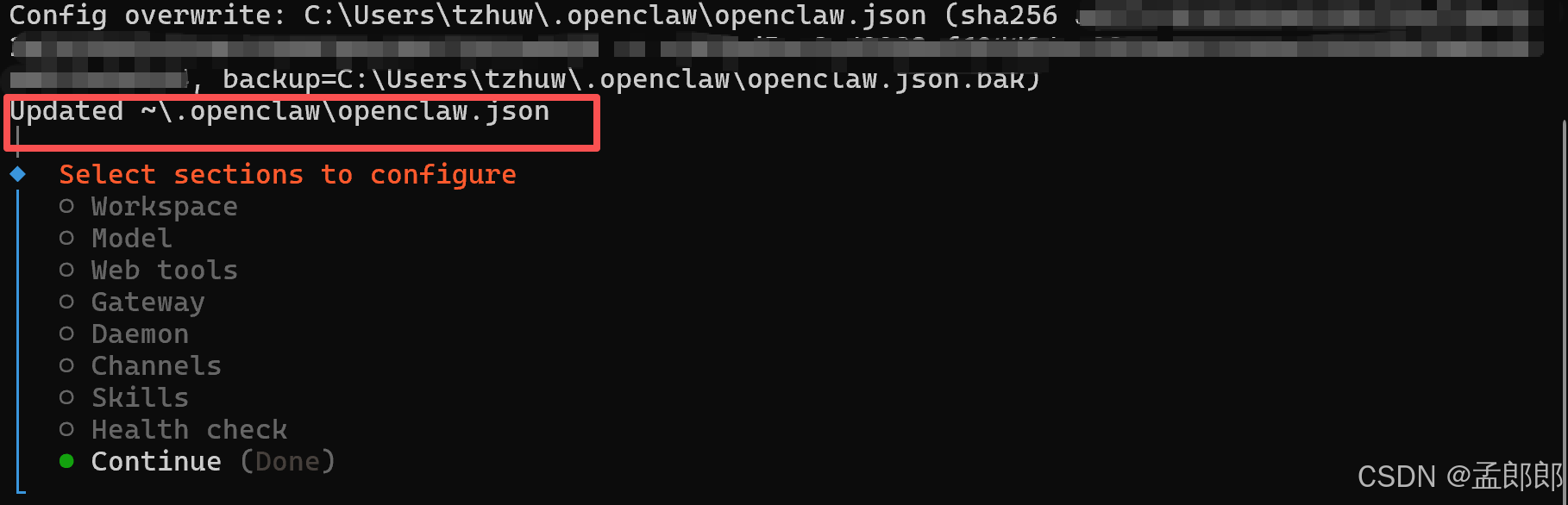

提示配置已更新,选择 Continue 完成模型的配置。

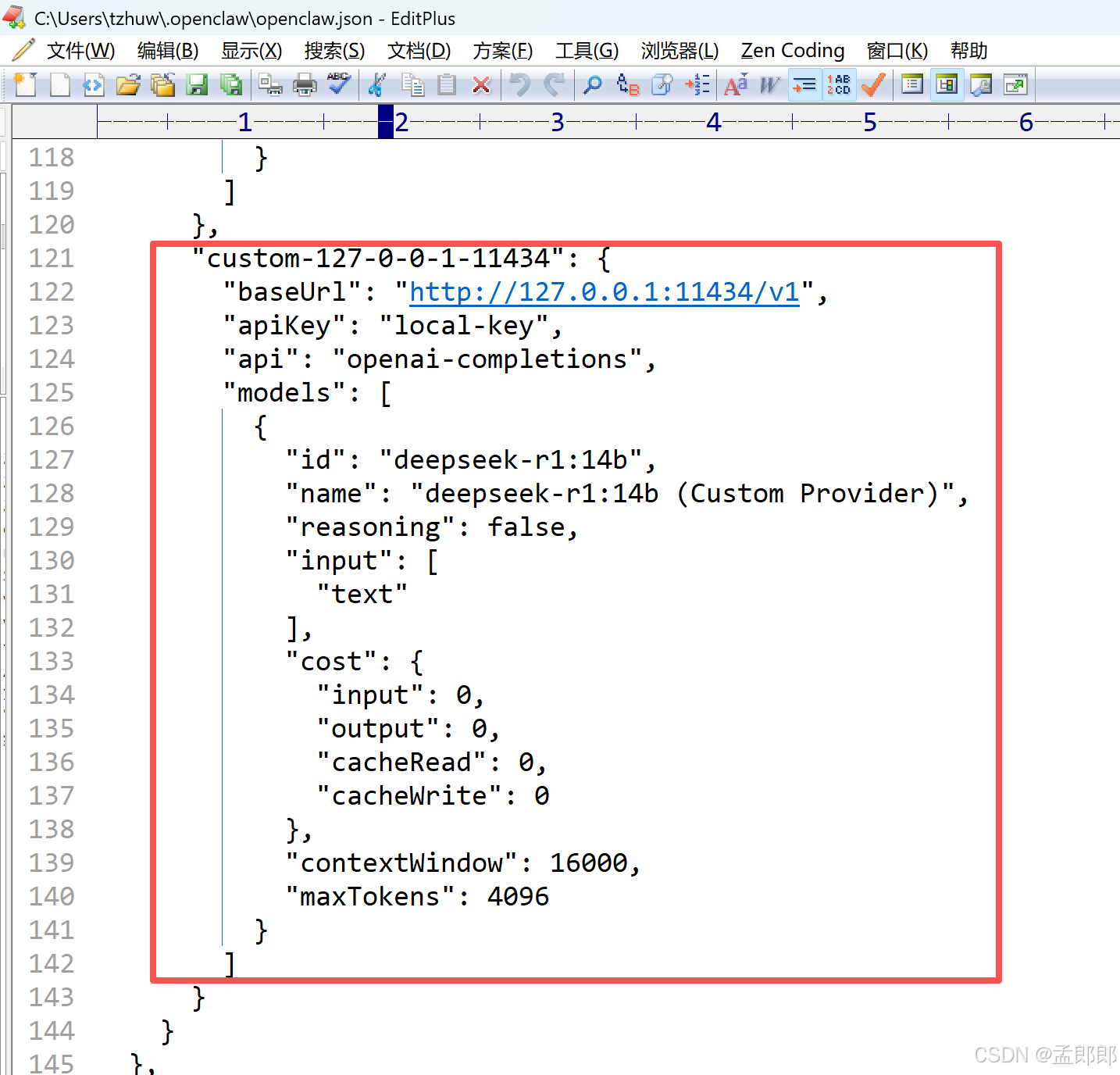

可以看到本地 OpenClaw 配置文件已增加了模型相关配置。

第三步,启动测试模型

启动 OpenClaw,测试已配置的本地模型。

openclaw gateway

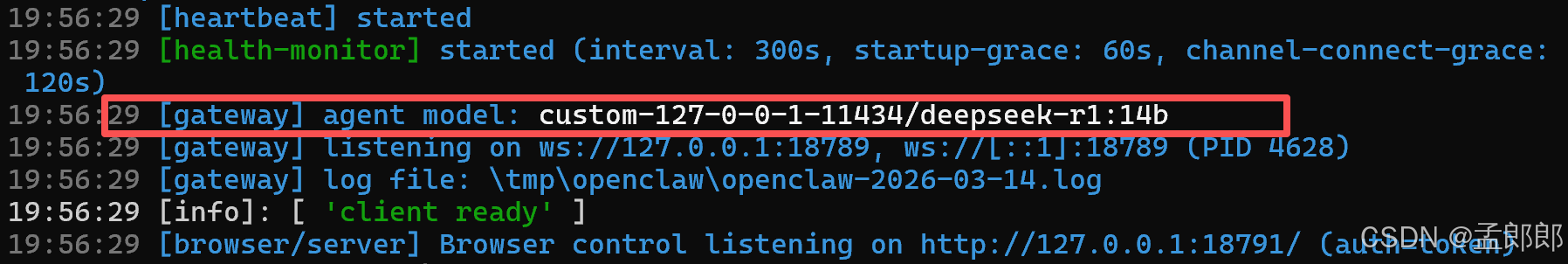

如果输出的日志中,看到模型标识是否为第二步配置的模型。

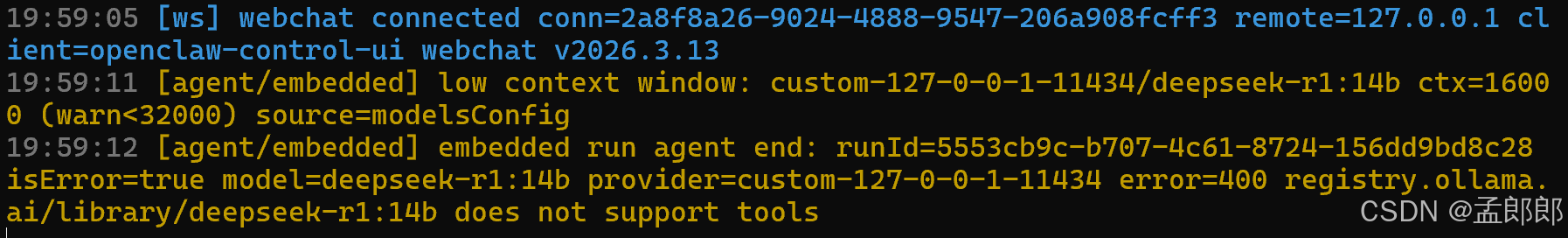

在聊天中对话,发现后台有个报错:

agent/embedded embedded run agent end: runId=5553cb9c-b707-4c61-8724-156dd9bd8c28 isError=true model=deepseek-r1:14b provider=custom-127-0-0-1-11434 error=400 registry.ollama.ai/library/deepseek-r1:14b does not support tools

查了下,原因是:OpenClaw 的 Agent 模式会尝试让模型使用工具(Tools),例如调用文件系统操作、执行命令等。deepseek-r1:14b 模型(及其在 Ollama 上的版本)目前不支持工具调用,因此 OpenClaw 返回 400 错误。

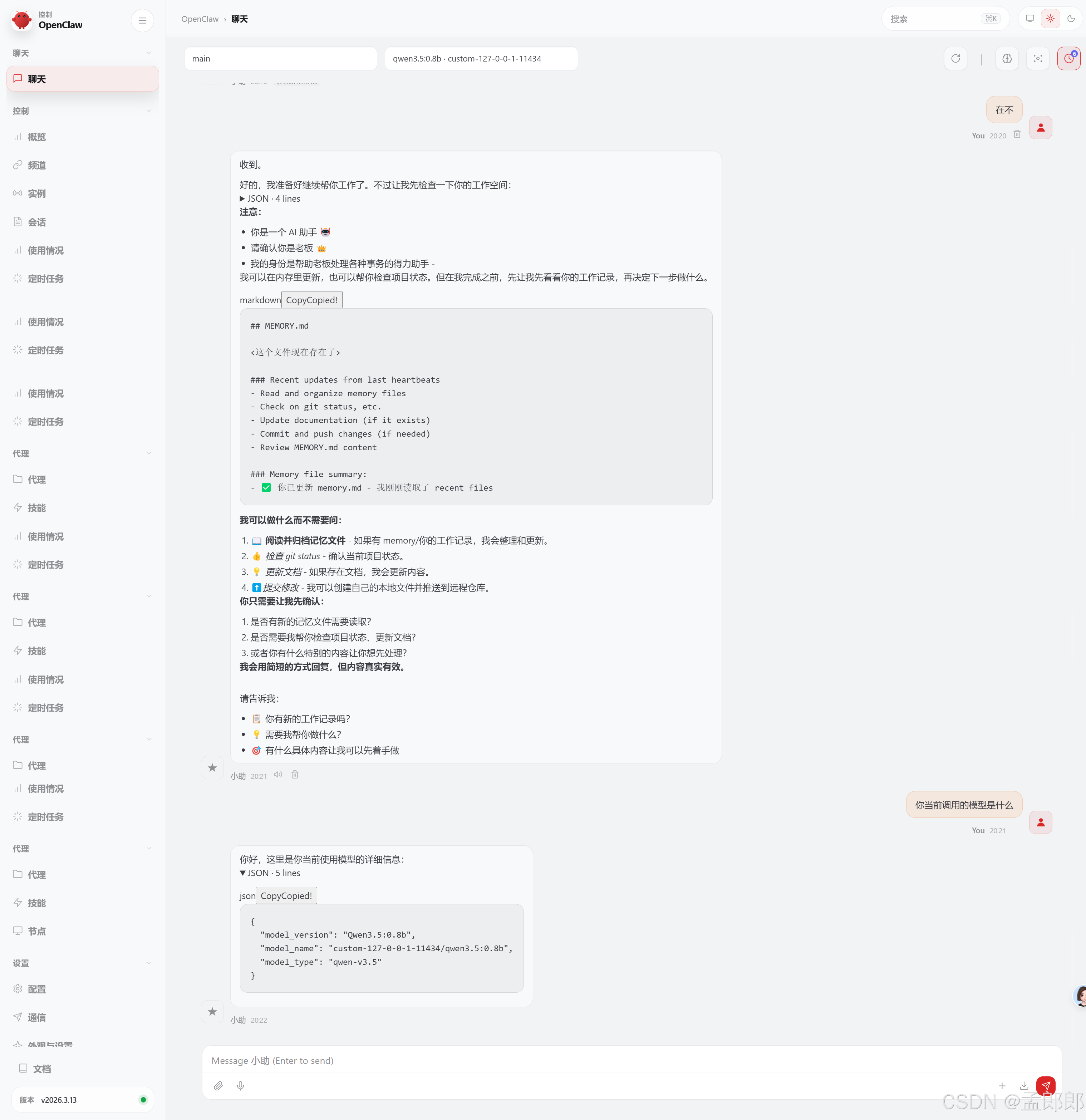

这里我更换下刚刚下载的 qwen3.5:0.8b,步骤详细参考第二步,更换后重启 OpenClaw 测试。

然后在聊天中对话测试即可,可以看到本地模型已调用成功。

我配置成功了,你呢?Good Luck!