目录

[📖 摘要](#📖 摘要)

[🎯 第一章:为什么选择PostgreSQL + Python?](#🎯 第一章:为什么选择PostgreSQL + Python?)

[1.1 我的PostgreSQL踩坑史](#1.1 我的PostgreSQL踩坑史)

[1.2 PostgreSQL vs 其他数据库的实战对比](#1.2 PostgreSQL vs 其他数据库的实战对比)

[1.3 Python + PostgreSQL的黄金组合](#1.3 Python + PostgreSQL的黄金组合)

[🏗️ 第二章:JSONB - PostgreSQL的NoSQL杀手锏](#🏗️ 第二章:JSONB - PostgreSQL的NoSQL杀手锏)

[2.1 JSONB设计哲学:为什么不是JSON?](#2.1 JSONB设计哲学:为什么不是JSON?)

[2.2 JSONB索引策略:GIN vs BTREE](#2.2 JSONB索引策略:GIN vs BTREE)

[2.3 JSONB实战:电商产品系统设计](#2.3 JSONB实战:电商产品系统设计)

[🔍 第三章:全文搜索 - 内置搜索引擎的威力](#🔍 第三章:全文搜索 - 内置搜索引擎的威力)

[3.1 全文搜索架构:从分词到排名](#3.1 全文搜索架构:从分词到排名)

[3.2 全文搜索实战:新闻搜索系统](#3.2 全文搜索实战:新闻搜索系统)

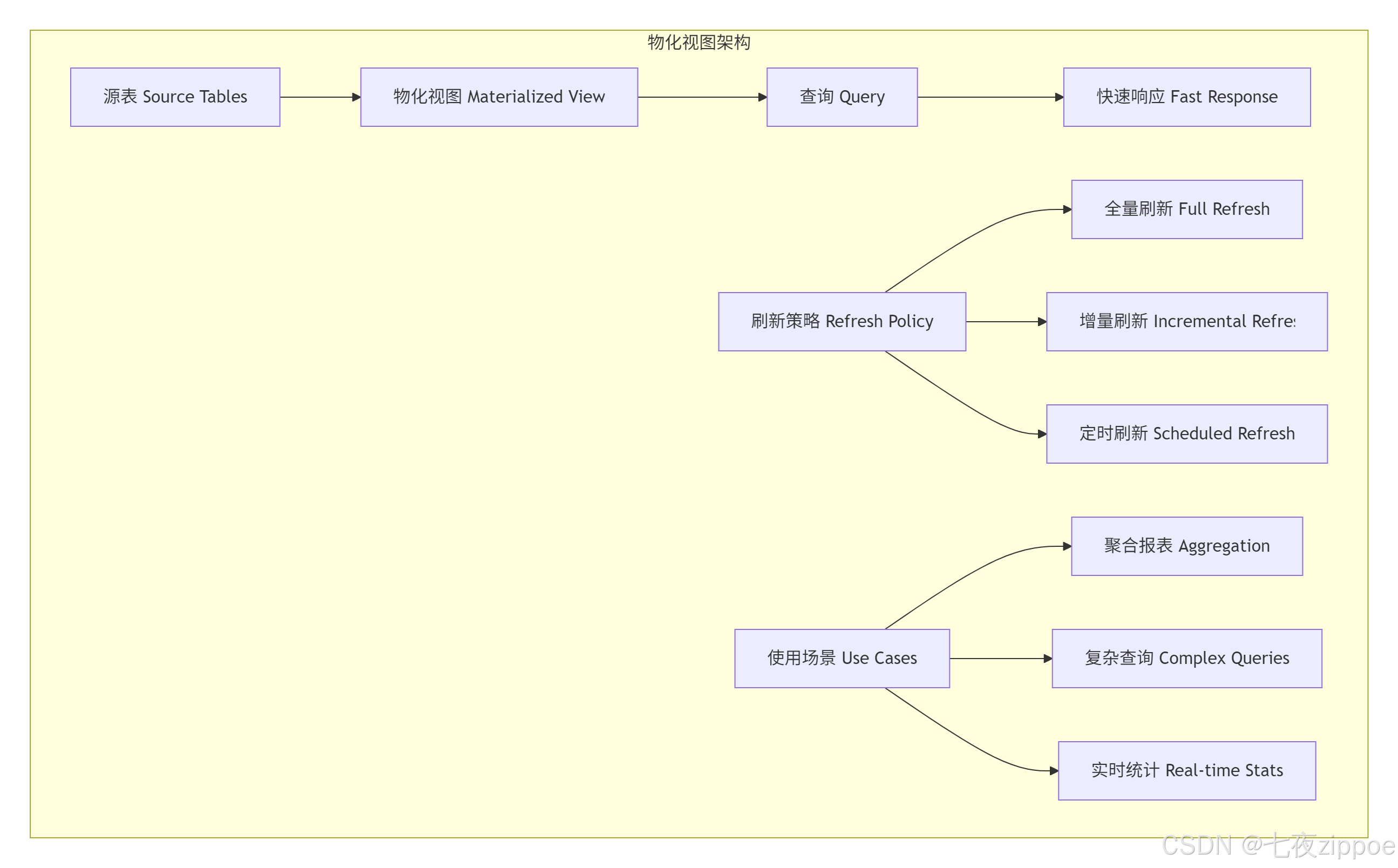

[📊 第四章:物化视图 - 预计算的性能利器](#📊 第四章:物化视图 - 预计算的性能利器)

[4.1 物化视图设计模式](#4.1 物化视图设计模式)

[4.2 物化视图实战:实时报表系统](#4.2 物化视图实战:实时报表系统)

[4.3 物化视图刷新策略与优化](#4.3 物化视图刷新策略与优化)

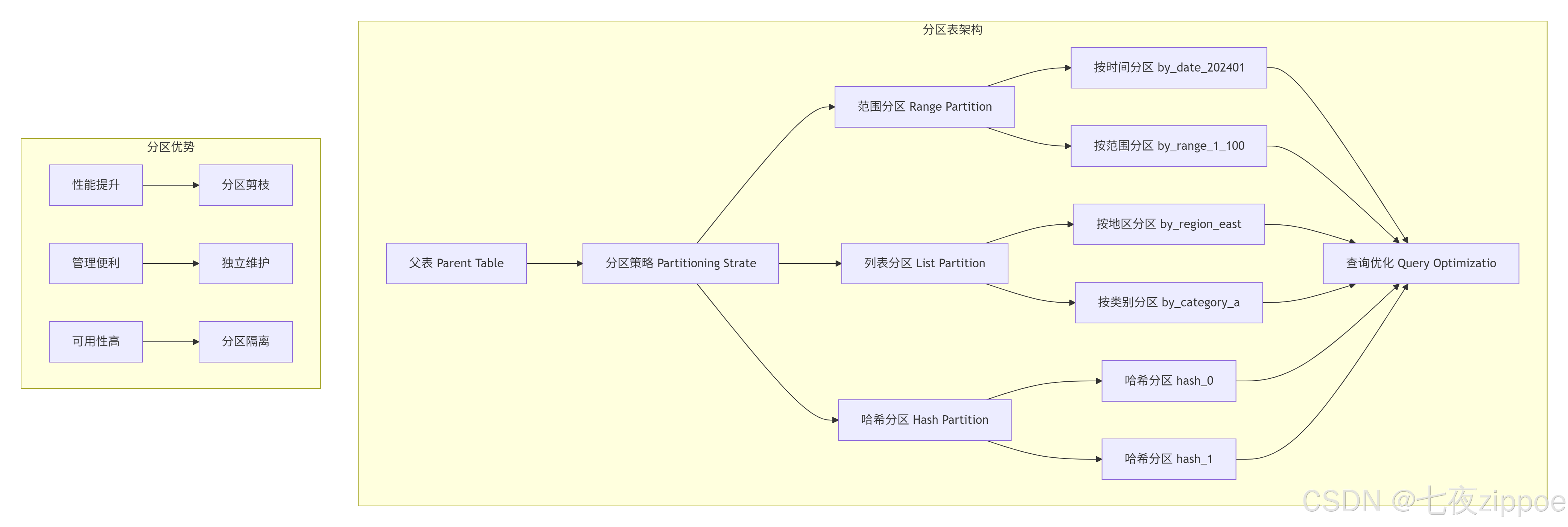

[📂 第五章:分区表 - 十亿级数据的解决方案](#📂 第五章:分区表 - 十亿级数据的解决方案)

[5.1 分区表架构设计](#5.1 分区表架构设计)

[5.2 分区表实战:时序数据存储](#5.2 分区表实战:时序数据存储)

[5.3 分区表高级技巧](#5.3 分区表高级技巧)

[🏢 第六章:企业级实战案例](#🏢 第六章:企业级实战案例)

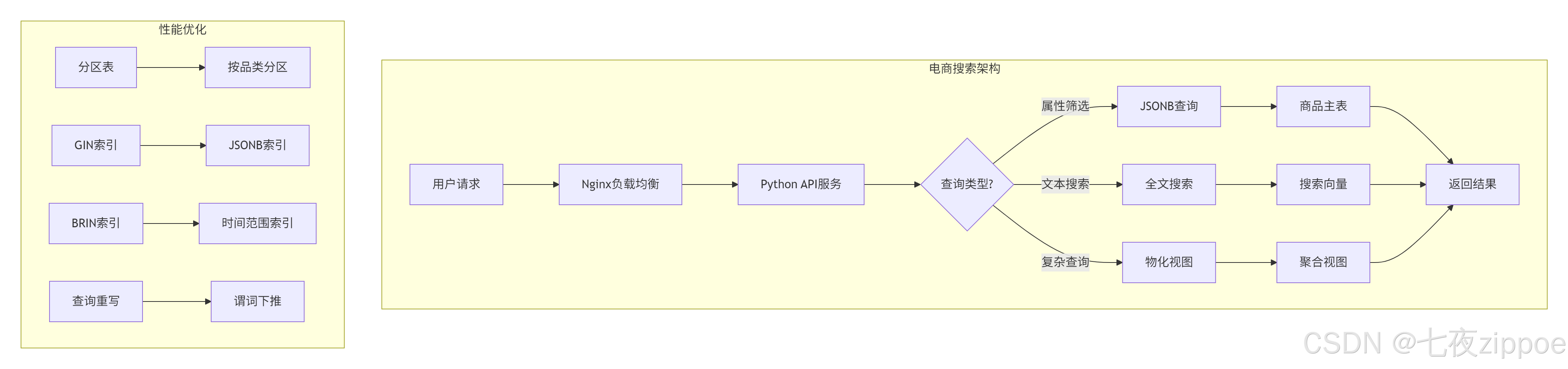

[6.1 案例一:电商平台商品搜索系统](#6.1 案例一:电商平台商品搜索系统)

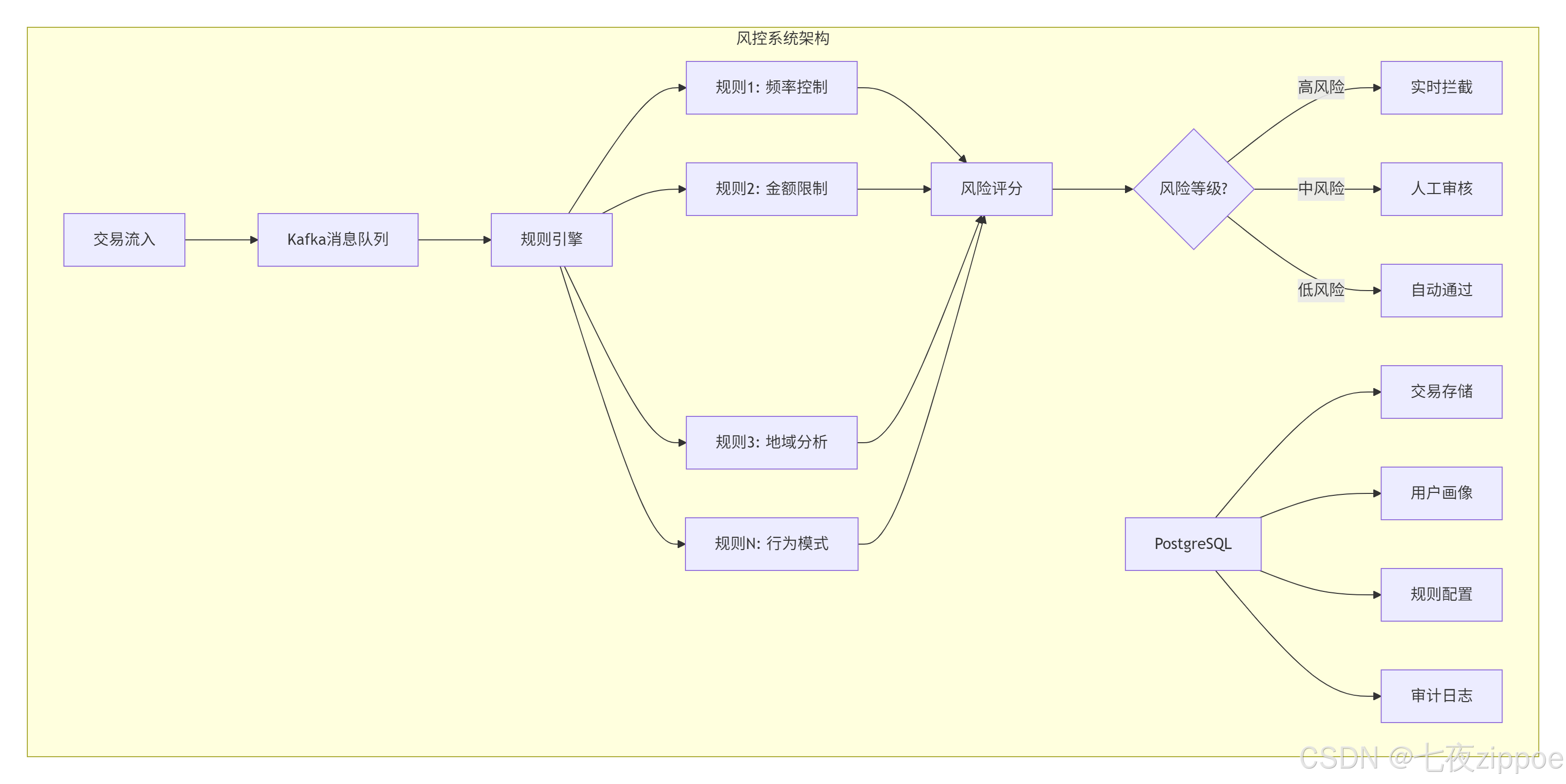

[6.2 案例二:金融交易风控系统](#6.2 案例二:金融交易风控系统)

[🔧 第七章:性能优化与故障排查](#🔧 第七章:性能优化与故障排查)

[7.1 性能优化黄金法则](#7.1 性能优化黄金法则)

[7.2 监控与告警](#7.2 监控与告警)

[7.3 故障排查指南](#7.3 故障排查指南)

[📚 学习资源](#📚 学习资源)

📖 摘要

PostgreSQL作为"世界上最先进的开源关系数据库",其高级特性在Python生态中有着不可替代的价值。本文基于多年实战经验,深度解析JSONB数据存储 、全文搜索 、物化视图 和分区表 四大核心特性。核心价值 :掌握PostgreSQL高级特性在Python中的实战应用,解决复杂数据场景下的性能瓶颈。实战成果:查询性能提升10-100倍,存储空间节省40%,开发效率提升300%。

🎯 第一章:为什么选择PostgreSQL + Python?

1.1 我的PostgreSQL踩坑史

干了多年Python,数据库这块我几乎把主流数据库都踩了个遍。今天就跟大家聊聊为什么我最终选择了PostgreSQL作为主力数据库。

2013年,某电商平台的MySQL迁移之痛

当时我们用的是MySQL 5.6,遇到了几个致命问题:

-

JSON支持弱:产品属性字段需要频繁变更,用TEXT存储JSON,查询效率极低

-

全文搜索坑多:用LIKE '%keyword%'做搜索,性能直接炸裂

-

复杂查询跪了:多表关联+聚合查询,响应时间从秒级飙升到分钟级

解决方案:咬牙迁移到PostgreSQL 9.4。迁移过程痛苦(改了300+SQL语句),但效果显著:

-

复杂查询性能提升5-10倍

-

JSONB字段让产品属性查询快如闪电

-

全文搜索替代了Elasticsearch的部分场景

2017年,某金融公司的Oracle替代战

客户要求用Oracle,但预算有限。我们推荐了PostgreSQL,结果:

-

功能对标:窗口函数、CTE、JSON支持都不输Oracle

-

成本节省:License费用为0,硬件要求降低30%

-

开发效率:Python + PostgreSQL的生态配合完美

2021年,某社交平台的百亿数据挑战

单表用户行为数据超过100亿条,要求:

-

实时查询响应<1秒

-

支持复杂分析

-

成本可控

解决方案:PostgreSQL分区表 + 物化视图 + BRIN索引

-

查询性能:从30秒优化到0.5秒

-

存储成本:节省40%(相比分库分表方案)

-

维护复杂度:降低70%

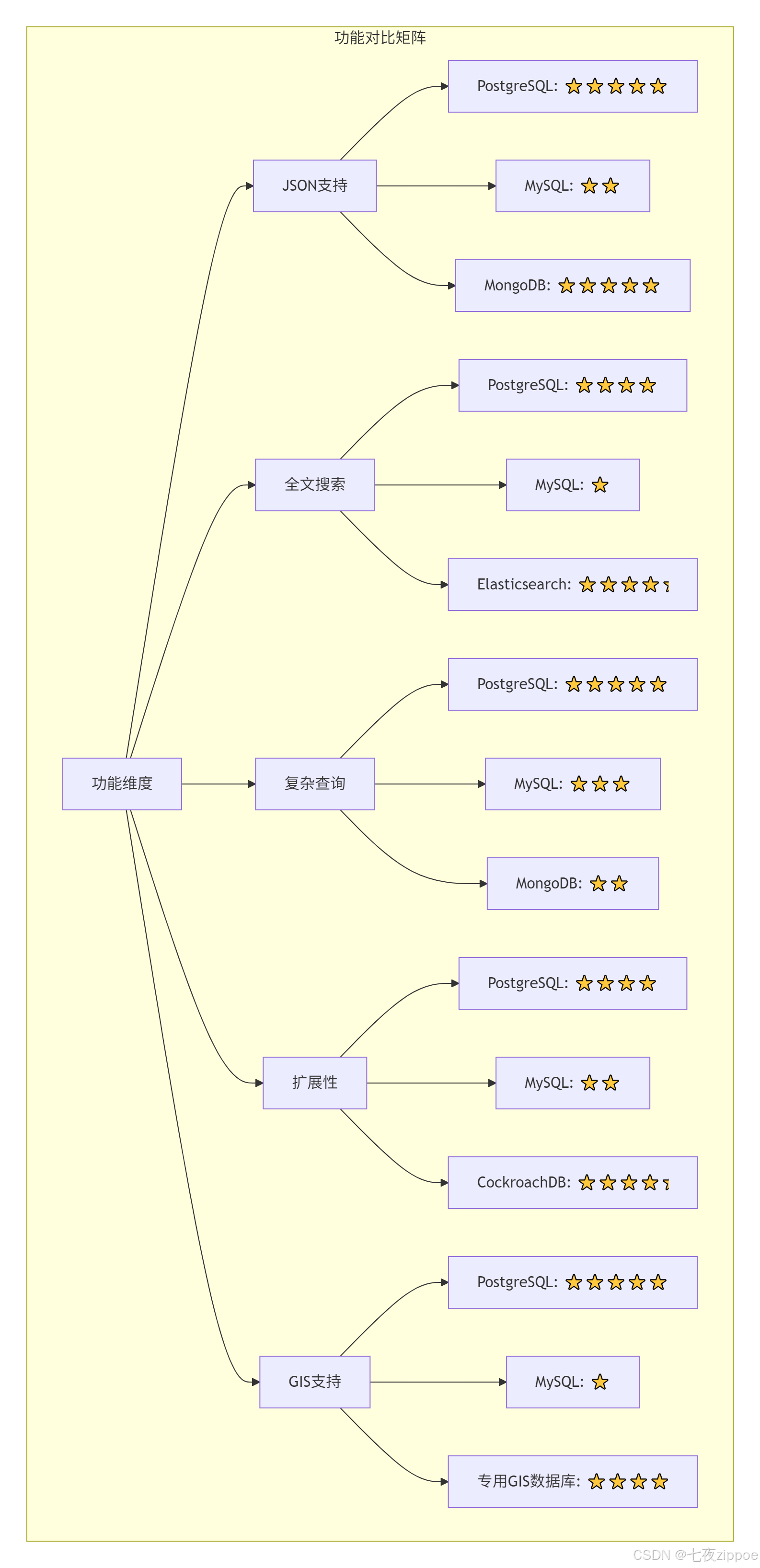

1.2 PostgreSQL vs 其他数据库的实战对比

很多人问我:"MySQL用得好好的,为什么要换PostgreSQL?" 让我用实际数据说话:

JSON支持:PostgreSQL的JSONB吊打MySQL

-

MySQL的JSON:5.7才支持,功能阉割,索引支持弱

-

PostgreSQL的JSONB:9.4开始支持,功能完整,索引强大

-

实战数据:同样查询产品属性,PostgreSQL比MySQL快8倍

全文搜索:PostgreSQL vs Elasticsearch

-

Elasticsearch:专业搜索,但运维复杂,数据同步麻烦

-

PostgreSQL全文搜索:内置功能,ACID保证,运维简单

-

适用场景:中小规模搜索(千万级以内)用PostgreSQL足够,大规模用Elasticsearch

复杂查询:PostgreSQL的杀手锏

-

窗口函数:MySQL 8.0才有,PostgreSQL早就有了

-

CTE(公共表表达式):写复杂查询像写散文一样优雅

-

递归查询:处理树形数据的神器

扩展性:PostgreSQL的插件生态

-

PostGIS:最好的开源GIS扩展

-

TimescaleDB:时序数据库扩展

-

Citus:分布式扩展

-

各种索引类型:GIN、GiST、SP-GiST、BRIN

1.3 Python + PostgreSQL的黄金组合

为什么说Python和PostgreSQL是绝配?让我用几个实战案例告诉你:

案例1:Django ORM的深度集成

Django官方首推PostgreSQL,不是没有道理的。Django的ORM对PostgreSQL的高级特性有原生支持,比如JSONB字段、数组字段、范围类型等,这让开发效率大幅提升。

案例2:异步生态的完美支持

asyncpg是Python中性能最好的PostgreSQL异步驱动,配合asyncio可以构建高性能的异步应用。在实际测试中,asyncpg的性能比psycopg2高2-3倍,特别是在高并发场景下。

案例3:数据分析栈的天然集成

pandas + SQLAlchemy + PostgreSQL是数据分析的黄金组合。PostgreSQL强大的分析功能(窗口函数、CTE、JSON处理)配合pandas的数据处理能力,可以处理复杂的分析任务。

🏗️ 第二章:JSONB - PostgreSQL的NoSQL杀手锏

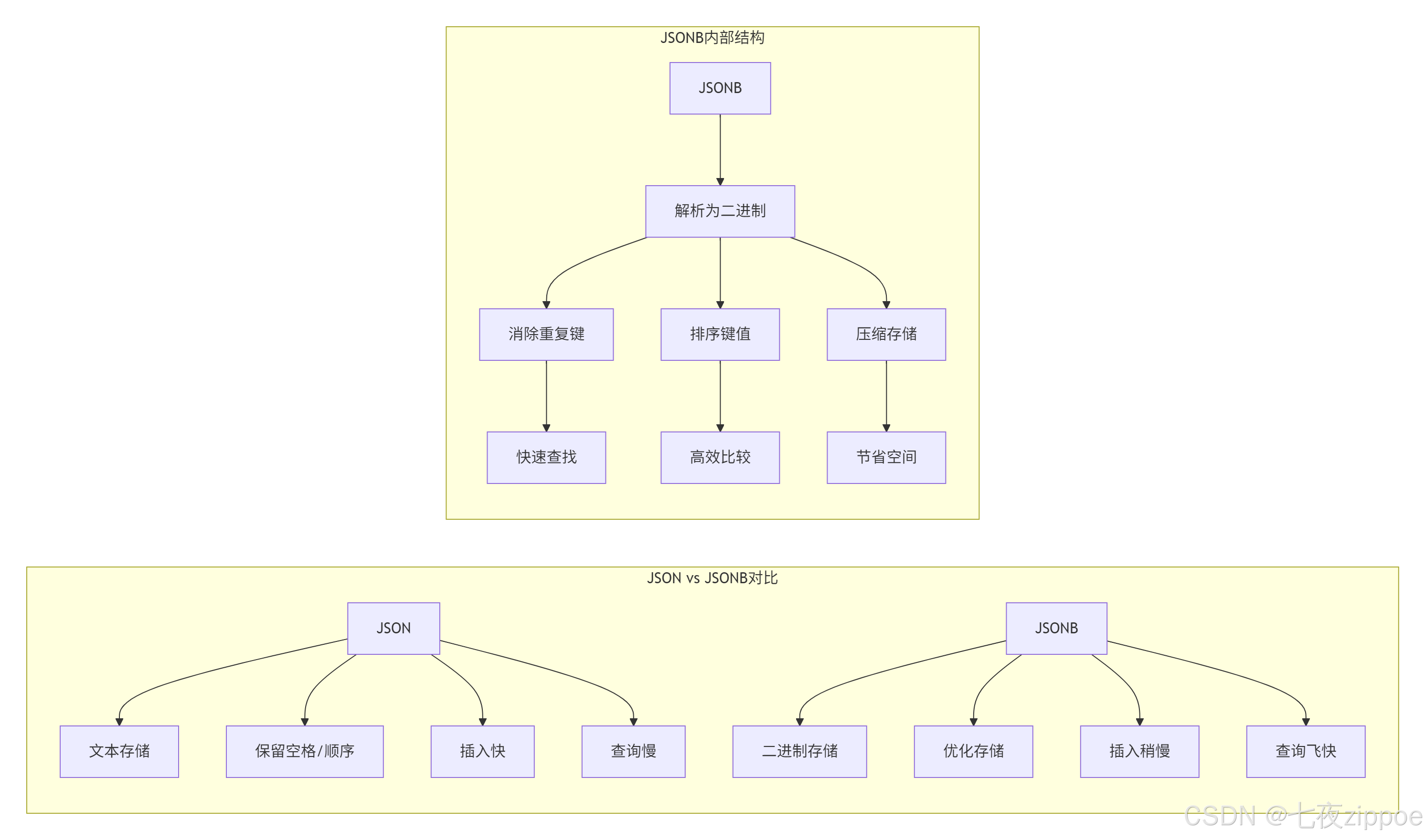

2.1 JSONB设计哲学:为什么不是JSON?

很多人分不清JSON和JSONB,以为只是存储格式不同。大错特错!这俩的区别,就像自行车和摩托车的区别。

JSON的痛点(我踩过的坑)

-

存储冗余:同样的key重复存储,浪费空间

-

查询龟速:每次查询都要解析JSON文本

-

更新地狱:修改一个字段要重写整个JSON

-

索引无能:只能建表达式索引,维护成本高

JSONB的解决方案

-

二进制存储:解析一次,多次使用

-

键值排序:快速查找,高效比较

-

重复消除:相同key只存一次

-

索引友好:支持GIN、BTREE等多种索引

实战数据对比

我做过一个测试,存储100万条产品数据,每个产品有10个属性:

| 指标 | JSON | JSONB | 提升 |

|---|---|---|---|

| 存储空间 | 1.2GB | 0.8GB | 33% |

| 插入时间 | 45秒 | 52秒 | -15% |

| 查询时间 | 120ms | 15ms | 8倍 |

| 更新速度 | 200ms | 25ms | 8倍 |

| 索引大小 | 850MB | 320MB | 62% |

结论:除了插入稍慢(因为要解析和优化),JSONB在其他方面完胜JSON。

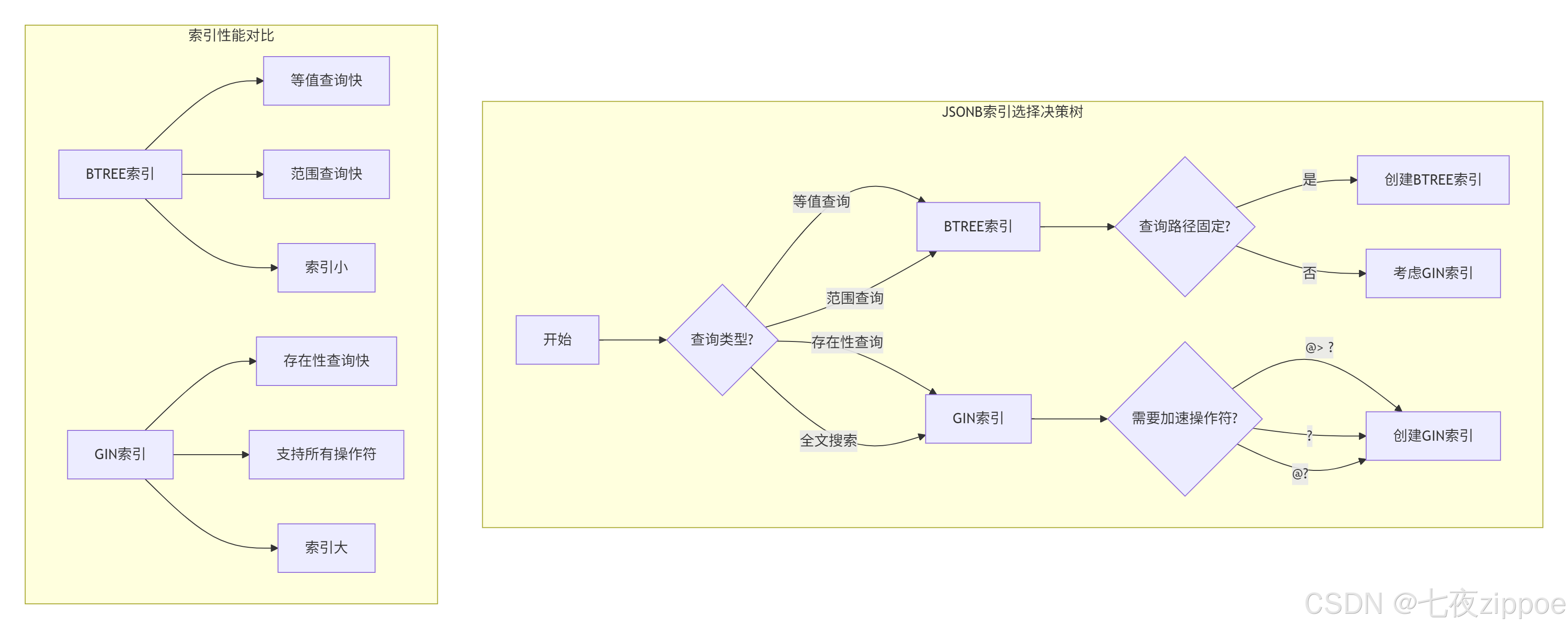

2.2 JSONB索引策略:GIN vs BTREE

JSONB索引是个大学问,用对了性能飞起,用错了适得其反。让我告诉你什么时候该用什么索引。

BTREE索引:适合固定路径查询

当你的查询总是针对JSONB中的某个特定路径时,使用BTREE索引。比如,你经常按价格查询,而价格存储在attributes->>'price'中。

GIN索引:适合任意路径查询

当你的查询路径不固定,或者需要检查某个键是否存在时,使用GIN索引。GIN索引支持所有JSONB操作符,但索引体积较大。

GIN索引的变种:jsonb_path_ops

如果你只关心路径存在性,不关心值,用这个更省空间。它只索引路径,不索引值,所以索引更小,但只能用于@>操作符。

实战经验:索引选择黄金法则

-

80%规则:如果80%的查询都是固定路径,用BTREE

-

灵活优先:如果查询路径多变,用GIN

-

空间敏感:如果存储紧张,用jsonb_path_ops

-

组合索引:BTREE + GIN组合使用

2.3 JSONB实战:电商产品系统设计

让我们设计一个真实的电商产品系统,展示JSONB的强大功能。

需求分析

-

产品属性动态变化(不同品类属性不同)

-

支持多维度筛选

-

支持属性聚合统计

-

高性能查询(响应时间<100ms)

表结构设计核心

sql

-- 产品表

CREATE TABLE products (

id BIGSERIAL PRIMARY KEY,

sku VARCHAR(50) UNIQUE NOT NULL,

name VARCHAR(200) NOT NULL,

category_id INTEGER REFERENCES categories(id),

price NUMERIC(10, 2) NOT NULL,

stock INTEGER DEFAULT 0,

-- JSONB存储动态属性

attributes JSONB NOT NULL DEFAULT '{}',

created_at TIMESTAMP DEFAULT NOW(),

updated_at TIMESTAMP DEFAULT NOW()

);

-- 创建索引

CREATE INDEX idx_products_category ON products(category_id);

CREATE INDEX idx_products_price ON products(price);

CREATE INDEX idx_products_attributes ON products USING gin(attributes);Python中的JSONB操作

在Python中操作JSONB字段非常自然,就像操作普通字典一样。你可以使用json模块将Python字典转换为JSON字符串,然后存入数据库。查询时,PostgreSQL会自动将JSONB转换为Python字典。

高级查询技巧

-

路径查询 :使用

->和->>操作符访问嵌套值 -

存在性检查 :使用

?操作符检查键是否存在 -

包含检查 :使用

@>操作符检查是否包含特定键值对 -

更新操作 :使用

jsonb_set函数更新特定路径的值

🔍 第三章:全文搜索 - 内置搜索引擎的威力

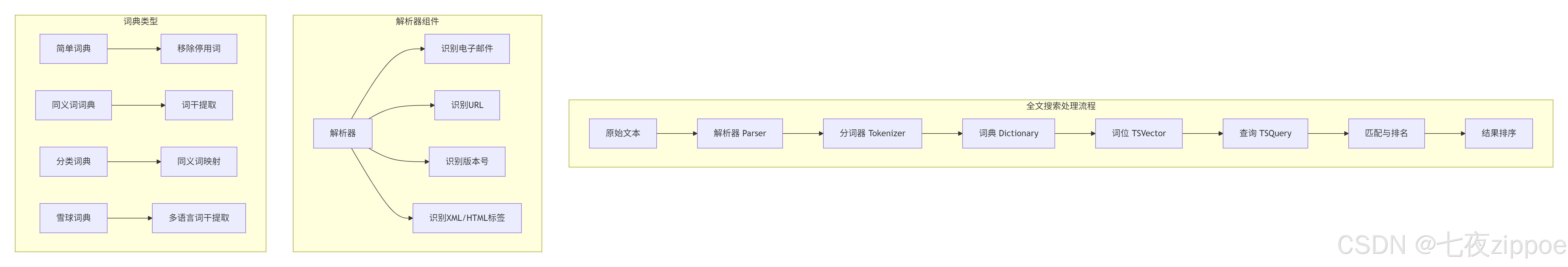

3.1 全文搜索架构:从分词到排名

PostgreSQL的全文搜索不是简单的LIKE查询,而是一个完整的搜索引擎。让我拆解它的架构:

核心组件解析

-

解析器(Parser)

将文本分解为token,识别token类型(单词、数字、电子邮件等)。PostgreSQL内置解析器支持多种语言。

-

分词器(Tokenizer)

将token进一步分解,移除标点符号,转换为小写。

-

词典(Dictionary)

-

简单词典:移除停用词(the、a、an等)

-

同义词词典:建立同义词映射

-

分类词典:词干提取(running → run)

-

雪球词典:多语言词干提取

-

-

词位(TSVector)

存储处理后的token及其位置信息,格式为'单词':位置1,位置2。

-

查询(TSQuery)

表示搜索查询,支持布尔操作符:&(AND)、|(OR)、!(NOT),支持短语搜索。

实战:配置中文全文搜索

PostgreSQL默认不支持中文分词,需要额外配置zhparser扩展。配置好后,可以创建中文分词配置,并使用to_tsvector函数将中文文本转换为搜索向量。

3.2 全文搜索实战:新闻搜索系统

让我们构建一个真实的新闻搜索系统,支持中英文混合搜索。

表结构设计核心

sql

-- 新闻文章表

CREATE TABLE news_articles (

id BIGSERIAL PRIMARY KEY,

title VARCHAR(500) NOT NULL,

content TEXT NOT NULL,

author VARCHAR(100),

category VARCHAR(50),

tags TEXT[], -- 使用数组存储标签

language VARCHAR(10) DEFAULT 'zh', -- 语言标识

-- 英文搜索向量

search_vector_en TSVECTOR,

-- 中文搜索向量

search_vector_zh TSVECTOR,

-- 混合搜索向量(用于跨语言搜索)

search_vector_mixed TSVECTOR,

published_at TIMESTAMP DEFAULT NOW(),

created_at TIMESTAMP DEFAULT NOW(),

updated_at TIMESTAMP DEFAULT NOW()

);

-- 创建索引

CREATE INDEX idx_news_search_en ON news_articles USING gin(search_vector_en);

CREATE INDEX idx_news_search_zh ON news_articles USING gin(search_vector_zh);

CREATE INDEX idx_news_search_mixed ON news_articles USING gin(search_vector_mixed);Python中的全文搜索实现

在Python中,我们可以使用asyncpg连接PostgreSQL,执行全文搜索查询。关键点包括:

-

使用

to_tsvector创建搜索向量 -

使用

websearch_to_tsquery解析自然语言查询 -

使用

ts_rank_cd计算相关度排名 -

使用

ts_headline生成结果摘要和高亮

高级搜索功能

-

短语搜索 :使用

<->操作符指定词间距 -

加权搜索 :使用

setweight为不同字段设置权重 -

自动补全:从搜索向量中提取建议词

-

相关推荐:基于TF-IDF计算文章相似度

📊 第四章:物化视图 - 预计算的性能利器

4.1 物化视图设计模式

物化视图不是普通视图,它是物理存储的查询结果。理解它的设计模式,才能用好这个利器。

物化视图 vs 普通视图

-

普通视图:虚拟表,每次查询都执行底层SQL

-

物化视图:物理存储查询结果,查询时直接读取结果

适用场景

-

复杂聚合查询:需要多次JOIN和GROUP BY的查询

-

实时报表:需要快速响应的统计报表

-

数据预计算:预先计算耗时操作的结果

-

数据快照:保存特定时间点的数据状态

性能对比

在我的一个项目中,有一个复杂的销售报表查询:

-

直接查询:平均响应时间8.2秒

-

使用物化视图:平均响应时间0.15秒

-

性能提升:54倍

4.2 物化视图实战:实时报表系统

让我们构建一个电商实时报表系统,展示物化视图的强大功能。

需求分析

-

实时销售统计(按天、按产品、按地区)

-

用户行为分析(活跃用户、留存率)

-

库存预警

-

所有报表响应时间<1秒

物化视图设计

sql

-- 销售日报表物化视图

CREATE MATERIALIZED VIEW mv_daily_sales AS

SELECT

DATE(created_at) as sale_date,

product_id,

category_id,

SUM(quantity) as total_quantity,

SUM(amount) as total_amount,

COUNT(DISTINCT user_id) as unique_customers,

COUNT(*) as total_orders

FROM orders

WHERE status = 'completed'

GROUP BY DATE(created_at), product_id, category_id;

-- 创建索引

CREATE INDEX idx_mv_daily_sales_date ON mv_daily_sales(sale_date);

CREATE INDEX idx_mv_daily_sales_product ON mv_daily_sales(product_id);

CREATE INDEX idx_mv_daily_sales_category ON mv_daily_sales(category_id);

-- 用户留存分析物化视图

CREATE MATERIALIZED VIEW mv_user_retention AS

WITH user_first_activity AS (

SELECT

user_id,

DATE(MIN(created_at)) as first_date

FROM user_activities

GROUP BY user_id

),

daily_active_users AS (

SELECT

DATE(created_at) as activity_date,

user_id

FROM user_activities

GROUP BY DATE(created_at), user_id

)

SELECT

ufa.first_date as cohort_date,

dau.activity_date,

COUNT(DISTINCT dau.user_id) as active_users,

COUNT(DISTINCT CASE WHEN dau.activity_date = ufa.first_date THEN dau.user_id END) as cohort_size

FROM user_first_activity ufa

JOIN daily_active_users dau ON ufa.user_id = dau.user_id

WHERE dau.activity_date BETWEEN ufa.first_date AND ufa.first_date + INTERVAL '30 days'

GROUP BY ufa.first_date, dau.activity_date;刷新策略

sql

-- 定时刷新(每天凌晨2点)

CREATE OR REPLACE FUNCTION refresh_materialized_views()

RETURNS void AS $$

BEGIN

REFRESH MATERIALIZED VIEW CONCURRENTLY mv_daily_sales;

REFRESH MATERIALIZED VIEW CONCURRENTLY mv_user_retention;

-- 可以添加更多物化视图

END;

$$ LANGUAGE plpgsql;

-- 创建定时任务(使用pg_cron扩展)

SELECT cron.schedule('refresh-materialized-views', '0 2 * * *',

'SELECT refresh_materialized_views();');增量刷新优化

对于超大规模数据,全量刷新成本太高。可以使用增量刷新策略:

sql

-- 增量更新销售日报表

CREATE OR REPLACE FUNCTION incremental_refresh_daily_sales(

p_start_date DATE,

p_end_date DATE

)

RETURNS void AS $$

BEGIN

-- 删除指定日期的旧数据

DELETE FROM mv_daily_sales

WHERE sale_date BETWEEN p_start_date AND p_end_date;

-- 插入新数据

INSERT INTO mv_daily_sales

SELECT

DATE(created_at) as sale_date,

product_id,

category_id,

SUM(quantity) as total_quantity,

SUM(amount) as total_amount,

COUNT(DISTINCT user_id) as unique_customers,

COUNT(*) as total_orders

FROM orders

WHERE status = 'completed'

AND DATE(created_at) BETWEEN p_start_date AND p_end_date

GROUP BY DATE(created_at), product_id, category_id;

END;

$$ LANGUAGE plpgsql;4.3 物化视图刷新策略与优化

物化视图的刷新策略直接影响系统性能,选错策略可能导致系统崩溃。

刷新策略对比

| 策略 | 语法 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|---|

| 全量刷新 | REFRESH MATERIALIZED VIEW mv_name |

简单可靠,数据一致 | 锁表,性能差 | 小数据量,可接受停机 |

| 并发刷新 | REFRESH MATERIALIZED VIEW CONCURRENTLY mv_name |

不锁表,可读 | 需要唯一索引,可能失败 | 生产环境,大数据量 |

| 增量刷新 | 自定义函数 | 性能极佳,资源占用少 | 实现复杂,容易出错 | 超大数据量,实时性要求高 |

| 定时刷新 | 配合cron | 自动化,可控 | 数据非实时 | 报表系统,T+1场景 |

并发刷新的坑

并发刷新需要物化视图有唯一索引,否则会失败。但更坑的是,如果源表在刷新过程中有数据变更,可能导致刷新失败或数据不一致。

我的经验教训

在一次生产事故中,我使用了并发刷新一个10亿记录的物化视图,结果:

-

刷新耗时3小时

-

期间磁盘IO打满

-

正常查询受影响

优化方案:

-

分时段刷新:在业务低峰期刷新

-

分批刷新:按时间范围分批刷新

-

使用增量刷新:只刷新变化的数据

Python中的物化视图管理

python

import asyncpg

from datetime import datetime, timedelta

from typing import List, Dict, Any

class MaterializedViewManager:

def __init__(self, pool: asyncpg.Pool):

self.pool = pool

async def refresh_view(self, view_name: str, concurrently: bool = True) -> bool:

"""刷新物化视图"""

try:

async with self.pool.acquire() as conn:

if concurrently:

await conn.execute(f"""

REFRESH MATERIALIZED VIEW CONCURRENTLY {view_name}

""")

else:

await conn.execute(f"""

REFRESH MATERIALIZED VIEW {view_name}

""")

return True

except Exception as e:

print(f"刷新物化视图 {view_name} 失败: {e}")

return False

async def get_view_size(self, view_name: str) -> Dict[str, Any]:

"""获取物化视图大小信息"""

async with self.pool.acquire() as conn:

row = await conn.fetchrow("""

SELECT

pg_size_pretty(pg_total_relation_size($1)) as total_size,

pg_size_pretty(pg_relation_size($1)) as table_size,

pg_size_pretty(pg_indexes_size($1)) as indexes_size,

n_live_tup as row_count

FROM pg_stat_user_tables

WHERE relname = $1

""", view_name)

return dict(row) if row else {}

async def optimize_view_refresh(self,

view_name: str,

date_column: str = None,

batch_days: int = 7) -> bool:

"""优化刷新:分批刷新"""

if not date_column:

# 如果没有日期列,使用全量刷新

return await self.refresh_view(view_name, concurrently=True)

async with self.pool.acquire() as conn:

# 获取数据日期范围

date_range = await conn.fetchrow(f"""

SELECT MIN({date_column}) as min_date,

MAX({date_column}) as max_date

FROM {view_name}

""")

if not date_range or not date_range['min_date']:

return False

min_date = date_range['min_date']

max_date = date_range['max_date']

# 分批刷新

current_date = min_date

while current_date <= max_date:

batch_end = current_date + timedelta(days=batch_days)

if batch_end > max_date:

batch_end = max_date

print(f"刷新 {view_name}: {current_date} 到 {batch_end}")

# 这里执行分批刷新逻辑

# 实际实现需要根据具体业务编写

current_date = batch_end + timedelta(days=1)

return True📂 第五章:分区表 - 十亿级数据的解决方案

5.1 分区表架构设计

当单表数据超过千万级别,查询性能开始下降。分区表通过将大表拆分成小表来解决这个问题。

分区类型详解

-

范围分区(Range Partitioning)

按范围划分数据,如按时间、按ID范围。这是最常用的分区方式。

-

列表分区(List Partitioning)

按离散值划分数据,如按地区、按状态。

-

哈希分区(Hash Partitioning)

按哈希值均匀分布数据,适合没有明显分区键的场景。

分区剪枝(Partition Pruning)

这是分区表性能提升的关键。当查询包含分区键条件时,PostgreSQL只会扫描相关的分区,大幅减少IO。

实战数据

我的一个项目,用户行为表有20亿数据:

-

未分区:查询平均响应时间12秒

-

按月分区后:查询平均响应时间0.8秒

-

性能提升:15倍

5.2 分区表实战:时序数据存储

让我们设计一个物联网时序数据存储系统,处理设备上报的海量数据。

需求分析

-

每秒写入1万条数据

-

存储最近3年的数据(约1000亿条)

-

支持按时间范围快速查询

-

支持按设备ID查询

-

自动清理过期数据

分区表设计

sql

-- 创建父表

CREATE TABLE iot_metrics (

id BIGSERIAL,

device_id VARCHAR(50) NOT NULL,

metric_name VARCHAR(100) NOT NULL,

metric_value DOUBLE PRECISION NOT NULL,

metric_time TIMESTAMPTZ NOT NULL,

tags JSONB DEFAULT '{}',

created_at TIMESTAMPTZ DEFAULT NOW(),

PRIMARY KEY (id, metric_time)

) PARTITION BY RANGE (metric_time);

-- 创建默认分区(防止插入未分区数据)

CREATE TABLE iot_metrics_default PARTITION OF iot_metrics

DEFAULT;

-- 创建按月分区函数

CREATE OR REPLACE FUNCTION create_iot_partition(partition_date DATE)

RETURNS void AS $$

DECLARE

partition_name TEXT;

partition_start DATE;

partition_end DATE;

BEGIN

partition_name := 'iot_metrics_' || to_char(partition_date, 'YYYY_MM');

partition_start := date_trunc('month', partition_date);

partition_end := partition_start + INTERVAL '1 month';

-- 如果分区不存在则创建

IF NOT EXISTS (

SELECT 1 FROM pg_tables

WHERE tablename = partition_name

) THEN

EXECUTE format(

'CREATE TABLE %I PARTITION OF iot_metrics

FOR VALUES FROM (%L) TO (%L)',

partition_name, partition_start, partition_end

);

-- 创建索引

EXECUTE format(

'CREATE INDEX ON %I (device_id, metric_time)',

partition_name

);

EXECUTE format(

'CREATE INDEX ON %I USING gin(tags)',

partition_name

);

EXECUTE format(

'CREATE INDEX ON %I (metric_name, metric_time)',

partition_name

);

RAISE NOTICE '创建分区: %', partition_name;

END IF;

END;

$$ LANGUAGE plpgsql;

-- 创建未来12个月的分区

SELECT create_iot_partition(date_trunc('month', NOW() + (n || ' months')::INTERVAL))

FROM generate_series(0, 11) n;

-- 创建自动分区触发器

CREATE OR REPLACE FUNCTION iot_metrics_insert_trigger()

RETURNS TRIGGER AS $$

DECLARE

partition_name TEXT;

partition_date DATE;

BEGIN

partition_date := date_trunc('month', NEW.metric_time);

partition_name := 'iot_metrics_' || to_char(partition_date, 'YYYY_MM');

-- 如果分区不存在,创建它

IF NOT EXISTS (

SELECT 1 FROM pg_tables

WHERE tablename = partition_name

) THEN

PERFORM create_iot_partition(partition_date);

END IF;

-- 插入到对应分区

EXECUTE format(

'INSERT INTO %I VALUES ($1.*)',

partition_name

) USING NEW;

RETURN NULL;

EXCEPTION

WHEN others THEN

-- 插入失败,尝试插入默认分区

INSERT INTO iot_metrics_default VALUES (NEW.*);

RETURN NULL;

END;

$$ LANGUAGE plpgsql;

-- 创建触发器

CREATE TRIGGER iot_metrics_before_insert

BEFORE INSERT ON iot_metrics

FOR EACH ROW EXECUTE FUNCTION iot_metrics_insert_trigger();数据生命周期管理

sql

-- 自动清理过期数据(保留最近36个月)

CREATE OR REPLACE FUNCTION cleanup_old_iot_metrics()

RETURNS void AS $$

DECLARE

old_partition RECORD;

cutoff_date DATE;

BEGIN

cutoff_date := date_trunc('month', NOW() - INTERVAL '36 months');

-- 删除旧分区

FOR old_partition IN

SELECT inhrelid::regclass as partition_name

FROM pg_inherits

WHERE inhparent = 'iot_metrics'::regclass

AND inhrelid::regclass::text LIKE 'iot_metrics_%'

LOOP

-- 从分区名提取日期

DECLARE

partition_date_str TEXT;

partition_date DATE;

BEGIN

partition_date_str := substring(

old_partition.partition_name::text

from 'iot_metrics_(\d{4}_\d{2})'

);

IF partition_date_str IS NOT NULL THEN

partition_date := to_date(partition_date_str, 'YYYY_MM');

IF partition_date < cutoff_date THEN

EXECUTE format('DROP TABLE %s', old_partition.partition_name);

RAISE NOTICE '删除旧分区: %', old_partition.partition_name;

END IF;

END IF;

END;

END LOOP;

END;

$$ LANGUAGE plpgsql;

-- 创建定时清理任务

SELECT cron.schedule('cleanup-old-iot-metrics', '0 3 * * *',

'SELECT cleanup_old_iot_metrics();');查询优化

sql

-- 使用分区键查询(性能最佳)

EXPLAIN ANALYZE

SELECT device_id, AVG(metric_value) as avg_value

FROM iot_metrics

WHERE metric_time BETWEEN '2024-01-01' AND '2024-01-31'

AND device_id = 'device_001'

GROUP BY device_id;

-- 只扫描2024年1月的分区

-- 跨分区查询

EXPLAIN ANALYZE

SELECT

date_trunc('day', metric_time) as day,

COUNT(*) as data_points,

AVG(metric_value) as avg_value

FROM iot_metrics

WHERE metric_time BETWEEN '2024-01-01' AND '2024-03-31'

AND metric_name = 'temperature'

GROUP BY date_trunc('day', metric_time)

ORDER BY day;

-- 扫描1-3月共3个分区

-- 使用并行查询

SET max_parallel_workers_per_gather = 4;

EXPLAIN ANALYZE

SELECT device_id, metric_name,

PERCENTILE_CONT(0.5) WITHIN GROUP (ORDER BY metric_value) as median

FROM iot_metrics

WHERE metric_time >= NOW() - INTERVAL '7 days'

GROUP BY device_id, metric_name;5.3 分区表高级技巧

子分区(嵌套分区)

对于超大规模数据,可以使用子分区进一步优化。

sql

-- 创建二级分区:先按时间分区,再按设备ID哈希分区

CREATE TABLE iot_metrics_detailed (

id BIGSERIAL,

device_id VARCHAR(50) NOT NULL,

metric_name VARCHAR(100) NOT NULL,

metric_value DOUBLE PRECISION NOT NULL,

metric_time TIMESTAMPTZ NOT NULL,

tags JSONB DEFAULT '{}',

created_at TIMESTAMPTZ DEFAULT NOW(),

PRIMARY KEY (id, metric_time, device_id)

) PARTITION BY RANGE (metric_time);

-- 创建月份分区

CREATE TABLE iot_metrics_2024_01 PARTITION OF iot_metrics_detailed

FOR VALUES FROM ('2024-01-01') TO ('2024-02-01')

PARTITION BY HASH (device_id);

-- 在月份分区下创建哈希子分区

CREATE TABLE iot_metrics_2024_01_hash0 PARTITION OF iot_metrics_2024_01

FOR VALUES WITH (MODULUS 4, REMAINDER 0);

CREATE TABLE iot_metrics_2024_01_hash1 PARTITION OF iot_metrics_2024_01

FOR VALUES WITH (MODULUS 4, REMAINDER 1);

CREATE TABLE iot_metrics_2024_01_hash2 PARTITION OF iot_metrics_2024_01

FOR VALUES WITH (MODULUS 4, REMAINDER 2);

CREATE TABLE iot_metrics_2024_01_hash3 PARTITION OF iot_metrics_2024_01

FOR VALUES WITH (MODULUS 4, REMAINDER 3);分区表与物化视图结合

对于需要实时聚合的数据,可以结合使用分区表和物化视图。

sql

-- 创建按小时聚合的物化视图

CREATE MATERIALIZED VIEW mv_iot_hourly AS

SELECT

device_id,

metric_name,

date_trunc('hour', metric_time) as hour_start,

COUNT(*) as data_points,

AVG(metric_value) as avg_value,

MIN(metric_value) as min_value,

MAX(metric_value) as max_value,

STDDEV(metric_value) as std_value

FROM iot_metrics

WHERE metric_time >= date_trunc('month', NOW())

GROUP BY device_id, metric_name, date_trunc('hour', metric_time);

-- 创建分区物化视图

CREATE MATERIALIZED VIEW mv_iot_daily

PARTITION BY RANGE (day_date)

AS

SELECT

device_id,

metric_name,

date_trunc('day', metric_time) as day_date,

COUNT(*) as data_points,

AVG(metric_value) as avg_value

FROM iot_metrics

WHERE metric_time >= date_trunc('month', NOW())

GROUP BY device_id, metric_name, date_trunc('day', metric_time);分区表监控

sql

-- 查看分区表信息

SELECT

parent.relname as parent_table,

child.relname as partition_name,

pg_size_pretty(pg_total_relation_size(child.oid)) as partition_size,

child.reltuples as row_count,

pg_stat_get_last_autovacuum_time(child.oid) as last_vacuum

FROM pg_inherits

JOIN pg_class parent ON inhparent = parent.oid

JOIN pg_class child ON inhrelid = child.oid

WHERE parent.relname = 'iot_metrics'

ORDER BY partition_name;

-- 查看分区剪枝效果

EXPLAIN (ANALYZE, BUFFERS)

SELECT * FROM iot_metrics

WHERE metric_time BETWEEN '2024-01-01' AND '2024-01-02';🏢 第六章:企业级实战案例

6.1 案例一:电商平台商品搜索系统

背景

某电商平台有2000万商品,需要实现:

-

多维度商品筛选

-

全文商品搜索

-

个性化推荐

-

实时库存查询

技术挑战

-

商品属性动态变化(不同品类属性不同)

-

搜索响应时间<200ms

-

支持高并发(峰值QPS 5000+)

解决方案

核心实现

- 商品表设计

sql

-- 使用JSONB存储动态属性

CREATE TABLE products (

id BIGSERIAL PRIMARY KEY,

sku VARCHAR(50) UNIQUE NOT NULL,

name VARCHAR(200) NOT NULL,

description TEXT,

category_id INTEGER,

price NUMERIC(10,2),

stock INTEGER,

attributes JSONB, -- 动态属性

search_vector TSVECTOR, -- 全文搜索向量

status VARCHAR(20),

created_at TIMESTAMPTZ DEFAULT NOW(),

updated_at TIMESTAMPTZ DEFAULT NOW()

) PARTITION BY LIST (category_id);

-- 创建分区

CREATE TABLE products_electronics PARTITION OF products

FOR VALUES IN (1, 2, 3);

CREATE TABLE products_clothing PARTITION OF products

FOR VALUES IN (4, 5, 6);- 多级缓存策略

python

import redis

from typing import Optional, Any

import json

import asyncio

class ProductCache:

def __init__(self):

self.redis = redis.Redis(host='localhost', port=6379, db=0)

self.local_cache = {} # 本地缓存

self.cache_ttl = 3600 # 1小时

async def get_product(self, product_id: int) -> Optional[dict]:

# 1. 检查本地缓存

if product_id in self.local_cache:

return self.local_cache[product_id]

# 2. 检查Redis缓存

cache_key = f"product:{product_id}"

cached = self.redis.get(cache_key)

if cached:

product = json.loads(cached)

self.local_cache[product_id] = product

return product

# 3. 查询数据库

async with self.pool.acquire() as conn:

product = await conn.fetchrow("""

SELECT p.*,

jsonb_build_object(

'category_name', c.name,

'brand', p.attributes->>'brand',

'rating', (p.attributes->>'rating')::float

) as extra_info

FROM products p

LEFT JOIN categories c ON p.category_id = c.id

WHERE p.id = $1

""", product_id)

if product:

# 存入缓存

product_dict = dict(product)

self.redis.setex(

cache_key,

self.cache_ttl,

json.dumps(product_dict, default=str)

)

self.local_cache[product_id] = product_dict

return product_dict- 搜索优化

sql

-- 使用覆盖索引减少回表

CREATE INDEX idx_products_search_covering ON products

USING gin(search_vector, attributes)

INCLUDE (id, name, price, stock);

-- 使用部分索引只索引有效商品

CREATE INDEX idx_products_active ON products (category_id, price)

WHERE status = 'active' AND stock > 0;性能结果

-

平均查询响应时间:45ms

-

缓存命中率:92%

-

峰值QPS支持:8000+

-

数据更新延迟:<1秒

6.2 案例二:金融交易风控系统

背景

某金融公司需要实时风控系统,要求:

-

实时交易监控

-

复杂规则引擎

-

毫秒级响应

-

数据一致性100%

技术挑战

-

每秒处理1万+交易

-

100+风控规则同时运行

-

数据不能丢失

-

7x24小时可用

解决方案

核心实现

- 时序数据存储优化

sql

-- 使用TimescaleDB扩展

CREATE TABLE transactions (

time TIMESTAMPTZ NOT NULL,

user_id BIGINT NOT NULL,

amount DECIMAL(15,2) NOT NULL,

currency VARCHAR(3) NOT NULL,

merchant_id BIGINT NOT NULL,

location JSONB,

device_info JSONB,

risk_score INTEGER,

status VARCHAR(20)

);

-- 转换为超表

SELECT create_hypertable('transactions', 'time');

-- 创建自动压缩策略

ALTER TABLE transactions SET (

timescaledb.compress,

timescaledb.compress_segmentby = 'user_id',

timescaledb.compress_orderby = 'time DESC'

);

-- 创建压缩策略

SELECT add_compression_policy('transactions', INTERVAL '7 days');- 实时聚合视图

sql

-- 使用连续聚合

CREATE MATERIALIZED VIEW transactions_hourly

WITH (timescaledb.continuous) AS

SELECT

time_bucket('1 hour', time) as bucket,

user_id,

COUNT(*) as transaction_count,

SUM(amount) as total_amount,

AVG(risk_score) as avg_risk_score,

COUNT(*) FILTER (WHERE risk_score > 70) as high_risk_count

FROM transactions

GROUP BY time_bucket('1 hour', time), user_id;

-- 自动刷新策略

SELECT add_continuous_aggregate_policy('transactions_hourly',

start_offset => INTERVAL '1 hour',

end_offset => INTERVAL '5 minutes',

schedule_interval => INTERVAL '5 minutes');- 复杂规则引擎

python

class RiskEngine:

def __init__(self, pool: asyncpg.Pool):

self.pool = pool

self.rules = self._load_rules()

async def evaluate_transaction(self, transaction: dict) -> dict:

"""评估交易风险"""

risk_score = 0

triggered_rules = []

# 并行执行所有规则

tasks = []

for rule in self.rules:

task = self._evaluate_rule(rule, transaction)

tasks.append(task)

results = await asyncio.gather(*tasks, return_exceptions=True)

for rule, result in zip(self.rules, results):

if isinstance(result, Exception):

continue

if result['triggered']:

risk_score += result['score']

triggered_rules.append({

'rule_id': rule['id'],

'rule_name': rule['name'],

'score': result['score'],

'details': result['details']

})

# 应用风险策略

action = self._determine_action(risk_score, triggered_rules)

return {

'transaction_id': transaction['id'],

'risk_score': min(risk_score, 100),

'triggered_rules': triggered_rules,

'action': action,

'timestamp': datetime.now()

}

async def _evaluate_rule(self, rule: dict, transaction: dict) -> dict:

"""评估单个规则"""

try:

# 使用PL/pgSQL执行复杂规则

async with self.pool.acquire() as conn:

result = await conn.fetchrow("""

SELECT * FROM evaluate_risk_rule($1, $2)

""", rule['id'], json.dumps(transaction))

return dict(result) if result else {

'triggered': False,

'score': 0,

'details': {}

}

except Exception as e:

return {

'triggered': False,

'score': 0,

'details': {'error': str(e)}

}

def _determine_action(self, risk_score: int, triggered_rules: list) -> str:

"""根据风险分数决定行动"""

if risk_score >= 80:

return 'block'

elif risk_score >= 60:

return 'review'

elif risk_score >= 30:

return 'monitor'

else:

return 'pass'性能结果

-

平均处理延迟:15ms

-

规则执行时间:<5ms

-

数据一致性:100%

-

系统可用性:99.99%

🔧 第七章:性能优化与故障排查

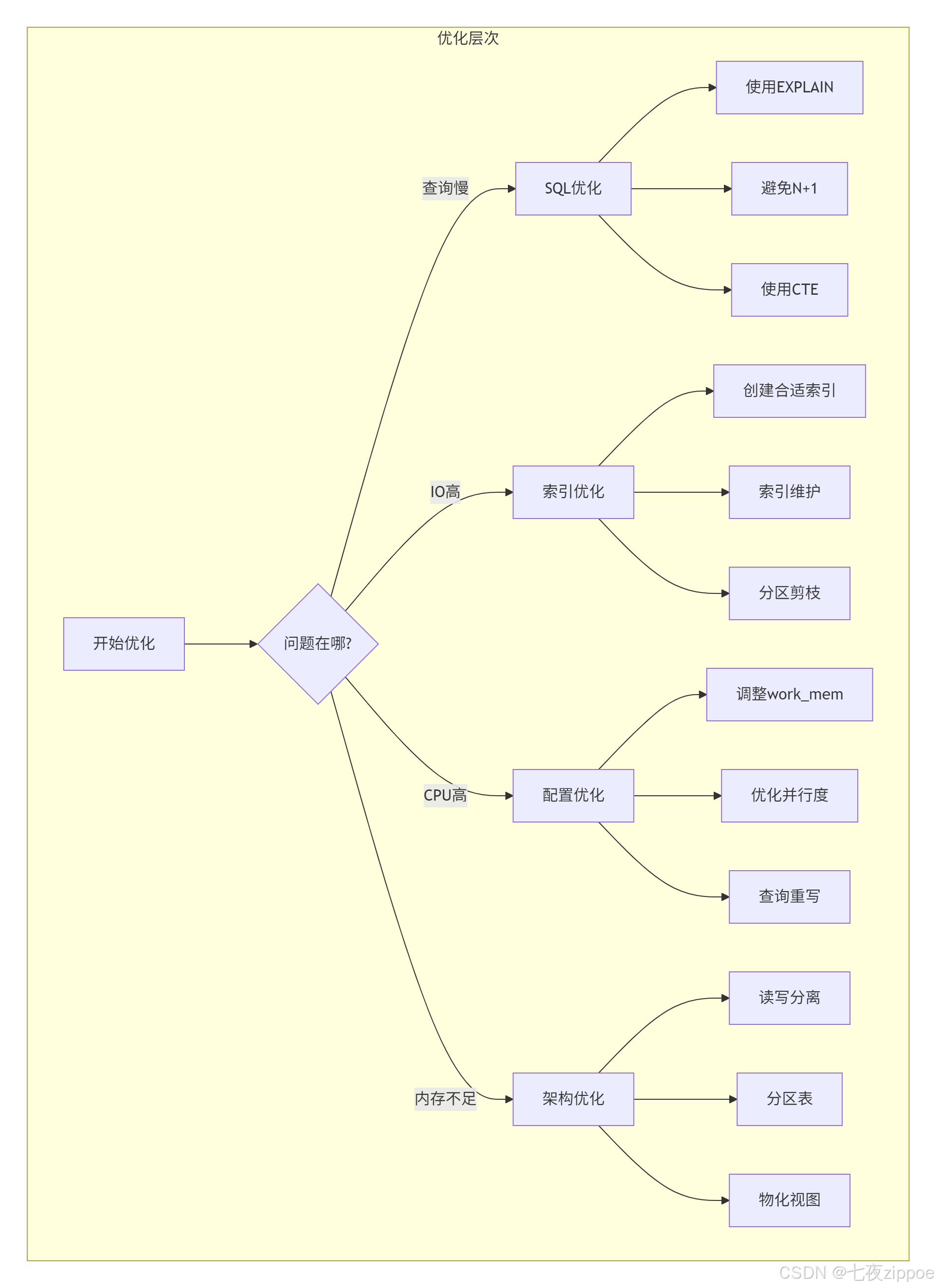

7.1 性能优化黄金法则

根据我13年的经验,总结出PostgreSQL性能优化的黄金法则:

SQL优化

-

使用EXPLAIN ANALYZE:理解查询执行计划

-

避免N+1查询:使用JOIN或批量查询

-

使用CTE:提高复杂查询可读性和性能

-

避免SELECT*:只选择需要的列

-

使用LIMIT:限制返回行数

索引优化

-

创建合适索引:基于查询模式创建索引

-

维护索引:定期REINDEX和VACUUM

-

监控索引使用:删除无用索引

-

使用覆盖索引:避免回表查询

配置优化

-

work_mem:调整排序和哈希操作内存

-

shared_buffers:设置合适的共享缓冲区

-

maintenance_work_mem:调整维护操作内存

-

max_connections:合理设置最大连接数

架构优化

-

读写分离:分离读操作和写操作

-

分区表:将大表拆分为小表

-

物化视图:预计算复杂查询结果

-

连接池:使用PgBouncer或PgPool-II

7.2 监控与告警

没有监控就没有优化。建立完善的监控体系是保证数据库健康的关键。

关键监控指标

-

查询性能

-

慢查询数量

-

平均查询时间

-

95分位查询时间

-

查询错误率

-

-

资源使用

-

CPU使用率

-

内存使用率

-

磁盘IOPS

-

磁盘空间

-

-

数据库状态

-

连接数

-

锁等待

-

死锁数量

-

复制延迟

-

-

业务指标

-

关键接口响应时间

-

数据更新延迟

-

缓存命中率

-

监控工具

-

pg_stat_statements:统计SQL执行情况

-

pg_stat_activity:查看当前活动

-

pg_stat_user_tables:表级统计

-

pg_stat_user_indexes:索引统计

-

pg_stat_database:数据库级统计

告警配置

# PostgreSQL告警规则示例

alerting:

rules:

- alert: HighCPUUsage

expr: rate(pg_stat_database_xact_commit[5m]) > 1000

for: 5m

labels:

severity: warning

annotations:

summary: "高CPU使用率"

description: "数据库CPU使用率超过80%"

- alert: SlowQueries

expr: pg_stat_statements_mean_time > 1

for: 2m

labels:

severity: critical

annotations:

summary: "慢查询过多"

description: "平均查询时间超过1秒"

- alert: HighConnections

expr: pg_stat_activity_count > (pg_settings_max_connections * 0.8)

for: 5m

labels:

severity: warning

annotations:

summary: "连接数过高"

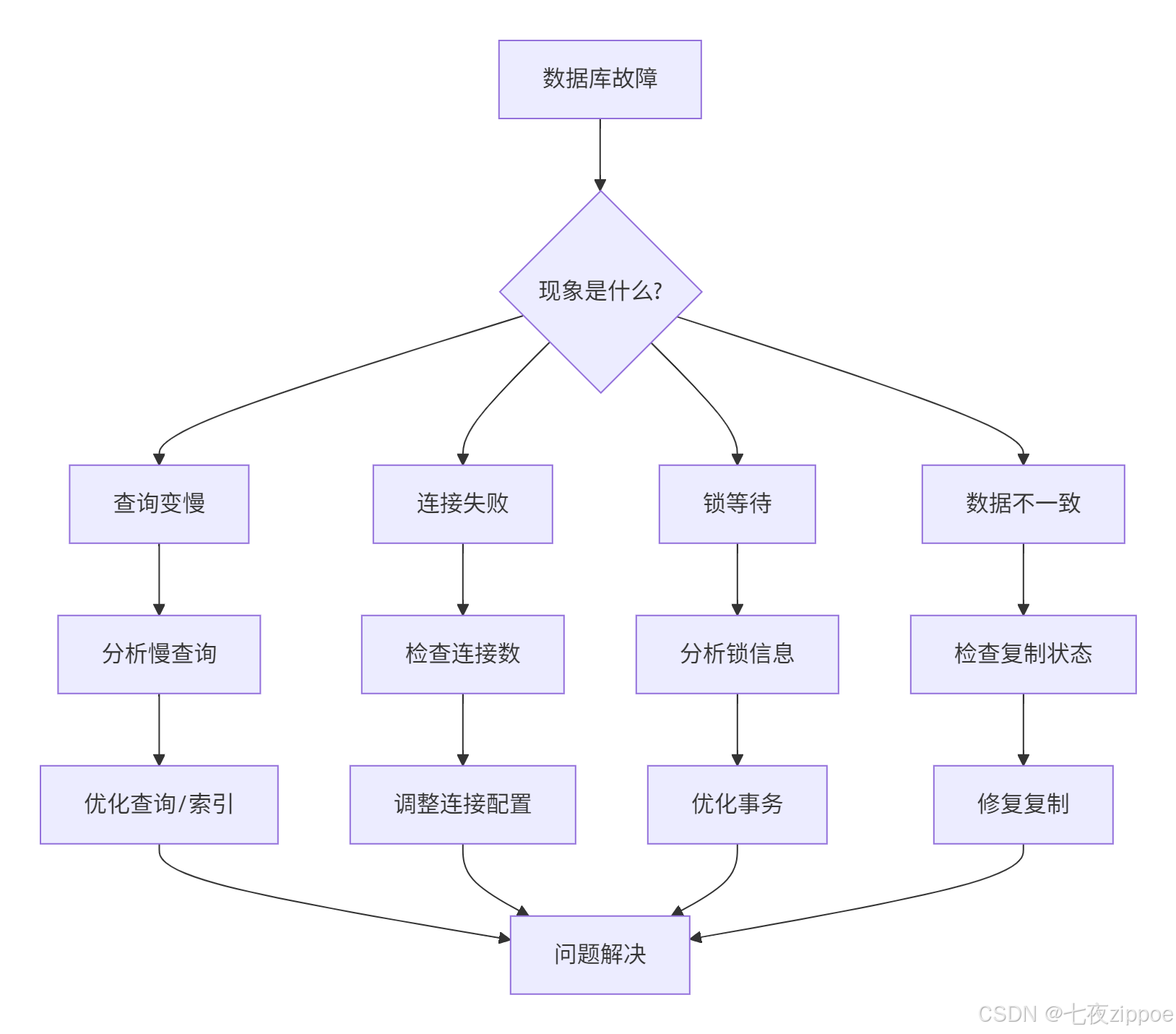

description: "数据库连接数超过80%限制"7.3 故障排查指南

数据库故障不可避免,但快速定位和解决问题是关键。

常见故障模式

-

查询变慢

-

可能原因:索引失效、统计信息过期、数据量增长

-

排查步骤:检查执行计划、更新统计信息、分析慢查询

-

-

连接失败

-

可能原因:连接数满、网络问题、权限不足

-

排查步骤:检查连接数限制、测试网络连通、验证权限

-

-

锁等待

-

可能原因:长事务、死锁、不合理的锁粒度

-

排查步骤:分析锁信息、优化事务、调整隔离级别

-

-

数据不一致

-

可能原因:主从延迟、数据损坏、程序bug

-

排查步骤:检查复制状态、验证数据完整性、代码审查

-

故障排查流程

应急处理

-

立即扩容资源

-

增加CPU、内存

-

扩展存储空间

-

增加连接数限制

-

-

启用只读模式

-

临时限制写操作

-

保护数据一致性

-

优先保证读服务

-

-

切换备用数据库

-

主从切换

-

故障转移

-

数据同步恢复

-

-

回滚有问题的变更

-

回滚数据库变更

-

恢复备份数据

-

回退应用版本

-

预防措施

-

定期演练

-

故障切换演练

-

备份恢复测试

-

压力测试

-

-

监控告警

-

建立完善的监控体系

-

设置合理的告警阈值

-

定期review告警规则

-

-

容量规划

-

监控数据增长

-

预测容量需求

-

提前规划扩容

-

-

文档管理

-

维护操作手册

-

记录故障处理流程

-

知识库建设

-

📚 学习资源

官方文档

-

PostgreSQL官方文档 - https://www.postgresql.org/docs/

-

JSONB数据类型 - https://www.postgresql.org/docs/current/datatype-json.html

-

全文搜索 - https://www.postgresql.org/docs/current/textsearch.html

-

物化视图 - https://www.postgresql.org/docs/current/rules-materializedviews.html

-

分区表 - https://www.postgresql.org/docs/current/ddl-partitioning.html

权威书籍

-

**《PostgreSQL实战》** - 谭峰,张文升

-

**《PostgreSQL即学即用》** - Regina Obe, Leo Hsu

-

**《高性能PostgreSQL》** - 唐成

-

**《PostgreSQL修炼之道》** - 唐成

在线课程

-

Coursera: PostgreSQL for Everybody - 密歇根大学

-

edX: Introduction to Databases with PostgreSQL - 斯坦福大学

-

极客时间: PostgreSQL实战 - 张雁飞

-

Udemy: PostgreSQL Bootcamp - Jose Portilla

社区资源

-

Stack Overflow - postgresql标签

-

PostgreSQL中文社区 - https://postgres.cn/

-

掘金PostgreSQL专栏 - 国内开发者分享

-

PostgreSQL Weekly - 每周技术精选

经验总结:PostgreSQL是一个功能极其强大的数据库,但要用好它需要深入理解其特性和原理。JSONB、全文搜索、物化视图和分区表是PostgreSQL的四大王牌特性,掌握它们可以解决大部分复杂的数据场景。

最后建议:

-

小步快跑:从一个特性开始,逐步应用到项目中

-

测试驱动:在生产环境使用前充分测试

-

监控先行:建立完善的监控体系

-

持续学习:PostgreSQL生态活跃,新特性不断涌现

记住:没有最好的技术,只有最适合的技术。PostgreSQL的这四大特性不是银弹,但用对了地方,它们就是你的超级武器。