在你的Mac开发机上通过Ollama运行qwen2.5:7b-instruct模型后,你可以使用curl命令直接调用其API。Ollama提供了兼容OpenAI的接口格式,非常方便。

以下是完整的curl调用示例:

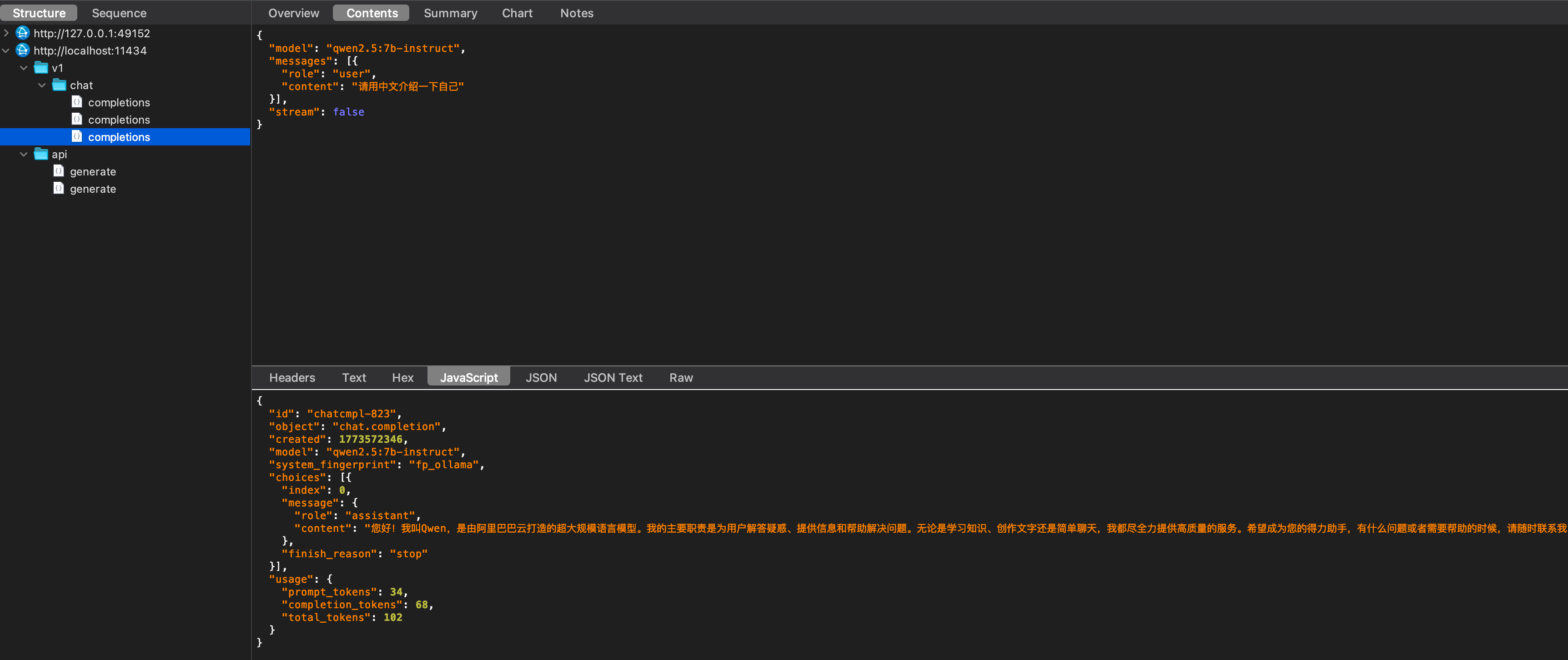

使用OpenAI兼容格式(推荐)

Ollama默认会启动一个与OpenAI API兼容的服务端点,这种方式与你之前在OpenClaw中配置模型时使用的格式一致。

bash

curl http://localhost:11434/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "qwen2.5:7b-instruct",

"messages": [

{"role": "user", "content": "请用中文介绍一下自己"}

],

"stream": false

}'参数说明:

model:指定你要使用的模型名称,必须与ollama list中显示的名称完全一致messages:符合OpenAI格式的对话消息列表stream:设为false表示等待完整响应;设为true则启用流式输出(每生成一部分内容就返回一次)

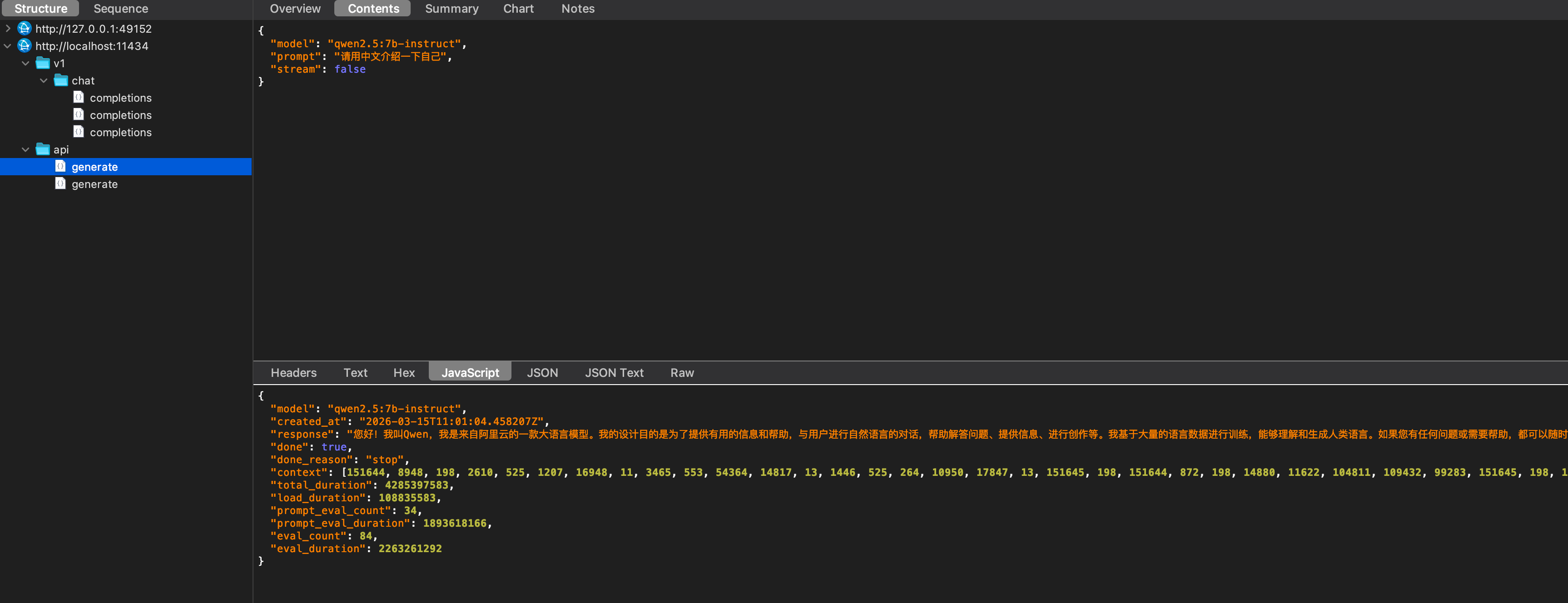

使用Ollama原生格式(备选)

如果你更喜欢Ollama原生的API格式,也可以使用/api/generate端点:

bash

curl http://localhost:11434/api/generate \

-H "Content-Type: application/json" \

-d '{

"model": "qwen2.5:7b-instruct",

"prompt": "请用中文介绍一下自己",

"stream": false

}'验证服务是否运行

在执行上述调用前,请确保:

- Ollama服务已在后台运行(可通过

ollama serve启动) - 模型已下载并可用(通过

ollama list确认qwen2.5:7b-instruct在列表中)

如果返回类似以下内容的响应,说明调用成功:

json

{

"id": "chatcmpl-xxx",

"object": "chat.completion",

"created": 1742012345,

"model": "qwen2.5:7b-instruct",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"content": "我是通义千问2.5-7B-Instruct模型,一个由阿里云开发的中文大语言模型..."

},

"finish_reason": "stop"

}

],

"usage": {

"prompt_tokens": 12,

"completion_tokens": 45,

"total_tokens": 57

}

}实用技巧

如果你想在命令行中更清晰地查看格式化的JSON响应,可以结合jq命令使用:

bash

curl -s http://localhost:11434/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{"model": "qwen2.5:7b-instruct", "messages": [{"role": "user", "content": "你好"}], "stream": false}' \

| jq '.choices[0].message.content'如果遇到连接失败的情况,请检查Ollama服务是否在后台运行,以及端口11434是否被其他程序占用。

附:执行抓包日志