Earth-Agent 论文解读报告

论文标题 :Earth-Agent: Unlocking the Full Landscape of Earth Observation with Agents

发表会议 :ICLR 2026

arxiv :2509.23141v3

作者 :Peilin Feng, Zhutao Lv, Junyan Ye 等(上海人工智能实验室 / 中山大学 / 清华大学深圳研究生院)

开源地址 :https://github.com/opendatalab/Earth-Agent

数据集:https://huggingface.co/datasets/Sssunset/Earth-Bench

一、论文概览

Earth-Agent 是第一个面向**地球观测(Earth Observation, EO)**的完整 Agent 框架,发表于 ICLR 2026。它将多模态大语言模型(MLLM)与专业地学工具库结合,在统一框架下支持 RGB 影像、原始光谱数据(Spectrum)和处理过的地球产品(Products)三类模态,实现跨模态、多步骤、定量的时空分析。

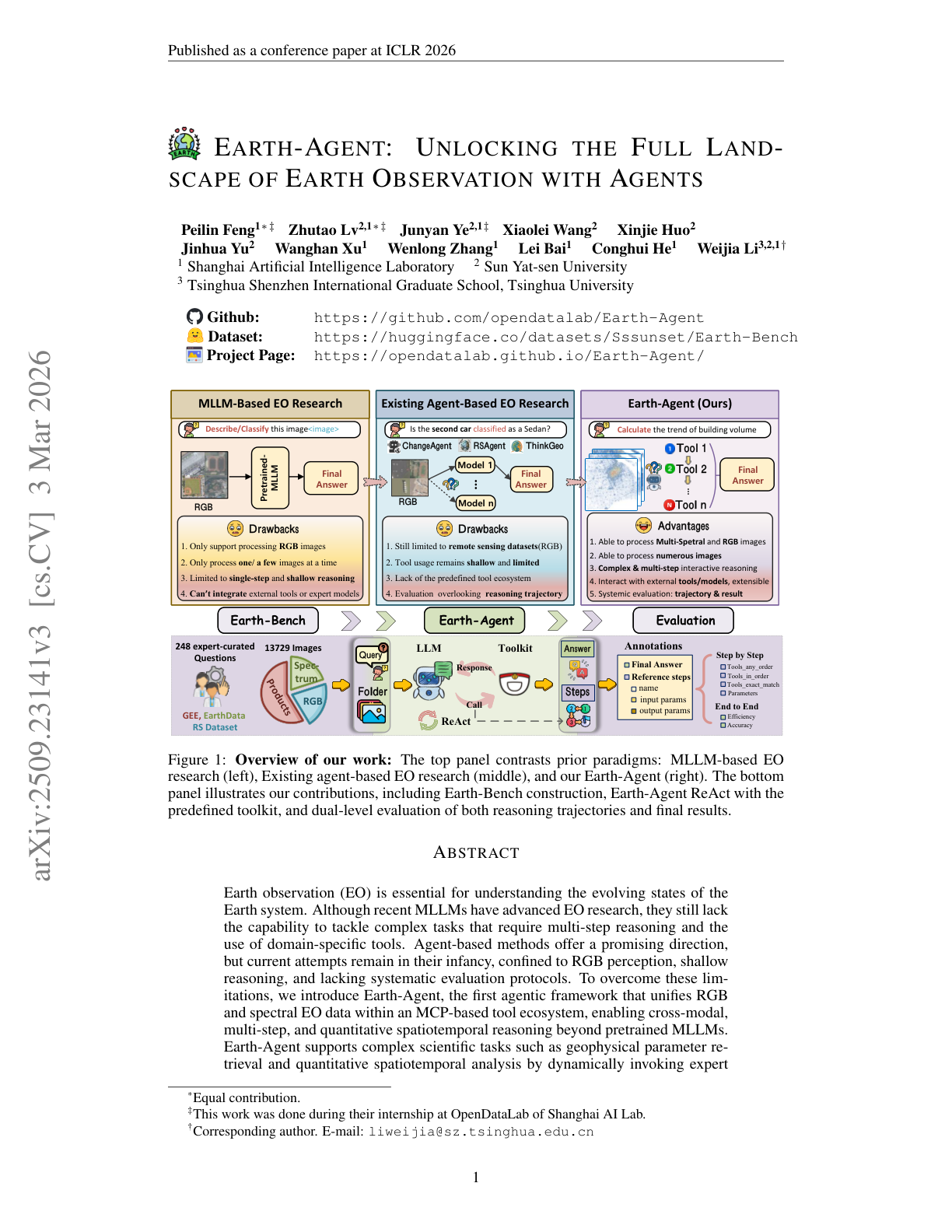

图 1:论文首页------对比了现有三类研究范式,右侧为 Earth-Agent 的核心贡献。

二、研究背景与动机

2.1 地球观测数据的两大类型

EO 数据通常分为两大类:

- 感知数据(Perceptual Data):RGB 图像,与人类视觉对齐,直观易理解;

- 原始观测数据(Raw Observational Data):包括原始光谱数据(Spectrum)和处理后的地球产品(Products),存储于 Google Earth Engine(GEE)、NASA EarthData 等地球数据库中,承载丰富的光谱与时空信息,是定量分析的基础。

2.2 现有方法的四大局限

基于 MLLM 的 EO 研究(如 GeoChat、RS-GPT)虽然在遥感感知任务上表现不错,但存在根本性缺陷:

| 局限 | 描述 |

|---|---|

| ① 模态单一 | 仅支持 RGB 图像,无法处理热红外(TIR)、合成孔径雷达(SAR)或高光谱影像 |

| ② 图像数量有限 | 每次只能处理一张或少数几张图像,难以扩展到大规模 EO 数据集 |

| ③ 推理层次浅 | 只能执行 VQA、分类等单步或浅层推理,无法完成复杂的多跳分析任务 |

| ④ 无法集成外部工具 | 受限于预训练参数中的静态知识,无法调用外部科学工具或专家模型 |

现有 Agent 类 EO 研究(如 Change-Agent、ThinkGeo、UnivEarth)虽然引入了工具调用,但仍存在:

- 大多局限于 RGB 感知任务,光谱数据支持极少

- 工具使用浅显,缺乏预定义的工具生态系统

- 评估协议不系统,只关注最终答案,忽视推理轨迹

这两方面问题共同提出了本文的核心问题:如何突破基础 RGB 感知和单步推理,设计一个集成多元 EO 模态、支持复杂多步骤科学分析的系统?

三、Earth-Agent 框架

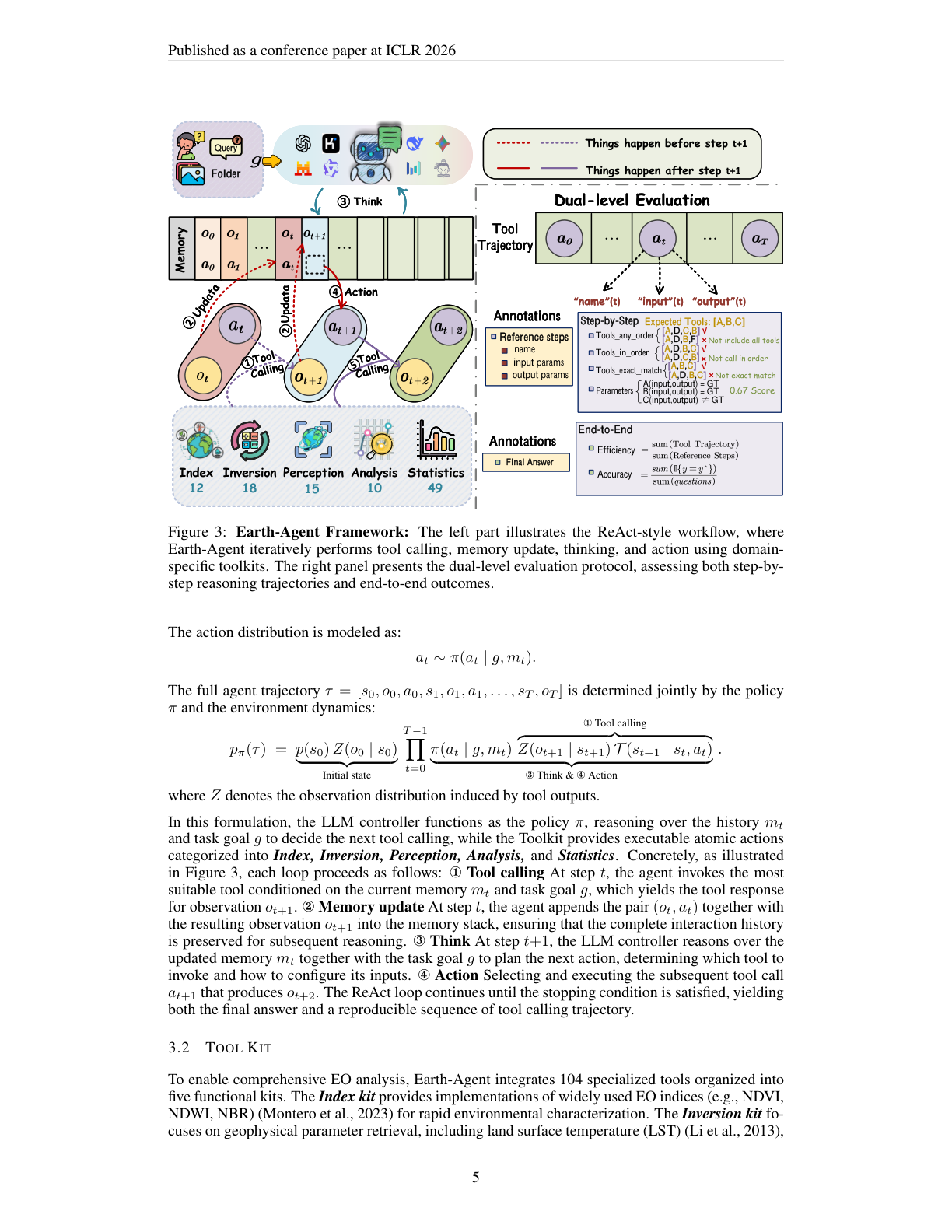

图 3:Earth-Agent 完整框架------左侧展示 ReAct 风格的工作流(工具调用→记忆更新→思考→动作),右侧展示双层评估协议。

3.1 运作机制:ReAct 风格的 POMDP

Earth-Agent 将工作过程形式化为部分可观测马尔可夫决策过程(POMDP) ,定义为元组 ⟨ g , S , A , O , T ⟩ \langle g, S, A, O, T \rangle ⟨g,S,A,O,T⟩:

- g g g:任务目标

- S S S:状态空间(不可观测的地理空间数据文件、栅格值等)

- A A A:动作空间(工具调用集合)

- O O O:观测空间(工具返回的文本、数值、图像等输出)

- T : S × A → S T: S \times A \rightarrow S T:S×A→S:状态转移函数

每一步推理循环依次执行:

- ① 工具调用(Tool Calling) :基于当前记忆 m t m_t mt 和任务目标 g g g,调用最合适的工具,获得工具响应 o t + 1 o_{t+1} ot+1;

- ② 记忆更新(Memory Update) :将 ( o t , a t ) (o_t, a_t) (ot,at) 和新观测 o t + 1 o_{t+1} ot+1 追加到记忆栈,保留完整交互历史;

- ③ 思考(Think) :LLM 控制器基于更新后的记忆 m t m_t mt 和任务目标 g g g 规划下一步动作;

- ④ 动作(Action) :选择并执行下一个工具调用 a t + 1 a_{t+1} at+1。

循环持续到停止条件满足,最终输出答案及可复现的工具调用轨迹。

3.2 工具库:104 个专业工具,5 大类别

Earth-Agent 基于**模型上下文协议(MCP)**构建了 104 个专业工具,按功能分为五个工具套件:

| 工具套件 | 数量 | 功能 | 典型工具 |

|---|---|---|---|

| Index(指数) | 12 | 常用 EO 指数计算 | NDVI、NDWI、NBR |

| Inversion(反演) | 18 | 地球物理参数反演 | 地表温度(LST)、降水水汽(PWV)、植被含水量 |

| Perception(感知) | 15 | 视觉感知任务 | 场景分类、目标检测、语义分割 |

| Analysis(分析) | 10 | 时空推理分析 | 趋势检测、季节性分解、变化点分析、空间自相关 |

| Statistics(统计) | 49 | 大规模数据预处理与统计计算 | 方差、偏度、批量操作、云掩膜 |

这一结构化设计不仅支持从感知到光谱、从描述性到定量分析的全类型 EO 任务,还具有良好的可扩展性------可方便地添加新的领域工具。

3.3 双层评估协议

端到端(End-to-End)评估:

- 准确率(Accuracy):最终答案的正确率

- 效率(Efficiency):相对于专家参考解的轨迹效率

逐步(Step-by-Step)评估:

| 指标 | 含义 |

|---|---|

| Tool-Any-Order | 检查是否使用了所有必要工具(不限顺序) |

| Tool-In-Order | 工具调用顺序是否正确 |

| Tool-Exact-Match | 预测轨迹与专家轨迹的前缀级精确匹配 |

| Parameters | 工具标识符及参数是否正确匹配 |

四、Earth-Bench 基准

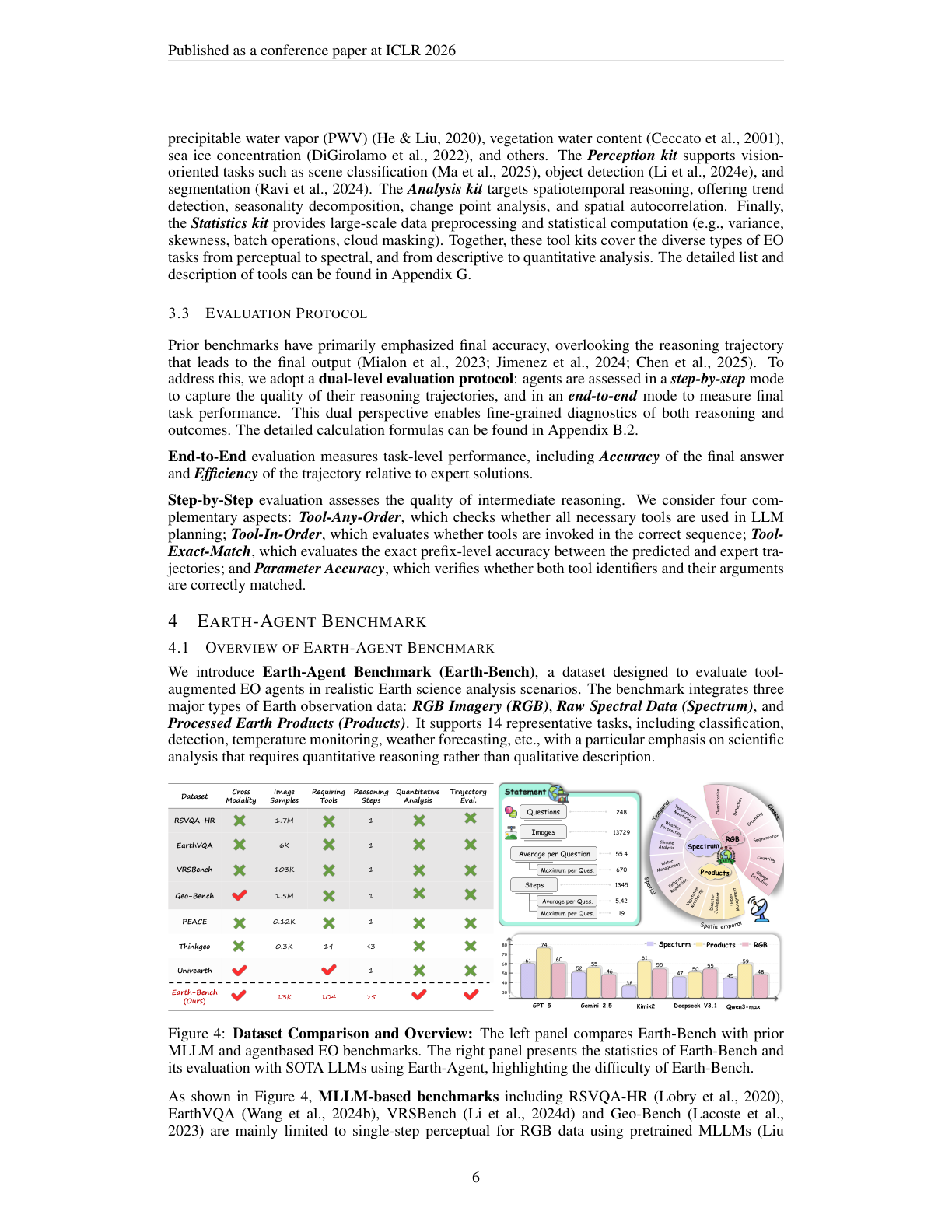

图 4:Earth-Bench 与现有基准的对比(左)及数据集统计与 SOTA LLM 测试结果(右)。

4.1 基准概况

Earth-Bench 是专为评估工具增强型 EO Agent 设计的专业基准,具备以下特点:

| 属性 | 数值 |

|---|---|

| 问题数量 | 248 道(专家精心设计) |

| 图像数量 | 13,729 张 |

| 平均每题图像数 | 55.4 张 |

| 最多单题图像数 | 670 张 |

| 推理步骤总数 | 1,345 步 |

| 平均每题步骤数 | 5.42 步 |

| 最多单题步骤数 | 19 步 |

覆盖 14 类任务:分类、检测、分割、目标定位(Grounding)、计数、变化检测、温度监测、天气预报、气候分析、水资源管理、污染监管、植被监测、城市管理、灾害判断。

三种数据模态:Spectrum(光谱)、Products(地球产品)、RGB(光学影像)。

4.2 与现有基准的差距

Earth-Bench 远超现有 MLLM 和 Agent 类基准:

| 基准 | 图像规模 | 工具数量 | 推理步骤 | 轨迹评估 |

|---|---|---|---|---|

| RSVQA-HR | 1.7M | --- | 1 | ✗ |

| EarthVQA | 6K | --- | 1 | ✗ |

| VRSBench | 103K | --- | 1 | ✗ |

| PEACE | 0.12K | --- | 1 | ✗ |

| ThinkGeo | 0.3K | 14 | ❤️ | ✗ |

| UnivEarth | --- | --- | 1 | ✗ |

| Earth-Bench (Ours) | 13K | 104 | >5 | ✓ |

4.3 数据标注流程

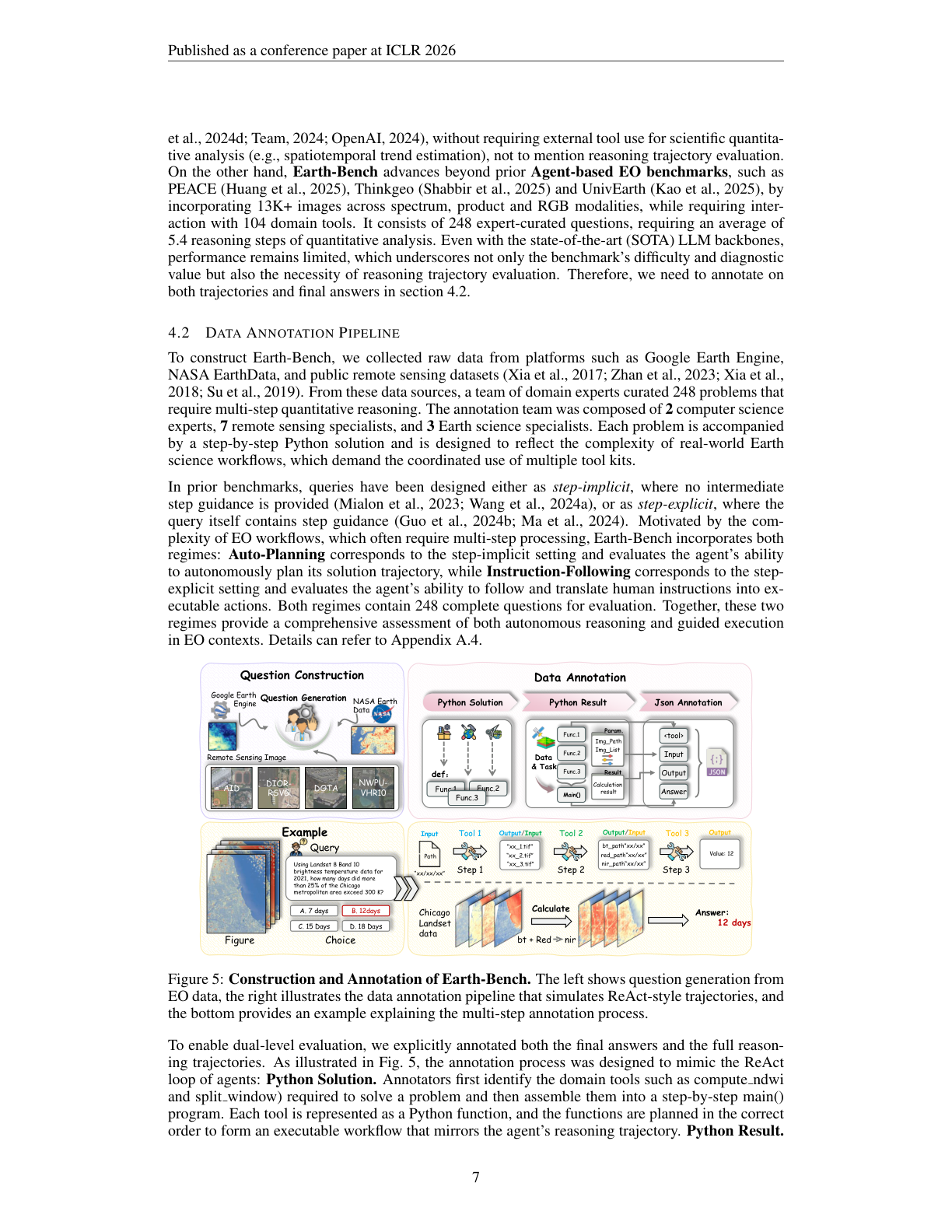

图 5:Earth-Bench 的构建与标注流程------左侧展示从 EO 数据生成问题,右侧展示模拟 ReAct 风格轨迹的标注流水线,底部给出多步标注示例。

标注团队由 2 名计算机科学专家 + 7 名遥感专家 + 3 名地球科学专家 组成,标注过程分三步:

- Python Solution :标注者确定所需工具并将其组装为逐步的

main()程序; - Python Result:执行程序,获取每个函数调用的显式输入输出参数及最终结果;

- JSON Annotation:将每个函数调用转换为结构化 JSON 记录,对齐 ReAct 风格的轨迹格式。

两种查询机制:

- Auto-Planning(自主规划):隐式步骤,评估 Agent 自主规划解题路径的能力;

- Instruction-Following(指令跟随):显式步骤,评估 Agent 将人类指令转化为可执行动作的能力。

五、实验结果

5.1 不同 LLM 骨干对比

论文评估了 3 个闭源 + 10 个开源 LLM 在 Earth-Bench 上的表现:

| 模型 | 准确率 (AP) | 准确率 (IF) | Tool-Any-Order (AP) | Tool-Any-Order (IF) |

|---|---|---|---|---|

| GPT-5 | 65.99 | 62.35 | 68.74 | 71.41 |

| Gemini-2.5 | 52.23 | 53.04 | 58.04 | 61.63 |

| GPT-4o | 43.72 | 44.94 | 65.65 | 67.02 |

| Kimik2 | 50.61 | 56.68 | 71.03 | 78.86 |

| DeepSeek-V3.1 | 51.42 | 52.23 | 78.31 | 78.66 |

| Qwen3-Max | 50.20 | 47.37 | 69.56 | 70.14 |

| Seed-1.6 | 52.48 | 59.51 | 55.43 | 59.44 |

| LLaMA-4 | 44.94 | 38.46 | 16.51 | 22.41 |

| GLM-4.5v | 32.86 | 35.25 | 42.48 | 46.69 |

| Mistral | 29.96 | 22.67 | 27.73 | 29.64 |

| InternVL-3.5 | 26.72 | 26.72 | 8.83 | 16.62 |

AP = Auto-Planning(自主规划),IF = Instruction-Following(指令跟随)

关键观察:

-

Obs.1:预训练了工具调用能力的 LLM(GPT-5、Gemini-2.5、DeepSeek-V3.1、Kimik2、Qwen3)整体表现更强。闭源模型 GPT-5 最终准确率最高,但开源模型 DeepSeek-V3.1 和 Kimik2 在工具使用准确率上超越 GPT-5,展现出更强的推理轨迹对齐能力。

-

Obs.2:指令跟随模式提升了几乎所有模型的工具调用准确率,但有趣的是,对于部分高级模型,显式步骤反而可能导致最终准确率下降------过多约束可能限制模型的灵活推理。

-

Obs.3:大多数模型在 Tool-Any-Order 和 Tool-In-Order 上表现不错,但经常引入无关步骤,这严重拖累了 Tool-Exact-Match 和参数执行准确率。这一"精确执行瓶颈"是阻碍 EO Agent 达到更高最终准确率的关键问题。

5.2 与通用 Agent 框架对比

由于 Earth-Bench 中许多任务需要处理数百张图像,现有开源 Agent 框架因输入规模限制无法处理。论文构建了 Earth-Bench-Lite(60 道题,三种模态各 20 道)进行公平比较:

| 方法 | Spectrum | Products | RGB | 平均 | 延迟 |

|---|---|---|---|---|---|

| GPT-Agent | 45.00 | 31.60 | 45.26 | 40.42 | ≈300 min |

| MGX | 40.00 | 15.80 | 0.00 | 18.60 | ≈60 min |

| Manus | 15.00 | 15.80 | 47.62 | 26.14 | ≈150 min |

| Coze | 35.00 | 10.50 | 0.00 | 15.30 | ≈120 min |

| Earth-Agent (GPT-5) | 65.00 | 36.84 | 65.71 | 55.83 | 158 min |

| Earth-Agent (DeepSeek-V3.1) | 50.00 | 42.11 | 51.43 | 47.84 | 79 min |

| Earth-Agent (Kimik2) | 36.84 | 50.00 | 50.00 | 45.95 | 131 min |

通用 Agent(GPT-Agent、Manus、Coze、MGX)能对 Spectrum 任务通过即兴编写代码勉强处理,但在 Products 任务上因缺少领域专用时空分析工具而大幅落后;MGX 和 Coze 甚至无法完成任何 RGB 任务。Earth-Agent 在三种模态上全面领先。

5.3 与遥感 MLLM 方法对比

| 方法 | AID(分类) | WHU-RS19(分类) | DOTA(检测) | HRSC2016(检测) | DIOR-RSVG(定位) |

|---|---|---|---|---|---|

| MiniGPT-v2 | 32.96 | 64.80 | 14.8 | 24.8 | 29.892 |

| LLaVA-1.5 | 51.00 | 74.52 | 17.5 | 22.1 | 12.085 |

| GeoChat | 72.03 | 86.47 | 16.5 | 24.0 | 10.024 |

| VHM | 91.70 | 95.80 | --- | --- | --- |

| LHRS-Bot | 91.26 | 93.17 | 17.1 | 24.4 | 11.826 |

| Earth-Agent (ours) | 93.42 | 96.12 | 60.88 | 65.60 | 60.46 |

Earth-Agent 在所有对比基准上全面超越现有 MLLM 方法。特别在检测(DOTA、HRSC2016)和定位(DIOR-RSVG)任务上,提升幅度极为显著------这得益于其可调用的 104 个专业工具和专家模型,实现了跨任务类型的稳定泛化能力。

六、案例分析

案例 1:光谱数据定量推理(Spectrum)

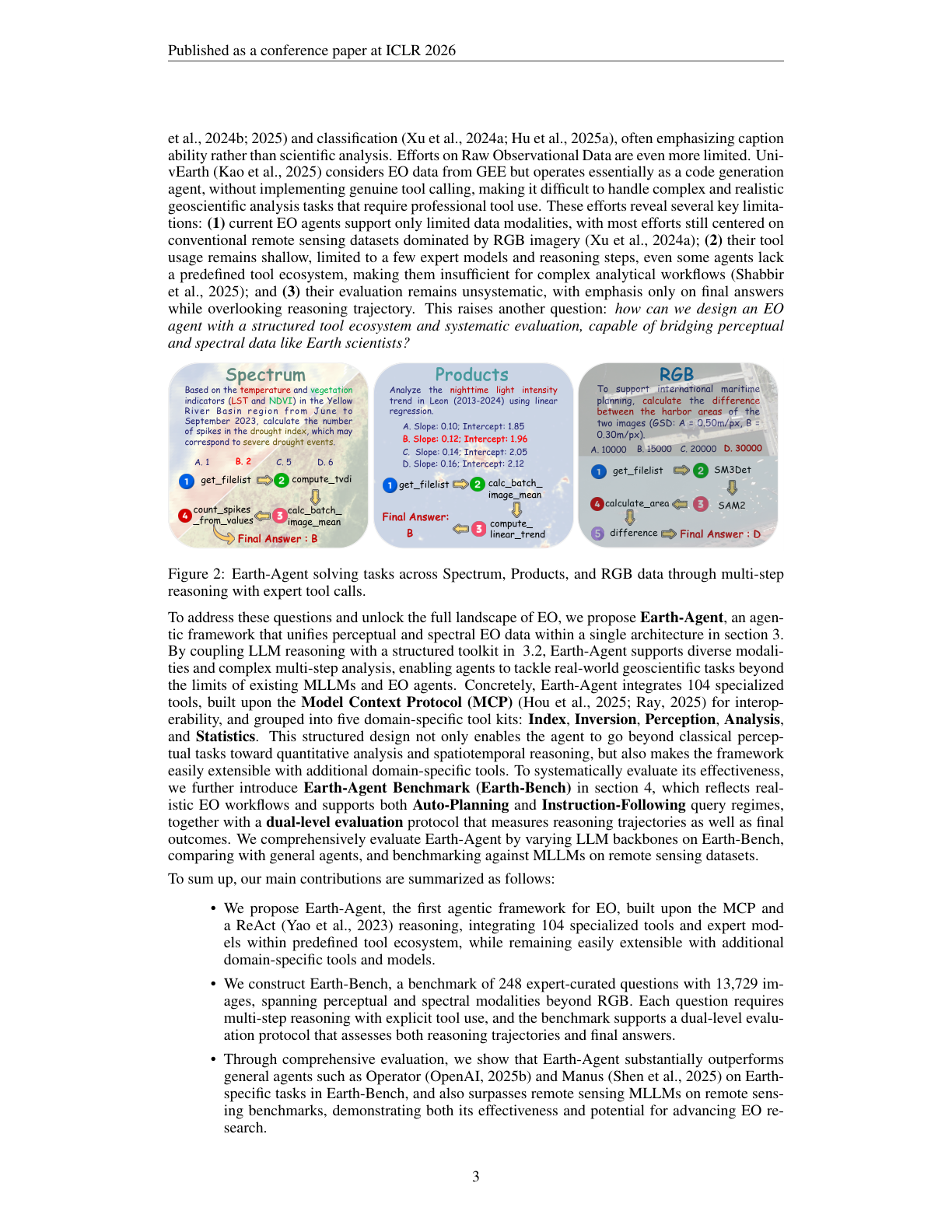

图 2:Earth-Agent 在光谱(Spectrum)、地球产品(Products)和 RGB 三类数据上的多步推理工具调用示例。

问题:基于 2023 年 6-9 月黄河流域的温度和植被指数(LST 和 NDVI),计算干旱指数的峰值次数(对应严重干旱事件)。

Earth-Agent 解题流程:

get_filelist--- 获取数据文件列表compute_tvdi--- 计算温度植被干旱指数(TVDI)calc_batch_image_mean--- 批量计算图像均值count_spikes_from_values--- 统计干旱指数峰值次数- Final Answer: B(2次)

案例 2:地球产品时空趋势分析(Products)

问题:利用 2013-2024 年莱昂市的夜间灯光强度数据,通过线性回归分析趋势。

Earth-Agent 解题流程:

get_filelist--- 获取文件列表calc_batch_image_mean--- 批量计算图像均值compute_linear_trend--- 线性趋势计算- Final Answer: B(斜率 0.12,截距 1.96)

案例 3:上海建筑体积线性趋势(复杂 Products 任务)

问题:基于 1980-2025 年上海的建筑总体积与非住宅体积数据,计算住宅体积整体变化的线性趋势。

Earth-Agent 解题流程:

get_filelist--- 获取数据目录(20张图像)subtract--- 计算住宅体积 = 总量 - 非住宅calc_batch_image_mean--- 批量计算均值(1980-2025年时序数据)compute_linear_trend--- 拟合线性趋势- Final Answer: A(267.13 单位/年,呈强增长趋势)

七、核心贡献总结

Earth-Agent 的三大贡献:

1. 首个 MCP 架构的 EO Agent 框架

├── 104 个专业地学工具(5大类)

├── ReAct 推理循环

├── 支持 RGB + Spectrum + Products 三模态

└── 基于 MCP 协议,易于扩展

2. Earth-Bench 专业评估基准

├── 248 道专家级问题 + 13,729 张图像

├── 三种数据模态(RGB / Spectrum / Products)

├── 平均 5.4 步推理

└── 双层评估(轨迹 + 结果)

3. 全面实验验证

├── 13 种 LLM 骨干评测

├── 对比 4 种通用 Agent(GPT-Agent/Manus/Coze/MGX)

└── 对比 6 种遥感 MLLM(GeoChat/VHM/LHRS-Bot 等)八、意义与展望

范式转变

Earth-Agent 标志着 EO 分析从"静态预训练 MLLM 推理 "向"动态工具增强 Agent 推理"的范式转变:

| 对比维度 | 传统 MLLM | Earth-Agent |

|---|---|---|

| 数据模态 | 仅 RGB | RGB + 光谱 + 地球产品 |

| 图像数量 | 1-数张 | 数百张 |

| 推理深度 | 单步感知 | 多步定量分析 |

| 工具集成 | 无 | 104 个专业工具 |

| 评估维度 | 最终答案 | 轨迹 + 结果双层 |

当前瓶颈

从实验结果来看,EO Agent 面临的主要瓶颈是精确执行能力:模型往往能识别正确的工具集(Tool-Any-Order 表现好),但容易引入多余步骤,导致 Tool-Exact-Match 和参数准确率偏低。这在真实 EO 数据处理中后果严重------错误的中间变换会使后续步骤完全失效。

未来方向

- 提升 LLM 对工具参数的精确控制能力(精确执行)

- 扩展工具库到更多地球科学子领域

- 提升 Agent 在更大规模图像集(数千张)上的处理效率

- 引入更强的地球科学先验知识

九、参考资源

- 论文 :arxiv 2509.23141

- 代码 :GitHub - opendatalab/Earth-Agent

- 基准数据集 :HuggingFace - Earth-Bench

- 项目主页 :Earth-Agent Project Page