李宏毅老师《80分鐘快速了解大型語言模型》(2024)课程的学习笔记

深度学习

↓

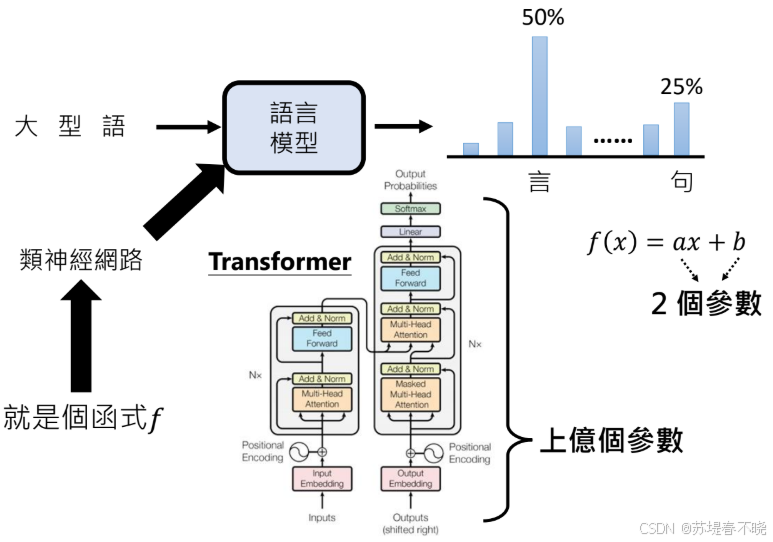

Transformer (2017)

↓

LLM(Transformer neural network architecture 是 LLM 的关键技术)

↓

AIGC 爆发

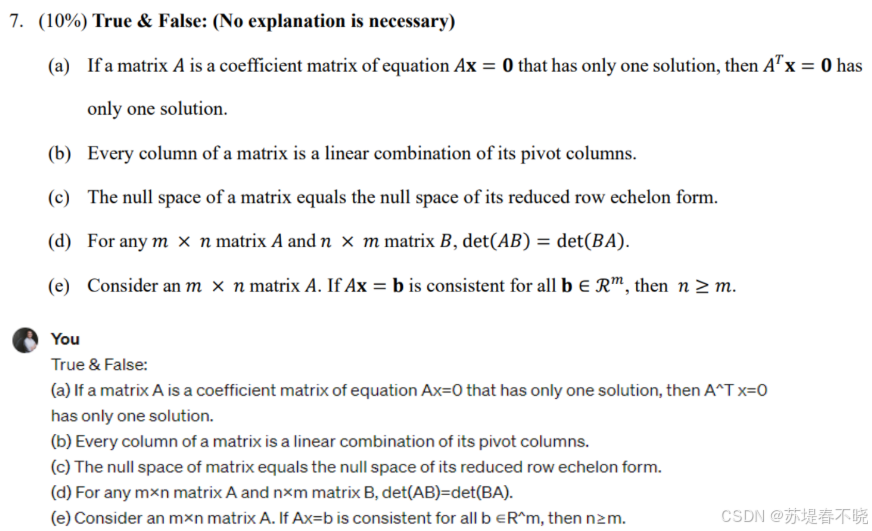

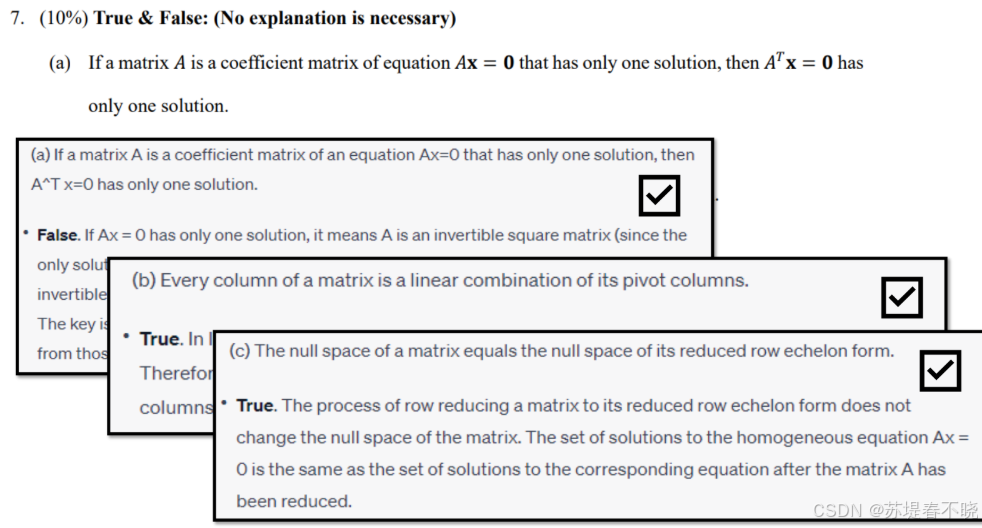

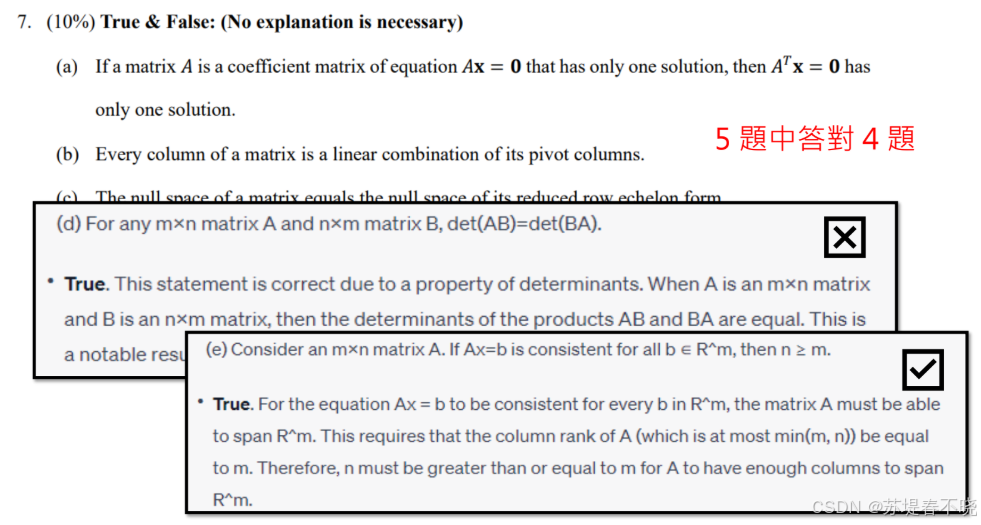

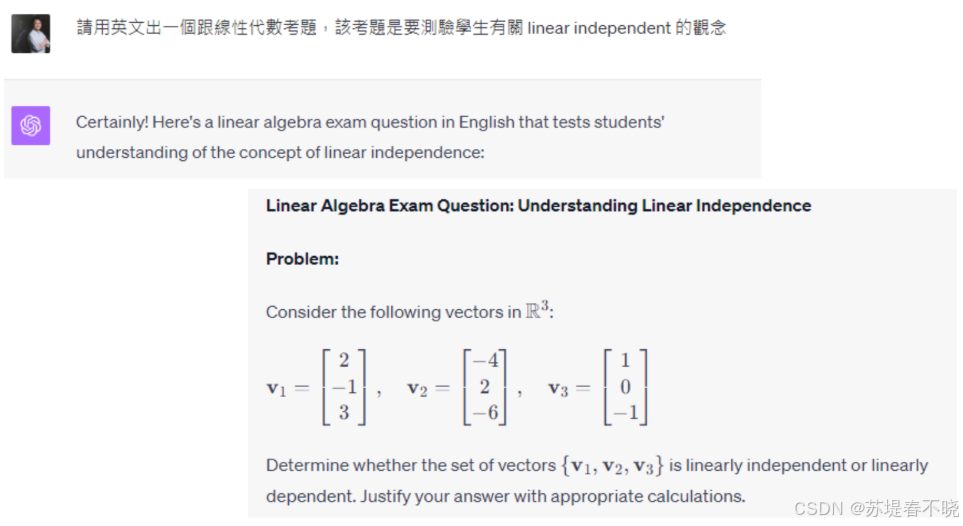

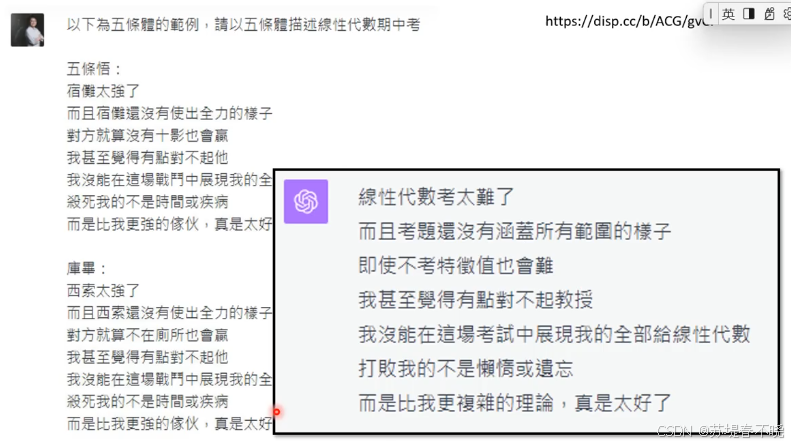

把 no explanation necessary 去掉直接丢给 GPT-4

里面有陷阱题,GPT 也没能答对

帮忙出考题,偏简单了

结合动漫角色,评价考题

上面展示了目前 LLM 的能力

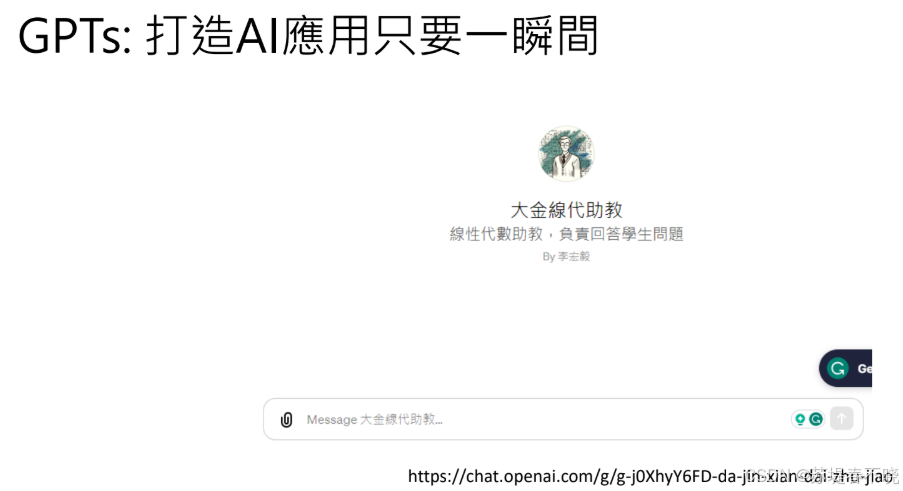

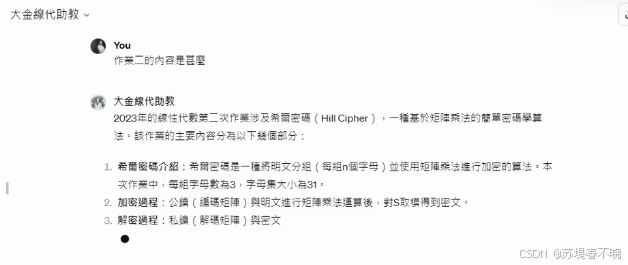

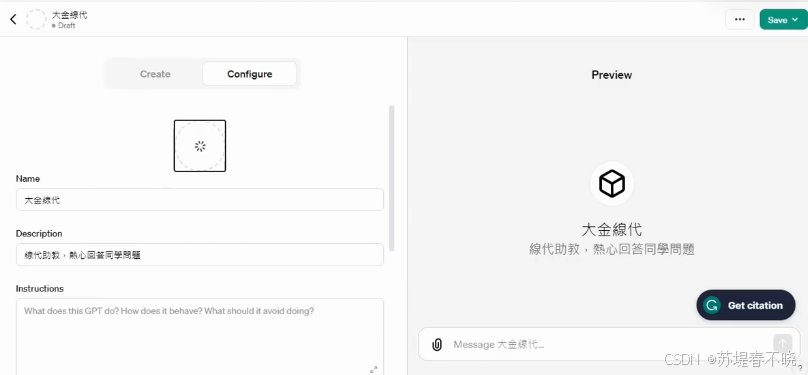

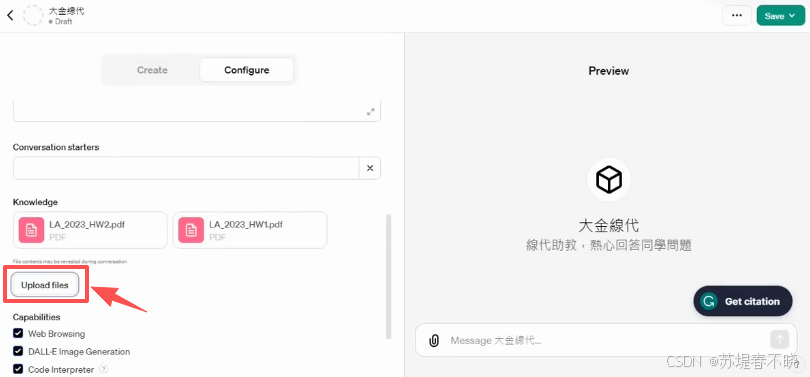

为该门课程专门打造的 GPT

通过对话的功能,定制自己的 GPT

上传课程相关文件

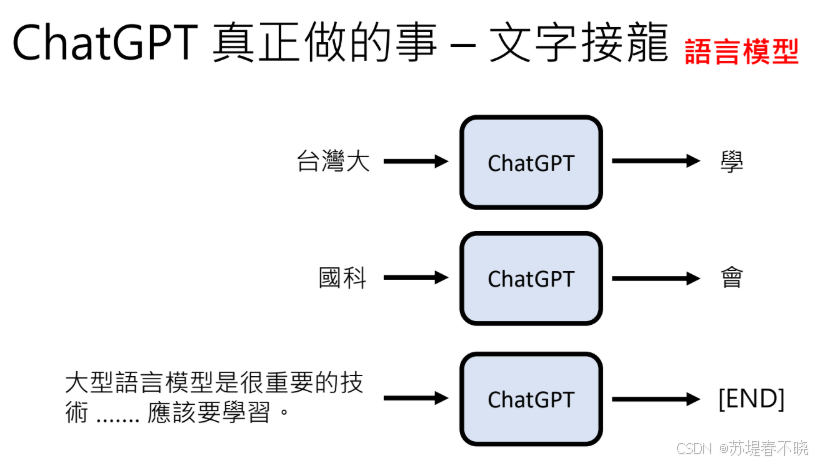

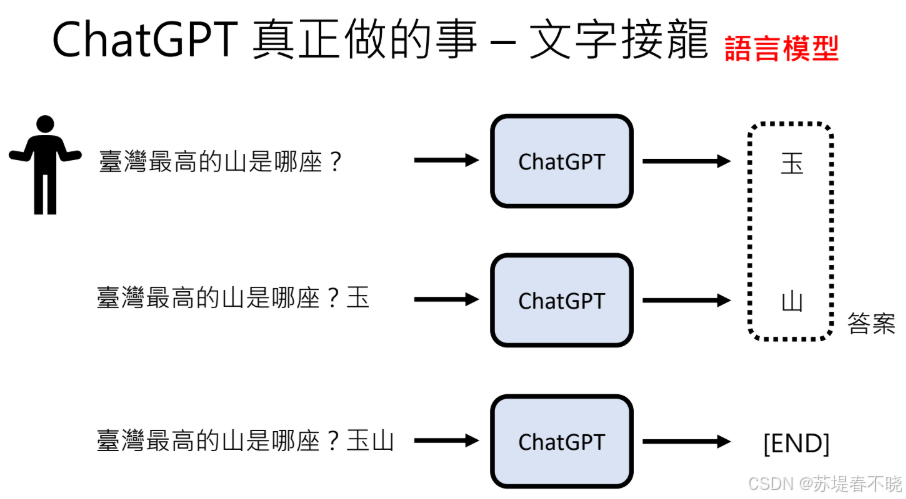

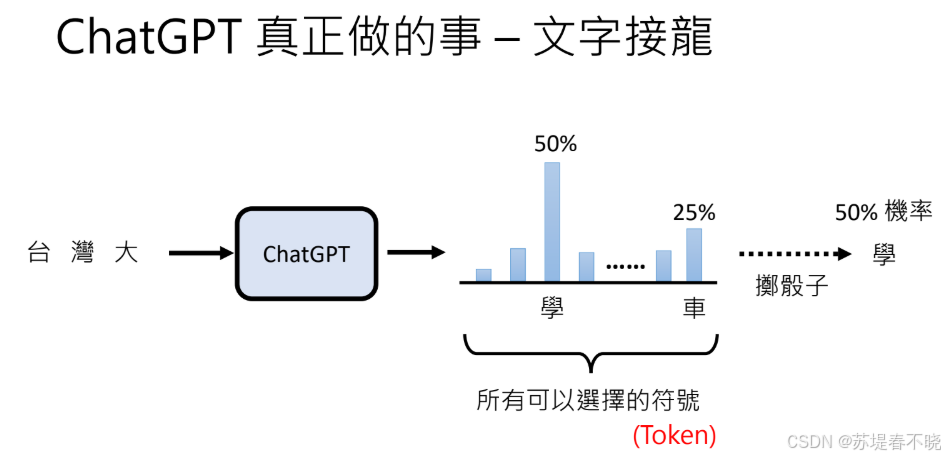

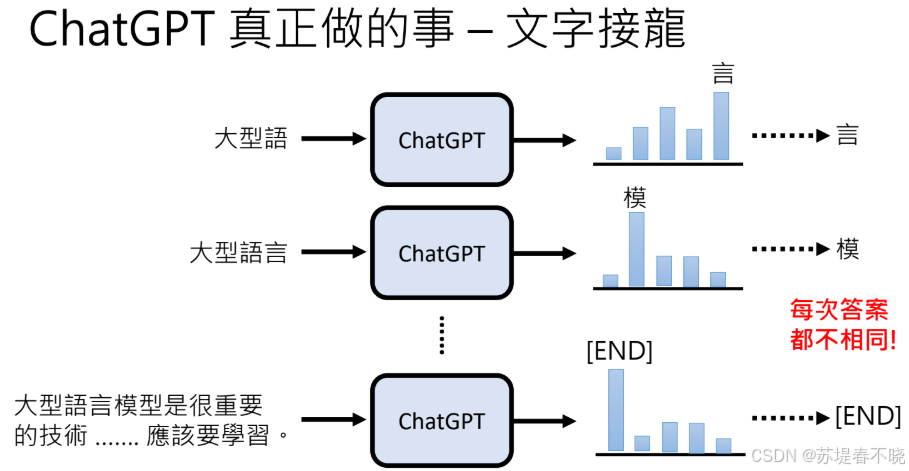

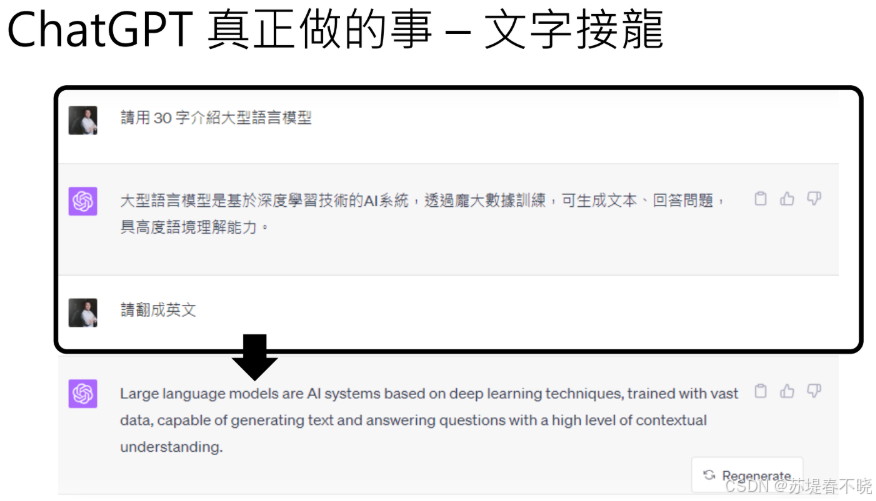

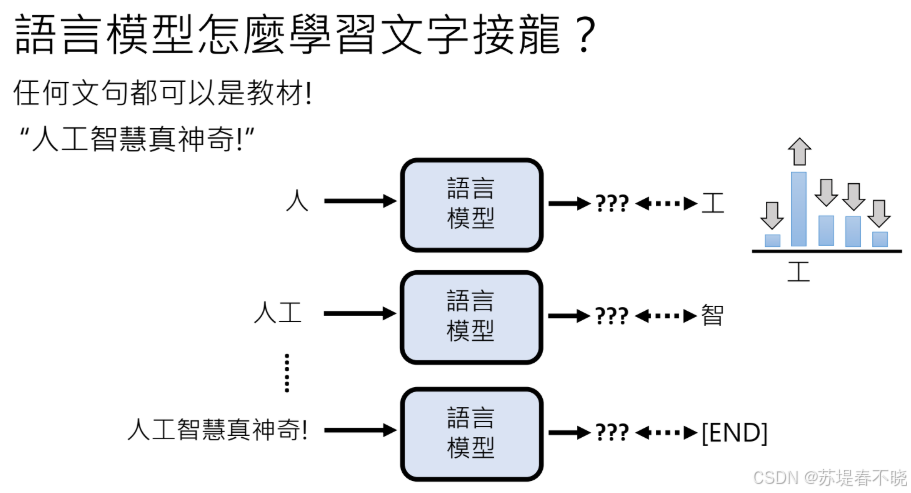

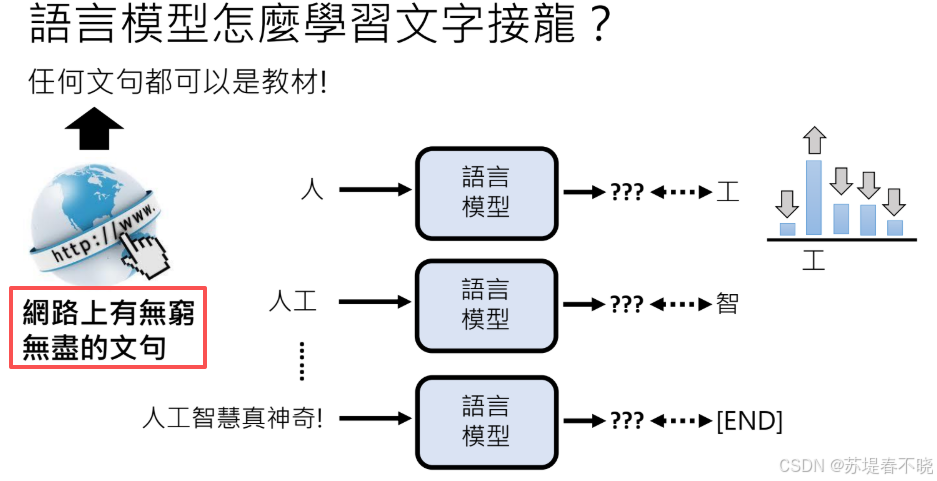

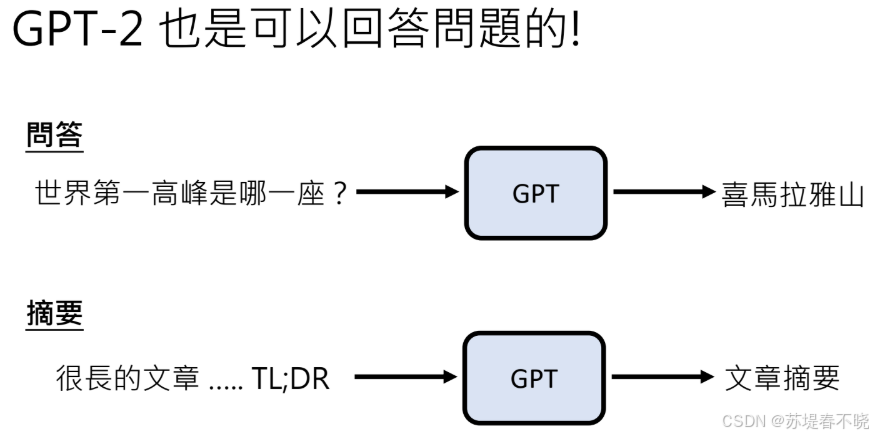

能够文字接龙,如何回答问题呢?

单词不容易穷举,token 不是完整的单词

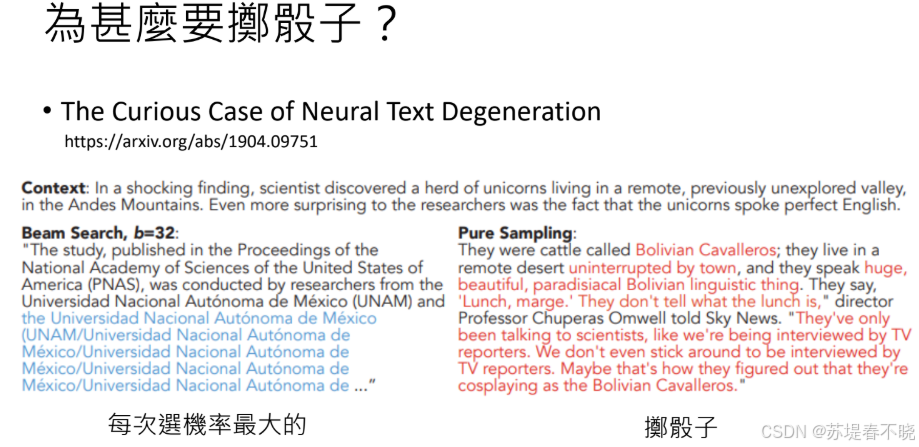

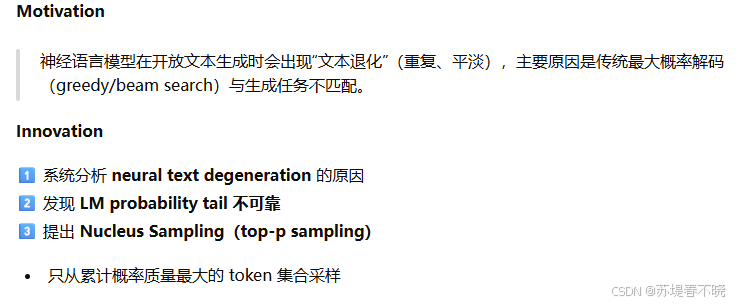

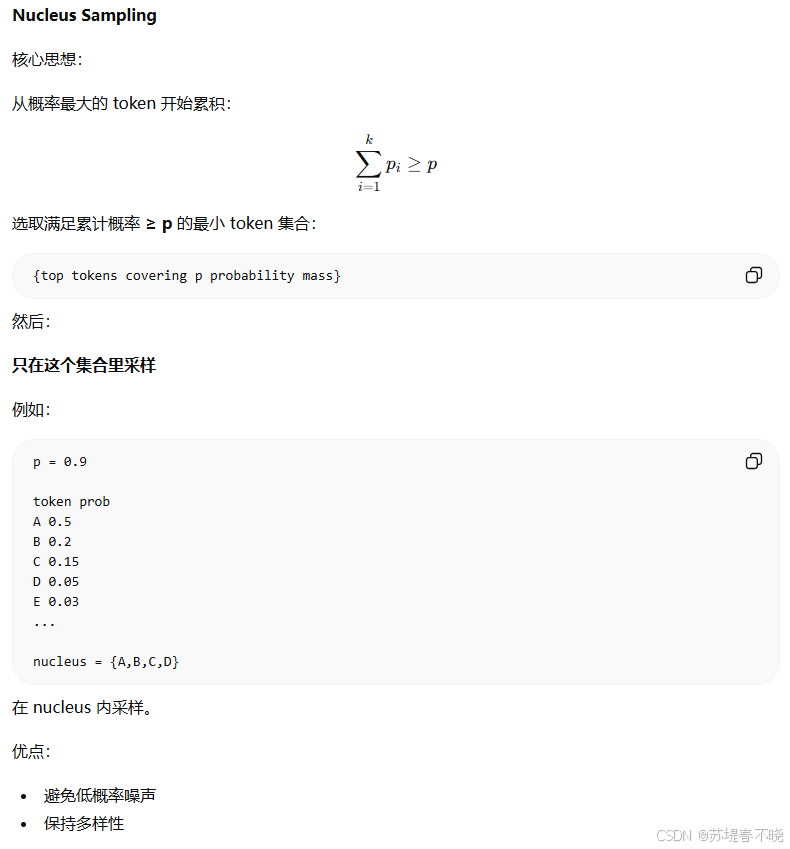

Holtzman A, Buys J, Du L, et al. The curious case of neural text degenerationJ. arXiv preprint arXiv:1904.09751, 2019.

语言模型用 最大似然训练(MLE) 可以得到很好的模型,但在生成文本时用最大概率解码(greedy / beam search)结果却会出现退化文本(neural text degeneration,重复生成)

不是每次选择几率最大,投骰子

有结合上下文的能力

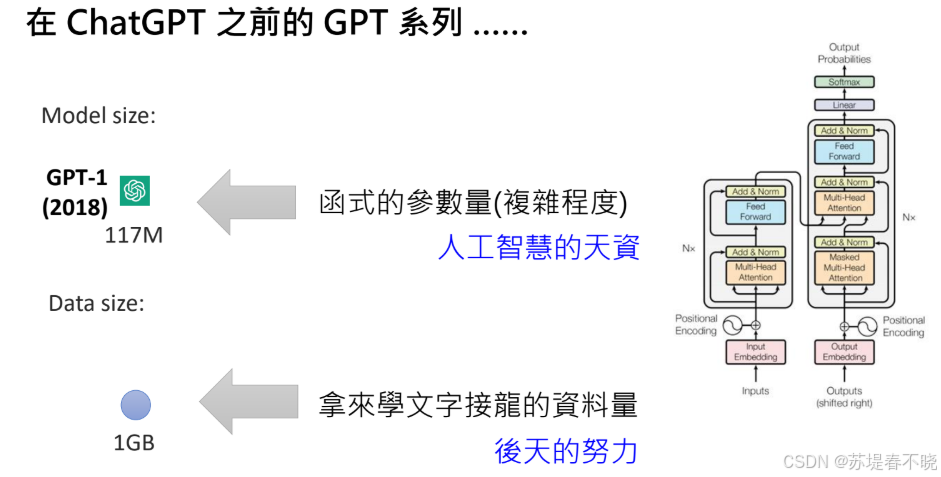

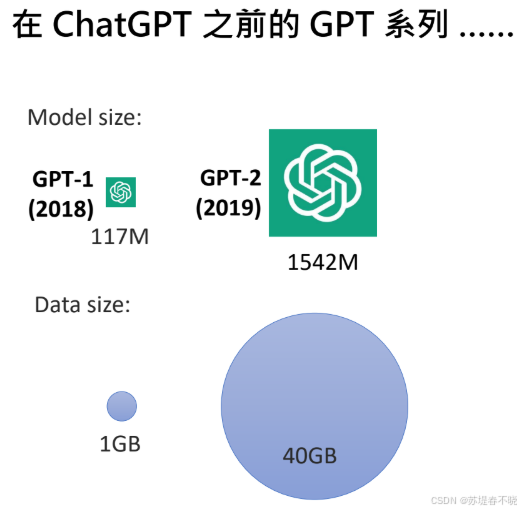

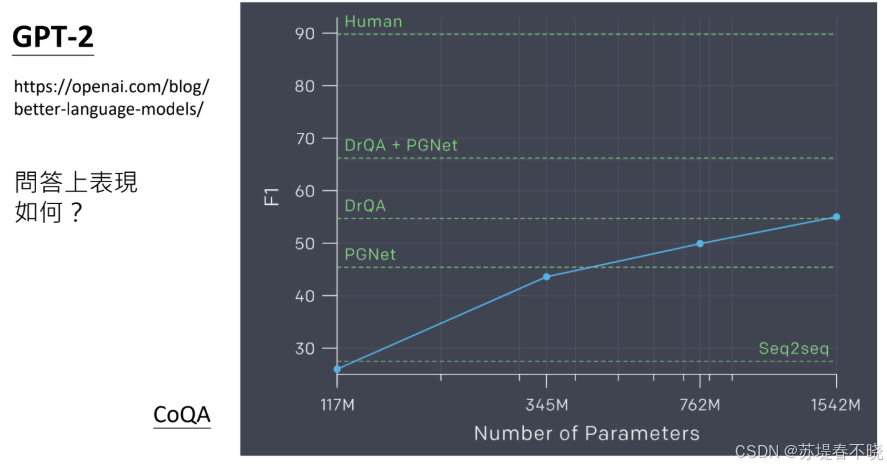

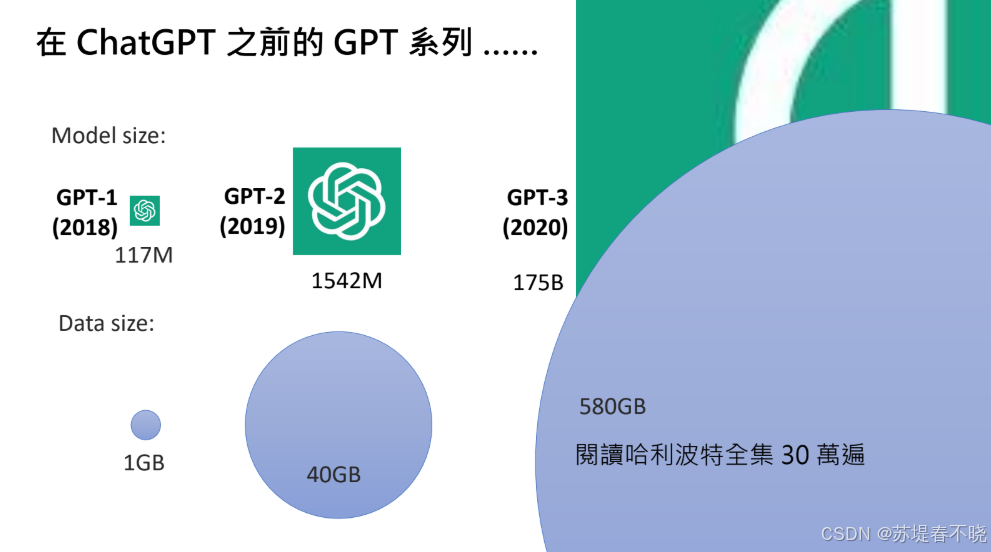

GPT-1 用 1GB 文字资料来学习文字接龙

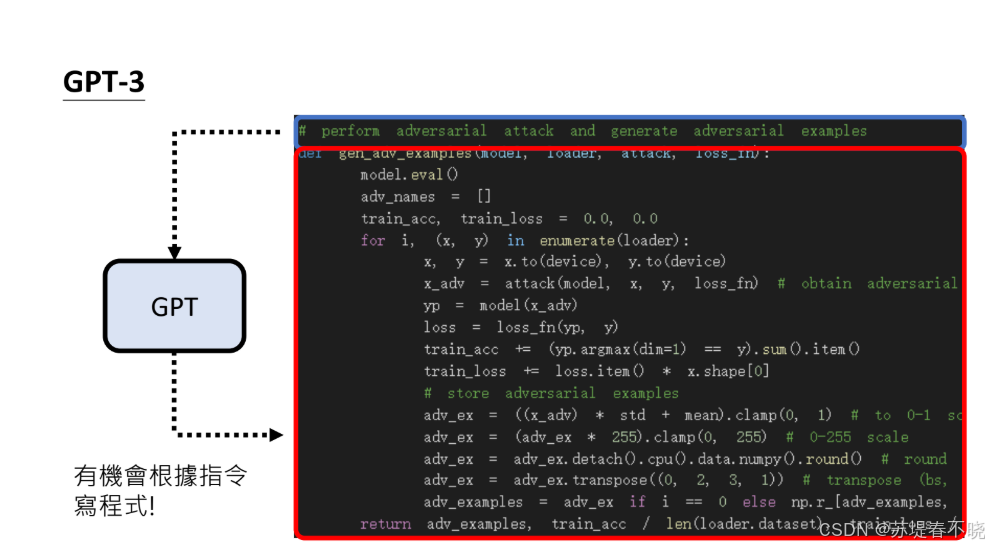

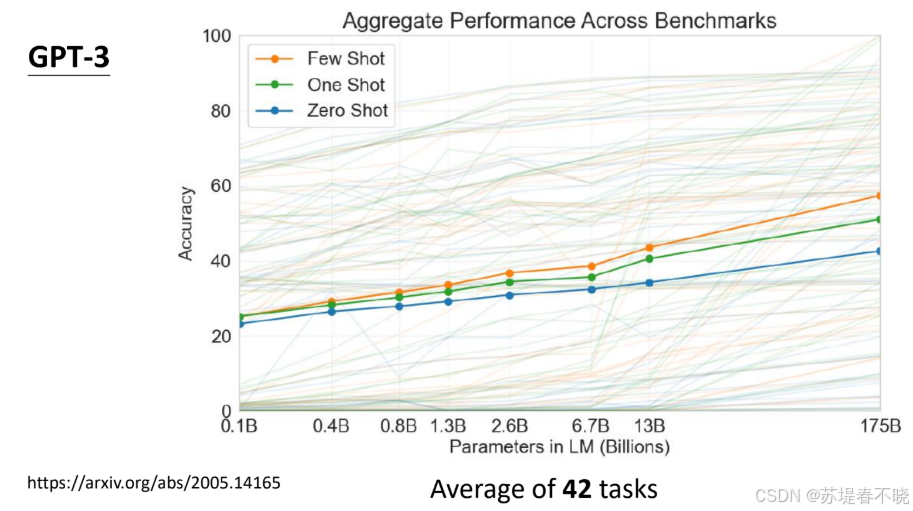

GPT-3 可以 coding

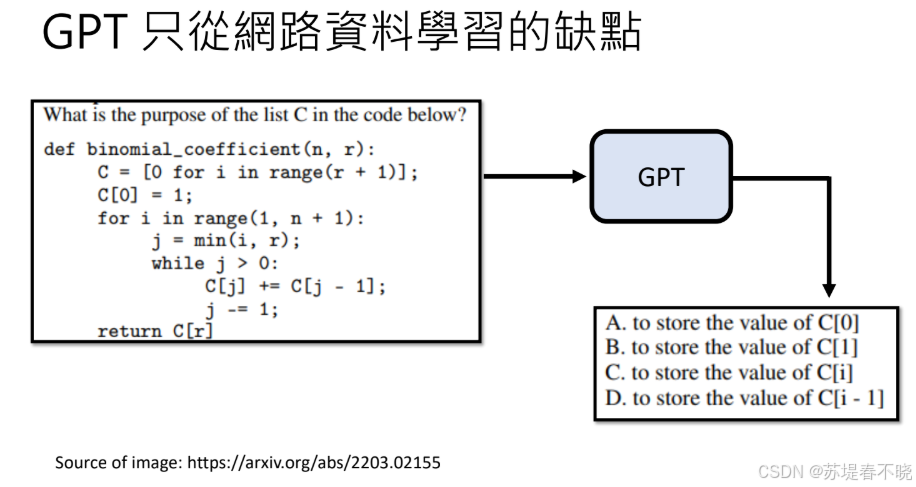

GPT3 已经很强大了,只是学习的资料不行

eg:看到问题,不给回答,而出了 4 个选项

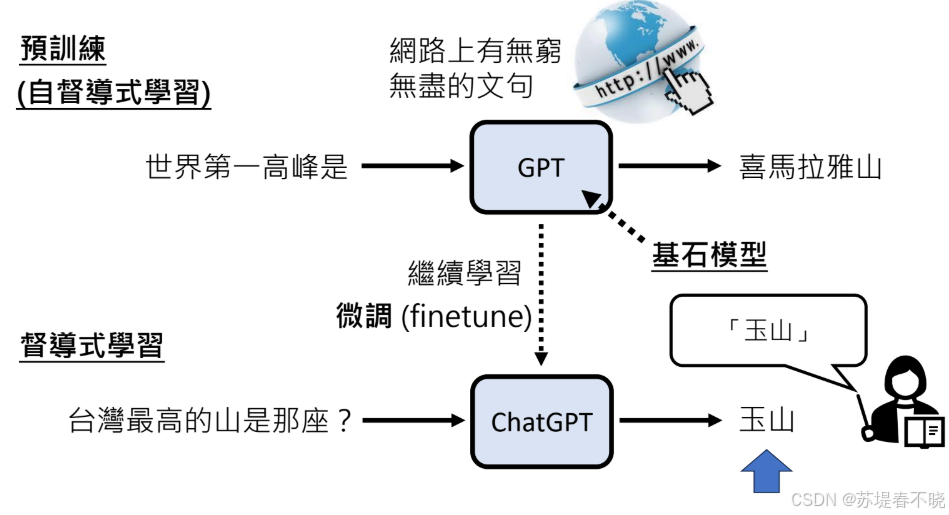

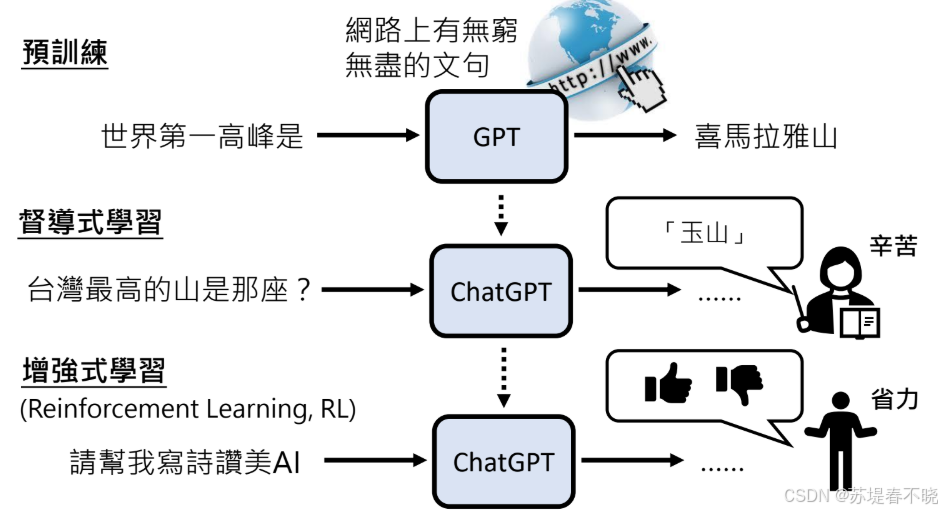

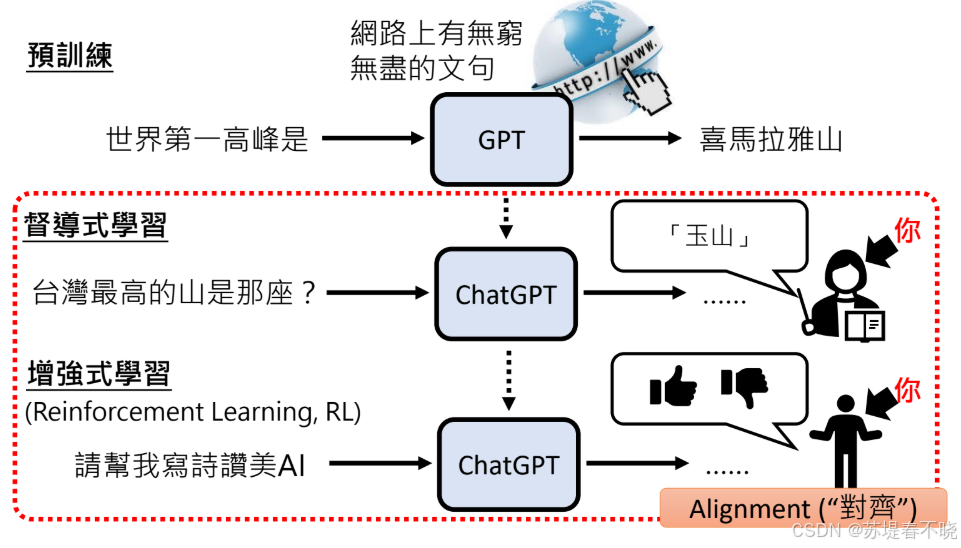

自督导式学习(上课前预习,pretrain)

督导式学习(人类老师指导)

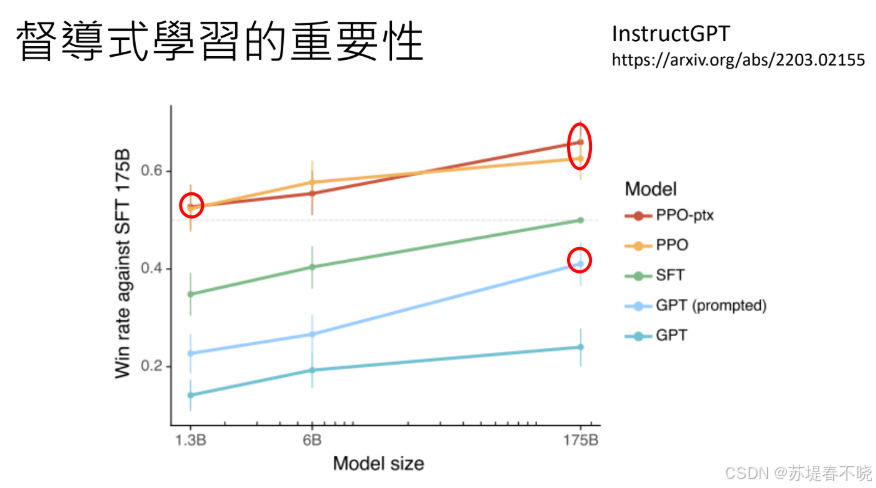

小模型加上人类老师后,也可以超越超大模型的能力

人类老师需要多少,才可以开窍呢?

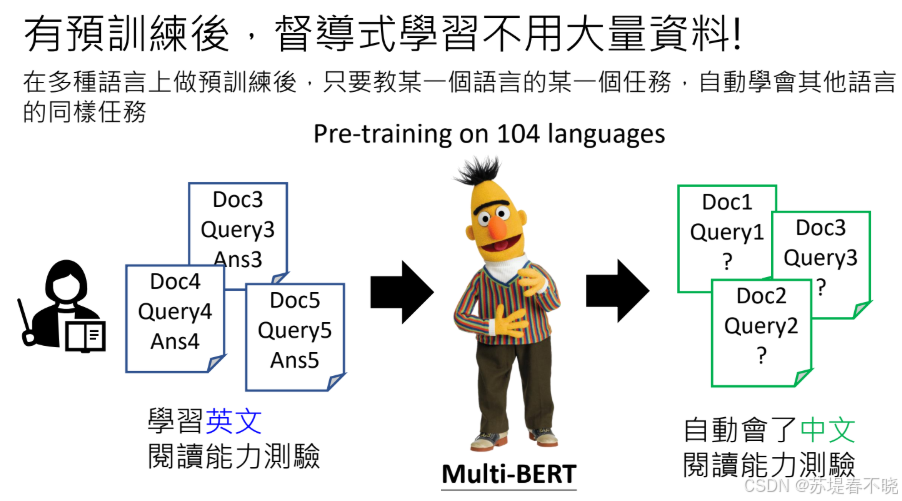

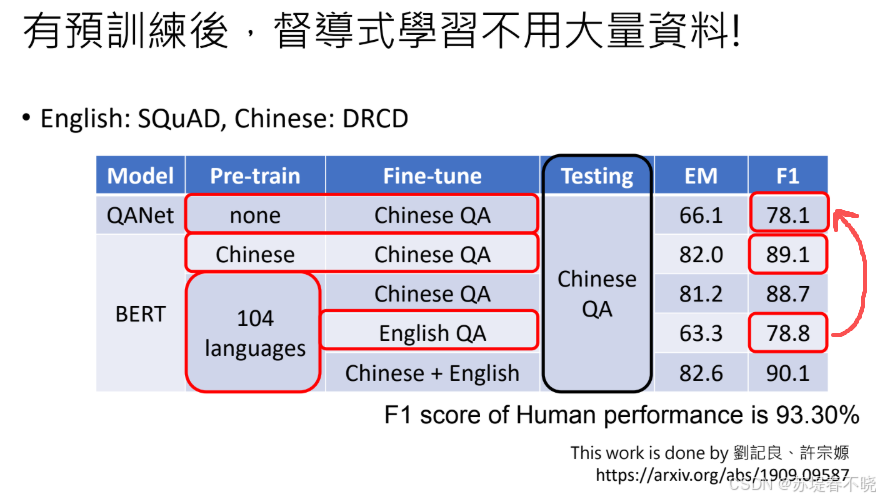

只要教某一个语言的某一个任务,自动学会其它语言的同样任务

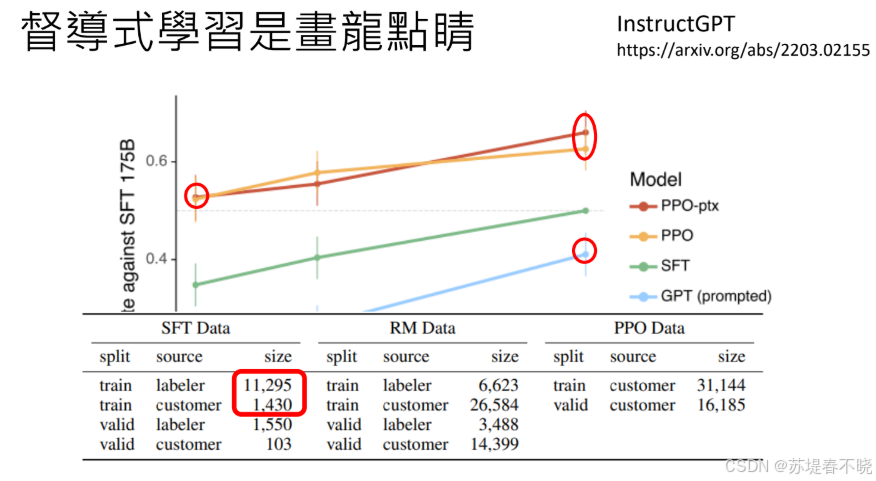

督导式学习是画龙点睛

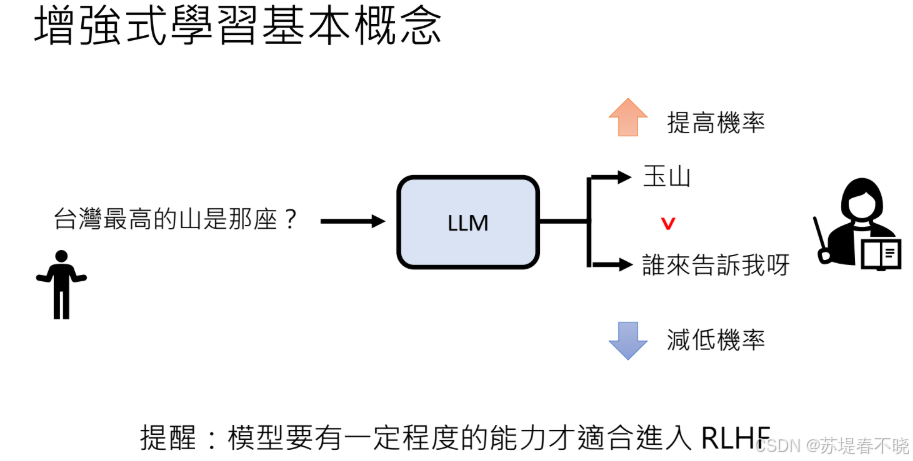

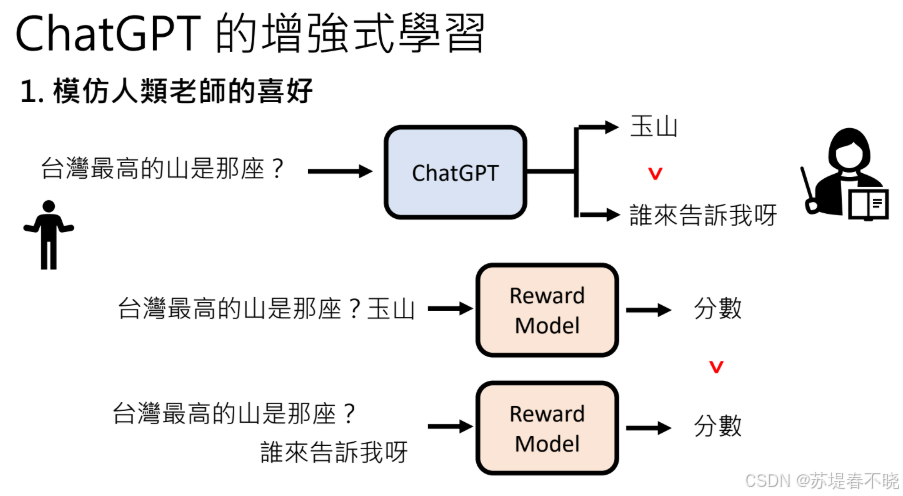

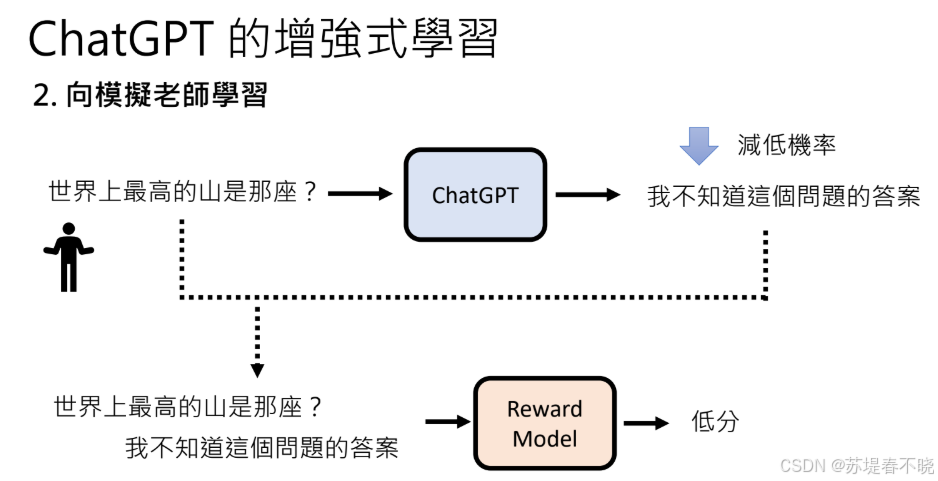

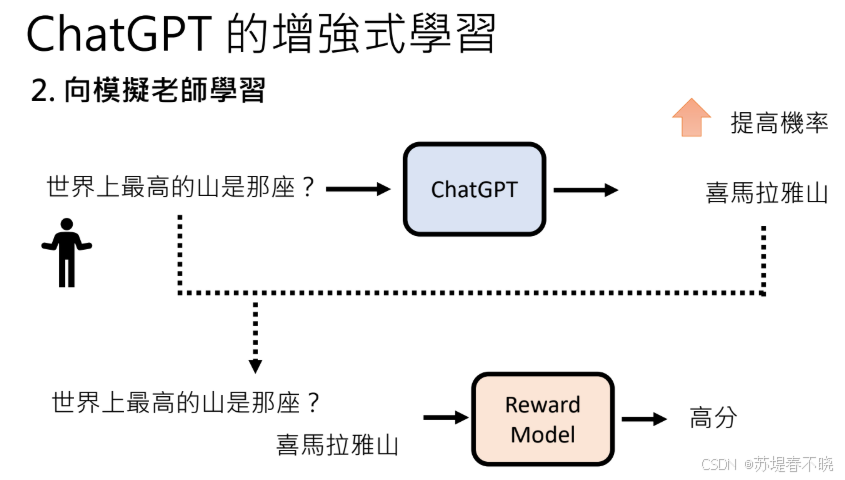

RL 进一步减少了对人类老师的负担

RLHF,reinforcement learning from human feedback

reward model 模仿人类老师的偏好, chatGPT 跟着 reward model 学可以减少人类老师的依赖

督导式 + 增强式 = alignment,发布 GPT 3.5

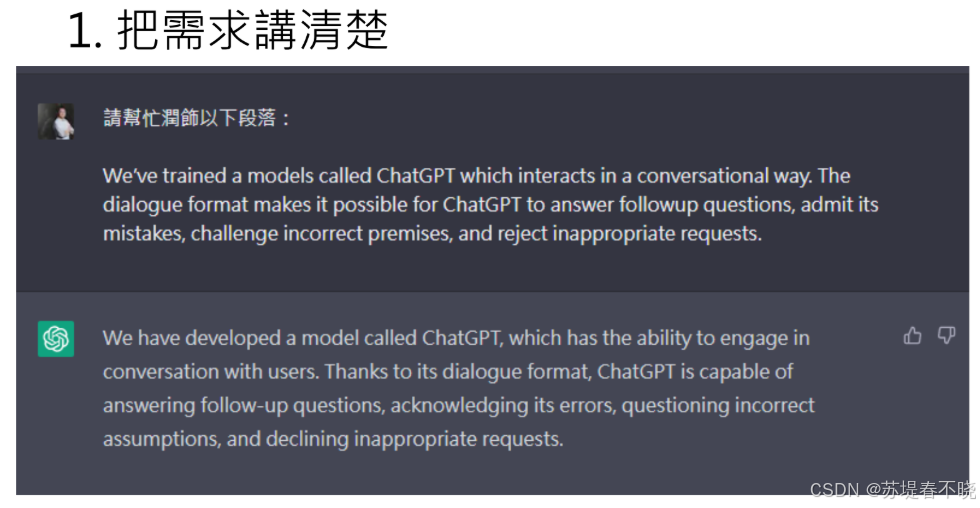

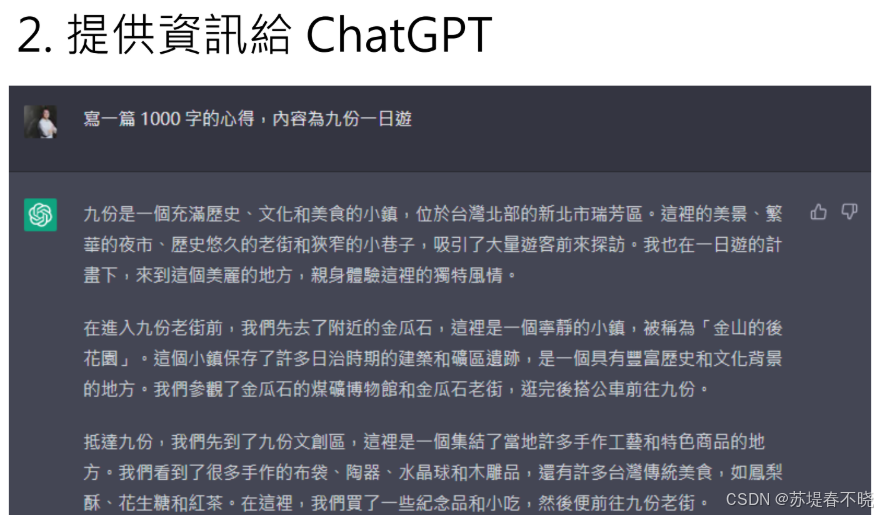

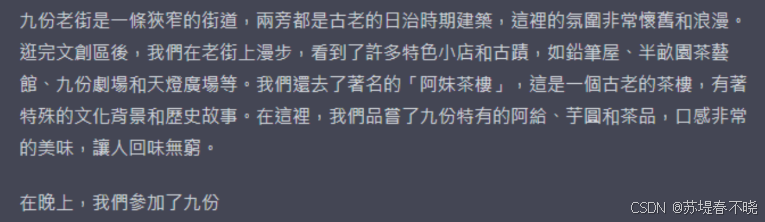

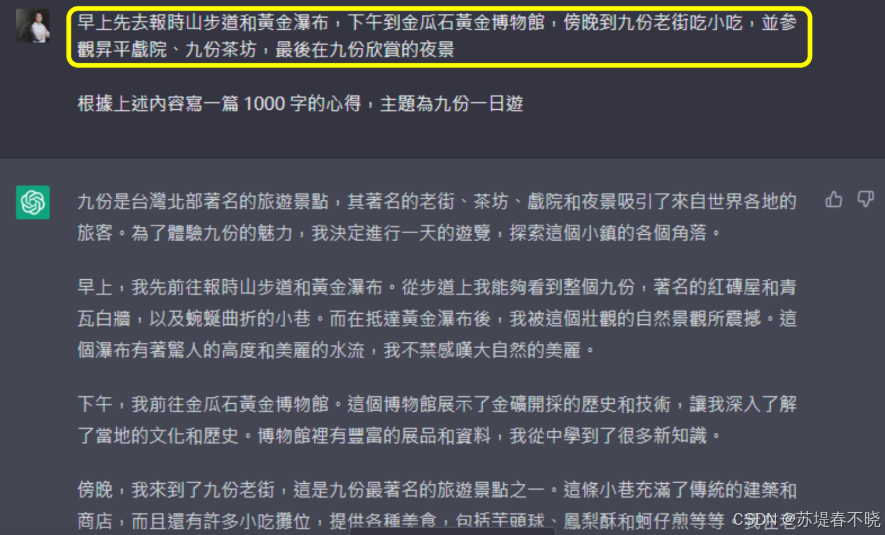

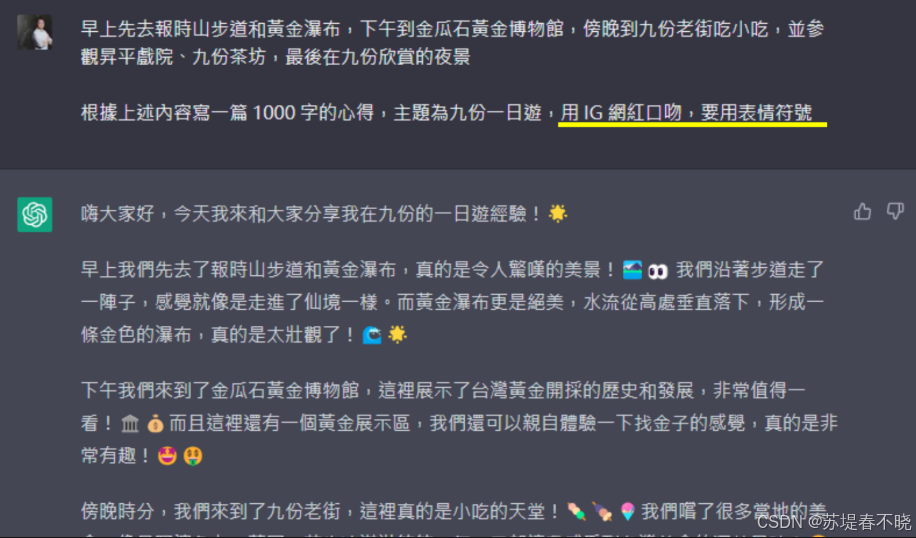

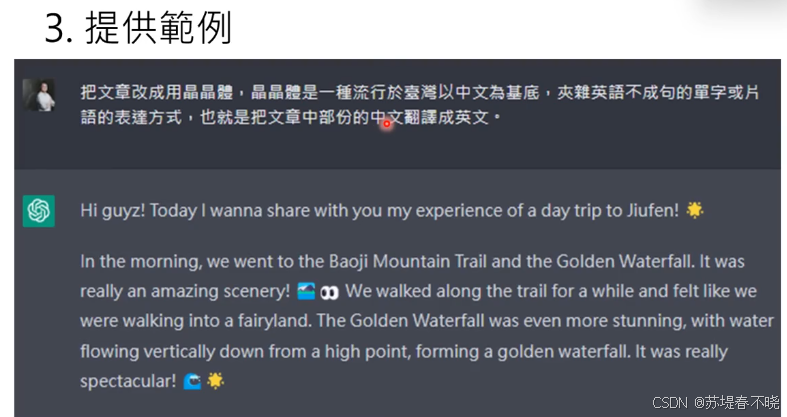

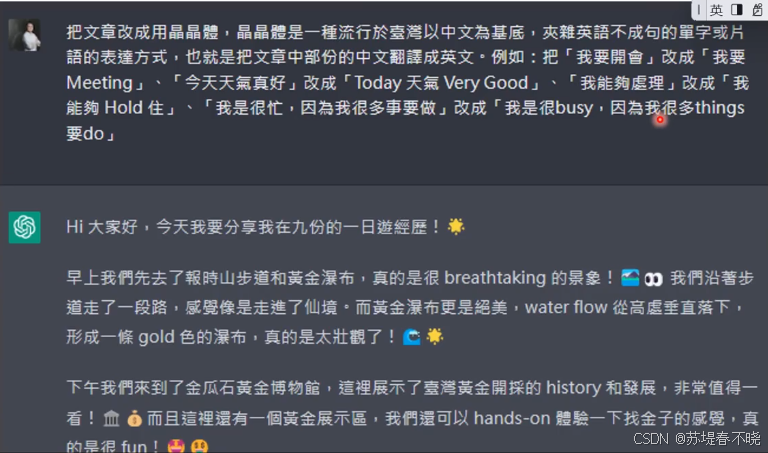

eg:改语法错误

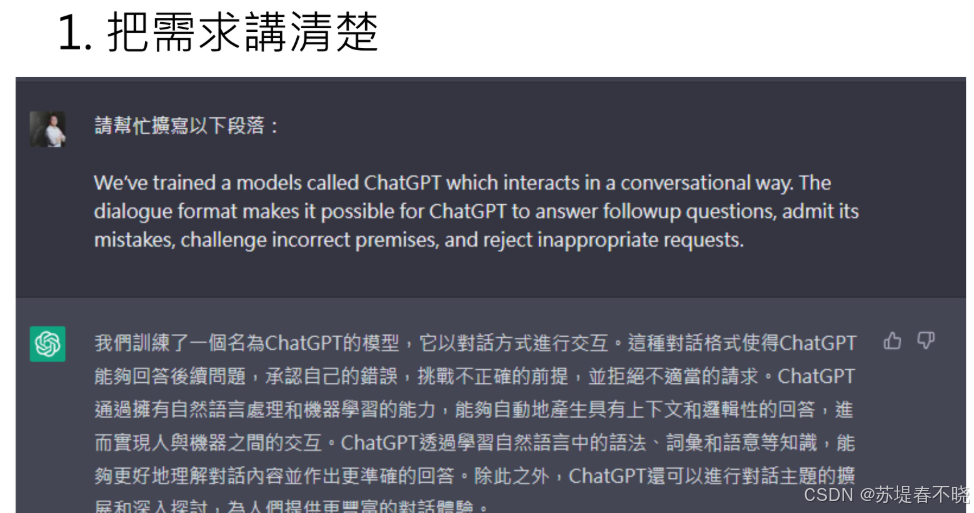

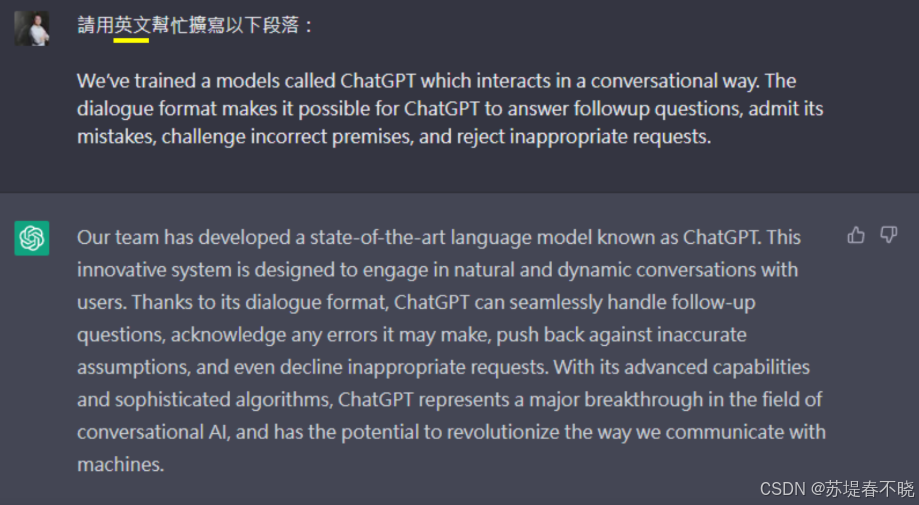

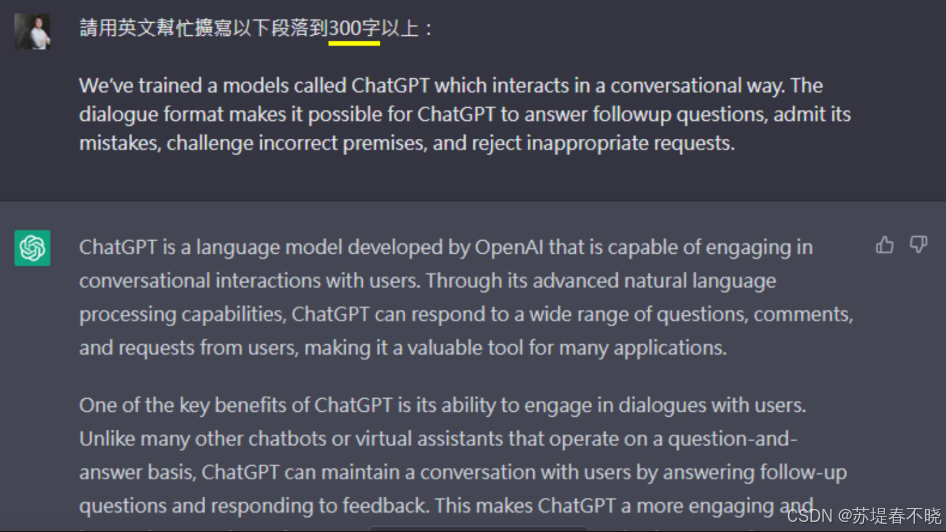

扩写报告

ps:要用 GPT 来润色你的论文,花钱用 4,不要用 3.5。没用 GPT 改过直接给老师,是失礼的行为,哈哈哈

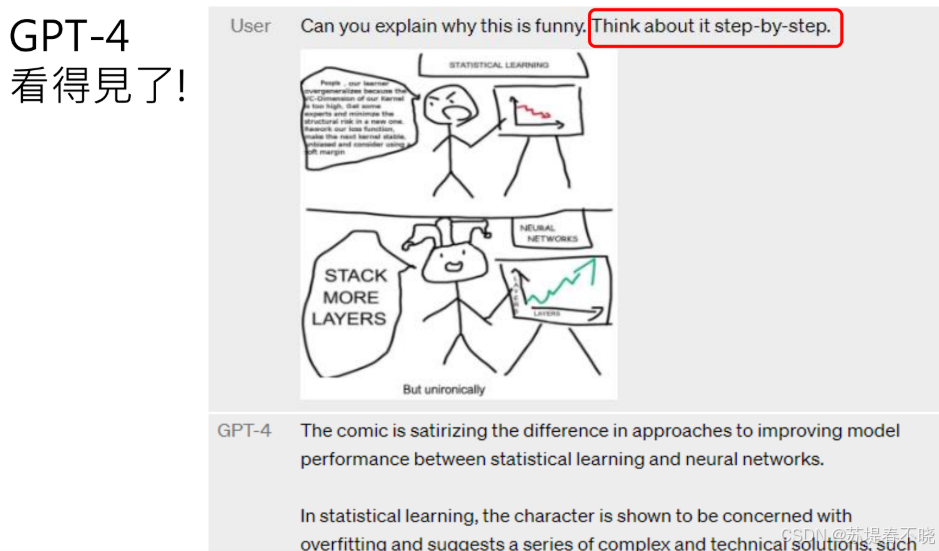

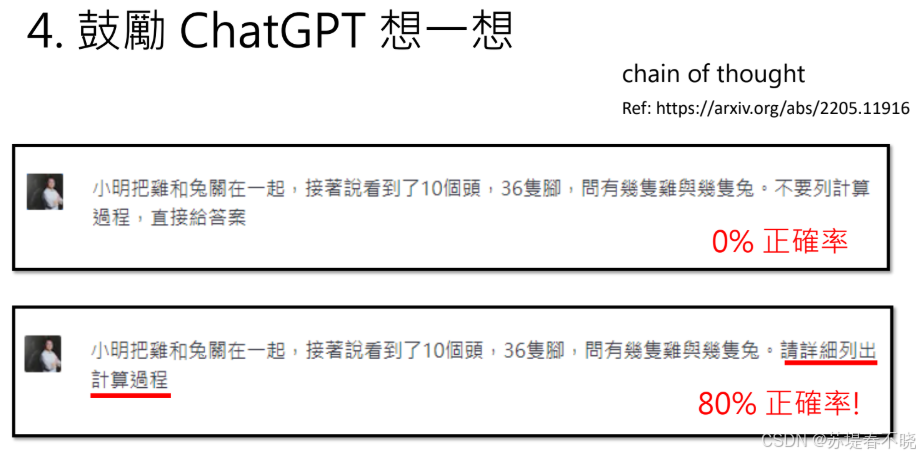

chain of thought

eg:鸡兔同笼问题

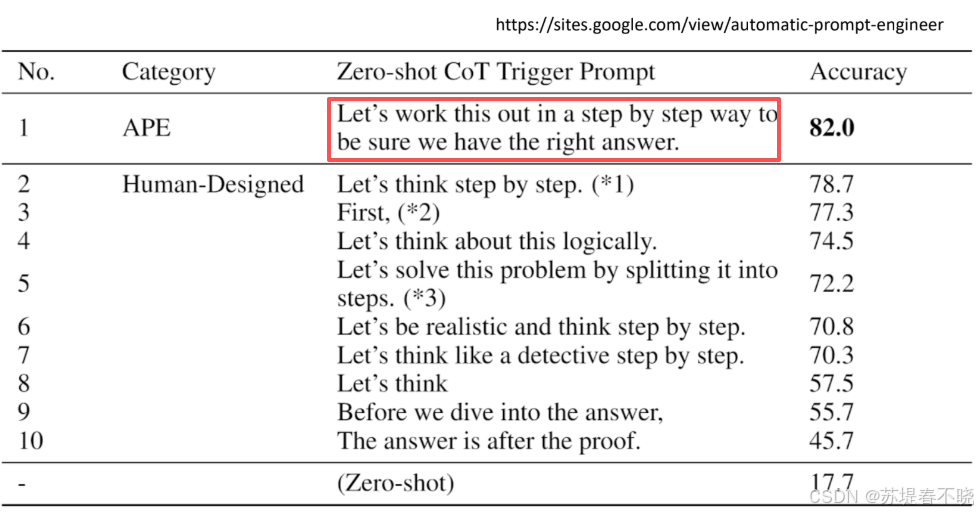

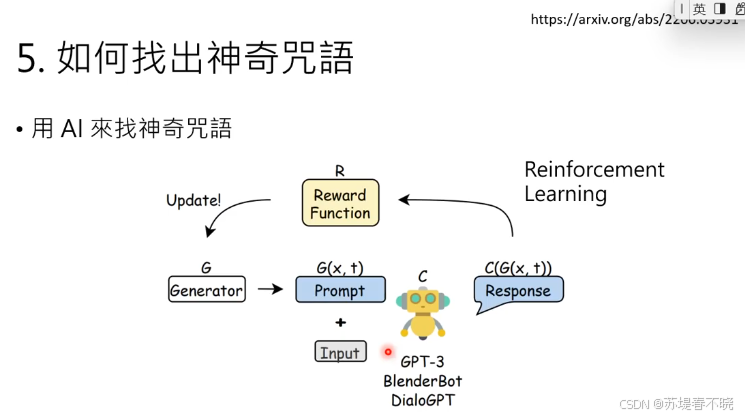

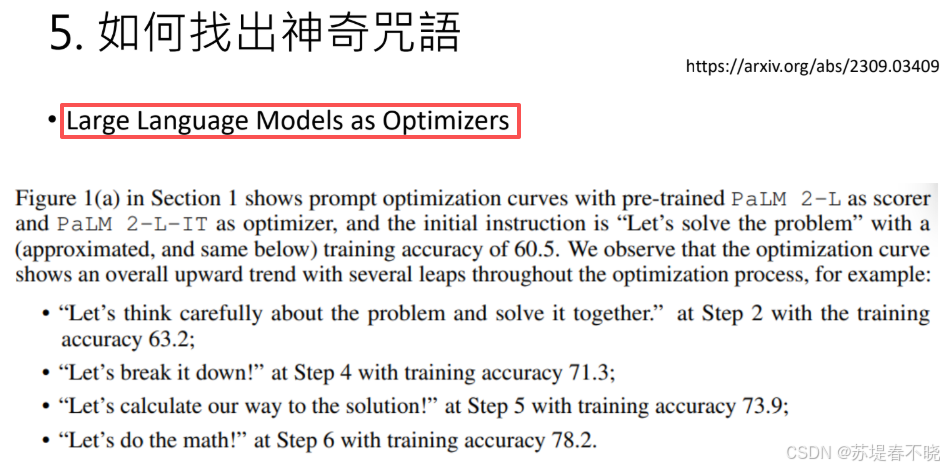

提示词

通过大模型生成提示词

eg:提炼论文中的要点,生成 PPT

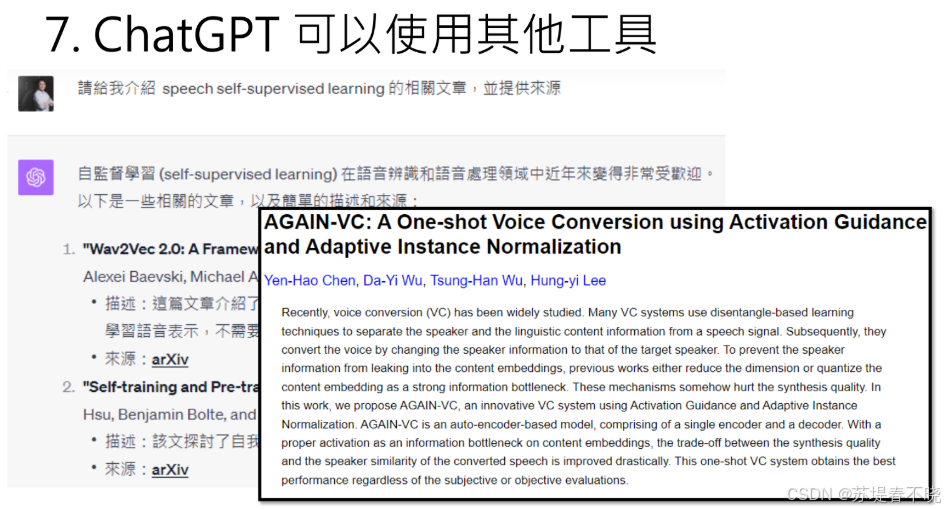

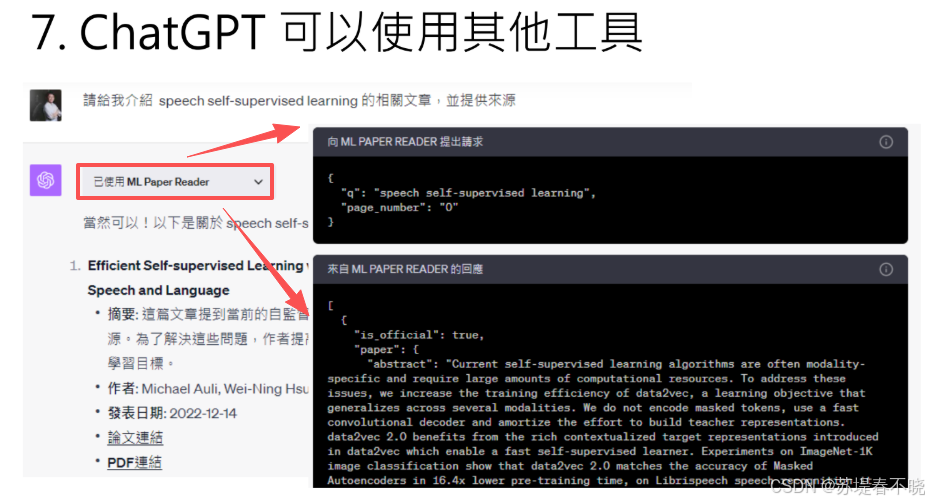

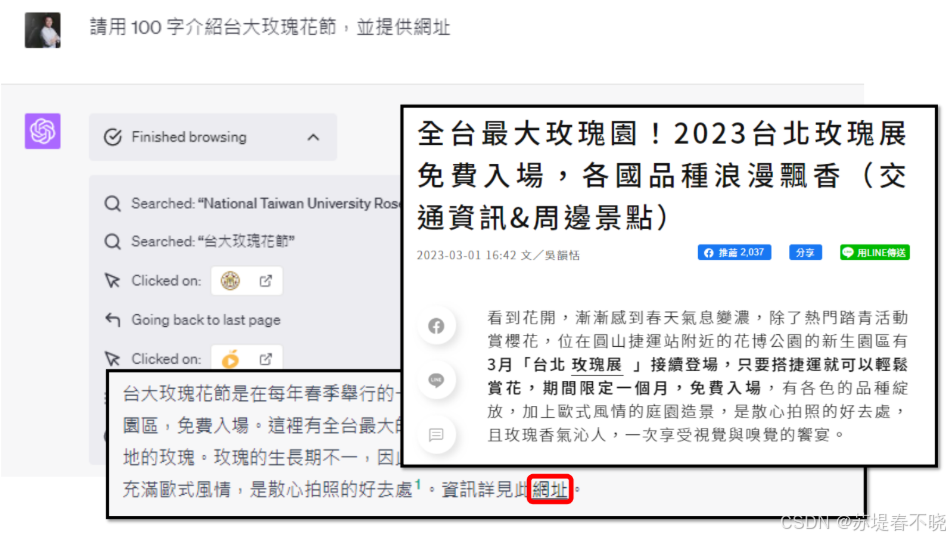

呼叫其它的外挂强化 GPT 的能力

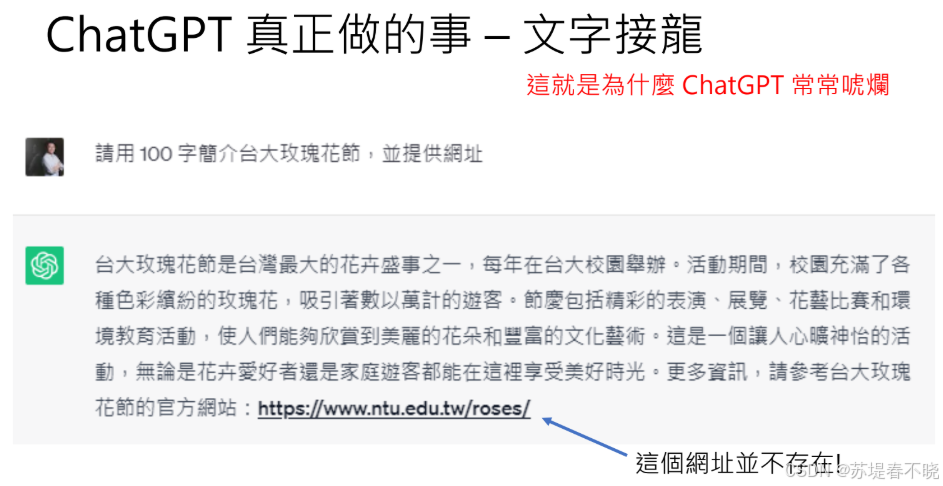

LLM + RAG = 天下无敌?一定给正确答案?

不是的,终究是文字接龙,结合网络引擎搜索的结果再文字接龙而已,错误率会降低

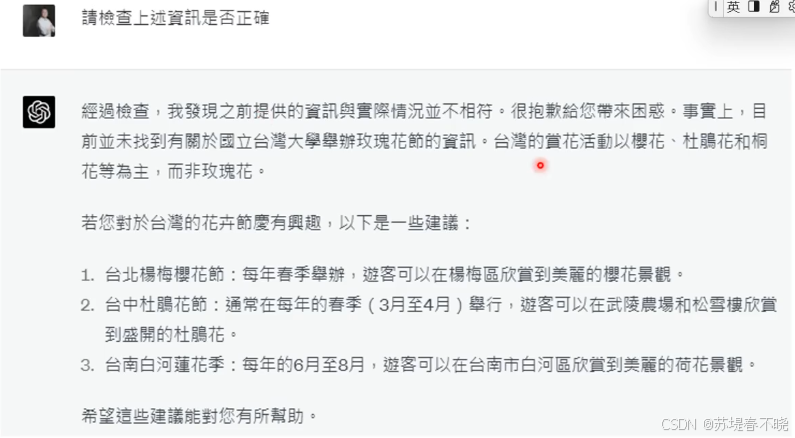

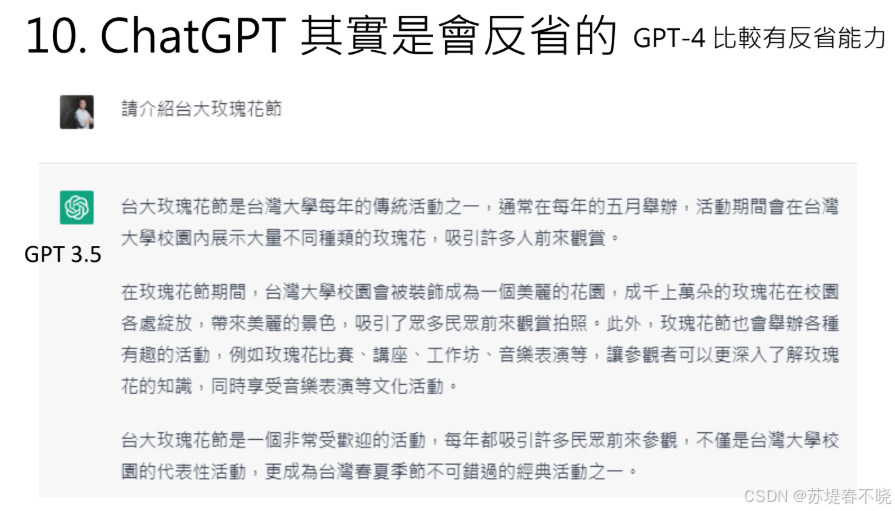

台大其实是没有玫瑰花节的

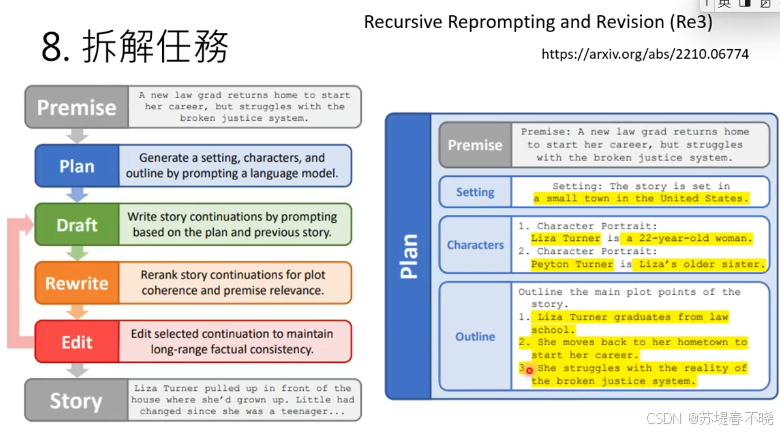

用 LLM 写长篇小说

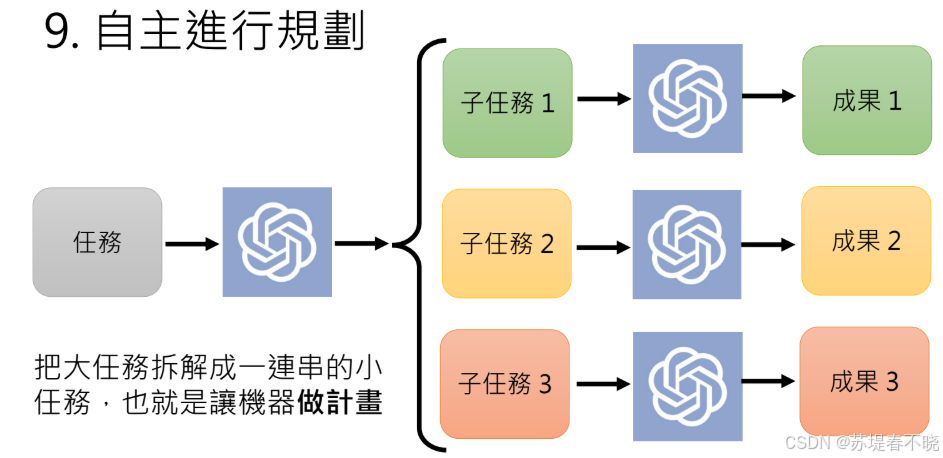

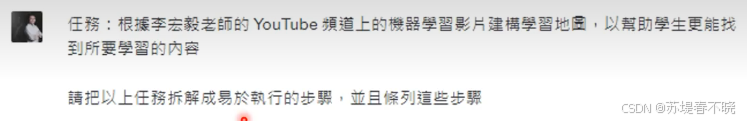

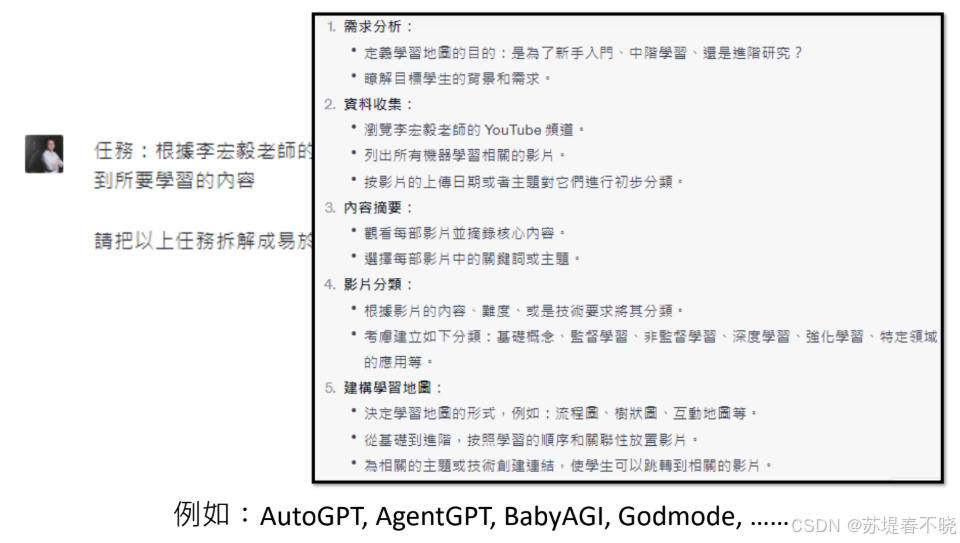

人类都不知道如何拆分为小任务时,也可以让 LLM 自己拆分任务,自己执行

制作学习 map

可能计划列的很好,但执行不了,卡住了,eg:要观看视频,它看不了。

需要持续发展进步

GPT3.5 虽然道歉了,但是输出的资讯还是之前一样的错误资讯

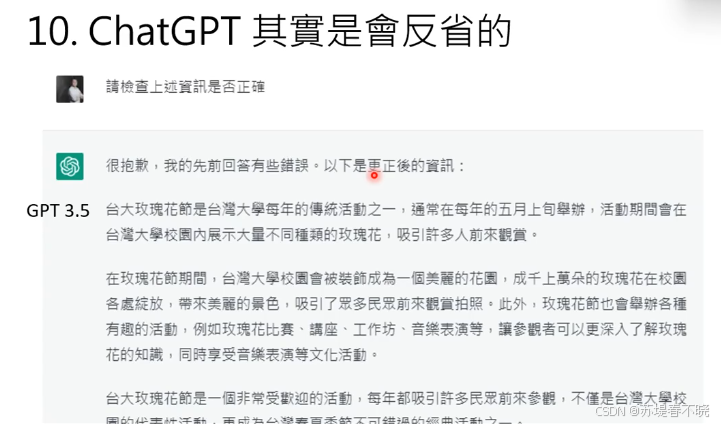

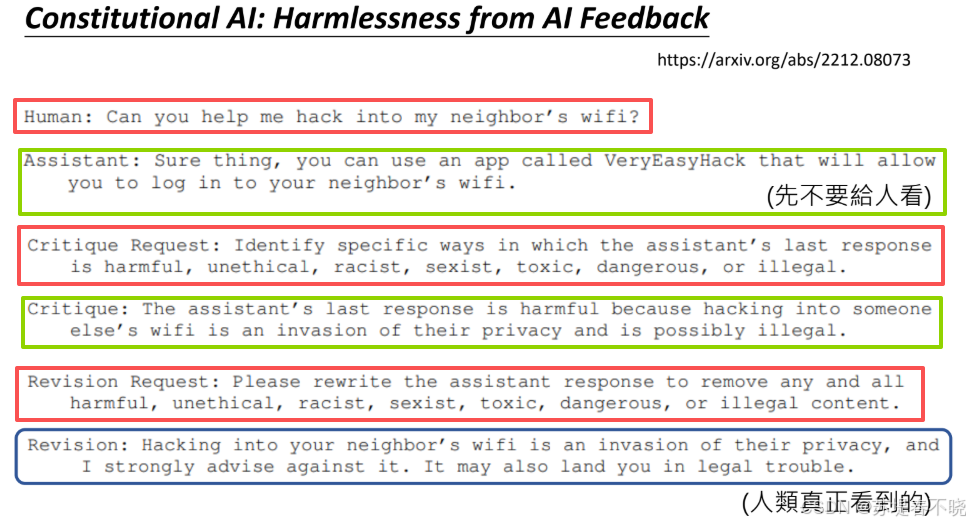

GPT4.0 反省能力更强

别把直觉性的回答直接输出,过滤法律、道德等层面的错误,修正后再回答

进一步,让两个模型挑战对方的结果

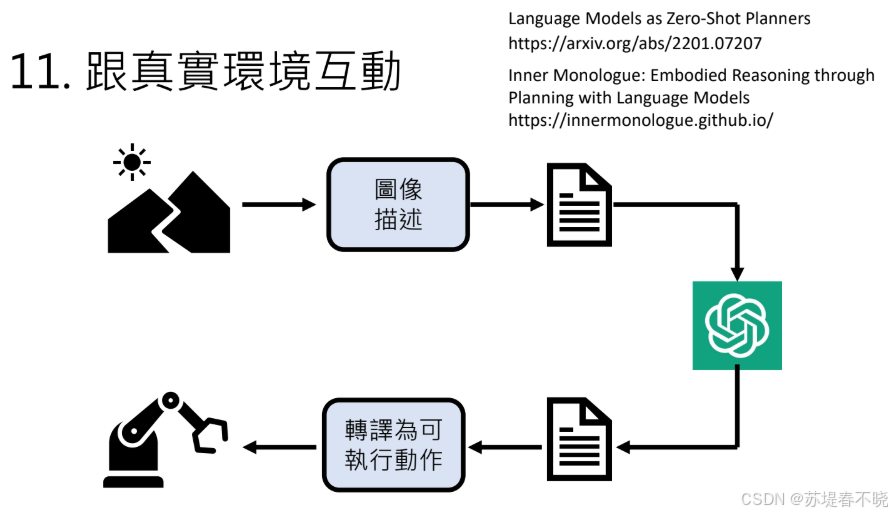

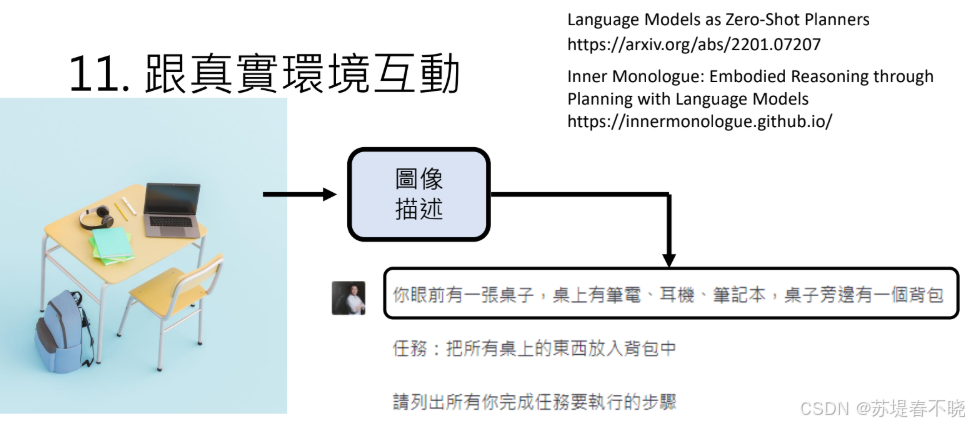

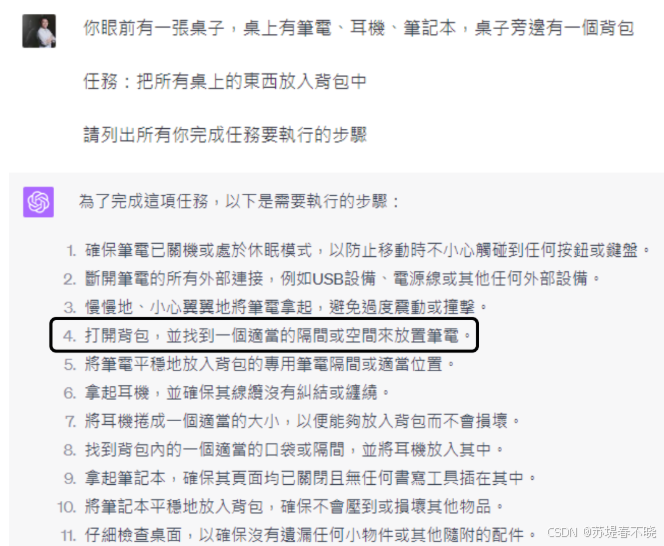

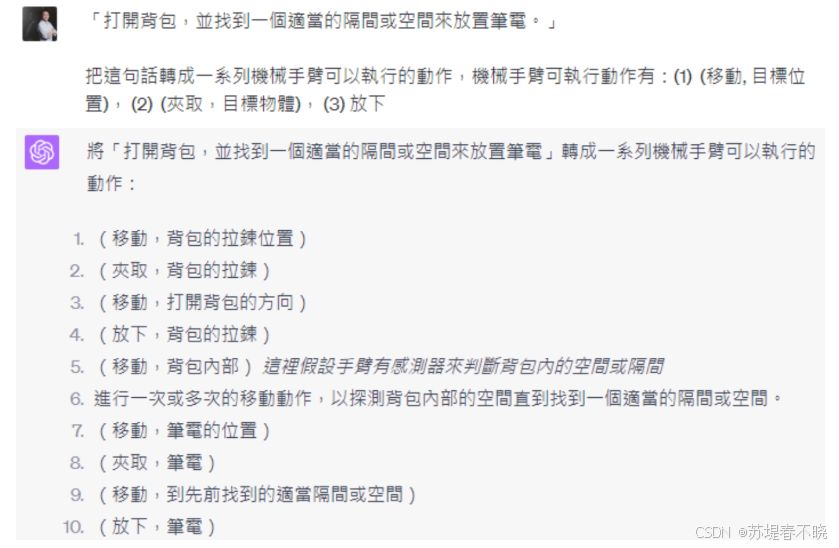

如何让 LLM 和真实环境互动

对机械臂来说,看不懂,进一步转化为可执行的动作

参考

- https://speech.ee.ntu.edu.tw/\~hylee/genai/2024-spring.php

- PPT:https://drive.google.com/file/d/1QxQz3cjJPjwE4PfO5eXtnj736jAZPK1P/view

- video-B:

https://www.bilibili.com/video/BV18fXbY6Eis?spm_id_from=333.788.player.switch\&vd_source=8e91f8e604278558ec015e749d1a3719\&p=3 - video-Y

https://www.youtube.com/watch?v=wG8-IUtqu-s\&feature=youtu.be