本文介绍先对于已经熟悉ollama的小伙伴,在安装ollama之后,如何安装并配置openclaw。

基础软硬件

- CPU:推荐 4 核及以上,入门级可运行 7B 模型。

- 内存:至少 16GB,7B 模型建议 16GB。

- GPU:RTX3060 12G,可以运行7B,14B等本地模型。如果没有RTX显卡或者苹果共享存储环境,不建议使用本地模型,因为跑不动。

- 网络:首次下载模型需联网。

- 操作系统:Windows 10/11(64位),虚拟机的下载路径详见我的专栏《AI安全》,见这里。

- 虚拟机:对于openlaw由于其权限太高,因此最好在虚拟机中安装运行,避免一些误操作导致相关文件受损的情况发生

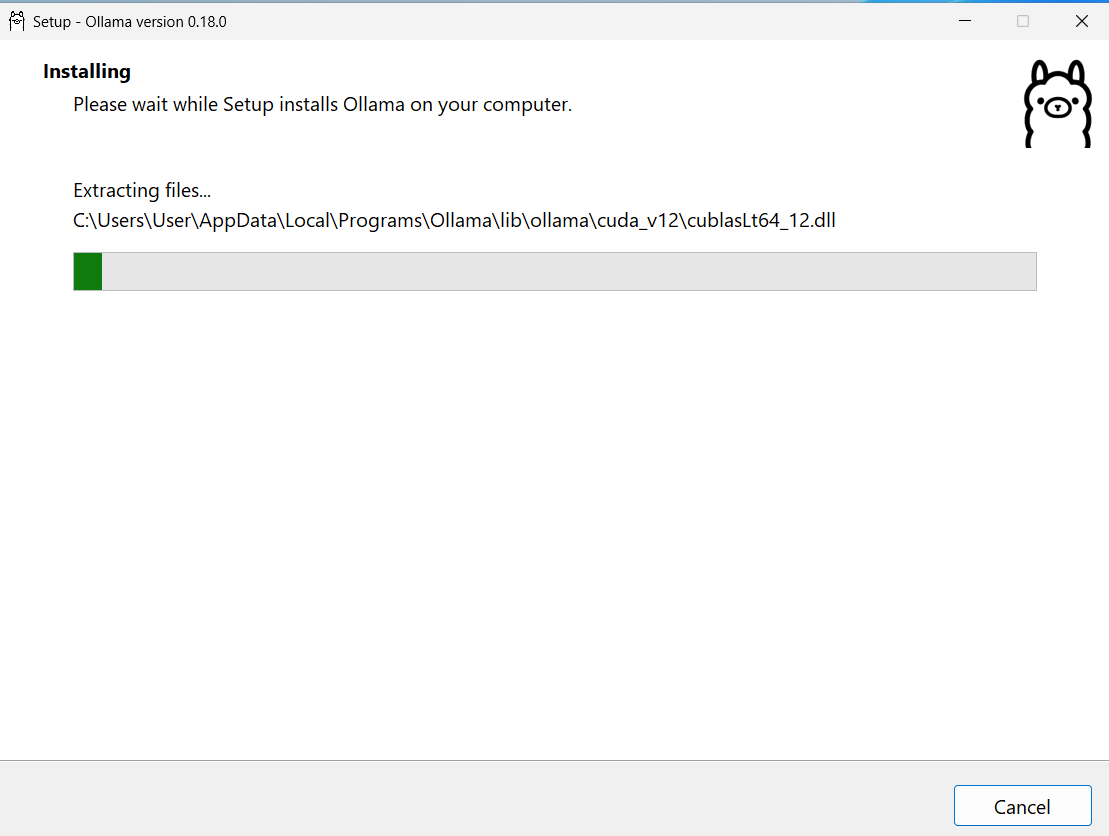

安装ollama

ollama也在不断地更新版本,建议老版本的小伙伴可以安装最新的ollama。ollama官网,这里,会检测操作系统,给出对应的命令,如下是windows的命令,以管理员权限打开powershell运行即可;

bash

irm https://ollama.com/install.ps1 | iex或者直接从官网下载安装包,如果下载速度有限,可以到这里下载0.18的版本,如下:

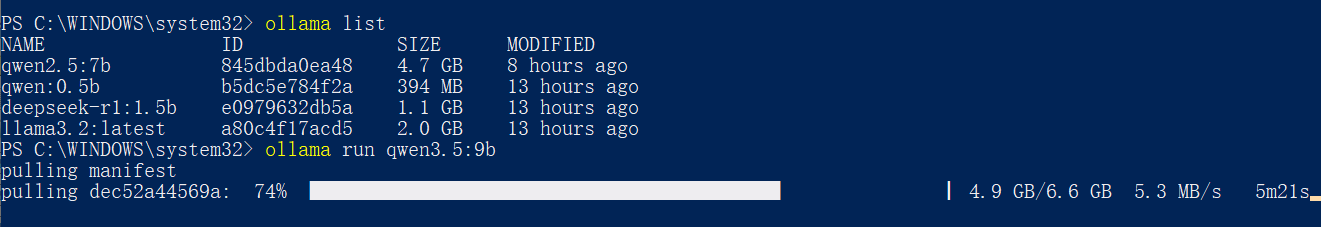

拉取模型

ollama run拉取需要的模型,qwen3.5需要高版本的ollama,关于模型信息,可以到这里进行查看。

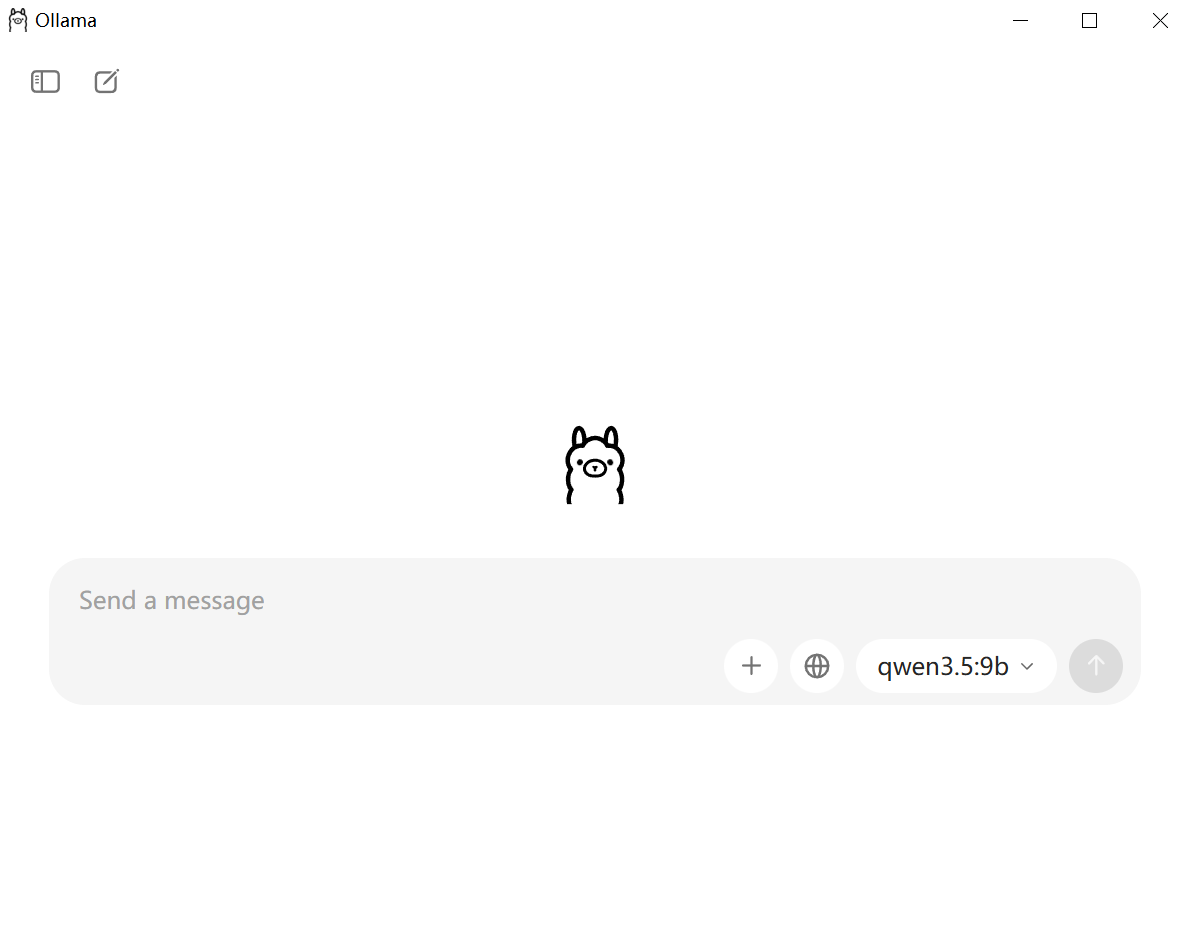

有了模型之后,就可以使用ollama客户端进行对话,如下:

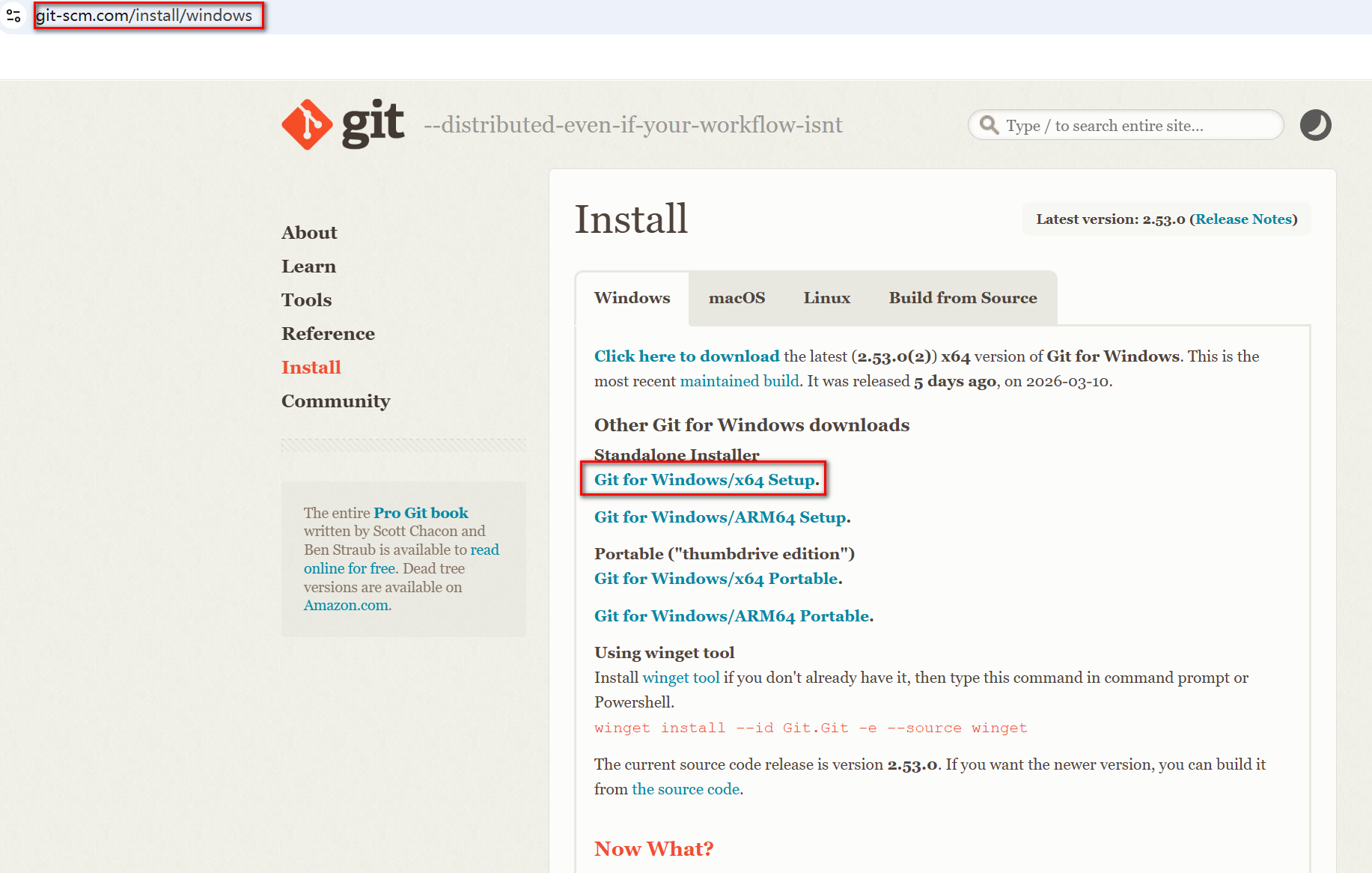

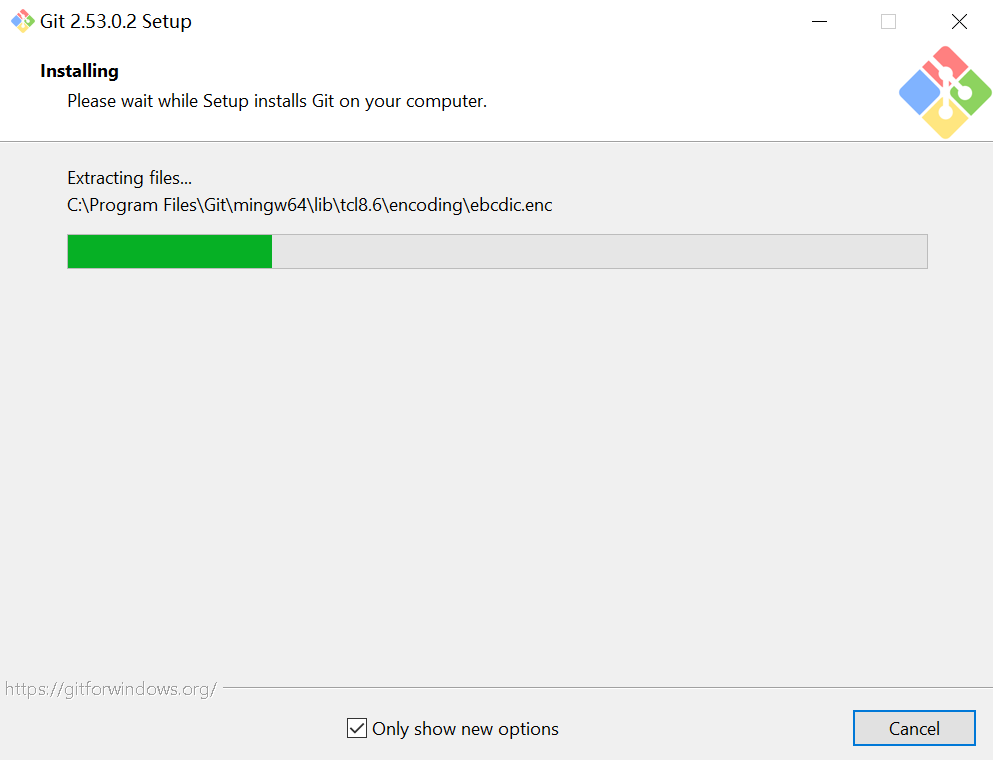

安装Git

该工具主要用于从github上下载操作,openclaw开源项目很多依赖需要从github拉取,如下:

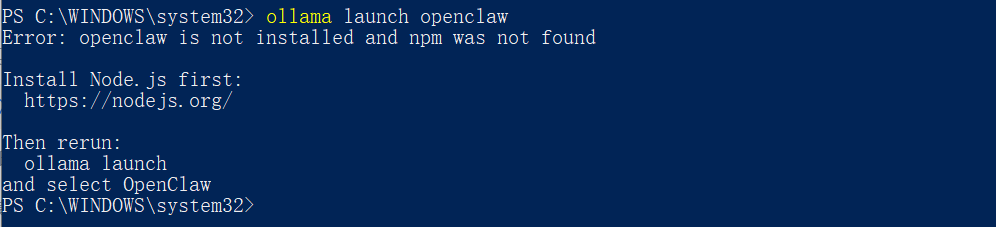

安装NodeJs

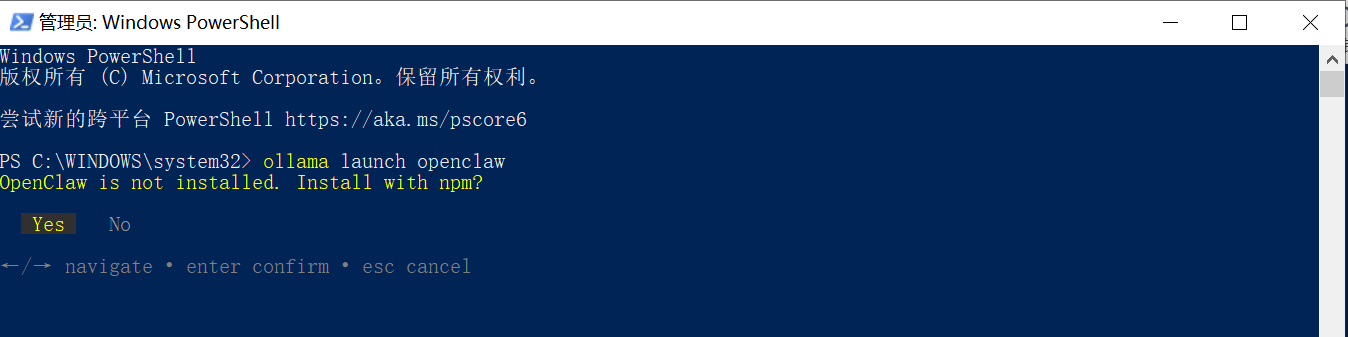

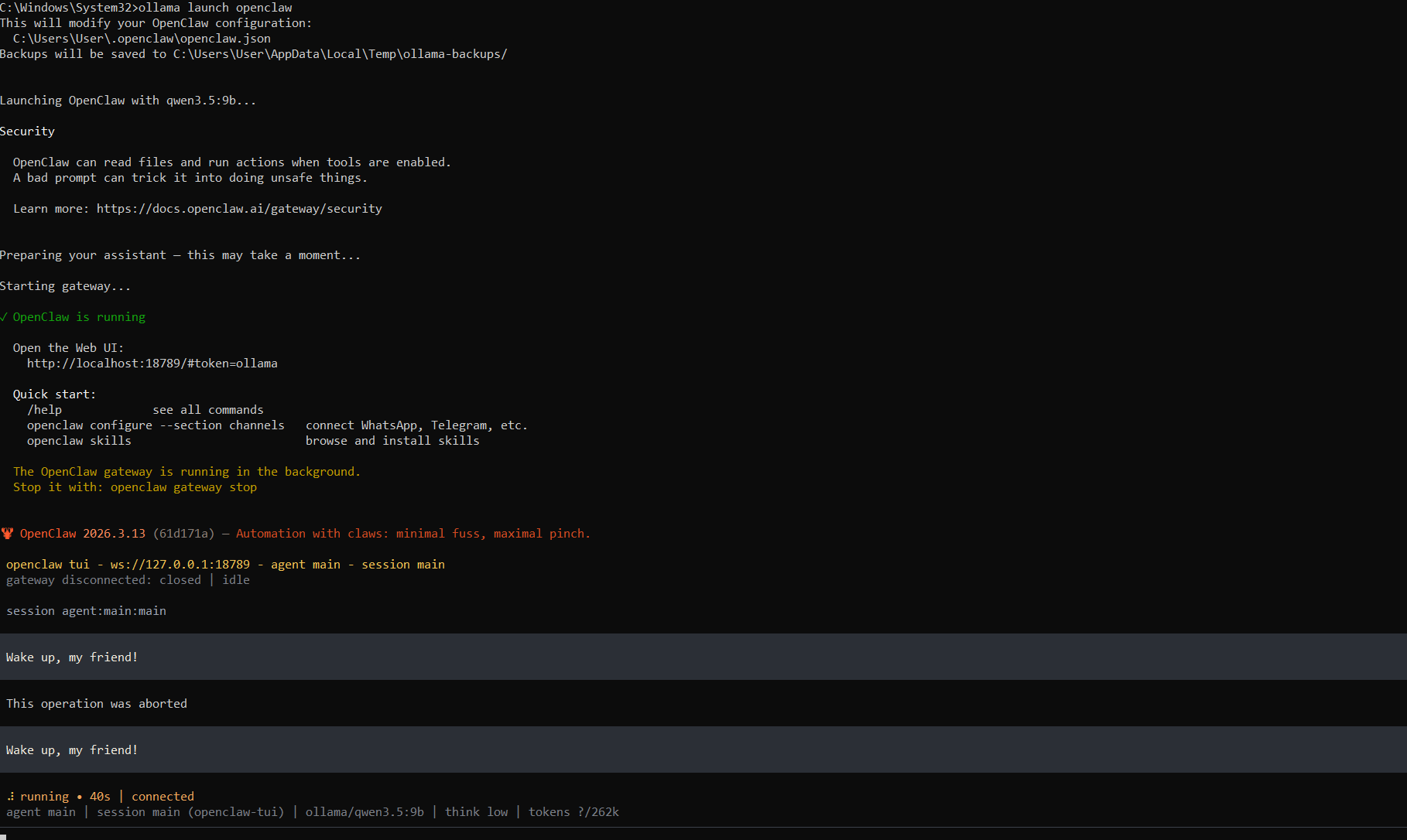

有了ollama之后直接使用命令ollama launch openclaw启动openclaw,出现如下提示:

由于openclaw是基于nodejs开发的项目,因此首先要安装nodejs的环境。下载nodejs,链接见这里,如下:

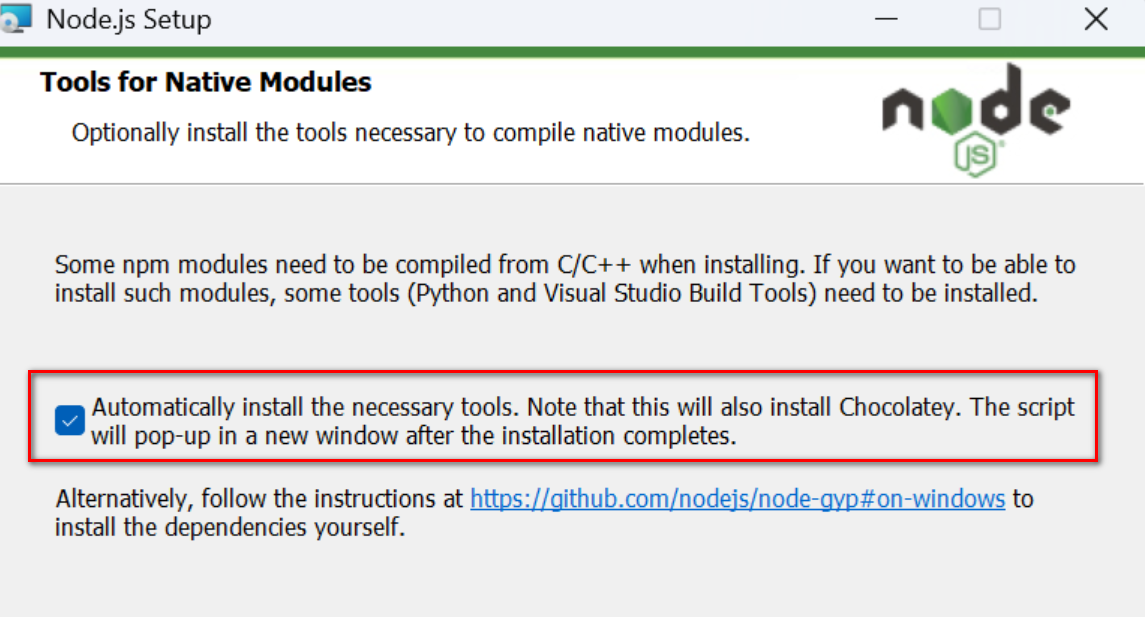

在安装这一块需要注意的是这一块一定要勾选自动安装所需要的依赖工具,在完成nodejs安装后,自动安装这些依赖需要10多分钟。

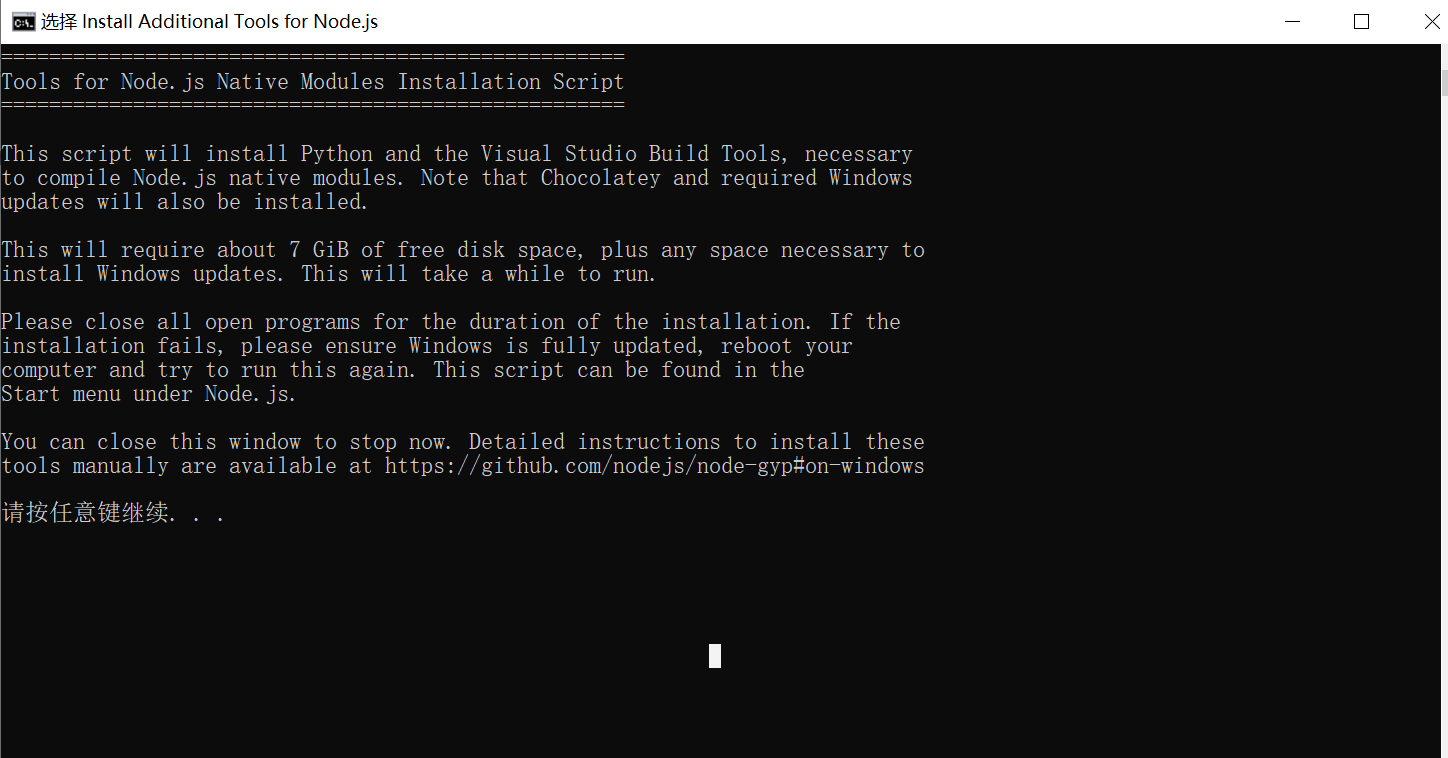

完成nodejs安装会提示按任意键继续,如下:

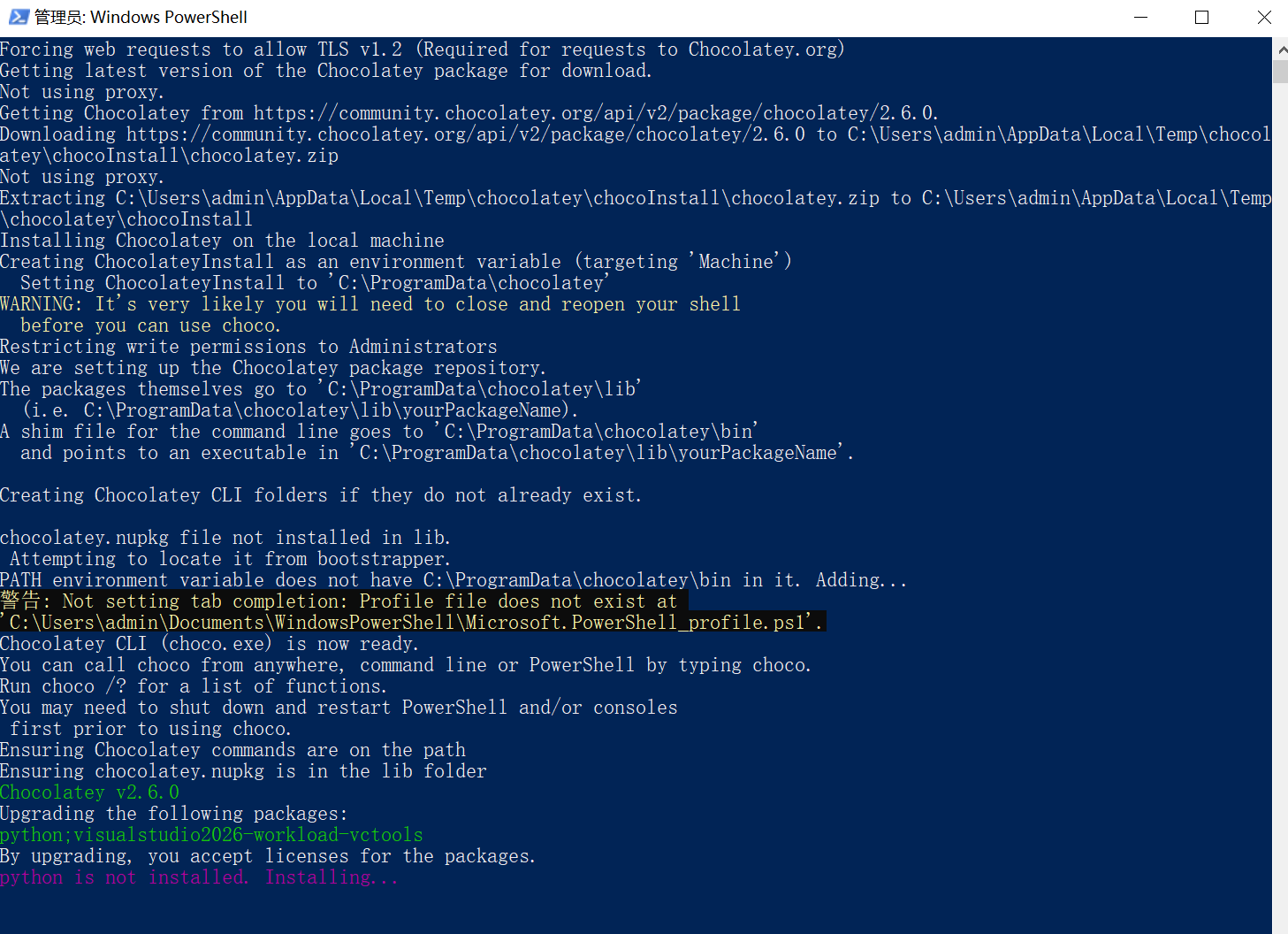

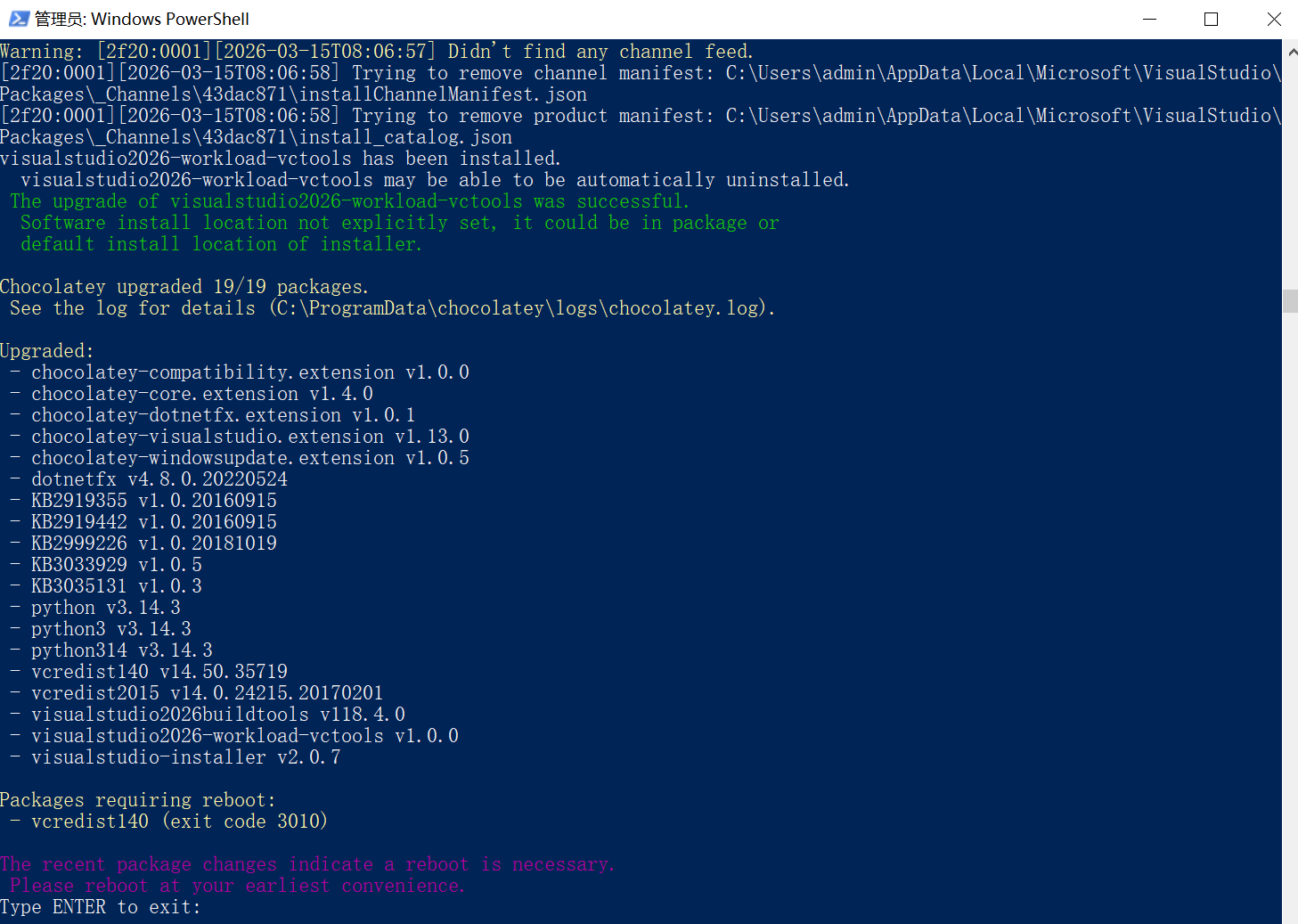

然后自动调用powershell安装其他依赖软件:

安装完成提示如下:

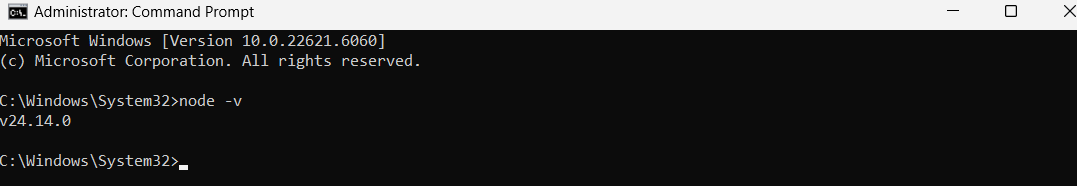

使用如下命令校验nodejs是否安装成功:

安装openclaw

继续执行ollama launch openclaw 命令如下,选择yes:

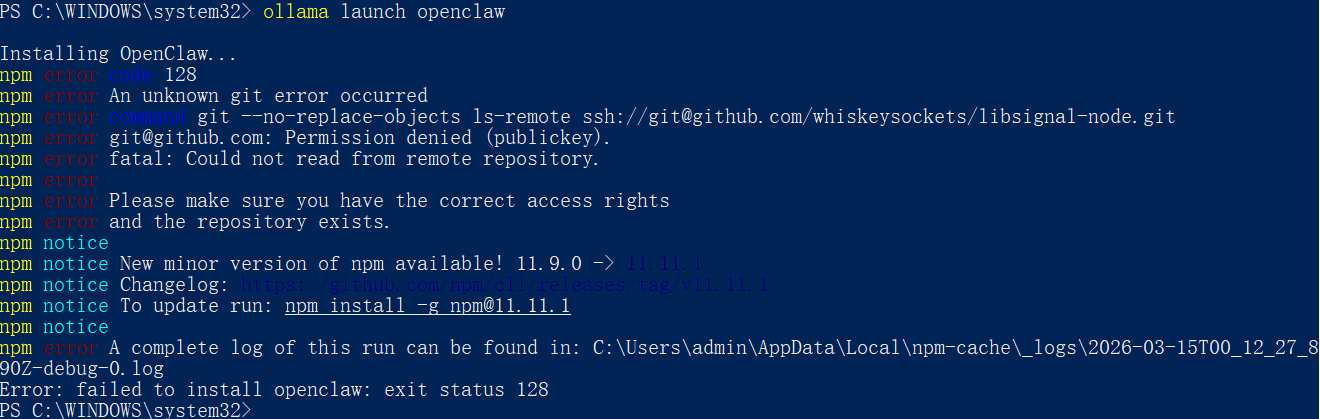

可能出现如下网络错误:

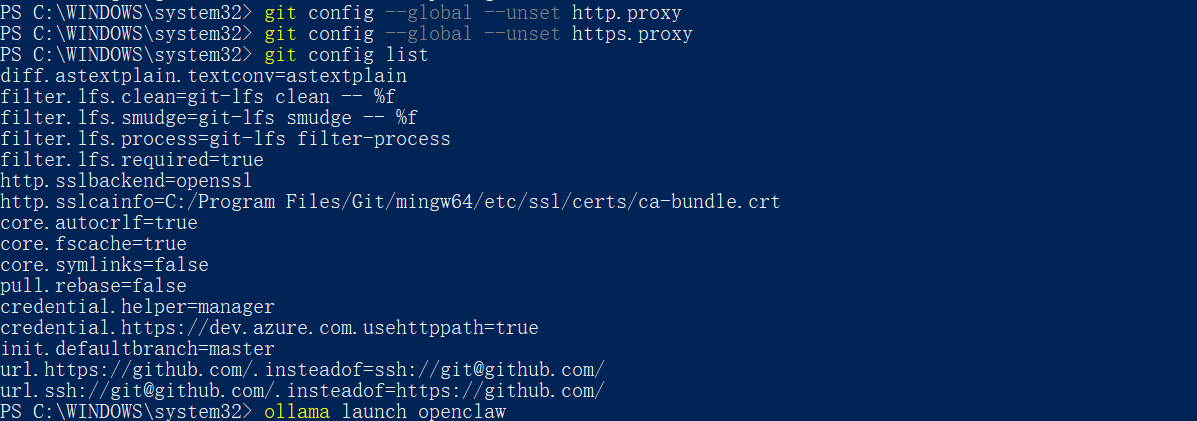

可能两个原因,其一查看使用git config list查看proxy配置,看看是否正确配置了proxy,必要时可以unset proxy,保证网络的连通性,如下:

如果还有可能的原因需要执行如下命令:

bash

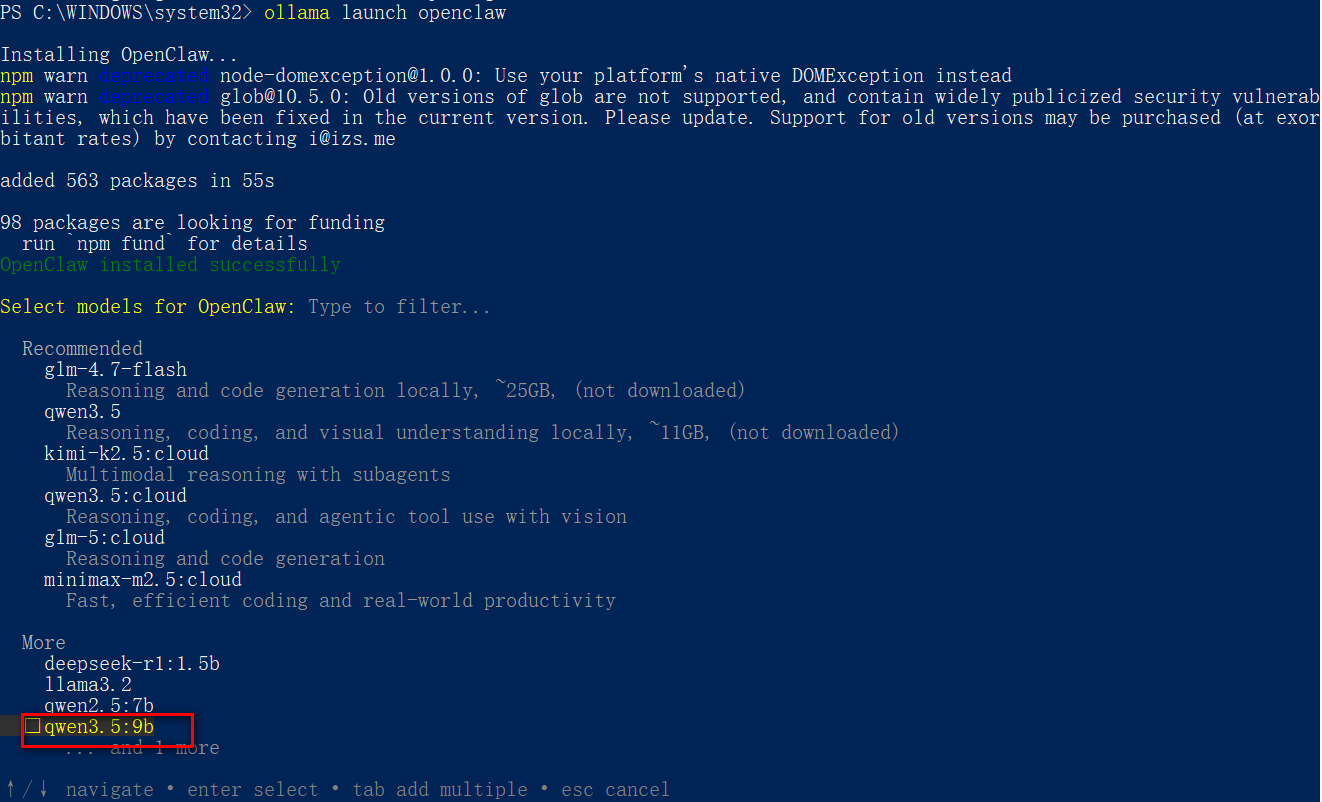

git config --global url."https://github.com/".insteadOf ssh://git@github.com/继续之后,选择本地已有的模型(要提前下载模型到本地):

当然也可以在CMD中执行该命令如下:

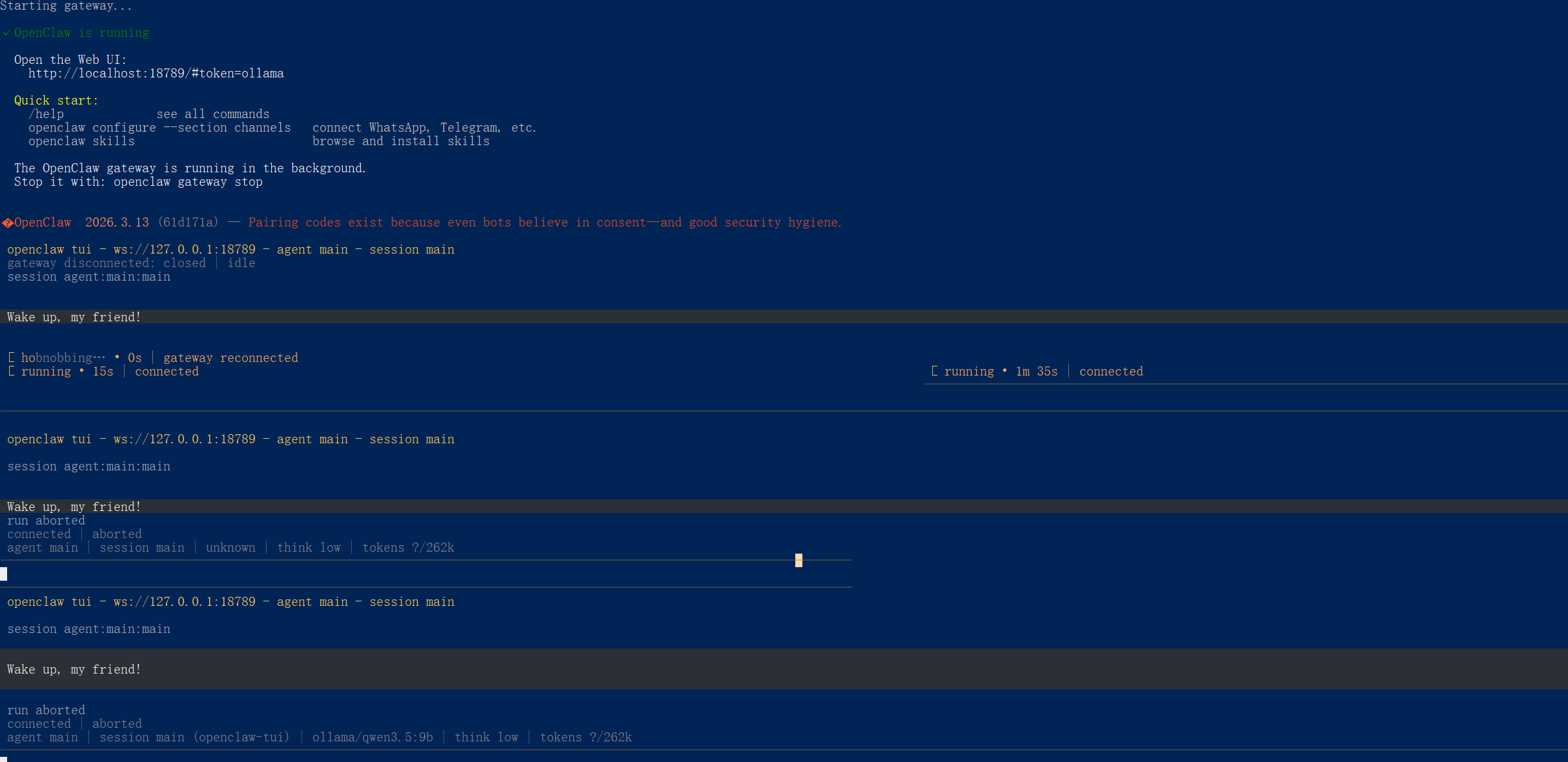

openclaw

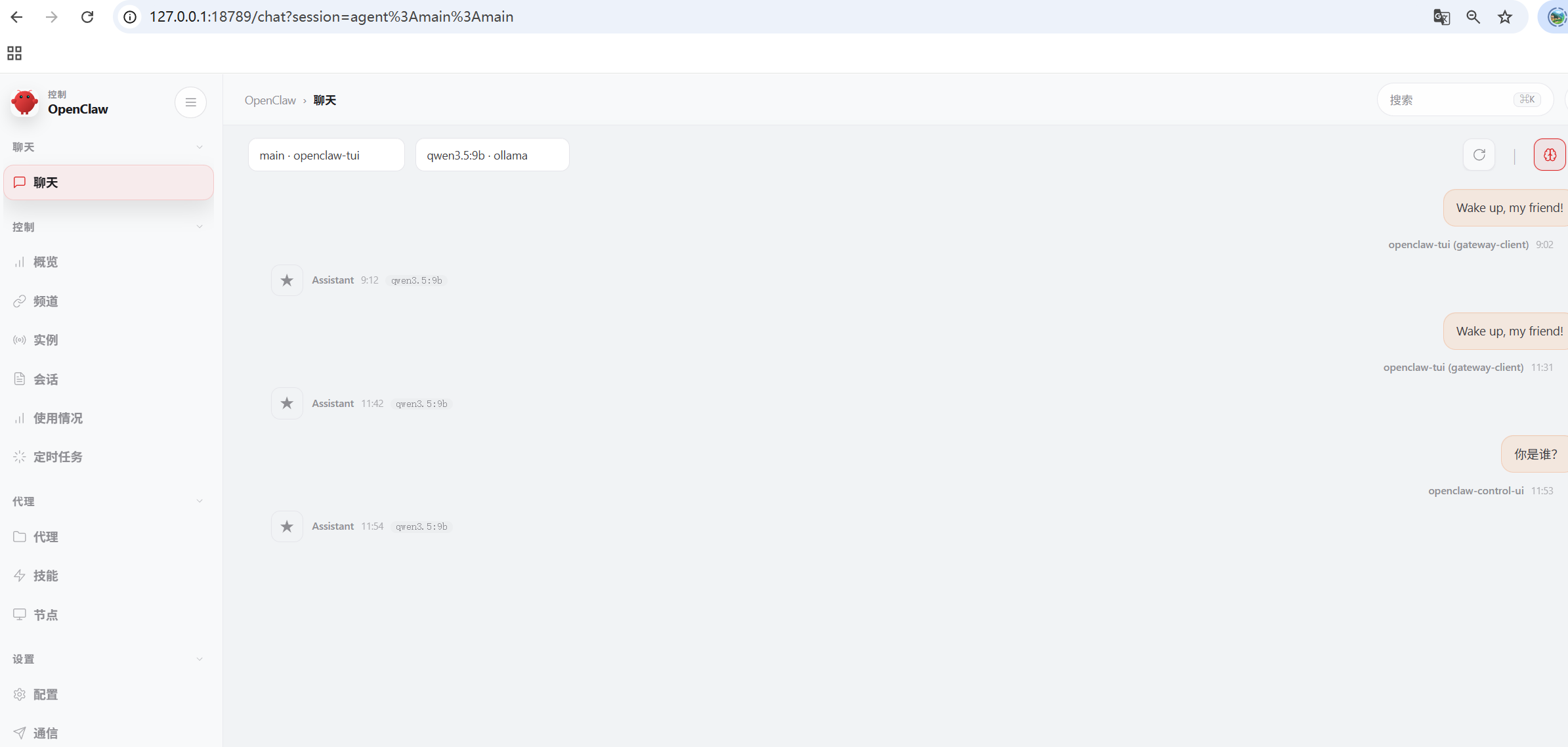

上述命令执行成功之后,直接访问本地的18789端口的WEB服务,如下为openclaw主页面:

本文并没有详细说明很多的配置,后续会按照openclaw功能详细介绍,详见后续的《AI安全》专栏,见这里。