为什么要提示词模版呢?就是为了能够复用,举个例子:比如现在有一个要求,

把用户传入的数据,从{language_from}翻译为{language_to},我们定义好提示词,只需要传这两个变量即可。定义好模版,我们就可以通过仅仅传入变量来实例化模版

提示词模板就是⼀个可复用的提示词蓝图,它允许我们动态地生成提示词,而不是每次都手动编写完整的提示词。它类似于编程中的字符串格式化功能。你创建⼀个带有"占位符"的模板,然后在运行时,用具体的值(变量)填充这些占位符,从而生成⼀个最终发送给 LLM 的完整提示词

提示词模板解决了以下几个核心问题:

可复用性: 只需定义⼀个模板,就可以用于⽆数个类似的查询

结构性: 将提示词的结构和逻辑(⼯程)与具体的内容和数据分离开。提示工程师可以专注于

优化模板,而应用程序则负责提供变量值。

⼀致性: 确保发送给LLM的提示词结构统⼀,这有助于获得更稳定、可预测的输出结果。

可维护性: 如果需要修改提示词的风格或结构,只需修改⼀个模板⽂件,而不用在代码的无数个地方进行修改

LangChain 提供了 PromptTemplate 类来轻松实现这⼀功能。 PromptTemplate 实现了标准的 Runnable 接口

举个例子:

python

model = ChatOpenAI(model="deepseek-chat",

api_key=os.environ.get("DEEPSEEK_API_KEY"),

openai_api_base="https://api.deepseek.com/v1")

# 方式一:使用from_template

# prompt_template = PromptTemplate.from_template("把用户传入的数据,从{language_from}翻译为{language_to}")

# 方式2,直接构造

prompt_template = PromptTemplate(input_variables=["language_from", "language_to", "text"],

template="把用户传入{text},从{language_from}翻译为{language_to}")

chain = prompt_template | model

# messages = [

# HumanMessage("我是一个人在战斗!"),

# ]

chain.invoke({

"language_from": "中文",

"language_to": "英文",

"text": "我是一个人在战斗!"

}).pretty_print()提示词有很多模版,我们再来看一个很常用的

聊天消息模板

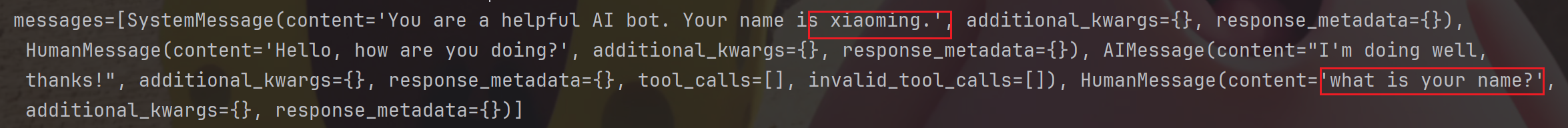

ChatPromptTemplate 模板:专为 LangChain 聊天模型设计。可以方便地构建包含 SystemMessage 、 HumanMessage 、 AIMessage 的消息模板。

python

# ChatPromptTemplate

template = ChatPromptTemplate(

[

("system", "You are a helpful AI bot. Your name is {name}."),

("human", "Hello, how are you doing?"),

("ai", "I'm doing well, thanks!"),

("human", "{user_input}"),

]

)

print(template.invoke({

"name": "xiaoming",

"user_input": "what is your name?"

}))

消息占位符

在上⾯的 ChatPromptTemplate 中,我们看到了如何格式化两条消息,每条消息都是⼀个字符串。但如果我们希望将消息插⼊特定位置怎么办?使用 MessagesPlaceholder 。MessagesPlaceholder 负责在特定位置添加消息列表。

python

template = ChatPromptTemplate(

[

("system", "You are a helpful AI bot. Your name is {name}."),

("human", "Hello, how are you doing?"),

MessagesPlaceholder("msgs"),

("ai", "I'm doing well, thanks!"),

("human", "{user_input}"),

]

)

# print(template.invoke({

# "name": "xiaoming",

# "user_input": "what is your name?"

# }))

messages_to_pass = [

HumanMessage(content="中国⾸都是哪⾥?"),

AIMessage(content="中国⾸都是北京。"),

HumanMessage(content="那法国呢?")

]

print(template.invoke({

"name": "xiaoming",

"user_input": "what is your name?",

"msgs": messages_to_pass

}))或者这样写也可以:

python

template = ChatPromptTemplate(

[

("system", "You are a helpful AI bot. Your name is {name}."),

("human", "Hello, how are you doing?"),

("placeholder", "{msgs}"),

("ai", "I'm doing well, thanks!"),

("human", "{user_input}"),

]

)最后调用一下链:

python

chain = template | model

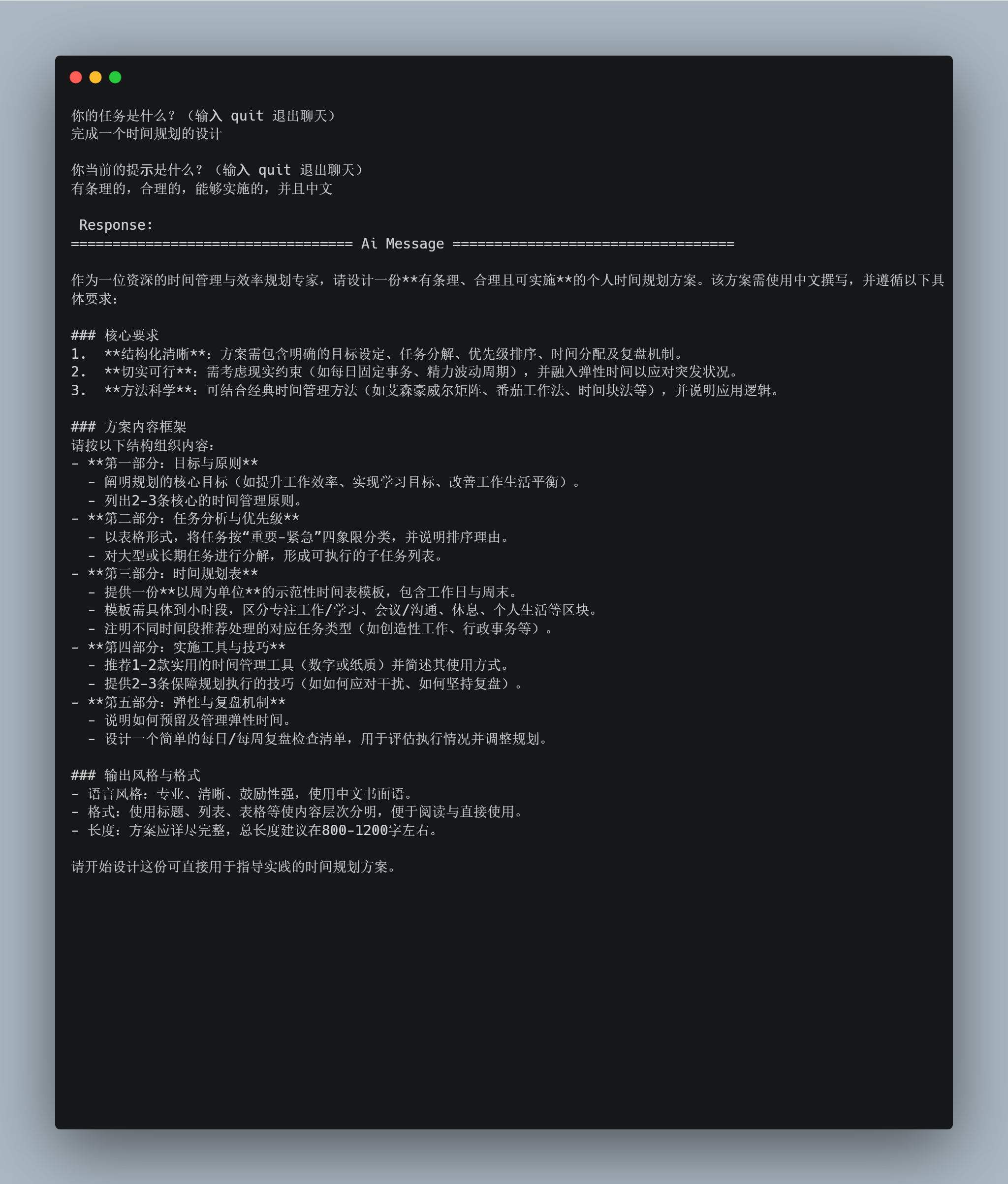

这里给小伙伴们推荐一个提示词平台,随着 LLM 的发展,示词变得越来越重要。LangChain 正在打造⼀个与像 GitHub 这样的传统平台, GitHub长期以来⼀直是共享和协作代码的⾸选平台。于是推出了 LangChain Hub 平台。

比如调用一下最火的能够给我们写提示词的模版工具(hardkothari/prompt-maker),我们只需要简单告诉他我们的任务和一些关键性提示词,就能帮我们写出一份合理的系统提示词:

python

# Create a LangSmith API in Settings > API Keys

# Make sure API key env var is set:

# import os; os.environ["LANGSMITH_API_KEY"] = "<your-api-key>"

import os

from langchain_openai import ChatOpenAI

from langsmith import Client

client = Client()

prompt = client.pull_prompt("hardkothari/prompt-maker")

# 定义模型

model = ChatOpenAI(model="deepseek-chat",

api_key=os.environ.get("DEEPSEEK_API_KEY"),

openai_api_base="https://api.deepseek.com/v1")

# 定义链

chain = prompt | model

while True:

task = input("\n你的任务是什么?(输⼊ quit 退出聊天)\n")

if task == 'quit':

break

lazy_prompt = input("\n你当前的提⽰是什么?(输⼊ quit 退出聊天)\n")

if lazy_prompt == 'quit':

break

print("\n Response:")

chain.invoke({'lazy_prompt': lazy_prompt, 'task': task}).pretty_print()

所以,有了ChatPromptTemplate,我们就无需再在Message中定义了,直接在ChatPromptTemplate定义系统提示词,用户提示词...