方式一:一键安装脚本(推荐)

macOS / Linux / WSL2

bash

curl -fsSL https://openclaw.ai/install.sh | bashWindows PowerShell

bash

iwr -useb https://openclaw.ai/install.ps1 | iex如果只想安装、不立即进入向导:

bash

curl -fsSL https://openclaw.ai/install.sh | bash -s -- --no-onboard方式二:npm 手动安装

确保 Node.js 22+

bash

node --version全局安装 OpenClaw

bash

npm install -g openclaw@latest

# 运行配置向导(同时安装守护进程)

openclaw onboard --install-daemon方式三:Docker 部署

bash

docker pull openclaw/openclaw:latest

bash

docker run -d \

--name openclaw \

-p 18789:18789 \

-v ~/.openclaw:/root/.openclaw \

-e ANTHROPIC_API_KEY=sk-ant-xxx \

openclaw/openclaw:latest安装后验证

bash

openclaw --version

openclaw doctor

openclaw gateway status

openclaw dashboard

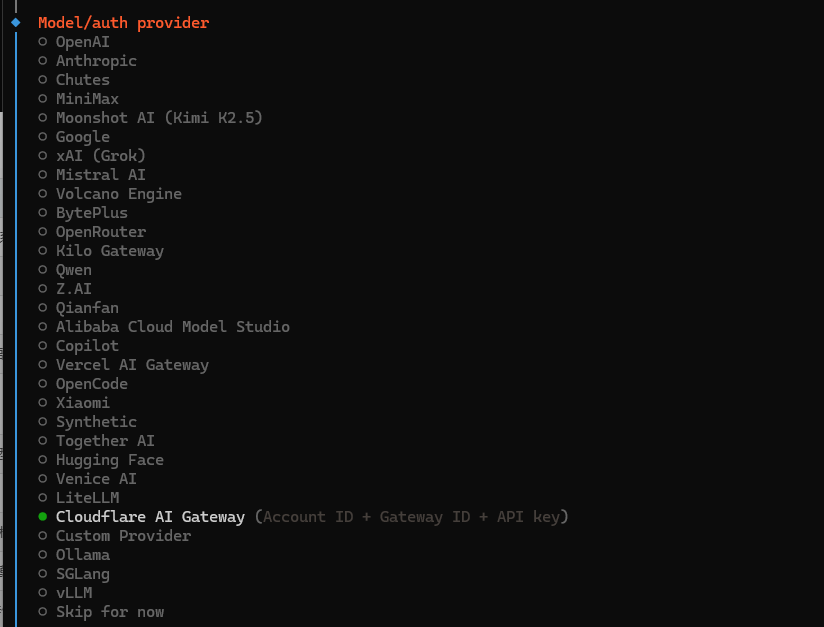

一个对照表格,展示每个选项支持的厂商:

| 选项 | 支持的厂商/模型 |

|---|---|

| OpenAI | OpenAI(GPT-4、GPT-3.5 等系列模型) |

| Anthropic | Anthropic(Claude 系列模型) |

| Chutes | 需要查询具体文档 |

| MiniMax | MiniMax(ABAB 系列模型、语音模型等) |

| Moonshot AI (Kimi K2.5) | 月之暗面(Kimi 系列模型) |

| Google(Gemini、PaLM 等模型) | |

| xAI (Grok) | xAI(Grok 系列模型) |

| Mistral AI | Mistral AI(Mistral、Mixtral 等模型) |

| Volcano Engine | 字节跳动火山引擎(豆包系列模型) |

| BytePlus | 字节跳动 BytePlus(AI 服务套件) |

| OpenRouter | OpenRouter(聚合多厂商模型接口) |

| Kilo Gateway | 需要查询具体文档 |

| Qwen | 阿里云(通义千问系列模型) |

| Z.AI | 知乎(知海图 AI 模型) |

| Qianfan | 百度智能云千帆平台(文心一言等模型) |

| Alibaba Cloud Model Studio | 阿里云(模型服务平台,含通义千问等) |

| Copilot | GitHub Copilot / Microsoft Copilot 相关服务 |

| Vercel AI Gateway | Vercel AI Gateway(聚合多厂商模型接口) |

| OpenCode | 需要查询具体文档 |

| Xiaomi | 小米(MiLM 小爱同学系列模型) |

| Synthetic | 需要查询具体文档 |

| Together AI | Together AI(聚合多种开源模型) |

| Hugging Face | Hugging Face(Hugging Face Hub 上的模型) |

| Venice AI | Venice AI(隐私优先的 AI 服务) |

| LiteLLM | LiteLLM(聚合多厂商模型接口) |

| Cloudflare AI Gateway | 聚合多厂商:OpenAI、Anthropic、Google、Azure OpenAI、Amazon Bedrock、Cohere、DeepSeek、Groq、Hugging Face、Mistral AI、OpenRouter、Perplexity、Replicate、xAI、ElevenLabs、Cerebras、Workers AI、Cartesia 等 |

| Custom Provider | 用户自定义的任意 AI 服务商 |

| Ollama | Ollama(本地运行的开源模型) |

| SGLang | SGLang(支持多种开源模型的高效推理框架) |

| vLLM | vLLM(支持多种开源模型的高吞吐推理框架) |

| Skip for now | 跳过此步骤 |

需要特别说明的是:

- Cloudflare AI Gateway 是一个统一的代理和管控平台,本身不生产模型,而是支持连接上述所有主流 AI 厂商的 API

- OpenRouter 、Vercel AI Gateway 、LiteLLM 等也属于聚合类平台,支持对接多家厂商

- 标记为 "需要查询具体文档" 的选项可能需要进一步查阅官方文档了解具体支持范围

按空格选中

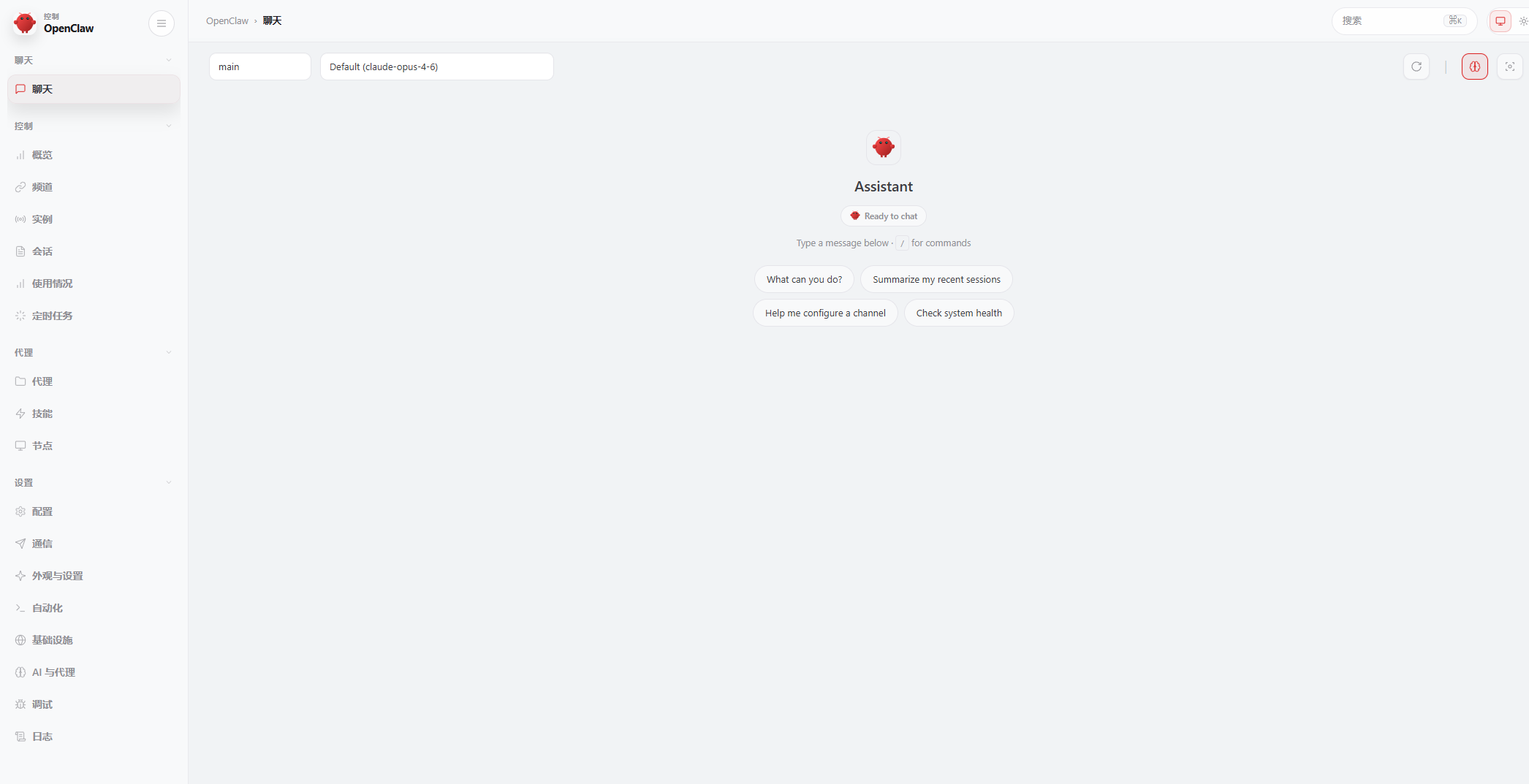

他自己就会跳到这个页面

将 OpenClaw 接入 Telegram,核心分为三步:创建 Telegram Bot、配置 OpenClaw 模型和频道、完成最终配对。整个过程可以根据你的部署环境(如云服务器或本地)选择最顺畅的路径。

💎 方案一:通过配置向导快速接入(推荐新手)

这是最标准、最简单的流程,无论你是在腾讯云、阿里云还是本地部署的 OpenClaw,都可以通过内置的 openclaw onboard 命令来启动配置向导,一步步完成设置。

1. 🎯 前期准备:创建你的 Telegram 机器人

在开始配置 OpenClaw 之前,你需要先拥有一个 Telegram 机器人的"通行证"(Token)。

- 找到 BotFather :在 Telegram 中搜索

@BotFather,这是官方机器人,用于创建和管理其他机器人。 - 创建新机器人 :向 BotFather 发送

/newbot命令。 - 设置名称和用户名 :根据提示,为你的机器人设置一个显示名称(例如

我的AI助理)和一个唯一的用户名(必须以_bot结尾 ,例如MyAIAssistant_bot)。 - 保存Token :创建成功后,BotFather 会返回一条包含

HTTP API的 Token 信息(格式类似7234567890:AAHdqTcvCH1vGWJxfSeofSAs0K5PALDsaw)。请务必复制并妥善保存这个 Token,它就是连接你 OpenClaw 和 Telegram 的"钥匙"。

2. ⚙️ 运行配置向导

登录到你的 OpenClaw 所在服务器,在终端执行以下命令,启动交互式配置向导:

bash

openclaw onboard3. 🧭 在向导中按步骤操作

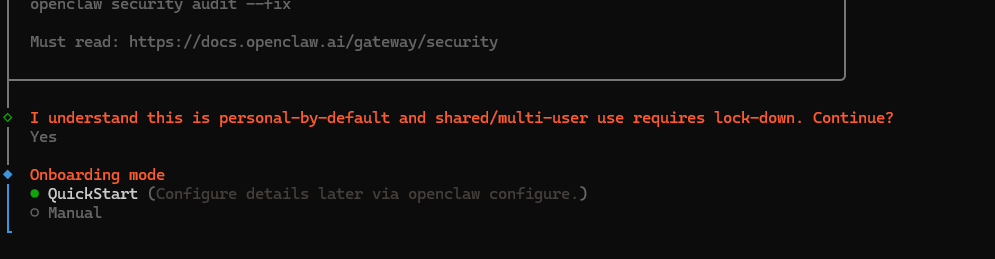

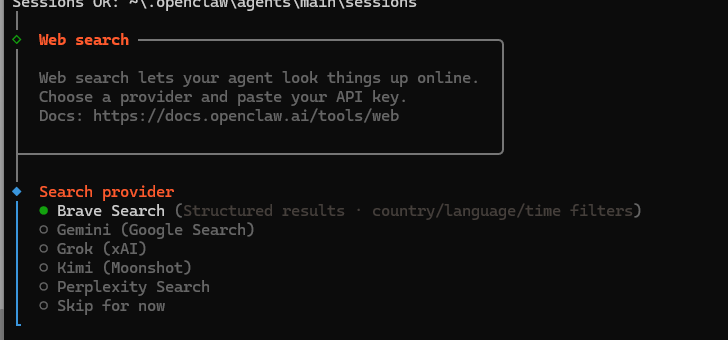

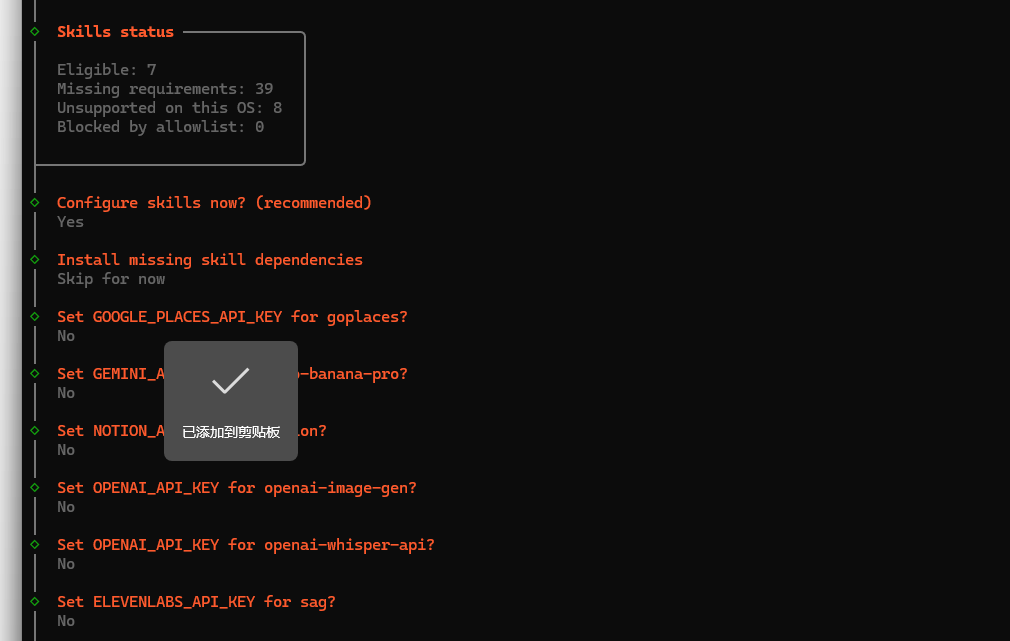

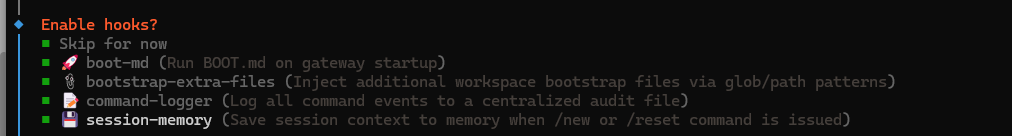

启动后,你会看到一个基于文本的菜单,需要用键盘方向键和回车键进行选择和确认。关键步骤如下:

- 同意免责声明 :选择

Yes。 - 选择配置模式 :选择

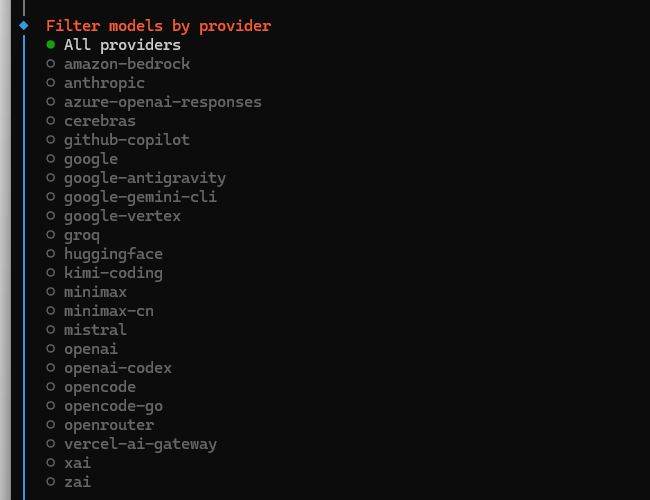

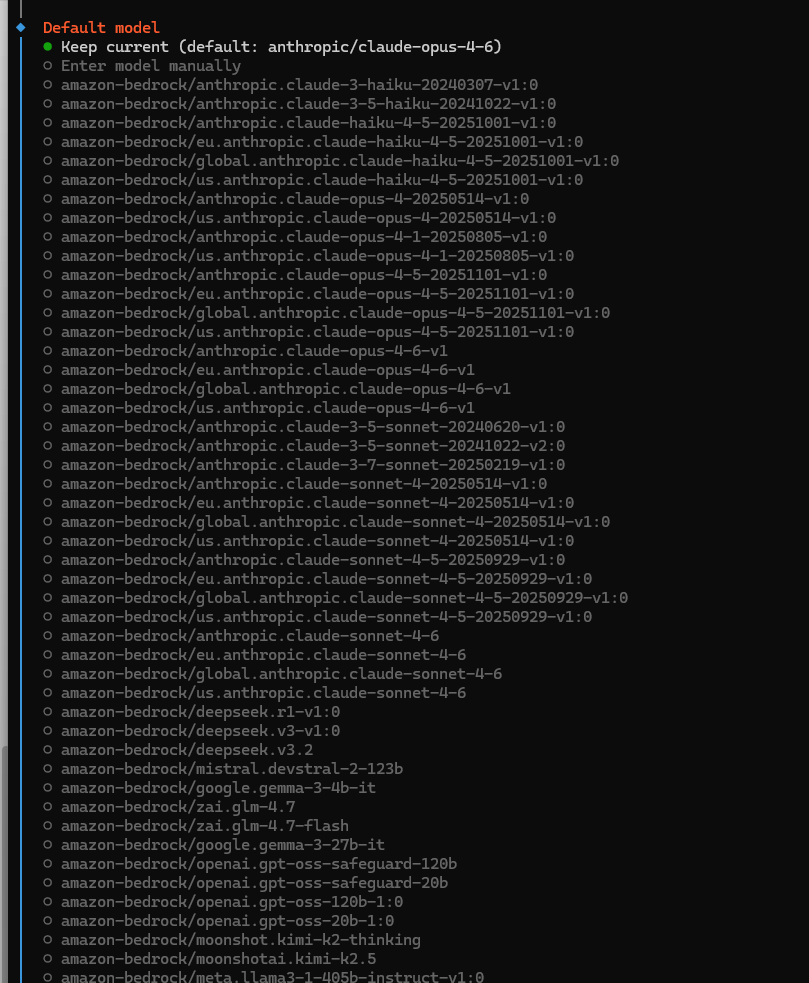

QuickStart(快速入门)。 - 配置AI模型 :这是让OpenClaw具备理解能力的关键。

- 选择你的模型提供商(例如阿里云百炼、MiniMax、腾讯混元等)。

- 输入对应的 API Key。如果你之前已在云控制台配置过,此处可选择跳过。

- 配置频道 :当进入

Select channel步骤时,用方向键选中Telegram (Bot API)并回车。 - 输入Bot Token:将你在第一步保存的 Telegram Bot Token 粘贴到这里并回车。

- 其他配置 :

- Skills(技能包) :新手建议选

No,避免因执行系统命令等高级功能带来的安全风险。 - Hooks :如果出现此步骤,建议只选择

session-memory以确保安全。

- Skills(技能包) :新手建议选

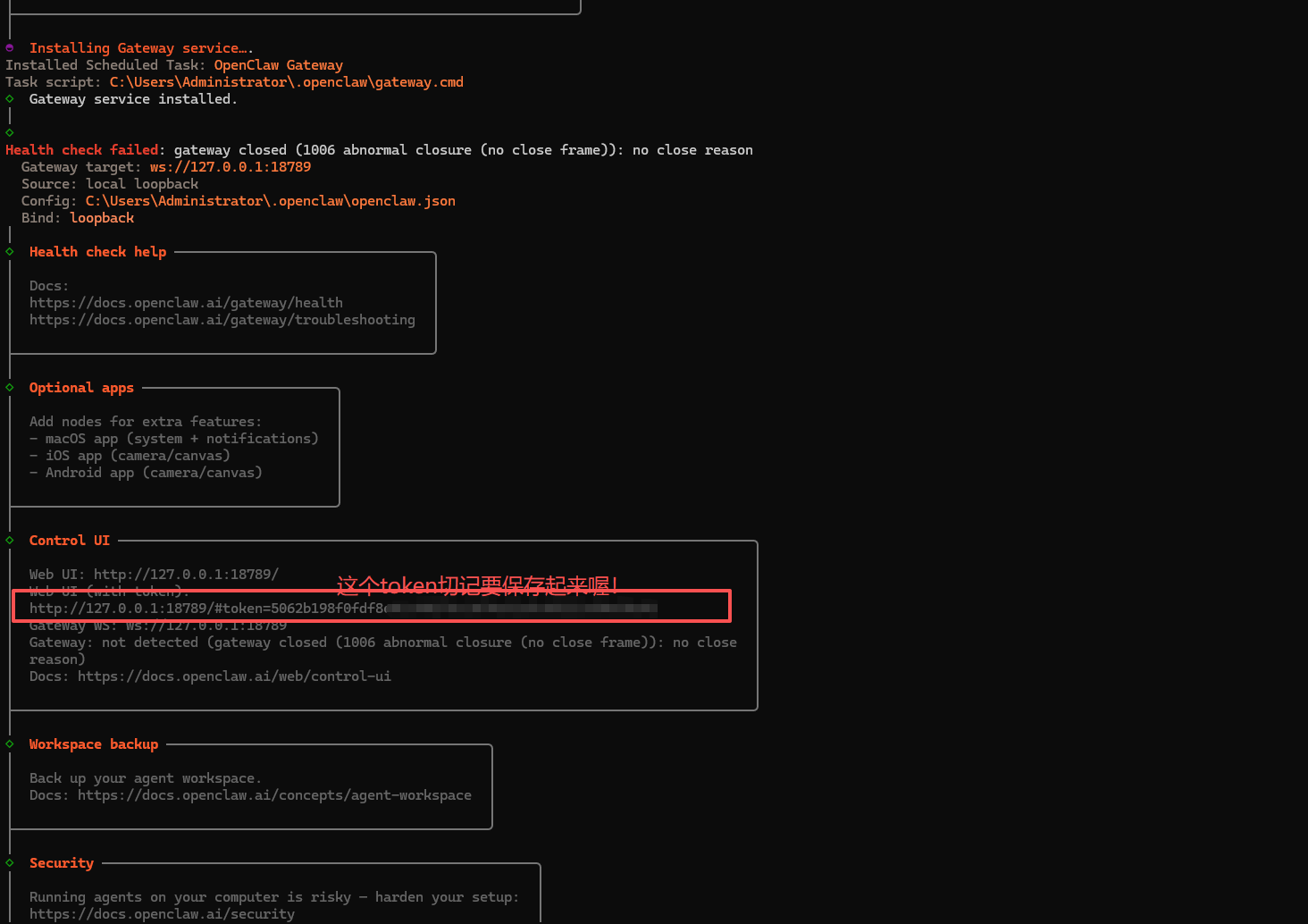

完成上述步骤后,等待向导自动退出,Telegram 频道的基础配置就完成了。

4. 🔗 最终配对:在Telegram中激活机器人

这是最后一步,用于将你的 Telegram 账号与 OpenClaw 实例绑定。

-

获取配对码 :在 Telegram 中打开你刚刚创建的机器人,点击

START按钮。机器人会自动回复一条消息,其中包含一个Pairing Code(配对码)。 -

在服务器上确认 :回到服务器的终端,执行以下命令,将

<你的配对码>替换为 Telegram 中收到的数字或字母组合。bashopenclaw pairing approve telegram <你的配对码> -

成功:命令执行成功后,你的 Telegram 机器人和 OpenClaw 就正式连接了。现在,你可以在 Telegram 中向机器人发送消息,它将会以 AI 助手的身份与你对话。

💎 方案二:通过命令行手动配置(适合进阶用户)

如果你更喜欢直接修改配置,或者需要在脚本中自动化部署,也可以使用命令行进行手动设置。

1. 🎯 前期准备

与方案一相同,你需要先通过 @BotFather 创建好机器人并获取 Bot Token 。此外,建议通过 @userinfobot 获取你的个人Telegram 用户ID(一串数字),用于设置权限。

2. ⚙️ 执行配置命令

通过 SSH 登录到你的 OpenClaw 服务器,执行以下一组命令来配置 Telegram 频道(部分命令可能需要先进入 OpenClaw 的容器环境 docker exec -it openclaw-core /bin/bash)。

bash

# 1. 设置 Telegram Bot Token

openclaw config set channels.telegram.botToken "你的BotToken"

# 2. (可选但推荐) 设置允许访问的用户ID,提高安全性

openclaw config set channels.telegram.allowedChatIds "你的用户ID"

# 3. 启用 Telegram 频道

openclaw config set channels.telegram.enabled true

# 4. (可选) 配置为 Webhook 模式,通常更稳定

# 将 <你的公网IP> 替换为服务器的公网IP地址

openclaw config set channels.telegram.mode "webhook"

openclaw config set channels.telegram.webhookUrl "http://<你的公网IP>:18789/telegram/webhook"

# 5. 重启 OpenClaw 服务使配置生效

openclaw gateway restart手动设置完配置后,仍需执行方案一中的"最终配对"步骤 ,在 Telegram 中获取配对码并在服务器上运行 openclaw pairing approve telegram <配对码> 来完成绑定。

💡 核心要点与避坑指南

- 部署环境 :为了让 Telegram 能稳定访问你的 OpenClaw,建议将 OpenClaw 部署在海外地域的云服务器上(如腾讯云轻量应用服务器、阿里云轻量应用服务器),以避免网络问题。

- AI模型依赖 :OpenClaw 本身不具备 AI 能力,必须配置第三方模型 API Key(如阿里云百炼、MiniMax、OpenAI等)才能实现自然语言对话。

- 安全性 :Bot Token 和 API Key 是核心凭证,请务必妥善保管,切勿泄露。泄露可能导致服务被滥用,产生不必要的费用。