目前许多 AI memory 项目都已经意识到:Memory ≠ Retrieval。

因为真正成熟的 AI memory,很可能会更接近一个持续演化的知识系统, 能够压缩经验、更新事实、并解决矛盾。

而这背后的核心问题,其实只有一个:我们应该如何在 AI 系统中,表示"记忆"本身。

PowerMem 是什么?

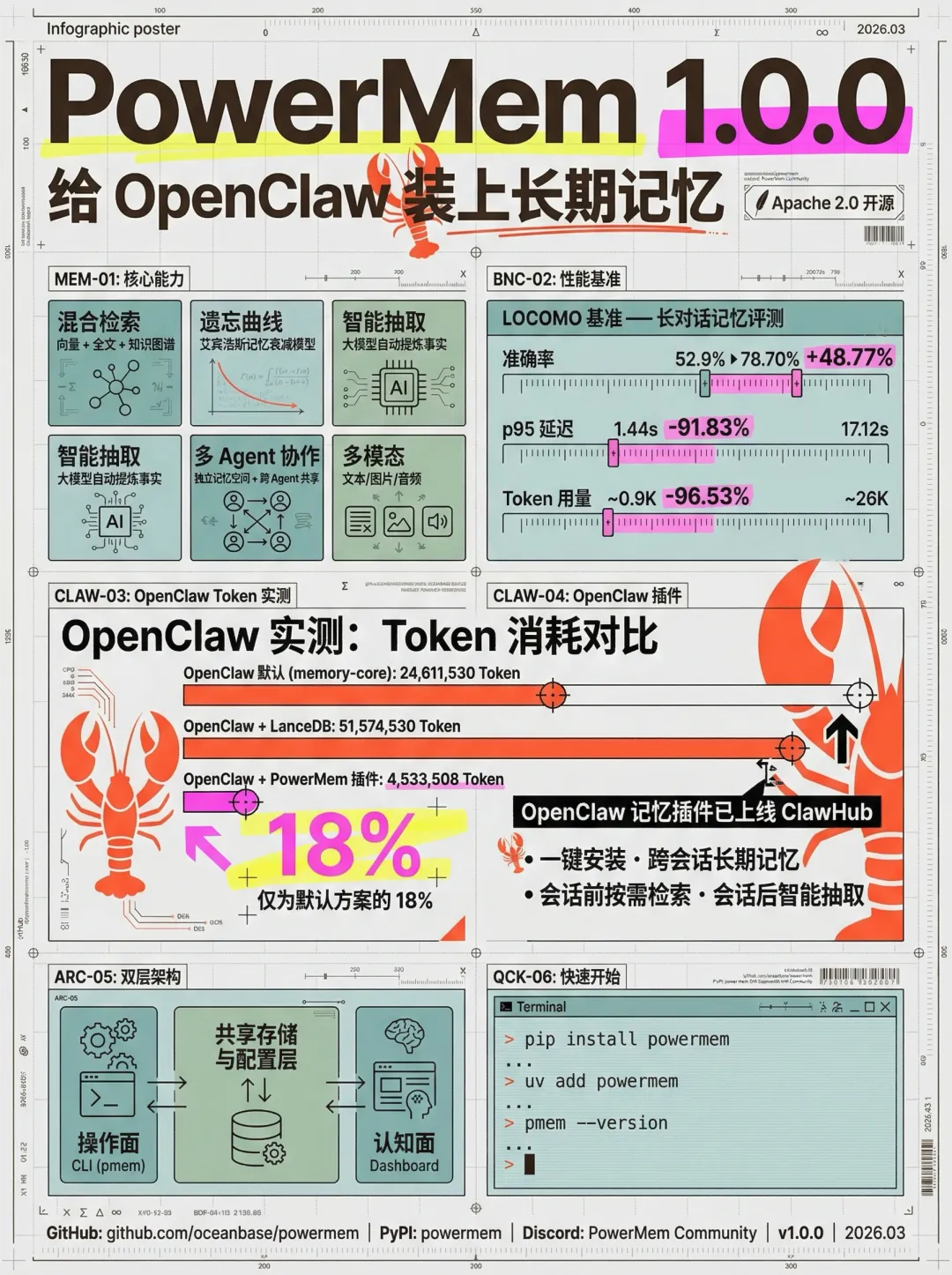

PowerMem 1.0.0:一个开源的智能记忆系统。

为 LLM 按需召回关键事实,Token 用量可降至全量上下文的 18%。

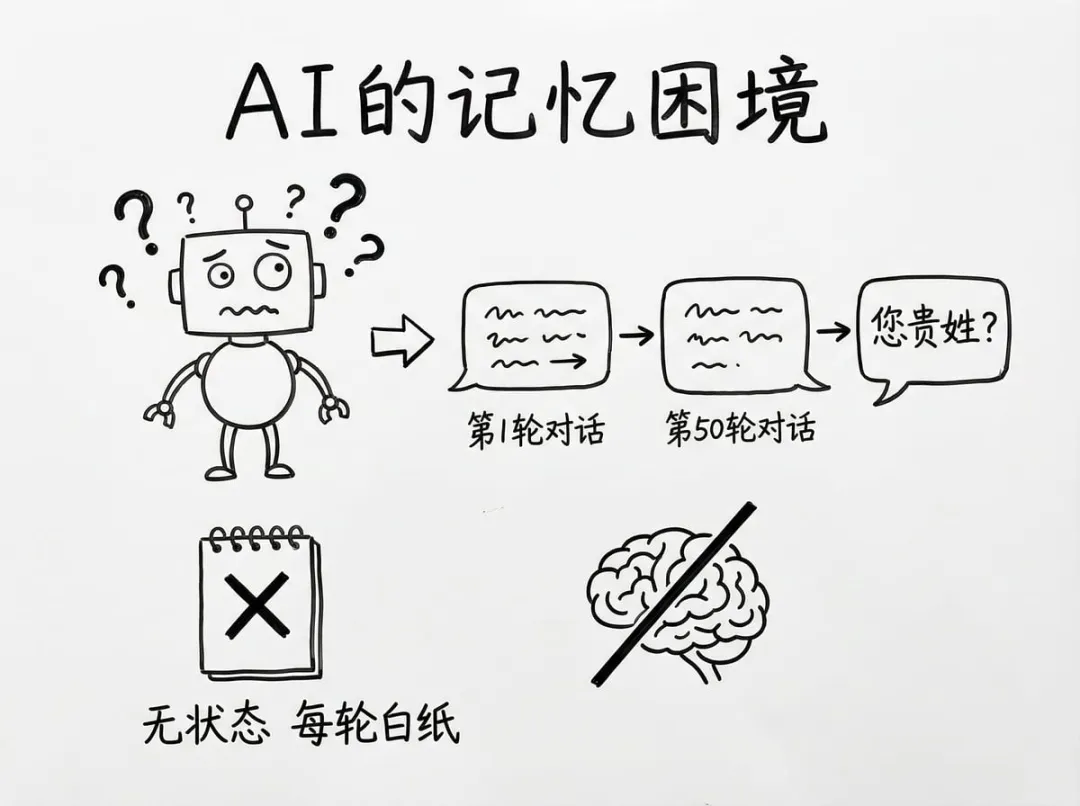

有没有这种体验:聊到第 50 轮,AI 突然问"您贵姓?"。或者昨天刚交代过偏好,今天又从头问起。

这不是模型"笨",而是它真的没有跨会话的记忆。

全量上下文方案代价高:推理变慢,Token 成本线性增长,上下文越长,模型对中间内容的注意力越差(中心衰减),回答质量反而下降。

OceanBase PowerMem 1是基于 Apache 2.02 协议的开源智能记忆系统,为 LLM 和多智能体应用提供持久化记忆层。

它从对话中提炼关键事实并持久化,过时的自动遗忘,需要时精准召回。

核心能力:

- 混合检索:向量、全文、知识图谱三路齐发------你模糊地说"上次那个项目",或精确搜"Q1 预算",都能找对

- 艾宾浩斯遗忘曲线:模拟人类遗忘规律,近期常用的优先,过时的自然淡出------就像人记得常去的餐厅,却忘了上周的菜单,AI 的"记忆"也该学会取舍

- 智能记忆抽取:大模型自动从对话里"划重点"------去重、冲突更新、相关合并,省得你手动整理

- 多智能体支持:每个 Agent 有自己的"记忆本",需要时还能跨 Agent 共享------团队协作,记忆也能协作

- 多模态:文本、图片、音频都能存、都能查,不止会记文字

我们在 LOCOMO **[3]** 基准(学术界用于衡量 AI 长对话记忆能力的标准数据集,模拟多轮长对话考察历史信息召回)上做了评测,PowerMem 对比全量上下文方案。

简单说:同样是记住长对话里的关键信息,PowerMem 用不到 1K token 就能逼近全量 26K token 的召回效果:

| 指标 | PowerMem | 全量上下文 | 提升 |

|---|---|---|---|

| 准确率 | 78.70% | 52.9% | +48.77% |

| p95 延迟 | 1.44s | 17.12s | 降低 91.83% |

| Token 用量 | ~0.9K | ~26K | 节省 96.53% |

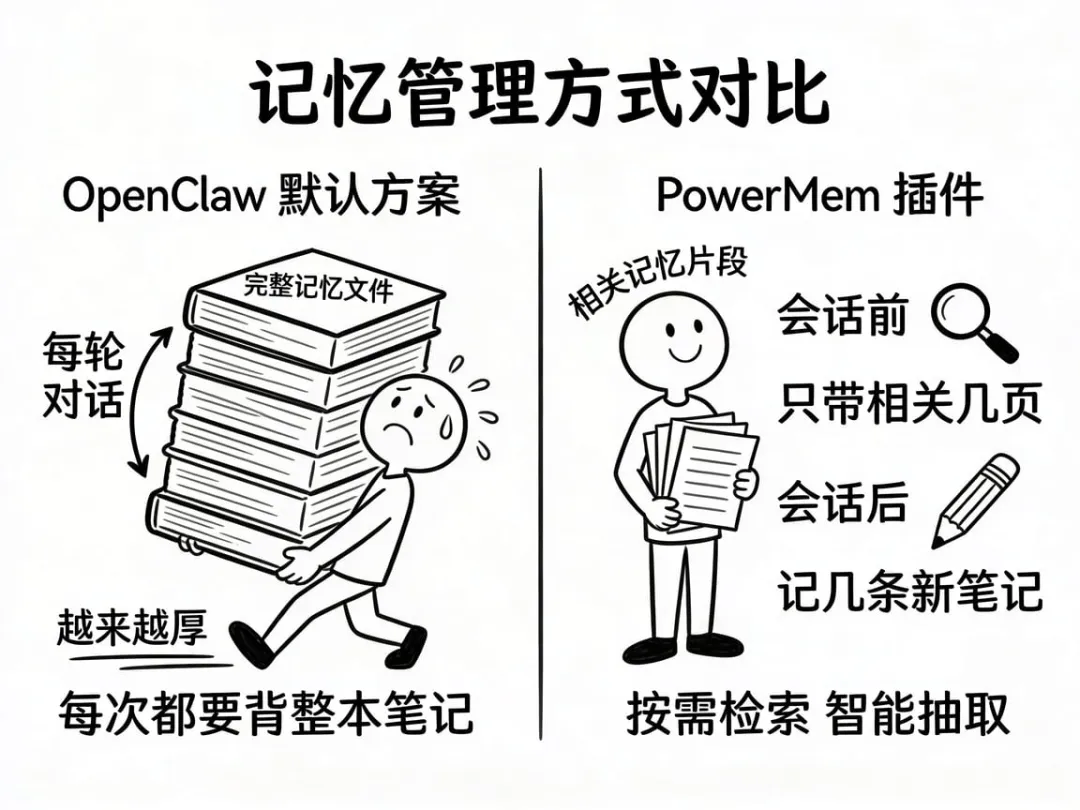

OpenClaw 默认每轮都把整份记忆文件塞进上下文------好比每次聊天都要背一本越写越厚的笔记本。

PowerMem 插件把它换成了"会话前按需检索、会话后智能抽取":只带和当前话题相关的那几页,用完再往本子里记几条新笔记。

落到真实场景验证:我们在 OpenClaw **[4]**上做了对比测试。

效果如何?我们直接看数据:

| 实验组 | 输入 Token 总量 |

|---|---|

| OpenClaw 默认(memory-core) | 24,611,530 |

| OpenClaw + LanceDB | 51,574,530 |

| OpenClaw + PowerMem 插件 | 4,533,508 |

同等任务下,PowerMem 插件的 Token 消耗仅为默认方案的 18%------原来要背整本书,现在带一页摘要就够了。

为什么发布 1.0.0 版本?

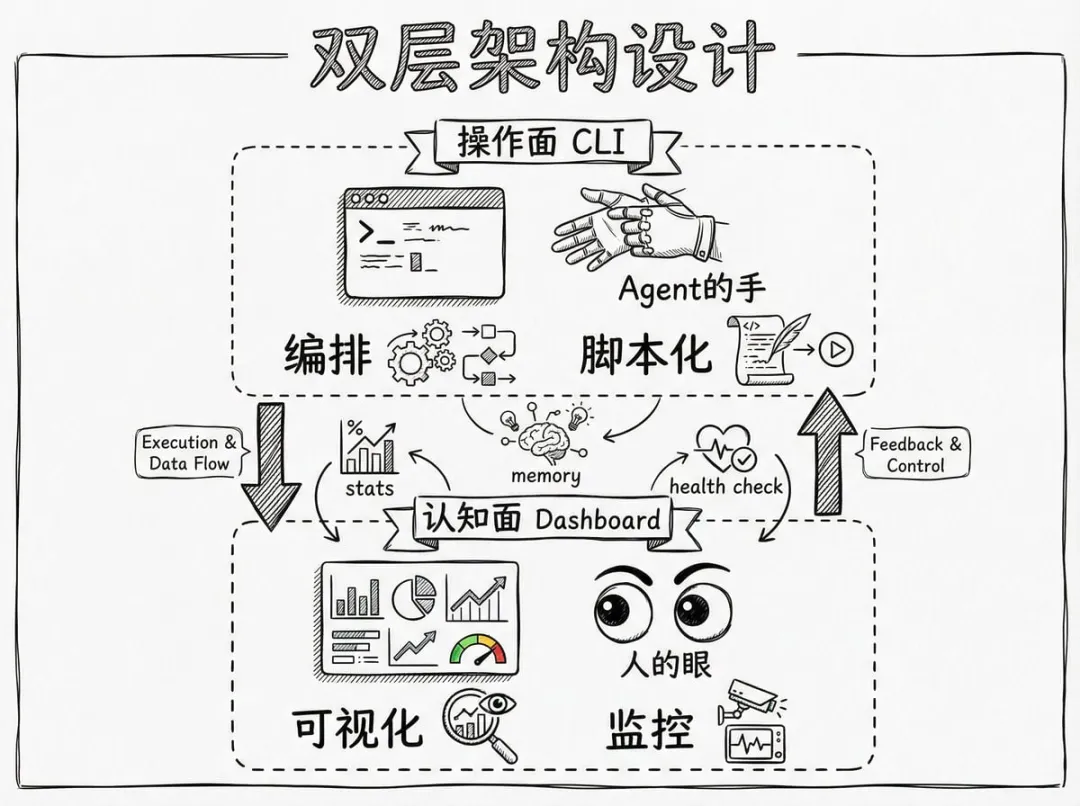

v1.0.0 API 与集成方式正式定型,从"可用"进入"可落地"阶段。这个版本同时交付了两层能力:

- CLI(

pmem)作为操作面:人和 Agent 共用的执行入口,支持编排和脚本化 - Dashboard 作为认知面:记忆的可视化、分布分析与健康监控,把数据变成判断依据

Agent 需要低摩擦接入的操作面,人需要理解全局的认知面,两层同时存在产品才完整------CLI 是 Agent 的"手",Dashboard 是人的"眼"。这个分层背后的思考,我们将另行专文展开。

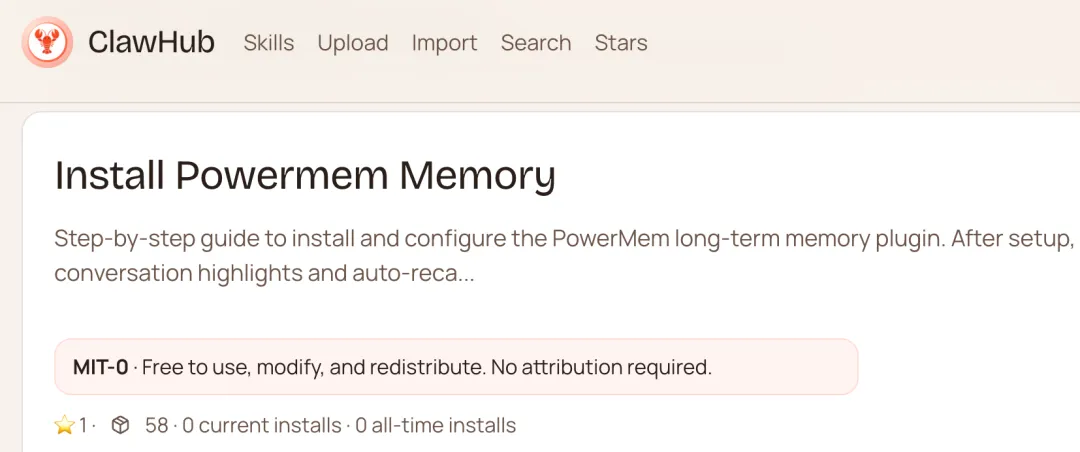

OpenClaw 记忆插件已上线 ClawHub

我们为 OpenClaw **[5]** 打造的 PowerMem 长期记忆插件 memory-powermem **[6]** 已发布。安装后 OpenClaw 就能告别"金鱼记忆",自动捕捉对话关键信息,后续会话中智能召回------再也不用每轮背整本笔记了。

图:ClawHub 中一键安装 PowerMem 记忆插件

一键安装 : 通过 ClawHub **[7]** Skill 直接安装,点一下,下载、配置、切换槽位全自动搞定:

clawhub.ai/Teingi/inst... **[8]**

手动安装:喜欢自己折腾?三步搞定:

- 安装并启动 PowerMem 服务:

plain

pip install powermem

# 在配置好 .env 的目录下启动

powermem-server --host 0.0.0.0 --port 8000- 安装插件到 OpenClaw:

plain

openclaw plugins install memory-powermem- 修改 OpenClaw 配置(

~/.openclaw/openclaw.json),将 memory 槽位切换到本插件:

plain

{

"plugins": {

"slots": { "memory": "memory-powermem" },

"entries": {

"memory-powermem": {

"enabled": true,

"config": {

"baseUrl": "http://localhost:8000",

"autoCapture": true,

"autoRecall": true,

"inferOnAdd": true

}

}

}

}

}重启 OpenClaw gateway 后执行 openclaw ltm health 确认连通即可。

插件的原理解析与完整配置指南,我们稍后将通过另一篇公众号文章为大家介绍。

PowerMem v1.0.0 新内容一览

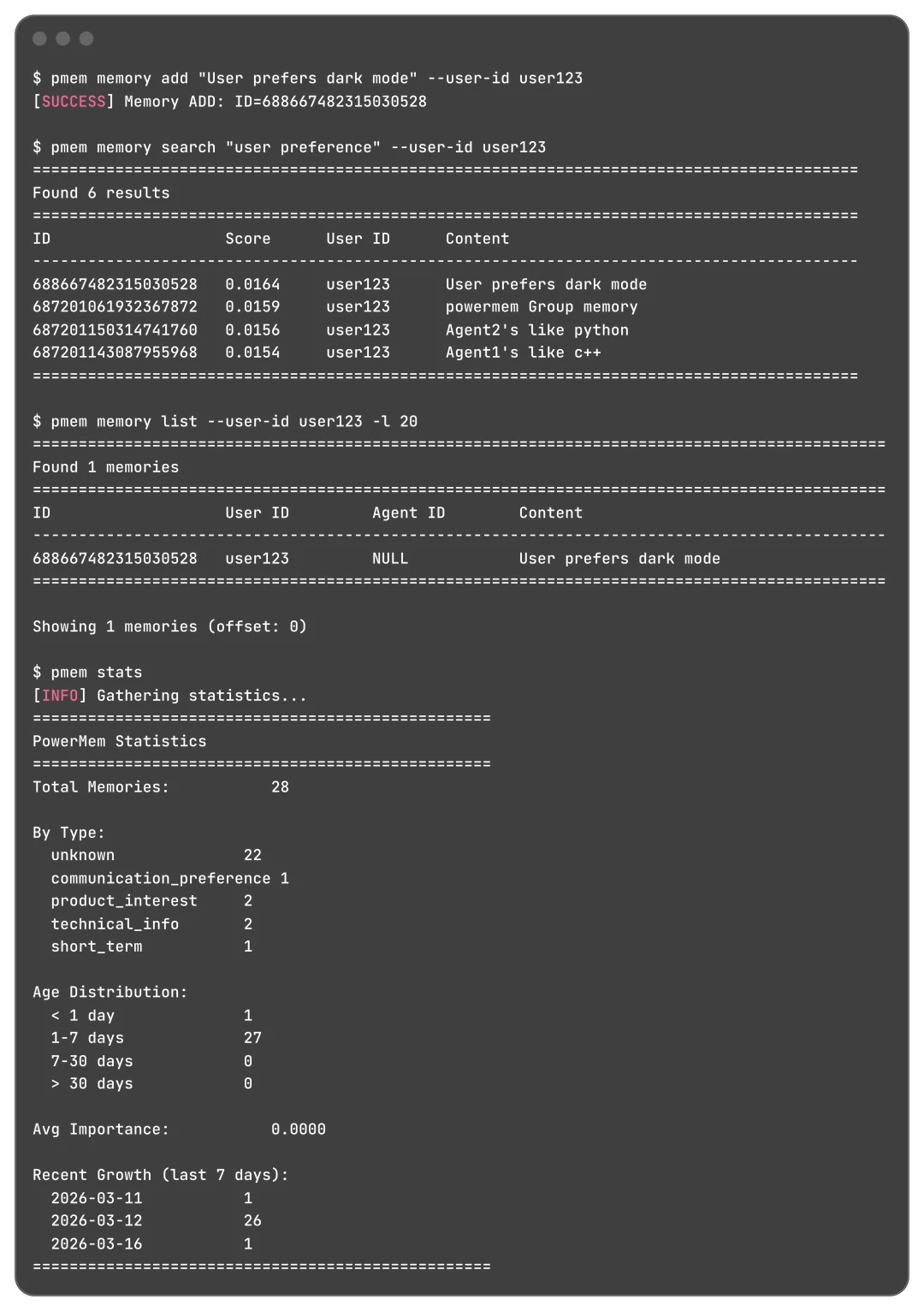

操作面:CLI( **pmem**)

CLI 与 SDK、HTTP API 共用同一套配置(.env)和存储,是 Agent 与脚本的编排入口------想加记忆、查记忆、管记忆,敲命令就行。

plain

pip install powermem # 或 uv add powermem

# 记忆操作

pmem memory add "用户偏好深色模式" --user-id user123

pmem memory search "用户偏好" --user-id user123

pmem memory list --user-id user123 -l 20

# 配置管理(交互式向导,无需手抄 .env)

pmem config init

# 统计与运维

pmem stats --json

pmem manage backup -o backup.json

pmem manage cleanup --dry-run

# 交互式 Shell

pmem shell完整命令覆盖 memory(增删改查)、config(查看/校验/测试/初始化)、stats(统计)、manage(备份/恢复/清理/迁移)、shell(交互式命令行 REPL),支持 bash/zsh/fish 补全。详见 CLI 使用指南 **[9]**。

图: _pmem__ CLI 命令演示_

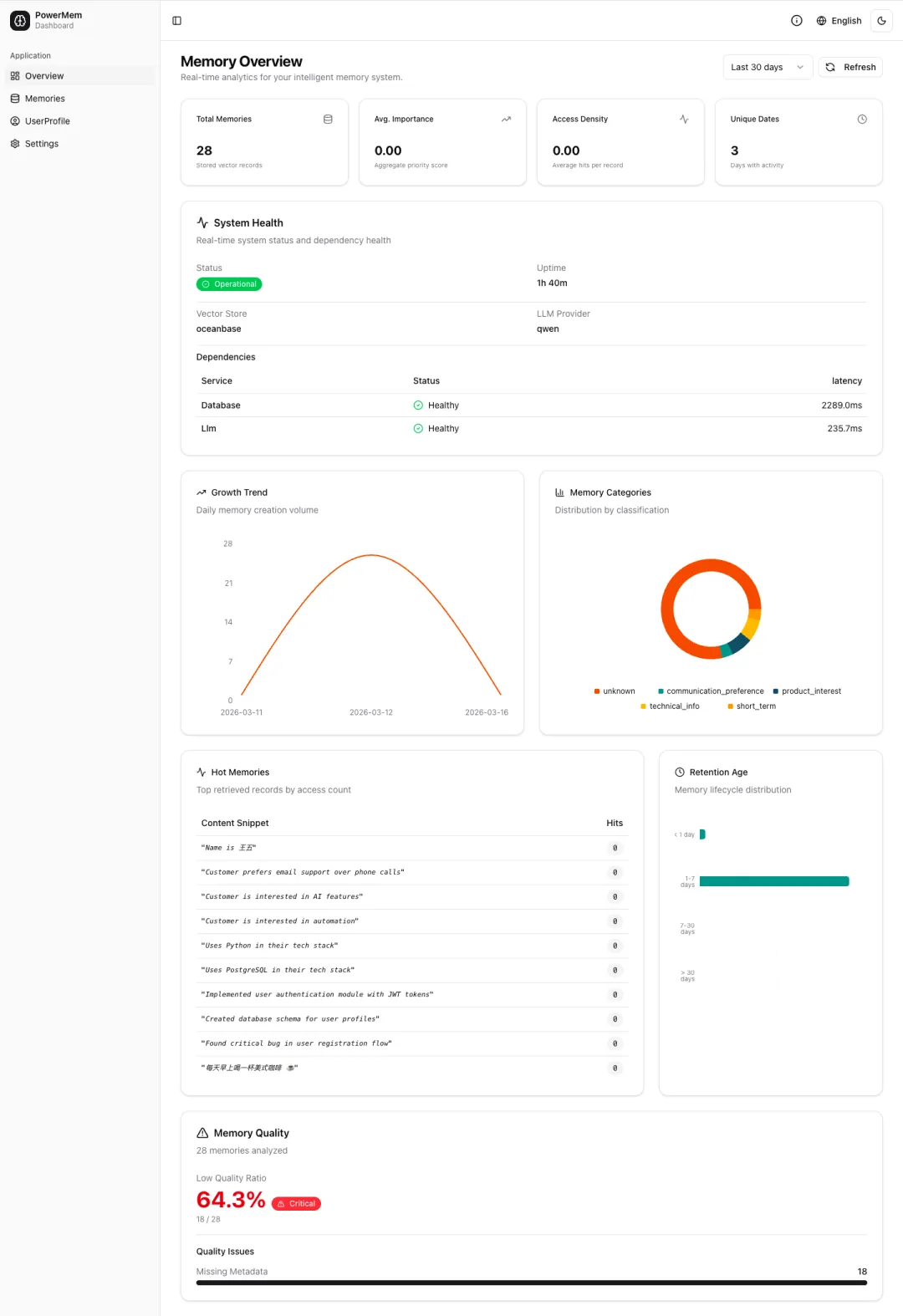

认知面:Dashboard

基于同一套 HTTP API 的 Web 可视化界面,记忆多少、谁在用、分布如何、系统健康与否,一眼看清。v1.0.0 做了多项修复与体验优化。

plain

powermem-server --host 0.0.0.0 --port 8000

# 浏览器访问 http://localhost:8000/dashboard/

图:Dashboard 记忆统计与健康监控界面

多种接入方式

PowerMem v1.0.0 提供五种接入方式,共用同一套配置与存储。

- Python SDK[10](三行起步,告别"金鱼记忆"):

plain

from powermem import Memory, auto_config

config = auto_config()

memory = Memory(config=config)

memory.add("用户喜欢喝咖啡", user_id="user123")

results = memory.search("用户偏好", user_id="user123")- CLI:终端直接操作,脚本化和 Agent 编排首选

- HTTP API[11]:RESTful + Swagger 文档 + API Key 鉴权,面向任意语言

- MCP Server[12]:支持 Model Context Protocol[13](MCP,模型与外部工具通信的开放协议),Claude Desktop 等 MCP 客户端可直接读写记忆

- Dashboard:Web 可视化,记忆统计与分析

立即体验

三行命令,让 OpenClaw 从"健忘"变"记事儿":

plain

pip install -U powermem

# 或

uv add powermem

pmem --version- GitHub :github.com/oceanbase/powermem[14]

- PyPI :pypi.org/project/powermem[15]

- Discord :加入社区[16]

- Issues / Discussions :反馈与交流[17]

图:PowerMem 核心亮点一览

参考资料

1 PowerMem: github.com/oceanbase/p...

2 Apache 2.0: github.com/oceanbase/p...

3 LOCOMO: arxiv.org/abs/2306.07...

4、5 OpenClaw: openclaw.ai/

6 memory-powermem: github.com/ob-labs/mem...

7 ClawHub: clawhub.ai

8 clawhub.ai/Teingi/inst...: clawhub.ai/Teingi/inst...

9 CLI 使用指南: github.com/oceanbase/p...

10 Python SDK: github.com/oceanbase/p...

11 HTTP API: github.com/oceanbase/p...

12 MCP Server: github.com/oceanbase/p...

13 Model Context Protocol: modelcontextprotocol.io/

14 github.com/oceanbase/powermem: github.com/oceanbase/p...

15 pypi.org/project/powermem: pypi.org/project/pow...

16 加入社区: discord.com/invite/74cF...

17 反馈与交流: github.com/oceanbase/p...