每一秒视频里,都藏着可被检索、被推荐、被审核的价值。 问题是------你如何在几小时内,把几十万条视频变成结构化的语义向量?

一、当"视频爆炸"遇上"理解瓶颈"

短视频、监控、影视素材、UGC 内容......视频数据正以每年数倍的速度堆积在企业的对象存储里。

但绝大多数团队都在同一个坑里打转:

-

抽帧慢:一台机器跑 FFmpeg 抽帧,几十万条视频要算到天荒地老;

-

打标贵:自建多模态推理服务,GPU 成本居高不下;

-

向量散:中间文件散落在各处,和数仓割裂,无法复用;

-

容错差:一条坏数据让整个任务重跑且无血缘维护,心态崩了还得从头再来。

有没有一种方式,让开发者像写本地 Python 代码一样,顺手就能分布式跑完"视频→抽帧→标签→向量"的全链路?

二、一套方案,三步打通

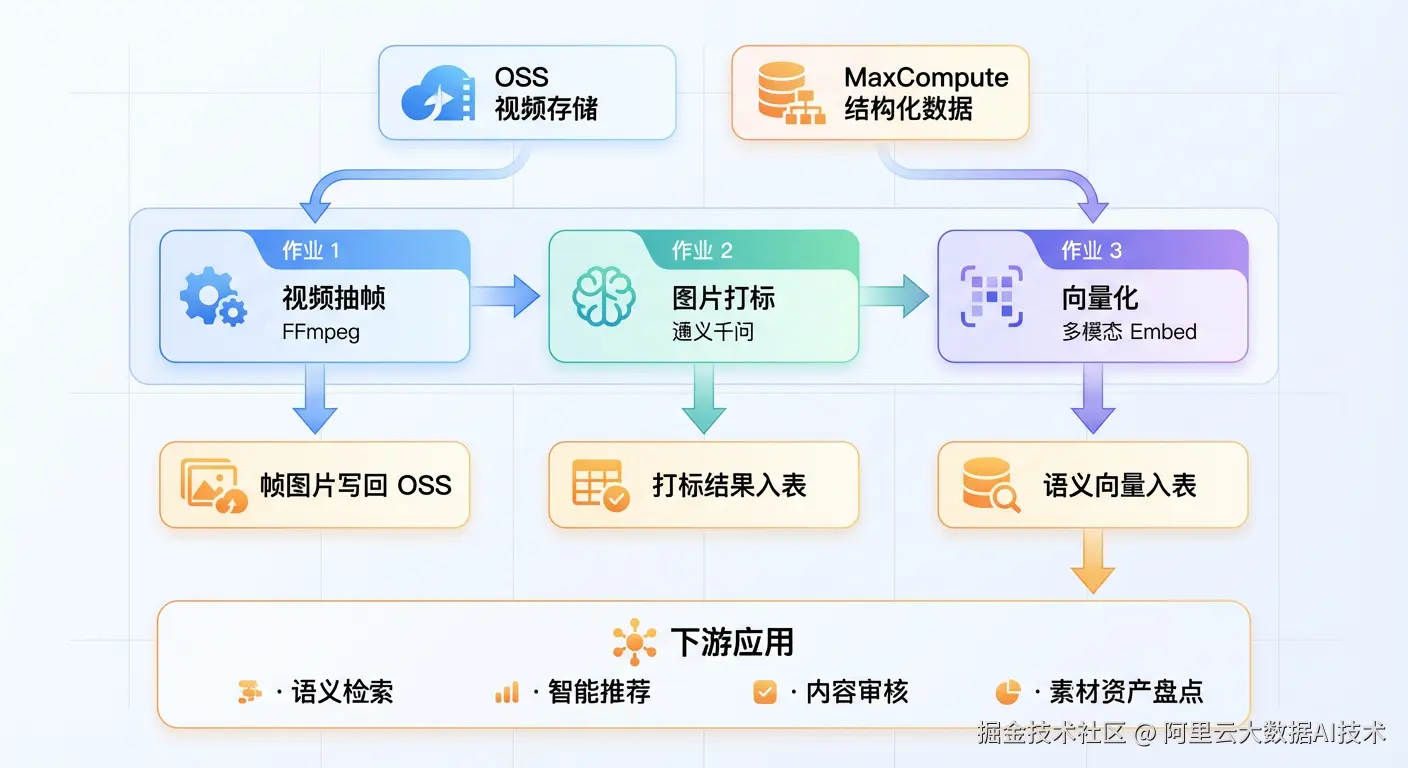

基于阿里云自研分布式 AI 计算引擎 MaxFrame ,我们构建了一条端到端的视频内容理解流水线------从海量视频自动抽帧,到多模态大模型生成语义标签,再到向量化落库,产出可直接用于语义检索、智能推荐、内容审核的结构化向量数据 。

三个作业首尾相接,数据在 OSS + MaxCompute 之间透明流转,开发者只需关注业务逻辑,底层并发、调度、容错由 MaxFrame 全部接管。

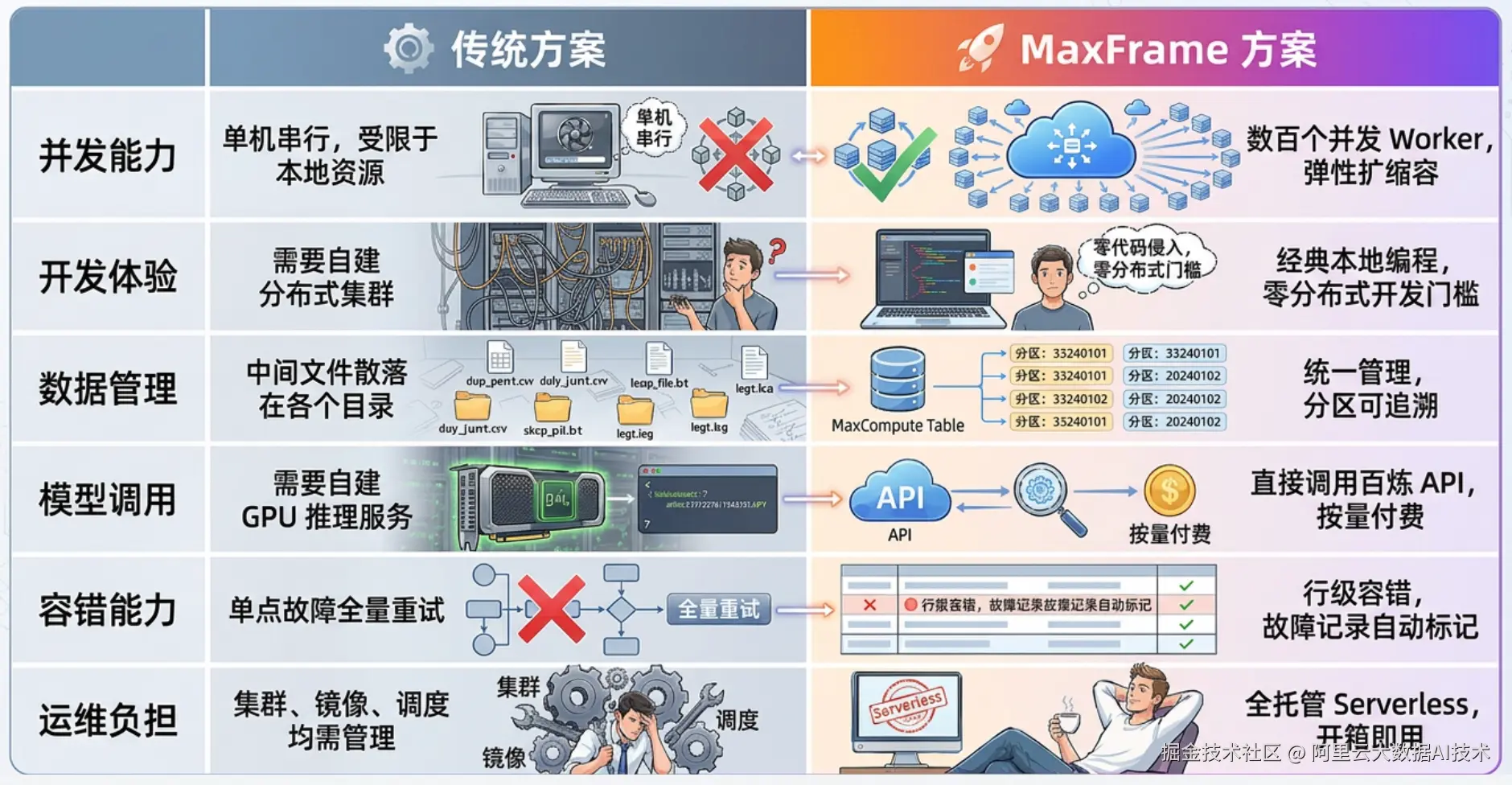

三、传统方案 vs MaxFrame:一张表看懂差距

四、三步全链路,逐一拆解

🎬 作业 1:分布式视频抽帧

将 OSS 上的视频按指定帧率(默认 2fps)批量抽帧,产出的图片自动写回 OSS。

-

引擎:MaxFrame DPE 引擎 + 自定义 FFmpeg 镜像

-

输入:OSS 视频文件目录

-

输出:MaxCompute 图片路径表 + OSS 帧图片

-

亮点:集群多并发 worker 同时处理,单视频超时自动跳过

🏷️ 作业 2:多模态大模型打标

对每张抽帧图片调用百炼多模态大模型(Qwen3.6-Plus),自动生成涵盖场景、人物、构图、情绪等多维度的文字描述。

-

引擎:MaxFrame DPE 引擎 + 百炼大模型

-

模型:通义千问多模态(Qwen3.6-Plus)

-

输出:结构化打标结果表(含成功/失败状态)

-

亮点:多并发调用,行级容错,失败不影响全局

🔢 作业 3:多模态向量化

对打标成功的记录,分别对文字标签 和原始图片 生成 Embedding 向量(Qwen-VL-Embedding),支持 文搜图 / 图搜图 双路检索。

-

引擎:MaxFrame DPE 引擎 + 百炼多模态 Embedding 模型

-

模型:qwen-vl-embedding(1024 维)

-

输出:文本向量 + 图片向量,紧凑 JSON 存储

-

亮点:多并发调用,向量维度自动校验

五、四大技术亮点,让工程师"爱上分布式"

💡 亮点一:零门槛分布式

和写单机 Python 作业几乎没区别。 一行 DataFrame 操作,背后就是数万个 worker 在并发跑。开发者告别 Spark / Ray 的集群运维复杂度,把分布式能力装进了单机式的思维习惯里。

💡 亮点二:OSS 透明挂载

通过一个装饰器,OSS 就像本地磁盘一样被挂载进 UDF。读写图片、视频、模型文件全部走本地路径,代码可读性和本地调试体验大幅提升。

💡 亮点三:行级容错 & 全程可观测

每条记录独立处理,一条失败不拖累整批 。结果表自带 status / error_stage / error_msg 字段,精确定位是读取失败、打标超时还是 API 限流------运维从"猜"变成了"看"。

💡 亮点四:弹性伸缩像拧水龙头

并发度就是一个参数,从 10 到 1000 改一个数字即可,业务代码一行不用动。想快点?加并发!

六、典型落地场景

-

🎥 视频内容理解:自动生成帧级语义描述,赋能智能推荐与个性化分发

-

🔍 多模态语义检索:文本向量 + 图片向量双路并进,实现"以文搜图、以图搜图"

-

🛡️ 内容安全审核:海量 UGC 视频的帧级内容分析,识别违规与风险

-

🎬 影视素材管理:自动化标注素材库,大幅提升检索与复用效率

-

📦 数字资产盘点:批量处理沉淀视频资产,建立结构化索引与二次变现

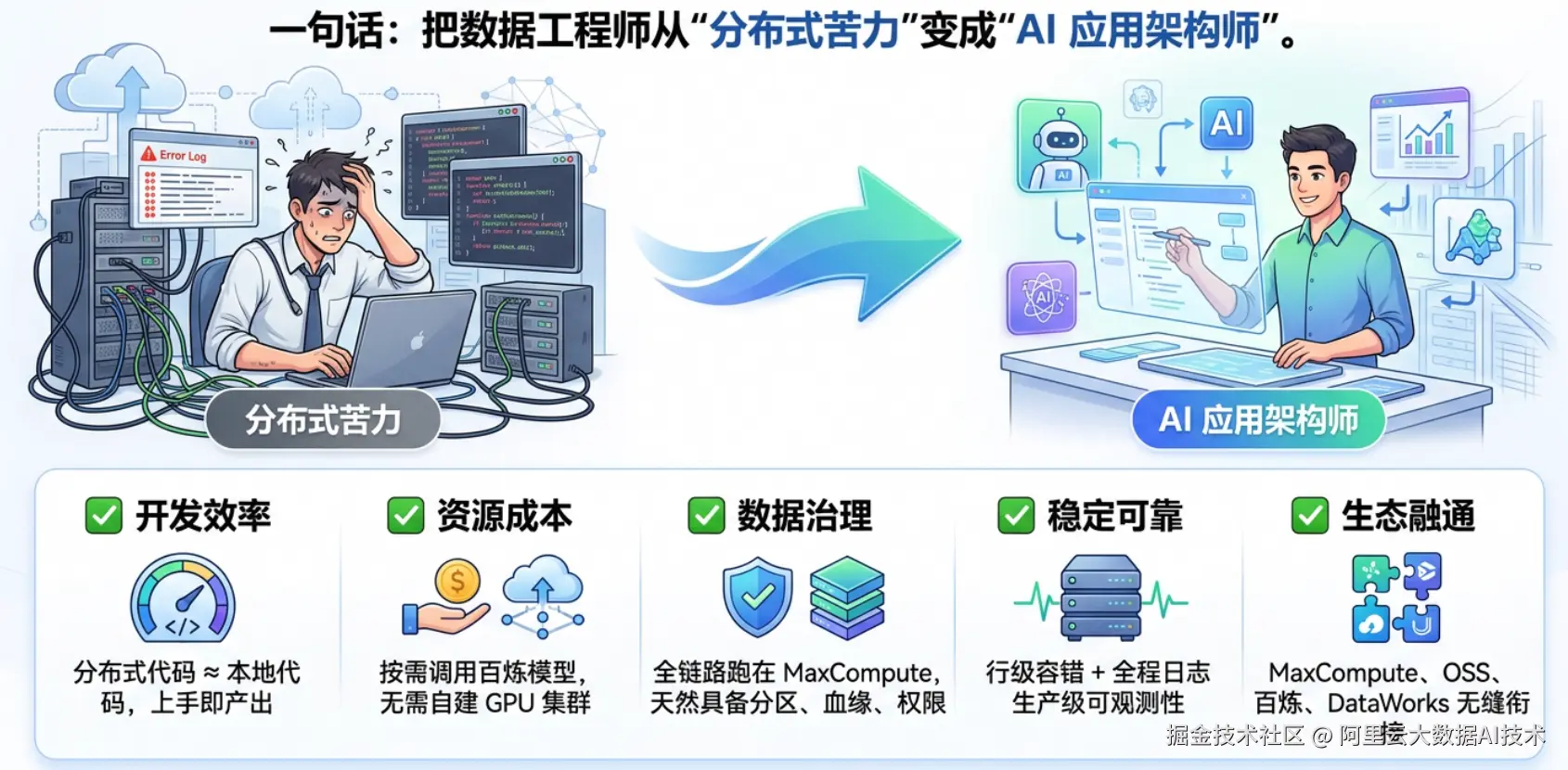

七、为什么选择 MaxFrame?

一句话:把数据工程师从"分布式苦力"变成"AI 应用架构师"。

写在最后

视频是这个时代信息密度最高的载体,也是最难被结构化理解的内容形态。

MaxFrame 做的事情很简单:让每一位开发者,都能以最低的学习成本和最优的算力效率,把视频变成可被 AI 理解和检索的"语义向量"。

未来,算力是底座,算法是工具,数据是燃料,而 MaxFrame,是把这一切粘合在一起的那双手。

🚀 现在就试试,让你的视频数据开口说话。 欢迎使用阿里云 MaxCompute MaxFrame(可加入MaxFFrame官方钉钉群:37130012987),开启你的分布式 AI 开发之旅。