大家好,我是Java1234_小锋老师。

一篇面向非论文读者的「AI Agent」概念小科普:它和你平时用的聊天机器人有什么不一样,为什么最近人人都在提,以及不用背公式也能理解的那条核心逻辑。

一、先撇开术语:我们到底在聊什么

如果你最近刷技术社区、产品发布会或招聘 JD,多半见过 Agent 这个词。中文里有人译成「智能体」,也有人直接说「代理」------听起来像科幻片里的角色,其实讨论的大都是同一件事:让大语言模型(LLM)不只是「接一句回一句」,而是能在多步操作里自己拿主意、调工具、改计划,最终完成一个目标。

所以,当你听到「我们做了一个 Agent」时,别先往「人格」或「意识」上脑补。在工程语境里,它更接近:一个围绕大模型搭建的、带循环与工具的小系统。

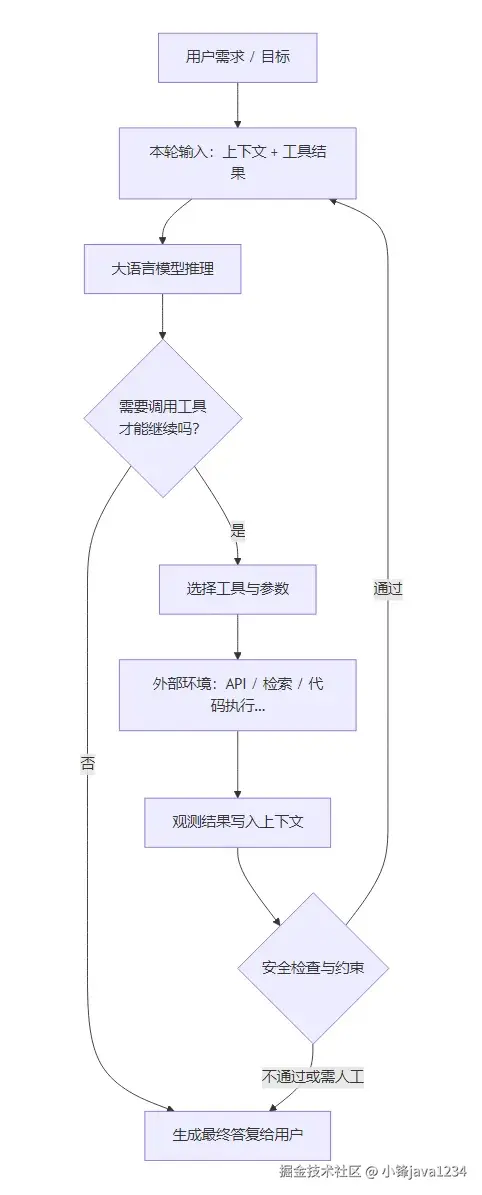

下面这张图用「感知---规划---行动」的循环,概括了多数 Agent 架构里反复出现的主线(细节各家实现不同,但思路相近):

二、一句话版定义,够用了

若只记一句,可以这么理解:

Agent = 大语言模型 + 明确的目标 + 可调用的工具(或环境)+ 多步推理与尝试的循环。

它不像传统脚本那样每一步都写死在代码里,而是根据当前结果决定下一步 ------包括要不要查资料、要不要改方案、要不要向用户再确认。这正是大家说的「自主性」在日常产品里的含义(注意:是任务层面的自主,不是哲学上的自由意志。)

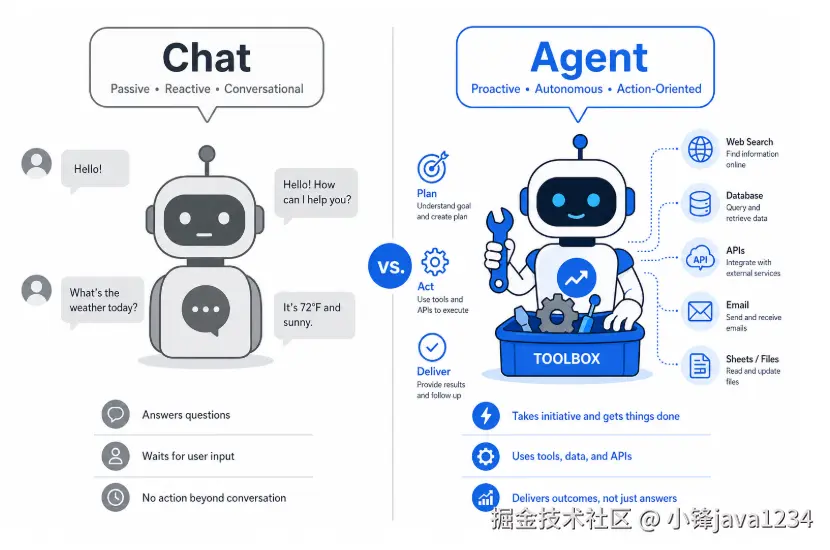

三、和「只会聊天」的模型差在哪

普通对话模式:用户问 → 模型答 → 结束。 单次生成里可能没有「真的会去执行」某件事。

Agent 模式往往多了几件事:

- 目标分解:把「帮我订一张下周去上海的票」拆成查日程、查航班、比价、下单等子步骤。

- 对外动作 :调用搜索、日历 API、订票接口、公司内部知识库检索等------也就是 Tool use / 函数调用。

- 试错与迭代:一条路不通就换一个工具或重写计划,而不是只说一句「我无法完成」。

下面这张对比图,大致对应「只会聊」和「能办事」两种形态的差异(示意用,具体产品会有更多变体):

四、Agent 一般长什么样:感知、规划、行动

拆开来看,行业里常见的表述会落到三块(名字可能叫法不同):

| 模块 | 人话解释 |

|---|---|

| 感知(Perceive) | 模型读到:用户说了什么、上一步工具返回了什么、记忆里之前存过什么。 |

| 规划(Plan) | 下一步该干什么:先搜还是先写代码,要不要追问用户澄清需求。 |

| 行动(Act) | 真的去调接口、跑命令、写文件、发请求------并把结果喂回下一轮感知。 |

再补两点实践中几乎绕不开的:

- 记忆:短期上下文 + 可选的长期存储(向量库、数据库、笔记),不然一长串任务里它会「忘掉」约束。

- 工具与环境 :浏览器、数据库、插件、操作系统......Agent 通过工具触碰外部世界,否则只能空谈。

五、用一张流程图串起来

流程图用 Mermaid 画,方便你在支持 Mermaid 的编辑器(如 VS Code、语雀、GitHub、多数文档站)里直接渲染:

这张图刻意保留了 「循环」 :只要任务没完成且仍允许调用工具,就会再回到模型推理。现实系统还会加:最大步数、预算、权限、人机确认,避免无限循环或不安全操作------那是工程上的护栏,不改变「Agent」这条主线的概念形状。

六、常见误区:Agent 不是万能的

聊概念时顺手拆几个误解,读起来会更踏实:

并不是「叫 Agent 就一定更聪明」。 底层还是模型;若规划混乱或工具设计糟糕,可能反而更费 token、更慢、更不可控。

并不是「一定要有很炫的界面」。 很多 Agent 跑在服务端、CLI 或自动化流水线里,用户根本看不到「一个卡通形象」。

并不是「可以完全无人值守」。 涉及钱、权限、隐私、不可逆操作时,成熟产品几乎都会加审批或沙箱------这与「Agent」概念不矛盾,而是工程负责。

七、小结:你可以这样理解它

- Agent 在当下的技术讨论里,主要指:以大语言模型为「大脑」、以目标为导向、能多次使用工具并自我调整步骤的一类系统。

- 它与普通聊天的核心差别,往往不在「会不会说人话」,而在 有没有闭环:想---做---看结果---再决定。

- 看到产品宣传时,可以追问三个实用问题:目标范围是什么、能调哪些工具、失败时怎么收敛------比纠结「算不算真 Agent」更有帮助。

如果你之后想往深里走,再分别啃 ReAct、规划与工具调用、多 Agent 协作、评估与安全 这些专题也不迟;先把「循环 + 工具 + 目标」这条主心骨立住,后面都不难挂钩。

锋哥简介:14年Java,Python,AI大模型技术专家,高级讲师,南通小锋网络科技光杆司令员。小破站:www.java1234.com