很多时候,我们看到的 AI Agent 仅仅停留在"回答问题"层面,但真正的复杂问题往往隐藏得更深。

当 AI Agent 开始真正连接模型接口、外部工具、文件、凭证和业务流程,团队面临的问题变成了:

系统不是不够强,而是太难看清、太难限制、也太难统一治理。

最近我关注了一个开源项目 ClawVault ,它从安全治理的角度提供了一个新颖且值得深入探讨的视角:

这不是增加一个简单的工作流层,而是一个定位为 OpenClaw Security Vault 的安全控制层。

它聚焦于将 AI 应用中的调用流程、原子能力边界和策略控制集中统一,做出细粒度且一致的治理。

1. 解决的是整条运行链路的问题,而非单点防御

ClawVault 的核心能力包括:

- 可视化监控 AI agents 与模型调用

- 原子粒度控制 限制 agent 权限和能力

- 生成式策略 通过自然语言定义安全策略

同时支持:

-

敏感数据检测

-

Prompt Injection 防护

-

危险命令自动拦截

-

自动脱敏处理

-

token 预算与成本控制

-

实时 Dashboard 统一管理

它不仅仅是"日志",而是将监控、检测、处理、审计和成本限制融合为一体。

2. 为什么称它为"控制层",而非单纯"插件"?

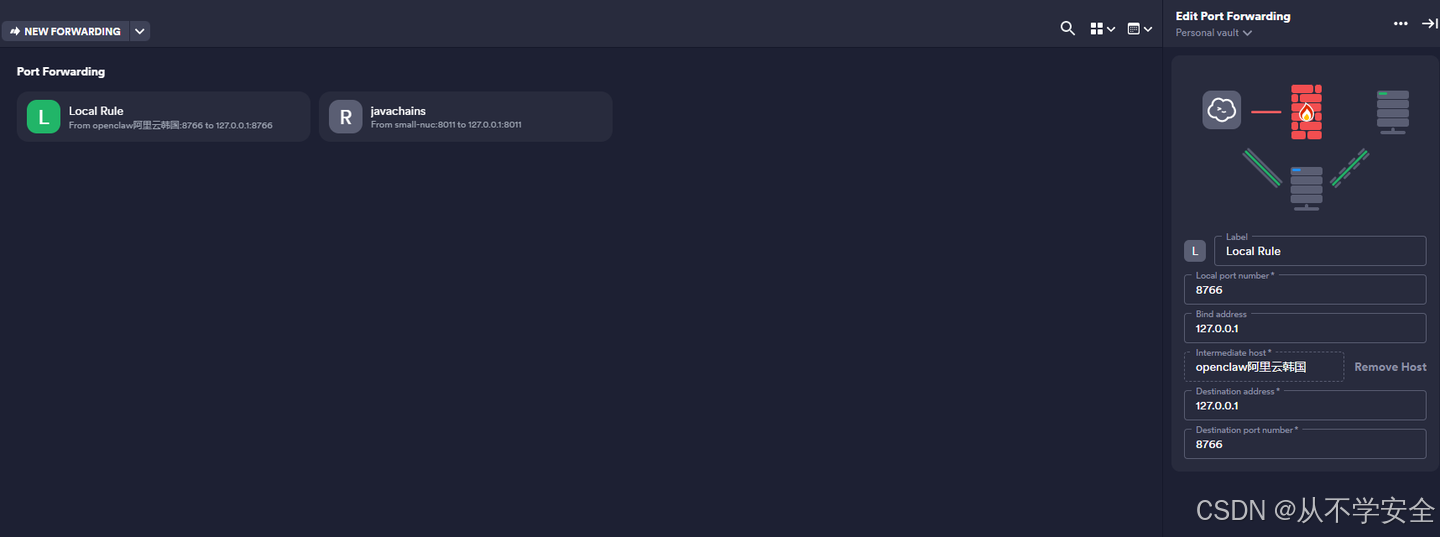

项目架构提供了清晰的运行路径:

-

Transparent Proxy Gateway 拦截 AI 工具和外部 API 流量

-

Detection Engine 识别敏感数据、注入攻击、风险命令

-

Guard / Sanitizer 按策略放行、拦截或脱敏

-

Audit + Monitor 记录审计和 token 使用

-

Dashboard 统一查看配置与安全态势

从工程实现角度,是将分散的安全逻辑集中到了运行时拦截和管控层,提升治理的集中性和可控性。

3. 不是概念而是已能立刻落地

README 给出了清晰使用入口:

bash pip install -e . clawvault start clawvault scan "password=MySecret key=sk-proj-abc123" clawvault demo配置示例一目了然:

proxy:

port: 8765

intercept_hosts: ["api.openai.com", "api.anthropic.com"]

guard:

mode: "interactive"

monitor:

daily_token_budget: 50000这说明,讨论远不只是"应该治理 AI",而是具体到代理端口、拦截目标、保护模式和成本预算的实施细节。

- 为什么这个方向必须重视? AI 安全,已经超越了简单的规则限制。真正的问题是:

不清楚 Agent 具体调用了什么 不确定是否接触敏感信息 注入风险、脱敏处理没法统一管理 成本控制难以精准落实 ClawVault 试图构建一个持续运行的安全和治理控制机制,这才是 AI Agent 场景下真正的"护城河"。

- 项目当前的成熟度阶段 目前核心功能状态:

API Gateway 监控和拦截:已实现

文件侧监控:进行中

Agent 级原子控制:进行中

生成式策略编排:进行中

这意味着它不是空谈,而是基于可用核心能力,逐步完善演进中的项目。

- 适合哪些团队参考?

需要统一监控 AI Agent 与模型调用行为 希望通过代理层实现流量拦截、敏感监测与自动脱敏 想将危险命令、Prompt Injection 与敏感数据治理统一纳入一条链路 需要控制 token 使用预算,精细化成本管理

项目地址:https://github.com/tophant-ai/ClawVault

如果你正在推进 AI Agent 的落地,关键不在于"模型够不够强",

而是你能否搭建起最难的那道防线------监控、风险检测、权限控制以及成本管控的边界。

ClawVault,正是值得你深入探索的解决方案。