小罗碎碎念

一百多年前,显微镜的发明,让人类第一次看到了细胞层面的病变,开启了现代病理学的时代;而今天,计算病理智能体的出现,让AI第一次拥有了像人类病理医生一样的思考、探索、学习能力,正在开启数字病理的全新时代。

本文核心内容基于综述论文《The Landscape of Computational Pathology Agents From Static Analysis to Autonomous Diagnostic Workflows》,核心作者为Jingyun Chen、Fengchun Liu、Songhan Jiang、Linghan Cai,来自哈尔滨工业大学(深圳)与德累斯顿工业大学,论文预印本于2026年1月发布于TechRxiv平台。

从早期的监督学习模型,到近年大火的病理基础模型,AI已经解决了病理标注成本极高的行业痛点,能完成固定场景下的图像分类任务。

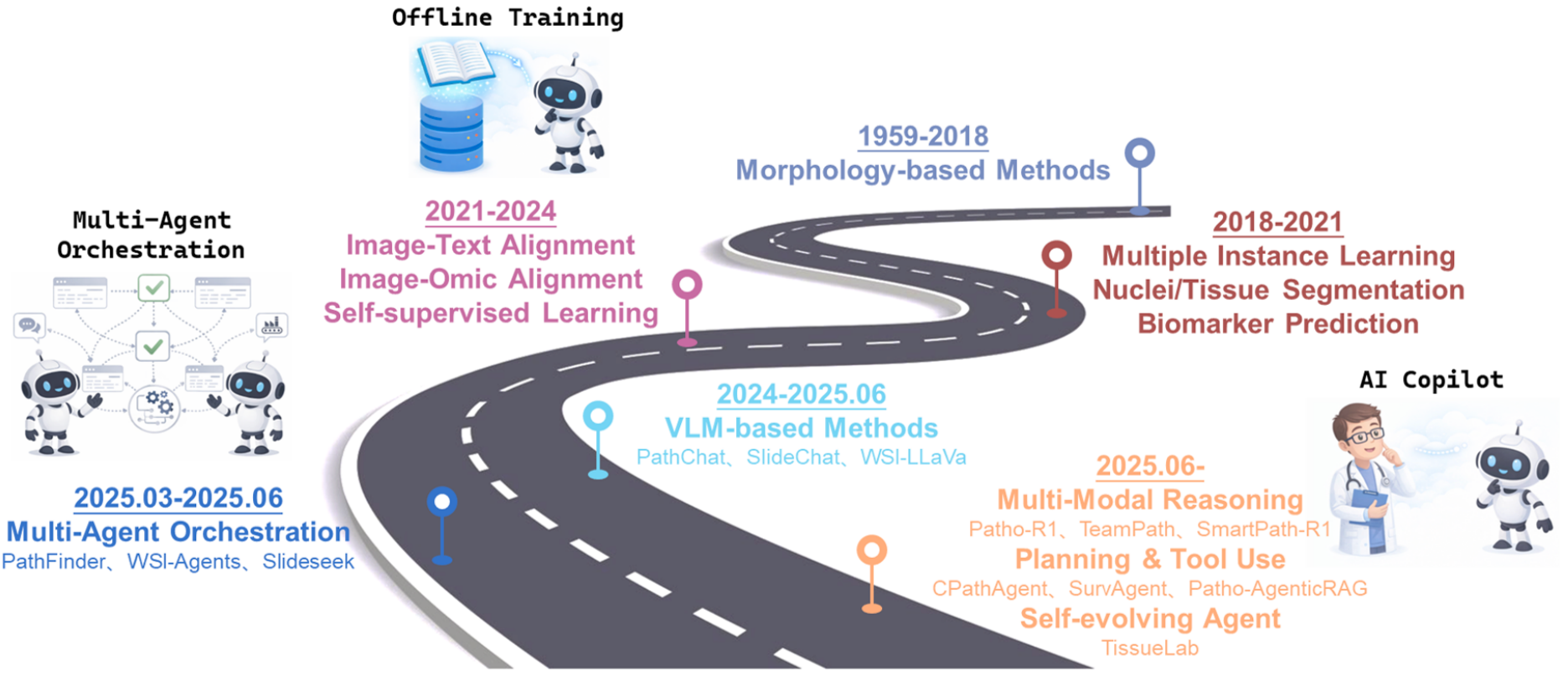

早期阶段(1959--2018):基于形态学的传统方法

这是计算病理学的起步阶段,核心思路是从病理图像的形态特征出发,用人工设计或传统机器学习提取特征,完成基础的病理分析。

- 核心技术:依赖病理学家定义的形态学特征(如细胞大小、核质比、腺体结构等),结合传统机器学习模型(如SVM、随机森林)做分类或分割。

- 局限:高度依赖人工特征工程,泛化能力弱,只能处理简单、标准化的病理场景,无法挖掘深层的生物学信息。

中期阶段(2018--2021):多实例学习与组织分割

随着深度学习的普及,计算病理学进入深度学习驱动的精准分析阶段,核心是解决WSI(全切片图像)的超高分辨率问题,并向临床可解释性迈进。

- Multiple Instance Learning(多实例学习,MIL):把超大WSI切分为小Patch(图像块),用"袋-实例"结构建模,解决全切片级别的分类/预测问题(如肿瘤分级、预后风险)。

- Nuclei/Tissue Segmentation(细胞核/组织分割):用CNN、U-Net等模型精准定位细胞、腺体、肿瘤区域,为后续分析提供基础结构信息。

- Biomarker Prediction(生物标志物预测):从病理图像中预测分子标志物(如ER/PR/HER2状态、基因突变),实现"形态学→基因组"的跨模态关联。

让病理AI从"看形态"升级为"读信息",开始具备临床辅助决策的潜力,但仍局限于单任务、单模态的静态学习。

进阶阶段(2021--2024):跨模态对齐与自监督学习

这一阶段的核心是打破模态壁垒,用自监督学习挖掘病理数据的通用表征,为后续大模型应用打基础。

- Image-Text Alignment(图文对齐):把病理图像和病理报告/医学文献做跨模态对齐,让模型理解"图像形态"和"文本描述"的对应关系。

- Image-Omic Alignment(图像-组学对齐):进一步关联病理图像与基因组、转录组等组学数据,挖掘形态背后的分子机制。

- Self-supervised Learning(自监督学习):用海量无标注病理图像做预训练,学习通用的病理特征表征,降低对标注数据的依赖,提升模型泛化能力。

为病理大模型奠定了基础,让AI能从"单一任务"走向"通用理解",为后续VLM和多智能体系统铺路。

近期阶段(2024--2025.06):基于视觉语言大模型(VLM)的方法

随着多模态大模型的爆发,计算病理学进入"看图说话"的自然交互阶段,核心是用VLM直接处理病理图像+文本,实现更贴近临床场景的交互。

- 代表模型:PathoChat、SlideChat、WSI-LLaVa等,都是基于LLaVA、Gemini等通用VLM改造的病理专用模型。

- 核心能力:

- 直接输入WSI/Patch+自然语言提问,输出病理描述、诊断建议、文献引用等。

- 支持"图像-文本"的双向交互,比如"请描述这张切片里的肿瘤形态""这张切片对应的分子亚型可能是什么"。

- 局限:仍以"单轮交互+静态推理"为主,缺乏复杂的任务规划、工具调用和自我校验能力,临床可信度仍需提升。

当前与未来阶段(2025.06--至今):多模态推理与多智能体协作

这是计算病理学的下一代范式,核心是从"被动应答"升级为"主动协作、终身学习",向真正的AI Copilot(病理助手) 迈进。

- Multi-Modal Reasoning(多模态推理):代表模型如Patho-R1、TeamPath、SmartPath-R1,能整合图像、文本、组学、临床数据,做复杂的逻辑推理(如"结合这张切片和患者病史,判断预后风险并给出治疗建议")。

- Planning & Tool Use(规划与工具调用):代表模型如CPathAgent、SurvAgent、Patho-AgenticRAG,能拆解复杂任务、调用外部工具(如数据库、分割模型、检索系统),完成端到端的临床任务。

- Self-evolving Agent(自进化智能体):代表项目如TissueLab,能从临床反馈、新数据中持续学习,自动更新模型知识,实现终身学习。

医学AI交流群

目前小罗全平台关注量120,000+,交流群总成员3000+,大部分来自国内外顶尖院校/医院,期待您的加入!!

由于近期入群推销人员较多,已开启入群验证,扫码添加我的联系方式,备注姓名-单位-科室/专业,即可邀您入群。

科研服务

我们是一支由国内外顶尖高校硕博组成的科研团队,能够提供一系列医工交叉前沿的科研服务。

有兴趣的老师欢迎扫码与我们取得联系!

一、解码计算病理智能体的"类人诊断大脑"

计算病理智能体的核心创新,是把病理诊断从一个静态的图像分析任务,变成了一个交互式、多步骤的问题解决过程。

自由缩放的"数字病理眼"

病理诊断的核心,是"看"的能力------但传统AI的"眼睛",始终被固定在单一分辨率下,要么丢了全局组织架构,要么丢了微观细胞细节,更无法整合多种来源的诊断信息。而智能体的感知系统,完全复刻了人类医生的诊断视觉逻辑,实现了三个维度的突破。

首先是多尺度金字塔视觉。

人类医生的诊断天生就是分层的:先低倍镜扫完整张切片,看清组织整体架构,锁定可疑病变区;再切换高倍镜,放大观察细胞异型性、核分裂象等恶性特征。

文献中提到的HIPT模型,就用分层视觉Transformer架构实现了这种能力:它能依次编码不同分辨率的视觉特征,把高倍镜下的细胞细节,嵌入到低倍镜的全局组织上下文里,让AI既能看到"整片森林",也能看清"每一棵树",真正理解病理结构的生物学层级,而不是把切片当成一堆孤立的像素。

其次是全切片全局理解。

一张十亿像素的WSI,对传统AI来说是无法突破的上下文窗口瓶颈,大多数模型只能把切片拆成小碎片处理,最终丢失了肿瘤浸润范围、免疫细胞分布等全局关键信息。

而智能体通过全新的架构设计解决了这个问题:

- Prov-GigaPath用LongNet的扩张注意力机制,能把整张切片当成一个完整的"叙事文本"处理;

- TITAN模型则通过分层上下文整合,能回答跨越整张切片的空间关系问题,让AI真正拥有了全局视野,而不是"盲人摸象"。

最后是多模态信息融合。

在现代临床中,一张HE染色切片从来不是诊断的唯一依据,医生需要结合免疫组化、基因数据、患者病史才能给出准确结论。

传统AI大多只能处理单一的图像数据,而智能体的感知系统,能把不同模态的信息整合到同一个语义空间里。

比如文献中的KEEP模型,能把病理图像特征和生物医学知识图谱、文本描述对齐;TeamPath框架则让专门的智能体分别处理HE切片、转录组学数据,最终整合形成完整的患者画像,就像一个肿瘤多学科会诊团队,把所有维度的信息融合在一起,做出最全面的判断。

复刻病理医生的"诊断思维逻辑"

如果说感知是智能体的眼睛,那认知就是它的大脑,也是它和传统静态模型最本质的区别------传统AI只会"给结果",而智能体学会了"像医生一样思考"。

这种思考能力的核心,是思维链(Chain-of-Thought, CoT)推理。病理诊断从来不是非黑即白的选择题,而是一个"提出假设-验证证据-鉴别诊断"的演绎过程。一个合格的病理医生,绝不会只给一个"良性/恶性"的结论,一定会附上完整的诊断思路。

而传统AI就是典型的"黑箱",哪怕结果是对的,也可能是"蒙对的",医生无法验证它的逻辑。智能体则通过思维链,把这个黑箱完全打开:面对一个边界模糊的病变,它会先生成内部思考:"核异型性提示恶性,但病变边界清晰更符合良性肿瘤特征,需要进一步寻找核分裂象确认",再根据这个思路去收集证据,最终给出结论。

文献中提到的Patho-R1模型,更是用分组相对策略优化(GRPO)的强化学习方法,让AI主动优化自己的推理逻辑,不仅让决策更可靠,也让医生能清晰地验证每一步推理,彻底解决了黑箱问题。

为了避免AI"凭空思考",智能体还拥有知识增强能力,确保所有推理都建立在权威医学事实之上。

就像医生遇到罕见病例会翻WHO肿瘤分类指南、查最新文献,智能体也不会只靠自己的内部知识下判断。

Patho-AgenticRAG模型会在遇到不确定性时,主动生成检索指令,从权威医学指南和文献中查找依据;KEEP模型则直接把结构化的生物医学知识图谱注入模型,让AI真正理解医学实体之间的语义关系。

这种"动态检索+静态注入"的双重机制,从根源上减少了AI的幻觉问题,确保它的推理不仅"逻辑通顺",更"医学合规"。

而复杂诊断任务的拆解能力,则让智能体的思考有了清晰的执行路径。

一句"诊断这张切片",对传统AI来说是无法处理的抽象指令,但对智能体来说,它会像人类医生一样,把这个大目标拆成可执行的子任务。

文献中的PathFinder模型,就把诊断流程拆解成了"低倍镜锁定感兴趣区域→导航到目标区域→高倍镜分析形态特征→综合所有发现给出诊断"的完整步骤,把诊断从一个静态图像分析问题,变成了一个有规划、有顺序的决策过程,不仅能高效分配算力,还能确保没有关键区域被遗漏,完全对齐了人类医生的诊断流程。

会操作、会调用工具的"数字手"

一个真正的诊断专家,不仅会看、会想,更会动手操作、会用工具。这也是智能体和传统静态模型最核心的区别:传统AI只能被动接收别人给它的数据,而智能体能主动和环境交互,自己去收集需要的信息。

这种行动能力,首先体现在模拟显微镜操作上。

你可以把传统AI想象成一个被人把所有切片碎片都堆在面前的人,只能被动地看,不能自己选择看哪里;而智能体就像一个能亲手操作显微镜的医生,拥有完整的操作权限:放大、缩小、平移、聚焦,完全复刻人类医生的显微镜操作。

文献中提到的CPathAgent、Pathology-CoT,通过学习资深病理医生的操作轨迹,掌握了最优的切片导航策略:先在低倍镜下沿着组织边缘扫描,锁定可疑区域,再放大到高倍镜下观察细节,而不是随机扫描整张切片。

这种主动视觉模式,极大减少了计算冗余,让AI能把算力集中在真正有诊断价值的区域,完全复刻了人类医生"搜索-确认"的诊断流程。

而外部工具调用能力,更是让智能体从"一个模型"变成了"一个诊断总指挥"。

就像医生不会手动数切片里的上千个细胞,而是用专门的图像分析工具;遇到罕见基因突变,会去查专业医学数据库,智能体也不需要用一个模型包打天下,而是作为核心控制器,调用专门的工具完成子任务。

文献里的UnPuzzle模型,搭建了一个"模型动物园",里面有预训练好的细胞核分割器、组织分类器等专用工具,智能体遇到对应任务,就会生成调用指令,让专用工具完成任务,再把结果整合到自己的推理链里;

而MedResearcher-R1,更是能直接访问医学数据库和搜索引擎,查找罕见突变的相关资料、最新的肿瘤分期指南,把整个互联网变成自己的外部认知延伸,解决那些罕见的、长尾的临床病例。

不会"看了就忘"的"临床经验库"

病理诊断是一个极度依赖记忆的工作,医生既要在看切片时记住已经看过的区域,避免"只见树木不见森林",也要靠常年积累的病例库,给新病例提供参考。

而传统AI最大的问题之一,就是"看了就忘"------处理高倍镜细节时,会丢失低倍镜的全局上下文;处理完一个病例,也不会积累任何经验。

智能体的记忆模块,就完美解决了这个问题。

首先是工作记忆,解决了"迷失在切片里"的难题。

一张WSI能包含超过10万个切片碎片,传统AI处理一个新碎片时,会忘记之前看过的内容,很容易出现前后矛盾的结论。就像你在森林里走路,不记路就会迷路,而智能体的工作记忆,就是它的"导航地图"。

文献中的ALPaCA模型,会动态维护一个切片级的上下文向量,智能体每浏览一个区域,就会把这个区域的特征整合到工作记忆里,让它能把不同区域的信息串联起来,始终保持对整张切片的全局认知,不会因为看了细节就忘了全局,确保诊断结论的一致性和全面性。

而长期记忆,则让智能体从"一次性分析工具",变成了能不断学习的"资深专家"。

人类病理医生的水平会随着接诊病例的增加而提升,靠的就是自己积累的病例库。

智能体也一样,文献中的SurvAgent模型,搭建了一个"病例银行",存储了过往患者的组织学特征、治疗结果、生存数据。

遇到新病例时,它会从长期记忆里检索视觉和临床特征相似的历史病例,参考过往的诊断和预后结果,不仅能给出更准确的诊断,还能基于实证数据给出预后判断。

这种能力,让智能体每处理一个病例,就能积累一份经验,真正实现了基于经验的持续学习。

二、计算病理智能体的能力究竟有多强?

从"全能单兵"到"协同团队"的全场景覆盖

基于不同的临床场景,计算病理智能体已经形成了三类成熟的架构范式,覆盖了从简单对话到全流程自主诊断、从单机运行到人机协同的全场景需求。

第一类是单模型端到端智能体,就像临床里的全科医生,用一个统一的多模态大模型,完成从图像输入到诊断报告输出的全流程。

这类架构的优势是训练和部署简单,端到端的设计也能保证语义对齐。

- 早期代表PathChat,用视觉适配器把病理图像特征和Llama 2大模型对齐,让医生能直接和AI对话,询问切片病变区域的细节;

- 而SlideChat、MUSK等模型,更是突破了十亿像素WSI的上下文窗口限制,能直接处理整张切片,实现了端到端的全切片诊断;

- Patho-R1、SmartPath-R1则把思维链推理直接嵌入单模型架构,让AI在给出诊断前,先生成完整的推理步骤,大幅提升了复杂病例的诊断可靠性。

第二类是多智能体协同系统,如果说单模型是全科医生,那这类架构就是一个完整的病理多学科会诊团队。

它把复杂的诊断任务拆分成不同的专业角色,交给专门的智能体完成,既能突破单模型的上下文长度限制,也能通过多角色交叉校验,大幅减少幻觉和错误。

- 比如SlideSeek设计了"主管-探索者-报告者"的三级架构:主管智能体负责制定诊断计划,探索者智能体负责在WSI里自主导航、寻找病变证据,报告者智能体负责整合信息、生成诊断报告;

- PathFinder则把诊断流程拆分成"分诊-导航-描述-诊断"的闭环,像人类医生一样一步步完成诊断;

- WSI-Agents更是专门设置了"批评家智能体",负责校验逻辑和事实,实现了系统的自我纠错,极大提升了诊断的准确性。

第三类是交互式&人在环中智能体,核心目标不是替代医生,而是对齐人类专家的诊断逻辑,成为医生的"数字学徒"。

这类架构的核心,是把病理医生的隐性知识、操作经验,转化成AI能学习的内容,实现人机协同的最优效果。

- 比如Pathology-CoT,通过行为克隆学习资深病理医生的显微镜缩放、平移轨迹,复刻人类的视觉思维链;

- PathoGaze结合了医生的眼动追踪数据,让AI的注意力和资深专家的视线焦点对齐,避免把精力浪费在无关的组织上;

- 而TissueLab,能根据医生的实时反馈,不断优化自己的策略,和医生一起协同进化,真正成为医生的诊断副驾,而不是一个独立的"机器诊断系统"。

从"看结果"到"看过程"

传统的计算病理模型,只用准确率、AUC这些分类指标来衡量,就像只看考试的最终分数,却不看解题过程。

但对于能自主推理、自主行动的智能体来说,这种评估方式完全不够。

在基准测试方面,领域已经从简单的分类数据集,升级到了能全面考察临床能力的专用基准。

- 比如PathMMU,是专家级的多模态理解数据集,包含33428道病理多选题,覆盖PubMed、医学图谱等专业来源,每道题都有详细的专家解析;

- PathGen-1.6M则通过多智能体协同,生成了160万对高质量病理图像-文本对,覆盖27种组织类型,为模型训练提供了大规模的高质量数据;

- 而WSI-Bench,更是专门为十亿像素WSI设计的大规模基准,包含来自30种癌症的9850张WSI、179569个问答对,覆盖了从形态分析、组织学分型、分级,到预后预测、治疗建议、报告生成的11个核心病理任务,相当于给AI准备了一套完整的"病理执业医师资格考试",全面考察AI的临床能力,而不是简单的识图能力。

在评估体系上,领域也完成了从"只看结果"到"结果+过程+安全"的全维度升级。

除了传统的分类指标,新的评估体系还包含四大核心维度:

- 一是推理质量评估,不再只看诊断结果对不对,还要验证AI的思维链逻辑是否严谨,有没有"蒙对答案",确保AI的每一步推理都有证据支撑;

- 二是导航效率评估,考察AI能不能高效找到病变区域,有没有浪费算力随机扫描背景组织,衡量它的主动视觉能力;

- 三是幻觉与安全性评估,通过事实一致性校验,严格惩罚AI编造的形态特征和临床关联,同时区分良性错误和致命的误诊,优先消除高风险的临床错误;

- 四是人类专家盲审,这也是最终的金标准,比如PathChat、HistoGPT等模型,在盲审实验中,资深病理医生根本分不清AI生成的报告和人类医生写的报告,证明顶级的智能体,已经能达到和人类专家相当的诊断报告水平。

三、计算病理智能体将如何改变病理诊断的行业生态?

病理诊断是现代医学的基石,但在全球范围内,病理医生都面临着巨大的缺口------在中国,每10万人口仅有不到2名病理医生,基层医院的病理诊断能力更是严重不足;

而一张肿瘤WSI,资深医生也要花几十分钟才能看完,巨大的工作负荷,也带来了误诊、漏诊的风险。计算病理智能体的出现,不是要替代病理医生,而是要彻底重塑这个行业的生态,让病理诊断更精准、更高效、更可及。

在当下,它首先能解决行业最核心的痛点:通过全切片初筛,自动锁定可疑病变区域,把医生从海量、重复性的筛查工作中解放出来,让医生能把精力集中在复杂病例的诊断、和患者的沟通上;

对于基层医院来说,智能体就像一个"随身的资深病理专家",能结合权威医学指南、全球的病例数据,帮助基层医生提高诊断准确率,减少误诊,让优质的病理诊断资源,能覆盖到更多偏远地区的患者。

除此之外,智能体的多模态融合能力,还能实现以前根本做不到的事情:比如直接从HE染色切片里,预测患者的基因突变状态、治疗响应和预后,把形态学和分子生物学、临床信息完美整合,真正推动精准医疗的落地。

当然,计算病理智能体还处在发展的早期,这篇综述也明确指出了它面临的核心挑战:首先是推理数据的稀缺,现在的数据集大多只有"切片-诊断报告"的输入输出对,没有记录医生诊断过程中的思考轨迹、操作流程,而这些"隐性知识",恰恰是病理诊断的核心;

其次是十亿像素级数据的计算效率瓶颈,一张WSI的处理需要巨大的算力和时间,很难满足临床实时诊断的需求;最核心的,还是临床安全性和监管问题,生成式AI的幻觉问题,在医疗这个高风险领域,是绝对不能忽视的红线。

针对这些挑战,综述也指出了未来的发展方向:

- 未来的智能体,会通过行为克隆、眼动追踪等技术,把医生的隐性诊断知识显性化,实现基于过程的监督;

- 会通过自适应注意力、分层记忆架构,平衡全局上下文和计算效率,实现实时的切片处理;

- 会通过多智能体的自我校验、检索增强生成等技术,打造可验证、可追溯的AI,解决幻觉问题,满足临床监管的要求;

最终,会进化成以人为中心的协同智能体------它不是要替代病理医生,而是要成为医生最可靠的诊断伙伴,医生负责复杂的临床决策、伦理判断,AI负责海量的信息整合、重复性的筛查、证据的收集验证,形成人机协同的全新诊断模式。

结束语

本期推文的内容就到这里啦,如果需要获取医学AI领域的最新发展动态,请关注小罗的推送!

团队正在招聘实习生/分析师/讲师,欢迎医工交叉方向的优秀硕博,投递个人简历到团队邮箱:lxltx2025@163.com