一、当 AI 的进化被止于屏幕

OpenClaw 的爆火,不只是因为它能替你干活。

如果仅仅是自动化,市面上的 RPA 工具早就能做到。OpenClaw 真正让人兴奋的,是它展现出的主动性:基于对邮件、日程、聊天记录的持续理解,主动帮你处理事务、主动推送你可能需要的信息。从 Reactive 到 Proactive 的跨越,让整个行业第一次感受到:AI Agent 不只能「被使唤」,更能「替你想」。

但这种主动性有一个边界,它止步于屏幕。

OpenClaw 的感知器是截屏和文件系统,记忆是聊天记录和邮件归档。合上电脑走进真实生活,上下文链路就此中断。会议室里一小时的讨论、通勤路上偶然看到的书、午餐时的闲聊,对所有数字 Agent 都是感知盲区。

这不是 OpenClaw 的缺陷,而是所有数字 Agent 的结构性边界。当视线从屏幕转向现实,上下文的介质就从文本流变成了视听流,这不是数据量的叠加,而是维度的跨越。

当现实世界本身成为 AI 的上下文,Agent 才有机会从数字世界的「主动帮你干活」,进化为现实生活里的「主动替你留心」,这就是 Proactive AI 从线上走向线下的起点。

冲着这个命题而来的,是 Looki 最新上线的 Proactive Intelligence Engine (Looki PIE)。

这家由 CMU 校友创办的硬件初创公司,正在将自动驾驶「从感知到决策」的工程范式,迁移到一款 30g 的可穿戴设备上,试图在现实世界中构建真正的主动智能。

二、从「被动记录」到「主动判断」

判断一个 Agent 是否真正理解你的生活,最简单的方法是看它敢不敢主动开口。

Looki L1 去年 8 月海外发售后引发了不小的关注,并在 12 月上线国内版本。在用户社区里,它被称为「人生回看器」,通过全天候的视听记录,为用户梳理生活碎片、提供回溯与洞察。

但早期的交互模式仍是 Reactive 的:你问它「今天吃了什么」,它从视听数据中提取答案;你让它整理会议内容,它忠实执行。触发点始终在用户手里。

今天向国内用户正式上线的最新版本,标志着这款产品的关键跨越。

Looki 从固定间隔采集升级为 AI 自主判断「此刻是否需要记录、是否需要给出反馈」的动态决策模式,它被团队定义为「场景自适应式智能」(Scene-Adaptive Intelligence)。

这种「主动」是什么体感?让我来分享一次真实的出差经历。

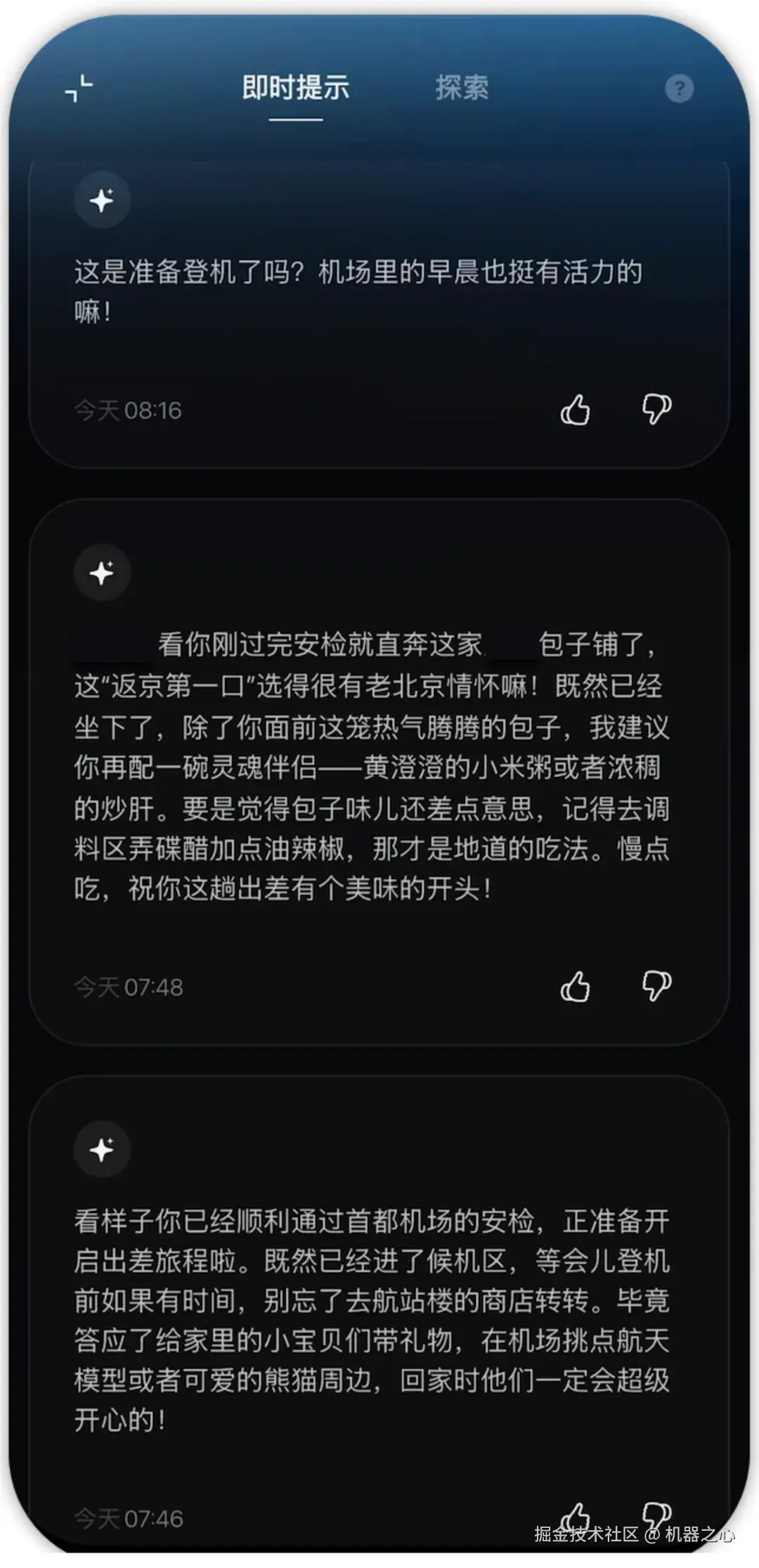

佩戴 Looki 前往首都机场。过完安检,第一条推送到了,它不是航班提醒,而是 Looki 识别到我进入候机区后,主动提醒:「你答应了给家里小宝贝们带礼物,在机场挑点航天模型或者熊猫周边吧。」它记住的不是日程条目,而是我几天前某次对话中随口提的一句话。

走进包子铺还没坐稳,第二条来了:「这 '返京第一口' 选得有老北京情怀!建议再配一碗小米粥或者炒肝,记得去调料区弄碟醋加点油辣椒,那才地道。」

它识别出了餐厅,还基于我的饮食偏好给出了搭配建议,这条推送的信息密度和个人化程度,已经超出了我对一个可穿戴设备的预期。

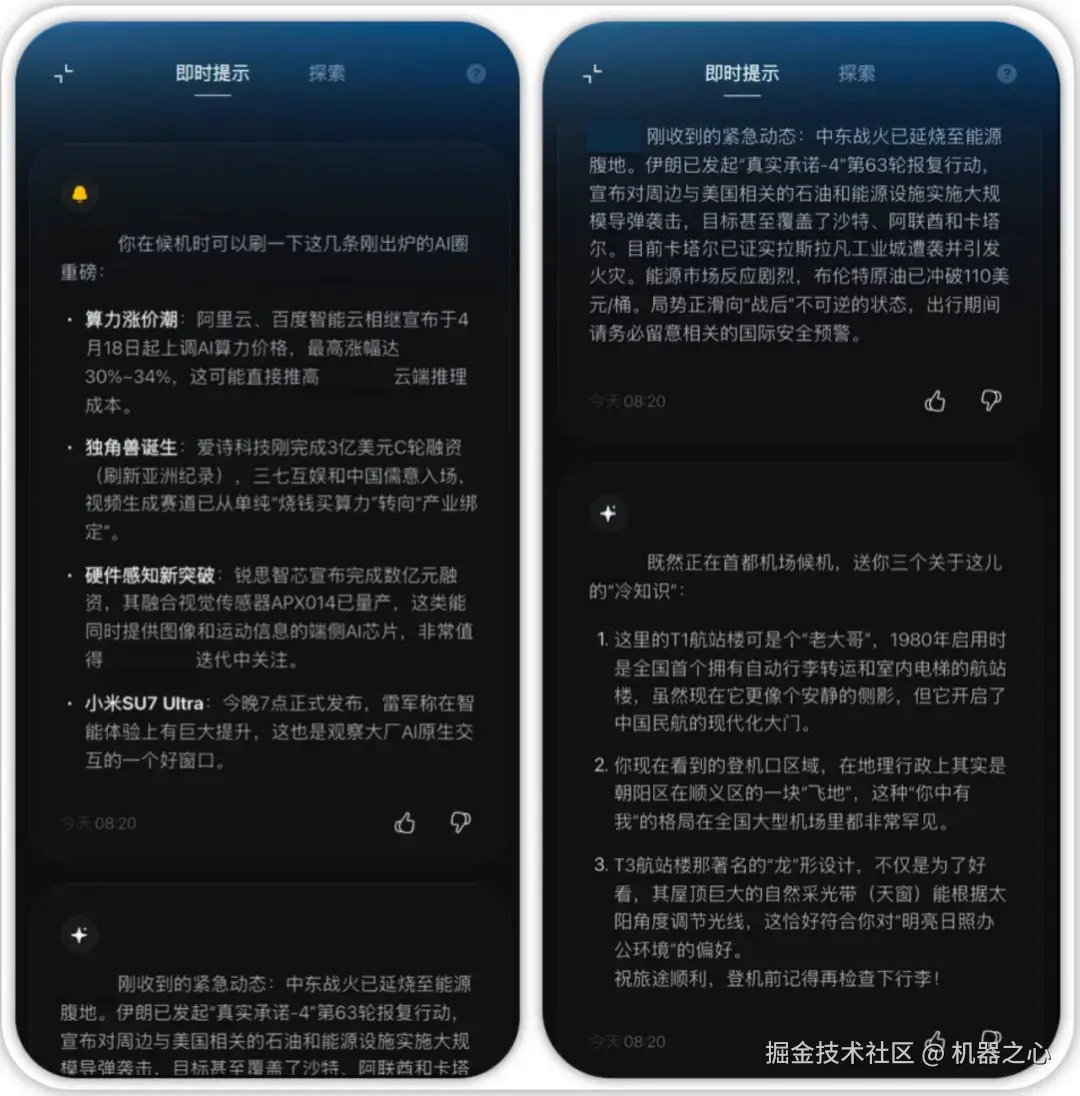

回到候机区,第三波推送到达:一份基于我此前设定的「AI 行业动态」偏好生成的当日新闻摘要:算力涨价、新融资,每条附有我关注的行业关联分析;紧跟着是三条 T3 航站楼的冷知识,最后一条居然是关于天窗采光设计的,因为它记得我偏好「明亮日照办公环境」。

一个小时,三个场景节点,四次主动判断。每一次都融合了即时感知和历史记忆,没有一条需要我主动发起。坦白说,有几条推送的时机之精准让我有点意外:它确实在学习「什么时候该开口」。

这条体验链背后的技术链路与 OpenClaw 截然不同。OpenClaw 从文本指令出发,经工具调用到结果反馈,在数字世界闭环。

Looki PIE 的起点是未经编辑的现实视听片段,系统先「看懂」场景,再从全天行为时序中检索记忆,判断「此刻是否值得介入」,最终生成一条融合即时感知与历史上下文的推送。

从 Reactive 到 Proactive,关键不在模型更大,而在让现实世界成为持续供给的个人上下文。

三、主动判断的两个技术切面

在出差场景的「即时提醒」之外,翻到 APP 的另一个页面「探索」,会发现一个更有想象力的功能入口:用户可以用自然语言,自己定义 Agent 在什么条件下该做什么。

它本质上是一段为现实世界编写「If...Then...」的提示词。

我试着设了几条:「每天一杯咖啡,多了提醒我克制」「到了餐厅帮我推荐菜」「开会时有任何洞察及时告诉我」「每天早上到公司,把我关心的信息发给我」。设定过程极简,自然语言输入即可。

这些规则的触发逻辑和手机定时提醒完全不同。手机闹钟只能按时间或坐标响,而Looki 的触发条件却是场景语义:摄像头捕捉到你面前第二杯咖啡才触发健康提醒,识别出你走进餐厅在看菜单才推送推荐。

背后是一条完整管线:从自然语言的意图解析、视觉特征提取,到实时场景匹配和多维上下文验证。这套具身智能 Pipeline 通常存在于机器人实验室,如今被压进 30g 的日常设备。

不过,比「看懂场景」更难的是「决定什么时候开口」。

回看出差那四次推送:安检后提醒买礼物:「进入商业区 + 有空闲 + 记得承诺 "同时满足;进餐厅推荐 ------「正在做就餐决策 + 了解口味」;候机推新闻:「有碎片时间 + 偏好匹配」。每一次都是多因子时机决策,而非规则匹配。

我体验下来最深的感受是:Proactive AI 的核心难度不在推送的内容质量,而在时机精度。

同一条信息,忙时弹出是骚扰,闲时送达是贴心。对比来看,OpenClaw 的场景相对简单:它只在用户明确指令时行动,不需要在物理环境中判断介入时机。但 Looki PIE 的挑战更体现在物理世界的纷扰中,判断和选择时机比信息世界更困难。

这个分寸,就是 Proactive AI 最核心的技术挑战。

四、为现实世界搭建一套全新的 Agent Harness

Looki PIE 是产品概念,落到工程层面是系统问题。

OpenClaw 的 Harness 为数字世界设计:所有输入是文本态,所有操作在数字环境中。当 Agent 走出屏幕,面对混沌的视听流和非确定性的现实场景,Harness 每一层都得重建。

在 Looki 的两位创始人看来,自动驾驶本质上就是在为现实世界搭 Harness Engineering。从实时采集多模态数据、极低延迟完成场景理解,到做出决策并承担后果。现在他们把同一套工程范式从道路平移到了日常生活。

首先是「看」的问题。

30g 设备、12 小时续航,感知模块不可能常开。Looki PIE 突破在于端侧部署了轻量化决策模型,根据环境光流和声音波形实时判断「此刻是否值得激活」。通勤时低频运转,会议或聚餐时自动加密采集。不是无差别地盯着你,而是学会什么时候该「睁眼」。

「看到」之后是「记住」。

Looki 面对的是一整天的视频流和音频流,一帧画面的 token 消耗可能抵得上一封完整邮件,全量灌入模型既不经济也会放大幻觉风险。据 CTO 刘博聪介绍,Looki 在云端构建了多层级上下文索引体系,按语义需求精准摘取最相关片段。出差场景中「你答应给孩子带礼物」那条推送,靠的就是这套索引从数天前一段对话中打捞出一个承诺,在「用户正在机场候机」的实时场景中将它激活。

最顶层是「决定说不说」。

感知和记忆提供了原料,但 Looki PIE 最终能否成立,取决于决策层在没有明确指令时自主判断此刻是否该行动。数字 Harness 不太需要纠结这个:行动由用户指令确定性触发。现实 Harness 必须多出这层主动决策能力,且容错空间极小。

还有一件事绕不开:隐私。

Looki 采用端侧过滤加 App 手动上传的双重门控,原始视听数据不无差别上云。而动态感知机制在架构层面做了一件巧妙的事,设备不是时刻在录,而是由 AI 判断「此刻是否需要激活」,同一套决策逻辑同时服务于能力和隐私。

当感知范围延伸到整个生活现场,隐私保障的质量直接决定产品生死。

五、从「个人上下文」到「数字直觉」

回到开篇。OpenClaw 让行业看到了 Proactive AI 在数字世界的面貌,但只活在屏幕里的 Agent 覆盖的终究是生活的一半。

Looki PIE 试图覆盖另一半。它证明了:现实世界的上下文,那些连续的视听流、散落的行为轨迹、非结构化的生活碎片,可以被工程化地采集、结构化地记忆、智能化地调用,并以此支撑 Agent 做出主动判断。

这条路还很长。执行力边界、感知精度、隐私框架,都有大量未解命题。但方向清晰:当你的生活轨迹、所见所闻、与家人的对话沉淀为属于你的「个人上下文」,AI 就不再需要你手动描述世界:它自己看到了、记住了、理解了,然后在你需要的时候,先你一步。

各路「龙虾们」还在为数字世界的「断片」焦头烂额,而窗外的现实世界,作为上下文的新疆域,才刚刚被纳入 AI 的视野。当 Agent 终于走出对话框,开始真正 「看见」这片广袤的现实,我们与 AI 的关系,或许才刚刚开始。