vscode一直支持的都是云端闭源的模型,例如 GPT Claude等等,当这些闭源模型的免费额度用完之后,则需要付费继续使用。本文介绍的是vscode接入ollama的本地模型,从而实现token自由。

ollama

首先需要到ollama的官网下载ollama应用,详见这里。

然后下载机器硬件所能支撑的模型,如下:

vscode

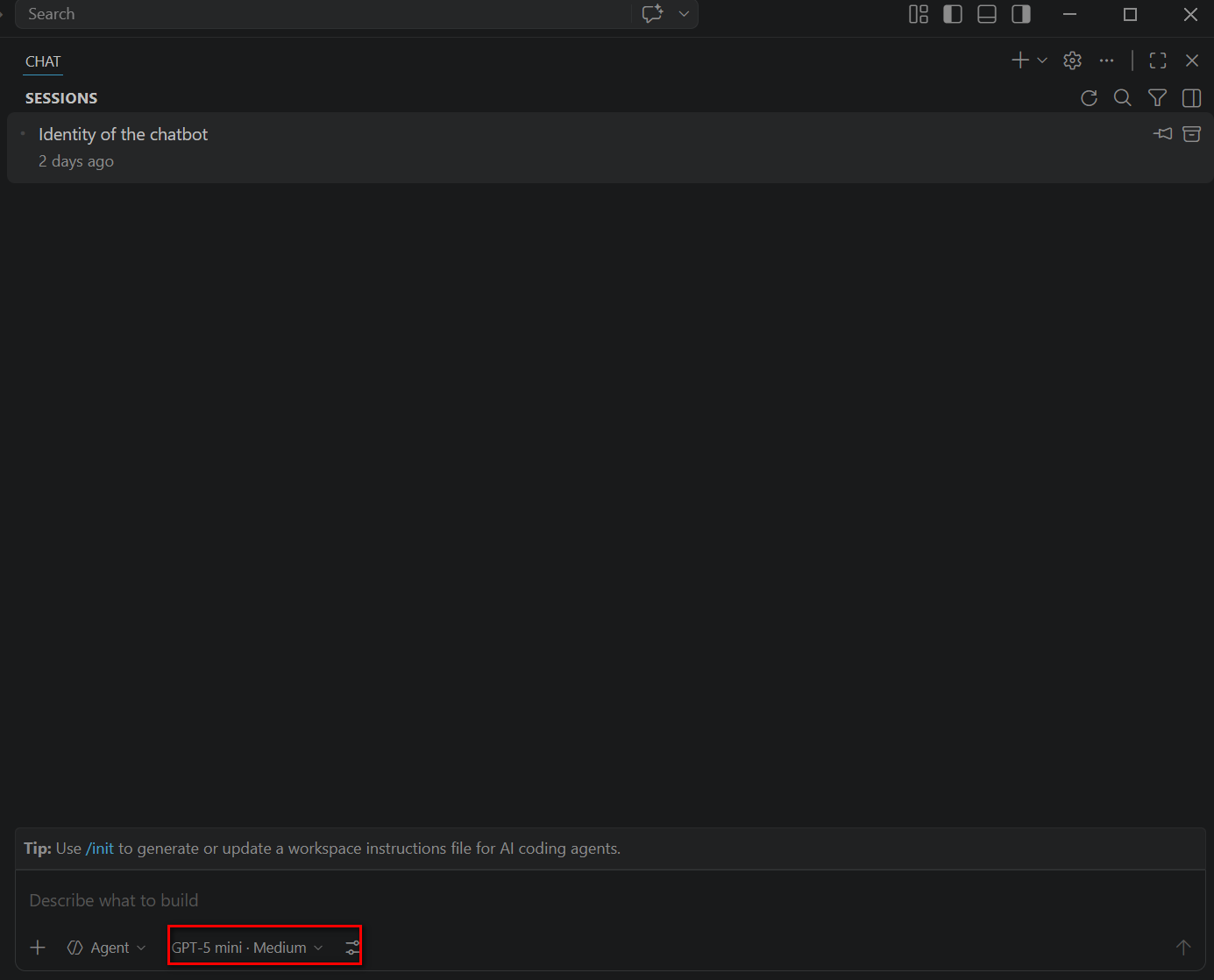

vscode登录GitHub账号之后,进入对应的chat界面,如下:

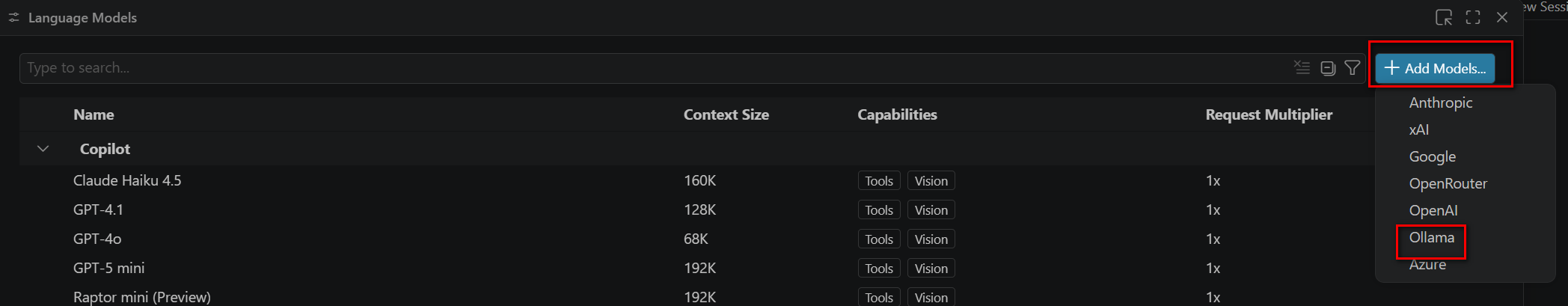

点击上图红色区域部分,下拉选择管理模型,如下:

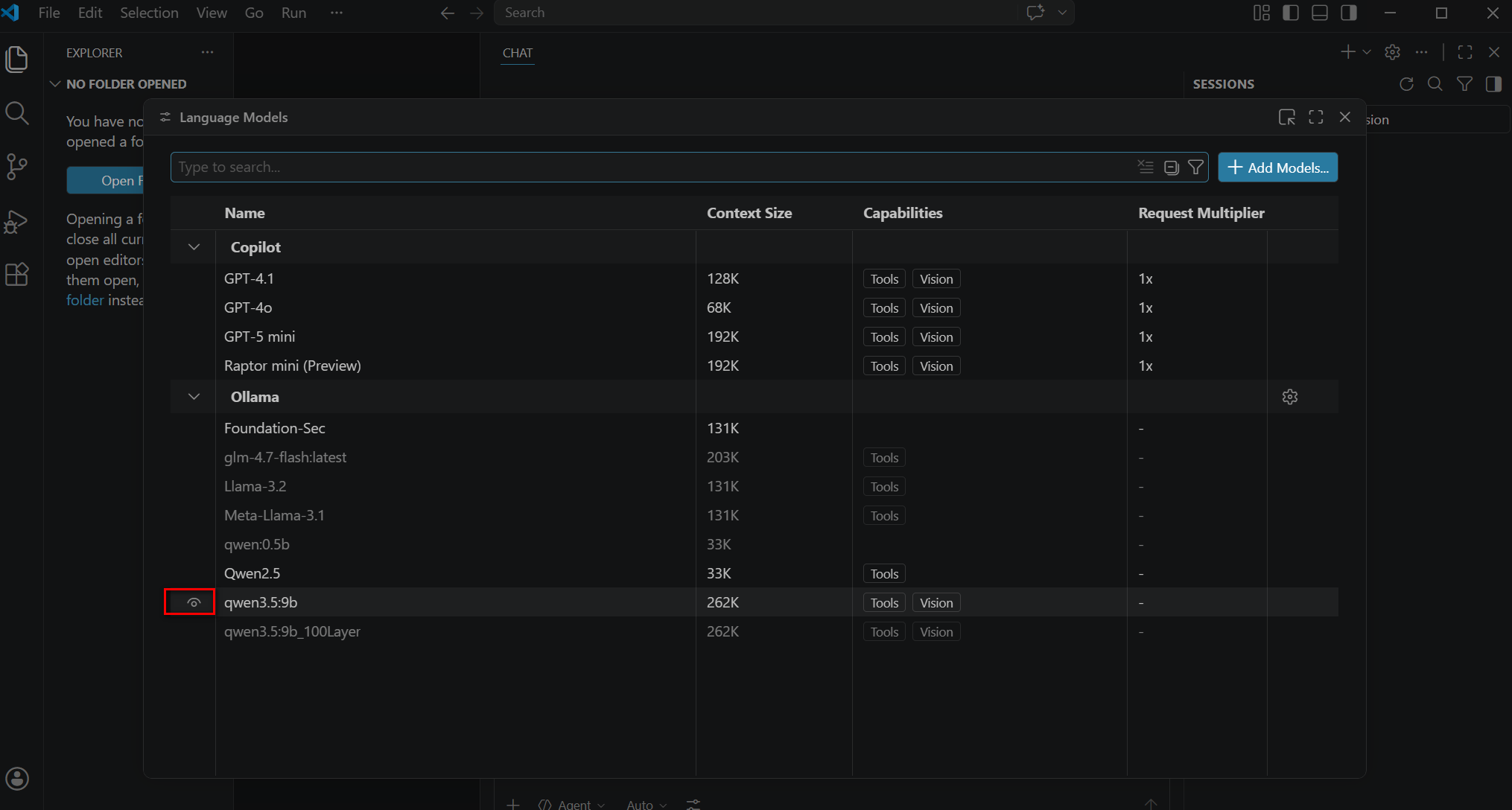

点击上图红色部分增加ollama模型,会跳出ollama默认的地址,完成默认的设置完成后,如下

如果想要vscode可以选择本地的模型,还需要将应用的模型变为可见,如上图的qwen2.5和qwen3.5。

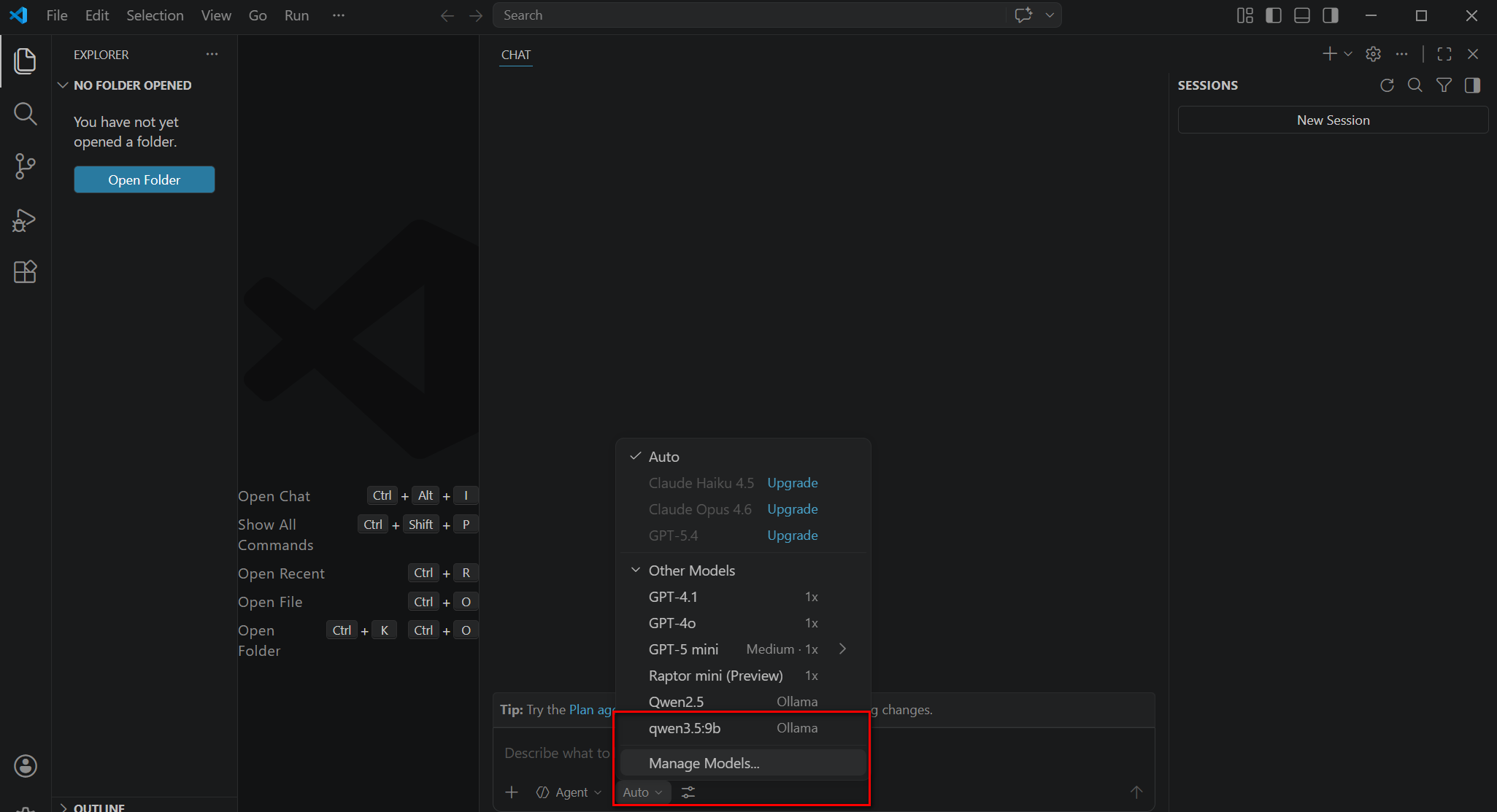

在聊天选中对应的本地模型,如qwen3.5:

有了本地的模型之后,在vscode中就不用担心后续token消耗过大了。

本文简单介绍了vscode如何添加ollama本地模型,后续更多的关于AI方面的介绍,将在后续我的专栏《AI安全》专栏详细说明,见这里。