之前我们在理论角度上理解了TCP协议,本期我们就来学习一下另一个重点协议:TCP协议

目录

[延迟应答的核心工作机制(RFC 1122 标准 + 工程实现)](#延迟应答的核心工作机制(RFC 1122 标准 + 工程实现))

[延迟应答的经典踩坑(20 年一线经验,90% 的人都栽过)](#延迟应答的经典踩坑(20 年一线经验,90% 的人都栽过))

[捎带应答的核心工作机制(RFC 793 原生定义)](#捎带应答的核心工作机制(RFC 793 原生定义))

[举个最直观的实战例子(SSH 会话)](#举个最直观的实战例子(SSH 会话))

[本质定义(RFC 793 原生规范 + 内核实现视角)](#本质定义(RFC 793 原生规范 + 内核实现视角))

[从业 20 年见过的 3 个致命认知误区](#从业 20 年见过的 3 个致命认知误区)

[粘包 / 半包的核心成因(分发送端、接收端双视角)](#粘包 / 半包的核心成因(分发送端、接收端双视角))

[TCP 连接建立异常(三次握手阶段)](#TCP 连接建立异常(三次握手阶段))

[TCP 数据传输阶段异常(ESTABLISHED 状态)](#TCP 数据传输阶段异常(ESTABLISHED 状态))

[TCP 连接关闭异常(四次挥手阶段)](#TCP 连接关闭异常(四次挥手阶段))

[TCP 可靠性的核心保障机制](#TCP 可靠性的核心保障机制)

[TCP 性能提升的核心机制](#TCP 性能提升的核心机制)

TCP在主机间传输的特征

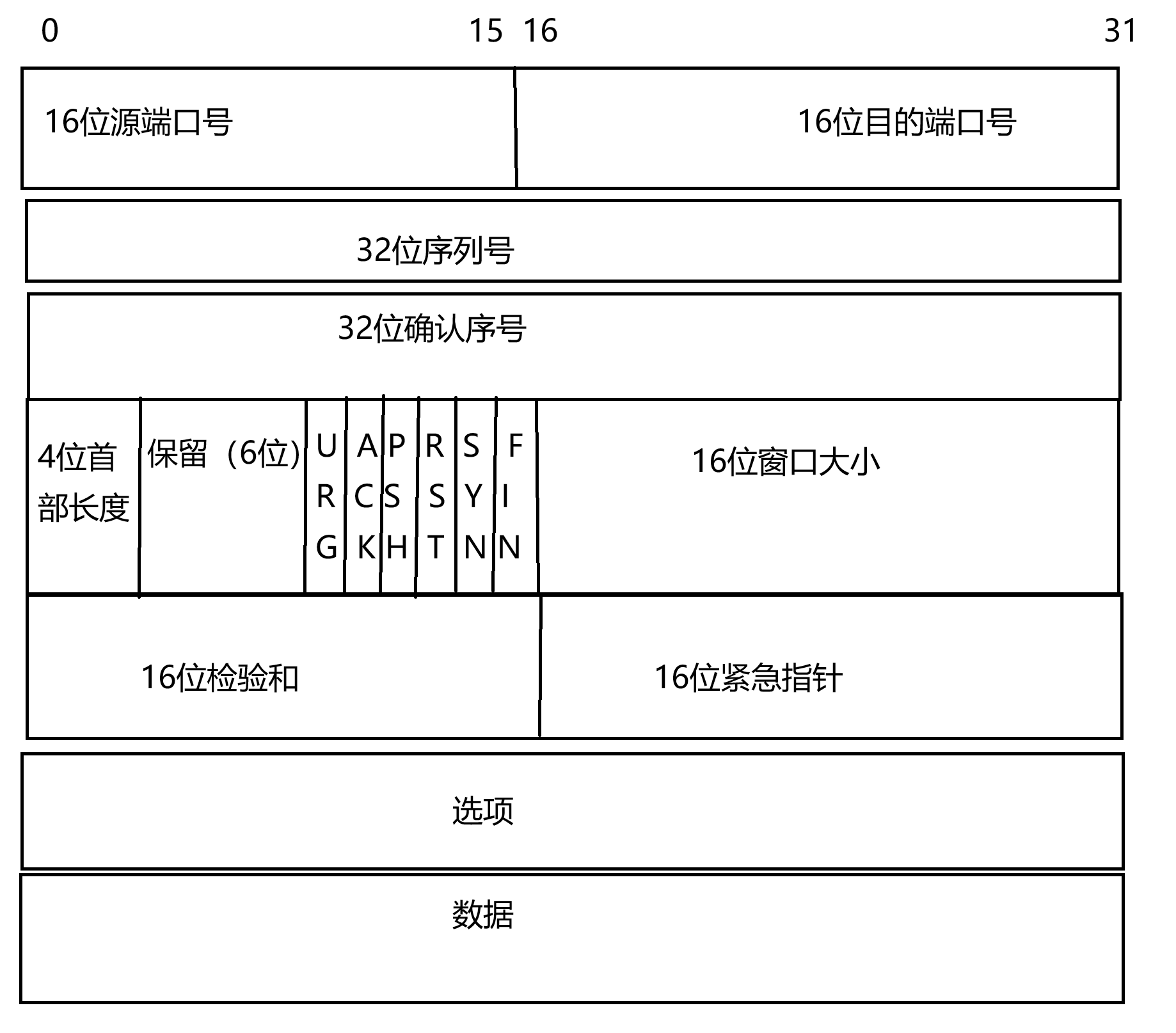

TCP协议段格式

各部分的作用:

源端口和目的端口(各16位)

- 作用:用于多路复用/分解。源端口标识发送方应用进程,目的端口标识接收方应用进程。这是TCP实现端到端通信的基础,确保数据能交付给正确的应用程序(如HTTP用80端口,HTTPS用443)。

序列号(32位)

-

作用:为每个发送的字节流分配一个序号。主要用于:

-

有序交付:接收方按序列号重排可能乱序到达的报文段。

-

去重:丢弃重复收到的报文段。

-

可靠性:通过确认号机制,接收方告知"已收到序列号X及之前的所有数据",发送方据此判断是否需要重传。

-

捎带应答

-

重传

-

确认号(32位)

- 作用 :仅在ACK标志位为1时有效。它表示期望收到对方下一个报文段的首字节序号 ,同时也隐含确认了该序号之前的所有数据都已成功接收。这是实现累计确认 和滑动窗口的关键。

数据偏移(4位)

- 作用 :指示TCP首部的总长度(以4字节为单位)。因为选项字段长度可变,需要该字段来明确首部结束和数据开始的位置。例如,

数据偏移 = 5表示首部长20字节(5 * 4字节),没有选项。

保留(3位)

- 作用:保留供未来使用,目前必须置为0。

标志位(每个1位,共9位但通常显示关键6位)

-

URG:紧急指针有效。

-

ACK:确认号有效。连接建立后的所有报文段通常都置1。

-

PSH:推送标志。接收方收到后应尽快将数据交付给应用层,而不是等待缓冲区填满。

-

RST:复位标志。用于异常终止一个连接(如拒绝非法请求、处理连接错误)。

-

SYN:同步序号。用于连接建立阶段。SYN=1, ACK=0 表示连接请求;SYN=1, ACK=1 表示连接接受。

-

FIN:结束标志。用于关闭连接,表示发送方已无数据要发送。

窗口大小(16位)

- 作用 :用于流量控制。它告知对方"从本确认号开始,我还能接收的字节数"(即接收窗口大小)。发送方不能发送超过该窗口大小的未确认数据,以避免淹没接收方。

校验和(16位)

- 作用:检测端到端的数据传输是否出现比特错误。它不仅计算TCP首部和数据,还计算一个伪首部(包含源/目的IP、协议号、TCP长度),以校验数据是否正确到达目的地。

紧急指针(16位)

- 作用:仅在URG=1时有效。它指向报文段内紧急数据的最后一个字节的序号(一个常见的说法是"紧急指针是正偏移,与序列号相加得到紧急数据最后一个字节的序号"),用于发送带外数据。

选项(可变长度,最多40字节)

-

作用:用于扩展TCP功能。常见选项包括:

-

MSS(最大报文段大小):告知对方自己能接收的最大报文段长度。

-

窗口缩放因子:扩展16位窗口字段,支持超过64KB的窗口,用于高带宽长延迟网络(如卫星链路)。

-

SACK(选择性确认):允许接收方告知发送方哪些数据块丢失、哪些已收到,实现更高效的重传。

-

时间戳:用于计算往返时间(RTT)和保护免受序列号回绕影响(PAWS)。

-

数据

- 作用:上层应用交付的净荷数据。TCP通过首部中的序号和确认号来保证这部分数据的可靠、有序传输。

前面我们已经了解过TCP本质是协议结构体。TCP通过目标端口号解决了如何分用的问题。但是TCP没有有效载荷长度,如何实现报头与载荷分离呢???

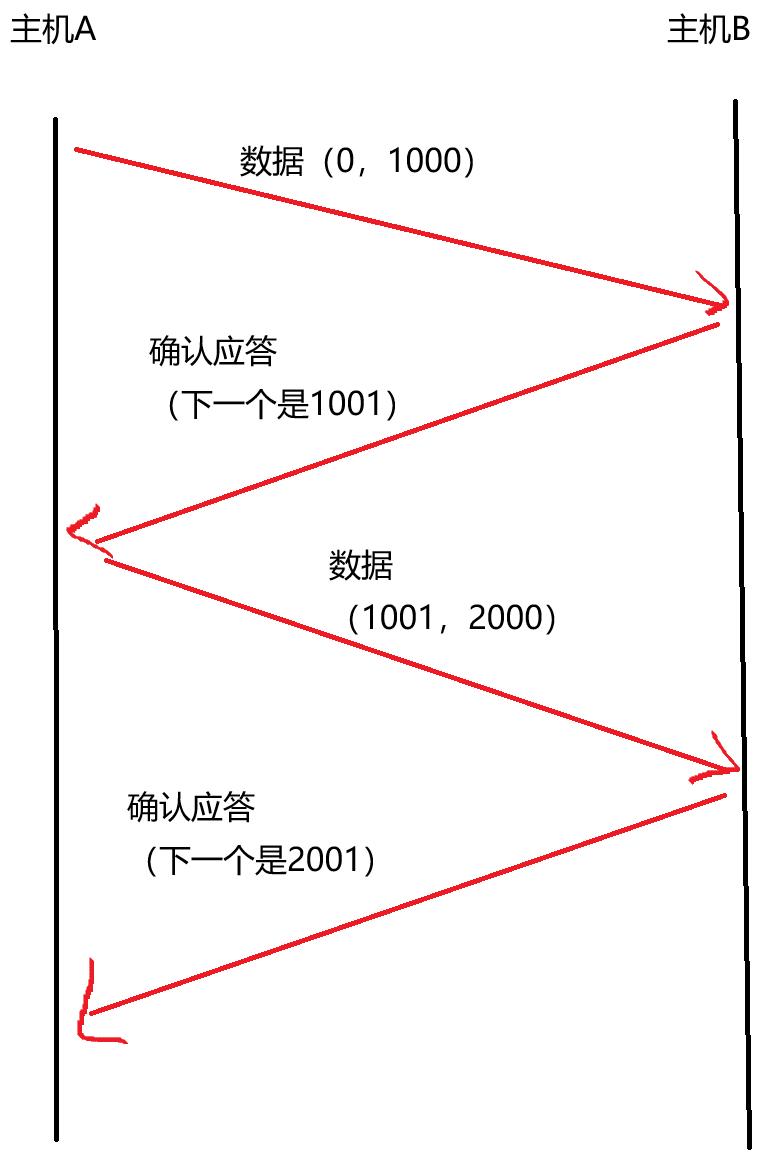

TCP的可靠性如何体现的呢?对于发出去的报文百分百有应答,收到应答,历史保温100%被对方收到。但是对于最新的报文100%可靠的协议是不存在的

TCP保证可靠性的机制

确认应答机制

确认应答机制是TCP保证可靠性的机制之一,收到报文必定应答。

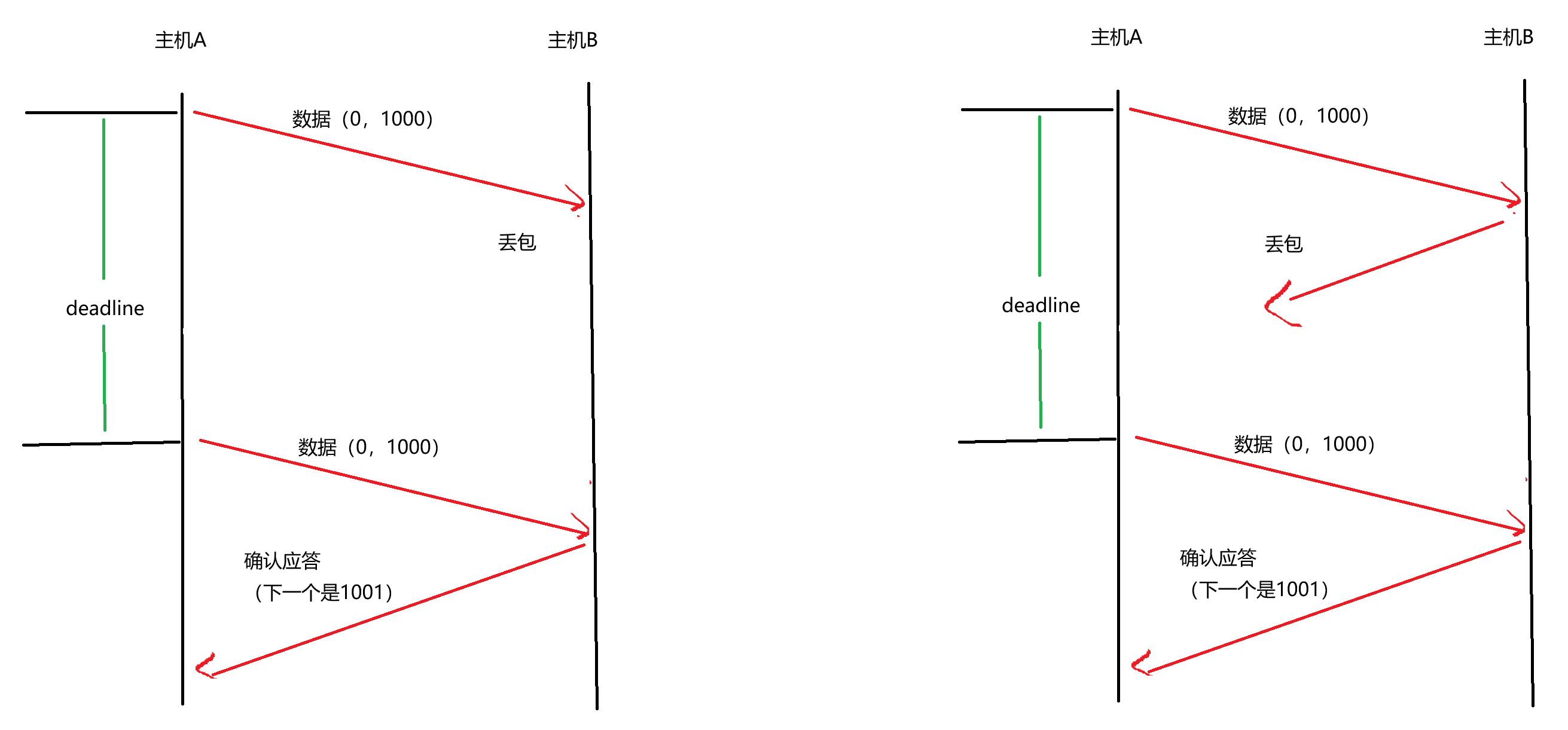

超时重传机制

无论应答丢了还是报文丢了A都不会受到应答。如果在限定的时间内(deadline)没有收到应答,就会丢包

那么这个deadline是如何确定的呢?以以下的机制:

Linux中(BSD Unix和Windows也是如此), 超时以500ms为一个单位进行控制, 每次判定超时重发的超时时间都是500ms的整数倍.

如果重发一次之后, 仍然得不到应答, 等待 2*500ms 后再进行重传.

如果仍然得不到应答, 等待 4*500ms 进行重传. 依次类推, 以指数形式递增.

累计到一定的重传次数, TCP认为网络或者对端主机出现异常, 强制关闭连接.

TCP在传输过程中是如何对通信双方进行流量控制的呢?

问题1:接收方,如何衡量自己的接受能力??

看接受缓冲区中,剩余空间的大小!

问题2:发送方如何得知对方的接受能力??

把自己的接受能力,填写到应答报文的16位窗口大小中

TCP状态位

TCP协议首部中的6个经典标志位(每个占1位)及其作用如下:

-

URG(紧急指针有效)

当该位为1时,表示报文段中包含紧急数据,需优先处理。配合"紧急指针"字段指明紧急数据的末尾位置。

-

ACK(确认号有效)

为1时确认号字段才有效。连接建立后,所有传输的报文段通常都置1,用于确认已成功接收的数据。

-

PSH(推送)

为1时要求接收方将数据尽快交付给应用层,而不是先放入缓冲区等待填满。用于交互式应用(如Telnet)。

-

RST(复位连接)

为1时表示连接出现严重错误(如拒绝非法的连接请求、主机崩溃),必须立即释放连接,然后重新建立。

-

SYN(同步序号)

用于连接建立阶段。

-

SYN=1, ACK=0:连接请求。

-

SYN=1, ACK=1:连接接受(即同步确认)。

-

-

FIN(终止连接)

为1时表示发送方已无数据要传输,请求释放连接。用于正常的四次挥手关闭连接。

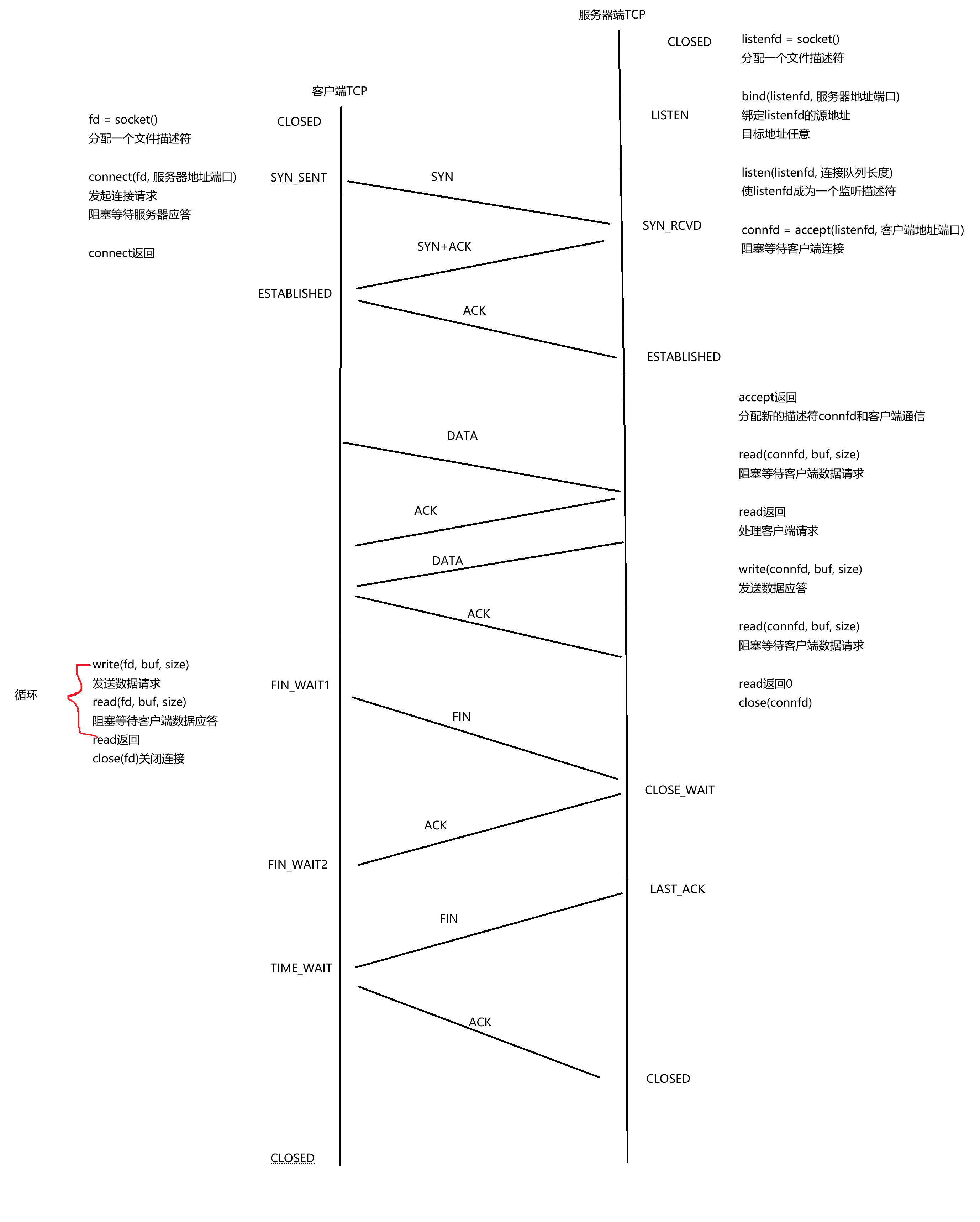

连接管理机制

TCP以三次挥手建立连接,四次挥手断开链接。具体流程如下

三次握手为了保证通信前必须保证网络流畅

四次挥手以最小的成本获得双方的统一

主动断开的一方会在4次挥手后进入TIME_WAIT状态,而被动一方会立刻释放链接,为什么要这样呢?

1、确保4次挥手尽可能地完成

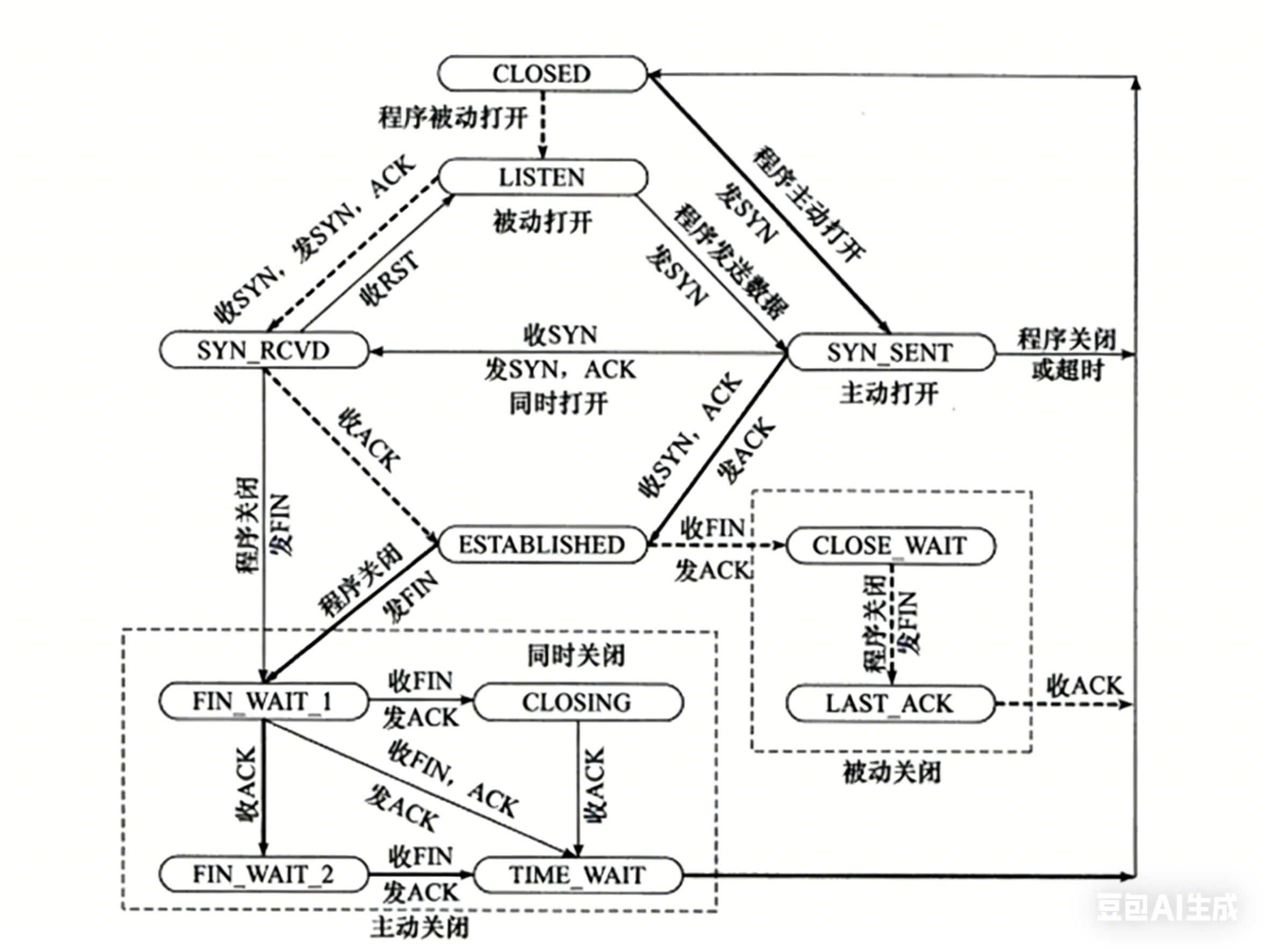

服务端状态转化 :

• CLOSED -\> LISTEN 服务器端调用listen后进入LISTEN状态, 等待客户端连接;

• LISTEN -\> SYN_RCVD 一旦监听到连接请求(同步报文段), 就将该连接放入内核等待队列中, 并向客户端发送SYN确认报文.

• SYN_RCVD -\> ESTABLISHED 服务端一旦收到客户端的确认报文, 就进入ESTABLISHED状态, 可以进行读写数据了.

• ESTABLISHED -\> CLOSE_WAIT 当客户端主动关闭连接(调用close), 服务器会收到结束报文段, 服务器返回确认报文段并进入CLOSE_WAIT;

• CLOSE_WAIT -\> LAST_ACK 进入CLOSE_WAIT后说明服务器准备关闭连接(需要处理完之前的数据); 当服务器真正调用close关闭连接时, 会向客户端发送FIN, 此时服务器进入LAST_ACK状态, 等待最后一个ACK到来(这个ACK是客户端确认收到了FIN)

• LAST_ACK -\> CLOSED 服务器收到了对FIN的ACK, 彻底关闭连接.

客户端状态转化 :

• CLOSED -\> SYN_SENT 客户端调用connect, 发送同步报文段;

• SYN_SENT -\> ESTABLISHED connect调用成功, 则进入ESTABLISHED状态, 开始读写数据;

• ESTABLISHED -\> FIN_WAIT_1 客户端主动调用close时, 向服务器发送结束报文段, 同时进入FIN_WAIT_1;

• FIN_WAIT_1 -\> FIN_WAIT_2 客户端收到服务器对结束报文段的确认, 则进入FIN_WAIT_2, 开始等待服务器的结束报文段;

• FIN_WAIT_2 -\> TIME_WAIT 客户端收到服务器发来的结束报文段, 进入TIME_WAIT, 并发出LAST_ACK;

• TIME_WAIT -\> CLOSED 客户端要等待一个2MSL(Max Segment Life, 报文最大生存时间)的时间, 才会进入CLOSED状态.

以下是TCP状态转换的汇总:

其中:

• 较粗的虚线表示服务端的状态变化情况;

• 较粗的实线表示客户端的状态变化情况;

• CLOSED是一个假想的起始点, 不是真实状态;

TIME_WAIT

通信双方状态

假如主机A、B进行TCP通信,A关闭后,会发生什么呢?

主机A(进入TIME_WAIT)

-

状态保持 :A发送最后一个ACK后,进入

TIME_WAIT,持续 2MSL(通常60~120秒)。 -

禁止复用四元组:A的源端口被锁定,相同四元组(源IP、源端口、目的IP、目的端口)的新连接无法建立。

-

丢弃旧包:若收到属于旧连接的延迟数据包,直接丢弃,不传给应用。

-

响应重传FIN:若B没收到最后的ACK而重传FIN,A会重新发送ACK,并重置TIME_WAIT计时器,保证B正常关闭。

主机B(已进入CLOSED)

-

完全无状态:B收到最后一个ACK后,连接彻底关闭,不保留任何信息。

-

端口可复用:B的本地端口立即释放,可用于其他连接。

-

若B后续发送数据 :因B已关闭,会收到RST或写入错误(如

EPIPE)。 -

不会感知TIME_WAIT:B不知道A还在等待,B已"遗忘"该连接。

核心区别:TIME_WAIT只存在于主动关闭方(A),被动关闭方(B)毫无负担。

导致的bind失败

但是当服务器程序(主动关闭方)崩溃重启,或频繁创建短连接后,bind()到相同端口(如8080)时失败,报错:

bash

Address already in use (EADDRINUSE)原因是该端口上仍有处于TIME_WAIT的连接。

解决方案(按推荐顺序)

方案一:SO_REUSEADDR(最标准、最安全)

在bind()前设置套接字选项:

cpp

int reuse = 1;

setsockopt(sockfd, SOL_SOCKET, SO_REUSEADDR, &reuse, sizeof(reuse));效果 :允许bind()到处于TIME_WAIT的地址/端口。

适用场景:服务端监听端口(如HTTP、Redis),几乎无副作用。

方案二:SO_REUSEPORT(Linux 3.9+)

允许多个进程/线程绑定同一端口,同样可绕过TIME_WAIT限制。适合多进程负载均衡或热升级。

⚠️ 方案三:调整内核参数(仅限客户端)

-

开启

tcp_tw_reuse:允许客户端在TIME_WAIT未结束时复用四元组发起新连接(需同时开启tcp_timestamps)。

注意 :仅适用于主动连接方(客户端),不能用于服务端监听端口。 -

扩大本地端口范围 :

net.ipv4.ip_local_port_range = 1024 65535,增加可用端口池。

绝对禁止的做法

-

tcp_tw_recycle:已被Linux 4.12+移除,在NAT环境下导致灾难性故障,永远不要使用。 -

缩短

TIME_WAIT时长(修改tcp_fin_timeout):会破坏TCP可靠性,可能造成数据错乱。

工程最佳实践

-

服务端 :使用

SO_REUSEADDR,这是标准做法。 -

客户端短连接频繁 :改用长连接/连接池,或增大本地端口范围。

-

不要试图"消灭"TIME_WAIT,它是可靠性保障,不是bug。

总结

| 角色 | TIME_WAIT期间特点 |

|---|---|

| 主机A(主动关闭方) | 1. 保持状态2MSL,禁止相同四元组复用 2. 丢弃旧包,响应重传FIN 3. 作为"守门员"保障可靠关闭 |

| 主机B(被动关闭方) | 1. 立即进入CLOSED,无任何状态残留 2. 端口可复用,不感知TIME_WAIT |

解决bind失效:

-

首选 :设置

SO_REUSEADDR。 -

次选 (客户端):开启

tcp_tw_reuse+ 扩大端口范围。 -

禁止 :使用

tcp_tw_recycle或随意缩短TIME_WAIT。

核心结论 :TIME_WAIT只困扰主动关闭方;SO_REUSEADDR是破局利器,但不要为了性能牺牲可靠性。

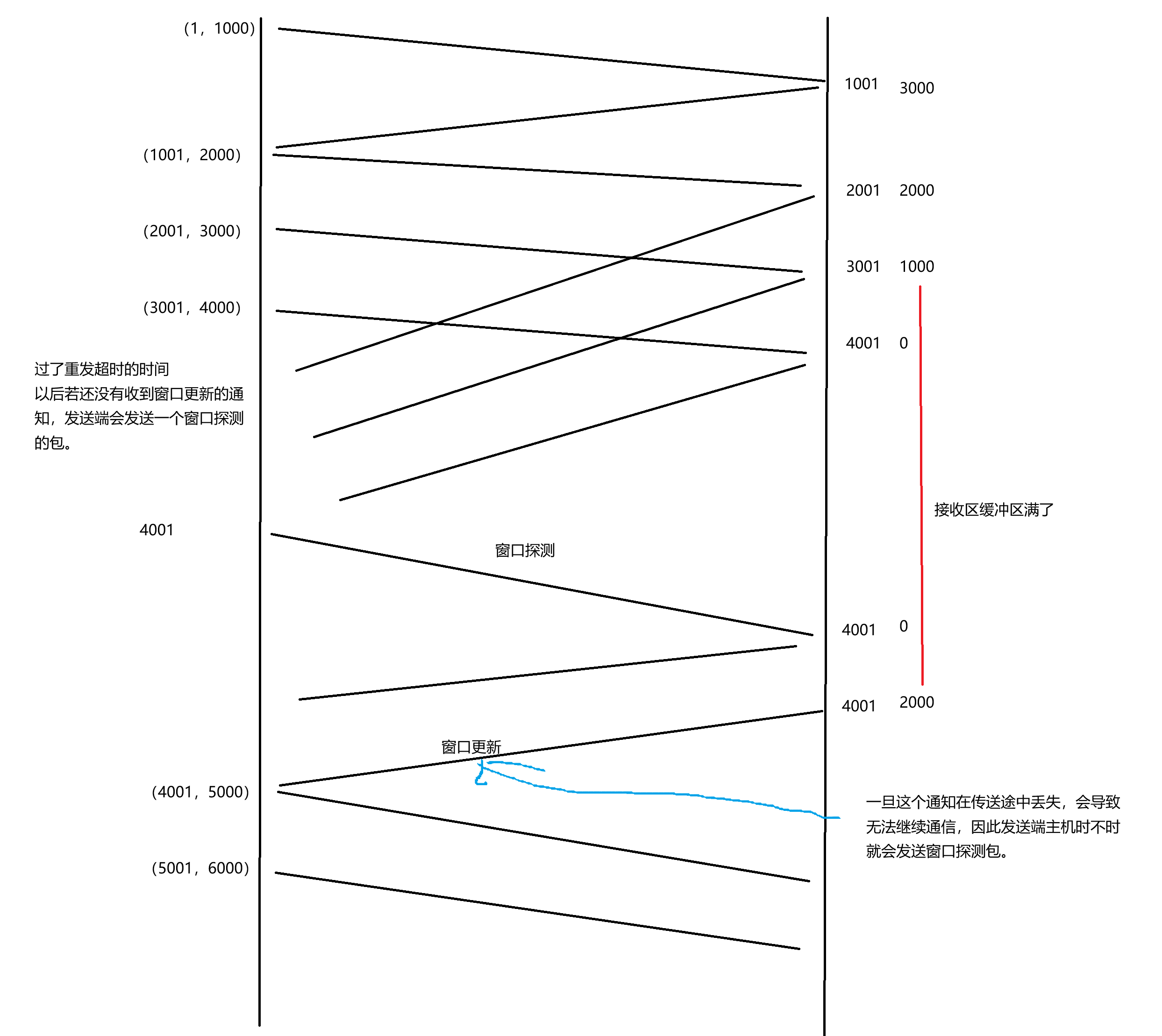

流量控制

接收端处理数据的速度是有限的. 如果发送端发的太快, 导致接收端的缓冲区被打满, 这个时候如果发送端继续发送, 就会造成丢包, 继而引起丢包重传等等一系列连锁反应.

因此TCP支持根据接收端的处理能力, 来决定发送端的发送速度. 这个机制就叫做流量控制(Flow Control);

接收端将自己可以接收的缓冲区剩余空间大小放入 TCP 首部中的 "窗口大小" 字段, 通过ACK端通知发送端;

窗口大小字段越大, 说明网络的吞吐量越高;

接收端一旦发现自己的缓冲区快满了, 就会将窗口大小设置成一个更小的值通知给发送端;

发送端接受到这个窗口之后, 就会减慢自己的发送速度;

如果接收端缓冲区满了, 就会将窗口置为0; 这时发送方不再发送数据, 但是需要定期发送一个窗口探测数据段, 使接收端把窗口大小告诉发送端.

接收端如何把窗口大小告诉发送端呢? 在我们TCP协议格式中, 有一个16位窗口字段, 就是存放了窗口大小信息;

那么问题来了, 16位数字最大表示65535, 那么TCP窗口最大就是65535字节么? 实际上, TCP首部40字节选项中还包含了一个窗口扩大因子M, 实际窗口大小是 窗口字段的值左移 M 位;

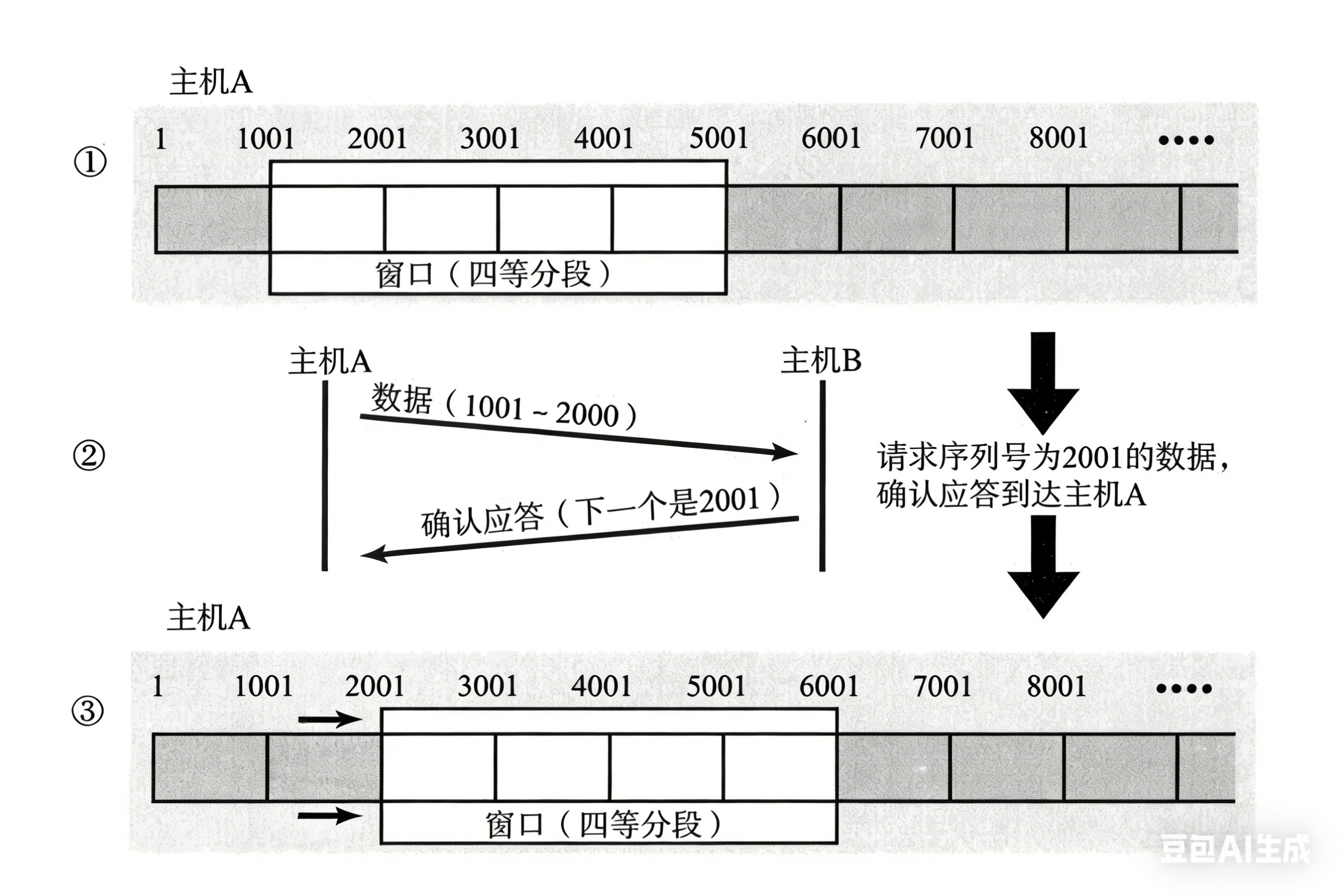

滑动窗口

应用场景

滑动窗口贯穿于每一个TCP连接的整个生命周期,只要双方在收发数据,滑动窗口就在工作。但以下几个典型场景最能体现它的价值:

-

高带宽、高延迟网络 (如跨大洋光纤、卫星链路、5G)

如果采用"发送一个包,等ACK再发下一个"(停等协议),带宽利用率极低。滑动窗口允许发送方连续发出大量数据,填满整个带宽-delay乘积管道。

-

接收方处理速度慢于发送方 (如嵌入式设备、手机、数据库服务器)

接收方通过通告窗口大小告诉发送方"我还能收多少",防止发送方把接收方缓冲区撑爆。

-

网络拥塞 (路由器队列堆积、丢包)

滑动窗口配合拥塞控制(慢启动、拥塞避免、快速重传/恢复),动态调整发送速率,避免加剧拥塞。

-

可靠传输与乱序重排

滑动窗口使得接收方可以暂存不连续的段,待缺失部分到达后按序递交应用层,避免了因乱序而丢包重传。

一句话总结:任何时候两个主机通过TCP交换数据,滑动窗口都在后台默默工作,它是TCP"可靠+高效"的基石。

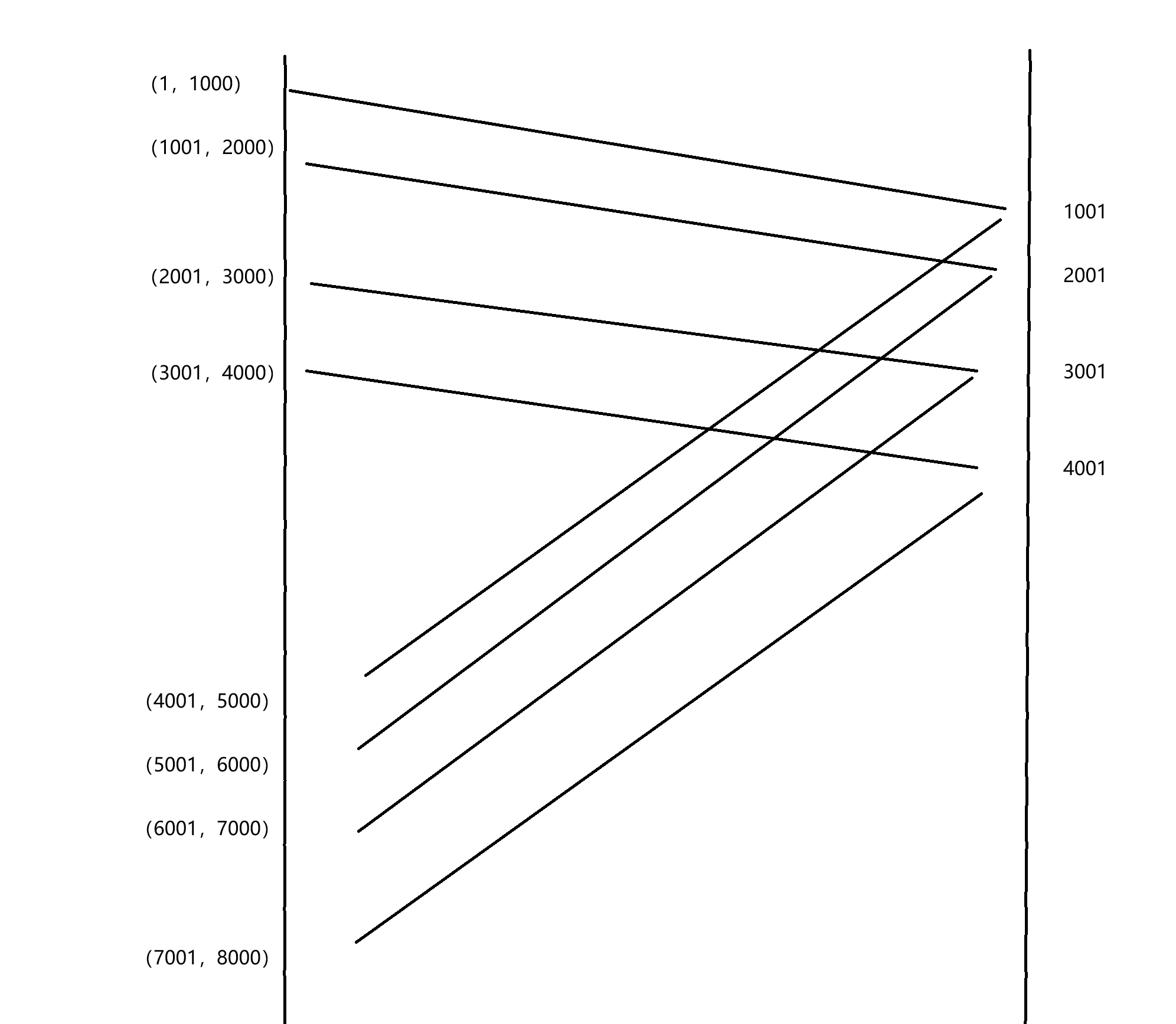

工作流程

正常的工作流程:

最开始的时候,滑动窗口的大小应该怎么确定?

滑动窗口 = min (ACK-win, 真实发送的数据量)

start_win=0, end_win=ACK_WIN

start_win = 2001

end_win = start_win + ACK_WIN;

异常工作过程? (细节)

最左侧丢失

start_win = 1001, end_win = start_win + ACK_WIN

快重传或者超时重传做补发

中间丢失

start_win = 3001

end_win =start_win + ACK_WIN;

右侧同中间丢失

总结:

确认序号的定义,为什么是这个样子??

XXX序号之前的报文,已经全部收到了?

为了支持滑动窗口左倾下移,不会跳过任何没有经过确认的报文

这样的报文要临时保存起来??保存在哪里??在滑动窗口内部

滑动窗口数据区域被划分到左侧,本质就是删除 数据!!

窗口大小 指的是无需等待确认应答而可以继续发送数据的最大值. 上图的窗口大小就是4000个字节(四个段).

发送前四个段的时候, 不需要等待任何ACK, 直接发送;

收到第一个ACK后, 滑动窗口向后移动, 继续发送第五个段的数据; 依次类推;

操作系统内核为了维护这个滑动窗口, 需要开辟 发送缓冲区 来记录当前还有哪些数据没有应答; 只有确认应答过的数据, 才能从缓冲区删掉;

窗口越大, 则网络的吞吐率就越高;

但是如果丢包了怎么重传呢?

1、数据包抵达,ACK丢了

根据ACK重新补发

2、数据包没有抵达

快速重传机制。

当某一段报文段丢失之后, 发送端会一直收到 1001 这样的ACK, 就像是在提醒发送端 "我想要的是"1001" 一样;

如果发送端主机连续三次收到了同样一个 "1001" 这样的应答, 就会将对应的数据 1001 - 2000 重新发送;

这个时候接收端收到了 1001 之后, 再次返回的ACK就是7001了(因为2001 - 7000)接收端其实之前就已经收到了, 被放到了接收端操作系统内核的接收缓冲区中;

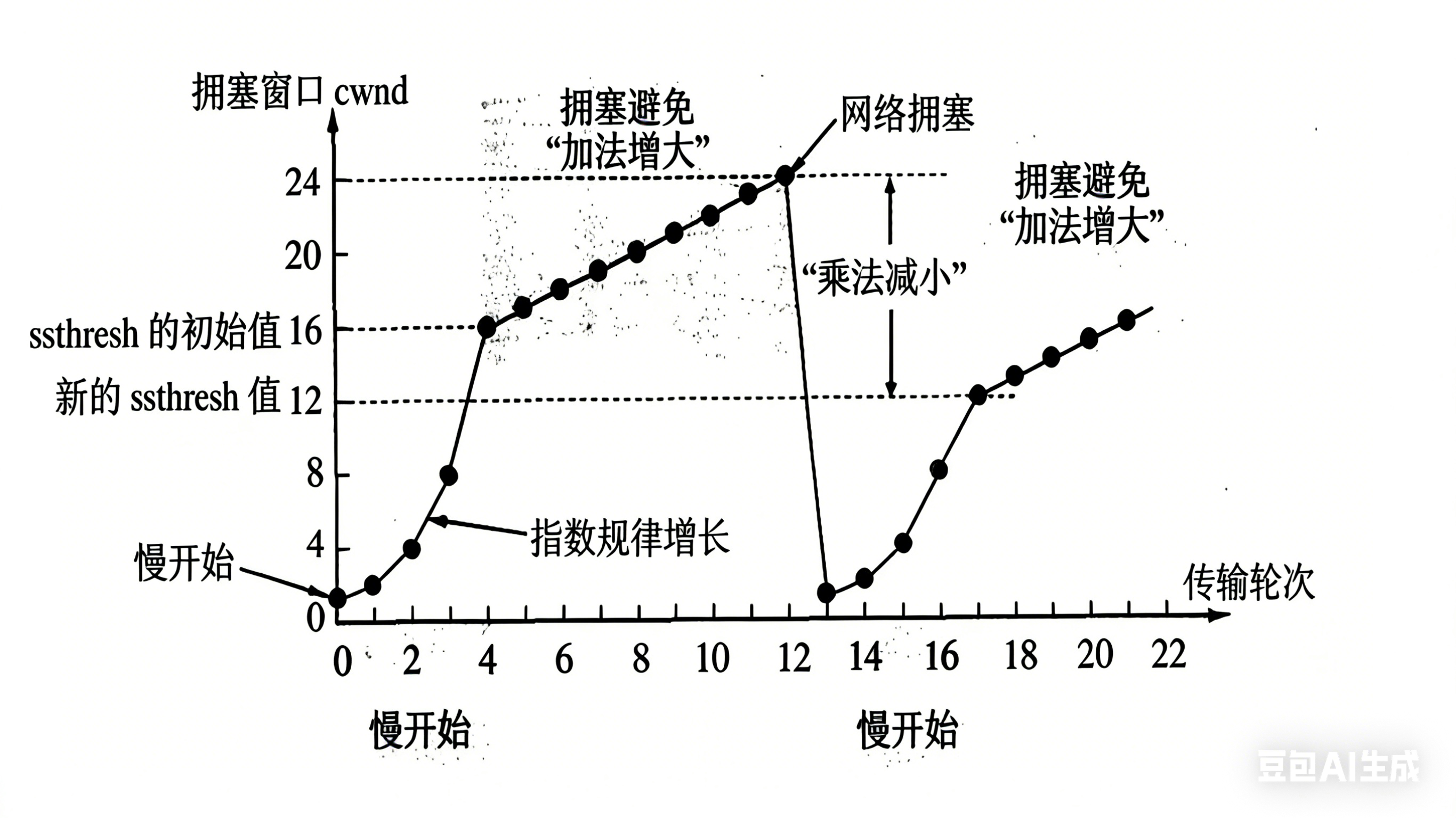

拥塞控制

虽然TCP有滑动窗口可以控制流量,但是当一个时间段内有多个主机通信的时候,网络状态比较拥堵时,发送大量的数据是很不可靠的。

因此TCP有一个名为慢启动的机制,先少量传输测试网速,随后调整网速大量数据传输。

慢启动有一个名为拥塞窗口的存在。发送时,初始定义其为1,它的机制是这样的:

1、每次收到一个ACK应答, 拥塞窗口加1;

2、每次发送数据包的时候, 将拥塞窗口和接收端主机反馈的窗口大小做比较, 取较小的值作为实际发送的窗口;

像上面这样的拥塞窗口增长速度, 是指数级别的. "慢启动" 只是指初始时慢, 但是增长速度非常快。为了不增长的那么快, 因此不能使拥塞窗口单纯的加倍,因此引入一个叫做慢启动的阈值,当拥塞窗口超过这个阈值的时候, 不再按照指数方式增长, 而是按照线性方式增长;当TCP开始启动的时候, 慢启动阈值等于窗口最大值;在每次超时重发的时候, 慢启动阈值会变成原来的一半, 同时拥塞窗口置回1;少量的丢包, 我们仅仅是触发超时重传; 大量的丢包, 我们就认为网络拥塞;

就像下图一样

当TCP通信开始后, 网络吞吐量会逐渐上升; 随着网络发生拥堵, 吞吐量会立刻下降;

拥塞控制, 归根结底是TCP协议想尽可能快的把数据传输给对方, 但是又要避免给网络造成太大压力的折中方案.

那么这样一来TCP有三个窗口了------------窗口大小、滑动窗口、拥塞窗口。那么三者之间的关系是什么呢?

滑动窗口=min(窗口大小,拥塞窗口)

延迟应答

为什么要有延迟应答?

TCP 是面向连接的可靠字节流协议,核心规则是:接收方每收到一个 TCP 数据段,必须回一个 ACK 确认报文,告诉发送方「我已经收到了哪个序号之前的数据,你可以继续发后面的了」。

但如果严格执行「来一个包,立刻回一个 ACK」,会出现一个致命的效率问题:

-

纯 ACK 报文只有 40 字节(20 字节 IP 头 + 20 字节 TCP 头),没有任何业务数据,属于纯协议开销;

-

交互式场景(SSH/Telnet、IM 聊天、RPC 调用、HTTP 长连接)下,大量小包交互会产生海量纯 ACK 包 ------ 比如你在 SSH 里敲一个字符,客户端发 1 个带数据的小包,服务端回 1 个纯 ACK,服务端再发 1 个回显的小包,客户端再回 1 个纯 ACK,4 个包里 2 个是纯开销;

-

海量小包会直接打满网络设备的 PPS 上限,防火墙、路由器的 CPU 会被中断占满,转发性能断崖式下跌,这是我们做运营商骨干网、IDC 核心网时,最头疼的问题之一。

延迟应答,就是为了解决这个问题而生的。

延迟应答的核心工作机制(RFC 1122 标准 + 工程实现)

一句话定义:TCP 接收方收到数据后,不立刻回 ACK,而是开启一个定时器,等待一个极短的时间窗口,再决定怎么发 ACK。

核心规则(所有商用操作系统 Linux/Windows/FreeBSD 均严格遵循):

-

超时兜底必发 :定时器超时必须回 ACK,RFC 标准规定超时上限不得超过 500ms,业界通用实现是默认 40ms~200ms(Linux 默认最小 40ms,最大 200ms;Windows 默认 200ms),绝对不会无限等待。

-

累计确认提前发 :等待窗口内,如果收到了第二个满 MSS(最大段长度)的数据包,立刻回 ACK,无需等待超时 ------ 也就是业界常说的「每隔一个包回一个 ACK」,这是默认场景下最常用的触发方式,直接把 ACK 包数量减半。

-

特殊场景强制禁用:以下情况绝对不会走延迟应答,必须立刻回 ACK,这是协议栈的硬规则,也是很多人忽略的工程细节:

-

收到乱序包、重复包,需要立刻回 ACK 触发快速重传,避免发送方超时重传;

-

收到 FIN、RST 报文,必须立刻确认,完成连接关闭流程;

-

开启了 TCP_QUICKACK 套接字选项的连接,强制关闭延迟应答。

-

延迟应答的经典踩坑(20 年一线经验,90% 的人都栽过)

最致命的坑:延迟应答 + Nagle 算法的联动死锁。

-

Nagle 算法是发送方的机制,核心规则是:只要链路上还有未被确认的、小于 MSS 的小包,就不能再发新的小包,必须等 ACK 回来。

-

死锁场景:发送方开启 Nagle,发了一个 100 字节的小包,停住等 ACK;接收方开启延迟应答,既没收到第二个满 MSS 包,也没有数据要回发,只能等 200ms 超时才回 ACK。

-

结果:本来几毫秒就能完成的交互,硬生生卡了 200ms,这个问题在 HTTP 接口、小程序请求、游戏 TCP 交互中高频出现,很多人找不到根因,就是这两个机制的冲突。

解决方案:小包低时延交互场景,二者必须关一个------ 要么发送方开 TCP_NODELAY 禁用 Nagle,要么接收方开 TCP_QUICKACK 禁用延迟应答,绝对不能两个同时开。

捎带应答

为什么要有捎带应答?

TCP 从设计之初就是全双工协议,同一个 TCP 连接里,双方可以同时向对方发送数据,TCP 报文头里,永远带着 ACK 确认号、窗口大小这些接收端的控制信息 ------ 不管这个报文有没有带业务数据。

那问题来了:接收方收到数据后,正好要给对方发业务数据,为什么还要单独发一个纯 ACK 包?直接把 ACK 信息写到待发送的业务报文的 TCP 头里,一起发过去不就行了?

这就是捎带应答的核心逻辑:把 ACK 确认信息「搭便车」到反向的业务数据报文中,完全消除纯 ACK 包的协议开销,比延迟应答的效率提升更极致。

捎带应答的核心工作机制(RFC 793 原生定义)

一句话定义:全双工 TCP 通信中,接收方将对收到数据的 ACK 确认信息,复用在反向发送给对端的业务数据报文的 TCP 头部中,无需单独发送纯 ACK 报文。

核心规则与触发条件:

-

前提是全双工双向流量:只有接收方在收到数据后,短时间内有反向业务数据要发给对端,才能触发捎带应答 ------ 单向流量场景(文件下载、视频直播、单向数据采集),接收方只有 ACK 要发,没有反向数据,永远触发不了捎带应答。

-

依赖延迟应答的时间窗口:如果收到数据立刻回 ACK,根本等不到上层应用生成反向业务数据的时机,正是延迟应答的 40~200ms 等待窗口,给了捎带应答唯一的触发机会 ------ 这就是二者强绑定的核心原因。

-

不改变 ACK 的核心语义:捎带的 ACK 号,必须是当前接收方已经连续收到的最大字节序号,和单独发的纯 ACK 报文的确认语义完全一致,不会影响 TCP 的可靠性。

-

优先级低于超时兜底:如果延迟应答的定时器即将超时,还没有等到反向业务数据,必须立刻发送纯 ACK 报文,不能为了等捎带而超时,影响发送方的滑动窗口和重传机制。

举个最直观的实战例子(SSH 会话)

-

你在 SSH 客户端敲了一个字符

a,客户端发送 1 个带a的 TCP 数据报文给服务端; -

服务端收到后,开启延迟应答定时器(200ms),不立刻回纯 ACK;

-

同时,服务端的 SSH 进程需要给客户端回显字符

a,正好有反向业务数据要发送; -

服务端 TCP 协议栈直接把对

a的 ACK 确认号,写到回显报文的 TCP 头部,把「回显数据 + ACK 确认」合并成 1 个报文发给客户端; -

最终结果:本来需要 4 个报文完成的交互,现在只需要 2 个,完全消除了 2 个纯 ACK 包,协议开销直接减半,这就是延迟应答 + 捎带应答的黄金组合效果。

| 维度 | 延迟应答(Delayed ACK) | 捎带应答(Piggybacking ACK) |

|---|---|---|

| 核心本质 | ACK 报文的发送时机策略 | ACK 信息的承载复用方式 |

| 设计目标 | 减少纯 ACK 包的数量,降低小包开销 | 完全消除纯 ACK 包,极致压缩协议开销 |

| 触发前提 | 任何 TCP 场景均可生效,无需反向流量 | 必须是全双工双向流量,有反向业务数据要发送 |

| 依赖关系 | 独立存在,无需依赖捎带应答 | 必须依赖延迟应答的时间窗口,否则无触发机会 |

| 协议标准 | RFC 1122 补充定义 | RFC 793 TCP 原生定义 |

| 失败兜底 | 超时必发纯 ACK 报文 | 超时则退化为延迟应答的纯 ACK 发送 |

面向字节流

本质定义(RFC 793 原生规范 + 内核实现视角)

TCP 是面向连接的、可靠的、全双工的字节流传输协议 ,这里的「面向字节流」,是整个 TCP 协议的设计基石,一句话讲透核心:TCP 完全不感知、不维护应用层的报文边界,只把应用层交付的数据,当成一串无结构、连续有序的字节流来处理;它只保证字节的按序、无差错、不重复、不丢失,绝对不保证「发送方一次 send 调用,对应接收方一次 recv 调用」。

与之形成本质区别的,就是 UDP------UDP 是面向报文的,发送方一次 send 对应一个 UDP 报文,接收方一次 recv 只能拿到一个完整的 UDP 报文,报文边界被协议层严格保留,多一个字节少一个字节都收不到。

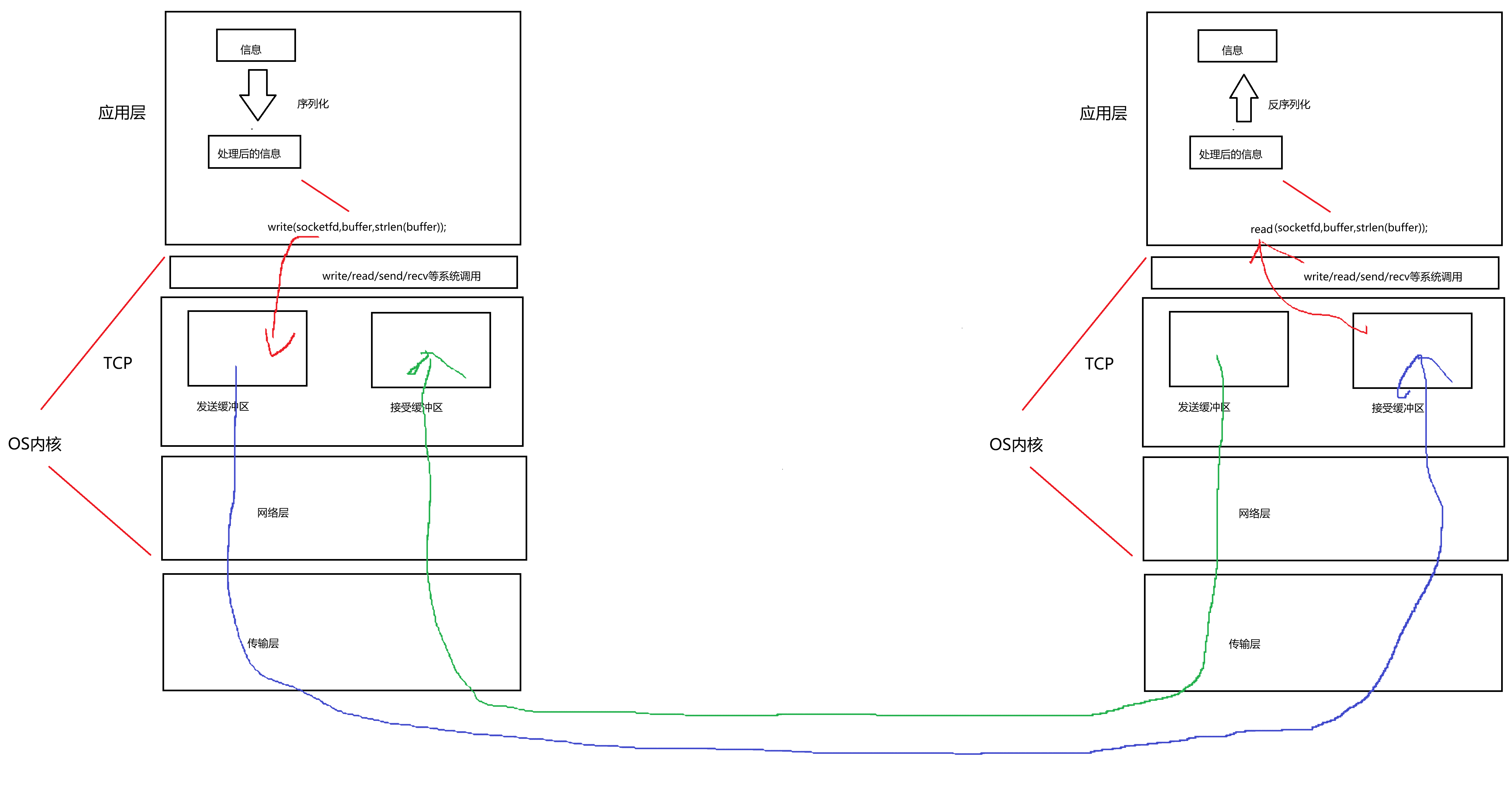

从内核协议栈实现,看懂字节流的完整流转

很多人对字节流的理解只停留在定义上,只有看懂发送、接收两端的内核处理流程,才能真正理解为什么会有后续的粘包问题,这也是一线排障的核心逻辑。

发送端的字节流处理逻辑

应用层调用send函数,绝对不是直接把数据发到网络上 ,而是完成了一件事:把用户态的业务数据,拷贝到内核态的 **TCP 发送缓冲区(SND_BUF)** 里,send调用就返回了。

至于这些数据什么时候发、一次发多少字节,完全由 TCP 内核协议栈决定,它会综合滑动窗口大小、MSS(最大段长度)、拥塞控制算法、Nagle 算法、延迟应答机制,对缓冲区里的字节流做任意的拆分与合并:

- 你一次

send了 2000 字节,若当前 MSS 是 1460 字节,TCP 会直接拆成 2 个 TCP 报文(1460 字节 + 540 字节)分开发送; - 你连续两次

send,分别发了 500 字节,TCP 可能会把这 1000 字节合并成一个 TCP 报文,一次性发送出去。

TCP 只关心字节的序号,不关心你应用层调用了几次send,也不关心你的业务报文边界在哪里。

接收端的字节流处理逻辑

TCP 从网络上收到报文后,会先校验报文合法性,再按序号重排,剔除重复包,处理乱序包,最终把连续有序的字节流,写入内核态的 TCP 接收缓冲区(RCV_BUF)。

应用层调用recv函数,也不是直接从网络上收包,而是从接收缓冲区里,按指定的长度读取字节流:

- 发送端分 2 次

send的 500 字节,被 TCP 合并成 1 个报文发送,接收端recv(1024)会一次性把 1000 字节全部取走,完全感知不到原来的 2 次业务调用; - 发送端 1 次

send的 2000 字节,被拆成 2 个报文发送,接收端可能先收到 1460 字节,调用recv就会先拿到这 1460 字节,剩下的 540 字节,等第二个报文到达后,下一次recv才能拿到。

TCP 只保证给应用层交付连续有序的字节,不保证交付的字节块,和发送端的业务报文一一对应。

从业 20 年见过的 3 个致命认知误区

这些误区,是 90% 的 TCP 业务故障的根源,必须彻底纠正:

- 误区 1:PSH 标志能解决报文边界问题 很多人以为给 TCP 报文加 PSH 标志,就能让接收端一次收到完整的业务报文,这是完全错误的。PSH 标志的唯一作用,是告诉接收端内核:「把缓冲区里现有数据立刻推送给应用层,不要等缓冲区满了再推」,它完全不改变 TCP 的字节流本质,也不会保留任何业务报文边界,只能缓解接收延迟,根本解决不了边界问题。

- 误区 2:关闭 Nagle 算法就能避免字节流合并 关闭 Nagle 算法,只能让发送端尽量做到一次

send对应一个 TCP 报文,但它改变不了接收端的字节流处理逻辑 ------ 接收端的缓冲区依然会把多个 TCP 报文的字节流累计在一起,应用层一次recv依然会拿到多个业务报文的数据,治标不治本。 - 误区 3:TCP 的 MSS 边界就是业务报文边界MSS 是 TCP 单次传输的最大段长度,是以太网 MTU 限制的结果,和应用层业务报文没有任何关联。协议栈会根据链路情况、窗口大小,随时调整单次发送的字节数,永远不要指望 MSS 来帮你划分业务报文。

TCP粘包问题

定义

所谓的「粘包」,根本不是 TCP 协议的 bug,而是应用层没有正确适配 TCP 的字节流特性,没有自主定义业务报文边界,导致接收方无法区分两个独立的业务报文,出现多个报文粘在一起读取,或者一个报文被拆成多段读取的异常现象。

行业里常说的「半包」,本质和粘包是同一个问题,都是业务报文边界识别失败,只是表现形式不同:粘包是一次读到了多个完整报文,半包是一次只读到了一个报文的一部分。

粘包 / 半包的核心成因(分发送端、接收端双视角)

发送端触发粘包的核心原因

-

Nagle 算法的字节合并 :Nagle 算法会强制合并链路上未被确认的小包,连续多次的小数据

send,会被合并成一个 TCP 报文发送,直接导致多个业务报文粘在同一个 TCP 报文中。 -

发送缓冲区的批量发送 :应用层多次

send的数据,都堆积在发送缓冲区中,TCP 协议栈根据滑动窗口的可用大小,一次性取出多个业务报文的数据,打包成一个 TCP 报文发送。 -

MSS 限制的报文拆分 :单次

send的业务报文长度超过 MSS,TCP 会强制将其拆分成多个 TCP 报文发送,接收端就会出现「一个业务报文被拆成多次接收」的半包问题。

接收端触发粘包的核心原因

-

接收缓冲区的字节累计 :TCP 收到的多个 TCP 报文,都会按序写入接收缓冲区,形成连续的字节流。应用层调用

recv时,会按指定长度读取缓冲区里的所有可用字节,一次性读取到多个业务报文的内容,直接触发粘包。 -

延迟应答的累计效应:之前讲过的延迟应答机制,接收端会累计收到 2 个满 MSS 报文后才回 ACK,这个过程中缓冲区会累计多个报文的字节流,进一步加剧粘包的概率。

-

应用层读取不及时 :应用层读取速度跟不上 TCP 的接收速度,接收缓冲区会堆积多个业务报文的字节流,后续

recv必然会一次性读取到多个粘在一起的报文。

粘包问题的解决方案

核心原则:TCP 协议层永远不会帮你维护业务报文边界,所有试图在 TCP 层解决粘包的方案,都只能缓解,无法根治。唯一的终极解决方案,是应用层自主定义清晰的报文边界。

从业 20 年,我见过所有稳定的 TCP 业务协议,无外乎以下 3 种边界定义方案,各有适用场景,踩坑点我也一并讲透:

方案 1:固定报文头 + 变长报文体

-

实现逻辑:每个业务报文,都由「固定长度的报文头」+「变长的报文体」组成。报文头里必须包含一个明确的字段,标注本次报文体的总字节长度。接收端先读取固定长度的报文头,解析出报文体长度,再严格按照长度读取完整的报文体。

-

典型案例 :HTTP 协议的

Content-Length字段、MySQL/Redis 私有协议、各类 RPC 框架协议,全都是这个逻辑。 -

核心优势:适配任意长度的业务报文,性能高、容错性强,既可以解决粘包,也可以完美处理半包问题,是唯一能适配二进制数据、大文件传输、高并发场景的方案。

-

一线踩坑提醒 :必须处理半包场景,不能指望一次

recv就能收满固定长度的报文头,也不能指望一次recv就能收满指定长度的报文体,必须循环读取,直到收满目标字节数,这是开发最容易忽略的点。

方案 2:特殊分隔符方案

-

实现逻辑:在每个业务报文的结尾,添加一个独一无二、绝对不会出现在报文内容里的特殊分隔符,接收端按分隔符对字节流进行切分,拆分出独立的业务报文。

-

典型案例 :HTTP 头部的

\r\n分隔符、FTP/SMTP 等应用层协议、文本类 IM 消息、日志上报场景。 -

核心优势:实现简单,无需提前预知报文长度,适配行式文本交互场景。

-

一线踩坑提醒:

-

必须保证分隔符绝对不会出现在报文内容中,否则会出现报文切分错误,导致数据错乱;

-

绝对不能用于二进制数据传输,二进制数据中可能出现任意字节序列,无法保证分隔符的唯一性;

-

接收端必须做字节流的缓存和逐字节扫描,性能远低于长度前缀方案,高并发场景慎用。

-

方案 3:固定长度报文方案

-

实现逻辑:所有业务报文的长度完全固定,比如固定 128 字节,不足长度的用填充位补齐,接收端每次严格读取固定长度的字节,就是一个完整的业务报文。

-

适用场景:仅适用于工控、电力、金融交易等报文格式永远固定、长度永远不变的极简场景。

-

核心劣势:灵活性极差,报文长度不足会浪费带宽,超过固定长度需要额外拆分,现在除了 legacy 老旧系统,几乎没有新业务会采用。

-

一线踩坑提醒:哪怕是固定长度,依然要处理 TCP 拆包导致的半包问题,必须循环读取,直到收满固定长度的字节。

TCP生命周期与异常

TCP 连接建立异常(三次握手阶段)

| 异常场景 | 核心现象 | 根因分析 | 一线排查要点 |

|---|---|---|---|

| SYN 超时(连接超时) | 客户端发送 SYN 包,无 SYN+ACK 返回,重试后超时,报connect timeout |

1. 网络链路:路由不可达、中间防火墙 / ACL 拦截 SYN 包、专线中断;2. 服务端:未监听对应端口、backlog 全连接队列满,内核丢弃 SYN;3. 安全策略:安全组 / WAF 拦截客户端 IP / 端口 | 先 telnet 端口验证连通性;服务端抓包看是否收到 SYN;收到未回则查 backlog 队列、防火墙规则;未收到则逐跳查链路 |

| SYN+ACK 超时 | 服务端收到 SYN 并回 SYN+ACK,无客户端 ACK 返回,连接卡在SYN_RECV状态 |

1. 客户端 ACK 包被中间链路丢弃;2. 客户端收到 SYN+ACK 但校验不通过 / 序号非法,内核丢弃不回 ACK;3. NAT 环境下源端口映射失效,SYN+ACK 无法到达客户端 | 查看服务端SYN_RECV连接数;抓包看客户端是否收到 SYN+ACK、是否回 ACK;检查 NAT 会话、客户端防火墙规则 |

| 三次握手阶段 RST 复位 | 客户端发 SYN 后立刻收到 RST,报connection refused |

99% 是服务端未监听对应端口,内核收到 SYN 直接回 RST;剩余 1% 是防火墙主动回 RST 拦截、backlog 队列满直接回 RST | 优先用ss/netstat查看服务端端口监听状态;再查防火墙 / 安全组拦截规则 |

TCP 数据传输阶段异常(ESTABLISHED 状态)

-

TCP 重传异常

- 现象:报文丢失导致发送方超时重传,重传次数超过内核阈值后连接断开;或频繁重传导致吞吐暴跌、时延飙升。

- 根因:物理链路错包 / 丢包、交换机 / 路由器 PPS 打满缓冲区溢出、QoS 限速丢包、MTU 设置不当导致 IP 分片丢包、服务器 CPU / 内存打满 / 网卡 Ring Buffer 满导致内核丢包。

- 排查要点:抓包定位重传方向;用 mtr/tracepath 查链路丢包率;查看服务器网卡丢包计数、CPU 负载、内核缓冲区参数。

-

零窗口(Zero Window)异常

- 现象:接收方回送的 TCP 窗口大小为 0,发送方停止数据传输,业务卡住、接口超时。

- 根因:接收方应用层读取数据速度远低于 TCP 接收速度,接收缓冲区被占满,内核通知发送方暂停发送。典型场景是应用进程卡死、CPU/IO 阻塞,无法调用

recv读取缓冲区数据。 - 排查要点:抓包定位零窗口发送端;查看对应服务器应用进程状态、CPU/IO 负载;优化应用层读取逻辑,调整 TCP 接收缓冲区大小。

-

保活探测(Keepalive)失败异常

- 现象:TCP 连接处于

ESTABLISHED状态,但实际链路已不通,业务发送数据超时,保活探测失败后内核断开连接。 - 根因:中间防火墙 / NAT 设备的 TCP 会话老化时间,短于 TCP Keepalive 探测间隔,会话条目被删除,报文被丢弃;链路中断后无数据交互,两端无法感知连接失效。

- 排查要点:调整 TCP Keepalive 参数,将探测间隔调至小于中间设备的会话老化时间(Linux 默认 2 小时,绝大多数防火墙老化时间为 30 分钟,建议调至 10 分钟以内)。

- 现象:TCP 连接处于

-

乱序与重复包异常

- 现象:报文序号乱序、重复包频繁出现,接收方持续回重复 ACK,触发快速重传,传输效率暴跌。

- 根因:ECMP / 链路聚合采用基于包的负载均衡,同一条 TCP 流的报文走不同链路,时延差异导致乱序;防火墙 / IPS 会话保持失效,报文转发顺序错乱。

- 排查要点:抓包查看报文序号连续性;检查负载均衡配置,改为基于五元组的流转发,禁止同一条流的报文散列到不同链路。

TCP 连接关闭异常(四次挥手阶段)

-

CLOSE_WAIT 状态堆积异常

- 现象:服务器出现大量

CLOSE_WAIT状态的连接,长期不释放,最终占满文件描述符,新连接无法建立。 - 根因:100% 是应用层代码 bug 。被动关闭端收到对端的 FIN,内核回 ACK 进入

CLOSE_WAIT状态,等待应用层调用close关闭连接,但应用层因逻辑漏洞、异常分支未处理,没有调用close,导致连接永远卡在该状态。 - 排查要点:无需排查网络,直接定位应用代码,检查连接关闭逻辑、异常处理分支,确认是否存在 socket 句柄泄漏。

- 现象:服务器出现大量

-

TIME_WAIT 状态堆积异常

- 现象:服务器出现大量

TIME_WAIT连接,占满内核连接跟踪表、端口耗尽,新连接建立失败。 - 根因:TCP 主动关闭端在四次挥手完成后,会进入

TIME_WAIT状态等待 2MSL(默认 120 秒),HTTP 短连接等高并发短连接场景,会快速产生大量该状态连接。 - 优化方案:开启

tcp_tw_reuse(安全可控,业界推荐),允许将 TIME_WAIT 端口复用给新连接;调小tcp_max_tw_buckets限制最大数量;尽量让客户端主动关闭连接,避免服务端成为 TIME_WAIT 堆积端。 - 致命踩坑提醒:绝对不要开启

tcp_tw_recycle参数,该参数在 NAT 环境下会导致大量连接失败,是无数线上故障的根源。

- 现象:服务器出现大量

-

传输 / 关闭阶段异常 RST 复位

- 现象:连接处于

ESTABLISHED状态,无正常四次挥手,直接收到 RST 包,连接强制断开,报connection reset by peer。 - 根因:对端应用进程崩溃 / 被强制终止,内核给对应 TCP 连接发送 RST;中间防火墙 / WAF 检测到异常流量,主动发送 RST 断开连接;一端已关闭连接,另一端仍在发送数据,收到 RST 复位。

- 排查要点:抓包定位 RST 发送端;查看对应端应用进程日志、崩溃记录;检查中间安全设备的拦截日志。

- 现象:连接处于

-

连接假死异常

- 现象:TCP 连接两端均显示

ESTABLISHED状态,但业务数据无法收发,连接完全卡死。 - 根因:中间链路中断、防火墙会话老化、NAT 条目删除,两端无数据交互、未开启 Keepalive,无法感知连接失效,一直保持 ESTABLISHED 状态。

- 排查要点:开启 TCP Keepalive 保活机制;业务层必须自主实现应用心跳,不能仅依赖 TCP 层保活。

- 现象:TCP 连接两端均显示

TCP/UDP对比

我们知道TCP是可靠连接, 那么是不是TCP一定就优于UDP呢? 并不是这样的,TCP和UDP之间的优点和缺点, 不能简单, 绝对的进行比较

TCP用于可靠传输的情况, 应用于文件传输, 重要状态更新等场景;

UDP用于对高速传输和实时性要求较高的通信领域, 例如, 早期的QQ, 视频传输等. 另外UDP可以用于广播;

归根结底, TCP和UDP都是程序员的工具, 什么时机用, 具体怎么用, 还是要根据具体的需求场景去判定,不能依据简单的断定其优劣

TCP总结

TCP 可靠性的核心保障机制

核心总定调:TCP 的可靠性,本质是端到端保障字节流的「按序、无差错、不丢失、不重复、不溢出」,所有机制围绕这个核心目标设计,按优先级从核心基石到兜底补充排序如下:

-

面向连接的生命周期管理(三次握手 + 四次挥手)

- 核心原理:三次握手同步双方随机初始序列号 ISN,双向验证收发能力,建立合法全双工连接,避免无效连接、历史脏报文干扰;四次挥手双向确认数据传输完成,优雅释放连接,确保收尾数据不丢失。

- 解决问题:从连接源头规避非法数据、无效传输,保障传输上下文的合法性与完整性。

-

字节流编号与累计确认机制(可靠性核心基石)

- 核心原理:TCP 为传输的每一个字节分配唯一的 32 位序列号,接收方仅对连续、无差错接收的最大字节序号返回 ACK 确认;发送方收到 ACK,即可确认该序号之前的所有字节均被正确接收,哪怕中间 ACK 丢失,后续更高序号的 ACK 也能完成兜底确认。

- 解决问题:实现字节的有序传输、重复数据过滤,为丢包判断、重传提供核心依据,是所有可靠性机制的基础。

-

超时重传机制(RTO,丢包兜底核心)

- 核心原理:发送方发送数据后,启动基于往返时延 RTT 动态计算的重传定时器 RTO;若超时未收到对应 ACK,无条件重传未被确认的数据,RTO 会随重传次数指数退避,避免网络过载。

- 解决问题:兜底处理链路丢包、ACK 丢失、报文被丢弃的场景,保障数据最终必达。

-

快速重传机制(丢包快速恢复)

- 核心原理:接收方收到乱序报文时,立即重复发送缺失报文序号的 ACK;发送方连续收到 3 个重复 ACK,无需等待 RTO 超时,立即重传缺失的报文段。

- 解决问题:大幅缩短丢包后的恢复时延,避免超时等待导致的业务卡顿,同时减少不必要的重传。

-

端到端流量控制(滑动窗口,接收端防溢出)

- 核心原理:接收方通过 TCP 头部的 16 位窗口字段,实时告知发送方自身接收缓冲区的可用大小;发送方严格控制未确认数据量不超过接收窗口上限,绝对不会超出接收方的处理能力。

- 解决问题:从根源避免接收方缓冲区溢出导致的数据丢失,实现收发双方的速率匹配,保障端到端传输的稳定性。

-

网络拥塞控制(网络层面防丢包)

- 核心原理:通过慢启动、拥塞避免、快速恢复、快速重传四大基础算法,以及 CUBIC/BBR 等现代演进算法,动态调整拥塞窗口 cwnd,控制发送速率,避免网络链路过载、路由器缓冲区溢出导致的大规模丢包。

- 解决问题:保障网络层面的传输稳定性,避免因网络拥塞引发的大面积数据丢失,同时兼顾网络公平性。

-

数据完整性校验与防篡改

- 核心原理:TCP 头部强制携带 16 位校验和,覆盖 TCP 头部 + 全部数据载荷,接收方校验失败直接丢弃报文,不返回 ACK,触发重传;同时支持 RFC 2385 MD5 认证选项,防止报文被恶意篡改。

- 解决问题:保障传输数据的完整性,避免错包、篡改数据被交付给应用层。

-

保活探测机制(Keepalive,死连接兜底)

- 核心原理:长时间无数据交互的空闲连接,按配置间隔发送保活探测包,若连续多次探测无响应,判定对端已失效,主动断开连接。

- 解决问题:检测并清理无效死连接,避免业务在失效连接上发送数据导致的丢失,同时释放系统资源。

TCP 性能提升的核心机制

核心总定调:TCP 的性能优化,本质是在保障可靠性的前提下,最大化链路带宽利用率、降低传输时延、减少协议开销、适配复杂网络环境,所有机制均围绕这个目标设计,按核心程度排序如下:

-

滑动窗口连续传输机制(性能核心基石)

- 核心原理:突破停等协议「发 1 包等 1 个 ACK」的低效限制,允许发送方在未收到 ACK 的情况下,连续发送窗口大小内的多个数据包,实现流水线式传输。

- 性能收益:最大化链路的带宽利用率,彻底解决停等协议的带宽浪费问题,是 TCP 高性能传输的基础。

-

窗口缩放选项(Window Scale,长肥管道适配)

- 核心原理:RFC 1323 定义,通过 TCP 选项将 16 位窗口字段的最大取值从 65535 字节,扩展至最大 1GB,适配高带宽长 RTT 的「长肥管道」链路。

- 性能收益:解决长时延跨地域 / 跨境链路的带宽利用率瓶颈,让高速长距离链路的传输吞吐提升数十倍。

-

选择性确认(SACK,精准重传优化)

- 核心原理:RFC 2018 定义,接收方通过 TCP 选项告知发送方「已正确接收的非连续字节块」,发送方仅重传真正丢失的报文段,无需重传已收到的后续数据。

- 性能收益:彻底解决累计确认的重传冗余问题,尤其在高丢包、高带宽链路中,大幅减少无效重传,提升传输效率。

-

捎带应答(Piggybacking ACK,协议开销极致压缩)

- 核心原理:利用 TCP 全双工特性,将对收到数据的 ACK 确认信息,复用在反向业务数据报文的 TCP 头部中,无需单独发送纯 ACK 小包。

- 性能收益:完全消除纯 ACK 包的协议开销,减少网络小包数量,降低设备 PPS 压力,提升有效数据的带宽占比。

-

延迟应答(Delayed ACK,ACK 包数量压缩)

- 核心原理:接收方收到数据后不立即回 ACK,开启 40-200ms 的超时定时器,要么累计收到 2 个满 MSS 报文后批量回 ACK,要么等待反向数据触发捎带应答。

- 性能收益:将纯 ACK 包的数量最多减半,大幅降低协议开销,同时为捎带应答创造触发窗口,双向提升传输效率。

-

Nagle 算法(小包泛滥治理)

- 核心原理:禁止在链路上存在未被确认的小包时,发送新的小于 MSS 的小包,将多次小数据发送合并为一个大的 TCP 报文,减少网络中小包的数量。

- 性能收益:大幅降低 TCP 头部开销占比(极端场景下 1 字节数据对应 40 字节头部,开销占比 97.5%),缓解网络设备 PPS 压力,提升交互式场景的传输效率。

-

现代拥塞控制算法(CUBIC/BBR,网络适配优化)

- 核心原理:CUBIC(Linux 默认)基于非线性窗口增长,适配高带宽链路,兼顾公平性;BBR 基于带宽和最小 RTT 的模型驱动,不依赖丢包判断拥塞,最大化链路带宽利用率,降低传输时延。

- 性能收益:解决传统丢包驱动算法在无线、跨运营商、长肥管道链路中的带宽利用率低、时延抖动大的问题,大幅提升复杂网络环境下的传输吞吐与稳定性。

-

路径 MTU 发现(PMTUd)与 MSS 协商

- 核心原理:通过 MSS 协商匹配链路 MTU,最大化单个 TCP 报文的有效数据载荷;通过 PMTUd 自动发现路径上的最小 MTU,避免 IP 分片。

- 性能收益:减少协议头开销占比,同时避免 IP 分片引发的「一个分片丢失,整个 IP 报文全量重传」的高代价问题,大幅提升传输效率与稳定性。

-

时间戳选项(Timestamps,RTT 精准计算)

- 核心原理:RFC 1323 定义,通过 TCP 选项携带时间戳,精准计算往返时延 RTT,解决重传二义性问题,让 RTO 计算更精准;同时实现 PAWS 保护序列号绕回,支持更高传输速率。

- 性能收益:减少不必要的超时重传,提升高速网络下的传输稳定性,适配千兆 / 万兆级高速链路。

-

TCP 快速打开(TFO,短连接时延优化)

- 核心原理:RFC 7413 定义,允许在三次握手的 SYN/SYN+ACK 报文中携带业务数据,无需等待三次握手完成再传输数据,省去 1 个 RTT 的连接建立时延。

- 性能收益:大幅降低 HTTP 短连接、API 请求等短连接场景的首包时延,提升交互式业务的响应速度。

本期关于TCP协议的讲解到这里就结束了,喜欢请点个赞谢谢: