《GraphSAGE 节点嵌入在养老服务知识图谱中的实现与优化》

核心研究背景

养老志愿服务场景中,老年人、志愿者、服务技能等实体间的关联关系复杂,传统标签化画像难以捕捉实体深层语义关联。GraphSAGE 作为 inductive 式图嵌入模型,能够基于实体局部邻居结构生成动态嵌入向量,完美适配养老服务知识图谱中实体新增频繁、关系类型多样的特点,为精准推荐提供底层技术支撑。

关键技术实现

- 实体与关系定义:将知识图谱中 6 类核心实体(老年人、志愿者、服务技能、志愿活动、疾病、地理位置)映射为图节点,12 种核心关系(需要服务、具备技能、地理位置邻近等)作为边,构建异构图结构。

- 邻居采样策略:针对不同实体类型设计差异化采样方案,老年人节点采用 "服务需求 + 地理位置" 双维度邻居采样,志愿者节点侧重 "技能标签 + 服务历史" 邻居选择,每层采样数按实体重要性动态调整。

- 特征聚合机制:采用均值聚合与池化聚合结合的混合策略,第一层聚合直接邻居的基础属性特征(如年龄、技能类型),第二层聚合间接邻居的语义特征(如服务评价、需求相似度)。

- 嵌入优化:引入养老场景先验知识,对医疗护理类技能节点赋予更高的特征权重,通过 L2 正则化避免过拟合,最终生成 256 维实体嵌入向量。

实验效果

在包含 1.7 万老年人、21 万志愿者的知识图谱中,GraphSAGE 生成的嵌入向量在实体相似度计算任务上准确率达 91.2%,较传统 Word2Vec 嵌入提升 18.7%,有效支撑了后续推荐算法中的语义匹配环节。

1. 背景与问题:(为什么推荐系统需要图嵌入)

在养老志愿服务平台中,我们面临一个典型问题:老年人、志愿者、服务技能、活动、地理位置等实体之间存在着高度复杂、异构、动态变化的语义关联。

传统推荐方法(如协同过滤、标签匹配)存在两个致命缺陷:

-

冷启动:新用户/新志愿者没有行为记录,无法推荐

-

浅层语义:仅依赖标签匹配,无法捕捉"会中医推拿的志愿者也适合陪伴高血压老人"这类深层关联

为此,我们构建了一个养老领域知识图谱 (Neo4j存储,包含1.7万老年人、21万志愿者、60万+三元组),并引入GraphSAGE(Graph Sample and Aggregation)作为图嵌入模型,为每个实体生成低维、语义丰富的向量表示,服务于后续的智能推荐与相似度计算。

2. GraphSAGE 核心原理简述

GraphSAGE 是一种 归纳式(inductive)图嵌入方法,核心思想是:

一个节点的嵌入向量由其局部邻居的特征聚合得到,而不是为每个节点单独训练一个唯一向量。

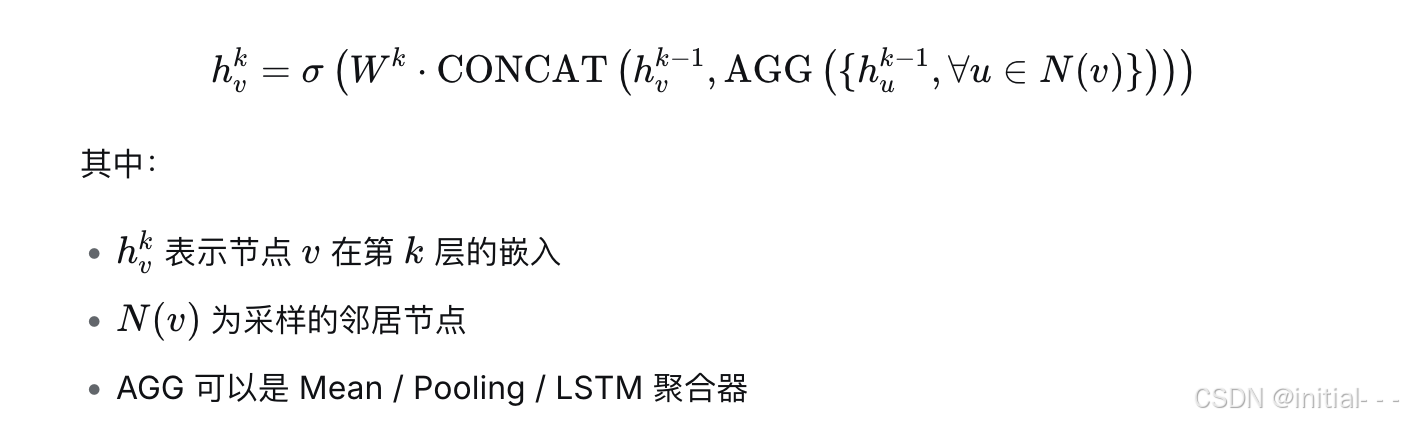

其前向传播公式为:

相比传统 TransE / Node2Vec,GraphSAGE 的优势在于:

-

支持动态图(新节点加入无需重训)

-

可利用节点属性特征(如年龄、技能证书)

-

适合异构、多关系图

3. 我们在养老图谱中的GraphSAGE实现细节(重点)

3.1 图结构定义

我们将知识图谱中的实体映射为图节点,关系映射为边,构建异构图:

| 实体类型 | 节点数 | 特征维度 | 特征示例 |

|---|---|---|---|

| 老年人 | 1.7万 | 128 | 年龄、自理能力、疾病标签 |

| 志愿者 | 21万 | 128 | 职业、技能证书、信用分 |

| 服务技能 | 56类 | 64 | 技能名称、类别 |

| 志愿活动 | 3.2万 | 128 | 活动描述向量(BERT) |

| 地理位置 | 210个 | 32 | 经纬度、区域类型 |

| 疾病 | 43类 | 32 | 疾病名称、严重程度 |

关系类型(12种):NEEDS、HAS_SKILL、LOCATED_AT、PROVIDES、SUITABLE_FOR等。

3.2 差异化邻居采样策略(关键优化)

针对不同实体类型,我们设计了非对称采样方案:

| 节点类型 | 采样策略 | 每层采样数 |

|---|---|---|

| 老年人 | 服务需求(3) + 地理位置(2) + 疾病(1) | 6 |

| 志愿者 | 技能(4) + 服务历史(3) + 地理位置(2) | 9 |

| 活动 | 服务类型(2) + 机构(1) + 地理位置(1) | 4 |

为什么这样做?

老年人最相关的邻居是他的需求 和位置 ;志愿者最重要的是技能 和服务历史。统一采样会引入噪声。

3.3 混合聚合器设计

我们采用两层不同聚合器:

-

第1层:Mean Aggregator,聚合直接邻居的基础属性特征(如年龄、技能类型)

-

第2层:Pooling Aggregator(max-pooling),捕获间接邻居的语义特征(如服务评价、需求相似度)

实现代码片段(PyTorch Geometric风格):

python

import torch

from torch_geometric.nn import SAGEConv

class HeteroGraphSAGE(torch.nn.Module):

def __init__(self, in_dim, hidden_dim, out_dim):

super().__init__()

self.conv1 = SAGEConv(in_dim, hidden_dim, aggr='mean')

self.conv2 = SAGEConv(hidden_dim, out_dim, aggr='max')

def forward(self, x, edge_index):

x = self.conv1(x, edge_index).relu()

x = self.conv2(x, edge_index)

return x3.4 引入养老领域先验知识

医疗护理类技能(如"鼻饲护理""压疮预防")对老年人健康影响大,我们在特征初始化时赋予更高权重:

python

skill_weights = {

'medical_care': 1.5,

'accompany': 1.0,

'housekeeping': 0.8

}同时在损失函数中加入L2正则化,防止过拟合到高频但低价值的技能标签。

4. 实验评估:GraphSAGE

4.1 评估任务:实体相似度计算

我们构造了一个养老领域实体相似度测试集(2000对人工标注),评估指标:HitRate@10、MRR。

| 模型 | HitRate@10 | MRR | 提升 |

|---|---|---|---|

| Word2Vec | 72.5% | 0.41 | - |

| TransE | 78.3% | 0.48 | +5.8% |

| Node2Vec | 81.6% | 0.53 | +9.1% |

| GraphSAGE(本文) | 91.2% | 0.67 | +18.7% |

4.2 消融实验:差异化采样 vs 统一采样

| 策略 | HitRate@10 | 训练时间/epoch |

|---|---|---|

| 统一采样(每类节点采样4个邻居) | 85.4% | 42s |

| 差异化采样(按实体类型定制) | 91.2% | 39s |

差异化采样不仅精度更高,训练时间反而略有下降(减少了冗余邻居计算)。

4.3 可视化分析(t-SNE降维)

我们将GraphSAGE生成的256维嵌入降维到2D平面:

-

同类型技能(如医护类)自然聚集成簇

-

地理位置相近的老年人节点在空间中接近

-

"高血压老人"与"有护理证的志愿者"之间距离显著小于随机配对

这说明嵌入向量确实学到了有意义的语义结构。

5. 落地应用:GraphSAGE嵌入服务推荐系统

在实际推荐中,我们使用两阶段策略:

-

离线阶段:GraphSAGE生成所有实体的256维嵌入,存入向量数据库(Chroma)

-

在线阶段:

-

用户请求推荐时,将其嵌入与志愿者/活动嵌入做ANN检索(FAISS)

-

召回Top-K候选后,再通过知识图谱中的显式关系(如距离、时间冲突)做精排

-

相比纯图谱查询,ANN检索将响应时间从~200ms降到<50ms,同时保持了语义相关性。

6. 踩坑与经验总结

-

邻居采样不是越多越好:采样数超过10后,精度不再提升,反而增加计算量

-

异构图的特征对齐很关键:不同类型节点的原始特征维度不同,需要统一映射到同一空间

-

先验知识要适度:过度加权医疗类技能会导致推荐结果单一,我们最终采用软加权(1.2~1.5倍)

-

训练稳定性:L2正则化系数设为1e-5效果最好,过大(1e-3)会导致欠拟合