### 文章目录

- [@[toc]](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [论文基本信息](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [一句话总结](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [0. 论文概述(Executive Summary)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [1. 问题背景与动机](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [1.1 研究的重要性](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [1.2 现有方法的演进](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [1.3 现存的主要问题](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [2. 相关工作与创新关联](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [2.1 前人工作综述](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**聚合型立体匹配方法**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**迭代型立体匹配方法**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**频率信息应用**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [2.2 存在的问题与不足](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [2.3 本论文与前人工作的关系](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [3. 贡献与核心创新点](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [3.1 核心创新点一:Selective Recurrent Unit (SRU)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

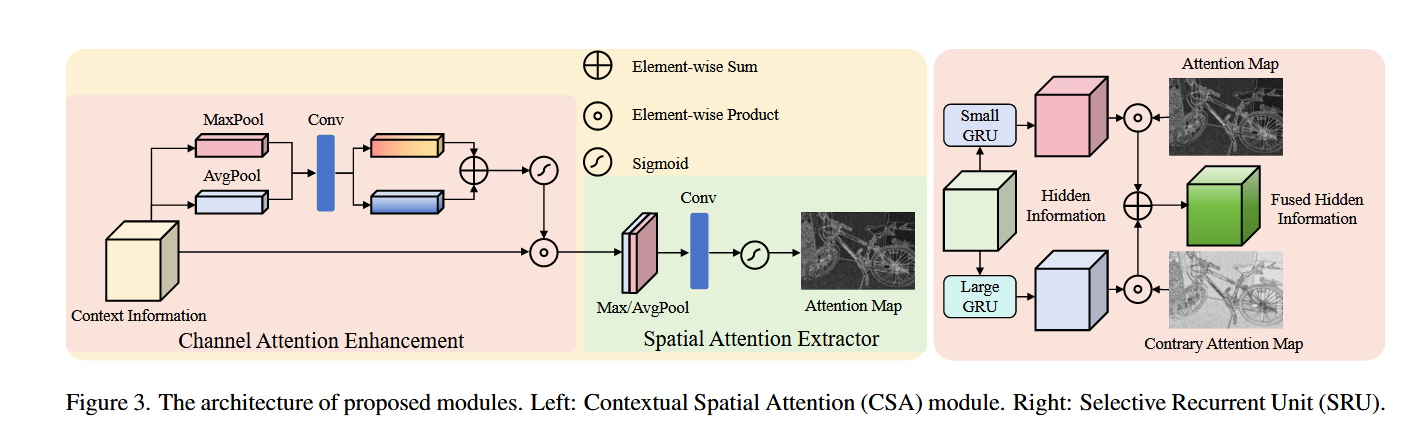

- [3.2 核心创新点二:Contextual Spatial Attention (CSA)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**子模块1:通道注意力增强(Channel Attention Enhancement, CAE)**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**子模块2:空间注意力提取器(Spatial Attention Extractor, SAE)**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [4. 方法与网络设计](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

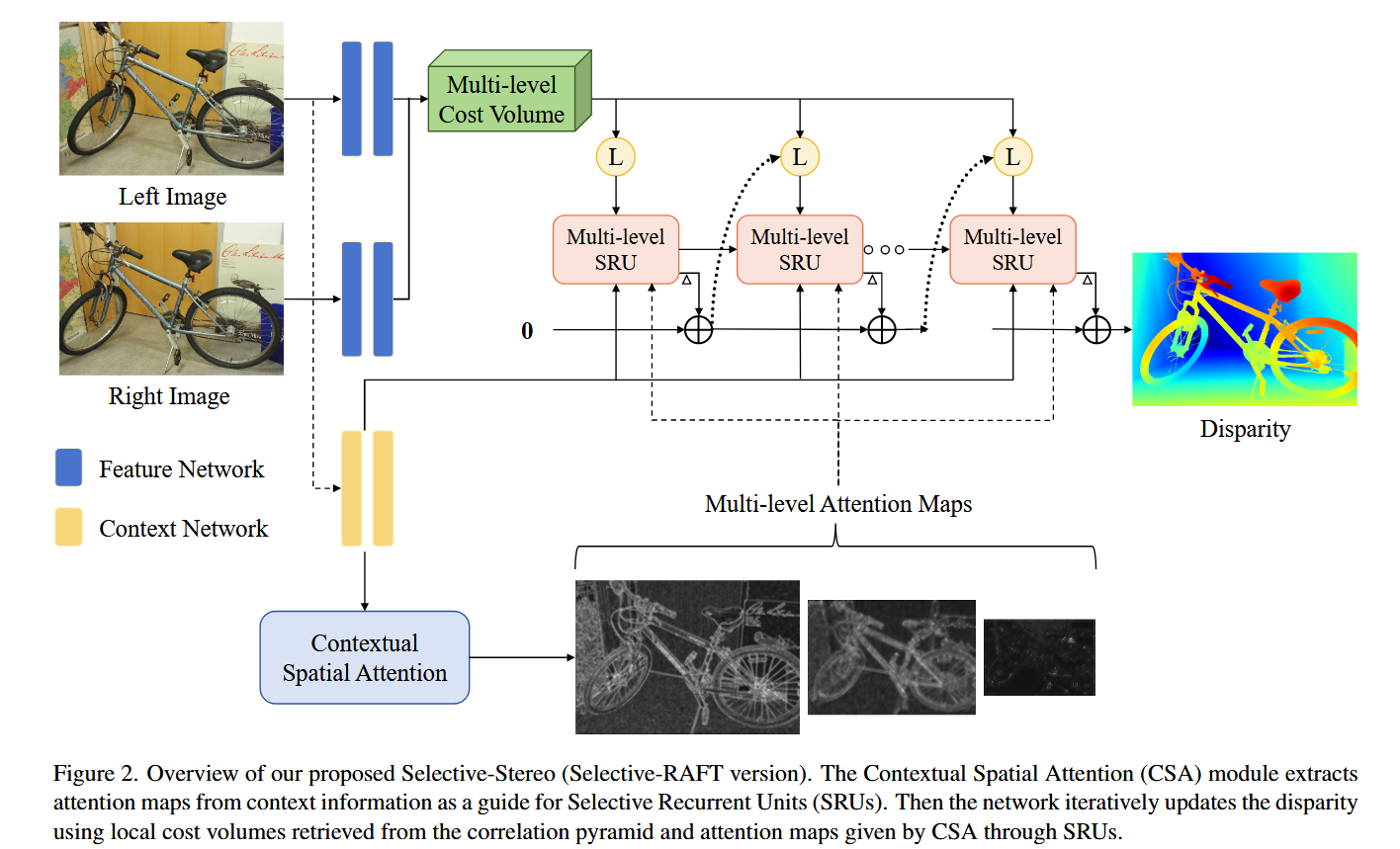

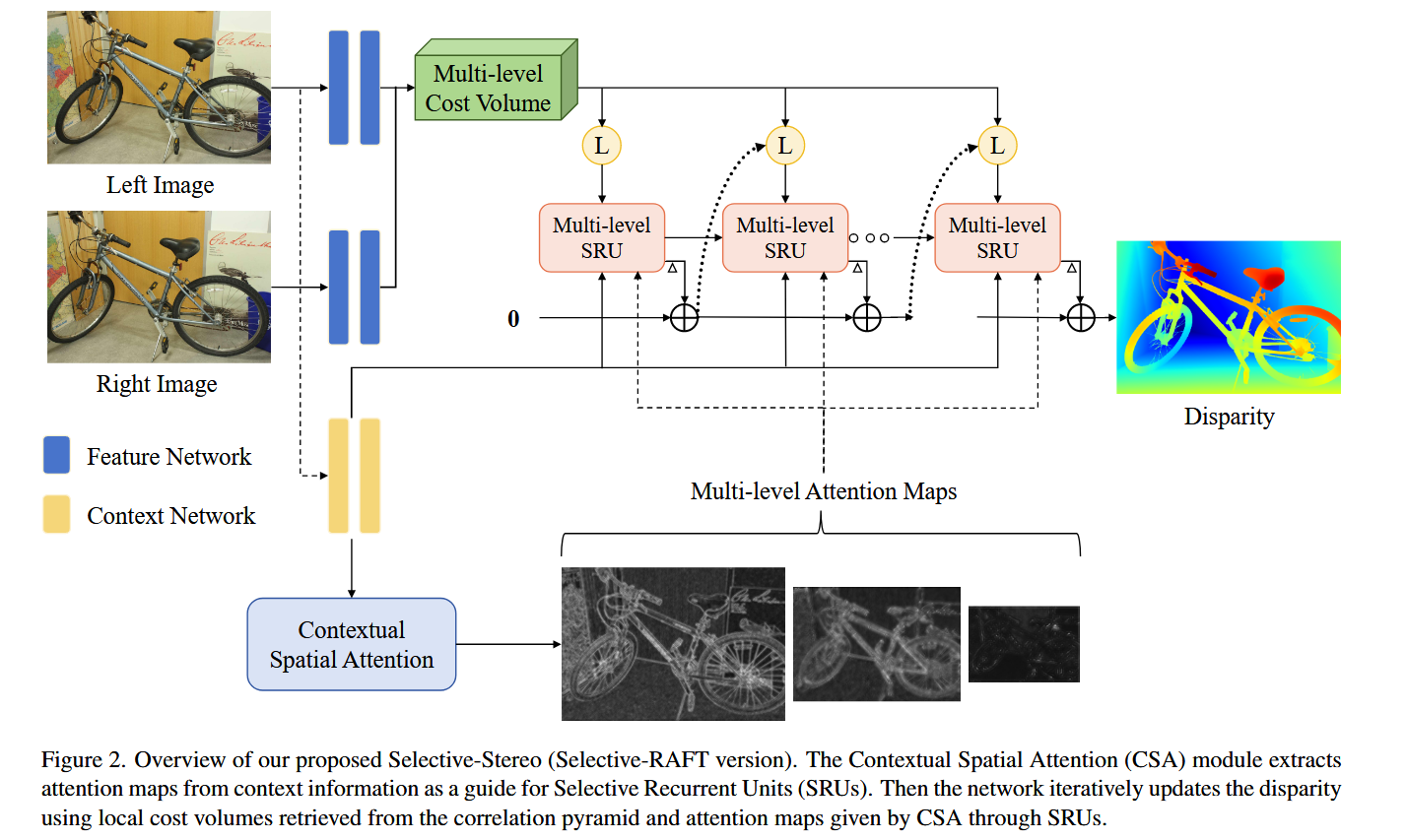

- [4.1 整体网络架构概览](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**4.1.1 网络的多级结构**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**4.1.2 多级结构示意**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**4.1.3 各模块功能概述**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [4.2 网络详细分析](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**4.2.1 特征提取模块详解**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**4.2.2 成本体积构建模块详解**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**4.2.3 Contextual Spatial Attention (CSA) 详解**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**4.2.4 Selective Recurrent Unit (SRU) 详解**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**4.2.5 损失函数与训练策略**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [4.3 核心创新的技术支撑](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [5. 实验结果](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [5.1 数据集与评估指标](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**数据集描述**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**评估指标**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [5.2 消融研究](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.2.1 模块有效性验证**(表1:Scene Flow测试集)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.2.2 通用性验证**(表2)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.2.3 迭代次数的影响**(表3)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.2.4 核大小选择**(表4)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [5.3 性能对比](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.3.1 Scene Flow 基准(表5)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.3.2 边缘 vs 非边缘区域分析**(表7)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.3.3 KITTI 基准排名**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.3.4 ETH3D 和 Middlebury**(表8)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [5.4 定性可视化分析](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.4.1 KITTI 上的视觉对比(图5)**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.4.2 Middlebury 上的定性结果和注意力图**(图7)](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)

- [**5.4.3 不同网络的注意力图差异(图6)**](#文章目录 @[toc] Selective-Stereo: 自适应频率信息选择用于立体匹配 论文总结 论文基本信息 一句话总结 0. 论文概述(Executive Summary) 1. 问题背景与动机 1.1 研究的重要性 1.2 现有方法的演进 1.3 现存的主要问题 2. 相关工作与创新关联 2.1 前人工作综述 聚合型立体匹配方法 迭代型立体匹配方法 频率信息应用 2.2 存在的问题与不足 2.3 本论文与前人工作的关系 3. 贡献与核心创新点 3.1 核心创新点一:Selective Recurrent Unit (SRU) 3.2 核心创新点二:Contextual Spatial Attention (CSA) 子模块1:通道注意力增强(Channel Attention Enhancement, CAE) 子模块2:空间注意力提取器(Spatial Attention Extractor, SAE) 4. 方法与网络设计 4.1 整体网络架构概览 4.1.1 网络的多级结构 4.1.2 多级结构示意 4.1.3 各模块功能概述 4.2 网络详细分析 4.2.1 特征提取模块详解 4.2.2 成本体积构建模块详解 4.2.3 Contextual Spatial Attention (CSA) 详解 4.2.4 Selective Recurrent Unit (SRU) 详解 4.2.5 损失函数与训练策略 4.3 核心创新的技术支撑 5. 实验结果 5.1 数据集与评估指标 数据集描述 评估指标 5.2 消融研究 5.2.1 模块有效性验证(表1:Scene Flow测试集) 5.2.2 通用性验证(表2) 5.2.3 迭代次数的影响(表3) 5.2.4 核大小选择(表4) 5.3 性能对比 **5.3.1 Scene Flow 基准(表5) 5.3.2 边缘 vs 非边缘区域分析(表7) 5.3.3 KITTI 基准排名 5.3.4 ETH3D 和 Middlebury(表8) 5.4 定性可视化分析 5.4.1 KITTI 上的视觉对比(图5) 5.4.2 Middlebury 上的定性结果和注意力图(图7) 5.4.3 不同网络的注意力图差异(图6) 5.5 反射区域(病态区域)的性能(表9:补充材料) 6. 不足之处与未来工作 6.1 现有限制 6.2 未来研究方向 7. 总体评价 7.1 研究价值 7.2 核心贡献总结 7.3 方法的优势 7.4 方法的劣势 7.5 研究的深远意义 附录:关键公式速查表 参考资源 讨论 一、CSA(上下文空间注意力模块) 🔷 子模块 1:通道注意力增强(CAE) 🔷 子模块 2:空间注意力提取器(SAE) 二、SRU(选择性循环单元) 🔶 标准 GRU 回顾 🔶 SRU 的核心改造 🔶 多级 SRU 结构 三、整体数据流总结 四、关键设计洞见 你的质疑是对的:Pool 本身不能判断频率 真正的推理链:从上下文特征到频率判断 第一步:上下文特征(Context Feature)天然编码了频率信息 第二步:CAE 做的是通道级别的"筛选放大" 第三步:SAE 做的是空间级别的"位置定位" 用一个直觉类比来理解 论文的直接原话印证 消融实验的间接证明 总结 SRU vs CREStereo RUM:基于原文的精准对比 先厘清"多个GRU"在各自框架里的真实含义 一、RUM 的"多GRU":级联粗到精 二、SRU 的"多GRU":单级内部的频率并行 三、成本体积的计算方式:另一个核心差异 四、设计动机的根本不同 五、一句话总结)