引言:硬件碎片化与算力孤岛的挑战

在构建企业级 AI 视频监控系统时,架构师面临的最大技术难题往往不是算法本身,而是"硬件环境的极度碎片化"。现实场景中,客户现场可能同时存在基于 x86 架构的中心服务器、基于 ARM 架构的边缘计算盒子(如基于 1684X 芯片的设备),以及种类繁多的 GPU/NPU 算力卡。传统的监控软件通常绑定特定的硬件指令集或特定厂商的 SDK,导致在混合部署环境下,不得不部署多套独立系统,形成"算力孤岛"。这不仅增加了运维成本,更让企业级应用的开发与适配周期变得漫长且不可控。

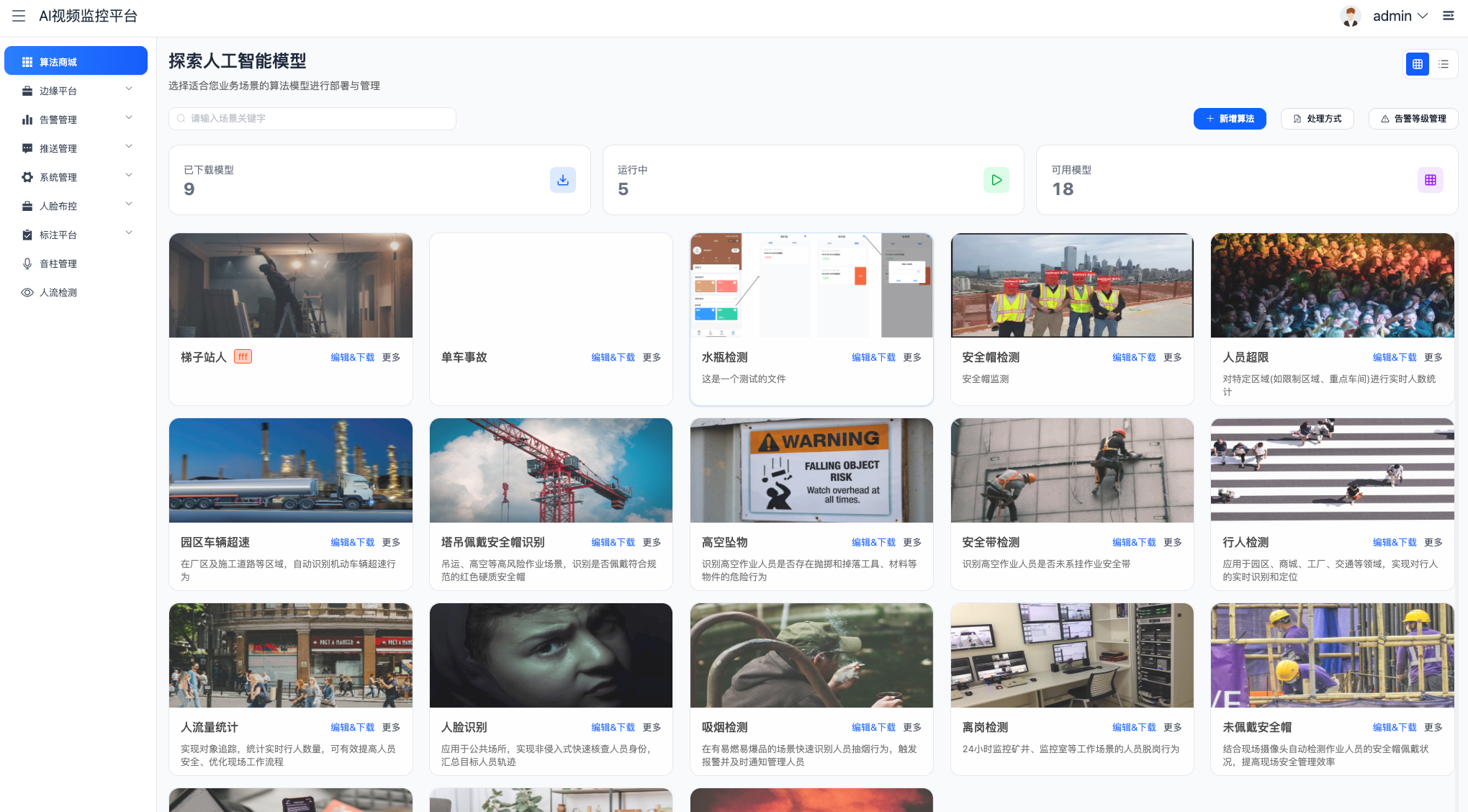

如何构建一套"一次开发,处处运行"且能统一调度异构算力的底座?YiheCode Server 给出的答案是"软硬解耦 + 边缘协同"。这不仅仅是一个基于 Spring Boot 2.7 + Vue 2.6 开发的开源平台,更是一个深度集成 ZLMediaKit 流媒体服务器与 MinIO 对象存储的异构计算中枢。本文将深入解析其如何通过微服务架构与边缘计算技术,打通 x86/ARM 与 GPU/NPU 的壁垒,帮助企业削减约 95% 的硬件适配与环境搭建成本。

一、 异构部署架构:从硬件绑定到指令集解耦

YiheCode Server 的核心设计理念在于**"跨平台兼容性"**。根据 Gitee 仓库文档,项目不仅支持 Java 的跨平台特性,更在底层服务上做了深度优化,以适应多样化的硬件环境。

1.1 全栈硬件适配矩阵

平台构建了一套覆盖"端-边-云"的硬件适配体系,能够适应从老旧的 x86 服务器到最新的 ARM 边缘盒子的各类场景:

| 层级 | 硬件类型 | 指令集/架构 | 技术实现优势 |

|---|---|---|---|

| 云端/中心 | GPU 服务器 | x86_64 | 支持主流 NVIDIA GPU,适合大规模并发推理与视频转码 |

| 边缘端 | NPU 边缘盒子 | ARM / RISC-V | 支持如 1684X 等国产芯片,低功耗运行轻量级算法 |

| 存储层 | 分布式存储 | x86 / ARM | 基于 MinIO 实现,支持多节点横向扩展,兼容对象存储协议 |

| 网关层 | 通用服务器 | x86 / ARM | 运行 ZLMediaKit 流媒体服务,自动适应不同 CPU 指令集 |

1.2 Docker 容器化与环境隔离

为了确保在不同硬件环境下的部署一致性,项目强制要求使用 Docker 与 Docker-Compose 进行部署。这种容器化架构将复杂的依赖库(如 FFmpeg、OpenCV)封装在镜像内部,彻底解决了"在我机器上能跑"的环境依赖问题。

部署架构逻辑:

- 镜像构建:基于 Alpine Linux 等轻量级基础镜像,减少攻击面与体积。

- 硬件透传:在支持 GPU 的服务器上,通过 Docker 参数透传 CUDA 或特定 NPU 驱动,使容器内的推理引擎能直接调用硬件算力。

二、 深度技术解析:边缘协同与流媒体调度

2.1 边缘-中心协同架构 (Edge-Cloud Collaboration)

Gitee 仓库文档详细描述了"盒子/服务器组"与"AI 平台"之间的交互逻辑。这是一种典型的边缘计算架构 ,旨在解决带宽浪费与延迟问题。

核心协同流程:

- 任务下发:中心服务器(Spring Boot 后端)通过 HTTP/WebSocket 下发算法任务与参数配置。

- 边缘执行:边缘盒子(ARM 设备)负责实时取流、解码与 AI 推理。

- 结果上报:仅当发生告警(如烟火、跌倒)时,边缘盒子才将截图或视频片段回传至中心,极大节省了带宽。

边缘通信协议模拟 (Socket):

python

# 伪代码:边缘盒子与中心服务器的 Socket 交互

def edge_box_heartbeat():

while True:

# 1. 每分钟上报一次心跳

heartbeat_data = {

"device_id": "ARM_BOX_001",

"status": "online",

"cpu_usage": get_cpu_usage(),

"memory_usage": get_memory_usage(),

"algorithm_list": ["smoke_detect", "person_track"] # 当前运行算法

}

center_server.send(heartbeat_data)

# 2. 监听中心指令 (如参数更新、算法升级)

command = center_server.listen()

if command.type == "UPDATE_PARAM":

update_algorithm_param(command.params)

elif command.type == "START_ALGO":

start_inference(command.algorithm_model)

time.sleep(60) # 1分钟读取一次2.2 智能流媒体调度策略

文档中提到的"录像控制程序"逻辑展示了系统如何精细化管理边缘与中心的资源:

- 按需拉流策略 (Lazy Pull) :

- 手动新增摄像头:录像控制程序定时(5分钟)判断是否需要录制。如果需要,且未拉流,则主动拉流并录制。

- 国标流/算法流 :对于国标流,系统不会 主动拉流(避免冗余带宽占用),而是由"算法启动"时主动触发拉流。这体现了架构的高效性------算力与流媒体的联动。

流媒体调度逻辑(伪代码):

java

// Java 逻辑:录像控制定时任务 (参考文档中的 5分钟/3分钟策略)

@Scheduled(fixedRate = 300000) // 5分钟

public void recordControlTask() {

for (Camera camera : cameraService.getAllCameras()) {

boolean needRecord = scheduleService.isInRecordTime(camera);

if (needRecord) {

// 如果是 RTSP 手动流,主动保活

if (camera.getProtocol().equals("RTSP") && !zlm.isStreaming(camera.getStreamId())) {

zlm.startPull(camera.getSourceUrl());

}

// 如果是国标流,仅标记状态,等待算法触发拉流

// 避免中心服务器与边缘设备同时拉流造成带宽浪费

} else {

// 资源回收

zlm.stopPullIfIdle(camera.getStreamId());

}

}

}三、 存储架构与异构算力管理

3.1 分布式对象存储 (MinIO)

为了解决海量视频与告警图片的存储问题,系统采用了 MinIO。这不仅解决了传统文件系统在海量小文件(告警截图)下的性能瓶颈,更实现了存储与计算的解耦。

- 存储逻辑 :

- 边缘盒子或中心服务器检测到告警 -> 上传文件到 MinIO -> 数据库记录文件 URL。

- 自动清理策略:系统支持设置告警图片存储时长(默认一天),每天 24:00 自动清除过期图片,节省磁盘空间。

3.2 异构算力编排

平台支持添加客户自己训练的模型,这意味着它必须兼容不同的推理引擎(如 TensorRT, ONNX Runtime, OpenVINO)。

算力抽象层设计:

- 统一接口 :无论底层是 NVIDIA GPU 还是 国产 NPU,上层业务逻辑调用的都是统一的

InferenceService接口。 - 动态加载:支持多路多算法的实时 AI 计算,系统会根据设备负载自动分配计算任务,实现 x86 与 ARM 节点的负载均衡。

四、 总结

YiheCode Server 通过容器化部署 与边缘协同架构 ,成功构建了一个硬件无关 的 AI 视频接入底座。

对于技术决策者而言,这套系统最大的价值在于:它将"适配 10 种不同硬件环境"的复杂性,转化为"编写 1 套标准 Docker 配置"的简单性。无论是 x86 的中心机房,还是 ARM 的边缘现场,亦或是混合部署的复杂网络,都能通过这套系统实现统一调度。这种"万能底座"的架构,正是实现"减少 95% 开发成本"并快速响应客户现场复杂硬件环境的核心竞争力。

架构师建议 :

在部署异构环境时,建议将 ZLMediaKit 流媒体节点部署在靠近摄像头的边缘网络(ARM 设备),而将 Spring Boot 业务中心部署在云端或内网服务器(x86),通过这种"边缘拉流、中心管控"的模式,可以最大化利用带宽并降低中心服务器的解码压力。